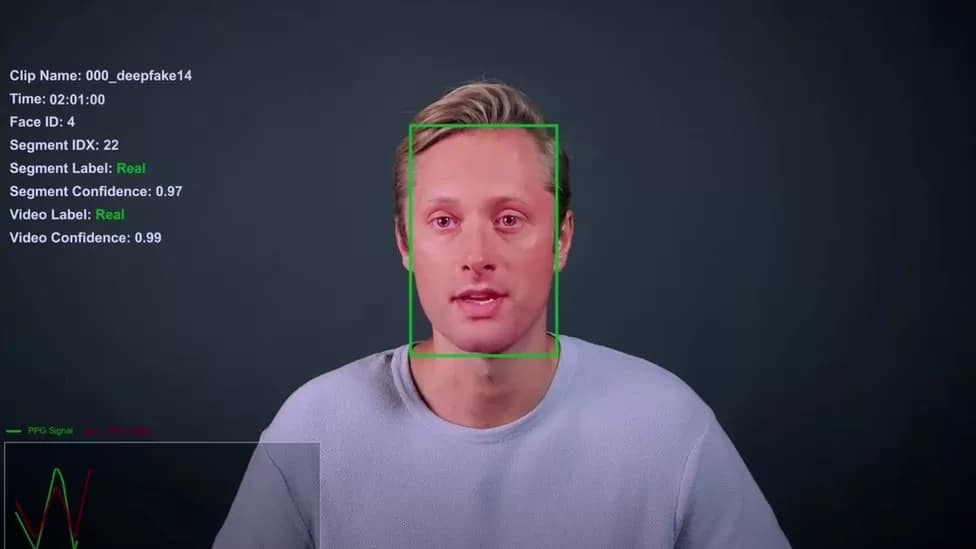

Intel ha sviluppato un sistema chiamato “FakeCatcher” che utilizza l’IA per rilevare i deepfake. Il sistema si basa sulla rilevazione del flusso sanguigno e del movimento degli occhi, due caratteristiche che i deepfake non riescono a replicare in modo convincente.

Cosa leggere

Come funziona FakeCatcher

Il sistema utilizza una tecnica chiamata fotopletismografia (PPG) per rilevare i cambiamenti nel flusso sanguigno. Le facce create dai deepfake non emettono questi segnali, spiega Ilke Demir, ricercatrice presso Intel Labs. Il sistema analizza anche il movimento degli occhi per verificare l’autenticità di un video.

L’efficacia di FakeCatcher

Intel sostiene che FakeCatcher sia in grado di distinguere un video reale da un falso in pochi secondi con una precisione del 96%. Tuttavia, il sistema ha mostrato qualche difficoltà nel rilevare video autentici, soprattutto se la qualità del video è bassa o pixelata, rendendo difficile rilevare il flusso sanguigno.

Le limitazioni di FakeCatcher

Un’altra limitazione di FakeCatcher è che non analizza l’audio. Pertanto, alcuni video che sembrano ovviamente reali ascoltando la voce sono stati classificati come falsi. Inoltre, se il programma indica che un video è falso quando è autentico, potrebbe causare problemi reali.

L’importanza della verifica indipendente

Gli esperti di deepfake, come Matt Groh, assistente professore alla Northwestern University in Illinois, ritengono che sia importante che il sistema venga analizzato in modo indipendente. Non pensano che sia sufficiente che Intel si autovaluti.

Il futuro di FakeCatcher

Nonostante le limitazioni, la tecnologia di FakeCatcher ha un grande potenziale. Tuttavia, dai test limitati, sembra che ci sia ancora un po’ di strada da fare prima che sia pronto per un uso diffuso.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.