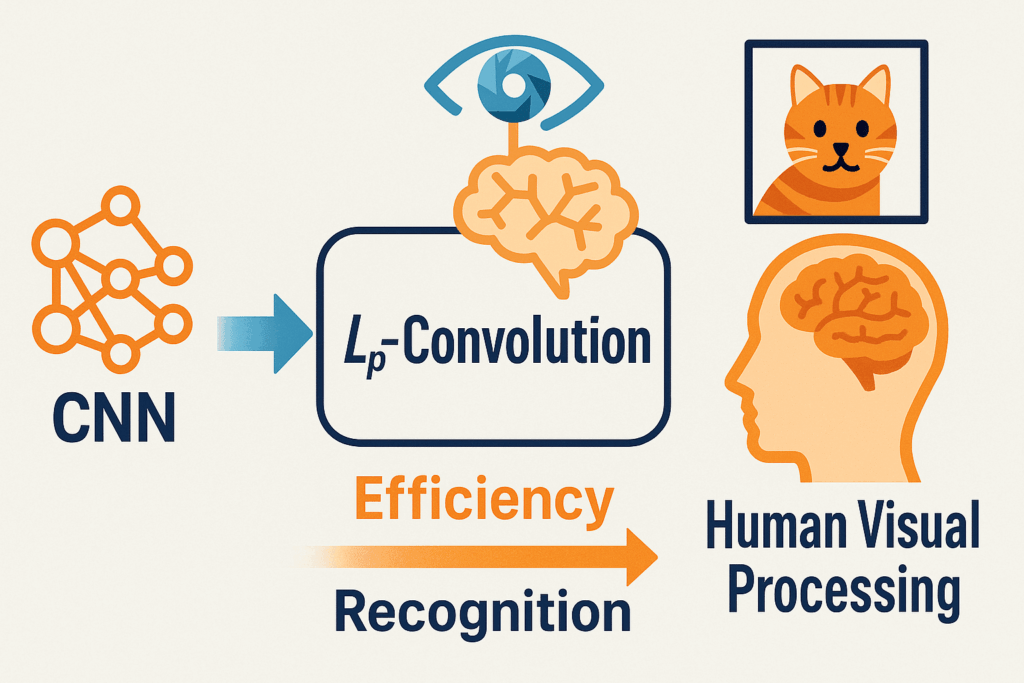

Un team di ricerca congiunto dell’Istituto per le scienze di base (IBS), dell’Università Yonsei e del Max Planck Institute ha sviluppato una nuova tecnica di intelligenza artificiale chiamata Lp-Convolution, capace di colmare il divario tra i modelli neurali convoluzionali (CNN) e il modo in cui il cervello umano processa le immagini. La tecnica offre una soluzione al problema dell’efficienza computazionale nei sistemi di visione artificiale, mantenendo elevata la precisione nei compiti di riconoscimento.

Cosa leggere

Il cervello come modello: le CNN non bastano, i transformer sono troppo pesanti

Le classiche CNN utilizzano filtri quadrati di dimensioni fisse per estrarre caratteristiche da immagini, ma questa rigidità limita la capacità di individuare schemi complessi. I più recenti vision transformer (ViT) offrono prestazioni superiori analizzando intere immagini contemporaneamente, ma richiedono risorse enormi e grandi set di dati, rendendoli inadatti a molte applicazioni reali.

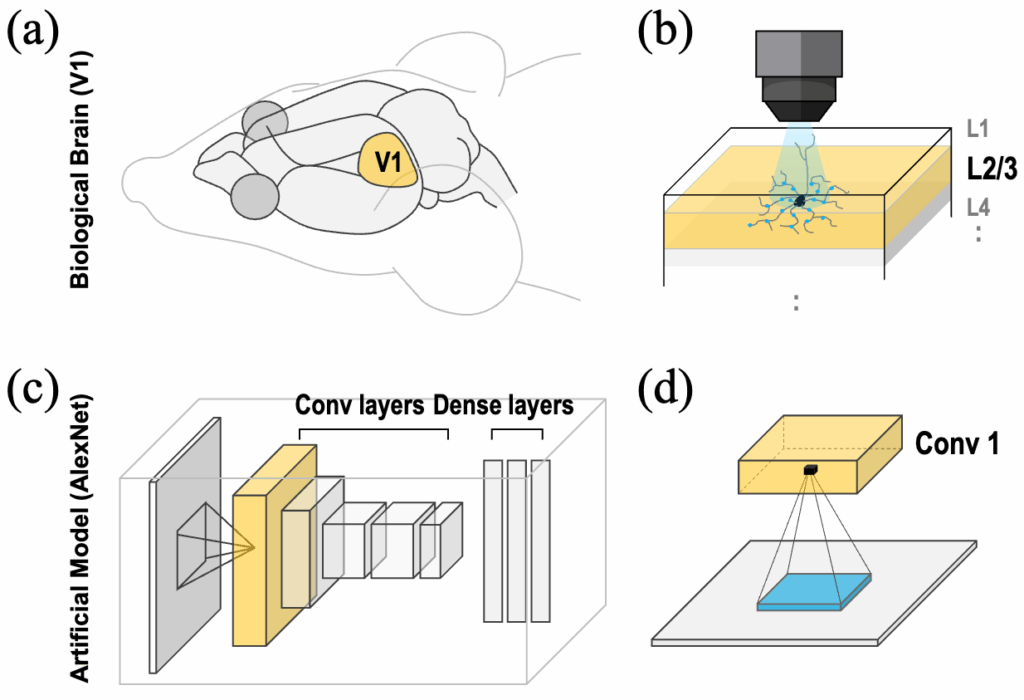

Ispirandosi all’efficienza della corteccia visiva umana, che utilizza connessioni circolari sparse per concentrarsi selettivamente su dettagli rilevanti, i ricercatori hanno ideato una soluzione ibrida. La domanda centrale è stata: può un approccio biologicamente ispirato rendere le CNN più efficienti e al tempo stesso potenti?

Lp-Convolution: forma adattiva dei filtri e modello ispirato al cervello

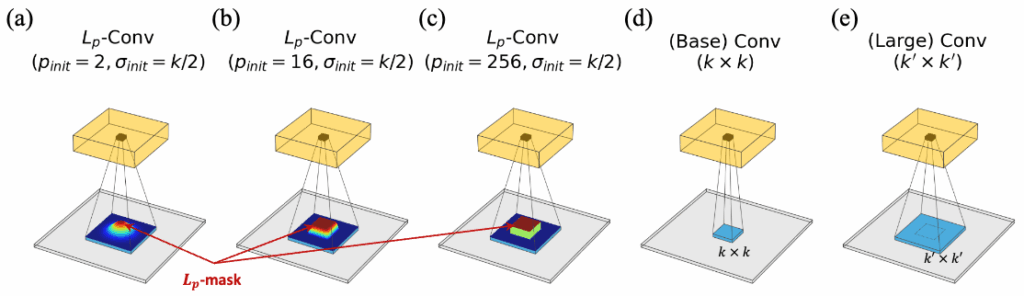

La risposta arriva con Lp-Convolution, una tecnica che applica la distribuzione normale p-generalizzata multivariata (MPND) per trasformare dinamicamente la forma dei filtri convoluzionali. A differenza dei filtri fissi, questi si adattano orizzontalmente o verticalmente in base al compito, mimando il comportamento selettivo dei neuroni nella corteccia visiva.

Questa soluzione risolve il noto problema dei kernel di grandi dimensioni, in cui l’aumento della dimensione del filtro non migliora necessariamente le prestazioni. Lp-Convolution evita l’aggiunta inutile di parametri grazie a una connettività flessibile, allineata alle strutture biologiche.

Prestazioni superiori e robustezza contro i dati corrotti

I test condotti su dataset standard per la classificazione di immagini (CIFAR-100, TinyImageNet) mostrano che Lp-Convolution migliora la precisione sia nei modelli storici come AlexNet, sia in architetture moderne come RepLKNet. Oltre a un netto incremento delle prestazioni, i modelli risultano più resistenti ai dati corrotti, un aspetto cruciale per l’uso reale in ambienti non controllati.

Un ulteriore aspetto rilevante emerge dall’analisi del comportamento interno dei modelli: quando le maschere Lp assumono una forma simile a una distribuzione gaussiana, i pattern neurali generati mostrano un’elevata somiglianza con quelli del cervello dei roditori, verificata tramite confronti con dati neurobiologici.

Applicazioni future: medicina, robotica e guida autonoma

Secondo il direttore del centro per la cognizione e la socialità presso l’IBS, C. Justin Lee, il metodo permette all’AI di “concentrarsi sulle parti più importanti di un’immagine proprio come fa il cervello umano”. Le potenziali applicazioni includono:

- guida autonoma, per il riconoscimento istantaneo di ostacoli

- diagnostica per immagini, con AI in grado di rilevare dettagli clinicamente rilevanti

- robotica, grazie a una visione artificiale più flessibile in ambienti dinamici

A differenza delle soluzioni precedenti, che si affidavano a filtri piccoli e rigidi o a transformer troppo costosi da implementare, Lp-Convolution si propone come alternativa pratica, scalabile e biologicamente coerente.

Prospettive: oltre la visione, verso il ragionamento spaziale e il problem solving

Il team prevede di estendere Lp-Convolution ad altri domini, tra cui la risoluzione di puzzle complessi e l’elaborazione di immagini in tempo reale. L’obiettivo a lungo termine è creare **modelli di intelligenza artificiale in grado di replicare non solo la percezione, ma anche la capacità di ragionamento attraverso strutture neurali più fedeli a quelle biologiche.

Il lavoro sarà presentato alla International Conference on Learning Representations (ICLR) 2025, e il codice è già disponibile pubblicamente su GitHub: https://github.com/jeakwon/lpconv/

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.