Meta potenzia l’infrastruttura AI con hardware affidabile e calcestruzzo a basso impatto, mentre ChatGPT raggiunge 2,5 miliardi di richieste giornaliere e Gemini 2.5 Flash Lite debutta come modello rapido ed efficiente. Meta sviluppa sistemi per garantire uptime di server AI, utilizzando test rigorosi e riparazioni automatizzate. Parallelamente, adotta calcestruzzo a basse emissioni per data center, riducendo l’impronta di carbonio. ChatGPT di OpenAI cresce con 500 milioni di utenti settimanali a marzo 2025, sfidando Google con un browser AI. Gemini 2.5 Flash Lite di Google offre prestazioni ottimizzate per task leggeri, con latenza ridotta e costi inferiori. Questi sviluppi riflettono la competizione nell’AI. Meta investe in resilienza hardware, con rilevamento guasti in tempo reale. Il calcestruzzo innovativo cura in giorni, non settimane. ChatGPT introduce l’Agent per task locali. Gemini eccelle in velocità per applicazioni mobili. Le aziende rispondono a esigenze di scalabilità, sostenibilità e performance. Gli utenti beneficiano di servizi AI più robusti e accessibili.

Cosa leggere

Affidabilità hardware AI di Meta

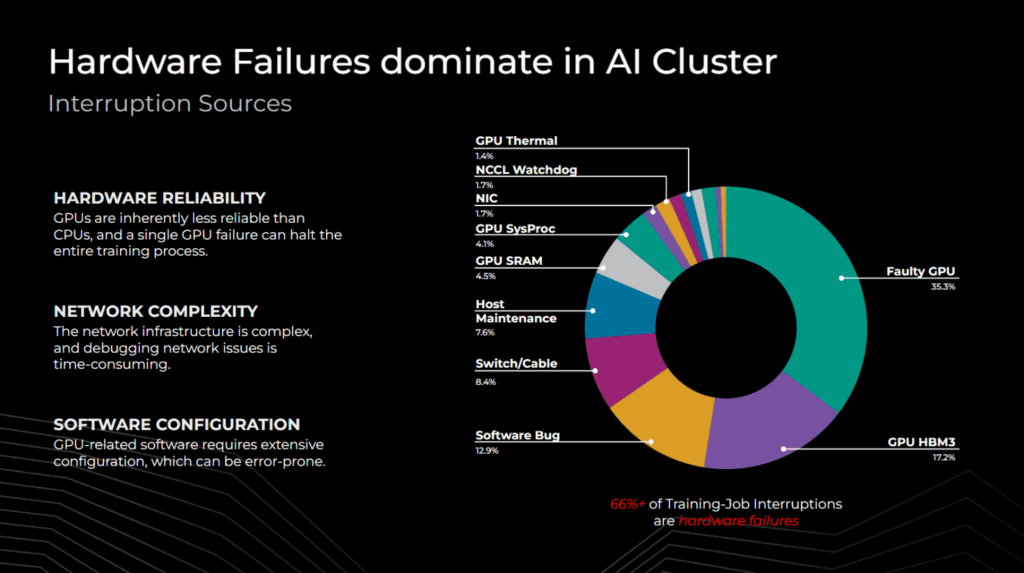

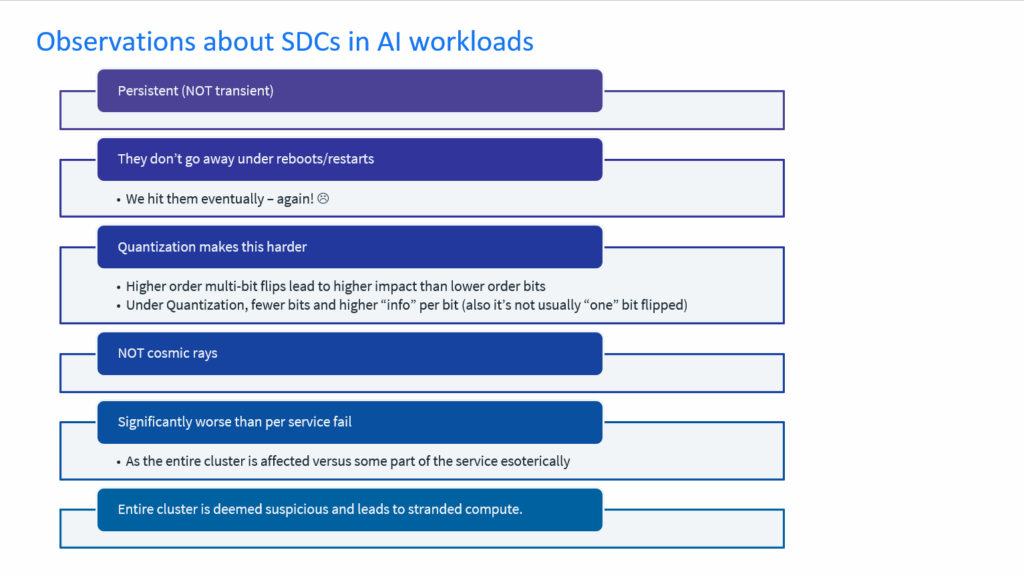

Meta garantisce l’affidabilità dei server AI con processi avanzati. I data center gestiscono carichi di lavoro intensi per modelli come Llama. L’infrastruttura include migliaia di GPU NVIDIA H100. Meta esegue test di stress sull’hardware e simula guasti per identificare debolezze. Sensori monitorano temperatura, voltaggio e vibrazioni, mentre algoritmi AI prevedono i guasti in anticipo. Il sistema rileva anomalie in millisecondi e automatizza le riparazioni con robot, riducendo l’intervento umano ai soli casi complessi.

Meta sviluppa chip custom MTIA per inferenza, capaci di ridurre la latenza del 20%. L’infrastruttura usa machine learning per ottimizzare il raffreddamento dinamico, riducendo il consumo energetico del 15%. I data center adottano liquid cooling per gestire la densità termica delle GPU. I componenti vengono testati in camere climatiche che simulano ambienti estremi per garantire robustezza e longevità. Ogni server è tracciato tramite database centralizzati. Meta investe 65 miliardi di euro nel 2025 per potenziare i data center Prometheus e Hyperion, che raggiungono i 5 gigawatt. L’obiettivo è garantire un uptime del 99,99%.

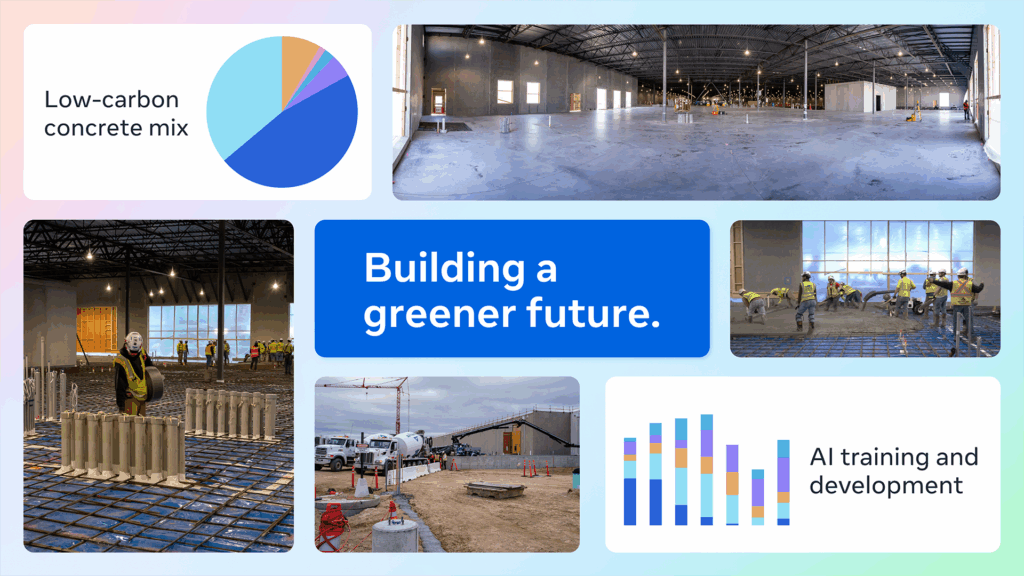

Calcestruzzo sostenibile per data center

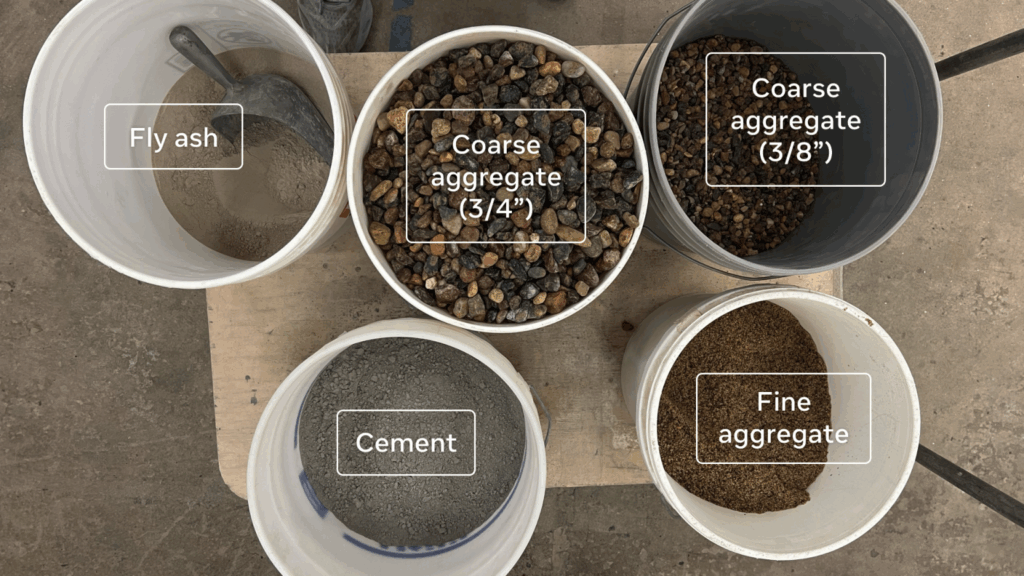

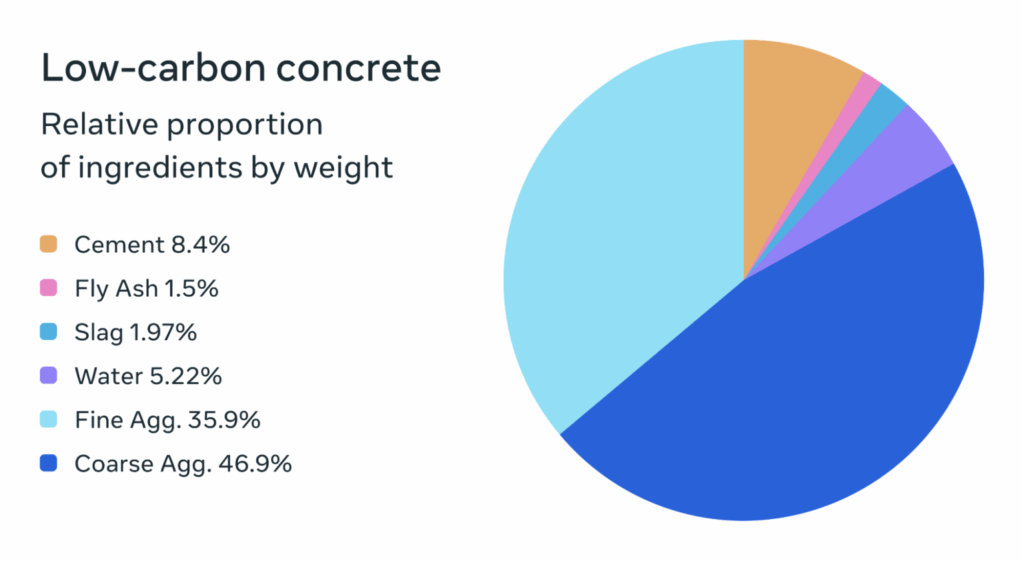

Meta innova con una miscela di calcestruzzo a basse emissioni che riduce dell’8% la CO₂ rispetto agli standard industriali. Il nuovo materiale impiega ceneri volanti, scorie d’altoforno e riduce del 30% l’uso di cemento Portland. La miscela cura in 3 giorni, accelerando i tempi di costruzione rispetto ai 28 giorni tradizionali. Applicata al data center di Richland Parish, copre una superficie di 4 milioni di piedi quadrati e consente un risparmio stimato di 10.000 tonnellate di CO₂.

La struttura integra sensori IoT per il monitoraggio in tempo reale delle crepe e delle sollecitazioni, abilitando una manutenzione predittiva. I dati raccolti alimentano algoritmi predittivi per la gestione del ciclo di vita delle strutture. La formula è stata rilasciata in open-source per permettere ad altri attori del settore di adottarla.

La sostenibilità si affianca all’efficienza: le forniture avvengono tramite supply chain locali, riducendo i costi logistici e accelerando i progetti edilizi. Meta si pone l’obiettivo di raggiungere emissioni nette zero entro il 2030.

Dettaglio tecnico: MTIA chip di Meta

Il chip MTIA di Meta migliora l’inferenza AI grazie a una larghezza di banda doppia rispetto alla generazione precedente. L’architettura custom include 128 core, opera a 1,2 GHz e consuma 50W in meno rispetto a GPU standard. Supporta INT8 e FP16, adattandosi a compiti di ranking e raccomandazione. La memoria on-chip consente la gestione efficiente di dataset massivi. MTIA si integra nativamente con Llama e gli sviluppatori lo utilizzano con PyTorch, ottimizzando i modelli per throughput e costi. Le performance contribuiscono a ridurre i costi operativi del 30%, e il chip è già operativo in diversi data center di Meta.

Crescita esplosiva di ChatGPT

ChatGPT gestisce 2,5 miliardi di richieste al giorno e ha superato i 500 milioni di utenti settimanali a marzo 2025. Rispetto ai 300 milioni di dicembre 2024, la crescita è vertiginosa. L’adozione di AI per compiti quotidiani si espande. ChatGPT evolve da semplice chatbot a assistente operativo, grazie all’introduzione dell’Agent, capace di gestire file, email, e comandi su desktop. OpenAI prepara anche un browser AI, in diretta concorrenza con Google Chrome, integrando funzionalità di ricerca e risposta avanzata. La latenza media si riduce a 200 millisecondi, mentre l’app mobile cresce del 40% in termini di download. L’infrastruttura si basa su Azure in collaborazione con Microsoft. Il sistema supporta 50 lingue, con traduzione in tempo reale migliorata. OpenAI si muove con attenzione al rispetto del GDPR, adottando crittografia end-to-end per le interazioni utente e puntando sull’affidabilità. Il software viene utilizzato anche in contesti aziendali per automatizzare workflow complessi.

Gemini 2.5 Flash Lite: velocità ed efficienza

Google lancia il nuovo modello Gemini 2.5 Flash Lite, progettato per task leggeri e ottimizzato per applicazioni mobili. Il modello riduce la latenza del 30% rispetto a Gemini 1.5 e garantisce risposte in meno di 100 millisecondi. Utilizza meno risorse computazionali ed è ideale per dispositivi low-power, come smartphone e IoT. Gli sviluppatori possono integrarlo facilmente tramite API Google Cloud. Il modello è multimodale, capace di gestire input testuali e visivi. Supporta 40 lingue, si adatta a diversi casi d’uso e consente personalizzazioni. Google testa il modello su Pixel 10, con risultati superiori alla concorrenza. Le performance si fondano su infrastruttura TPU v5, con un risparmio energetico del 15%. L’offerta include un tier gratuito per testing rivolto a startup e sviluppatori. Gemini 2.5 Flash Lite si afferma come scelta ideale per chi cerca velocità, efficienza e scalabilità nel deployment di servizi AI.

Competizione AI e sostenibilità

Meta, OpenAI e Google competono sull’asse AI-sostenibilità. Meta punta su hardware custom e materiali green, OpenAI scala su numeri utente e servizi enterprise, mentre Google si concentra su ottimizzazione mobile e cloud API. L’UE impone criteri di trasparenza e sicurezza che tutte le aziende cercano di rispettare. Meta rende open-source Llama, OpenAI rafforza la protezione dei dati, e Google integra Gemini nei suoi ecosistemi. Le iniziative green sono fondamentali: Meta utilizza raffreddamento a liquido, Google potenzia TPU ad alta efficienza, e OpenAI migliora il footprint su Azure. L’attenzione a cybersecurity, privacy e trasparenza si unisce all’obiettivo di contenere il consumo energetico, che entro il 2030 potrebbe rappresentare il 20% del totale statunitense. L’industria AI investe in sicurezza e compliance, mentre assume talenti e collabora con università per innovare.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.