Cisa e Cert-Agid introducono nel terzo trimestre del 2025 due documenti strategici destinati a ridefinire la gestione della cybersecurity nelle infrastrutture critiche italiane ed europee. Da un lato, Cisa elabora principi avanzati per integrare intelligenza artificiale in domini OT (Operational Technology), dove la combinazione tra modelli predittivi, automazione e processi fisici può aumentare drasticamente efficienza e manutenzione, ma anche amplificare vulnerabilità, drift dei modelli e rischi di sicurezza funzionale. Dall’altro, Cert-Agid pubblica una guida operativa sulla conduzione corretta delle simulazioni di phishing, indicando elementi chiave per evitare che queste esercitazioni vengano scambiate per minacce reali o inserite in blacklist da organismi nazionali, con conseguenze operative impreviste. Questi documenti rappresentano un passo decisivo nell’equilibrio tra innovazione tecnologica, governance e protezione dei sistemi industriali, soprattutto in un momento storico in cui l’AI permea pipeline di automazione e le simulazioni di phishing diventano strumenti essenziali per la formazione del personale.

Cosa leggere

Principi per comprendere l’AI in OT

Cisa evidenzia che l’adozione dell’AI in OT introduce rischi unici e profondi, derivanti da modelli che imparano da dati distribuiti e talvolta rumorosi, con possibili manipolazioni, avvelenamenti, e output errati capaci di alterare comportamenti fisici di impianti industriali. L’agenzia sottolinea come la scarsa qualità dei dati raccolti in impianti complessi riduca l’affidabilità dei modelli, portando a fenomeni di drift che, nel tempo, compromettano diagnosi, manutenzione e sicurezza operativa. L’assenza di explainability rende più difficile comprendere il motivo degli errori, aumentando i tempi di ripristino e generando un pericoloso overload cognitivo sugli operatori, spesso travolti da allarmi errati o fuorvianti.

Cisa mette inoltre in guardia da rischi di perdita competenze: l’eccessiva dipendenza dai sistemi predittivi provoca erosione delle capacità manuali, alterando la capacità di risposta in situazioni non previste dai modelli. Le sfide toccano anche i requisiti normativi, poiché gli standard AI evolvono più velocemente delle certificazioni OT. Per mitigare questi rischi, Cisa propone un ciclo di sviluppo AI sicuro, che include design robusto, procurement trasparente, deployment segmentato e monitoraggio continuo delle vulnerabilità. L’agenzia richiede inoltre formazione strutturata del personale, con l’insegnamento dei fondamenti AI, delle tecniche di validazione degli output e dell’uso di segnali alternativi per verificare il comportamento del modello.

Considerazioni per l’uso dell’AI in dominio OT

Cisa invita le organizzazioni a valutare criticamente il business case dell’AI in OT, stabilendo se l’introduzione di questi sistemi superi effettivamente alternative più semplici in termini di sicurezza, affidabilità e costi. La valutazione considera requisiti specifici come la protezione dei dati ingegneristici, la segregazione tra ambienti OT e IT, la gestione di silos e formati proprietari, oltre ai rischi di data poisoning o dipendenza da dataset sintetici. Particolare attenzione viene posta alle politiche di data governance: lo storage deve essere controllato, gli accessi limitati, i vendor attentamente selezionati. Per le amministrazioni pubbliche, Cisa raccomanda contratti che includano SBOM, policy dati con residenza locale, crittografia avanzata, controlli su AI embedded nei dispositivi OT e opzioni operative completamente on-premises senza necessità di connessione Internet. Le sfide d’integrazione AI-OT includono latenza, cloud dependency, protocolli incompatibili, modelli opachi e complessità crescente dei sistemi. Per mitigare tali criticità, Cisa propone architetture push-based, controlli human-in-the-loop, test in ambienti isolati e aggiornamenti regolari dei modelli.

Quadri di governance e assurance per AI

La governance è al centro delle linee guida Cisa. Le organizzazioni devono definire ruoli chiari per CEO, CISO, team OT/IT e vendor, introducendo policy rigorose per la gestione sicura dei dati, audit periodici, logging, prevenzione data-loss e analisi delle minacce basate su framework come MITRE ATLAS. I modelli devono essere testati in ambienti non produttivi, con passaggi graduali da test di bassa fedeltà a stress test realistici. Inoltre, le aziende devono valutare la conformità rispetto a standard emergenti come ETSI SAI, verificando le prestazioni rispetto a norme di sicurezza funzionale.

Incorporare oversight e failsafe nei sistemi AI-OT

Cisa richiede l’inserimento di meccanismi di oversight continuo, incluso il tracciamento dei componenti AI tramite inventari aggiornati, logging esteso degli input e degli output, e gestione degli stati sicuri del sistema. L’uso di tecniche human-in-the-loop, algoritmi di anomalie e strategie di red teaming AI consente una sorveglianza costante sulla qualità delle decisioni. I sistemi devono prevedere fallback non-AI e failsafe per garantire continuità operativa anche in caso di errore del modello.

Suggerimenti per simulazioni di campagne phishing

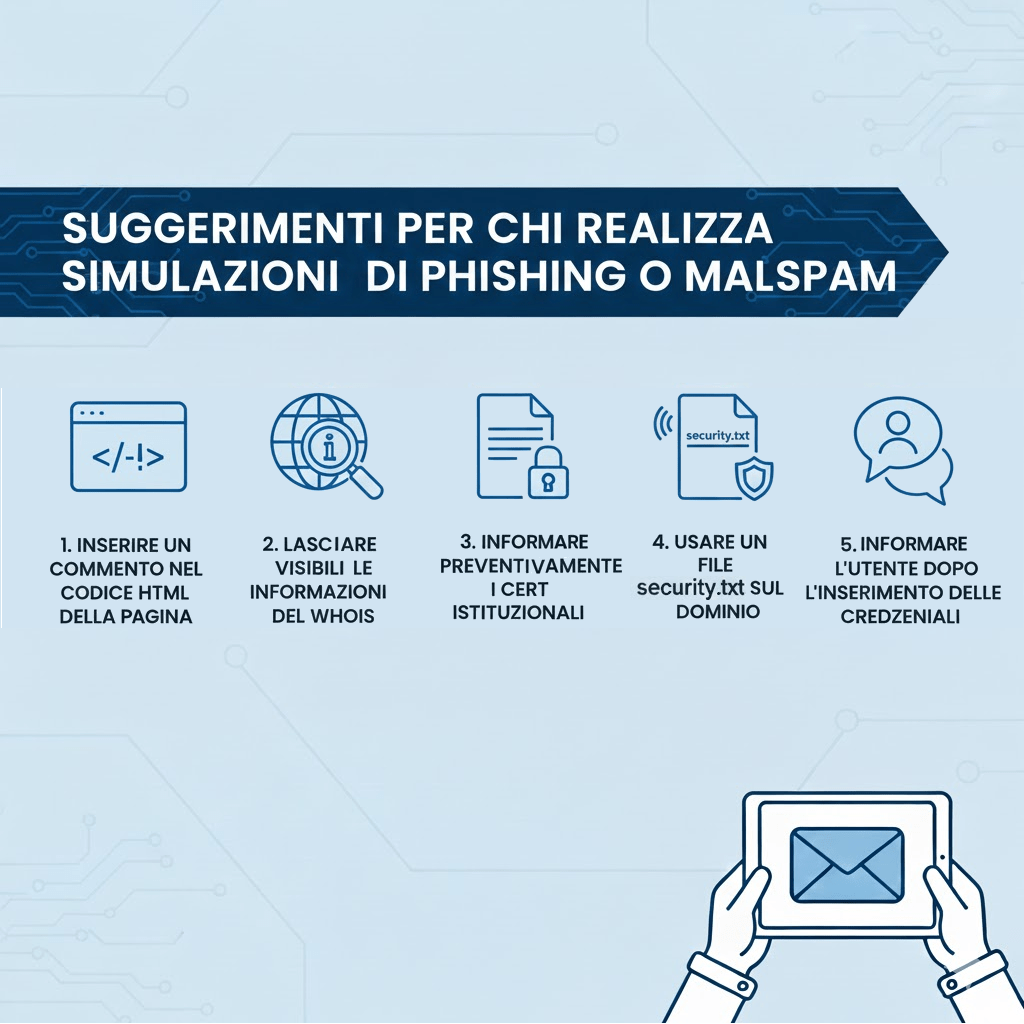

Parallelamente, Cert-Agid affronta una sfida pratica ma cruciale: come garantire che le simulazioni di phishing non vengano scambiate per attacchi reali. L’agenzia propone una serie di accorgimenti operativi che permettono alle amministrazioni di testare la consapevolezza dei dipendenti senza generare allarmi falsi. Le indicazioni includono l’inserimento di commenti HTML nelle pagine di destinazione per segnalare, solo a un’analisi approfondita, la natura legittima dell’esercitazione. Viene richiesto di mantenere trasparenti le informazioni WHOIS dei domini usati, evitando tecniche di offuscamento tipiche degli attori malevoli. Le amministrazioni devono informare preventivamente CERT istituzionali, fornendo dettagli tecnici dell’attività in modo da evitare segnalazioni sbagliate. L’uso del file security.txt conforme allo standard RFC 9116 permette di esporre contatti verificabili per la gestione rapida delle verifiche. Infine, gli utenti devono essere informati al termine della simulazione per consolidare la formazione e prevenire timori o escalation improprie.

Impatto delle guide su infrastrutture critiche

Le linee guida congiunte di Cisa e Cert-Agid rafforzano la resilienza digitale delle infrastrutture critiche italiane. Da un lato, le indicazioni di Cisa permettono di integrare l’AI in OT in maniera sicura, trasparente e controllata, riducendo rischi funzionali, interruzioni operative e incidenti legati a modelli opachi o a drift non monitorati. Dall’altro, le raccomandazioni di Cert-Agid evitano che le simulazioni phishing — strumenti essenziali nella cultura della sicurezza — generino falsi allarmi, blocchi operativi o classificazioni errate da parte dei CERT nazionali. Questo duplice approccio migliora la governance, favorisce relazioni più solide tra operatori pubblici, vendor e team di sicurezza, e contribuisce alla costruzione di un ecosistema più resiliente, dove la crescita dell’AI e la formazione del personale convivono con esigenze di protezione, continuità e compliance regolatoria.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.