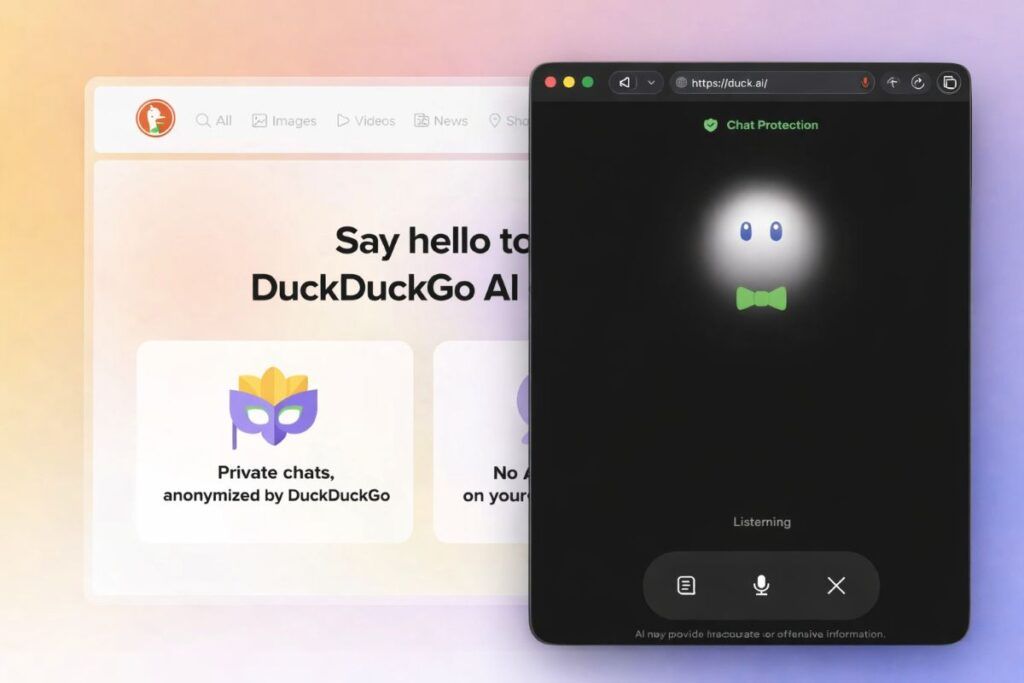

Duck.ai entra nella fase più delicata dell’AI consumer: la chat vocale in tempo reale, proposta da DuckDuckGo come funzione “privata” con crittografia end-to-end e connessioni relay progettate per non esporre l’identità dell’utente. Nel back-end, però, la voce viene gestita da modelli di OpenAI, con un set di promesse che punta a togliere l’ansia da registrazione: streaming solo durante la sessione, cancellazione dell’audio a fine conversazione, niente uso per addestramento e vincoli contrattuali sul trattamento dati. La novità non è solo “parlare con un chatbot”, ma misurare quanto sia credibile un modello di privacy quando il canale è il più sensibile di tutti: la voce, con la sua impronta biometrica, le sue sfumature e la sua capacità di rivelare contesto.

Il posizionamento è chiaro: DuckDuckGo vuole una scorciatoia per chi chiede AI senza consegnare account, cronologia e profilazione. La chat vocale su Duck.ai viene descritta come accessibile senza setup complessi, con limiti giornalieri gratuiti e un piano premium da 9 euro al mese che si appoggia a un bundle più ampio, includendo VPN DuckDuckGo, rimozione di informazioni personali e servizi di ripristino identità. È la tipica architettura da “privacy-as-a-service”: la feature attrae, l’abbonamento monetizza, la promessa è ridurre la superficie di tracciamento.

Resta il nodo centrale: cosa significa “privato” quando un flusso audio deve essere trascritto, interpretato e trasformato in risposta in pochi secondi. Qui DuckDuckGo prova a costruire una linea netta tra contenuto e identità, dicendo in sostanza che il contenuto serve solo per rispondere, mentre l’identità non deve emergere mai. È una distinzione che, se regge tecnicamente e contrattualmente, diventa un vantaggio competitivo reale contro assistenti vocali mainstream.

Cosa leggere

Duck.ai come piattaforma: perché la voce cambia la natura del rischio

La chat testuale è già un compromesso: scrivi, invii, ricevi. La voce è un altro piano, perché aggiunge tre livelli di sensibilità. Il primo è fisico: la voce è un dato che può contenere biometria implicita, anche quando non vuoi. Il secondo è sociale: parlando si tende a rivelare più contesto, più dettagli, più sfumature, spesso con meno filtro. Il terzo è ambientale: la voce è legata a un microfono, quindi al rischio di catturare frammenti di ciò che succede intorno.

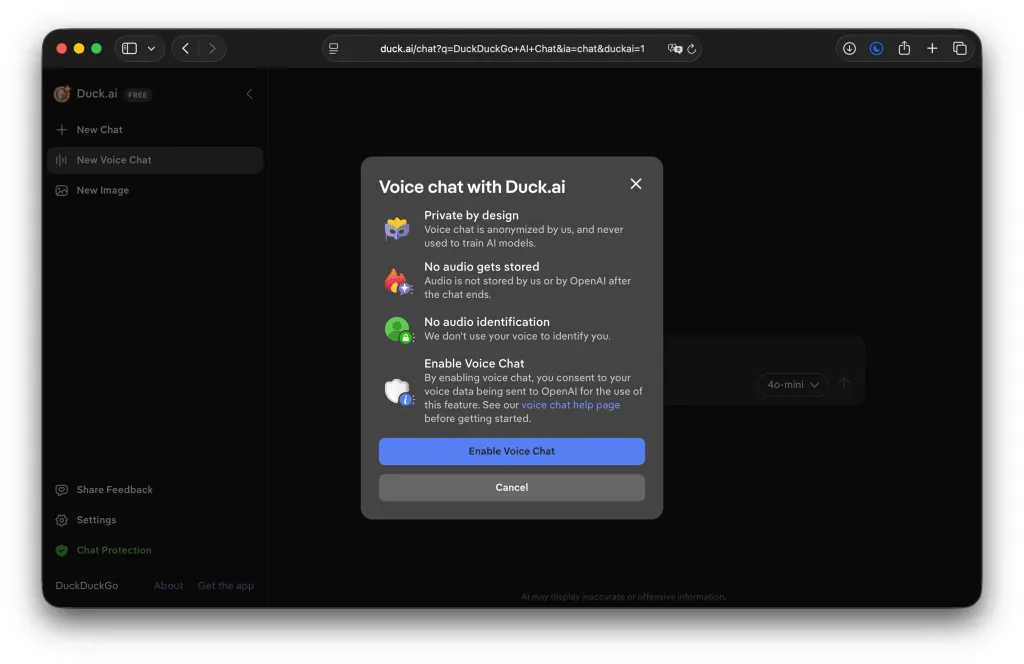

Per questo l’ingegneria “privacy-first” su un assistente vocale non può limitarsi a dire “non salviamo nulla”, deve chiarire dove passa l’audio, chi può decifrarlo, per quanto tempo esiste, e soprattutto cosa viene conservato come traccia tecnica inevitabile. DuckDuckGo, in questa implementazione, insiste su un concetto: il sistema gestisce streaming audio solo durante la sessione attiva e poi elimina ogni registrazione al termine. È una promessa forte, perché sposta la funzione nel regime dell’effimero: la conversazione esiste mentre avviene, poi scompare.

Il punto, per l’utente evoluto, è capire cosa resta comunque. Anche quando non resta un file audio, spesso restano metadati di funzionamento, perché i sistemi hanno bisogno di telemetria minima per garantire stabilità, prevenire abusi, applicare limiti e gestire billing. La differenza tra una piattaforma “invasiva” e una “privacy-oriented” non è l’assenza totale di metadati, ma la riduzione del metadato a ciò che serve e la separazione netta da un’identità persistente.

Il relay come architettura: separare identità e contenuto senza chiedere fiducia cieca

La parola che DuckDuckGo usa per distinguersi è relay. L’idea è connettere l’utente ai modelli di OpenAI attraverso un passaggio intermediato e cifrato, in modo che il provider del modello veda la richiesta e risponda, ma non possa ricondurla facilmente a un profilo identificabile dell’utente finale. È una logica simile a quella che, in altri contesti, serve a ridurre esposizione di IP o fingerprinting, ma qui viene applicata a un flusso più ricco: la voce.

Tecnicamente, l’esperienza vocale “naturale” richiede bassa latenza. È qui che entrano strumenti come WebRTC, spesso usati per comunicazioni real-time, perché gestiscono flussi bidirezionali in modo efficiente. DuckDuckGo presenta WebRTC come pezzo del puzzle di sicurezza e streaming, ma la parte più importante non è solo il protocollo: è l’idea che l’audio resti in transito e non finisca in una pipeline di archiviazione.

Quando il relay è progettato bene, l’utente non deve “fidarsi” della dichiarazione di non tracciamento: riduce a monte ciò che un fornitore esterno può osservare. È una differenza strutturale rispetto a modelli dove la voce viene elaborata da un account, legata a un dispositivo e conservata come cronologia. Qui la promessa è opposta: nessun account obbligatorio, sessioni anonime, audio che esiste solo mentre parli.

OpenAI nel back-end: il punto non è chi risponde, ma quali vincoli reggono

DuckDuckGo dichiara che la chat vocale su Duck.ai è alimentata da modelli di OpenAI, e che esistono limitazioni contrattuali sull’uso dei dati vocali, in particolare sul divieto di usare le conversazioni per addestramento. È un dettaglio cruciale, perché sposta la garanzia dal solo piano tecnico al piano legale e operativo.

Nella percezione pubblica, “OpenAI dietro” può generare reazioni contrastanti: alcuni lo leggono come affidabilità e qualità del modello, altri come rischio di centralizzazione. Il punto utile, qui, è ricordare che DuckDuckGo sta vendendo un “wrapper privacy” attorno a modelli esterni. Il suo valore aggiunto non è costruire l’LLM, ma costruire una modalità di accesso che riduca retention e identificabilità.

Il vero discrimine diventa l’esecuzione: se davvero l’audio non viene registrato e viene eliminato a fine sessione, l’area di rischio principale si sposta su due aspetti. Il primo è la possibilità che restino trascrizioni o frammenti testuali, perché un assistente vocale spesso passa da voce a testo per interpretare, poi torna a voce. Il secondo è la gestione di errori e log: ogni sistema real-time ha fallback e debugging, e il modo in cui vengono gestiti può fare la differenza tra privacy “di principio” e privacy “di implementazione”.

DuckDuckGo prova a tagliare questa ambiguità dicendo che lo streaming è gestito “solo durante la sessione” e che l’audio viene eliminato alla fine. È una promessa che, se mantenuta, riduce drasticamente il rischio di esposizione postuma. Ma per l’utente consapevole resta una regola pratica: la voce è sempre il dato più delicato, quindi anche una piattaforma privacy-first va usata con disciplina informativa, evitando di dettare segreti, codici e informazioni che non diresti a un estraneo.

Crittografia end-to-end: cosa significa in un servizio che deve “capire” quello che dici

L’espressione crittografia end-to-end è potente ma spesso fraintesa. In una comunicazione E2E classica, solo i due endpoint possono leggere il contenuto. Nel caso di una chat vocale con AI, uno degli endpoint è un sistema che deve processare e rispondere, quindi, per definizione, il contenuto deve diventare interpretabile da quel sistema in qualche punto della catena. Il valore dell’E2E, in questo scenario, è limitare l’accesso di intermediari e prevenire intercettazioni durante il trasporto, non rendere “illeggibile” il contenuto al motore che deve rispondere.

DuckDuckGo usa la crittografia per sostenere una promessa diversa: non che nessuno possa tecnicamente vedere nulla, ma che la visibilità sia minimizzata, non associata e non trattenuta. È un modello più realistico per un assistente vocale: la privacy diventa una questione di “chi può osservare cosa” e “quanto a lungo quel dato resta disponibile”. Qui la scelta di relay crittografati serve a ridurre correlazioni. In un mondo dove quasi tutto è identificabile tramite combinazione di segnali, ridurre i punti di correlazione è spesso più efficace che proclamare un assoluto.

Browser supportati e assenza temporanea di Firefox: un dettaglio che pesa per il pubblico privacy

DuckDuckGo dichiara supporto sui principali browser, con un’esclusione temporanea di Firefox e supporto “in arrivo”. Non è un dettaglio banale: una parte dell’utenza più orientata alla privacy usa proprio Firefox come scelta identitaria. L’assenza temporanea può essere letta come limite tecnico, ma anche come problema di coerenza narrativa, perché il pubblico che DuckDuckGo vuole conquistare spesso è quello che rifiuta l’ecosistema Chromium. Nel breve periodo, la scelta più razionale è considerarla una fase di compatibilità. Nel medio, però, DuckDuckGo dovrà chiudere quel gap, perché la chat vocale “privata” ha senso soprattutto quando è disponibile nel browser che l’utente privacy-first considera più affidabile. Se Firefox resta indietro troppo a lungo, la feature rischia di sembrare “privata ma non per tutti”.

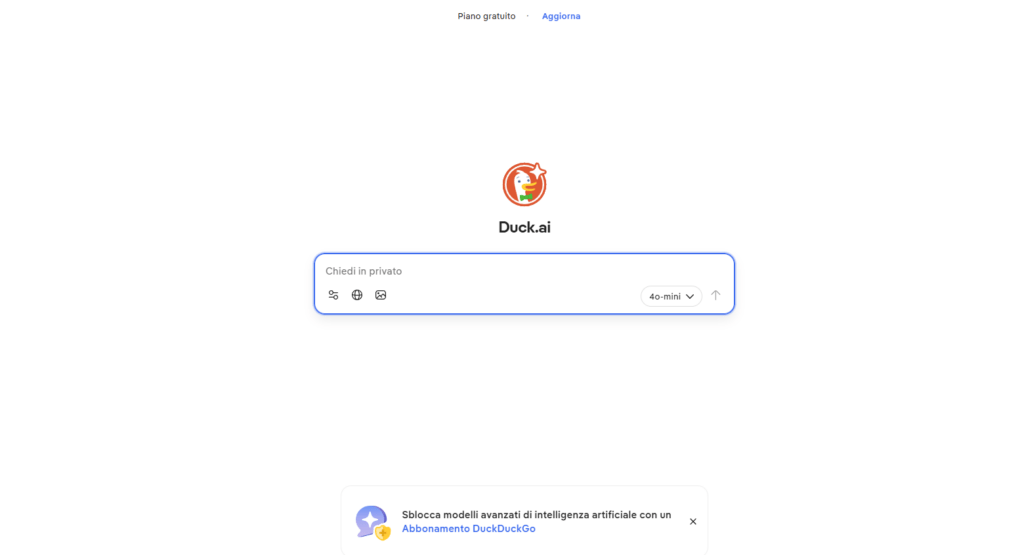

Free tier e abbonamento da 9 euro: la privacy come prodotto e il bundle come leva

L’accesso gratuito con limiti giornalieri è la tipica strategia per creare abitudine. La voce, più del testo, genera dipendenza d’uso perché riduce frizione, quindi un cap giornaliero diventa un incentivo naturale al piano premium. DuckDuckGo posiziona il premium a 9 euro al mese, ma la parte interessante è il bundle: VPN, rimozione di informazioni personali e servizi di ripristino identità. In pratica, la chat vocale è una porta d’ingresso in un pacchetto di “protezione” più ampio. Questa architettura è coerente con l’idea che la privacy sia un ecosistema di scelte, non una singola feature. Se l’utente paga per parlare con l’AI in modo più libero, è più probabile che paghi anche per ridurre tracciamento, esposizione e danni da furto d’identità. DuckDuckGo sta trasformando la privacy da valore astratto a proposta commerciale integrata. Il rischio, come sempre, è la percezione di “paywall della privacy”. DuckDuckGo prova a bilanciarlo mantenendo un free tier reale e un accesso senza account obbligatorio, ma l’equilibrio dipenderà da quanto sia restrittivo il cap gratuito. Se il cap è troppo basso, la feature sembra un teaser. Se è ragionevole, la piattaforma cresce e il premium resta una scelta, non un ricatto.

Controlli utente: disattivare la voce e ridurre superficie di rischio

Un punto positivo della proposta è la possibilità di disattivare la chat vocale dalle impostazioni di Duck.ai. È un dettaglio che, per un pubblico privacy-oriented, pesa più di molte promesse: significa che l’utente può ridurre la superficie di rischio e scegliere una modalità più controllabile. La voce è comoda, ma è anche il canale con più variabili. Offrire un toggle chiaro è un segnale di design orientato al controllo, non solo all’adozione. In un prodotto di AI consumer, l’assenza di controlli espliciti genera diffidenza. Qui DuckDuckGo fa l’opposto: rende la feature opzionale, non inevitabile. È un modo per evitare la sensazione che “il microfono sia sempre lì”, anche quando non lo è.

Multi-modello su Duck.ai: OpenAI per la voce, Meta/Anthropic/Mistral per il resto

Duck.ai nasce e cresce come piattaforma che integra più modelli, includendo opzioni non vocali da Meta, Anthropic e Mistral, oltre a OpenAI. Questa pluralità ha due vantaggi. Il primo è tecnico: la piattaforma può scegliere il modello migliore per un compito. Il secondo è strategico: riduce la dipendenza da un singolo fornitore e rafforza la narrativa di neutralità. Nel contesto della chat vocale, però, la scelta di OpenAI come motore evidenzia che la voce richiede una pipeline specifica, spesso legata a tecnologie di trascrizione e generazione vocale con latenza bassa. È un terreno in cui non tutti i provider sono equivalenti. DuckDuckGo, qui, sembra privilegiare l’esperienza di conversazione naturale, tentando di mantenere la privacy non attraverso il modello, ma attraverso l’architettura di accesso. Questa distinzione è importante: DuckDuckGo non sta dicendo “il modello è privacy-first”, sta dicendo “l’accesso è privacy-first”. È un modo più realistico di competere, ma richiede trasparenza continua, perché l’utente deve capire che la privacy promessa nasce da relay, policy e retention, non da magia.

Cosa cambia per il mercato: la voce come standard e la privacy come differenziale credibile

La chat vocale in tempo reale è diventata un simbolo di “AI moderna”. Chi non la offre sembra indietro. Il problema è che la voce, per la maggior parte dei player, è anche un acceleratore di raccolta dati: più uso, più segnali, più profiling. DuckDuckGo vuole ribaltare questa equazione, dicendo in sostanza che puoi avere la comodità senza pagare con la tua identità. Se la promessa regge, Duck.ai diventa un caso studio: una piattaforma che usa modelli di terzi ma costruisce un perimetro “privacy-first” che riduce retention e identificazione. Se la promessa non regge, il danno reputazionale è pesante, perché chi sceglie DuckDuckGo lo fa proprio per evitare ambiguità. In un mercato saturo di “privacy washing”, la soglia di tolleranza è bassa. Il vero valore, quindi, non è solo la feature vocale, ma l’insieme: sessioni anonime, relay, cancellazione audio, controlli utente, opzione di disattivazione, free tier e bundle premium coerente. È un tentativo di dimostrare che la privacy può essere un prodotto competitivo anche quando la tecnologia core è presa in prestito da un gigante.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.