Discord ha deciso di aprire un pezzo di “cucina interna” che di solito resta chiuso dietro le quinte: Osprey, il proprio motore regole per la sicurezza delle piattaforme online, progettato per investigare attività in tempo reale e applicare regole dinamiche con un livello di trasparenza utile non solo per bloccare, ma anche per capire. Il segnale non è piccolo, perché Osprey non nasce come progetto didattico: nasce come risposta a una scala che mette a nudo i limiti dei sistemi tradizionali, dove la differenza tra un contenuto innocuo e una campagna coordinata può dipendere da pochi minuti, e dove la manutenzione dell’infrastruttura divora tempo che le squadre di trust and safety non possono permettersi di perdere. In questo quadro, l’open source non è una mossa di immagine. È un invito a smettere di reinventare la stessa infrastruttura in ogni azienda, e a spostare la competizione dove dovrebbe stare: sull’intelligence, sui segnali, sulla qualità delle regole, sulla capacità di reagire ai nuovi pattern. Discord collega la scelta a una collaborazione con Roost e all’ecosistema che ruota attorno a internet.dev, con l’idea di condividere strumenti e pratiche per contrastare minacce che, per definizione, non rispettano i confini di una sola piattaforma. La promessa implicita è chiara: se il mondo delle piattaforme affronta problemi simili, allora il “motore” può diventare comune, mentre le regole e i modelli restano specifici. Osprey prova a essere quel motore.

Cosa leggere

Perché un motore regole oggi conta più del singolo blocco

Il lessico delle piattaforme, negli ultimi anni, ha spostato l’attenzione dal “moderare contenuti” al “gestire sistemi ostili”. Spam, scam, grooming, estorsioni, campagne di impersonificazione, abuse di inviti e bot, creazione massiva di account, tentativi di eludere le policy usando variazioni minime. È un contesto in cui la difesa non può essere solo reattiva e non può essere solo manuale. Servono sistemi che assorbano eventi ad altissimo volume e producano risposte coerenti, auditabili e aggiornabili. Osprey si colloca esattamente lì: prende in input “azioni” e “eventi” e li trasforma in un flusso valutabile da regole che possono essere scritte e rilasciate velocemente. Discord parla di un motore che elabora migliaia di eventi al secondo e che, nella propria realtà operativa, si muove su numeri enormi di azioni quotidiane. Questo dettaglio non serve per fare scena: serve a capire perché un sistema del genere tende a diventare inevitabile quando una piattaforma cresce.

A livello pratico, Osprey punta a ridurre una delle frizioni più tossiche nel trust and safety: quando il team identifica un pattern malevolo e chiede “una regola”, ma per trasformare quella richiesta in implementazione serve un ciclo ingegneristico lungo, pieno di deploy, test, dipendenze e colli di bottiglia. Qui il progetto rivendica la possibilità di passare dall’idea alla regola in tempi rapidi, senza compromettere la robustezza.

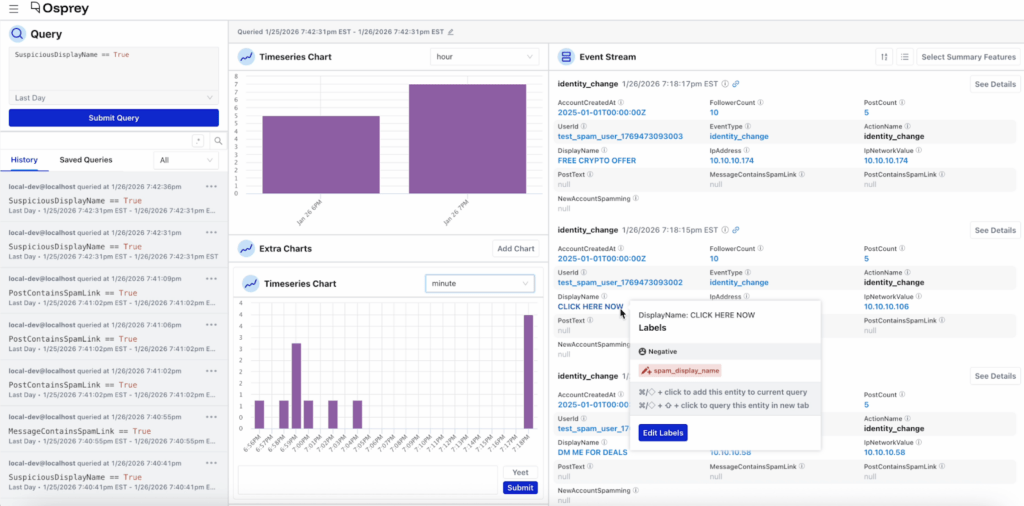

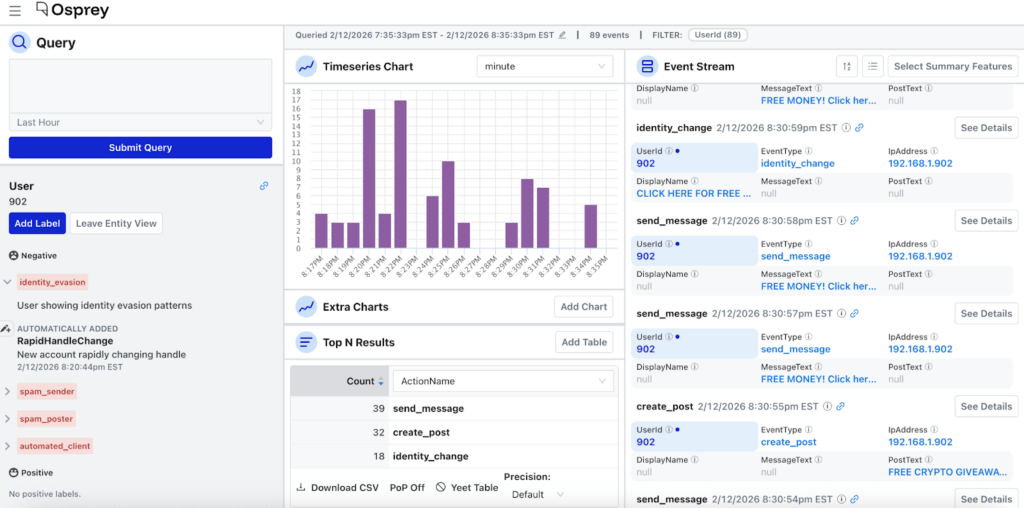

Verdetti chiari e spiegabili: safe, suspicious, malicious

Uno dei punti più interessanti di Osprey non è solo la capacità di decidere, ma la capacità di mostrare come decide. Il motore produce verdetti espliciti come safe o malicious, e permette di osservare l’esecuzione delle regole per fare debug. In termini di operatività quotidiana questo cambia la dinamica, perché in sicurezza di piattaforma gli errori non sono solo “falsi negativi” che lasciano passare l’abuso, ma anche falsi positivi che colpiscono utenti legittimi, con impatto reputazionale e legale. La spiegabilità, in questo contesto, non è un vezzo accademico: è un requisito per correggere velocemente, per dimostrare coerenza interna, per fare audit e per evitare che il sistema diventi una scatola nera ingestibile. Osprey mette al centro la possibilità di capire quale regola ha scattato, con quale contesto, e quali effetti sono stati applicati. È un modo per rendere il sistema più “ingegnerizzabile” anche da team non giganteschi.

SML e UDF in Python: potenza senza trasformare tutto in codice applicativo

Osprey propone un equilibrio: da una parte un linguaggio di regole, SML, pensato per rendere rapida la scrittura e la manutenzione; dall’altra la possibilità di estendere le capacità attraverso UDF in Python, utili per chiamare servizi esterni o calcolare segnali più complessi. Questo è un punto chiave, perché molte piattaforme finiscono intrappolate tra due estremi. O costruiscono sistemi di regole troppo semplici, incapaci di evolvere, oppure implementano tutto nel codice applicativo, trasformando ogni regola in una modifica di prodotto, con conseguente lentezza. SML, per come viene descritto, cerca di abbassare la soglia di accesso, mantenendo però la possibilità di comporre logiche e di referenziare altre regole. Le UDF, invece, fanno da ponte quando serve calcolo aggiuntivo, integrazione con un modello ML o chiamate a servizi interni. Il risultato atteso è una piattaforma in cui la regola resta dichiarativa, mentre l’estensione resta incapsulata e controllabile. Dal punto di vista della governance, questo è un compromesso che evita la deriva più comune nei sistemi di trust and safety: un mosaico di script, cron, servizi e query scollegate, dove nessuno ha più una visione unificata del perché una decisione sia stata presa.

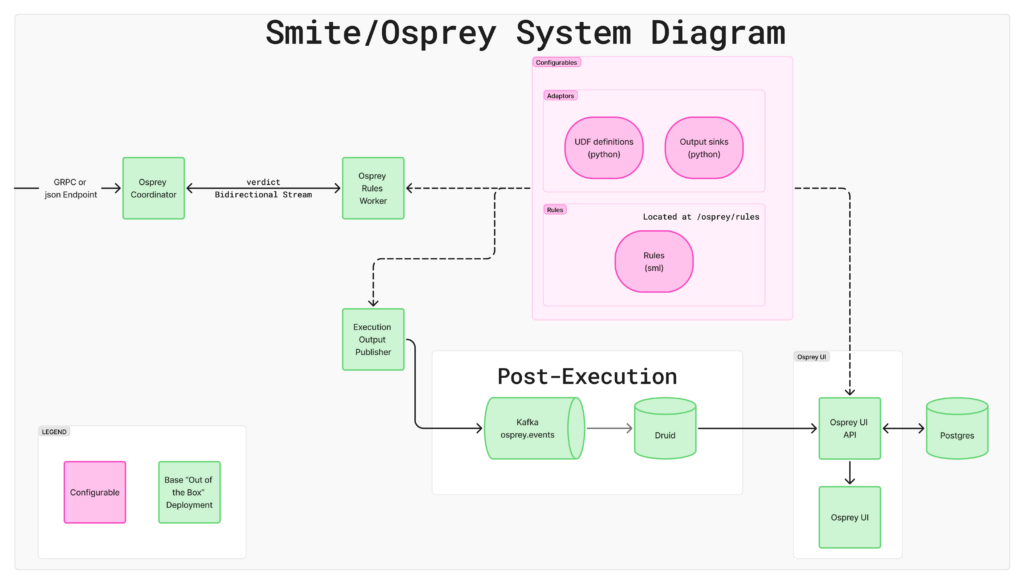

Architettura distribuita: sincrono via gRPC, asincrono via Kafka

Osprey nasce con un’idea di piattaforma: azioni sincrone valutate in tempo reale e flussi asincroni gestiti tramite coda eventi. Da qui l’uso di gRPC per le richieste sincrone, dove la piattaforma vuole un verdetto immediato, e l’integrazione con Kafka per gli eventi asincroni, dove la valutazione può essere parte di pipeline più lunghe, di analisi, di arricchimento. Questa separazione non è un dettaglio “da architetti”: riflette due tempi della sicurezza. Il tempo della decisione, quando devi fermare una frode, limitare un invito, bloccare uno spammer o mettere in quarantena un account. E il tempo dell’investigazione, quando devi ricostruire una campagna, correlare segnali, capire la propagazione e misurare l’efficacia delle contromisure.

Discord descrive Osprey come un sistema che bilancia scala e semplicità, distribuendo il carico e mantenendo la possibilità di aggiornare rapidamente le regole. In questo quadro, componenti come un coordinator e worker che eseguono regole localmente hanno un senso operativo: evitare che ogni decisione diventi un collo di bottiglia centrale.

Feature store e analisi: esportare in Druid per vedere i trend

Un motore regole che decide “ora” è utile, ma spesso non basta. Le piattaforme hanno bisogno di capire cosa sta succedendo nel tempo: picchi anomali, nuove tattiche, spostamenti geografici, cambiamenti di comportamento. Osprey, nel racconto di Discord, esporta feature in Druid, così da consentire query rapide e indagini sui trend. Questo aspetto sposta Osprey da “motore di enforcement” a “motore di osservabilità del rischio”. La sicurezza di piattaforma è fatta di pattern che evolvono, e spesso la differenza tra una mitigazione efficace e una patch temporanea è la capacità di misurare e iterare. Se un motore regole non lascia tracce analizzabili, ogni correzione diventa un gesto cieco. Se invece produce segnali interrogabili, allora la regola può diventare parte di un ciclo di miglioramento continuo. È anche qui che la promessa “future-proof” assume sostanza: non perché un sistema possa anticipare ogni attacco, ma perché può essere aggiornato rapidamente con feedback e misurazioni, senza dover rifare l’infrastruttura.

L’idea di “imparare dal feedback” senza vendere magia

Quando si dice che un framework “impara dal feedback”, il rischio è sempre quello di scivolare nel marketing. Nel caso di un motore regole, però, l’apprendimento può essere inteso in modo più concreto e meno mistico: le regole cambiano perché i team osservano l’efficacia, correggono i falsi positivi, raffinano le condizioni, aggiungono contesto, incorporano nuovi segnali. Osprey, da come viene descritto, facilita questo ciclo perché rende più veloce la scrittura e il deploy delle regole e perché rende più leggibili gli esiti. È un tipo di “apprendimento” che assomiglia più all’ingegneria operativa che al machine learning. E, per il trust and safety, spesso è proprio questo che serve: strumenti che rendono possibile iterare senza introdurre caos. Il vero valore di un sistema del genere è abbassare il costo della correzione. Se ogni regola è un progetto, si corregge poco. Se ogni regola è un file e un deploy controllato, si corregge molto. E la sicurezza, nelle piattaforme, è soprattutto una guerra di attrito.

Open source come standardizzazione del motore, non delle policy

La scelta di aprire Osprey è interessante perché tocca un punto delicato: le policy tra piattaforme sono diverse, i contesti normativi sono diversi, i rischi reputazionali sono diversi. Ma il motore che valuta eventi, gestisce entità persistenti, applica effetti, produce verdetti e lascia audit trail è un problema che tende a ripetersi. Discord spinge l’idea che molte aziende, soprattutto quelle più piccole, non dovrebbero essere costrette a costruire da zero un’infrastruttura solo per poter competere sul piano della sicurezza. Se Osprey diventa un motore riutilizzabile, allora anche chi non ha risorse gigantesche può concentrarsi sul proprio dominio e sui propri segnali. In teoria, questo riduce la superficie globale di vulnerabilità, perché meno piattaforme restano “indietro” con strumenti improvvisati. La collaborazione con Roost rafforza il messaggio: la sicurezza online è un problema collettivo, e alcuni layer possono essere condivisi. È un approccio simile a quello che ha reso robusto l’ecosistema open source in altri ambiti: non perché tutti usino le stesse regole, ma perché tutti usano strumenti solidi per applicare le proprie.

Il punto operativo: ridurre overhead ingegneristico senza perdere controllo

Il cuore del progetto, per come emerge dal testo, è la riduzione dell’overhead ingegneristico. Non nel senso di “meno ingegneri”, ma nel senso di meno lavoro ripetitivo e più capacità di intervenire velocemente. In molte piattaforme, quando la sicurezza richiede interventi rapidi, si finisce a introdurre scorciatoie: patch veloci, sistemi paralleli, eccezioni, logiche hard-coded. Col tempo, quelle scorciatoie diventano debito tecnico che rende ogni intervento più lento. Osprey prova a evitare proprio questa traiettoria, proponendo un motore che rende naturale scrivere regole, testarle, debugarle, rilasciarle e misurarle. Il fatto che il sistema mostri l’esecuzione delle regole e fornisca verdetti chiari è un modo per mantenere il controllo, non per delegarlo a un automatismo opaco. E c’è un altro elemento implicito: in trust and safety non basta “fare” una regola, bisogna poterla spiegare. A un team interno, a un auditor, a un legale, a un regolatore, a un utente che contesta. Un motore che conserva un trail e rende visibile la logica riduce attriti in tutti questi passaggi.

Osprey come infrastruttura politica della piattaforma

C’è una lettura più ampia che vale la pena mettere a fuoco: un motore regole è anche un modo di formalizzare “chi decide cosa” dentro una piattaforma. Se tutto è codice applicativo, decidono gli ingegneri di prodotto. Se tutto è manuale, decidono gli operatori e la moderazione in emergenza. Se esiste un motore regole, allora la decisione diventa un oggetto esplicito, versionabile, discutibile, misurabile. In questo senso Osprey è un pezzo di governance tecnica. E il fatto che venga open-source porta quella governance a un piano più pubblico, dove le scelte architetturali diventano osservabili e, potenzialmente, criticabili. Non è un rischio da poco, ma è anche un modo per aumentare credibilità: aprire un sistema significa accettare che altri lo guardino davvero, e non solo attraverso un comunicato.

Roadmap ambiziosa e conseguenza inevitabile: la community come moltiplicatore

Discord presenta l’open source come inizio di una roadmap, non come punto d’arrivo. Questo è coerente con la natura dei sistemi di sicurezza: se restano statici, diventano rapidamente obsoleti. L’ambizione, dichiarata o implicita, è far crescere un ecosistema di contributi, integrazioni, connettori e casi d’uso. Qui si misura la maturità del progetto. Osprey non potrà essere utile fuori da Discord solo se resta legato a presupposti troppo specifici o a dipendenze interne non replicabili. La promessa è che il motore bilancia scala e semplicità e che integra servizi distribuiti in modo riusabile. La verifica, come sempre, sarà nella capacità delle aziende di adattarlo senza riscriverlo. Se ci riesce, Osprey diventa qualcosa di raro: un tool di trust and safety che non è solo una collezione di best practice teoriche, ma un motore operativo con una filosofia chiara. La filosofia è questa: decisioni rapide, debug trasparente, regole scrivibili in poco tempo, architettura distribuita, segnali analizzabili. E, soprattutto, un’idea di sicurezza che smette di essere un compartimento stagno. Se un attaccante può muoversi da una piattaforma all’altra, allora anche gli strumenti difensivi hanno senso quando possono circolare. Osprey prova a trasformare quel principio in ingegneria.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.