Gemini 3.1 Pro entra in scena come un aggiornamento che non si limita a “fare meglio” ciò che già esiste, ma prova a spostare l’asse dell’ecosistema AI di Google: meno chatbot da interrogare e più sistemi che ragionano, pianificano, agiscono e rendicontano. L’annuncio si incastra in una settimana in cui l’AI non viene più descritta come funzione aggiuntiva, ma come infrastruttura che cambia le interfacce: una Gemini app su Android che avvia task multi-step in background, una Circle to Search che passa dal riconoscimento dell’oggetto singolo a una lettura “multi-oggetto” dell’immagine, e una nuova Gemini Enterprise app pensata per separare definitivamente i flussi consumer da quelli professionali. Il punto, per Google, non è soltanto lanciare un modello più capace. Il punto è rendere quel modello operativo in tre contesti che contano: sviluppo e piattaforme (API e Vertex AI), produttività e mobilità (Gemini app su Android), lavoro e governance (Workspace e strumenti enterprise). È qui che si decide la partita: un modello può essere brillante in laboratorio, ma se non entra in un workflow reale resta una demo di lusso. Con Gemini 3.1 Pro, Google prova a ridurre questa distanza, presentando un pacchetto in cui il “ragionamento” del modello diventa il motore di azioni e decisioni che l’utente può controllare, interrompere, verificare.

Cosa leggere

Gemini 3.1 Pro e il salto nel reasoning: non solo risposte, ma catene di decisione

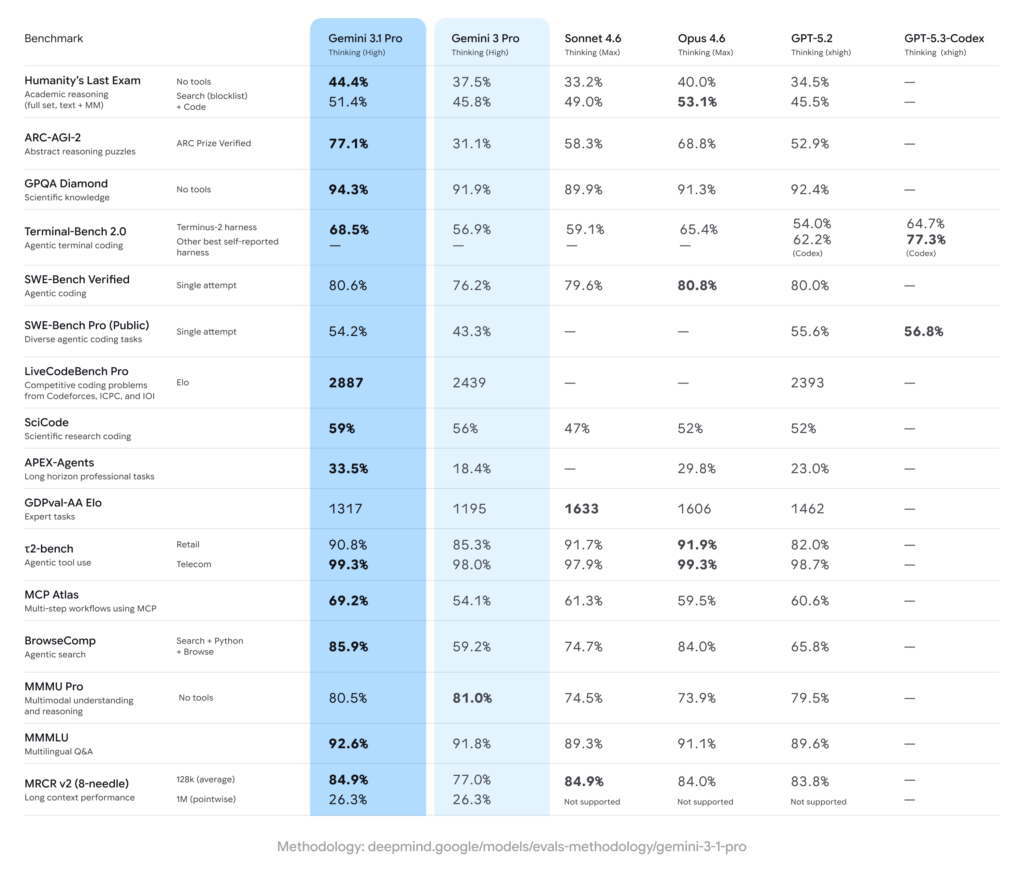

Gemini 3.1 Pro viene presentato come un modello con un ragionamento più solido per compiti complessi: sintesi di informazioni dense, spiegazioni articolate, problem solving su scenari dove una risposta rapida e superficiale fallisce. È il tipo di promessa che negli ultimi mesi è diventata lo standard della competizione AI, ma qui l’accento di Google è specifico: la preview serve a validare la direzione verso workflow agentici, cioè processi in cui il modello non si limita a generare testo, ma costruisce passaggi intermedi, gestisce vincoli, e produce output utili a far partire un’azione o un progetto. Il ragionamento, in questa impostazione, non è un’etichetta astratta. È la capacità di tenere insieme obiettivi e contesto, di evitare scorciatoie, di sostenere una spiegazione quando l’utente chiede “perché” e “come”. In altre parole, un modello che non vive solo di completamento probabilistico, ma che inizia a comportarsi come un componente di sistema in grado di sostenere una conversazione tecnica, un brief progettuale, una lettura di dati, una fase di prototipazione.

Google insiste molto anche sull’uso creativo e tecnico, perché è lì che i modelli vengono messi alla prova senza pietà: generazione di codice che non sia un collage di frammenti, capacità di produrre asset leggeri come SVG animati, costruzione di dashboard con dati in tempo reale, simulazioni e prototipi interattivi. In questa narrativa, Gemini 3.1 Pro diventa una sorta di “ponte” tra strumenti complessi e output presentabili: non tanto l’AI che ti scrive due righe, ma quella che ti aiuta a passare da un’idea a un prototipo in tempi compressi.

Questa è anche la parte più delicata. Quando Google parla di superamento dei benchmark su problem solving complessi, la posta in gioco non è il punteggio, ma la percezione di affidabilità: l’utente esperto non accetta un modello che “ci prova”. Pretende coerenza, gestione dei dettagli e un livello di controllo che riduca gli errori silenziosi. La preview, in questo senso, è un segnale: Google non vende un traguardo definitivo, ma un modello in evoluzione che vuole essere testato dentro casi reali prima di essere spinto come default.

Dove arriva Gemini 3.1 Pro: API, Vertex AI, Gemini app e NotebookLM

Il rilascio di Gemini 3.1 Pro viene descritto come trasversale, con disponibilità tramite Gemini API e Vertex AI per il mondo developer e enterprise, e integrazione nella Gemini app e in strumenti come NotebookLM per l’uso quotidiano. Questa distribuzione multipiattaforma è un dettaglio che conta, perché chiarisce l’obiettivo di Google: non creare un “prodotto AI” separato, ma innestare la capacità del modello in stack già esistenti. Sul lato API e Vertex AI, la scelta di una preview è quasi un invito a chi costruisce prodotti: provate ora, misurate ora, portate feedback ora. Il sottotesto è evidente. Se l’AI deve diventare un componente industriale, deve convivere con requisiti che un chatbot non vede mai: latenza, costi, policy, logging, sicurezza, integrazione dati, controllo accessi, osservabilità. È qui che il reasoning “da demo” diventa reasoning “da piattaforma”. Sul lato consumer, l’integrazione nella Gemini app e in NotebookLM ha un valore diverso: spingere l’idea che l’AI non sia solo Q&A, ma un layer per sintetizzare, organizzare, trasformare contenuti in output utili. NotebookLM, in particolare, ha senso in questa logica perché è un ambiente dove l’utente pretende un modello capace di reggere documenti lunghi, contesti multipli e richieste iterative, senza perdere il filo.

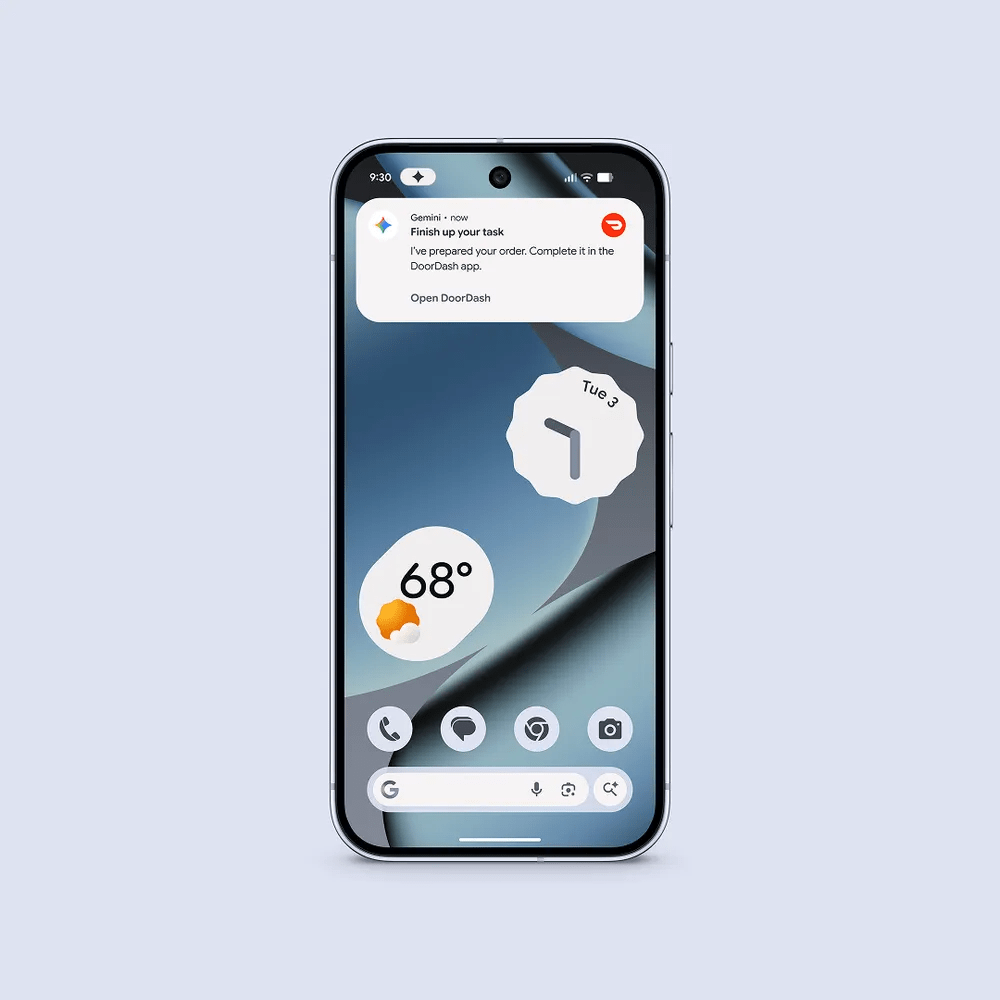

Task multi-step in background: la Gemini app su Android diventa un esecutore controllabile

La novità più “politica” del pacchetto è l’introduzione, nella Gemini app per Android, di task multi-step in background. Non è un miglioramento estetico: è un cambio di ruolo. La Gemini app smette di essere una finestra di risposta e prova a diventare un esecutore di azioni ripetitive, con un modello che avvia un processo, lo porta avanti in più passaggi e ti notifica a completamento. Gli esempi raccontano bene il target. Ordinare di nuovo un pasto, riordinare la spesa, prenotare una corsa verso casa: attività semplici, ma fastidiose perché richiedono micro-interazioni, conferme, navigazione tra schermate. Qui l’idea è comprimere quella frizione. L’utente avvia il task con comandi vocali o tenendo premuto il tasto power, l’AI opera in background e l’utente riceve notifiche sullo stato di avanzamento, con possibilità di intervenire o stoppare. La promessa è doppia: automazione e controllo.

Il nodo è la sicurezza, e Google lo affronta dichiarando un perimetro ristretto: l’esecuzione avviene in una finestra virtuale e l’accesso è limitato a un set selezionato di app e categorie. L’idea della finestra virtuale è importante perché risponde alla diffidenza naturale verso gli agenti: nessuno vuole un’assistente che “ha accesso a tutto”. Qui l’automazione viene venduta come funzione che si muove in un recinto, con trasparenza tramite notifiche e possibilità di interruzione. Il rollout iniziale in beta, negli USA e in Corea, su dispositivi specifici come Pixel 10 e Samsung Galaxy S26, scopri su Amazon, e con requisito di età 18+, è un altro indicatore: Google preferisce un rilascio controllato, sia per limitare i rischi reputazionali sia per raccogliere dati d’uso in un contesto gestibile. È una forma di prudenza che, in un momento in cui l’AI viene accusata di invadere spazi senza consenso, diventa parte della narrativa di prodotto: automazione sì, ma con interruttori.

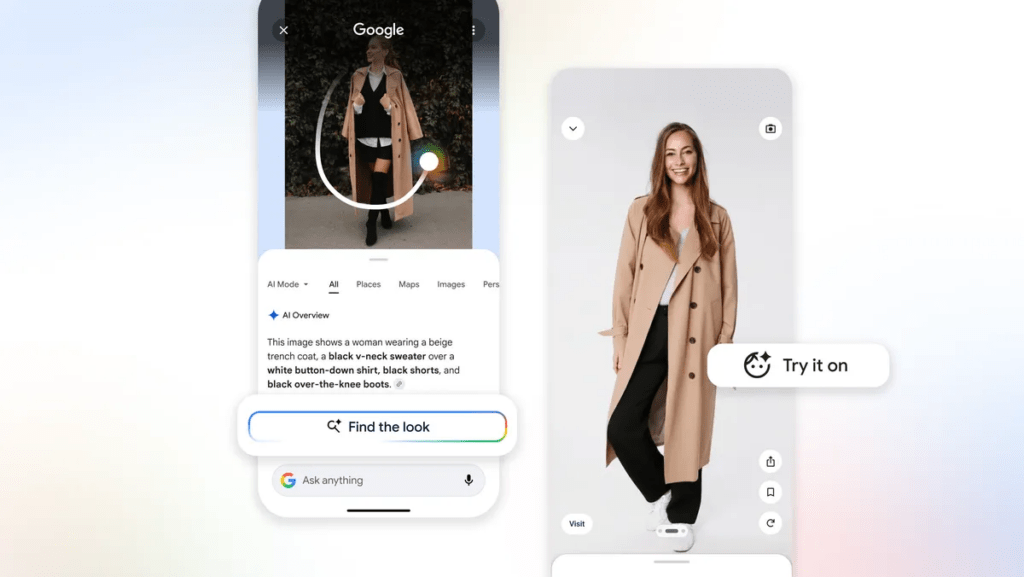

Circle to Search cambia pelle: dalla “cerchiatura” a una lettura multi-oggetto dell’immagine

Circle to Search è già uno dei simboli dell’Android AI di Google: un gesto rapido, un contesto visivo, una risposta immediata. Ora, con l’aggiornamento, la feature viene spinta verso una dimensione più ambiziosa: ricerca multi-oggetto e capacità di identificare non solo elementi singoli, ma relazioni tra oggetti all’interno di un’immagine.

È un cambiamento sottile, ma sostanziale. La ricerca visuale tradizionale tende a isolare un oggetto e a “matcharlo” con un database. Qui l’obiettivo è più vicino a una lettura semantica: cerchi più elementi, il sistema li riconosce, li mette in relazione e propone risultati che rispecchiano il contesto. Nella narrativa, questo si traduce in casi moda, outfit completi e suggerimenti di stile, ma il sottotesto è più ampio: riconoscere relazioni significa avvicinarsi a un motore di ricerca che non cerca solo “cose”, ma cerca scene. Il try-on virtuale e l’ispirazione moda sono esempi perfetti per un lancio consumer perché sono immediati, visuali, raccontabili. Ma l’impatto reale si vedrà quando la multi-oggetto verrà usata su immagini “sporche”: foto con molti elementi, riflessi, sfondi confusi, soggetti parzialmente coperti. È lì che si misura se l’AI sta davvero spostando l’asticella o se sta solo aggiungendo un effetto wow.

Anche qui il rollout passa da dispositivi specifici, con Galaxy S26 e Pixel 10 in prima linea. Non è un caso: Circle to Search è un vettore di differenziazione hardware, e Google ha tutto l’interesse a legarlo a nuove generazioni di dispositivi, spingendo l’idea che l’AI “vera” arrivi quando hardware e software sono progettati insieme.

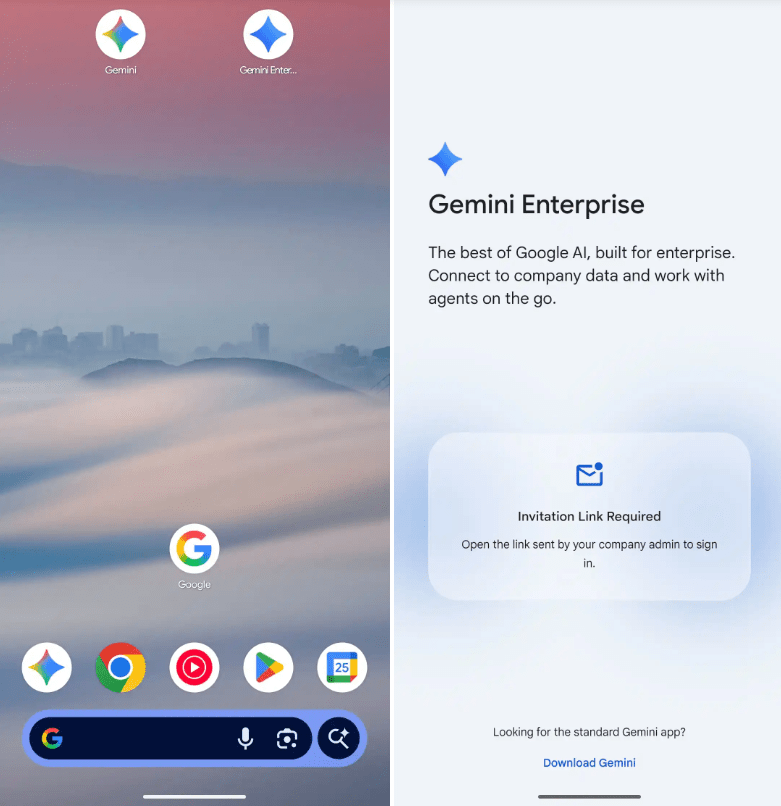

Gemini Enterprise app: Google separa il consumer dal lavoro, e mette Workspace al centro

L’altra mossa chiave è la nuova Gemini Enterprise app, pensata per gli utenti di Google Workspace e, soprattutto, per rispondere a un’esigenza che le aziende ripetono da mesi: vogliamo l’AI, ma vogliamo anche governance, policy e confini. La scelta di una app enterprise separata è un segnale. Google non vuole che l’AI per il lavoro sia percepita come “la stessa cosa” della Gemini app consumer. Vuole un prodotto con identità diversa, accesso controllato da admin, e integrazioni profonde con gli strumenti di lavoro. Questo significa, nella pratica, che l’utente enterprise non sta solo chattando: sta interrogando contesti come chat, documenti, file, calendari e dati, con regole di accesso definite dall’organizzazione.

Le funzionalità descritte ruotano intorno a tre assi. Il primo è la produttività quotidiana, con riassunti e recupero di informazioni, anche in ambienti come Google Chat, filtrando per mittenti e date e aggiornando su topic specifici. Il secondo è l’analisi, con agenti first-party per Data Insights e strumenti in ambito scientifico, che spostano Gemini da assistente generico a componente di lavoro specializzato. Il terzo è l’estensione, con integrazioni anche verso ecosistemi esterni come Microsoft 365, Salesforce e SAP, cioè l’idea che Gemini debba vivere in un mondo ibrido, non solo dentro Google. Il punto più interessante è l’accenno a un visual builder low-code per creare agenti custom. Qui Google sta dicendo, implicitamente, che l’enterprise non vuole solo “usare” agenti preconfezionati: vuole costruire automazioni su misura senza trasformare ogni progetto in un cantiere software. Se il builder funzionerà davvero, sarà uno snodo strategico: l’AI diventerà una piattaforma di composizione di workflow, non solo un modello da interrogare.

Disponibilità, dispositivi e rollout: prudenza e controllo come parte del messaggio

La disponibilità viene raccontata come graduale e selettiva. Preview per il modello, beta per i task multi-step, inviti admin per l’app enterprise, paesi specifici per le prime release, dispositivi specifici per le funzioni più spinte. Questa struttura non è solo logistica. È un modo per raccontare che l’AI entra nelle interfacce senza diventare incontrollabile. I task multi-step, in particolare, sono un terreno minato: basta un caso di automazione percepita come invasiva per trasformare una feature in boomerang. Per questo Google insiste su notifiche, possibilità di stop, perimetro ristretto di app e “finestra virtuale”. Anche Circle to Search, nel suo potenziamento, resta legata a device che possono garantire prestazioni e latenza coerenti con una UX che deve essere immediata. Nel mezzo c’è l’ecosistema: Gemini 3.1 Pro come motore, Android e Search come superfici, Workspace come piattaforma di lavoro. È una triangolazione che chiarisce l’obiettivo: far sì che Gemini non sia percepito come “un prodotto”, ma come una presenza costante che cambia il modo di usare smartphone, ricerca e strumenti professionali.

Perché Google spinge sugli agenti: l’AI come interfaccia, non come app

Se si guarda l’insieme, la mossa più netta è il passaggio dall’AI come app all’AI come interfaccia operativa. Gemini 3.1 Pro promette reasoning migliore perché serve a sostenere processi più lunghi e più delicati. I task multi-step provano a trasformare l’assistente in un esecutore. Circle to Search porta la ricerca visuale in una dimensione semantica più ricca. L’app enterprise separa lavoro e consumer e mette governance al centro. Questo è il punto di collisione con i concorrenti. Oggi non vince chi ha il modello “più grande”, ma chi porta l’AI in punti del sistema dove l’utente sente davvero un vantaggio. Per Google, quei punti sono chiari: Android, Search e Workspace. Se Gemini diventa il layer che connette questi tre mondi, allora la battaglia non è più solo tra modelli, ma tra ecosistemi. C’è anche un aspetto culturale. Google sta tentando di rendere “normale” l’idea di un telefono che fa cose per te, ma senza diventare un telefono che decide al posto tuo. Ecco perché torna sempre il tema del controllo, delle notifiche, dei limiti di accesso. È un messaggio che non è neutro: è una risposta preventiva alla paura che gli agenti siano una scorciatoia verso dispositivi opachi. Il risultato, se tutto regge, è un cambio di aspettative. L’utente esperto non chiede più soltanto una risposta intelligente, ma chiede un assistente che sappia costruire un percorso, eseguire parti di quel percorso e rendere conto di ciò che sta facendo. Gemini 3.1 Pro viene presentato come il modello che può sostenere questa ambizione, mentre le nuove funzioni Android e enterprise sono il tentativo di dimostrarlo fuori dai benchmark.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.