La rete mobile italiana smette di essere un tema da spot e torna, almeno per un momento, a essere una questione misurabile. Il resoconto della campagna MisuraInternet Mobile 2025 mette sul tavolo un’idea semplice, ma scomoda: quando si parla di “5G”, “copertura” e “velocità”, il punto non è la promessa pubblicitaria, ma la differenza tra ciò che la rete può erogare in condizioni controllate e ciò che l’utente percepisce nella vita quotidiana. In mezzo c’è un ecosistema fatto di radio access network, scelte di core network, congestione, priorità, capacità reale dei siti, e una variabile che spesso viene taciuta: la qualità è locale, dipende da dove ti trovi e da cosa sta facendo la rete in quell’istante. Il documento nasce dentro un impianto regolamentare che prova a rendere confrontabile ciò che, per natura, tende a diventare opaco. La cornice è quella tracciata dall’Autorità con la revisione delle regole sulla qualità dei servizi mobili, con obblighi di pubblicazione e trasparenza sulle offerte che includono accesso a Internet, e con un meccanismo che costringe gli operatori a trasformare la qualità in numeri, periodicamente, davanti agli utenti e davanti al regolatore. In questo contesto, MisuraInternet Mobile diventa un termometro pubblico, imperfetto ma utile: non racconta “tutta” la rete, racconta una fotografia ad alta definizione di pezzi di rete, in un set di condizioni dichiarate. Il resoconto della campagna 2025 descrive un lavoro sul campo che si muove su scala nazionale e che, soprattutto, prova a riprodurre il comportamento dell’utente finale senza abbandonare il rigore sperimentale. Qui sta il suo valore, ma anche il suo limite: i drive test non sono la media annuale della tua esperienza, sono una serie di misure ripetibili su percorsi e punti definiti, effettuate con strumenti specifici e con un approccio progettato per mostrare “il massimo conseguibile” più che l’esperienza media del mercato.

Cosa leggere

Il perimetro della campagna 2025: dove si misura e perché

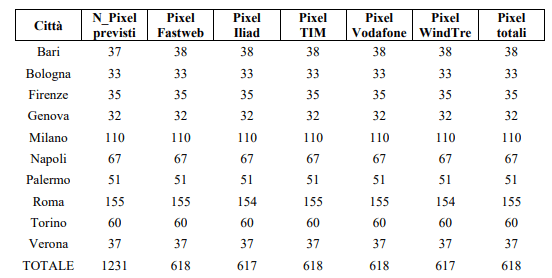

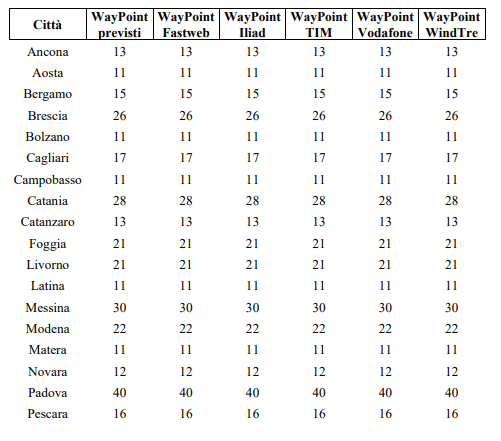

La campagna 2025 lavora su 45 città distribuite su tutto il territorio nazionale, con una combinazione di misure statiche e dinamiche che prova a coprire sia l’uso “nomadico” sia l’uso in movimento, quello che più spesso mette in crisi l’idea ingenua di velocità costante. Il disegno prevede 10 città con misure anche statiche e 35 città con misure esclusivamente dinamiche, vincolando i percorsi urbani a punti di passaggio definiti. Il documento usa un concetto già adottato nelle campagne precedenti: il way-point, un punto di transito che guida i test dinamici dentro la città e rende più strutturabile la comparazione tra aree e operatori. Sul piano operativo, la campagna lavora dal lunedì al venerdì, in fascia oraria diurna estesa, con test distribuiti tra punti e percorsi. Il resoconto riporta una pianificazione con 617 pixel e 614 way-point programmati, una durata di 10 minuti per ogni misura statica, e un impianto che include misure dinamiche urbane e spostamenti extraurbani. Questa impostazione serve a evitare l’effetto “prova in vetrina”: misurare solo dove la rete è già nota come performante produrrebbe risultati interessanti ma poco informativi. Gli operatori coinvolti sono quelli con infrastruttura propria e copertura significativa della popolazione: Fastweb, Iliad, TIM, Vodafone, WindTre. Questa selezione evita la confusione tipica delle reti appoggiate o degli accordi wholesale, ma sposta il focus sul cuore competitivo della rete mobile in Italia: chi controlla l’infrastruttura, controlla anche l’esperienza, o almeno ne determina i vincoli principali.

La macchina di misura: “best technology”, strumenti e condizioni

Il punto più delicato del resoconto è anche quello più facile da fraintendere: l’approccio best technology. Significa che la campagna non misura “la tua tariffa”, misura ciò che la rete può offrire quando la configurazione di test sfrutta la migliore tecnologia disponibile in quel punto, fino al 5G, e quando l’ecosistema tecnico non introduce limitazioni volontarie. L’obiettivo è esplicitamente informativo: fornire una stima delle massime prestazioni conseguibili in condizioni controllate. Questo approccio è utile perché separa, almeno in parte, la capacità potenziale della rete dalle scelte commerciali sulle offerte. Ma è anche un punto che richiede onestà interpretativa: chi usa un’offerta con prestazioni inferiori, o chi vive in aree dove il 5G è meno penetrante, può percepire una distanza importante dai numeri pubblicati. Il documento lo dichiara in modo netto: la fotografia del drive test può non rappresentare la media delle prestazioni sperimentate dagli utenti sull’intera rete.

La strumentazione di test, però, rende coerente la fotografia. Il resoconto indica un terminale specifico, Samsung Galaxy S25+ con sistema operativo Android, e una piattaforma di misura dedicata, Rohde & Schwarz SmartBenchmarker con release software dichiarata. La campagna usa un punto di attestazione di rete, un NAP a Milano (MIX), che aiuta a normalizzare le condizioni lato Internet e a ridurre variabili esterne. Anche qui, l’interpretazione va fatta con attenzione: un NAP definito rende comparabili le misure, ma non elimina la variabilità dell’ultimo miglio radio e delle scelte di instradamento interne alla rete dell’operatore.

Cosa si misura davvero: KPI che contano e KPI che ingannano

La campagna non parla di “tacche” o di “barre”, parla di indicatori che descrivono il servizio dati in modo più vicino all’esperienza reale. Il pacchetto di KPI include velocità di download e upload su trasferimenti HTTP multi-stream, tempi di navigazione per HTTP e HTTPS, round trip time come metrica di latenza, jitter come variabilità del ritardo, packet loss come perdita di pacchetti, e un set di indicatori legati allo streaming video: tempo di inizio riproduzione, tasso di interruzione per freezing, e tasso di esecuzione in HD. Accanto ai valori medi, il documento inserisce anche metriche di affidabilità del test: tasso di mancata accessibilità e tasso di fallimento. Sono indicatori spesso trascurati nella narrazione mainstream, ma in rete mobile contano quanto la velocità: una rete che “va fortissimo” quando aggancia bene, ma fallisce più spesso l’accesso o interrompe il servizio, produce frustrazione e non fiducia. In pratica, questi KPI disegnano tre piani di realtà. Il primo è la capacità di trasferire dati in quantità, cioè la banda. Il secondo è la capacità di rendere l’interazione immediata, cioè latenza e jitter. Il terzo è la stabilità, cioè accessibilità e continuità, con lo streaming come cartina di tornasole perché amplifica ogni micro-instabilità.

Le medie complessive in modalità statica: velocità alta, latenza contenuta

Nelle misure statiche, calcolate sull’insieme dei pixel delle città testate anche in statica, il resoconto riporta valori medi che restituiscono l’immagine di una rete mobile che, in condizioni controllate e con tecnologia migliore disponibile, raggiunge numeri solidi. La velocità media di download si attesta a 331.679 kbps, mentre l’upload medio arriva a 58.294 kbps. Tradotti in megabit, sono ordini di grandezza che raccontano un’infrastruttura capace di sostenere servizi pesanti e simultanei, soprattutto quando il terminale resta fermo e la rete non deve gestire continui handover.

Sul piano della reattività, la latenza media (RTT) scende a 27,97 ms, con jitter medio a 4,54 ms e perdita pacchetti media a 0,71%. Sono numeri che, letti in chiave utente, significano sessioni più stabili per chiamate IP, videoconferenze e gaming casual, pur con le limitazioni tipiche del mobile rispetto a un accesso fisso ben dimensionato.

Lo streaming video, in statica, appare come la parte più “matura” del quadro: il tempo medio di avvio riproduzione è 0,51 secondi, il tasso di esecuzione in HD arriva a 99,69%, e il tasso di interruzione per freezing resta praticamente nullo, con una traccia minima che segnala più un controllo di qualità del test che un problema strutturale. Questi dati, però, non vanno letti come promessa universale. Vanno letti come segnale di capacità: la rete, in condizioni favorevoli, tiene. Ed è proprio quando la rete “tiene” che diventa interessante osservare dove e come smette di farlo.

La modalità dinamica: la rete in movimento paga il prezzo della realtà

Quando le misure passano alla modalità dinamica, cioè al comportamento in movimento che più assomiglia alla vita urbana, i numeri cambiano e raccontano il costo operativo della mobilità. La velocità media di download scende a 268.796 kbps, mentre l’upload medio arriva a 54.232 kbps. La banda resta alta, ma perde quella punta di stabilità e continuità che il test statico restituisce. Il salto più significativo riguarda la latenza e la stabilità del trasporto: l’RTT medio sale a 36,34 ms, il jitter medio cresce a 5,75 ms, la perdita pacchetti media raddoppia in modo sensibile fino a 1,49%. Non sono numeri catastrofici, ma sono numeri che spiegano perché alcune esperienze “in movimento” risultano più fragili: non serve un collasso della banda per percepire peggioramento, basta una latenza meno prevedibile e un aumento della perdita pacchetti per trasformare un’app fluida in un’app che “si impunta”. Anche lo streaming si muove nella stessa direzione. Il tempo medio di avvio riproduzione sale a 0,63 secondi, il tasso di esecuzione in HD resta alto a 99,59%, ma emerge un 0,01% di freezing medio che in statica era sostanzialmente assente. Nel linguaggio dell’utente, significa che il video continua a partire quasi sempre e quasi sempre in alta definizione, ma l’ecosistema mobile mostra più spesso piccoli strappi, soprattutto quando la rete gestisce passaggi di cella, carichi radio variabili e condizioni non ripetibili. Il documento propone anche una lettura per fasce demografiche delle città, e qui emerge un punto che spesso viene ignorato nel discorso pubblico: la dimensione della città non coincide automaticamente con la qualità, perché nelle grandi aree urbane convivono densità, migliore infrastrutturazione e, insieme, congestione più elevata. In altre parole, la grande città può offrire tecnologia migliore ma anche più competizione per le risorse radio. E infatti il resoconto sottolinea che la significatività dei risultati si intreccia con la penetrazione reale delle tecnologie migliori nel mercato: una best technology poco diffusa tende a performare meglio nei test perché trova meno utenti concorrenti sulle stesse risorse.

Quanto pesa davvero il 5G nel traffico: la distanza tra etichetta e uso

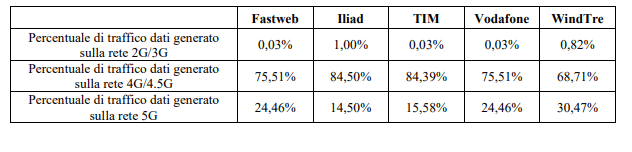

Una delle parti più preziose del resoconto è quella che mette in relazione la campagna best technology con il grado di utilizzo delle tecnologie. Qui il documento riporta, per ciascun operatore, la percentuale di traffico dati generato su 2G/3G, su 4G/4.5G e su 5G. Il quadro che emerge è chiarissimo: il 2G/3G pesa poco, ma non è ovunque scomparso. Il traffico su 2G/3G resta a 0,03% per Fastweb, TIM e Vodafone, ma sale a 1,00% per Iliad e a 0,82% per WindTre. La parte dominante, per molti, è ancora il 4G/4.5G: 75,51% per Fastweb e Vodafone, 84,50% per Iliad, 84,39% per TIM, 68,71% per WindTre.

Il 5G, invece, mostra una penetrazione reale che varia in modo netto: 24,46% per Fastweb, 14,50% per Iliad, 15,58% per TIM, 24,46% per Vodafone, 30,47% per WindTre. Questo passaggio, più di qualunque slogan, spiega perché l’esperienza degli utenti resta disomogenea: anche quando la rete “ha” 5G, non significa che una quota dominante del traffico passi in 5G, e soprattutto non significa che il 5G venga agganciato e mantenuto con la stessa continuità ovunque. Il resoconto, in sostanza, consegna una lettura strutturale: la campagna misura il massimo conseguibile, ma il mercato vive ancora in larga parte su 4G e 4.5G. Di conseguenza, la distanza tra i numeri “di targa” e l’esperienza quotidiana non dipende solo dalla copertura, dipende anche da quanta popolazione e quanto traffico insistono su quel livello tecnologico. Dove il 5G pesa di più nel traffico, l’ecosistema di accesso tende a essere più “reale”, perché non resta un livello premium da pochi.

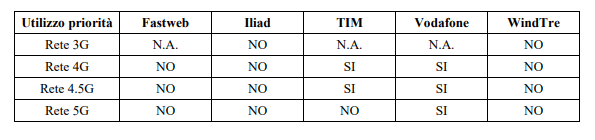

Priorità delle SIM e gestione della congestione: il dettaglio che cambia la percezione

Un altro punto tecnico, ma politicamente rilevante, riguarda i meccanismi di priorità nell’accesso alle risorse condivise. Il resoconto indica che alcuni operatori implementano priorità sulle reti 4G e 4.5G, e che nel 5G la situazione cambia. In particolare, il documento riporta la presenza di priorità su 4G e 4.5G per TIM e Vodafone, e la presenza di priorità anche su 5G per Vodafone, mentre altri operatori indicano assenza di priorità in quelle condizioni o non applicabilità. Questa informazione non va letta in modo ideologico, va letta in modo operativo. In condizioni di traffico regolare, la priorità può restare invisibile. In condizioni di congestione, la priorità può diventare la differenza tra una sessione che resta stabile e una sessione che degrada. Il resoconto chiarisce anche un punto cruciale: i dati best technology presentati prescindono dalla configurazione di priorità, perché l’attributo assume significatività soprattutto nei picchi di carico. Ma proprio per questo, per l’utente, la priorità è spesso più “vera” della velocità massima: non ti interessa quanto potresti fare in laboratorio, ti interessa se, allo stadio o in stazione, il servizio rimane usabile. Qui si apre un tema che va oltre la tecnica e tocca la trasparenza commerciale. Quando il mercato vende “illimitato” e “5G”, ma la rete gestisce accesso e risorse con livelli di priorità, la domanda diventa inevitabile: l’utente comprende davvero cosa sta comprando? Il resoconto non risponde a questa domanda, ma offre i mattoni per porla nel modo corretto.

Dai KPI alla vita reale: cosa significano download, latenza e video per chi usa la rete

Il valore di un report di misurazione non sta nei numeri isolati, sta nella loro traduzione in conseguenze. Una velocità media di download nell’ordine di centinaia di migabit al secondo, in best technology, significa che il collo di bottiglia per molte attività non è la banda, ma l’ecosistema: server, applicazioni, congestione temporanea, qualità del segnale, e soprattutto gestione dei passaggi tra celle. L’utente che scarica un file pesante in stazione può percepire una rete “lenta” non perché manchi banda, ma perché la sessione si interrompe, riparte, rinegozia. E qui entrano in gioco i tassi di fallimento, la mancata accessibilità e la perdita pacchetti.

La latenza, in particolare, resta la metrica più sottovalutata nel discorso pubblico. Un RTT medio sotto i 30 ms in statica e intorno ai 36 ms in dinamica racconta una rete complessivamente reattiva, ma la media nasconde due cose: la coda, cioè i casi peggiori, e la variabilità, cioè il jitter. Per l’utente, l’impressione di fluidità dipende dal fatto che il ritardo sia prevedibile. Quando il jitter sale, l’app può mostrare micro-ritardi, audio che “aggancia” con fatica, input che arrivano in ritardo, streaming che deve aumentare il buffering. E questo accade anche quando la velocità nominale resta elevata.

Lo streaming video, invece, è la prova del nove perché mette insieme banda, latenza e stabilità. Il fatto che il tasso di esecuzione in HD resti vicino al 100% in entrambe le modalità indica che, nella fotografia MisuraInternet, la rete italiana supporta bene il consumo video, anche in movimento. Ma il comparire di un freezing, seppur minimo, in dinamica, e l’aumento del tempo di avvio riproduzione, mostrano la componente reale della mobilità: l’utente si muove, la rete cambia cella, la qualità fluttua, e il servizio deve adattarsi.

In questo senso, il report non “premia” o “boccia” in astratto: descrive una rete che, al massimo delle condizioni, regge bene carichi moderni, ma che in movimento mostra un degrado fisiologico misurabile. È un messaggio importante perché sposta il discorso dalla narrativa del “5G risolve tutto” a una verità più concreta: la qualità non è un numero, è un insieme di compromessi.

La fotografia e i suoi limiti: perché non è la media dell’Italia, ma resta utile

Il resoconto insiste su un concetto che spesso viene ignorato nei dibattiti social: i risultati dei drive test sono una fotografia in specifici istanti e luoghi, influenzata da contingenze operative non completamente prevedibili o ripetibili. È un avviso metodologico, ma è anche un invito a non usare i numeri come arma retorica. Eppure, proprio perché è una fotografia controllata, questo tipo di misura è utile. In un Paese dove la discussione sulle reti spesso si riduce a percezioni e slogan, un impianto di test dichiarato, con strumenti e KPI pubblici, crea un terreno comune. È come una foto ad alta risoluzione: non racconta l’intero film, ma ti dice dove guardare e cosa cercare quando l’esperienza reale diverge. C’è anche un secondo livello di utilità: la comparabilità tra operatori, quando disponibile nel dettaglio territoriale. Il resoconto evidenzia che i risultati sono resi disponibili anche a livello comparativo, fino al singolo pixel di misura. In pratica, la qualità diventa georeferenziata. E quando la qualità diventa georeferenziata, la retorica perde potere, perché l’utente può confrontare non “l’operatore” in astratto, ma la prestazione in un punto reale, in una città reale, in un contesto reale.

Trasparenza e mercato: cosa cambia quando la qualità diventa un obbligo

Il report si inserisce in una stagione in cui la regolazione spinge gli operatori a pubblicare informazioni più complete e confrontabili: copertura, velocità massima stimata per tecnologia, velocità pubblicizzata, indicatori di qualità per servizi e reclami. Questo non significa che il mercato diventi automaticamente più corretto, ma significa che aumenta la pressione per rendere esplicite le differenze. Quando un operatore comunica “fino a 2 Gbps”, la domanda non dovrebbe più essere “quanto fa in speedtest”, ma “in quali condizioni, con quale tecnologia, e con quale continuità”. MisuraInternet, con tutti i suoi limiti, porta la discussione in quella direzione, perché mette sul tavolo contemporaneamente banda, latenza, stabilità e qualità di esperienza su servizi tipici come web e video. In prospettiva, questo tipo di reporting produce un effetto laterale: costringe gli operatori a competere anche su aspetti meno vendibili, come il packet loss o il jitter, che però incidono sulla qualità percepita quanto, se non più, della velocità di picco. E quando la competizione si sposta su parametri tecnici che non si possono “truccare” facilmente con marketing, la rete torna a essere infrastruttura, non narrazione.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.