Kali Linux introduce una nuova integrazione con LLM locali tramite Ollama e 5ire, permettendo di utilizzare modelli di intelligenza artificiale direttamente su hardware locale senza dipendere da servizi cloud. La guida pubblicata nel blog ufficiale della distribuzione illustra come configurare un ambiente completamente offline per utilizzare modelli come Llama 3.1 e Qwen3 come assistenti per il penetration testing. L’obiettivo dell’iniziativa è consentire agli esperti di sicurezza di interagire con strumenti come Nmap, Gobuster e Dirb utilizzando linguaggio naturale. L’architettura combina un server MCP Kali, che espone API per i tool di sicurezza, con un’interfaccia grafica gestita da 5ire e un sistema di esecuzione dei modelli fornito da Ollama. Questa configurazione permette di mantenere tutti i dati all’interno dell’infrastruttura locale, migliorando privacy e controllo operativo durante attività di analisi e testing.

Cosa leggere

Kali Linux porta l’intelligenza artificiale direttamente nell’ambiente di penetration testing

La crescente diffusione dei modelli linguistici ha spinto molte piattaforme a integrare strumenti basati su AI. Tuttavia gran parte di queste soluzioni dipende da servizi cloud o API esterne. Il nuovo approccio proposto da Kali Linux punta invece su un modello completamente offline, dove i modelli di linguaggio vengono eseguiti direttamente sulla macchina dell’utente. Questo è particolarmente importante in ambienti sensibili come analisi di sicurezza, red teaming o laboratori di ricerca. Utilizzando Ollama come motore per l’esecuzione dei modelli e 5ire come interfaccia grafica, Kali permette di controllare strumenti di sicurezza tramite prompt naturali, riducendo la complessità delle interazioni con la riga di comando. La configurazione è progettata per funzionare anche su hardware relativamente datato, come GPU Nvidia GTX 1060 con 6 GB di VRAM.

Configurazione della GPU Nvidia per accelerare i modelli AI

Uno degli elementi chiave del setup riguarda l’utilizzo della GPU Nvidia per accelerare l’inferenza dei modelli. Kali Linux consiglia di verificare innanzitutto la presenza della scheda grafica utilizzando il comando lspci, che permette di identificare il controller VGA installato. Una volta identificata la GPU, è necessario installare i driver proprietari Nvidia insieme ai pacchetti del kernel e agli header necessari. Questa operazione abilita il supporto CUDA, fondamentale per eseguire modelli di intelligenza artificiale con prestazioni adeguate. Durante la configurazione è importante disabilitare il driver open source Nouveau, che può generare conflitti con i driver proprietari. Dopo il riavvio del sistema è possibile verificare il corretto funzionamento con il comando nvidia-smi, che mostra informazioni su temperatura, consumo energetico e memoria GPU. Nel caso di una GTX 1060 con 6 GB di VRAM, il sistema può gestire diversi modelli linguistici di dimensioni moderate.

Installazione di Ollama come motore per i modelli linguistici

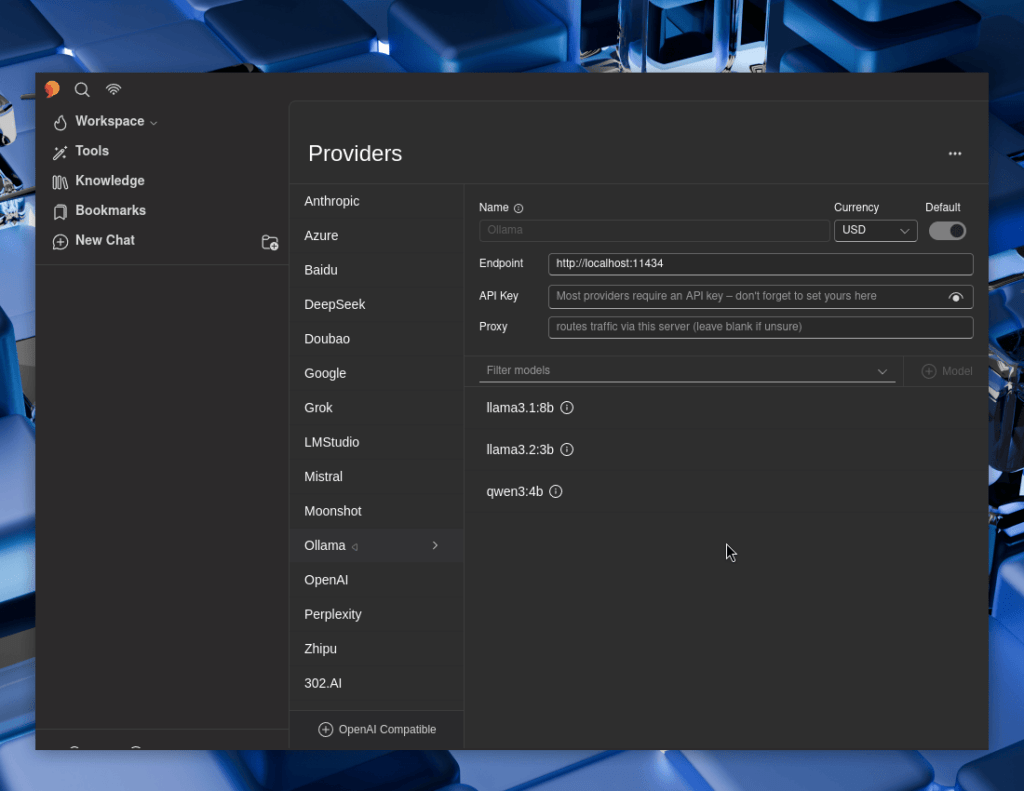

Il componente centrale dell’architettura è Ollama, una piattaforma che consente di eseguire modelli linguistici localmente utilizzando il backend llama.cpp. L’installazione avviene tramite download del pacchetto ufficiale dal sito del progetto e successiva estrazione nel sistema. Dopo l’installazione viene creato un servizio systemd che permette a Ollama di funzionare come servizio persistente. Una volta attivo il servizio, è possibile scaricare i modelli desiderati utilizzando comandi dedicati. Tra quelli consigliati nella guida troviamo:

Llama3.1 8B, circa 4.9 GB

Llama3.2 3B, circa 2 GB

Qwen3 4B, circa 2.5 GB

Questi modelli sono sufficientemente leggeri da essere eseguiti su sistemi con VRAM limitata.

Il sistema può essere testato eseguendo un semplice prompt tramite il comando ollama run, verificando che il modello generi una risposta corretta.

Modelli linguistici consigliati per l’uso in Kali Linux

La scelta del modello è fondamentale per ottenere prestazioni adeguate su hardware locale. Kali Linux suggerisce modelli relativamente compatti che supportino l’uso di strumenti esterni tramite API. Tra i modelli più adatti troviamo Llama3.1, noto per la sua versatilità, e Qwen3, che offre buone capacità di ragionamento e interpretazione dei comandi. Entrambi i modelli supportano contesti fino a circa 4096 token, sufficienti per gestire sessioni di comando e analisi relativamente complesse. Grazie alla GPU Nvidia, l’inferenza può essere eseguita con un utilizzo della GPU che può raggiungere il 100 percento, riducendo significativamente i tempi di risposta rispetto all’esecuzione su CPU.

MCP Kali Server collega l’AI ai tool di sicurezza

Per consentire ai modelli AI di interagire con gli strumenti di sicurezza, Kali introduce il componente MCP Kali Server. Questo server espone una serie di API locali che permettono ai modelli linguistici di eseguire comandi su tool di penetration testing. Il server viene installato tramite il pacchetto mcp-kali-server e avviato come servizio locale. Una volta attivo, il server espone un endpoint locale, tipicamente 127.0.0.1:5000, attraverso il quale possono essere controllati strumenti come:

Nmap

Nikto

Dirb

Gobuster

Metasploit

Il modello linguistico interpreta il prompt dell’utente e traduce l’intenzione in comandi reali eseguiti dal sistema. Questo approccio consente di trasformare i tradizionali strumenti di sicurezza in strumenti AI-assisted.

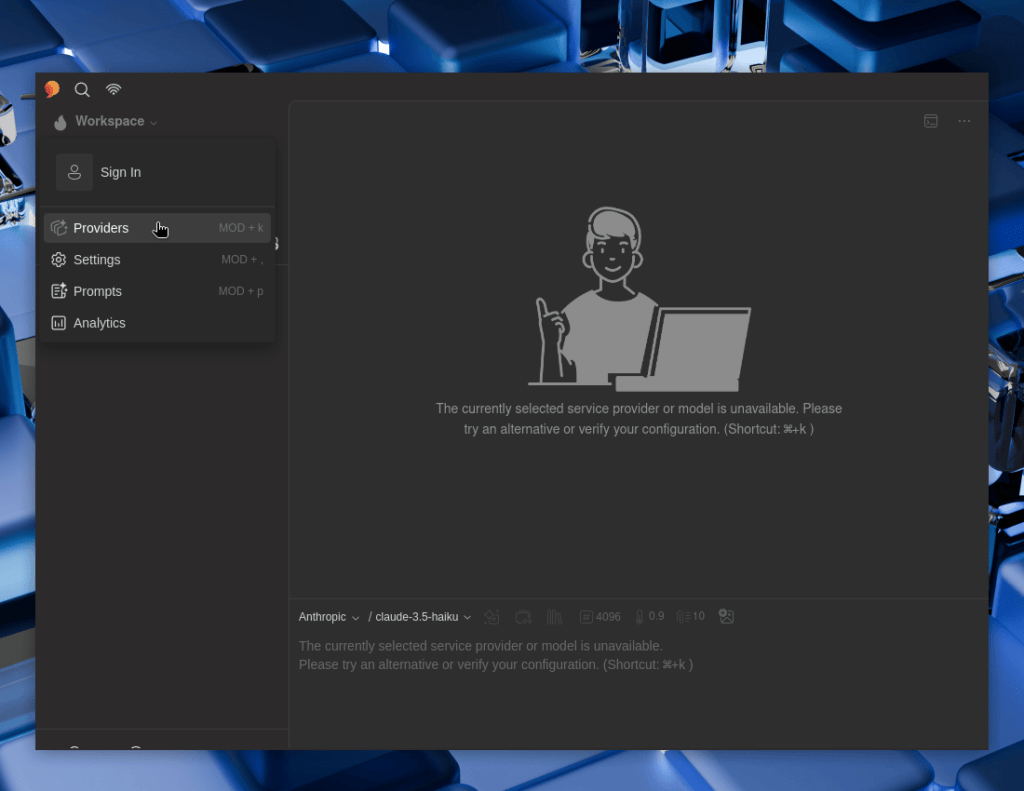

5ire introduce un’interfaccia grafica per l’assistente AI

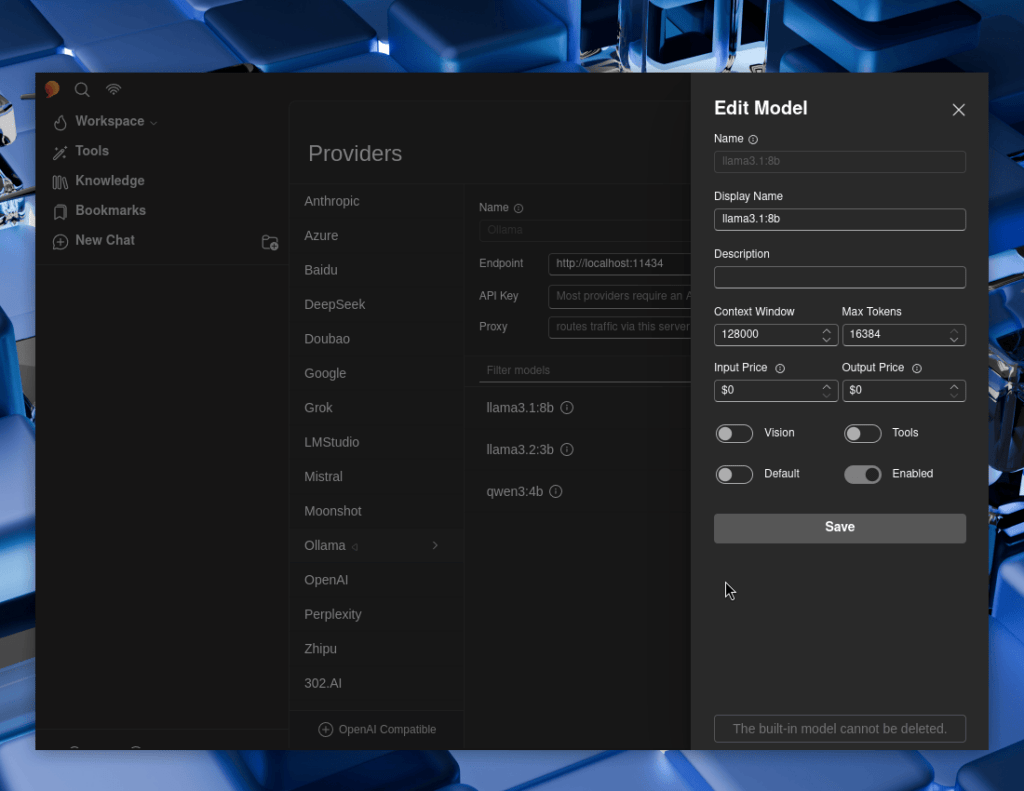

Il terzo elemento dell’architettura è 5ire, un client grafico progettato per interagire con Ollama e il server MCP. Il software viene distribuito come AppImage, il che significa che può essere eseguito senza installazioni complesse o dipendenze aggiuntive. Dopo il download dal repository GitHub, è sufficiente rendere il file eseguibile e avviarlo. Una volta aperta l’interfaccia, l’utente può selezionare il modello locale gestito da Ollama e configurare la connessione al server MCP. L’interfaccia grafica permette di inviare prompt in linguaggio naturale e visualizzare direttamente l’output degli strumenti di sicurezza eseguiti dal sistema. Questo rende l’esperienza molto più accessibile rispetto alla gestione manuale dei comandi da terminale.

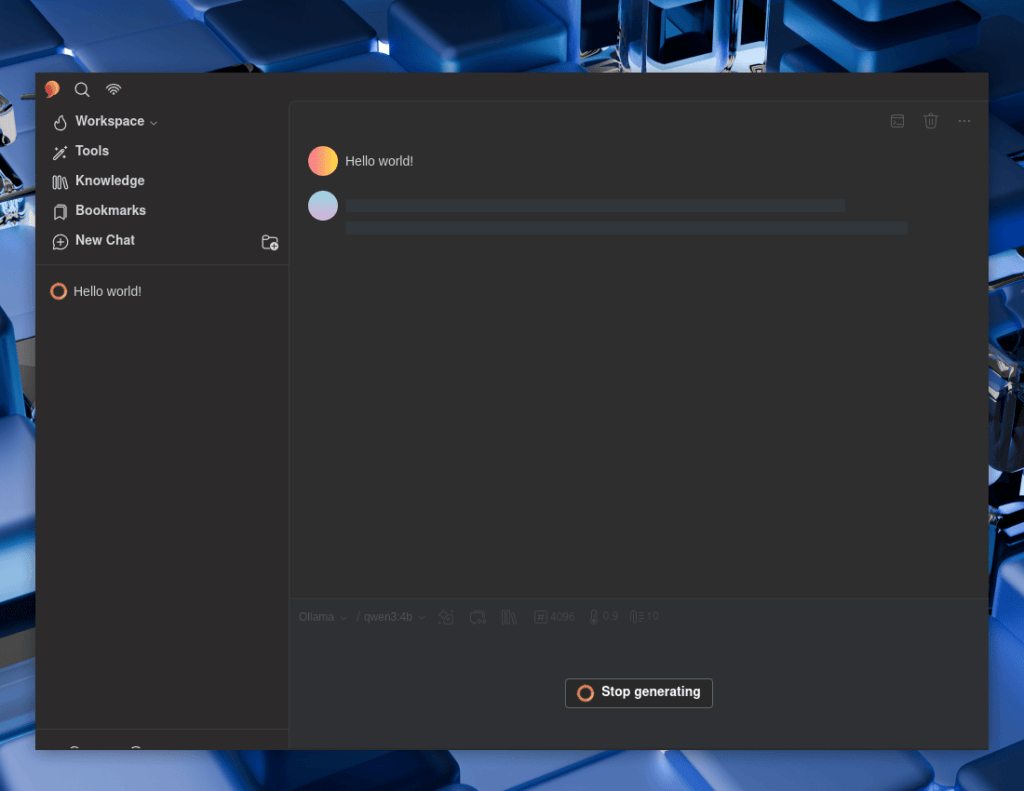

Come funziona l’integrazione tra Ollama, MCP e 5ire

Quando l’utente invia un prompt tramite 5ire, il sistema lo inoltra al modello linguistico eseguito da Ollama. Il modello analizza il prompt e determina quale strumento di sicurezza utilizzare. Se il prompt richiede una scansione di rete, il modello può generare un comando per Nmap. Questo comando viene inviato al MCP Kali Server, che esegue lo strumento e restituisce i risultati. L’output viene quindi visualizzato nella GUI di 5ire, permettendo all’utente di analizzare rapidamente le informazioni ottenute. Questo workflow crea un’interfaccia conversazionale per strumenti tradizionalmente complessi.

Privacy e vantaggi dell’esecuzione locale dei modelli

Uno dei principali vantaggi della soluzione proposta da Kali è la totale indipendenza dal cloud. Tutti i modelli e i dati vengono eseguiti e archiviati localmente. Questo approccio è particolarmente importante in scenari di sicurezza, dove i dati analizzati possono essere sensibili o classificati. Utilizzando modelli open source eseguiti localmente, gli utenti evitano anche costi legati ad abbonamenti SaaS o API commerciali. Inoltre la latenza delle operazioni è ridotta, poiché tutte le elaborazioni avvengono direttamente sul sistema locale.

Requisiti hardware e limiti del sistema

Nonostante la possibilità di utilizzare hardware relativamente datato, l’esecuzione di modelli linguistici richiede comunque risorse adeguate. Una GPU con almeno 6 GB di VRAM consente di eseguire modelli da 3 a 8 miliardi di parametri, ma modelli più grandi richiedono schede grafiche più potenti. La guida di Kali suggerisce comunque di riutilizzare hardware esistente quando possibile, riducendo i costi di implementazione. L’utilizzo di servizi systemd per Ollama e MCP consente inoltre di mantenere i servizi attivi in background.

L’integrazione AI segna una nuova evoluzione per Kali Linux

L’integrazione di LLM locali rappresenta un passo significativo nell’evoluzione di Kali Linux come piattaforma per la sicurezza informatica. L’uso di modelli linguistici per controllare strumenti di penetration testing potrebbe cambiare il modo in cui gli esperti interagiscono con le piattaforme di sicurezza, riducendo la complessità operativa e migliorando l’efficienza. Con l’avanzare dell’intelligenza artificiale locale e l’aumento della potenza hardware disponibile, è probabile che strumenti di questo tipo diventino sempre più diffusi negli ambienti di cybersecurity.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.