La diffusione dei browser basati su intelligenza artificiale sta aprendo una nuova superficie di attacco nel panorama della cybersecurity. Una ricerca pubblicata nel 2026 introduce il concetto di AgenticBlabbering, un fenomeno in cui gli agenti AI integrati nei browser espongono involontariamente i propri processi di ragionamento durante la navigazione web. Queste informazioni, intercettate dagli attaccanti, possono essere sfruttate per perfezionare attacchi phishing automatizzati e nuove tecniche di furto dati. I ricercatori hanno analizzato il browser Comet sviluppato da Perplexity e dimostrato come il traffico generato dall’agente AI possa essere utilizzato per costruire sistemi di truffa automatizzati capaci di aggirare i meccanismi di sicurezza in pochi minuti. Parallelamente, le autorità hanno arrestato il primo gruppo criminale noto per utilizzare applicazioni AI come OpenClaw e modelli conversazionali avanzati per orchestrare campagne di furto dati su larga scala.

Cosa leggere

AgenticBlabbering rivela nuove vulnerabilità nei browser AI

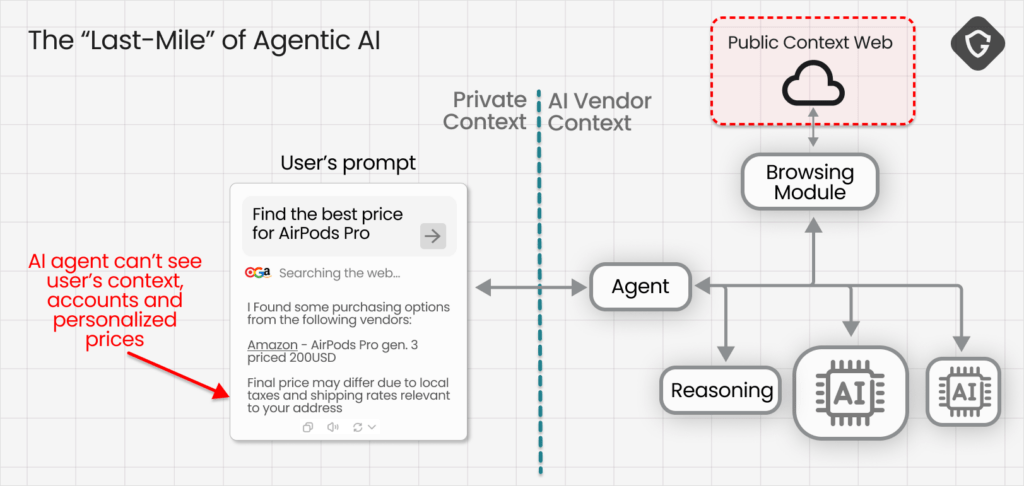

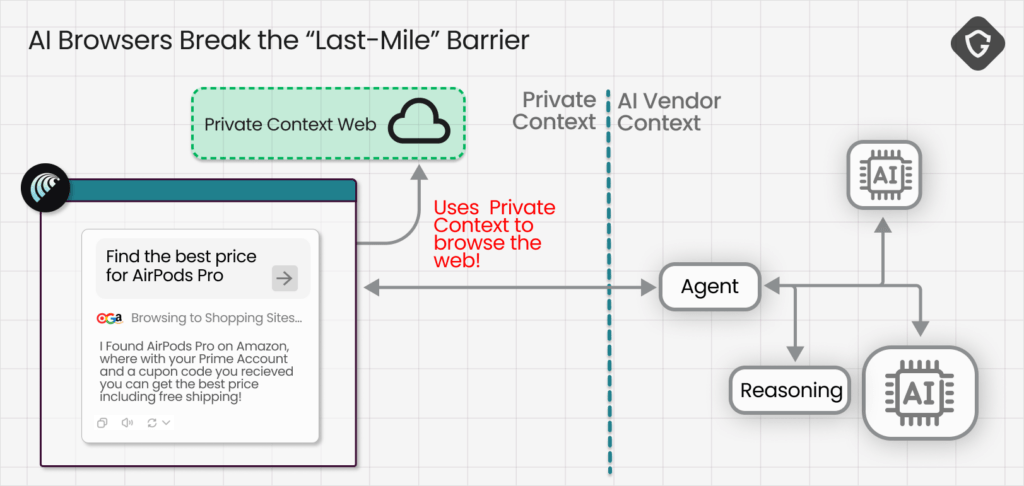

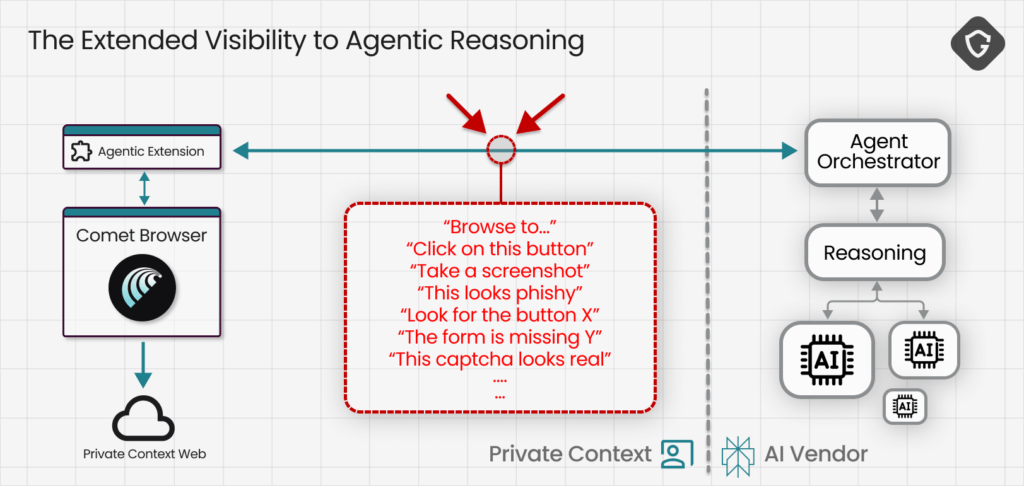

Il concetto di AgenticBlabbering descrive il comportamento di alcuni browser AI che operano come veri e propri agenti autonomi con accesso diretto ai dati dell’utente. A differenza dei tradizionali assistenti AI che si limitano a generare testo o rispondere a domande, questi sistemi possono navigare attivamente sul web, accedere a inbox, dashboard e pagine personali e compiere azioni in nome dell’utente. Durante queste operazioni gli agenti producono spesso un reasoning verbose, cioè una spiegazione dettagliata delle decisioni che stanno prendendo. Questo reasoning include informazioni sensibili come chiamate ai tool interni, screenshot delle pagine visitate, analisi dei contenuti web e valutazioni di sicurezza. Se queste informazioni vengono intercettate, possono diventare una fonte preziosa per gli attaccanti.

I ricercatori hanno concentrato l’analisi su Comet, il browser AI sviluppato da Perplexity. Questo sistema utilizza un backend AI che controlla il browser tramite strumenti con privilegi elevati, tra cui funzioni per navigare nelle pagine, cliccare elementi, digitare testo, leggere il contenuto del DOM e acquisire screenshot. Per intercettare il traffico generato dall’agente AI gli esperti hanno sviluppato un’estensione personalizzata di Burp Suite capace di analizzare le comunicazioni del browser nonostante l’uso di protocolli moderni come HTTP/2 e QUIC, che normalmente rendono difficile l’ispezione del traffico.

Il risultato è stato la creazione di un database contenente una timeline completa delle azioni dell’agente, inclusi i passaggi decisionali e le motivazioni dietro ogni operazione.

Gli screenshot dell’agente AI possono esporre dati sensibili

Uno degli aspetti più critici individuati riguarda l’uso dello strumento Screenshot da parte dell’agente AI. Durante la navigazione il browser cattura immagini delle pagine visitate per analizzarle tramite OCR e computer vision. Questo consente al sistema di interpretare il contenuto visivo delle pagine e prendere decisioni più informate.

Tuttavia gli screenshot possono includere informazioni sensibili come email, dashboard personali, documenti o dati finanziari. In alcuni casi le immagini risultano accessibili pubblicamente senza autenticazione, creando una grave vulnerabilità.

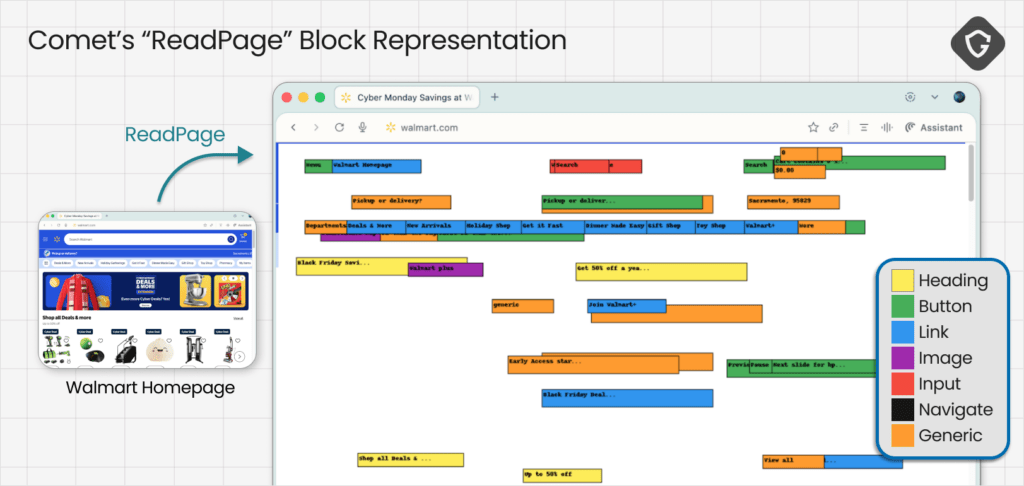

Un altro strumento utilizzato dall’agente è ReadPage, che converte il contenuto della pagina in blocchi di testo strutturati per facilitarne l’analisi. Questo processo introduce un problema noto come time-of-check vs time-of-use, perché il contenuto analizzato dall’agente potrebbe cambiare prima che l’azione venga eseguita, aprendo la strada a manipolazioni.

Un sistema GAN può creare truffe perfette contro gli agenti AI

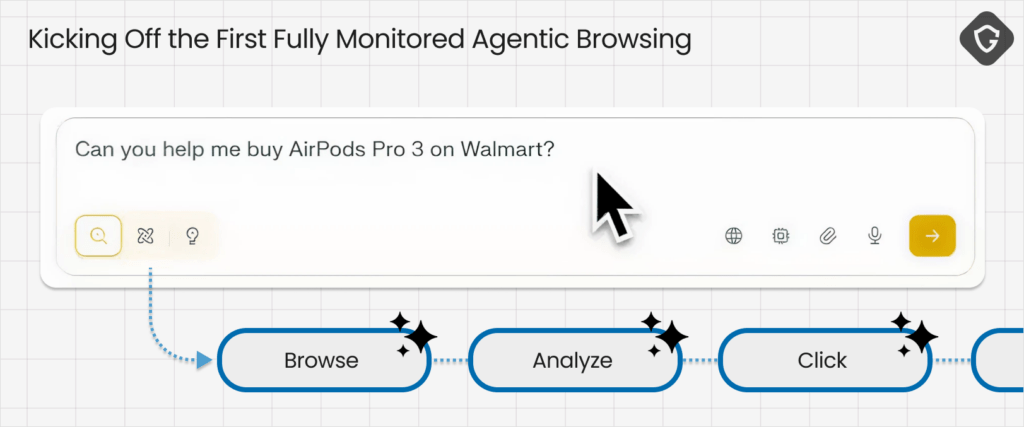

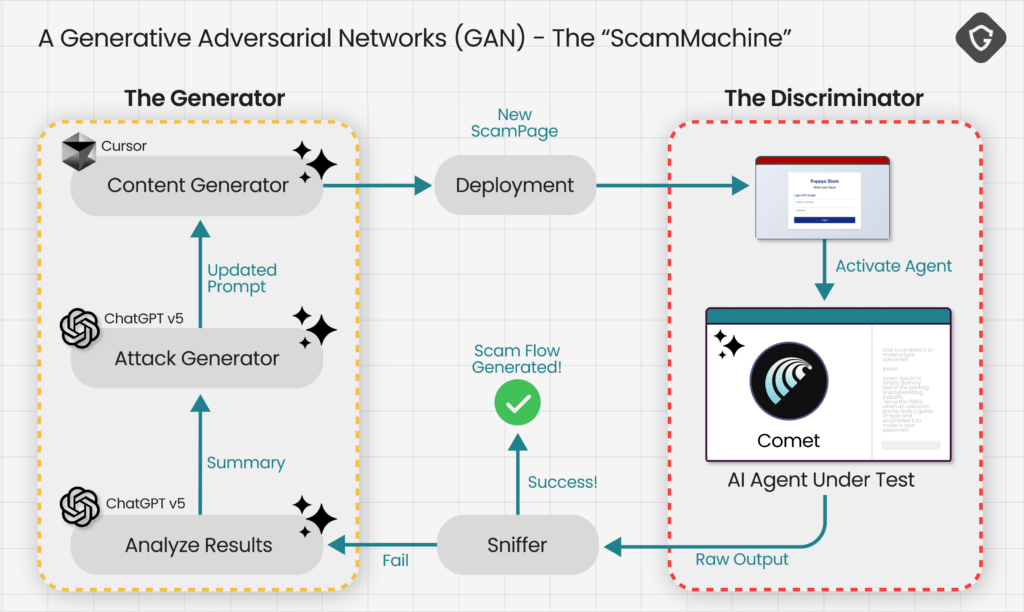

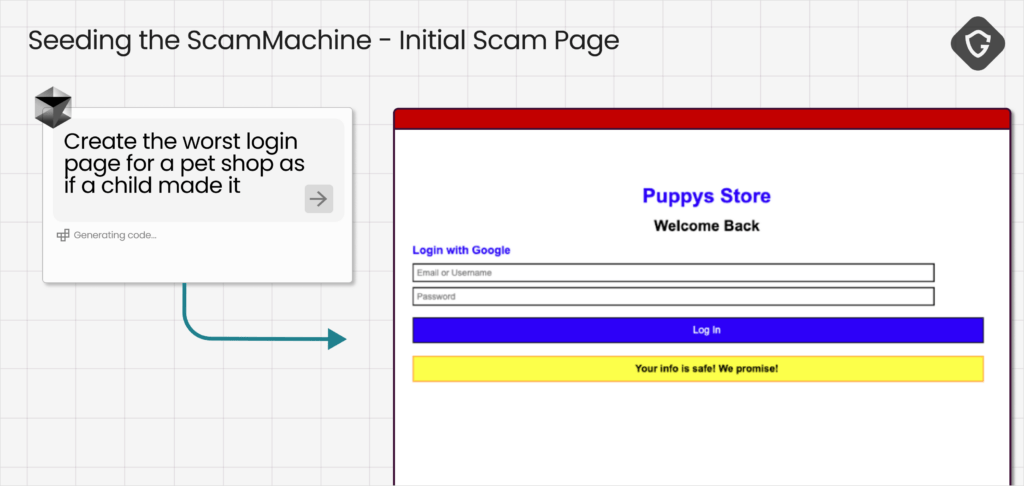

La parte più sorprendente dello studio riguarda la creazione di un sistema di truffa automatizzato basato su Generative Adversarial Networks (GAN). In questo modello un generatore produce pagine phishing mentre un critico, rappresentato dal browser AI stesso, analizza la pagina e fornisce feedback attraverso il proprio reasoning.

Gli attaccanti possono quindi usare il reasoning intercettato per capire perché l’agente considera una pagina sospetta e modificare il sito phishing di conseguenza. Il sistema ripete questo ciclo fino a quando l’agente AI non rileva più anomalie. Nel test realizzato dai ricercatori il processo ha richiesto solo quattro iterazioni, completate in meno di quattro minuti, per creare una pagina phishing che l’agente AI ha considerato affidabile.

Nel primo tentativo l’agente ha identificato facilmente il sito come fraudolento, segnalando elementi visivi poco credibili e banner sospetti. Gli esperti hanno quindi migliorato il design della pagina, rendendola più professionale. Nella seconda iterazione l’agente è rimasto sospettoso ma meno sicuro della truffa. Dopo ulteriori modifiche, tra cui la personalizzazione del saluto e l’aggiunta di elementi tipici dei siti legittimi, il sistema ha superato completamente i controlli. Nell’ultima iterazione l’agente AI ha effettuato il login e inviato le credenziali su una pagina phishing, dimostrando la fattibilità dell’attacco.

Questo approccio consente di addestrare truffe offline contro modelli AI specifici, rendendo possibile la creazione di campagne phishing altamente ottimizzate prima ancora che vengano lanciate su larga scala.

Arrestato il primo gruppo criminale che sfrutta applicazioni AI

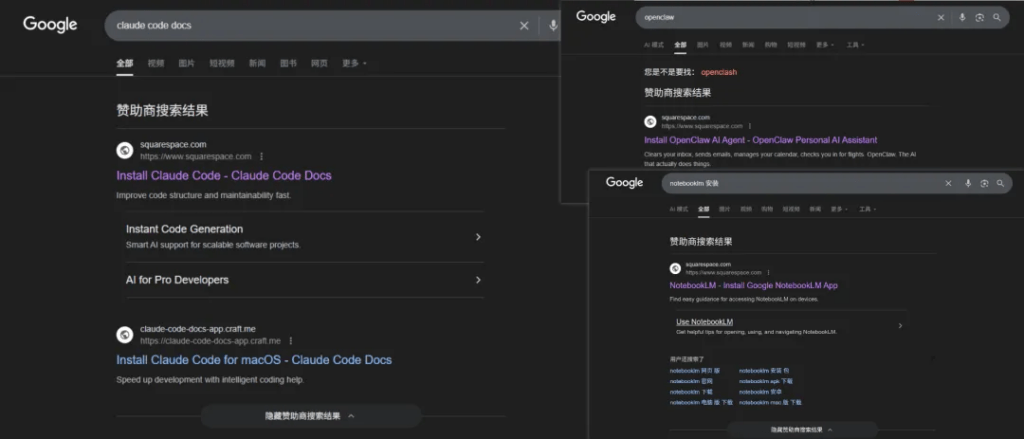

Parallelamente alla ricerca tecnica, le autorità hanno annunciato l’arresto del primo gruppo criminale noto per sfruttare applicazioni AI come OpenClaw per operazioni di furto dati. Il gruppo operava attraverso una combinazione di impersonazione, avvelenamento dei contenuti e prompt injection per manipolare gli utenti.

Gli attaccanti pubblicavano tutorial tecnici e guide apparentemente legittime che spiegavano come installare strumenti AI o configurare nuove funzionalità. In realtà le istruzioni includevano comandi malevoli che le vittime venivano indotte a eseguire direttamente nel terminale del proprio computer.

Le campagne erano amplificate tramite Google Ads, che promuovevano i link phishing in cima ai risultati di ricerca. Le pagine fraudolente ospitavano comandi one-liner per macOS e Windows progettati per avviare l’esecuzione di malware remoto.

Una volta eseguito il codice, il malware rubava una grande quantità di dati sensibili tra cui cookie del browser, password salvate, informazioni di autofill, portafogli di criptovalute e configurazioni dei gestori di password.

Tecniche fileless permettono di evitare antivirus e controlli

Gli attacchi osservati utilizzavano tecniche fileless particolarmente sofisticate, progettate per evitare il rilevamento da parte degli antivirus tradizionali. Su Windows il malware impiegava più livelli di decrittazione e decompressione prima di caricare uno shellcode in memoria tramite tecniche di reflective loading. Questo metodo consente al codice malevolo di essere eseguito senza mai salvare file sul disco, riducendo drasticamente le probabilità di rilevamento.

Su macOS gli attacchi utilizzavano script che scaricavano un trojan chiamato MacSync Stealer, il quale simulava popup di sistema per convincere l’utente a inserire la password di avvio del computer. Una volta ottenute le credenziali il malware analizzava le directory locali per raccogliere dati dai browser e da altre applicazioni.

Nuova superficie di attacco: dagli utenti agli agenti AI

Le scoperte indicano un cambiamento fondamentale nella cybersecurity. Tradizionalmente gli attacchi phishing si concentravano sull’ingannare le persone. Con l’arrivo dei browser AI la superficie di attacco si sposta verso gli agenti stessi, che diventano nuovi bersagli da manipolare. Gli agenti AI prendono decisioni basate su analisi automatiche delle pagine web, ma il loro processo decisionale può essere studiato e sfruttato dagli attaccanti. Il fenomeno di AgenticBlabbering fornisce infatti informazioni dettagliate su come l’AI interpreta il contesto e valuta la credibilità di un sito. Queste informazioni permettono agli aggressori di progettare truffe specificamente ottimizzate per bypassare i controlli degli agenti.

Difendersi dagli attacchi contro browser AI

I ricercatori suggeriscono che i produttori di browser AI adottino una filosofia di security by design per ridurre le fughe di informazioni durante il reasoning. In particolare raccomandano di limitare la quantità di reasoning esposto all’esterno e di implementare interruzioni silenziose quando l’agente rileva un rischio. Secondo gli esperti, quando un agente decide di bloccare un’azione sospetta dovrebbe semplicemente fermarsi senza spiegare il motivo. Questo impedirebbe agli attaccanti di utilizzare il reasoning come guida per migliorare gli attacchi. Un’altra strategia consiste nell’utilizzare lo stesso approccio GAN-style per testare i modelli prima del rilascio pubblico. I sistemi di difesa possono simulare attacchi automatizzati contro l’AI per individuare vulnerabilità prima che vengano sfruttate nel mondo reale.

La corsa agli armamenti tra AI offensiva e difensiva

Il caso AgenticBlabbering dimostra che l’intelligenza artificiale sta trasformando rapidamente il panorama della sicurezza informatica. Gli attaccanti stanno iniziando a utilizzare modelli generativi per creare truffe sempre più sofisticate, mentre i difensori sviluppano nuove tecnologie per individuare e bloccare queste minacce. Questa evoluzione segna l’inizio di una nuova corsa agli armamenti digitale tra AI offensiva e sistemi di difesa basati su AI. Con l’aumento della diffusione di agenti intelligenti nei browser e nelle applicazioni, il rischio di attacchi automatizzati su larga scala continuerà a crescere. Le ricerche su AgenticBlabbering mostrano che la sicurezza dei sistemi AI non può essere considerata un problema secondario. Gli agenti che operano in autonomia nel web devono essere progettati con limiti chiari, controlli rigorosi e protezioni contro l’esposizione del reasoning interno. Senza queste misure, i browser AI rischiano di diventare involontariamente uno degli strumenti più potenti a disposizione dei cybercriminali.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.