Un consorzio internazionale di ricercatori ha sviluppato Humanity’s Last Exam (HLE), un nuovo benchmark progettato per valutare in modo più rigoroso le capacità dei modelli di intelligenza artificiale avanzata. Il progetto introduce un esame composto da 2.500 domande altamente specialistiche, creato da quasi 1.000 esperti accademici provenienti da discipline diverse. L’obiettivo è superare i limiti dei benchmark tradizionali come MMLU (Massive Multitask Language Understanding), che negli ultimi anni sono diventati relativamente facili per i modelli linguistici più avanzati. I risultati iniziali mostrano un quadro sorprendente: molti sistemi AI leader del settore ottengono punteggi molto bassi. Ad esempio GPT-4o raggiunge solo il 2,7%, mentre Claude 3.5 Sonnet arriva al 4,1%. Anche modelli più recenti come Gemini 3.1 Pro e Claude Opus 4.6 si fermano tra il 40% e il 50%, dimostrando che esiste ancora un ampio divario tra intelligenza artificiale e conoscenza umana specialistica. Lo studio è stato pubblicato sulla rivista scientifica Nature e rappresenta uno dei tentativi più ambiziosi di misurare la reale comprensione dei sistemi AI.

Cosa leggere

Perché serviva un nuovo benchmark per l’AI

Negli ultimi anni i modelli di intelligenza artificiale hanno raggiunto prestazioni molto elevate nei benchmark accademici tradizionali. Tuttavia molti ricercatori hanno iniziato a sospettare che questi test non fossero più sufficienti per valutare le capacità reali dei sistemi. Molti benchmark misurano infatti abilità come riconoscimento di pattern o recupero di informazioni già presenti online. Questo significa che i modelli possono ottenere punteggi elevati senza dimostrare una vera comprensione del problema. Per questo motivo un gruppo internazionale di ricercatori ha deciso di creare Humanity’s Last Exam, un test progettato specificamente per superare queste limitazioni. Il benchmark è stato costruito attraverso un processo rigoroso: ogni domanda è stata progettata da esperti nel proprio campo e verificata da altri specialisti per garantire precisione, unicità della risposta e impossibilità di risolvere il problema tramite semplice ricerca online.

Il contributo di Dr. Tung Nguyen

Tra i principali contributori del progetto figura Dr. Tung Nguyen, professore associato di Computer Science and Engineering alla Texas A&M University. guyen ha scritto 73 domande dell’esame, il secondo contributo più ampio tra tutti i ricercatori coinvolti. Le sue domande si concentrano principalmente su matematica e informatica, due ambiti particolarmente complessi per i sistemi AI. Secondo Nguyen, il progetto dimostra che l’intelligenza artificiale eccelle nel riconoscere pattern e correlazioni nei dati, ma fatica ancora quando è richiesta una comprensione profonda del contesto o una conoscenza altamente specializzata. Il ricercatore sottolinea che l’obiettivo dell’esame non è dimostrare la superiorità dell’uomo sull’AI, ma fornire strumenti più accurati per valutare i progressi tecnologici.

Come è stato costruito Humanity’s Last Exam

La creazione del benchmark ha richiesto la collaborazione di quasi mille ricercatori provenienti da università e istituti di ricerca di tutto il mondo. Il processo di sviluppo ha seguito diverse fasi. Inizialmente gli esperti hanno proposto domande altamente specialistiche nei rispettivi campi. Successivamente il team ha testato ogni quesito contro i principali modelli AI disponibili. Se un modello riusciva a rispondere correttamente, la domanda veniva rimossa o modificata. Questo metodo ha permesso di costruire un esame che si colloca deliberatamente oltre le capacità attuali dei sistemi AI.

Le discipline coinvolte sono estremamente diverse e includono matematica avanzata, linguistica storica, biologia, fisica, medicina e scienze umane. Questa diversità rende l’esame uno strumento particolarmente efficace per individuare i limiti dell’intelligenza artificiale.

Domande che richiedono vera expertise

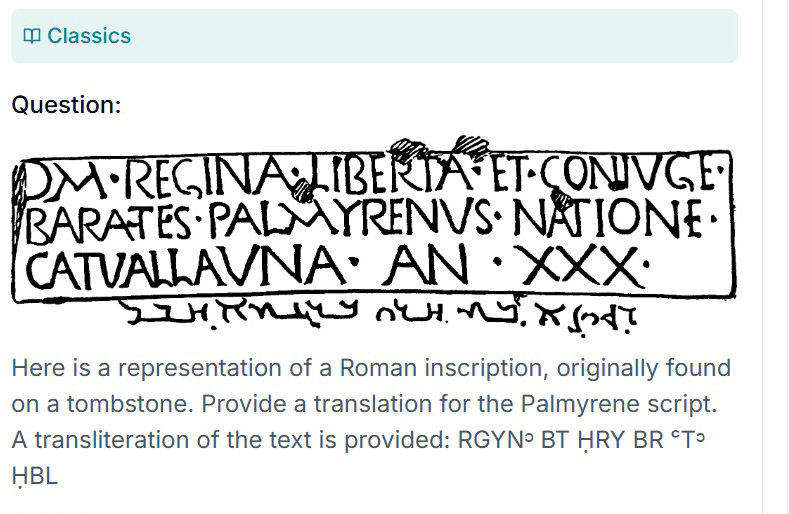

Le domande presenti in Humanity’s Last Exam sono progettate per richiedere conoscenze specialistiche molto specifiche. Alcuni esempi includono la traduzione di iscrizioni antiche in lingua palmirena, l’identificazione di strutture microanatomiche negli uccelli e l’analisi delle pronunce dell’ebraico biblico. Questi problemi richiedono competenze che normalmente appartengono a ricercatori o accademici con anni di esperienza in un campo specifico. Secondo i ricercatori, proprio questo tipo di conoscenza rappresenta uno dei principali punti di forza dell’intelligenza umana rispetto ai sistemi artificiali.

I risultati iniziali dei modelli AI

I test preliminari condotti con i principali modelli linguistici mostrano risultati molto diversi da quelli osservati nei benchmark tradizionali. I sistemi più noti del settore ottengono punteggi sorprendentemente bassi. GPT-4o raggiunge circa il 2,7%, mentre Claude 3.5 Sonnet arriva al 4,1%. Il modello OpenAI o1 ottiene circa l’8%, mentre i sistemi più recenti come Gemini 3.1 Pro e Claude Opus 4.6 riescono a superare il 40-50%. Nonostante questi progressi, i risultati dimostrano che l’AI non è ancora in grado di affrontare in modo affidabile problemi che richiedono conoscenze altamente specialistiche.

Il valore della collaborazione interdisciplinare

Uno degli aspetti più interessanti del progetto è la collaborazione tra esperti provenienti da discipline molto diverse. Storici, fisici, linguisti, matematici e ricercatori medici hanno contribuito alla creazione delle domande. Questa combinazione di prospettive ha permesso di costruire un benchmark estremamente ampio e rappresentativo della conoscenza umana. Nguyen ha sottolineato l’ironia della situazione: gli esseri umani provenienti da campi diversi collaborano per dimostrare i limiti dell’intelligenza artificiale. Questa cooperazione interdisciplinare rappresenta uno degli elementi chiave del successo del progetto.

Perché Humanity’s Last Exam è importante

Secondo gli autori dello studio, benchmark accurati sono fondamentali per evitare interpretazioni errate dei progressi dell’intelligenza artificiale. Senza strumenti di valutazione adeguati, esiste il rischio che le capacità dei sistemi AI vengano sovrastimate. Questo potrebbe influenzare decisioni politiche, strategie aziendali e percezioni pubbliche della tecnologia. Humanity’s Last Exam offre quindi un metodo più realistico per misurare i progressi dell’intelligenza artificiale e individuare le aree in cui sono necessari ulteriori miglioramenti.

Un benchmark progettato per il futuro

Per evitare che i modelli AI possano semplicemente memorizzare le risposte, solo una parte delle domande dell’esame è disponibile pubblicamente. La maggioranza dei quesiti rimane nascosta e viene utilizzata per test futuri. Questo permette al benchmark di mantenere la propria efficacia anche quando i modelli diventano più avanzati. Il progetto è accessibile online attraverso il sito lastexam.ai, dove ricercatori e sviluppatori possono consultare la documentazione e alcuni esempi di domande. Gli autori prevedono che Humanity’s Last Exam verrà aggiornato periodicamente per riflettere i progressi dell’intelligenza artificiale e continuare a rappresentare una sfida significativa per i nuovi modelli.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.