Google espande Personal Intelligence di Gemini a tutti gli utenti negli Stati Uniti e rende gratuita una delle funzioni AI più avanzate. L’aggiornamento arriva insieme all’automazione dei task sullo schermo sui Pixel 10, trasformando l’assistente in uno strumento operativo completo. La nuova versione di Gemini unisce analisi dei dati personali e azioni automatiche sulle app. L’utente ottiene risposte e risultati senza passaggi manuali. Il March Feature Drop segna un salto concreto verso assistenti realmente proattivi.

Cosa leggere

Google rende Personal Intelligence gratuita e accessibile a milioni di utenti

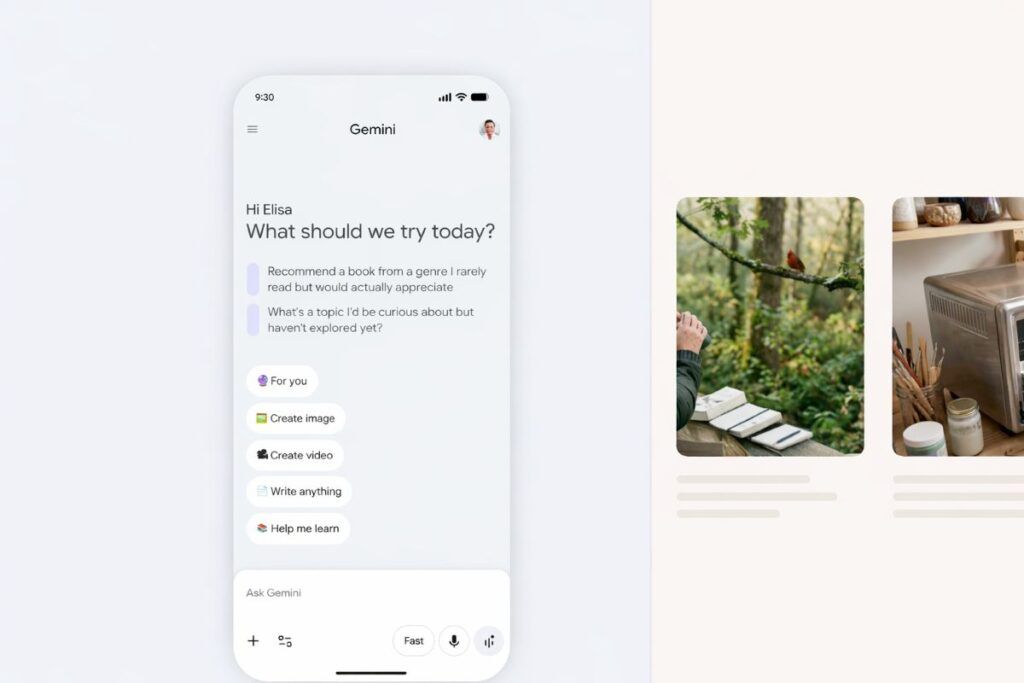

Google attiva Personal Intelligence su tutti gli smartphone Android negli Stati Uniti, eliminando il requisito di abbonamento premium. La funzione utilizza il modello Gemini per costruire un profilo contestuale basato su Gmail, Google Photos e Google Docs. L’assistente analizza email, immagini e documenti per fornire risposte personalizzate. Gli utenti possono ottenere riassunti automatici, consigli basati su esperienze passate e suggerimenti intelligenti senza dover reinserire informazioni. La funzione memorizza conversazioni precedenti e migliora progressivamente la qualità delle risposte. Questo approccio crea una AI contestuale persistente, molto più avanzata rispetto ai chatbot tradizionali. Google sottolinea che i dati sono protetti tramite crittografia end-to-end e controlli granulari. L’espansione democratizza l’accesso all’AI avanzata.

Gemini analizza dati personali in modo sicuro e genera risposte contestuali

Il cuore di Personal Intelligence è la capacità di collegare dati diversi e trasformarli in insight utili. Gemini può, ad esempio, recuperare informazioni da email, confrontarle con foto archiviate e suggerire azioni coerenti. Un utente può chiedere consigli su un viaggio passato e ottenere risposte basate su contenuti reali salvati nel proprio account. Questo elimina la necessità di fornire contesto manuale. La modalità AI avanzata migliora la comprensione del linguaggio naturale e rende le interazioni più fluide. L’assistente diventa progressivamente più preciso con l’uso continuo. Questa evoluzione avvicina Gemini a un vero assistente personale digitale, capace di comprendere abitudini e preferenze.

Google introduce automazione dei task sullo schermo sui Pixel 10

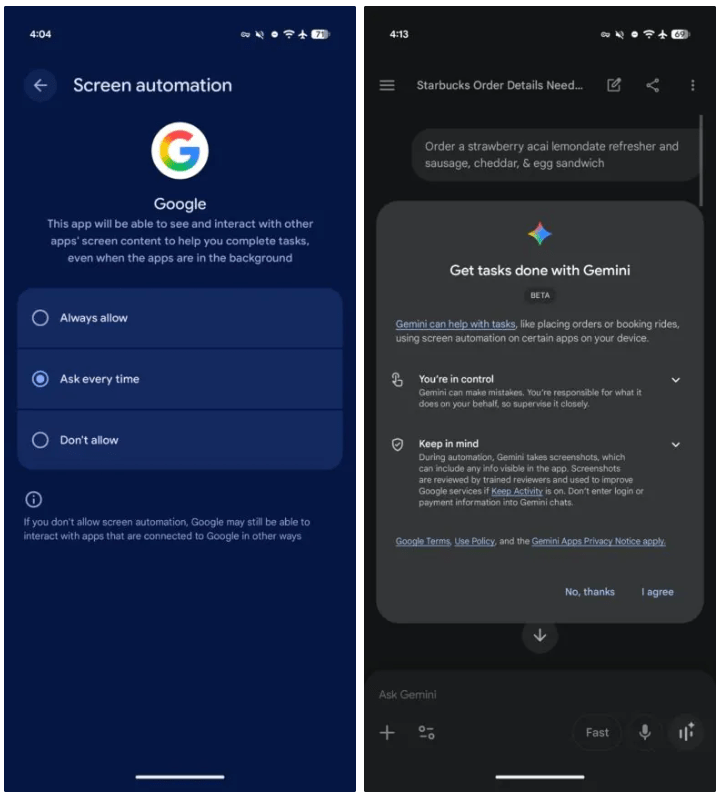

Con i Pixel 10, Google introduce l’automazione dei task sullo schermo, una funzione che permette a Gemini di interagire direttamente con l’interfaccia utente. L’assistente osserva lo schermo in tempo reale e può eseguire sequenze complesse come prenotare servizi, compilare moduli o navigare tra applicazioni. L’utente deve solo descrivere l’azione una volta.

Ad esempio, Gemini può ordinare cibo o prenotare un trasporto senza intervento manuale. Questa capacità sfrutta il nuovo framework di screen understanding integrato nel sistema. Google limita l’accesso a contesti autorizzati per garantire sicurezza e controllo. L’automazione rappresenta un passo oltre i comandi vocali tradizionali.

Il framework di screen understanding abilita interazioni autonome

La tecnologia alla base dell’automazione è il screen understanding, che consente a Gemini di riconoscere elementi visivi, pulsanti e menu nelle app. Il sistema interpreta layout dinamici, gestisce input e conferme e completa operazioni in modo autonomo. Questo elimina la necessità di API dedicate per ogni servizio. L’integrazione con il March Feature Drop ottimizza prestazioni e consumo energetico, rendendo la funzione utilizzabile nella vita quotidiana. I test interni indicano un aumento significativo della produttività e una riduzione del tempo necessario per completare attività comuni.

Personal Intelligence e automazione creano un assistente proattivo completo

L’integrazione tra Personal Intelligence e automazione rappresenta il vero salto evolutivo. Il sistema non si limita a suggerire ma può anche agire direttamente. Un utente può chiedere a Gemini di organizzare un viaggio e lasciare che l’assistente analizzi dati personali e completi le prenotazioni automaticamente. Questo unisce contesto e azione in un’unica esperienza. Google introduce permessi espliciti che l’utente attiva una sola volta, mantenendo controllo e trasparenza. Il sistema lavora in background senza interrompere il flusso. Questa architettura segna il passaggio da assistenti reattivi a assistenti autonomi.

Il rollout negli Stati Uniti anticipa l’espansione globale

Il rilascio negli Stati Uniti rappresenta una fase iniziale. Google utilizza questo mercato come banco di prova per ottimizzare prestazioni, sicurezza e user experience. L’azienda prevede un’espansione globale nei prossimi mesi, estendendo la funzione ad altri dispositivi e mercati. L’obiettivo è rendere Gemini il centro dell’esperienza Android. Questa strategia rafforza la posizione di Google nella competizione con altri assistenti AI e piattaforme mobile.

Google accelera sulla democratizzazione dell’intelligenza artificiale

Con Personal Intelligence gratuita e automazione avanzata, Google riduce le barriere di accesso all’AI. Funzioni che prima erano riservate a utenti premium diventano disponibili su larga scala. Questo approccio aumenta l’adozione e consolida l’ecosistema Google. L’integrazione tra servizi, dati e automazione crea un vantaggio competitivo significativo. Il March Feature Drop dimostra che l’AI non è più solo uno strumento di risposta ma una piattaforma operativa. Google spinge verso un futuro in cui lo smartphone agisce come un assistente completo e intelligente.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.