Nel 2026, la velocità con cui l’innovazione corre è pari solo alla velocità con cui gli hacker trovano il modo di sabotarla. Le ultime 48 ore hanno rivelato un quadro inquietante: oltre 800.000 siti WordPress sono vulnerabili a causa di una falla nel popolarissimo plugin Smart Slider 3, capace di “leggere” i file segreti dei server. Contemporaneamente, il cuore pulsante dello sviluppo AI, LangChain, è stato travolto dalla ricerca LangDrained, che ha individuato tre vie maestre per il furto di chiavi API e conversazioni private. E per chiudere il cerchio, l’estensione Chrome di Claude è finita nel mirino di ShadowPrompt, una tecnica che permetteva a qualsiasi sito web di prendere il controllo totale dell’assistente AI di Anthropic. Dalla grafica web agli agenti autonomi: oggi la sicurezza non è un’opzione, è una corsa contro il tempo.

Cosa leggere

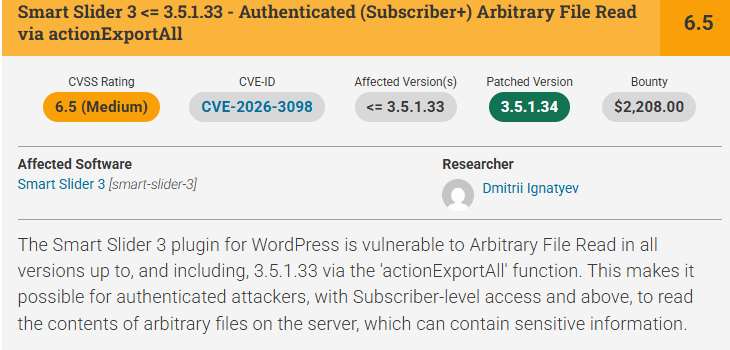

Smart Slider 3 espone 800mila siti WordPress a lettura arbitraria di file

La prima falla riguarda Smart Slider 3, uno dei plugin più diffusi nell’ecosistema WordPress per la creazione di slider, carousel e componenti visivi interattivi. Secondo quanto riportato da Wordfence, il difetto consente una arbitrary file read che permette a un attaccante di leggere file presenti sul server. Il rischio è particolarmente elevato perché il plugin conta oltre 800mila installazioni attive, quindi l’impatto potenziale non riguarda una nicchia ma una porzione ampia del web costruito su WordPress. Il problema nasce dall’assenza di una validazione adeguata dei percorsi file caricati o richiamati all’interno delle configurazioni dello slider. Una richiesta appositamente costruita può spingere il plugin a restituire contenuti che non dovrebbero essere accessibili pubblicamente, inclusi file di configurazione, log di sistema e credenziali archiviate sul server. In un contesto reale questo significa che una semplice componente grafica può diventare il punto di ingresso per una catena di compromissione ben più grave.

La falla di Smart Slider 3 può aprire la strada a compromissioni più ampie

La lettura arbitraria di file viene spesso percepita come un problema meno grave rispetto all’esecuzione di codice remoto, ma in realtà può rappresentare un passaggio decisivo verso compromissioni complete. Se un attaccante riesce a recuperare credenziali di database, chiavi di configurazione o dettagli interni del server, può combinare queste informazioni con altre debolezze e ottenere accessi ulteriori. Nel caso di Smart Slider 3, la superficie di attacco è resa ancora più delicata dal fatto che il plugin viene usato in contesti di produzione e su siti pubblicamente esposti.

La ricerca mette in luce un tema ricorrente nell’ecosistema WordPress: plugin apparentemente innocui, nati per migliorare grafica e usabilità, finiscono per avere accesso a porzioni sensibili dell’applicazione e del filesystem. Quando mancano sanitizzazione rigorosa degli input e controlli sui percorsi, anche una funzione visuale può trasformarsi in un vettore privilegiato per scansioni automatizzate e raccolta di dati sensibili. Per questo l’aggiornamento immediato del plugin non è un semplice consiglio, ma una misura di contenimento urgente.

LangChain mostra tre percorsi distinti di data leakage nell’ecosistema AI

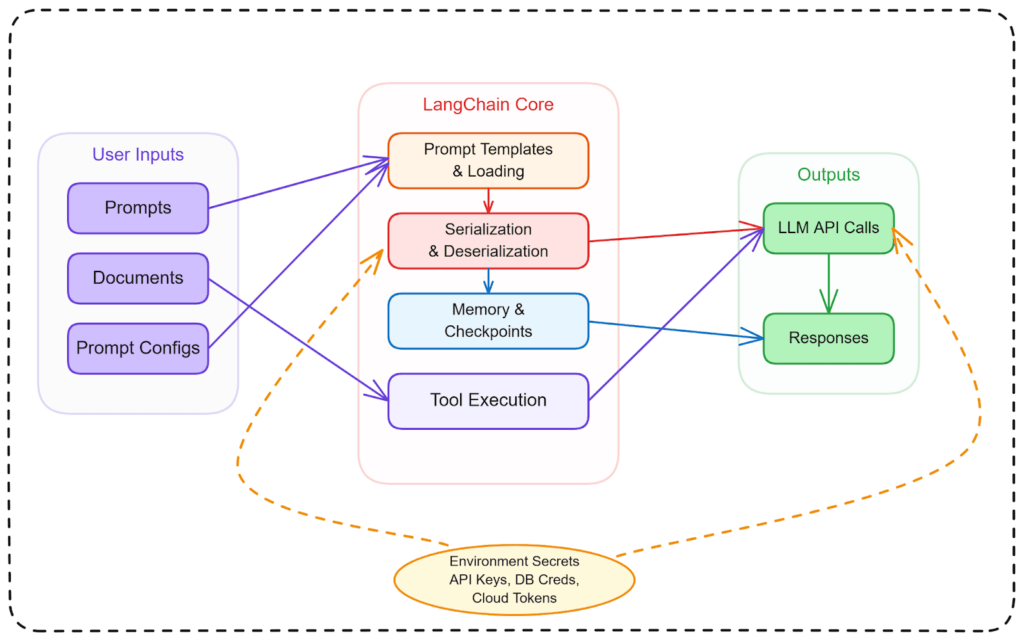

Il secondo caso colpisce LangChain, uno dei framework open source più diffusi nell’ambito dell’intelligenza artificiale, con oltre 847 milioni di download. La ricerca LangDrained pubblicata da Cyera individua tre vie diverse attraverso cui un attaccante può estrarre dati sensibili da ambienti che utilizzano il framework. La portata del problema è notevole perché LangChain non è uno strumento di nicchia, ma una base tecnica ampiamente usata da startup, grandi aziende e ambienti governativi per costruire agenti, pipeline e applicazioni AI.

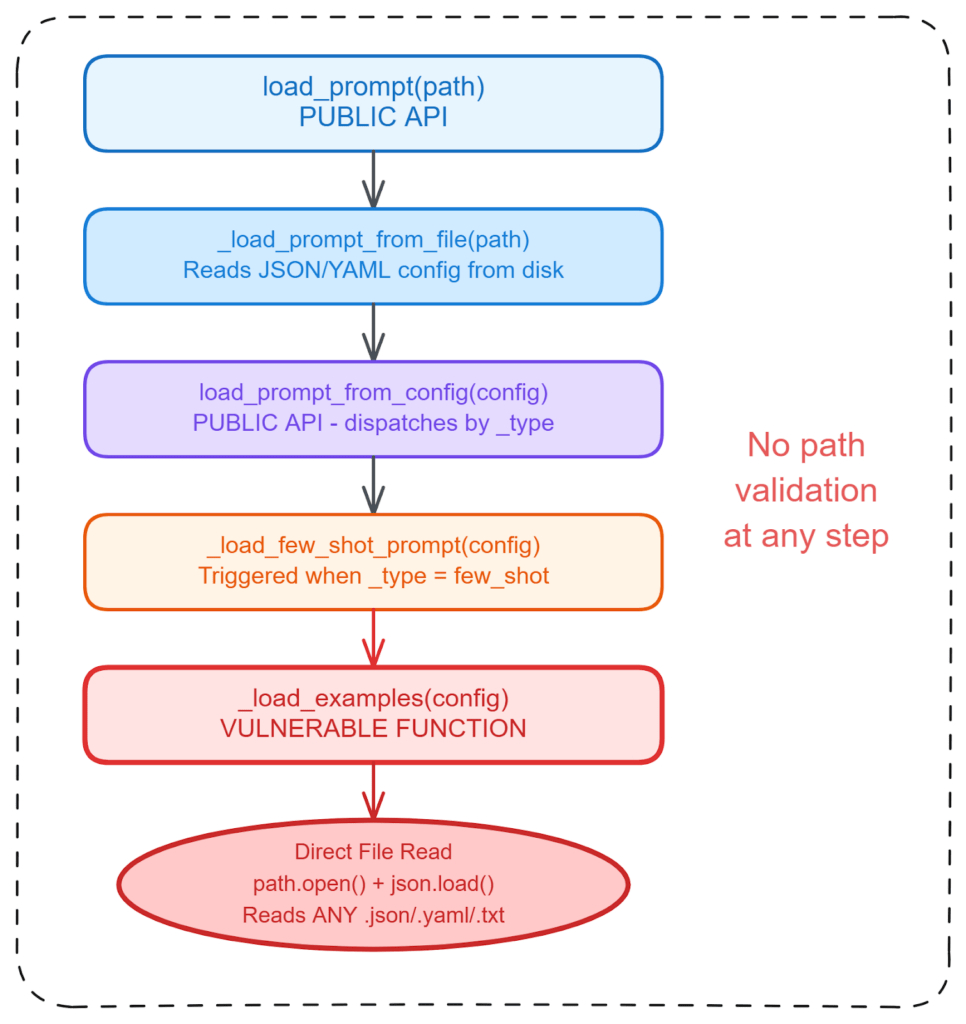

La prima via di fuga sfrutta una path traversal nelle funzioni load_prompt_from_config o load_prompt. Attraverso un percorso manipolato, un attaccante può tentare la lettura di file sensibili presenti nel sistema, inclusi file contenenti credenziali Docker, token Azure o chiavi AWS. In termini pratici, un singolo input malevolo può diventare sufficiente per sottrarre segreti infrastrutturali fondamentali per l’intero ambiente di esecuzione.

La serializzazione in LangChain apre la strada a esposizione di segreti ambientali

La seconda vulnerabilità individuata da Cyera colpisce il meccanismo di serializzazione degli oggetti. Qui il problema non riguarda solo il caricamento di un file, ma la possibilità di iniettare una struttura con chiavi specifiche, come lc:1, così da forzare la risoluzione di variabili d’ambiente quando l’opzione secrets_from_env resta attiva di default. Questo scenario è particolarmente delicato perché molte organizzazioni archiviano proprio nelle variabili d’ambiente chiavi API, token e credenziali di servizi esterni.

In altre parole, un difetto di serializzazione può trasformarsi in una porta diretta verso OPENAI_API_KEY, segreti di piattaforme cloud o altri dati che dovrebbero rimanere confinati nel contesto applicativo. Il problema mostra bene quanto sia fragile l’equilibrio tra flessibilità degli strumenti AI e sicurezza operativa. Un framework pensato per accelerare sviluppo e integrazione può esporre l’intera infrastruttura se le opzioni di default non vengono valutate in ottica difensiva.

LangGraph e SQLite aggiungono un rischio concreto di esfiltrazione conversazioni

La terza via di fuga tocca LangGraph, più precisamente il checkpointer SQLite, dove la funzione _metadata_predicate costruisce query senza parametrizzazione adeguata. Il risultato è una SQL injection che consente l’estrazione di conversazioni salvate e altri dati applicativi. In un ecosistema AI questo tipo di fuga è ancora più delicato rispetto ai database tradizionali, perché le conversazioni possono contenere prompt proprietari, dati finanziari, informazioni HR, appunti strategici o materiale sensibile fornito dagli utenti.

Questo punto è centrale perché evidenzia un problema spesso sottovalutato: le applicazioni AI non gestiscono solo testo generico, ma accumulano conoscenza operativa, istruzioni interne, preferenze degli utenti e frammenti di contesto aziendale. Una SQL injection in questo scenario non sottrae semplicemente record di un database, ma può rivelare l’intero patrimonio informativo che alimenta il comportamento dell’agente. Per molte organizzazioni il danno reputazionale e operativo di una fuga simile sarebbe elevatissimo.

ShadowPrompt ha mostrato quanto un’estensione AI possa diventare un vettore silenzioso

Il terzo caso, descritto da Koi.ai come ShadowPrompt, riguarda l’estensione Anthropic Claude per Chrome, utilizzata da oltre tre milioni di utenti. La falla nasce dalla combinazione di un allowlist troppo permissivo, che include *.claude.ai, e di una DOM-based XSS nel componente CAPTCHA di Arkose Labs ospitato su a-cdn.claude.ai. In pratica qualsiasi sito malevolo poteva sfruttare questo insieme di debolezze per interagire con l’estensione come se fosse un’origine fidata.

Il meccanismo descritto è particolarmente insidioso perché non richiedeva scenari complessi o compromissioni dirette del browser. Un sito web malevolo poteva caricare un iframe invisibile, scambiare messaggi con l’estensione e iniettare prompt controllati dall’attaccante. Da quel momento l’estensione eseguiva i comandi come se fossero arrivati dall’utente. Non si trattava quindi di una semplice perdita marginale di dati, ma di un vero hijack dell’assistente AI integrato nel browser.

Il controllo di Claude Chrome poteva estendersi a email, chat e servizi Google

Le conseguenze operative di ShadowPrompt sono quelle che più colpiscono l’immaginario degli utenti finali. Secondo la descrizione fornita, un attaccante poteva rubare token di accesso a Gmail, Google Drive o Contatti, leggere la cronologia delle chat e persino inviare email a nome della vittima. Ancora più preoccupante è il fatto che l’accesso persistesse in background, permettendo il controllo del sidebar di Claude e quindi una manipolazione continua dell’assistente.

Questo episodio dimostra quanto le estensioni AI abbiano un profilo di rischio superiore rispetto alle estensioni tradizionali. Non si limitano a modificare l’interfaccia o aggiungere scorciatoie, ma operano come agenti capaci di leggere pagine, eseguire script e interagire con servizi esterni. Quando le verifiche sulle origini non sono strette e il modello di messaggistica tra domini è troppo permissivo, il browser smette di essere solo uno strumento di navigazione e diventa un ponte verso asset digitali molto più ampi.

Le tre falle condividono radici comuni tra input non validati e fiducia eccessiva

Nonostante riguardino WordPress, framework AI e un’estensione browser, le tre vulnerabilità mostrano uno schema ricorrente. In Smart Slider 3 manca una validazione severa dei percorsi file. In LangChain i problemi emergono da caricamento non sicuro, serializzazione pericolosa e query non parametrizzate. In Claude Chrome l’errore nasce da una fiducia eccessiva verso origini considerate legittime e da una sanitizzazione insufficiente nella catena che coinvolge il CAPTCHA. Il filo conduttore è la sottovalutazione del principio secondo cui ogni input deve essere considerato ostile fino a prova contraria. Questo vale per un parametro passato a un plugin WordPress, per una configurazione caricata in un framework AI, per un filtro su un database SQLite o per un postMessage ricevuto da un’estensione del browser. Quando i software più popolari vengono progettati assumendo che alcuni flussi siano “interni”, “attesi” o “fidati”, gli attaccanti trovano esattamente lì il margine per inserirsi.

Gli amministratori e le aziende devono trattare queste patch come priorità operative

Sul piano operativo il messaggio è netto. Gli amministratori WordPress devono aggiornare Smart Slider 3 immediatamente o disabilitarlo finché non possono intervenire. Le aziende che usano LangChain devono verificare le versioni di langchain-core e langgraph-checkpoint-sqlite, controllare le dipendenze transitive, disabilitare secrets_from_env su input non fidati e validare rigorosamente i filtri passati ai checkpointer. Gli utenti dell’estensione Claude devono controllare la versione installata e assicurarsi di utilizzare almeno la release corretta indicata come risolutiva. Ma oltre alla patch immediata esiste un problema più ampio di governance tecnica. Questi incidenti dimostrano che aggiornare non basta se non esistono processi continui di audit, verifica delle configurazioni di default e revisione delle dipendenze software. La velocità con cui strumenti AI, plugin e browser extension vengono adottati supera spesso la maturità dei controlli interni. Per questo la cybersecurity non può essere una reazione occasionale all’advisory del giorno, ma una pratica proattiva di verifica costante.

WordPress, AI e browser mostrano una stessa fragilità strutturale

Le notizie del 27 marzo 2026 raccontano tre casi diversi ma un unico problema di fondo. Smart Slider 3 espone centinaia di migliaia di siti a letture arbitrarie di file. LangChain mostra come persino il framework più diffuso nell’AI possa diventare un canale di esfiltrazione di segreti e conversazioni. ShadowPrompt rivela infine che un’estensione AI nel browser può essere trasformata in uno strumento di hijack quasi invisibile. La lezione è chiara: la popolarità di un tool non equivale alla sua sicurezza, e la rapidità dell’innovazione non elimina la necessità di controlli basilari su percorsi, serializzazione, query e comunicazioni cross-domain. Per sviluppatori, aziende e utenti il punto non è solo reagire a queste tre falle, ma riconoscere che plugin grafici, framework AI e assistenti browser vanno trattati come componenti ad alto impatto, con audit regolari, patch tempestive e un modello di fiducia molto più ristretto rispetto al passato.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.