Google accelera sull’Intelligenza Artificiale e blinda la partnership con Anthropic: un maxi-accordo garantirà al modello Claude la potenza ecosostenibile delle nuove TPU Ironwood. Nel frattempo, Mountain View cala il jolly mobile lanciando su iOS l’innovativa app di dettatura “Eloquent”, capace di funzionare interamente offline. Una strategia chiara e definita (nonostante un blackout temporaneo dei server di Claude) che fa da forte contraltare al caos che regna in casa Microsoft, dove la proliferazione incontrollata di oltre 80 versioni diverse del marchio Copilot sta generando una frammentazione e una confusione senza precedenti sul mercato. Google rafforza il proprio ruolo nell’infrastruttura globale dell’intelligenza artificiale con un nuovo accordo strategico siglato da Anthropic insieme a Broadcom per l’approvvigionamento di multiple gigawatt di capacità TPU di prossima generazione destinate ai modelli frontier di Claude. L’infrastruttura entrerà in funzione dal 2027 e servirà a sostenere una domanda che continua a crescere a ritmi molto elevati tra clienti enterprise e utenti globali. L’operazione si inserisce nella più ampia corsa alla capacità computazionale, ma segnala anche una direzione precisa: più scala, più efficienza e maggiore controllo della supply chain hardware. Nello stesso contesto Google spinge anche su AI Edge, sostenibilità dei data center e calcolo on-device, mentre Anthropic consolida la propria crescita e Microsoft deve fare i conti con una frammentazione sempre più evidente della famiglia Copilot.

Cosa leggere

Anthropic prenota gigawatt di TPU Google per far crescere Claude

Il nuovo accordo tra Anthropic, Google e Broadcom riguarda una quantità di calcolo impressionante, misurata in multiple gigawatt di capacità TPU di nuova generazione. Si tratta di un’espansione che non punta solo ad aumentare il numero di chip disponibili, ma a costruire una base industriale stabile per l’addestramento e l’inferenza dei modelli frontier di Claude nei prossimi anni. La disponibilità effettiva dell’infrastruttura partirà dal 2027 e dipenderà, come sempre in questo settore, dalla consegna dei componenti e dall’attivazione progressiva dei siti. Il grosso dell’installazione sarà collocato negli Stati Uniti, confermando la centralità del mercato americano nella corsa all’AI infrastrutturale. Per Anthropic l’intesa rappresenta il rafforzamento concreto dell’impegno da 50 miliardi di dollari annunciato nel novembre 2025 per potenziare il calcolo avanzato sul territorio statunitense.

Claude cresce rapidamente e spinge Anthropic a blindare l’infrastruttura

Dietro l’accordo c’è soprattutto la necessità di sostenere una crescita commerciale che Anthropic definisce straordinaria. Claude continua ad attirare domanda da grandi aziende, sviluppatori e organizzazioni che richiedono modelli sempre più performanti per ricerca, automazione, coding e analisi documentale. L’aumento dei clienti enterprise con spesa superiore a 1 milione di dollari l’anno indica che il problema non è più solo la qualità del modello, ma la disponibilità stabile di capacità computazionale sufficiente per garantire continuità di servizio, training e inferenza su scala globale. In questo scenario, prenotare con anni di anticipo un’infrastruttura basata su TPU Google significa evitare colli di bottiglia e ridurre il rischio che la crescita di Claude venga frenata dalla scarsità di hardware o da ritardi nella catena di fornitura.

Google usa Ironwood per alzare potenza e sostenibilità delle TPU

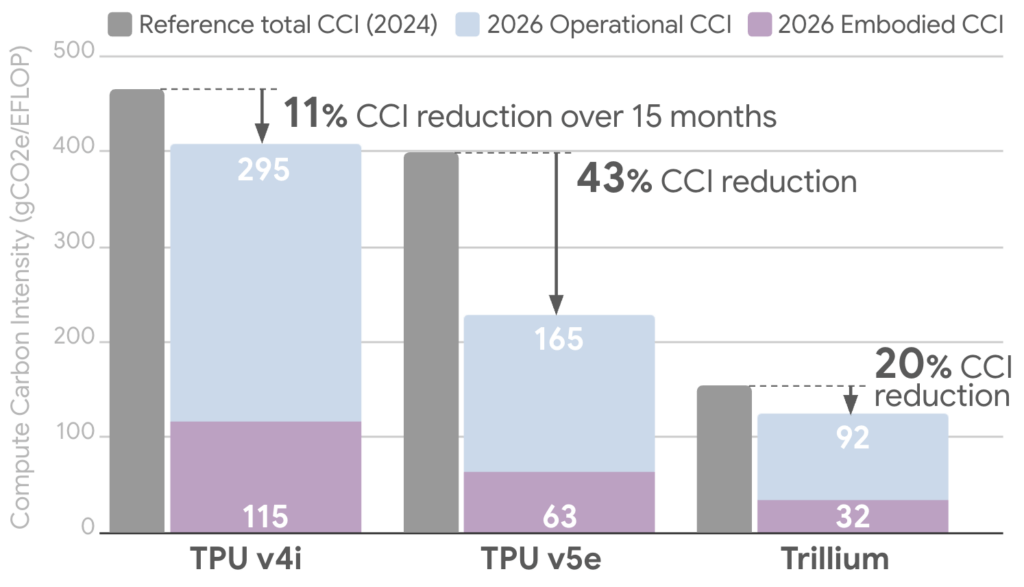

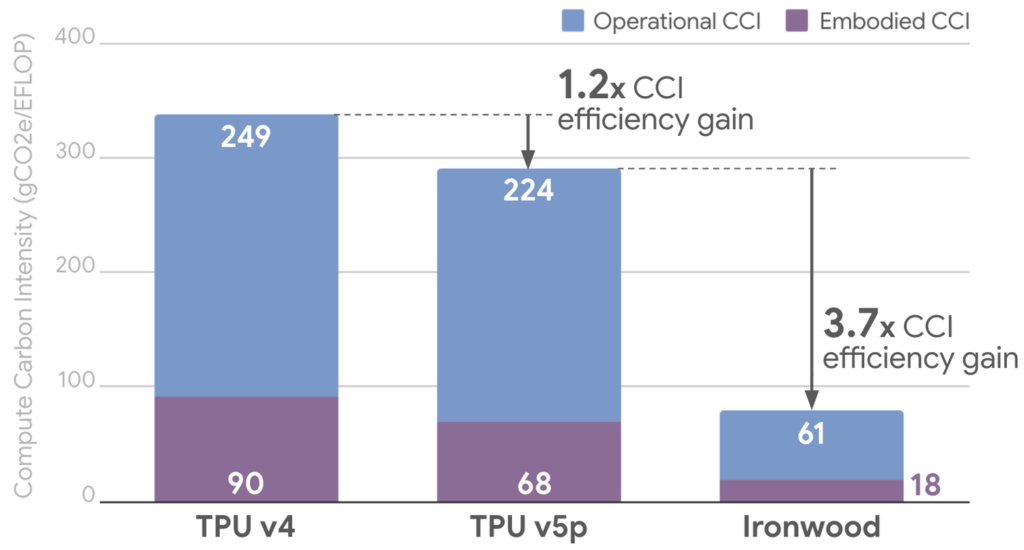

Uno degli elementi più importanti del quadro è Ironwood, la settima generazione di Tensor Processing Unit di Google. L’azienda presenta questi processori come un salto sia in potenza sia in efficienza ambientale. I dati indicano 2307 FLOPS in precisione BF16, contro i 459 FLOPS di picco della precedente TPU v5p, con un miglioramento che segnala una forte accelerazione nella capacità di supportare modelli più grandi e più complessi. Ancora più rilevante, sul piano industriale e reputazionale, è il dato sulla Compute Carbon Intensity, che Google quantifica in un miglioramento di 3,7 volte rispetto alla generazione precedente. Questo significa che l’aumento della potenza di calcolo non si traduce automaticamente in un aumento proporzionale dell’impatto carbonico, un fattore decisivo mentre il settore AI viene osservato con crescente attenzione per i suoi consumi energetici.

Ironwood spinge Mixture of Experts e FP8 nella flotta Google

Dal punto di vista tecnico Ironwood è progettato per valorizzare architetture sempre più diffuse come Mixture of Experts e per sfruttare la precisione FP8, che consente di raddoppiare il throughput e ridurre sensibilmente la banda di memoria necessaria. Questo approccio permette a Google di ottimizzare sia il training sia l’inferenza su carichi reali, migliorando l’utilizzo effettivo della flotta e limitando gli sprechi nei momenti di inattività. L’azienda afferma di aver già distribuito questi TPU nella propria infrastruttura da gennaio 2026, verificando i benefici su workload concreti, inclusi quelli legati alla generazione e modifica di immagini. La direzione è chiara: non basta aggiungere chip, serve una piattaforma capace di far lavorare l’hardware con elevata saturazione, basso consumo a riposo e migliore rapporto tra prestazioni ottenute e costo energetico complessivo.

L’outage di Claude mostra i limiti operativi della crescita accelerata

Mentre Anthropic annuncia nuova capacità futura, Claude ha dovuto affrontare anche un outage parziale che ha colpito migliaia di utenti. I problemi hanno riguardato login, modalità voice, chat e stabilità di altri servizi collegati, mostrando quanto sia delicato il passaggio da piattaforma in forte crescita a infrastruttura pienamente resiliente. In una fase di espansione così rapida, ogni interruzione assume un peso maggiore perché coinvolge utenti professionali che usano Claude per lavoro, sviluppo software, ricerca o flussi documentali quotidiani. L’incidente non cancella il valore strategico dell’accordo con Google, ma rafforza il messaggio di fondo: per competere davvero nel segmento frontier non basta avere un buon modello, servono ridondanza, scalabilità e continuità operativa all’altezza della domanda enterprise.

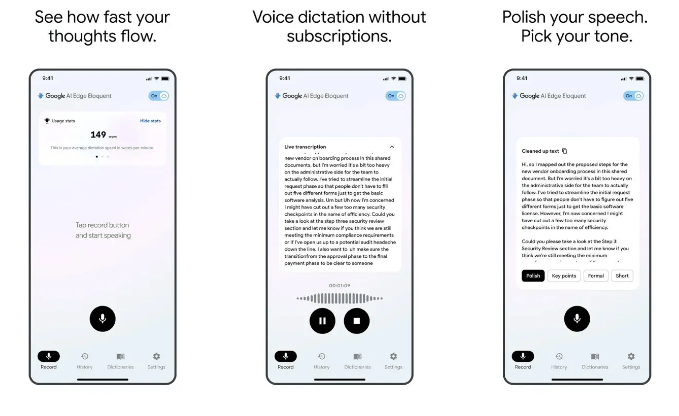

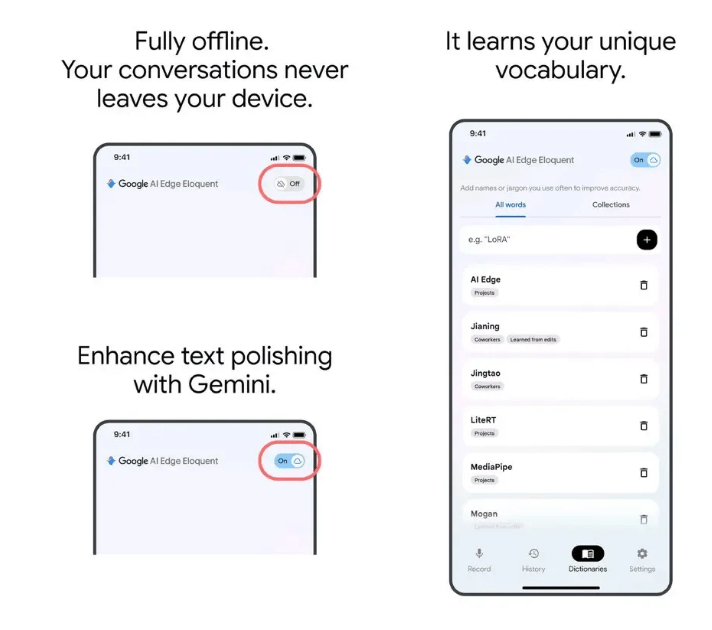

Google porta l’AI offline su iPhone con AI Edge Eloquent

Parallelamente alla spinta sul cloud, Google lancia AI Edge Eloquent, un’app sperimentale di dettatura per iOS che funziona quasi interamente offline. È un passaggio importante perché mostra come la strategia AI di Google non si limiti ai grandi data center e alle TPU, ma si estenda anche al dispositivo dell’utente. Eloquent trasforma il parlato in testo pulito, elimina parole di riempimento, corregge errori a metà frase e consente diversi stili di output come formale, breve, lungo o a punti chiave.

La logica è quella del calcolo on-device: maggiore privacy, latenza ridotta e minore dipendenza dal cloud per attività quotidiane. Un toggle opzionale consente comunque di usare Gemini per un polishing ulteriore del testo, creando così una combinazione flessibile tra elaborazione locale e rifinitura cloud.

Eloquent rafforza la strategia Google AI Edge senza abbonamenti

L’app si inserisce nel progetto Google AI Edge, che punta a distribuire modelli direttamente sui dispositivi per costruire esperienze di intelligenza artificiale locali, rapide e accessibili. Eloquent permette di dettare testo, consultare una cronologia delle registrazioni, usare un dizionario personalizzato e migliorare progressivamente il riconoscimento di nomi, termini tecnici e frasi ricorrenti. Il fatto che l’app sia gratuita e priva di abbonamenti rafforza il valore strategico dell’iniziativa: Google non propone solo modelli sempre più grandi nei data center, ma cerca anche di presidiare i casi d’uso ad alta frequenza che possono diventare quotidiani per studenti, professionisti e creatori di contenuti. L’AI offline diventa così un complemento naturale dell’AI cloud, non un’alternativa marginale.

Microsoft affronta la frammentazione di Copilot mentre Google resta più lineare

Nel frattempo il confronto competitivo con Microsoft mette in luce due approcci molto diversi. Da una parte Google concentra la comunicazione attorno a infrastruttura, efficienza e pochi pilastri software ben riconoscibili.

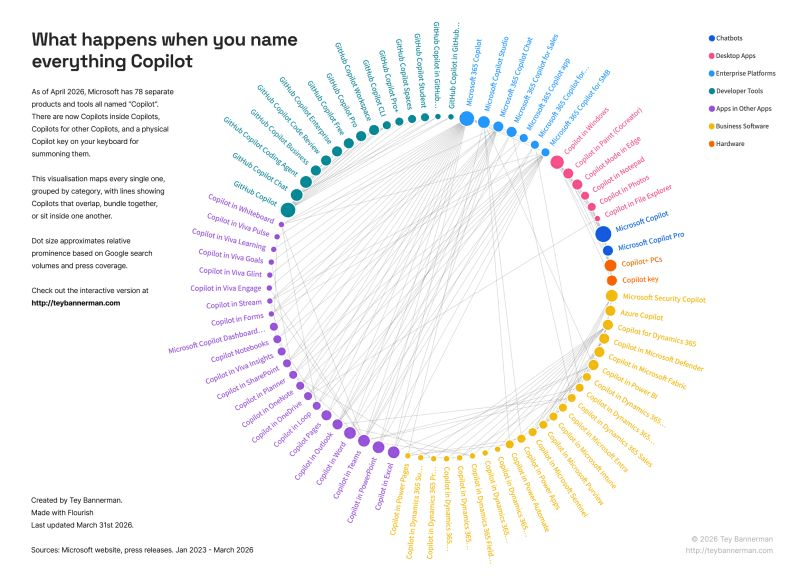

Dall’altra Microsoft si ritrova con almeno 80 prodotti Copilot distinti, e secondo alcune stime il numero reale potrebbe superare quota 100 se si includono integrazioni, varianti enterprise e strumenti collegati. Questa proliferazione crea inevitabilmente confusione sia tra i consumatori sia nelle aziende, dove scegliere il Copilot giusto diventa sempre più complesso. Il paragone avvantaggia Google sul piano del posizionamento strategico: accordo per TPU next-gen, chip più efficienti e app edge offline compongono una narrativa più ordinata, mentre Microsoft deve prima di tutto razionalizzare un’offerta che rischia di diventare dispersiva.

Google e Anthropic disegnano un ecosistema AI tra cloud, edge e sostenibilità

Messi insieme, questi sviluppi raccontano una traiettoria precisa. Anthropic blinda il futuro di Claude assicurandosi capacità TPU su scala gigawatt a partire dal 2027. Google consolida la propria posizione come fornitore infrastrutturale di riferimento, mostrando con Ironwood che la crescita del calcolo AI può essere accompagnata da un netto miglioramento dell’efficienza carbonica. Con Eloquent l’azienda dimostra inoltre che l’intelligenza artificiale non deve vivere solo nel cloud, ma può essere utile anche direttamente sul dispositivo, in forma offline e continua. L’outage di Claude ricorda che la crescita comporta inevitabili tensioni operative, ma non cambia la sostanza del quadro: Google e Anthropic stanno costruendo una filiera AI che unisce hardware, cloud, edge computing e sostenibilità, mentre il resto del mercato cerca ancora un equilibrio tra espansione, chiarezza di offerta e affidabilità del servizio.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.