La sicurezza dell’Intelligenza Artificiale viaggia su un doppio binario. Da un lato, Google Workspace alza un vero e proprio muro dinamico per proteggere Gemini dalle iniezioni di prompt indirette (IPI), implementando un motore di policy continuo, test di simulazione offensiva (red teaming) e dati sintetici per bloccare la manipolazione del contesto prima ancora dell’esecuzione. Dall’altro, i cybercriminali cavalcano l’entusiasmo per i nuovi tool di programmazione IA: secondo le ultime analisi di Trend Micro, una massiccia campagna sta utilizzando finti repository GitHub e falsi pacchetti di Claude Code come esca perfetta per distribuire stealer e malware. Il vero bersaglio non è più l’utente comune, ma gli sviluppatori, le startup e i team DevOps, con il chiaro obiettivo di penetrare nella supply chain del software e rubare credenziali cloud, token e chiavi API. Google Workspace rafforza in modo deciso la difesa continua contro le iniezioni di prompt indirette (IPI), adottando un modello di sicurezza iterativo che evolve insieme alle minacce emergenti. In parallelo, una campagna attiva continua a sfruttare il noto errore di packaging di Claude Code come esca per distribuire malware e stealer attraverso repository GitHub falsi e snippet apparentemente legittimi. Le due novità emerse ad aprile 2026 mostrano chiaramente come la sicurezza AI stia entrando in una nuova fase: da un lato i vendor cloud spingono su red teaming costante, dati sintetici e policy engine dinamici, dall’altro gli attaccanti sfruttano la fiducia crescente verso gli AI coding tool per colpire sviluppatori, startup e pipeline CI/CD. Per le organizzazioni il rischio non riguarda più solo il modello, ma l’intera catena di interazione tra utenti, documenti, tool esterni e ambienti di sviluppo.

Cosa leggere

Google Workspace passa a una difesa continua contro le prompt injection indirette

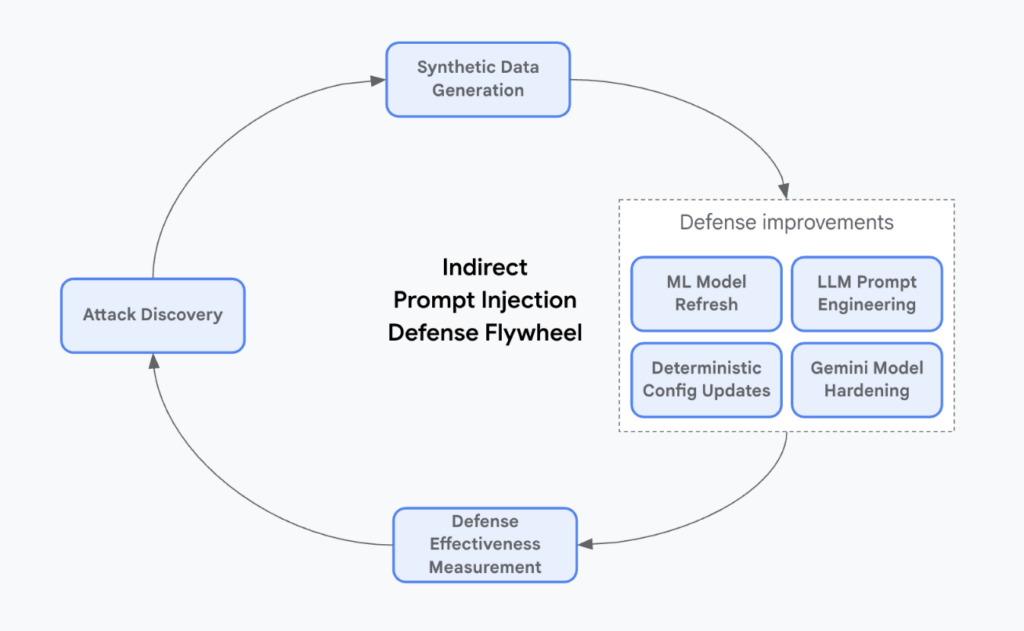

Il cambio di paradigma introdotto da Google Workspace è netto: le prompt injection indirette non vengono più trattate come una minaccia affrontabile con verifiche periodiche, ma come un vettore in costante mutazione che richiede mitigazione continua. Il sistema monitora in tempo reale le interazioni tra utenti, applicazioni Workspace e modelli AI integrati in Gmail, Drive, Docs e Meet, identificando pattern anomali prima che possano influenzare il comportamento dell’assistente.

Questo approccio riduce drasticamente il rischio che contenuti malevoli nascosti in documenti condivisi, email, commenti o contenuti importati da integrazioni terze riescano a modificare il contesto del modello. In ambienti enterprise, dove i workflow includono automazioni multi-step e agenti AI con accesso a dati sensibili, la continuità della difesa diventa il vero fattore differenziante.

Red teaming continuo e Simula generano dataset sintetici contro nuove minacce

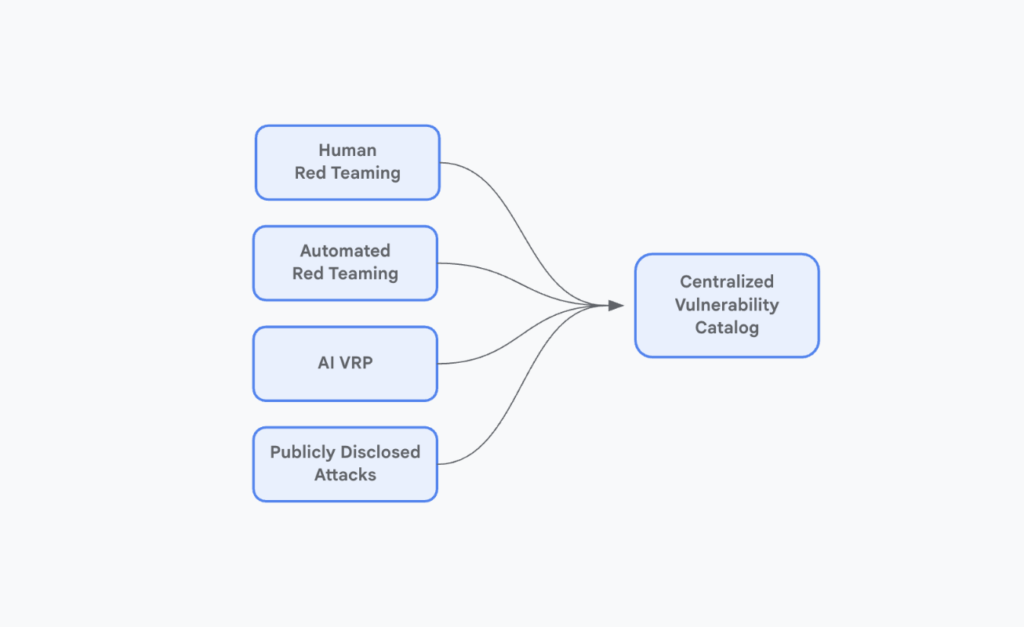

Uno dei pilastri della nuova architettura è il red teaming umano continuo, in cui i team di sicurezza simulano attacchi realistici basati su scenari complessi: documenti contaminati, prompt nascosti in allegati, concatenazioni di tool e catene di ragionamento su più passaggi.

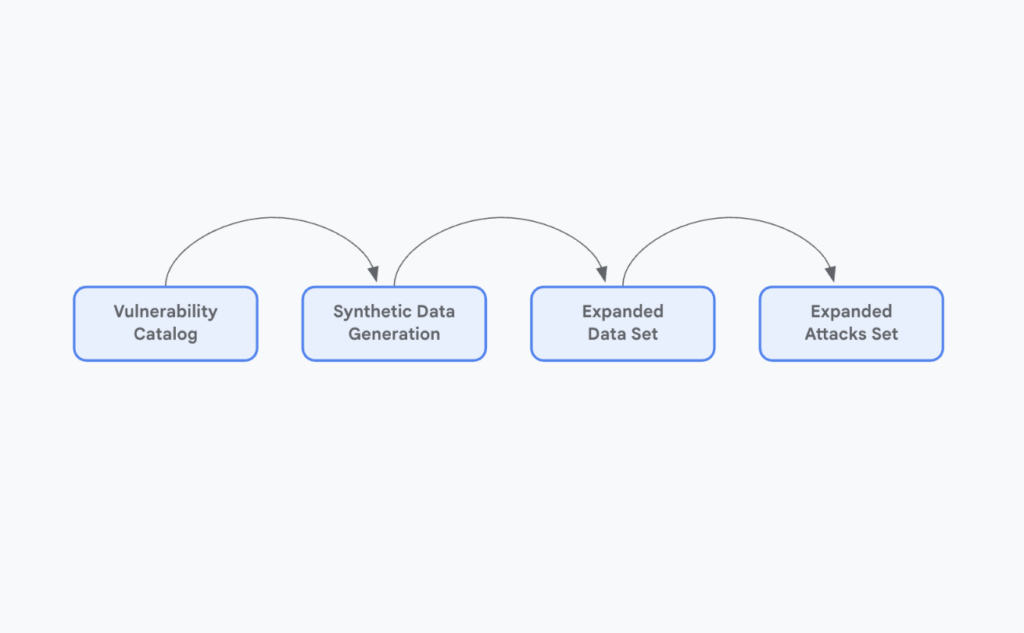

Ogni simulazione produce segnali che alimentano Simula, il sistema proprietario di generazione di dataset sintetici. Questo permette di creare migliaia di esempi di prompt malevoli senza utilizzare dati reali dei clienti. Il vantaggio operativo è enorme: i modelli di rilevamento possono essere aggiornati in modo iterativo e veloce, mantenendo la protezione efficace anche quando emergono nuove varianti di attacco.

Il policy engine blocca l’attacco prima che raggiunga Gemini

Il cuore tecnico della difesa è il nuovo policy engine contestuale, che analizza provenienza del prompt, contesto operativo, sensibilità dei dati coinvolti e tool chain utilizzata prima di consentire l’elaborazione.

In pratica, Google Workspace non filtra solo il testo, ma l’intera sequenza logica che porta il modello a prendere una decisione. Questo è fondamentale contro le IPI multi-step, dove la manipolazione non avviene in una singola richiesta ma in una serie di passaggi apparentemente innocui. Il motore di policy può inoltre essere esteso via API da amministratori e sviluppatori, permettendo regole granulari per reparti finance, HR, legal o ambienti ad alta compliance.

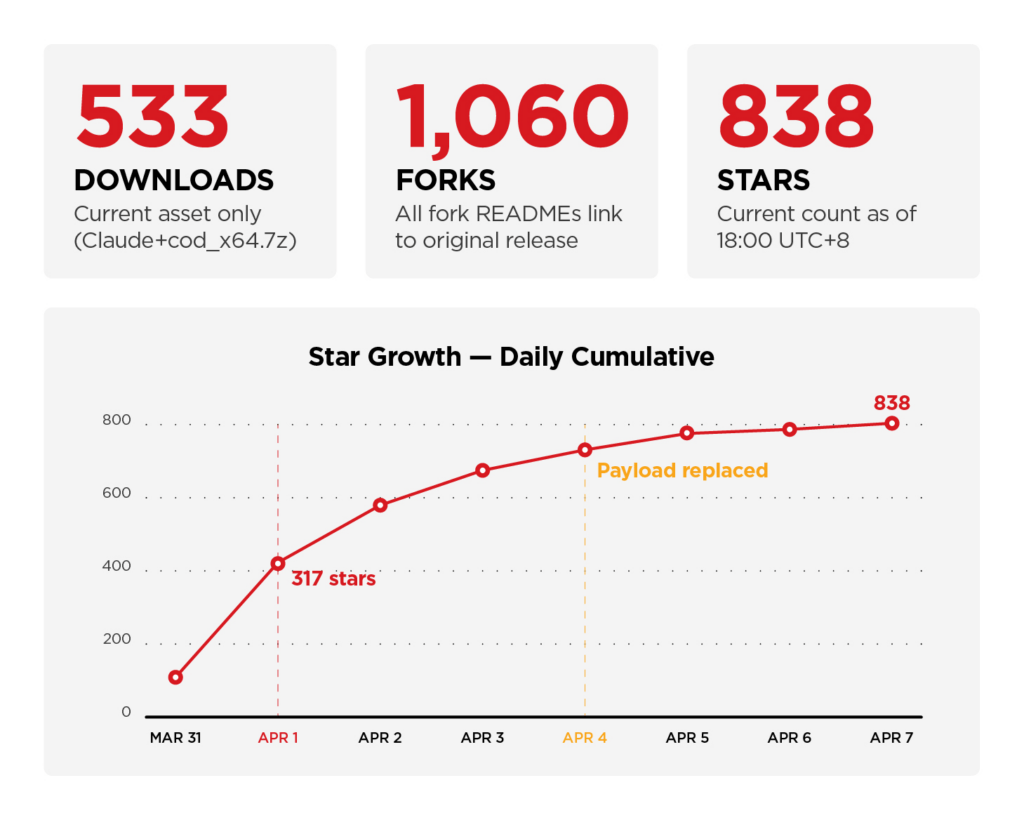

Claude Code packaging error continua a essere una esca perfetta

Sul fronte offensivo, la campagna che sfrutta il packaging error di Claude Code continua a evolvere. Gli attaccanti pubblicano repository GitHub fake, archivi trojanizzati e snippet apparentemente utili, spesso accompagnati da istruzioni che imitano la documentazione ufficiale o i flussi di installazione reali degli AI coding assistant. Una volta eseguito, il payload attiva malware in grado di rubare token cloud, chiavi API, cookie browser, credenziali CI/CD e accessi a repository privati, oltre a installare backdoor persistenti o proxy SOCKS5. Il successo della campagna deriva dalla fiducia implicita degli sviluppatori verso strumenti AI di coding, che abbassa la soglia di verifica dell’origine del codice.

Sviluppatori e pipeline CI/CD diventano il nuovo bersaglio prioritario

La caratteristica più critica di questa campagna è il target: non utenti consumer, ma sviluppatori freelance, startup e team DevOps che integrano tool AI nei flussi di sviluppo.

Questo trasforma il problema in una vera minaccia di software supply chain, perché un singolo pacchetto malevolo può compromettere ambienti di build, repository Git, chiavi di deploy e infrastrutture cloud collegate. L’abuso di Claude Code dimostra come ogni errore mediatico o bug pubblico di un tool AI possa essere rapidamente convertito in una campagna di social engineering e malware delivery.

Difesa multilayer tra Workspace, GitHub e ambienti di sviluppo

La risposta più efficace è una strategia multilayer. In Google Workspace il focus deve restare su policy dinamiche, rilevamento comportamentale e conferme esplicite per task sensibili. Nei workflow di sviluppo diventano invece fondamentali sandbox isolate, verifica della firma dei pacchetti, validazione dell’origine dei repository GitHub e scanning dinamico dei processi AI-generated. La convergenza tra la difesa continua di Workspace e le misure di hardening sui tool di sviluppo mostra la direzione della sicurezza AI moderna: non più controlli statici ma monitoraggio iterativo, behavioral analysis e protezione della supply chain del codice generato. Le aziende che implementano subito queste best practice riducono drasticamente l’esposizione a campagne ibride che uniscono prompt injection indirette, social engineering e packaging malevolo.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.