AWS e Google Cloud spingono l’evoluzione dell’intelligenza artificiale enterprise su due direttrici chiave: personalizzazione avanzata dei modelli e sovranità del dato. Da una parte Amazon Bedrock amplia i modelli Nova con fine-tuning supervisionato, reinforcement e workflow human-in-the-loop, rendendo più semplice costruire agenti affidabili per sanità, analytics e automazione regolata. Dall’altra Google Cloud consolida la leadership nel Sovereign Cloud e ottimizza i carichi AI/ML su GKE, offrendo maggiore controllo su residenza dati, chiavi crittografiche e orchestrazione dei modelli. Il risultato è una nuova fase dell’AI enterprise, in cui precisione, conformità e performance diventano parte della stessa architettura. Le novità di aprile 2026 mostrano una chiara maturazione del settore. L’attenzione non è più soltanto sulla potenza dei foundation model, ma sulla capacità di adattarli ai dati reali dell’organizzazione, farli operare in ambienti regolati e integrarli in pipeline aperte come Apache Iceberg e Kubernetes. Parallelamente, l’AI generativa continua a scendere verso l’utente finale con esperienze sempre più contestuali, come la ricerca video conversazionale e i modelli contemplativi.

Cosa leggere

AWS Bedrock amplia Amazon Nova con fine-tuning supervisionato e reinforcement

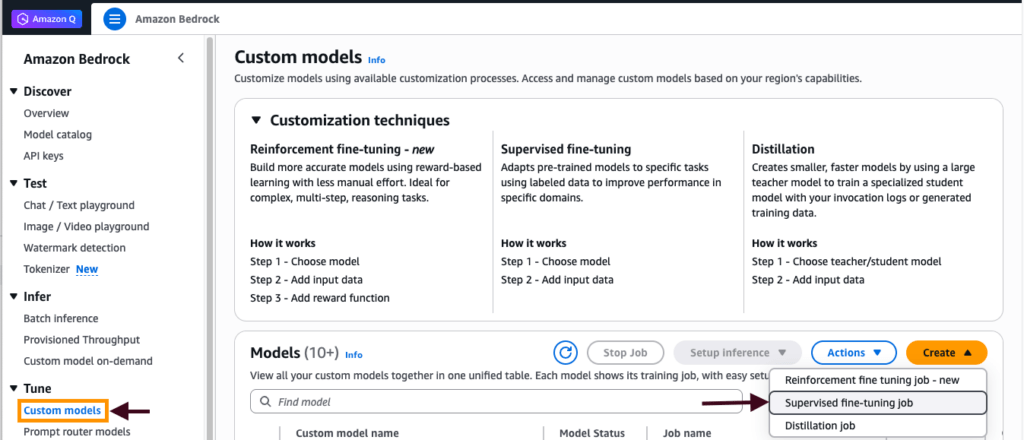

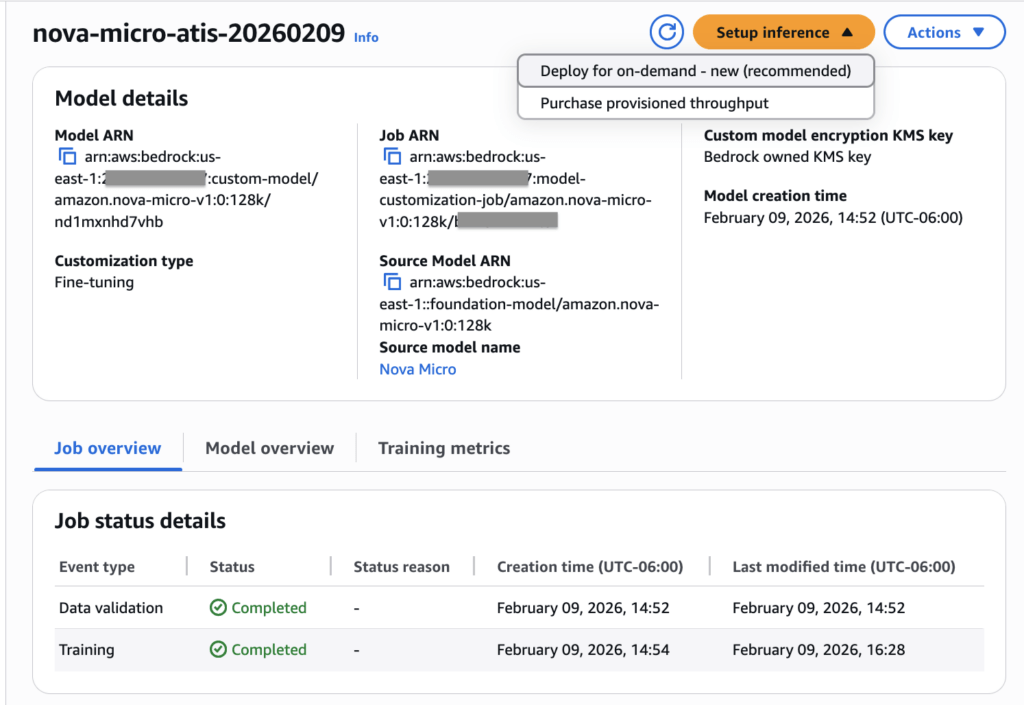

La novità più importante per il mondo AWS riguarda l’espansione del fine-tuning nativo dei modelli Amazon Nova all’interno di Bedrock. Gli sviluppatori possono ora personalizzare Nova Micro, Nova Lite e Nova Pro caricando dataset JSONL direttamente su Amazon S3 e avviando i job dalla console, senza doversi occupare di cluster GPU o orchestrazione manuale. Questo abbassa drasticamente la soglia di ingresso per aziende che vogliono modelli specializzati su customer care, classificazione documentale, medical reasoning o coding assistito.

Il supporto a tecniche parameter-efficient come LoRA adapters riduce costi e memoria, rendendo il tuning economicamente sostenibile anche con dataset relativamente piccoli. Il salto di accuratezza riportato in task strutturati come ATIS dimostra come queste tecniche superino il semplice prompt engineering, soprattutto nei casi in cui servono robustezza semantica e generalizzazione su varianti linguistiche.

Reinforcement fine-tuning e human-in-the-loop portano Nova nei workflow regolati

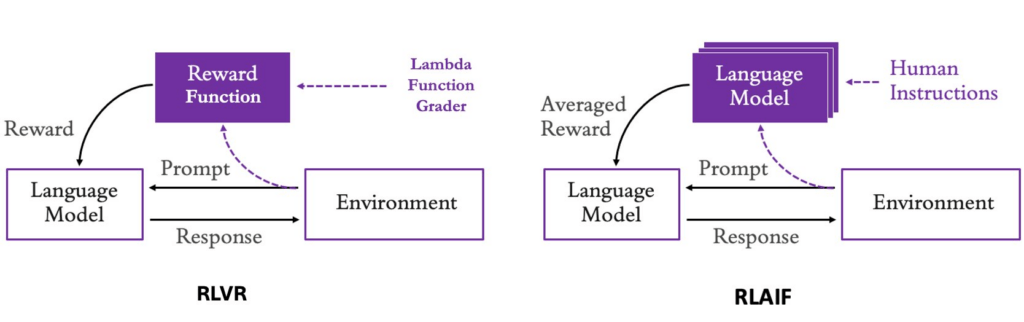

L’altro salto qualitativo è il reinforcement fine-tuning, ora sempre più integrato nei modelli Nova per task verificabili. Invece di ottimizzare solo sulla somiglianza con output di training, il modello viene guidato tramite funzioni di reward basate su regole o valutazione LLM, ideale per generazione di codice, moderazione contenuti, estrazione di dati strutturati o validazione di procedure.

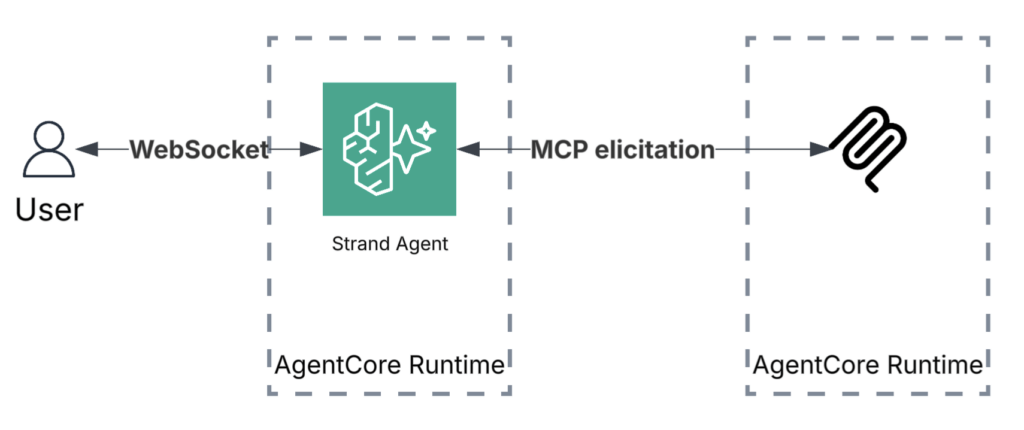

Questo si lega perfettamente ai nuovi workflow human-in-the-loop costruiti con Strands Agents, Model Context Protocol e AWS Step Functions. In contesti sanitari, ad esempio, un agente può elaborare documentazione clinica o preparare una dimissione, ma il flusso si interrompe prima delle azioni sensibili finché non arriva una conferma umana.

Questo pattern rende l’automazione compatibile con requisiti GxP, audit trail e protezione di dati sanitari sensibili, portando l’AI agentica dentro scenari enterprise ad alta compliance.

Nova Multimodal Embeddings abilita la ricerca audio semantica

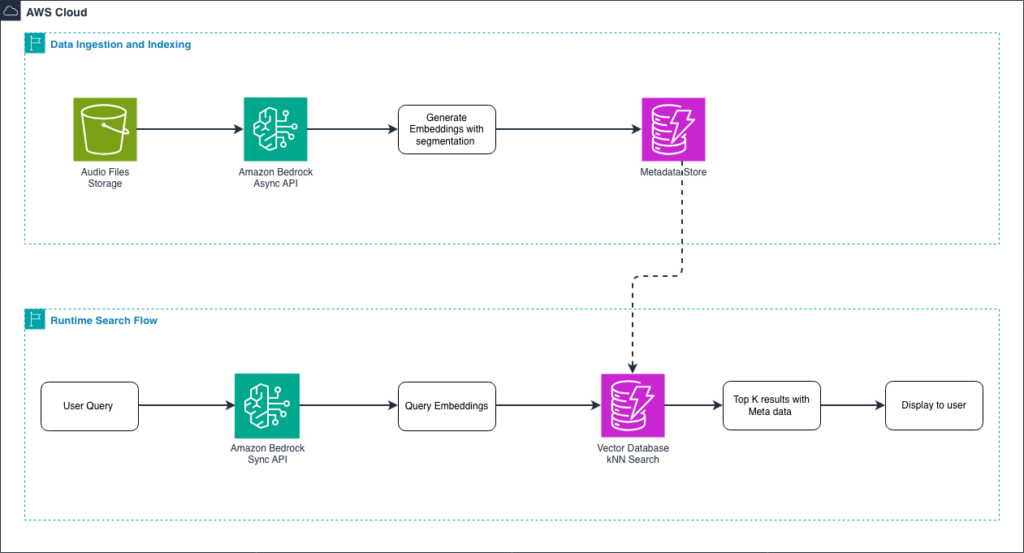

AWS amplia anche il fronte multimodale con Nova Multimodal Embeddings, che introduce una forma molto evoluta di ricerca audio semantica. Le registrazioni vengono trasformate in vettori densi capaci di catturare significato, tono emotivo, contesto conversazionale e persino intensità della voce. Questo consente query naturali come “cliente frustrato per fatturazione” o “momento in cui il medico comunica il piano terapeutico”, restituendo clip con timestamp estremamente precisi.

L’impatto è notevole per call center, media intelligence, archivi broadcast e librerie audio enterprise. Il supporto multilingua e l’integrazione con vector database rende questa funzione una delle evoluzioni più pratiche del retrieval multimodale oggi disponibile nel cloud pubblico.

Google Cloud domina il Sovereign Cloud e accelera AI su GKE

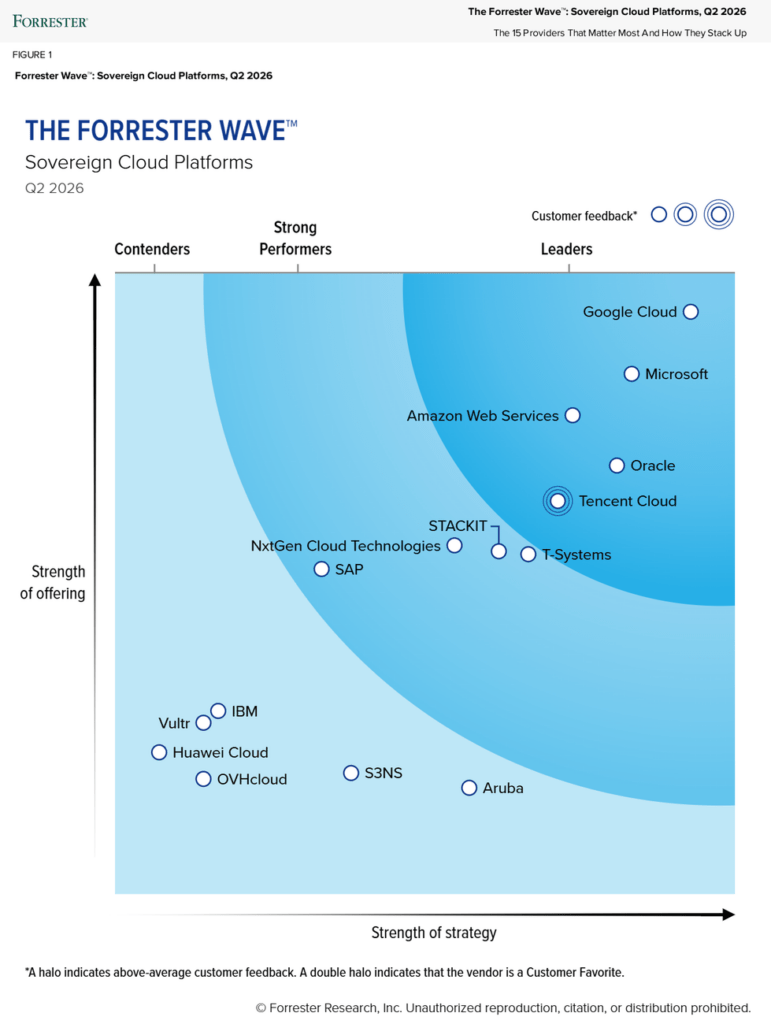

Sul lato infrastrutturale, Google Cloud rafforza la propria posizione come riferimento per il Sovereign Cloud, con una strategia che combina Data Boundary, Dedicated Cloud e Distributed Cloud per garantire residenza del dato, autonomia operativa e gestione locale delle chiavi. Questa impostazione è particolarmente rilevante per governi, difesa, utility e settori altamente regolati che devono mantenere il controllo giurisdizionale completo dei workload.

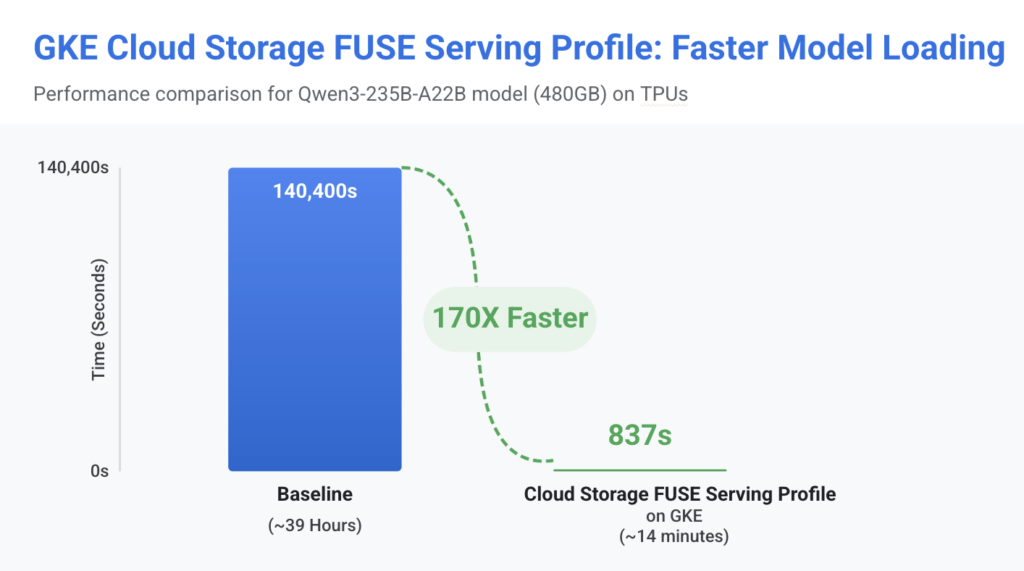

In parallelo, Google Kubernetes Engine evolve con ottimizzazioni specifiche per workload AI/ML. I nuovi profili di Cloud Storage FUSE automatizzano mount, cache e accesso ai bucket per modelli di grandi dimensioni, riducendo drasticamente il tempo di caricamento su TPU e GPU. Per pipeline di serving, questo significa passare da ore a minuti nel bootstrap dei modelli, con impatto diretto su costi e velocità di deployment.

Apache Iceberg e lakehouse aperti diventano centrali per analytics e AI

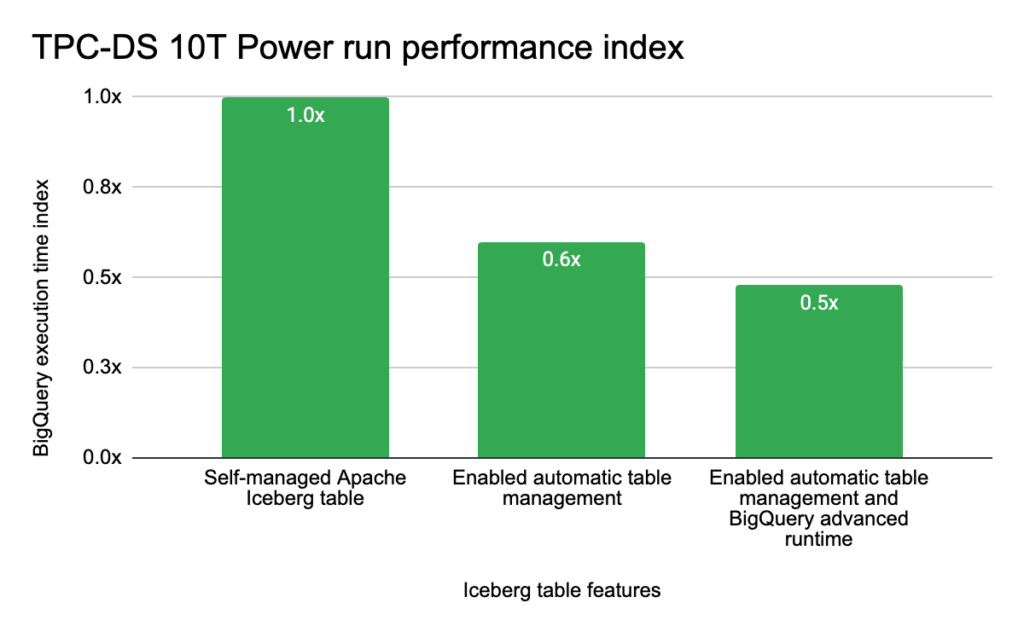

Un altro tassello chiave è la crescente interoperabilità di Apache Iceberg nei lakehouse enterprise. La possibilità di operare in lettura e scrittura bidirezionale tra Spark, Flink, Trino e motori cloud-native semplifica la costruzione di pipeline AI dove training data, feature store e analytics condividono lo stesso layer aperto.

Questa apertura riduce la dipendenza da stack proprietari e permette alle organizzazioni di costruire workflow che uniscono training, inference batch e real-time analytics senza dover duplicare dati tra sistemi differenti. È una direzione cruciale per chi vuole coniugare AI e governance dei dati su scala multi-cloud o sovereign.

Meta e OpenAI portano l’AI generativa verso esperienze più immersive

Sul fronte consumer e prosumer, Meta evolve i propri modelli con Muse Spark AI, introducendo una modalità contemplating che privilegia risposte più riflessive, multilivello e contestuali. L’obiettivo è spostare l’esperienza da semplice generazione rapida a ragionamento più lento e qualitativo, particolarmente utile in ricerca creativa, coaching e scrittura assistita.

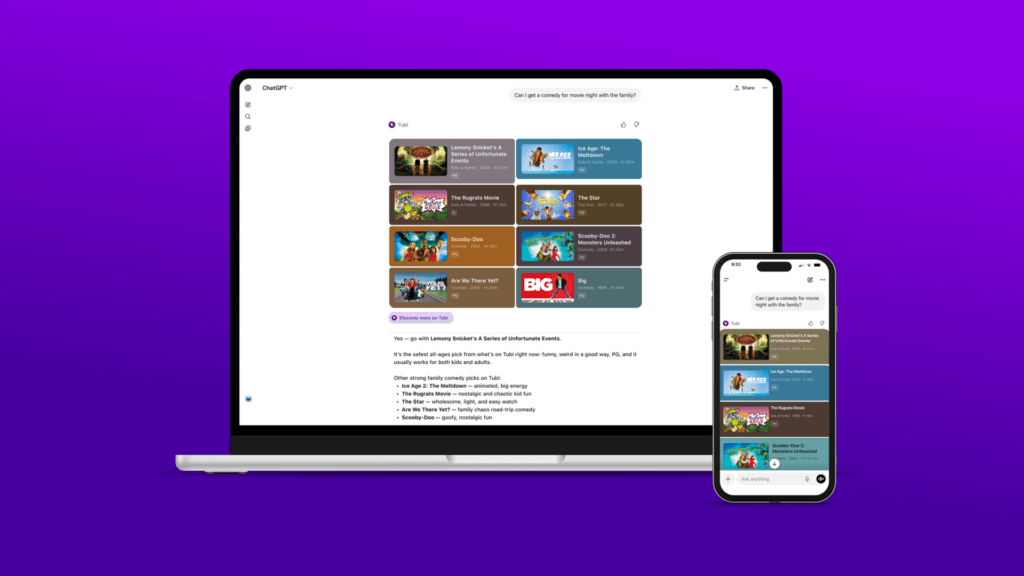

In parallelo, l’integrazione di Tubi dentro ChatGPT apre una nuova categoria di interazione: la scoperta video conversazionale. Gli utenti possono ricevere suggerimenti su oltre 300 mila titoli partendo da mood, generi o situazioni, con accesso diretto allo streaming e percorsi di navigazione guidati dal linguaggio naturale. Questo dimostra come la ricerca semantica stia rapidamente diventando il layer universale di accesso ai contenuti digitali.

Cloud AI 2026 punta su controllo, performance e usabilità concreta

Le novità di AWS Bedrock, Google Cloud e dei grandi player generativi convergono tutte verso una stessa direzione: AI più controllabile, specializzata e integrata nei workflow reali. Il fine-tuning dei modelli Nova, la leadership sul Sovereign Cloud, l’apertura dei lakehouse e le nuove esperienze multimodali spostano il mercato dalla sperimentazione alla produzione su larga scala. Per enterprise, governi e settori regolati, il messaggio è chiaro: l’adozione dell’AI non passa più soltanto dalla qualità del modello base, ma dalla capacità di governarlo su dati proprietari, mantenerne la conformità e inserirlo in pipeline robuste. Ed è qui che si giocherà il vero vantaggio competitivo del cloud nel resto del 2026.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.