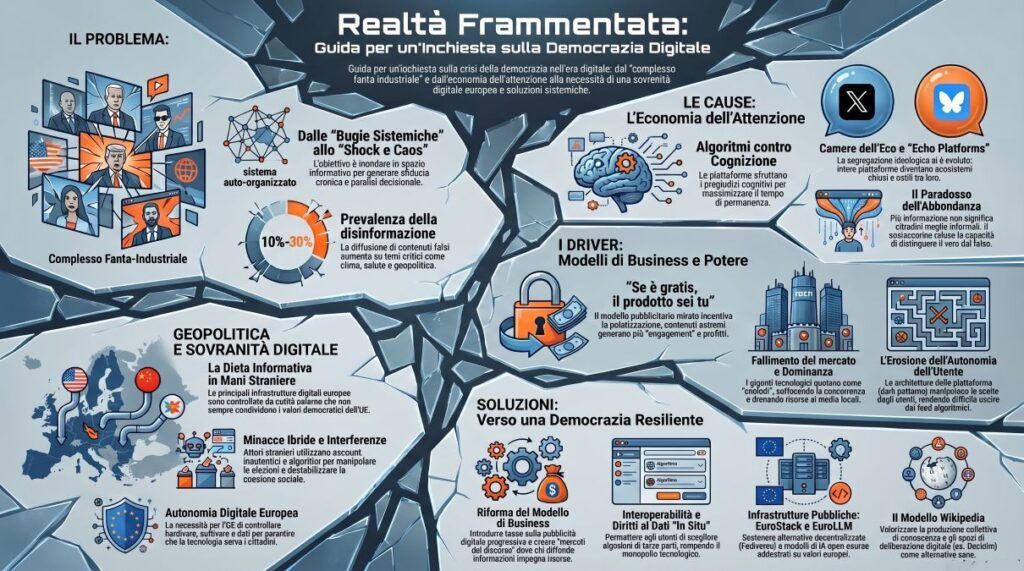

C’è un passaggio che più di ogni altro definisce il senso politico del nuovo rapporto del Joint Research Centre della Commissione europea: senza informazioni di alta qualità i cittadini non riescono più a chiedere conto ai governi delle proprie decisioni. Non è una formula accademica, non è un richiamo generico alla qualità del dibattito pubblico, ma il riconoscimento che la crisi democratica europea passa ormai dal controllo dello spazio informativo. Ed è qui che Fractured reality – How democracy can win the global struggle over the information space rompe un equilibrio retorico durato anni: non si limita a parlare di fake news, ma individua nell’economia dell’attenzione, nei modelli di business delle piattaforme e nella dipendenza geopolitica dell’Europa da infrastrutture digitali straniere il vero nodo strutturale della fragilità democratica contemporanea. Il documento, pubblicato nel 2026 dal servizio scientifico della Commissione europea, firmato da Mario Scharfbillig, Stephan Lewandowsky, Sacha Altay, Marshall Van Alstyne, Anastasia Kozyreva, Ralph Hertwig, Philipp Lorenz-Spreen, Renee DiResta, Sebastian Valenzuela, Stefanie Egidy, Walter Quattrociocchi e Amy Orben, non va letto come l’ennesimo compendio teorico sulla disinformazione. Va letto, piuttosto, come un atto d’accusa istituzionale contro un ecosistema che per anni è stato presentato come inevitabile, neutrale o al massimo correggibile con qualche intervento di fact-checking. Gli autori sostengono invece che il problema sia molto più profondo: le piattaforme non si limitano a ospitare contenuti problematici, ma organizzano la visibilità, premiano i messaggi più emotivi, divisivi e conflittuali e spingono il sistema informativo verso un punto in cui la realtà condivisa si spezza in tante realtà concorrenti, reciprocamente ostili. In altre parole, non è solo il falso a circolare troppo. È il vero a perdere valore dentro architetture progettate per monetizzare il tempo, la reazione e il conflitto.

Cosa leggere

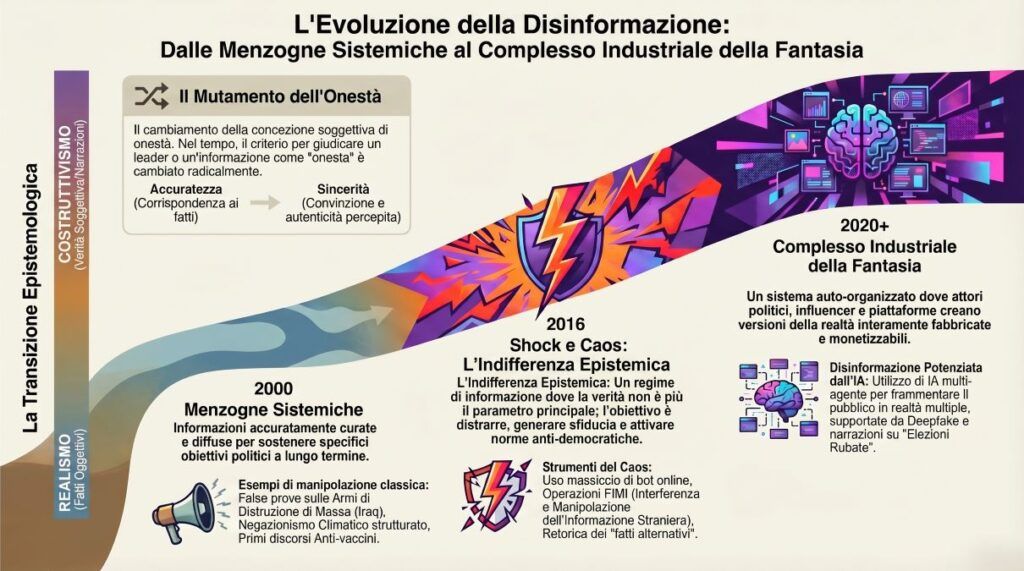

Dal fact-checking al fantasy-industrial complex

Il rapporto usa un’espressione destinata a lasciare il segno: “fantasy-industrial complex”. Non si parla più soltanto di singole campagne di manipolazione, di bufale isolate o di propaganda lineare. La diagnosi europea è che l’attuale ambiente informativo sia diventato un sistema auto-organizzato e vagamente coordinato in cui si mescolano misinformazione, disinformazione, inganno, frammenti di verità, suggestione e rumore. L’obiettivo, avverte il report, spesso non è nemmeno far credere una menzogna precisa, ma distrarre, generare sfiducia, attivare istinti autoritari e spingere il cittadino a rinunciare alla possibilità stessa di distinguere fra fatto, interpretazione e propaganda. È un salto di qualità decisivo. La manipolazione non punta più solo al consenso. Punta all’esaurimento cognitivo. Punta alla saturazione. Punta a “inondare la zona”, lasciando che sia il caos a fare il lavoro politico.

Qui emerge uno dei punti più forti del documento: colpevolizzare l’individuo disinformato è una diagnosi sbagliata. Gli autori contestano apertamente l’idea che il problema possa essere scaricato sul singolo cittadino distratto, ingenuo o ideologizzato. La disinformazione, scrivono, è insieme causa, mediatore e sintomo di danni sociali più profondi. Disuguaglianze economiche, insicurezza sociale persistente, identità partigiane irrigidite, sfiducia istituzionale: sono tutti fattori che spingono individui e comunità verso fonti alternative di informazione, modificando a loro volta i comportamenti pubblici e privati. In questo quadro, l’ambiente digitale non è soltanto uno specchio del disagio sociale, ma una macchina che lo amplifica e lo trasforma in dinamica politica. È una lettura molto diversa da quella semplicistica che per anni ha dominato il dibattito europeo, secondo cui sarebbe bastato insegnare un po’ più di alfabetizzazione mediatica per risolvere il problema.

Il report non si ferma alle formule. Porta anche numeri che aiutano a capire la scala del fenomeno. L’esposizione a contenuti di misinformazione all’interno del consumo online di notizie e contenuti civici tende a oscillare fra l’1% e il 10%, ma può salire fino al 10%-30% quando si parla di temi altamente conflittuali come clima, salute o guerra Russia-Ucraina. Ancora più significativo è il dato sui convincimenti errati consolidati: in alcune popolazioni target, il livello di false credenze è superiore alla mera esposizione al contenuto falso e, nel caso citato dal rapporto, il 47% degli anziani risulta portatore di convinzioni errate su questioni sanitarie importanti. Non è dunque solo una questione di volume di contenuti tossici, ma di sedimentazione cognitiva e sociale di convinzioni false o distorte che poi influenzano il comportamento democratico e sanitario.

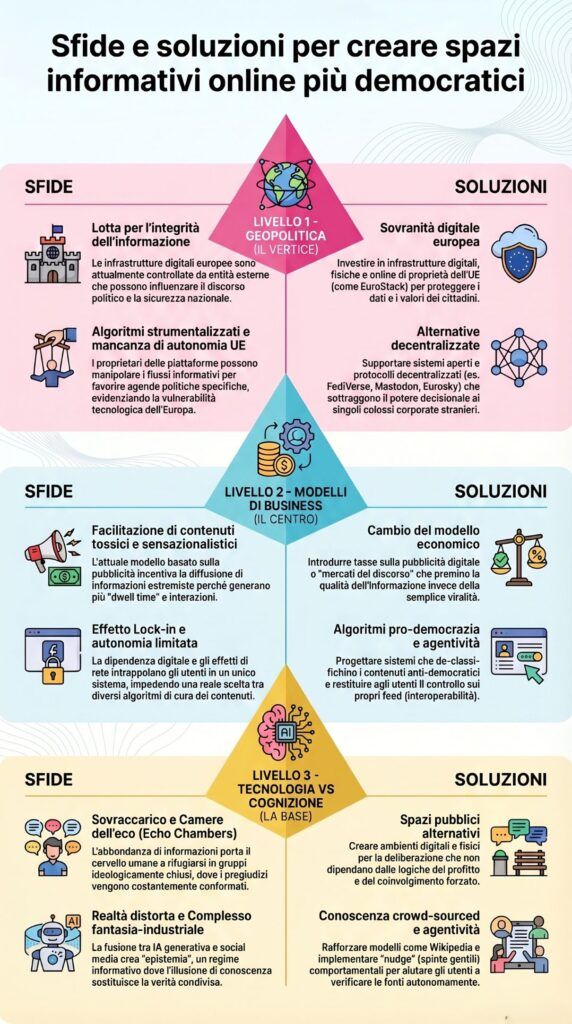

Dalla mediazione algoritmica alla fine della neutralità

L’Unione europea inserisce questo scenario dentro un mutamento storico più ampio: la notizia non arriva più prevalentemente dai media legacy, ma da sistemi di mediazione algoritmica. Il rapporto ricorda che lo spostamento del consumo informativo verso i social è ormai globale. In Europa il fenomeno è più lento che negli Stati Uniti, ma la traiettoria è chiarissima: meno del 20% degli europei indica i social come fonte principale di informazione, contro il 34% negli Usa, mentre tra i più giovani le percentuali sono molto più alte e destinate a crescere. Questo significa che il cuore del problema non è soltanto editoriale, ma infrastrutturale. Chi controlla i feed, controlla sempre più spesso anche l’agenda informativa, la visibilità dei temi e il grado di polarizzazione del discorso pubblico.

Il passaggio successivo è forse il più delicato politicamente, perché chiama in causa il mito della neutralità tecnica. Gli autori scrivono che le piattaforme consentono formalmente la libertà di espressione, ma allo stesso tempo modellano ciò che viene amplificato secondo interessi propri, opachi e sottratti al controllo democratico. È una distinzione cruciale. Non basta dire che tutti possono pubblicare se poi la struttura dei sistemi di raccomandazione rende sistematicamente più visibili contenuti estremi, divisivi o tossici. Il rapporto afferma apertamente che gli algoritmi possono essere progettati per lavorare a favore della democrazia e non contro di essa, perché il ranking non è un fatto naturale ma una scelta politica travestita da ottimizzazione tecnica. Se un contenuto antidemocratico viene retrocesso, spiegano gli autori, gli utenti risultano meno polarizzati e le loro emozioni meno negative. Il punto non è quindi se esista l’intervento algoritmico, ma chi lo decide, per quali fini e con quale accountability.

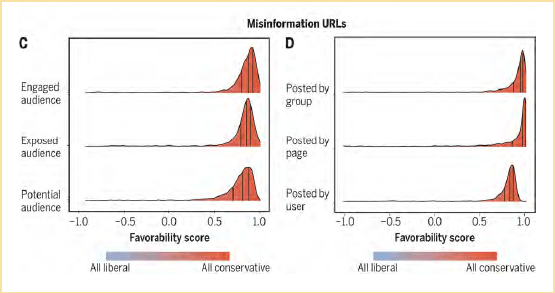

La Figura fornisce un’illustrazione sorprendente di questa inclinazione.

La maggior parte delle notizie etichettate come disinformazione su Facebook (97%) ha un pubblico che in media è conservatore (pannello di sinistra). Un modello simile si osserva per la condivisione (a destra). Figura basata sui dati di oltre 200 milioni di utenti Facebook

.

In questa chiave il rapporto smonta anche l’idea secondo cui il modello dominante dei social sia semplicemente “il prezzo da pagare” per avere servizi gratuiti. No: il problema è che l’engagement maximization è diventato il motore dell’intero sistema. Le piattaforme selezionano contenuti che prolungano il tempo di permanenza e aumentano il valore pubblicitario dell’utente, indipendentemente dalla qualità dell’informazione. Per questo il report sostiene che l’attuale economia dell’attenzione privilegia strutturalmente contenuti negativi, emotivi e conflittuali. Non è un effetto collaterale. È una conseguenza funzionale al modello di ricavo. Da qui nasce una delle proposte più nette del documento: cambiare i modelli di business, non limitarsi a correggere i sintomi.

Le soluzioni europee tra spazi pubblici, wiki e demonetizzazione

Le soluzioni indicate non sono cosmetiche. La prima è la creazione di spazi pubblici alternativi che non dipendano dall’economia dell’attenzione. Gli autori parlano anche di spazi fisici, non solo digitali, perché la ricostruzione di una realtà condivisa non può essere lasciata esclusivamente a piattaforme private costruite per frammentare e personalizzare. La seconda è il rafforzamento della conoscenza collaborativa, con un chiaro riferimento a Wikipedia e ai modelli wiki decentralizzati, considerati fra le fonti più affidabili e meno distorte. La terza è dare ai cittadini più agenzia attraverso design diversi, pause di raffreddamento, prompt di accuratezza, lettura laterale, campagne di consapevolezza e strumenti che aiutino a non reagire impulsivamente. C’è poi il nodo della fact-checking implementation: il rapporto riconosce che il fact-checking, così com’è, spesso non raggiunge chi ha già visto il contenuto falso. Infine, arriva la proposta economicamente più dura: demonetizzare gli attori della disinformazione, perché finché la menzogna sarà redditizia continuerà a essere prodotta e distribuita.

Tassare la tossicità e restituire autonomia agli utenti

Ma è nel capitolo sui modelli economici che il testo diventa davvero dirompente. Il JRC mette sul tavolo l’idea di una tassa progressiva sulla pubblicità digitale con un obiettivo esplicito: spingere le piattaforme lontano dalla dipendenza da attenzione e sorveglianza e verso modelli più sostenibili, anche a sottoscrizione o non profit. Il rapporto cita la proposta di Daron Acemoglu e Simon Johnson di una tassa del 50% sui ricavi pubblicitari oltre i 500 milioni di dollari e ne elenca i vantaggi: riallineamento degli incentivi, beneficio concorrenziale contro la concentrazione, maggiore neutralità rispetto ai contenuti e maggiore efficienza regolatoria rispetto alla moderazione manuale o alla correzione caso per caso. Ancora più interessante è il parallelo ambientale: tassare la tossicità del flusso informativo un po’ come si tassano gli scarichi industriali, con sistemi di campionamento rappresentativo capaci di valutare la prevalenza di contenuti dannosi, illegali o disinformativi. È una prospettiva radicale, perché sposta il baricentro dalla singola violazione alla responsabilità sistemica del modello industriale.

Accanto alla tassazione, il rapporto propone di restituire autonomia agli utenti tramite interoperabilità e in-situ data rights, cioè il diritto di essere serviti da altri operatori usando i propri dati. Tradotto: non essere più prigionieri dell’algoritmo proprietario della piattaforma dominante, ma poter scegliere da un menu di sistemi di raccomandazione, curatori e modalità di ordinamento dei contenuti. Se attuata davvero, una simile riforma colpirebbe il cuore del potere delle Big Tech, perché toglierebbe al proprietario della piattaforma il monopolio sulla mediazione della visibilità. Ecco perché gli autori insistono sulla necessità di standard, API e protocolli comuni in grado di abbattere i costi di conformità e aprire nuovi spazi di innovazione europea. Non è un tecnicismo: è un pezzo di sovranità democratica.

Sovranità digitale come questione democratica

Ed è qui che l’analisi cambia ancora livello. Perché, dice il rapporto, anche se si correggesse il modello dell’attenzione, rimarrebbe un ostacolo decisivo: le piattaforme più rilevanti sono controllate da soggetti esterni alla giurisdizione europea. La dieta informativa degli europei, si legge, è quindi nelle mani di attori stranieri che potrebbero non condividere i valori democratici europei. Il documento inserisce questo punto dentro la più ampia lotta geopolitica per l’integrità informativa e parla apertamente di intrusioni straniere nella sovranità europea, di piattaforme online come parte dell’agenda delle minacce ibride e di algoritmi che possono essere strumentalizzati sia dai proprietari sia da campagne inautentiche orchestrate da attori statali. Non è più solo il terreno della policy digitale: è già pienamente il terreno della sicurezza, della difesa cognitiva e della tenuta istituzionale.

La risposta proposta è la sovranità digitale europea. Ma qui il report prova a dare sostanza a un’espressione spesso usata in modo vago. Sovranità, in questo testo, significa infrastrutture europee fisiche, digitali e online, sostegno a sistemi decentralizzati come Mastodon, FediVerse, Atmosphere ed Eurosky, investimenti in cloud, potenza di calcolo, ecosistemi applicativi alternativi, adozione pubblica precoce e formazione dei funzionari. In parallelo si propone di trattare l’informazione come bene comune, sostenendo modelli di remunerazione non puramente commerciali, comprese sovvenzioni pubbliche, schemi reputazionali e persino valute locali. È un’impostazione che rompe con l’idea che il mercato pubblicitario globale debba restare l’unico arbitro possibile dello spazio informativo europeo.

AI generativa, illusione di conoscenza e risposta europea

Il rapporto non ignora il ruolo dell’intelligenza artificiale generativa, anzi lo colloca al centro della prossima fase del conflitto informativo. Viene citata una valutazione su 466.000 affermazioni generate da AI che mostra un compromesso allarmante: maggiore persuasività, ma minore accuratezza fattuale. Allo stesso tempo il documento evita il sensazionalismo facile e riconosce che, finora, l’evidenza non dimostra che la GenAI sia già stata un game changer elettorale assoluto. Il problema, spiegano gli autori, è un altro: la capacità di creare l’illusione della conoscenza, soprattutto quando i contenuti generativi si mescolano con le logiche di viralità dei social. In quel punto il rischio non è solo la menzogna automatizzata, ma l’erosione del senso stesso di verificabilità condivisa. Eppure il testo non è tecnofobico: vede nell’AI anche potenzialità democratiche per traduzione della conoscenza, deliberazione, trasparenza e inclusione, purché inserite in architetture coerenti con i valori europei. Da questo punto di vista è significativa l’apertura verso un’AI europea basata sui valori Ue, con richiami all’uso trasparente ed etico dei dati, al rispetto del copyright, a guardrail più efficaci contro contenuti problematici e a benchmark che misurino non solo la capacità tecnica, ma anche l’impatto sociale. Il rapporto cita inoltre EuroLLM-22B, modello open source multilingue addestrato in Europa e sulle 24 lingue ufficiali dell’Unione, come esempio di direzione da sostenere se manterrà le promesse. È il segno che la partita non è solo difensiva: Bruxelles inizia a capire che senza capacità industriale, computazionale e linguistica autonoma la regolazione rischia di restare un guscio vuoto.

Minimum viable evidence e la corsa contro il tempo

Un altro elemento notevole è l’approccio metodologico adottato. Il JRC sostiene che nel digitale non sia più sufficiente attendere evidenze definitive prima di intervenire. Parla di “minimum viable evidence”, cioè della necessità di iniziare a testare misure di mitigazione quando i rischi sono già riconoscibili, anche se la letteratura non ha ancora raggiunto il massimo grado di consolidamento. È una presa d’atto importante, perché la velocità delle piattaforme e dell’industria AI ha superato la lentezza fisiologica della produzione scientifica e della risposta normativa. Per questo il report chiede accesso più rapido ai dati delle piattaforme e arriva a proporre un “CERN for Data and Democracy” europeo, capace di unire competenze frammentate e fare ricerca industriale sulle piattaforme in tempo reale. È forse una delle idee più concrete e più strategiche dell’intero documento.

La conclusione politica del rapporto è netta: l’Unione europea è fra i pochi attori in grado di intervenire davvero, ma non può farlo continuando a inseguire il problema soltanto con il linguaggio della moderazione dei contenuti. Deve affrontare insieme tecnologia, incentivi economici e geopolitica. In questo senso Fractured reality segna una maturazione del discorso europeo. Non siamo più nel perimetro ingenuo delle “bufale online” da correggere a valle. Siamo nel cuore di una guerra per l’integrità informativa, in cui i feed sono infrastrutture di potere, gli algoritmi sono strumenti di governo privato e la dipendenza da piattaforme straniere è una questione di sovranità tanto quanto il cloud, i chip o le reti. Per Matrice Digitale, il punto più interessante è proprio questo cambio di paradigma. Bruxelles sembra finalmente ammettere che il problema non è l’utente che sbaglia clic, ma il sistema che premia il contenuto peggiore, spezza la realtà comune, monetizza l’istinto e lascia l’Europa a consumare informazione dentro recinti costruiti altrove. Se questa consapevolezza produrrà davvero riforme incisive, è ancora tutto da vedere. Ma il rapporto del JRC ha già fatto una cosa importante: ha smesso di raccontare la crisi informativa come incidente di percorso e ha iniziato a descriverla per ciò che è, cioè una questione strutturale di democrazia, potere economico e autonomia strategica europea.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.