Meta rinnova completamente la propria implementazione di WebRTC introducendo un’architettura modulare capace di supportare oltre 50 casi d’uso tra messaggistica, videochiamate, cloud gaming e realtà virtuale. Il nuovo approccio elimina il fork interno e si riallinea con il codice upstream migliorando prestazioni e sicurezza. In parallelo Netflix rafforza la gestione operativa degli eventi live su larga scala mentre Google Cloud definisce nuove linee guida per infrastrutture GPU resilienti dedicate all’intelligenza artificiale. Queste evoluzioni segnano un passo deciso verso sistemi real time più scalabili e affidabili.

Cosa leggere

Meta introduce layer shim per unificare WebRTC e ridurre debito tecnico

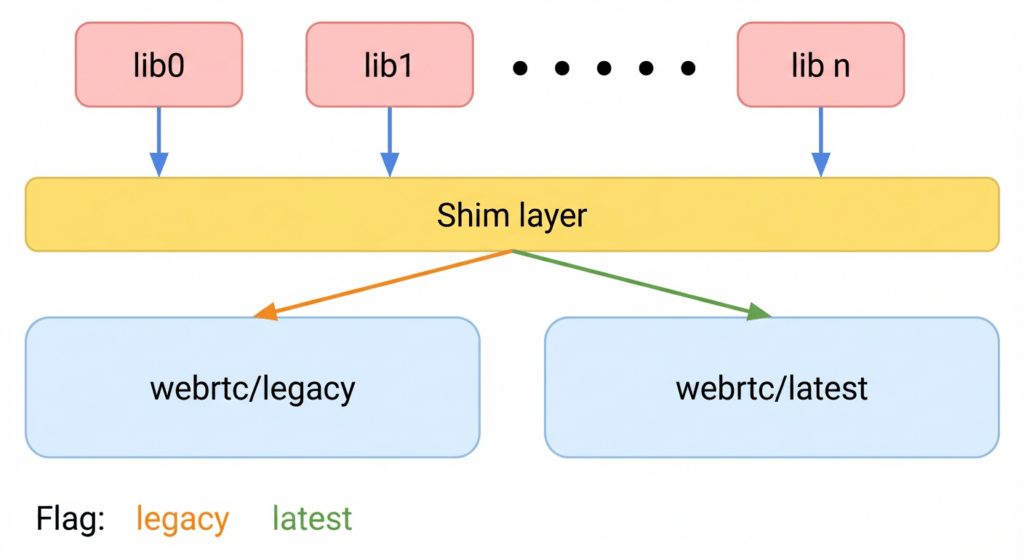

Meta abbandona il precedente fork proprietario di WebRTC che nel tempo aveva creato divergenze rispetto al progetto open source ufficiale. L’azienda sviluppa un layer shim che funge da interfaccia tra il codice applicativo e le diverse implementazioni del protocollo.

Questo strato espone un’API unificata che consente agli sviluppatori di lavorare indipendentemente dalla versione sottostante, eliminando la complessità legata alla gestione di più branch divergenti. Il sistema dual stack esegue contemporaneamente versioni legacy e aggiornate nello stesso binario, permettendo una transizione graduale senza interruzioni del servizio.

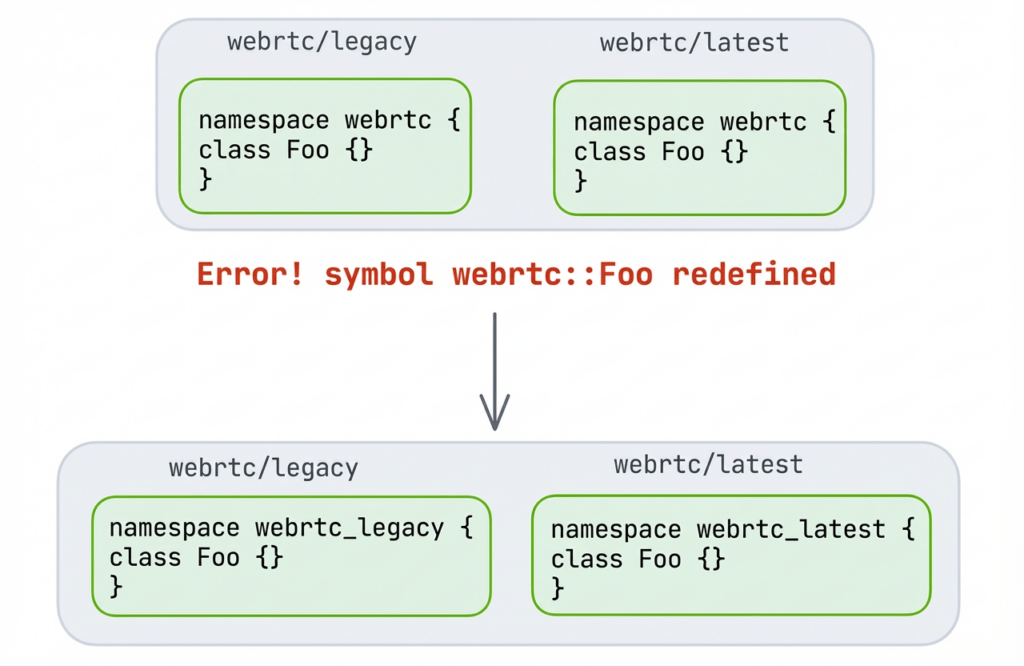

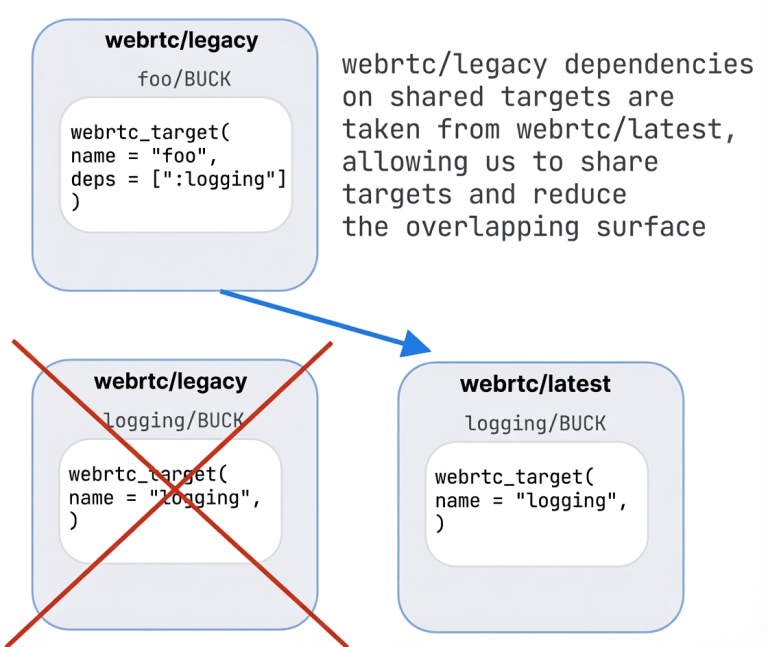

La gestione dei conflitti avviene tramite un meccanismo di renamespacing automatico che separa le componenti in namespace distinti. Il codice viene trasformato dinamicamente per distinguere tra implementazioni legacy e aggiornate, consentendo un controllo preciso del comportamento runtime. Questo approccio riduce drasticamente il debito tecnico accumulato negli anni e permette a Meta di riallinearsi rapidamente con le release ufficiali di Chromium.

Meta migliora performance e stabilità con aggiornamenti continui WebRTC

L’introduzione dell’architettura modulare produce effetti concreti sulle prestazioni delle applicazioni. Meta registra una riduzione del consumo CPU fino al 10 percento e un calo del tasso di crash del 3 percento nelle principali piattaforme. Anche la dimensione del binario diminuisce tra 100 e 200 kilobyte, contribuendo a migliorare l’efficienza complessiva delle applicazioni distribuite su larga scala. L’azienda elimina componenti legacy come usrsctp e corregge vulnerabilità accumulate nel tempo.

Il passaggio a un modello di aggiornamento continuo rappresenta un cambiamento strutturale importante. Meta passa da rilasci sporadici a un ciclo costante sincronizzato con le versioni stabili di Chromium, arrivando fino alla release M145. Questo garantisce maggiore sicurezza e accesso rapido alle innovazioni introdotte dalla community open source, migliorando la qualità delle comunicazioni real time su scala globale.

Netflix scala le operazioni live con infrastruttura umana specializzata

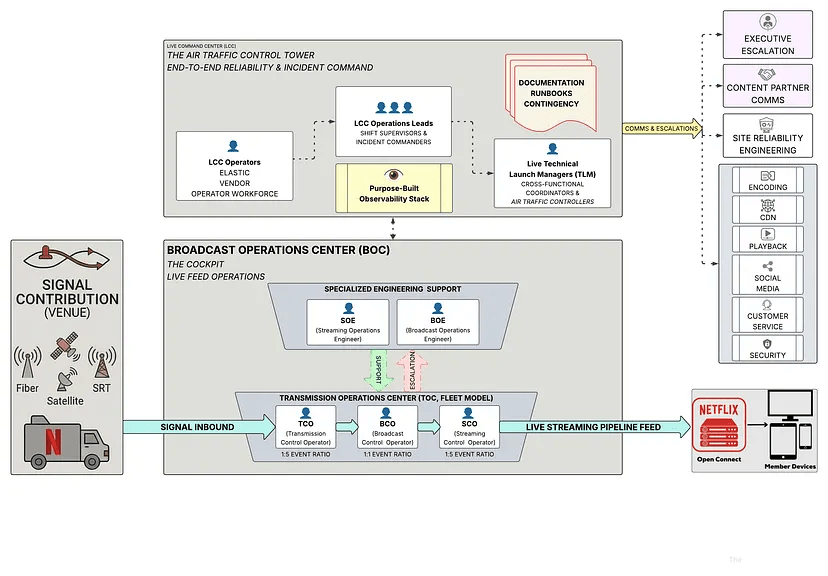

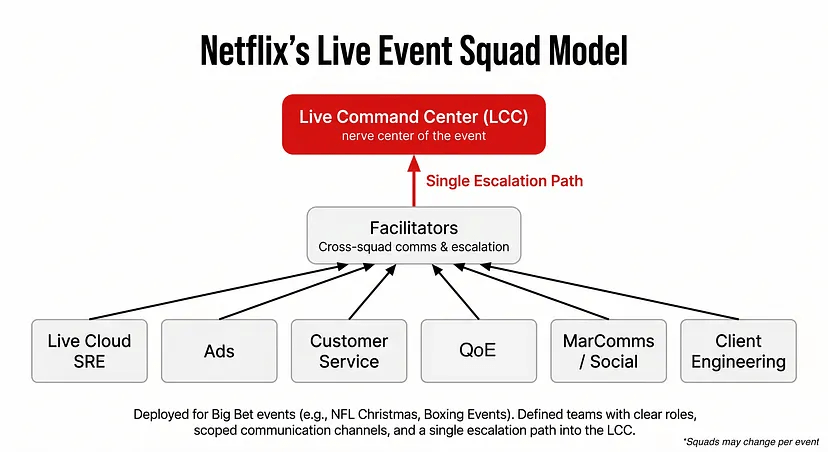

Netflix affronta una crescita significativa nel numero di eventi live passando da un singolo evento mensile nel 2023 a oltre nove eventi giornalieri nel 2026. Questo incremento rende inefficace il modello iniziale basato su team di ingegneri generalisti e porta alla creazione di una struttura operativa dedicata. L’azienda introduce ruoli specializzati come Transmission Control Operators, Streaming Control Operators e Broadcast Control Operators, ciascuno responsabile di specifiche fasi della pipeline di streaming.

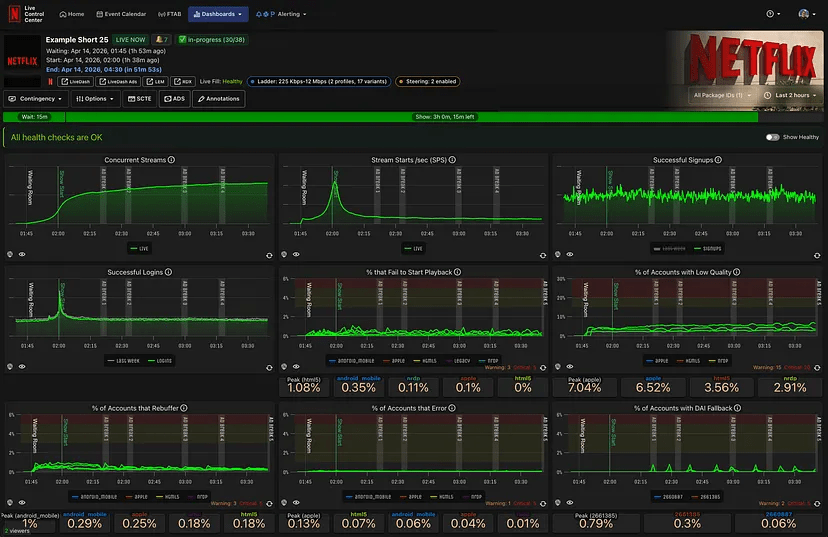

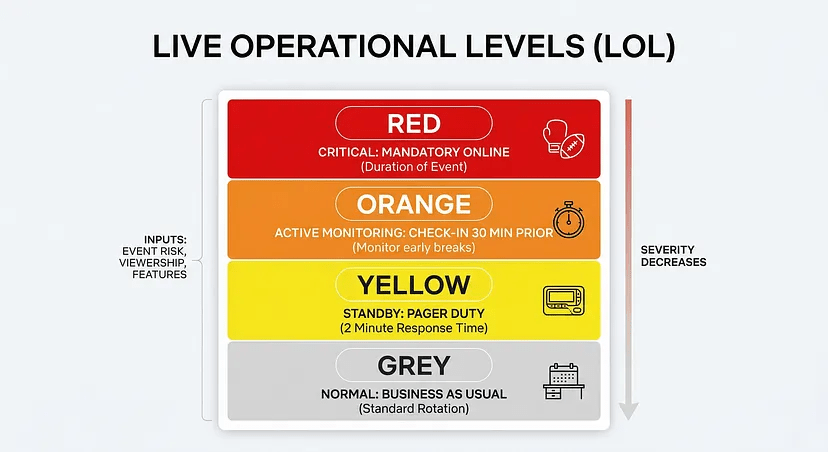

Un Live Command Center coordina tutte le operazioni attraverso team cross funzionali e playbook dettagliati preparati in anticipo. Netflix classifica gli eventi in diversi livelli di priorità e adatta le risorse operative in base all’importanza del contenuto. Per gli eventi più critici viene attivato un Broadcast Operations Center dedicato con strumenti avanzati di monitoraggio e controllo. Questo modello consente di mantenere elevati standard di qualità anche in contesti ad alta complessità operativa.

Netflix integra ridondanza e monitoraggio per garantire continuità degli eventi

Per assicurare affidabilità, Netflix richiede almeno tre percorsi di trasmissione indipendenti per ogni evento live. Questo approccio garantisce continuità anche in caso di guasti su una delle linee. Gli operatori eseguono test approfonditi prima della messa in onda e monitorano costantemente metriche critiche durante la trasmissione. Il sistema integra strumenti automatici di rilevamento delle anomalie con interventi manuali rapidi da parte degli operatori.

La combinazione tra automazione e supervisione umana rappresenta un elemento chiave per gestire eventi live che non possono essere interrotti o ripetuti. Il modello operativo di Netflix dimostra come la scalabilità non dipenda solo dalla tecnologia ma anche dall’organizzazione dei team e dalla capacità di coordinare risorse in tempo reale.

Google Cloud definisce architetture GPU resilienti per AI su larga scala

Google Cloud pubblica una guida tecnica per la progettazione di infrastrutture GPU affidabili dedicate all’addestramento di modelli di intelligenza artificiale. L’approccio si basa su una gestione proattiva che integra validazione hardware, telemetria continua e sistemi di remediation automatica. Il framework identifica quattro principi fondamentali: prevenzione dei guasti, monitoraggio continuo, trasparenza operativa e minimizzazione delle interruzioni. Questo modello consente di mantenere elevata la produttività anche in cluster composti da migliaia o centinaia di migliaia di GPU. Le architetture moderne richiedono una gestione coordinata delle risorse, soprattutto in configurazioni rack scale dove più unità lavorano in modo interconnesso. Google Cloud introduce sistemi che correlano le metriche hardware con il concetto di goodput, ovvero il lavoro utile completato nel tempo, migliorando la visibilità sulle prestazioni reali dei cluster.

Google Cloud introduce automazione e ridondanza per ridurre downtime GPU

Per garantire continuità operativa, Google Cloud consiglia di mantenere una ridondanza hardware tra il 10 e il 20 percento. Questo buffer consente di assorbire eventuali guasti senza interrompere i workload. I sistemi di remediation automatica permettono al cluster di auto riprendersi senza intervento umano, mentre algoritmi di scheduling intelligente spostano i carichi di lavoro su nodi sani in modo proattivo. Il parametro chiave diventa il Mean Time Between Interruption, che misura l’affidabilità complessiva del sistema nel tempo. Le notifiche di manutenzione e le funzionalità di migrazione automatica consentono di mantenere attivi processi di training complessi anche durante interventi infrastrutturali. Questo approccio riduce significativamente i tempi di debug e accelera lo sviluppo di modelli AI su larga scala.

Big Tech investono in resilienza e scalabilità delle infrastrutture critiche

Le iniziative di Meta, Netflix e Google Cloud mostrano una direzione comune verso infrastrutture più resilienti e scalabili. L’aggiornamento di WebRTC migliora la gestione delle comunicazioni real time su miliardi di utenti, mentre il modello operativo di Netflix dimostra l’importanza dell’integrazione tra tecnologia e organizzazione umana. Google Cloud completa il quadro con soluzioni avanzate per garantire stabilità nei sistemi di calcolo accelerato. Questi sviluppi evidenziano come le grandi piattaforme stiano investendo non solo in nuove funzionalità ma anche nella solidità delle infrastrutture esistenti. La capacità di gestire carichi elevati, prevenire guasti e mantenere continuità operativa diventa un elemento centrale nella competizione tecnologica globale.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.