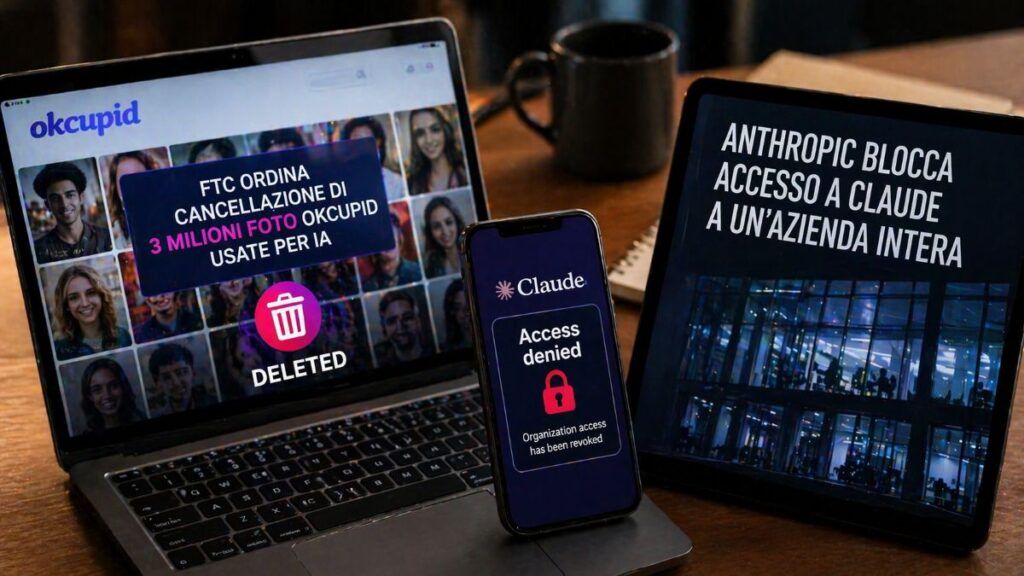

La FTC impone a OkCupid la cancellazione di 3 milioni di foto utilizzate per addestrare modelli di intelligenza artificiale senza consenso, mentre Anthropic blocca improvvisamente l’accesso a Claude per un’intera azienda. I due episodi, emersi nell’aprile 2026, mostrano criticità profonde nella gestione dei dati e nelle policy delle piattaforme AI. Da un lato emergono pratiche storiche di condivisione non autorizzata, dall’altro decisioni operative opache che impattano direttamente sulle aziende. Il contesto evidenzia un problema sistemico nella governance dell’intelligenza artificiale.

Cosa leggere

FTC sanziona OkCupid per uso illecito di dati utente

L’indagine della FTC riguarda una condivisione risalente al 2014, quando OkCupid ha fornito accesso completo a dati utente a Clarifai. Le informazioni includevano immagini, dati geografici e profili demografici senza consenso esplicito. Questa pratica violava direttamente la policy della piattaforma che escludeva la condivisione con terze parti non collegate. L’autorità americana ha imposto la cancellazione dei dati e del modello AI addestrato, oltre a un divieto di 20 anni sull’uso di pratiche ingannevoli relative ai dati.

Clarifai utilizza le immagini per addestramento di computer vision

Clarifai ha sfruttato il dataset per sviluppare sistemi di riconoscimento visivo. La collaborazione è avvenuta in modo informale tra soggetti collegati, senza accordi formali né trasparenza verso gli utenti. L’accesso a milioni di immagini ha permesso di migliorare significativamente le capacità dei modelli AI. Il caso dimostra come dataset provenienti da piattaforme consumer possano alimentare tecnologie avanzate senza controllo adeguato.

Match Group deve cancellare dati e modelli AI derivati

La società madre Match Group è obbligata a eliminare sia le immagini sia i modelli addestrati con tali dati. La decisione rappresenta uno dei rari casi in cui viene imposta la distruzione di sistemi AI derivati da dati illegittimi. Tuttavia, l’assenza di sanzioni economiche solleva interrogativi sull’efficacia deterrente delle misure. Il provvedimento punta soprattutto a garantire maggiore trasparenza futura nelle pratiche di gestione dei dati.

Anthropic blocca Claude senza spiegazioni dettagliate

Parallelamente, Anthropic revoca l’accesso al modello Claude all’azienda Belo, interrompendo il lavoro di circa 60 dipendenti. Il blocco avviene tramite un’email automatica che cita una violazione generica delle policy. L’azienda colpita non riceve dettagli specifici né prove concrete. Questo tipo di intervento evidenzia la dipendenza crescente delle imprese da servizi AI centralizzati e la fragilità operativa che ne deriva.

Il caso Belo evidenzia i rischi della dipendenza da API AI

L’interruzione improvvisa dei servizi AI ha causato un blocco operativo immediato. I flussi di lavoro basati su integrazioni e cronologie del modello sono stati sospesi senza preavviso. L’accesso è stato ripristinato dopo circa 15 ore, probabilmente a seguito dell’attenzione mediatica. Il caso dimostra come la continuità operativa delle aziende possa essere compromessa da decisioni unilaterali dei provider AI.

Policy opache e mancanza di strumenti di ricorso efficaci

Le policy di Anthropic non chiariscono i criteri che portano a un blocco dell’accesso. L’unico canale di supporto disponibile è un modulo online, spesso associato a tempi di risposta lunghi o inesistenti. Questa mancanza di trasparenza rende difficile per le aziende comprendere e prevenire eventuali violazioni. Il problema non riguarda solo un singolo caso ma riflette una criticità diffusa nel settore AI.

Due casi che evidenziano problemi strutturali nel settore

Gli episodi di OkCupid e Anthropic rappresentano due aspetti diversi dello stesso problema. Il primo mostra l’uso storico di dati senza consenso per addestrare modelli AI. Il secondo evidenzia il controllo centralizzato e opaco delle piattaforme AI moderne. Entrambi i casi sottolineano la necessità di regole più chiare e di meccanismi di responsabilità più efficaci.

Privacy e controllo diventano temi centrali nell’era AI

La gestione dei dati personali e l’accesso ai servizi AI sono elementi chiave nel nuovo ecosistema digitale. Le aziende devono garantire trasparenza nell’uso dei dati, mentre i provider AI devono offrire maggiore prevedibilità nelle loro policy. La fiducia degli utenti e delle imprese dipende dalla capacità di bilanciare innovazione tecnologica e responsabilità operativa.

Il futuro richiede regolamentazione più chiara e accountability

I casi analizzati dimostrano che la regolamentazione attuale è ancora in evoluzione. Le autorità intervengono spesso a posteriori, mentre le piattaforme mantengono ampio controllo sulle decisioni operative. La crescita dell’intelligenza artificiale richiede un quadro normativo più definito, in grado di proteggere utenti e aziende senza rallentare l’innovazione.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.