Google Cloud presenta le nuove TPU 8t, TPU 8i e la rete Virgo durante Google Cloud Next ‘26, ridefinendo l’infrastruttura per l’intelligenza artificiale su scala industriale. In parallelo, la collaborazione con NVIDIA introduce nuove architetture per fabbriche di AI agentica e fisica. L’insieme di hardware, rete e software forma un AI Hypercomputer capace di supportare training, inference e simulazioni avanzate con efficienza e throughput senza precedenti.

Cosa leggere

TPU 8t ottimizza il training di modelli AI su larga scala

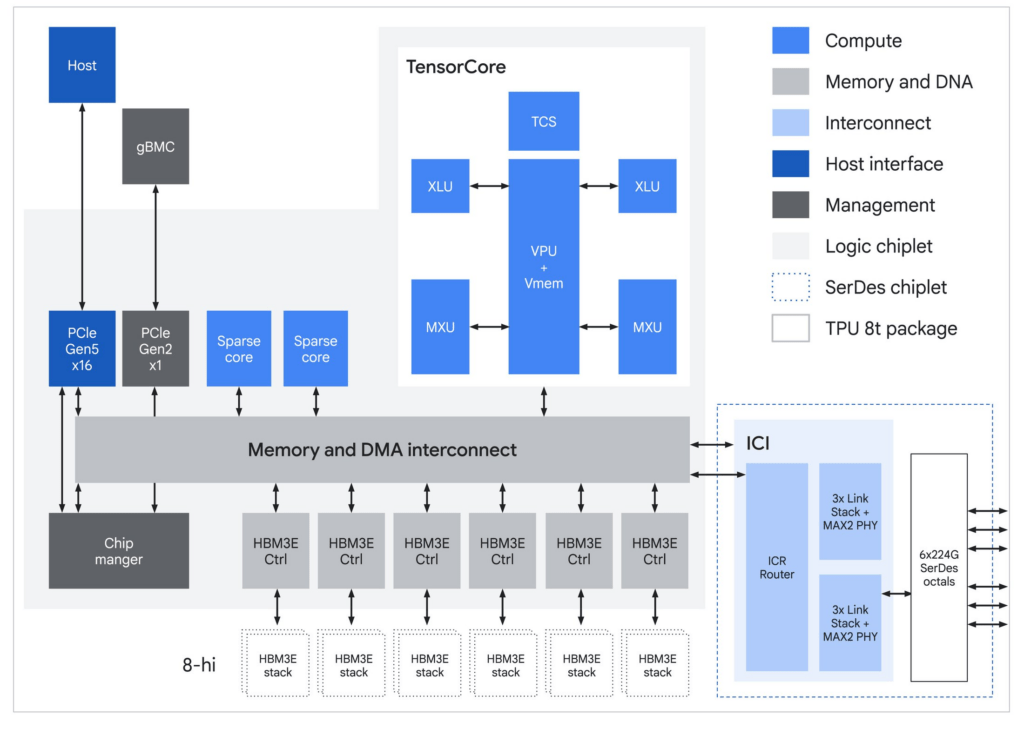

La TPU 8t è progettata per il pre-training di modelli densi e Mixture-of-Experts. Il chip raggiunge 12,6 petaFLOPS in FP4 grazie alla quantizzazione a 4 bit e integra 216 GB di memoria HBM con bandwidth elevata. L’architettura include unità dedicate per accessi irregolari e consente un bilanciamento efficace tra calcolo e comunicazione. Il sistema scala fino a migliaia di chip per superpod e offre miglioramenti significativi in performance per dollaro e per watt rispetto alla generazione precedente.

TPU 8i accelera inference e agenti AI multi-turn

La TPU 8i è ottimizzata per inference, serving e reasoning agentico. Il chip offre 10,1 petaFLOPS in FP4 e una memoria espansa fino a 288 GB HBM, con latenza ridotta nelle operazioni collettive. L’architettura supporta contesti lunghi e modelli avanzati per simulazioni di ambienti complessi. La topologia di rete interna migliora la comunicazione tra chip e riduce i tempi di risposta nelle applicazioni ad alta intensità di dati.

Virgo Network abilita data center AI su scala megacluster

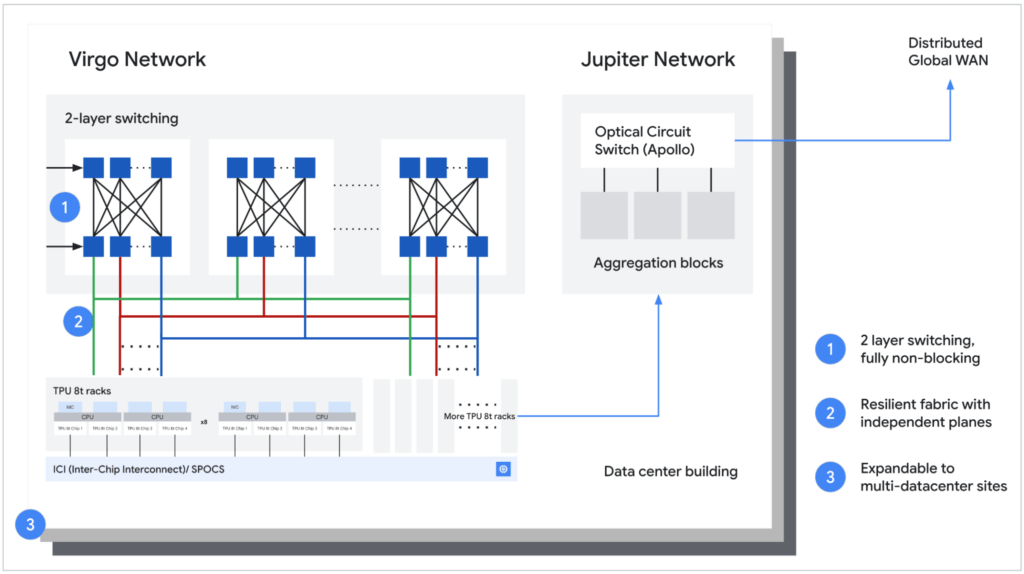

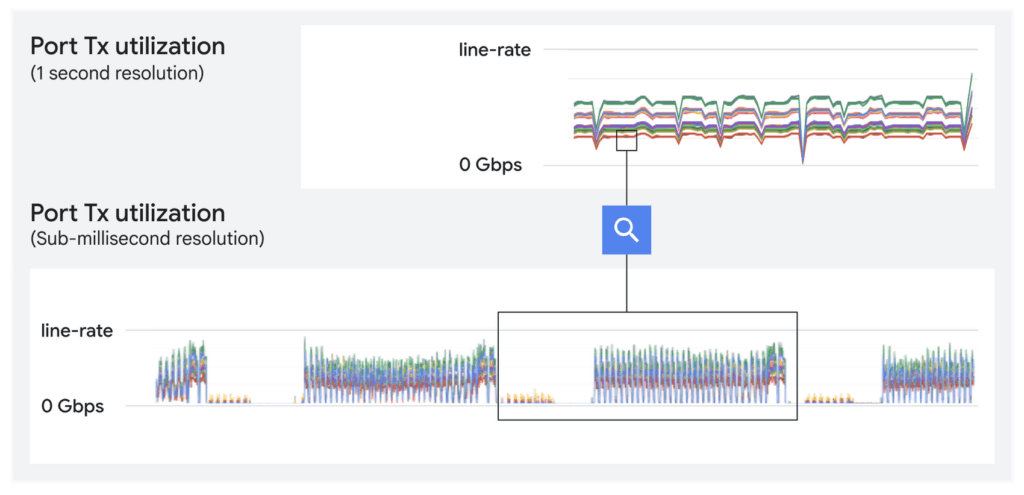

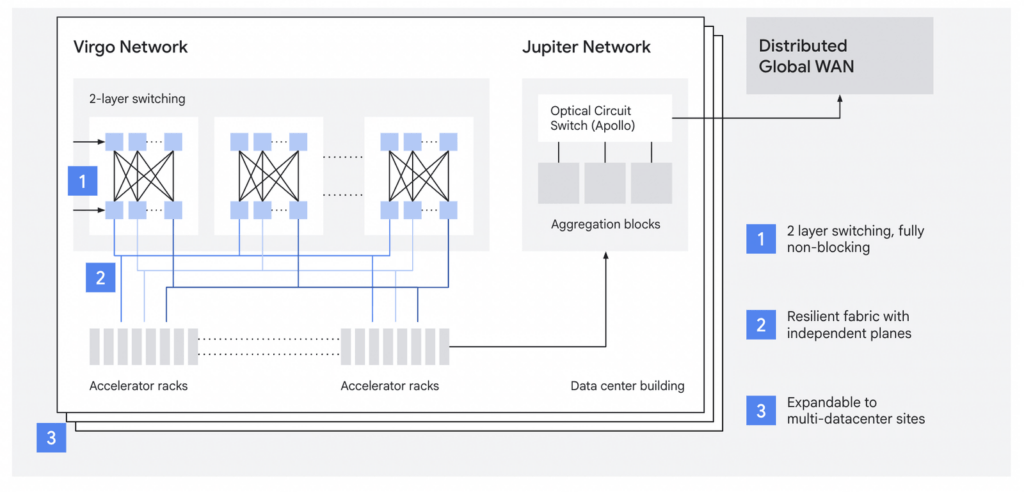

La rete Virgo rappresenta il nuovo fabric scale-out per carichi AI. Il sistema offre fino a 47 petabit al secondo di bandwidth bisectionale e collega fino a 134.000 chip in un singolo dominio. L’architettura non-blocking riduce la latenza del 40 per cento e gestisce traffico sincronizzato senza congestione. Virgo consente il modello “campus-as-a-computer”, permettendo training distribuiti su più data center con prestazioni uniformi.

Collaborazione NVIDIA e Google Cloud per AI fisica e robotica

La partnership tra Google Cloud e NVIDIA integra piattaforme come Rubin, Blackwell e Isaac Sim. Le nuove infrastrutture supportano cluster con decine di migliaia di GPU e permettono simulazioni avanzate per robotica e digital twin. L’integrazione con strumenti come Omniverse e NeMo accelera lo sviluppo di applicazioni AI fisiche e agentiche, aprendo scenari in ambito industriale e scientifico.

AI Hypercomputer unifica TPU, GPU e software avanzato

L’AI Hypercomputer combina TPU, GPU e rete Virgo in una piattaforma unificata. Framework come JAX e PyTorch ottimizzano training e inference su larga scala mentre sistemi di storage ad alta velocità migliorano l’accesso ai dati. L’architettura supporta simulazioni complesse e workload distribuiti, garantendo resilienza e scalabilità per ambienti enterprise.

Efficienza energetica e prestazioni per watt migliorate

Le nuove TPU offrono fino a 2 volte migliore performance per watt rispetto alla generazione precedente. Le GPU NVIDIA Rubin permettono throughput fino a 10 volte superiore per megawatt, riducendo i costi operativi. Il co-design hardware-software migliora l’efficienza energetica e consente di addestrare modelli più grandi con consumi ridotti.

Impatto su industria e adozione AI su larga scala

Le innovazioni presentate da Google Cloud e NVIDIA permettono alle aziende di passare dall’AI sperimentale alla produzione industriale. L’infrastruttura supporta agenti autonomi, simulazioni fisiche e automazione su larga scala. Le imprese possono sviluppare modelli più complessi, ridurre tempi di elaborazione e migliorare il ritorno sugli investimenti grazie a maggiore efficienza e scalabilità.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.