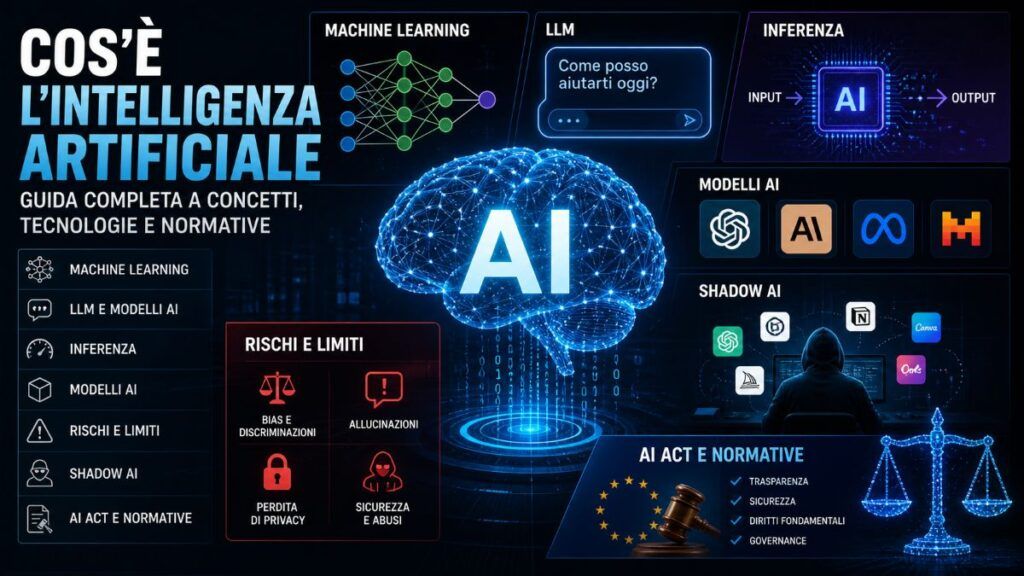

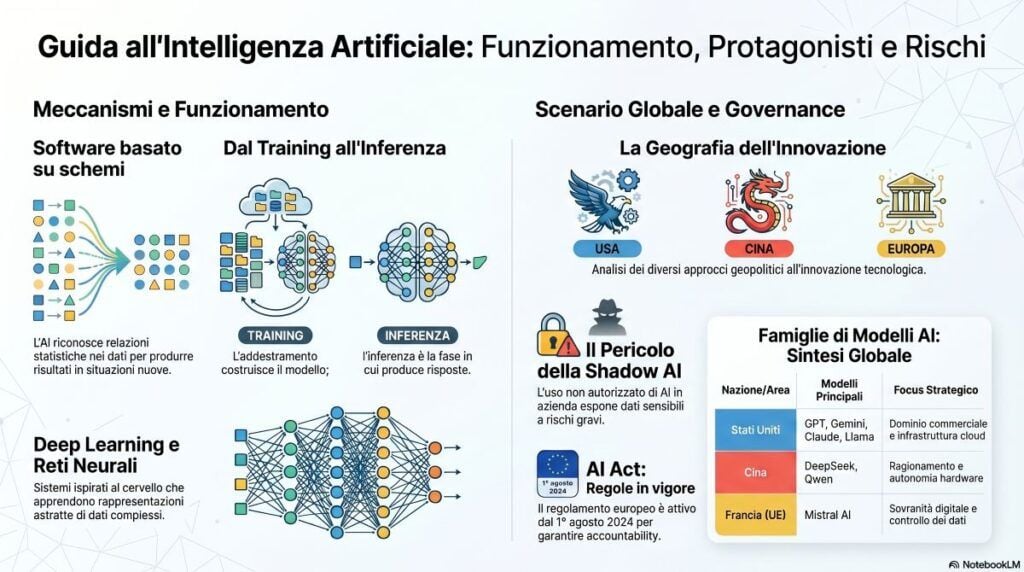

L’intelligenza artificiale, spesso indicata con la sigla AI, è l’insieme di tecnologie che permette a un sistema informatico di svolgere attività che normalmente richiederebbero capacità cognitive umane: comprendere un testo, riconoscere immagini, generare risposte, tradurre lingue, scrivere codice, classificare dati, prevedere comportamenti, prendere decisioni probabilistiche o interagire con l’ambiente fisico attraverso sensori e robot. In parole semplici, l’intelligenza artificiale è un software capace di elaborare dati e produrre risultati non soltanto seguendo istruzioni rigide, ma riconoscendo schemi, apprendendo relazioni statistiche e applicando ciò che ha imparato a situazioni nuove. Questa è la differenza fondamentale rispetto al software tradizionale. Un programma classico esegue regole scritte esplicitamente da uno sviluppatore. Un sistema AI, invece, viene addestrato su grandi quantità di dati e costruisce un modello interno che gli consente di stimare, generare o classificare nuove informazioni. Il cambio di paradigma è enorme. Nel software tradizionale, il programmatore definisce la logica e la macchina la esegue. Nell’intelligenza artificiale moderna, il programmatore definisce architettura, obiettivi, dati e vincoli, mentre il modello apprende da esempi. Non è la macchina a “capire” nel senso umano del termine, ma è la macchina a calcolare correlazioni complesse e a trasformarle in output utili. Questa distinzione è essenziale per evitare due errori opposti. Il primo è sopravvalutare l’AI, immaginandola come una coscienza digitale autonoma. Il secondo è sottovalutarla, riducendola a un semplice algoritmo. L’intelligenza artificiale contemporanea non è magia e non è coscienza, ma è già abbastanza potente da modificare lavoro, ricerca, cybersecurity, informazione, sanità, finanza, scuola, industria, robotica e pubblica amministrazione.

L’intelligenza artificiale è diventata una tecnologia ombrello perché comprende sistemi molto diversi tra loro. Un filtro antispam, un sistema di raccomandazione, un assistente conversazionale, un modello linguistico, un algoritmo di visione artificiale, un software di guida autonoma e un robot industriale intelligente appartengono tutti allo stesso grande campo, ma non funzionano nello stesso modo e non hanno lo stesso livello di autonomia.

Cosa leggere

Sotto il cofano: come pensa l’algoritmo

Dire che un algoritmo “pensa” è una semplificazione utile ma imprecisa. Un modello AI non pensa come un essere umano, non possiede intenzioni proprie e non comprende il mondo con esperienza diretta. Quello che fa è trasformare input in output attraverso parametri appresi durante l’addestramento. Più il modello è complesso, più questa trasformazione diventa difficile da interpretare anche per chi lo ha progettato. Il funzionamento dell’AI moderna dipende da tre elementi: dati, architettura e calcolo. I dati forniscono esempi. L’architettura definisce come il sistema elabora quegli esempi. Il calcolo permette di ottimizzare milioni, miliardi o trilioni di parametri. Quando questi tre elementi crescono insieme, nascono modelli capaci di generare testi, immagini, video, codice, audio, previsioni e decisioni sempre più sofisticate.

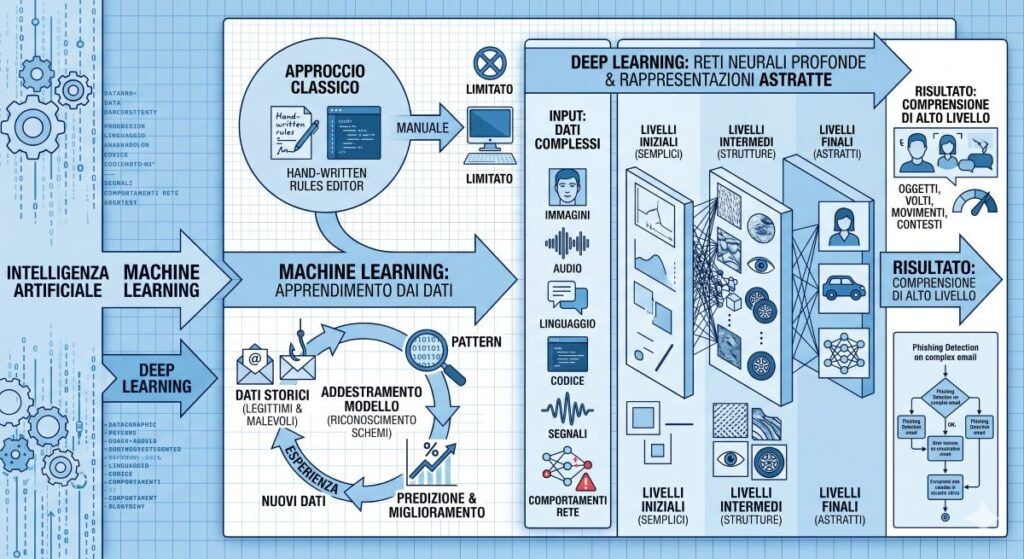

Machine learning e deep learning

Il machine learning è il ramo dell’intelligenza artificiale che permette a un sistema di migliorare le proprie prestazioni attraverso l’esperienza, cioè attraverso i dati. Invece di scrivere manualmente tutte le regole, si addestra un modello affinché impari a riconoscere schemi. Un esempio classico è il riconoscimento delle email di phishing: invece di programmare ogni possibile truffa, il sistema analizza grandi quantità di messaggi legittimi e malevoli, imparando a distinguere pattern ricorrenti. Il deep learning è una sottofamiglia del machine learning basata su reti neurali profonde, cioè architetture composte da molti livelli di elaborazione. Questi sistemi sono particolarmente efficaci quando devono trattare dati complessi come immagini, audio, linguaggio naturale, codice sorgente, segnali biologici o comportamenti anomali in una rete informatica. Il machine learning apprende dai dati. Il deep learning apprende rappresentazioni sempre più astratte dei dati. Nei primi livelli di una rete neurale visiva, per esempio, il sistema può riconoscere bordi e forme semplici. Nei livelli successivi può riconoscere strutture più complesse, fino ad arrivare a oggetti, volti, movimenti o contesti.

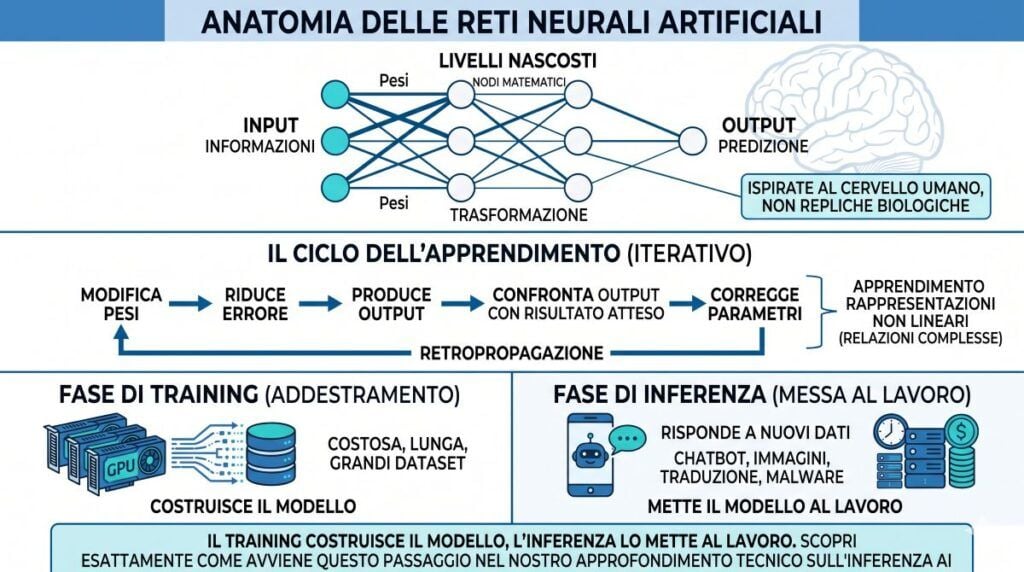

Reti neurali

Le reti neurali artificiali sono ispirate in modo molto semplificato al funzionamento del cervello umano. Non replicano davvero le sinapsi biologiche, ma usano nodi matematici collegati tra loro per trasformare informazioni. Ogni connessione ha un peso, e durante l’addestramento questi pesi vengono modificati per ridurre l’errore del modello. Il processo è iterativo. Il modello riceve un input, produce un output, confronta l’output con il risultato atteso e corregge i propri parametri. Questa procedura, ripetuta su grandi quantità di dati, permette alla rete di migliorare. La potenza delle reti neurali sta nella capacità di apprendere rappresentazioni non lineari, cioè relazioni troppo complesse per essere codificate facilmente con regole tradizionali. Nei modelli linguistici moderni, le reti neurali non si limitano a completare frasi. Imparano distribuzioni statistiche del linguaggio, relazioni semantiche, strutture sintattiche, stili di scrittura, pattern di ragionamento e associazioni tra concetti. Questo non equivale a coscienza, ma produce output che possono sembrare ragionati, creativi e contestuali.

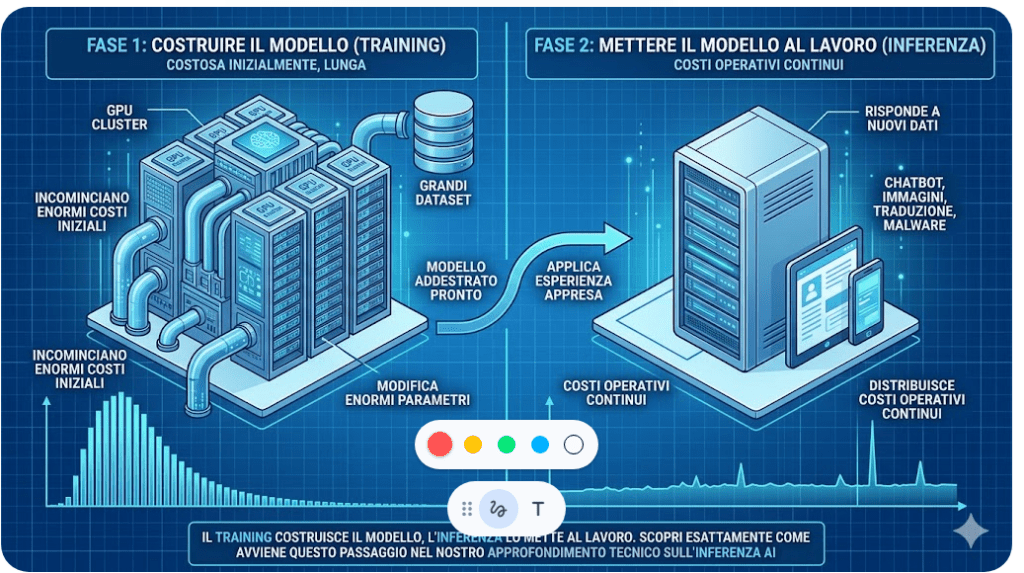

Il ciclo di vita: dal training all’inferenza

Il ciclo di vita di un modello AI comprende due fasi fondamentali: training e inferenza. Il training è la fase di addestramento. È costosa, lunga e richiede grandi dataset, infrastrutture GPU o acceleratori AI, energia, competenze specialistiche e processi di valutazione continui. Durante il training, il modello modifica i propri parametri per imparare a svolgere un compito. L’inferenza è la fase in cui il modello già addestrato viene usato per produrre risposte su nuovi dati. Quando un utente scrive una domanda a un chatbot, quando un sistema genera un’immagine, quando un software classifica un file come malware o quando un’app traduce un testo, sta avvenendo inferenza. Il training costruisce il modello, l’inferenza lo mette al lavoro. Questa distinzione è cruciale anche dal punto di vista economico. Il training concentra enormi costi iniziali. L’inferenza distribuisce costi continui, perché ogni richiesta dell’utente consuma calcolo, memoria, energia e infrastruttura. Una volta addestrato, il modello applica ciò che ha imparato per generare risposte sui nuovi dati. Scopri esattamente come avviene questo passaggio nel nostro approfondimento tecnico sull’inferenza AI.

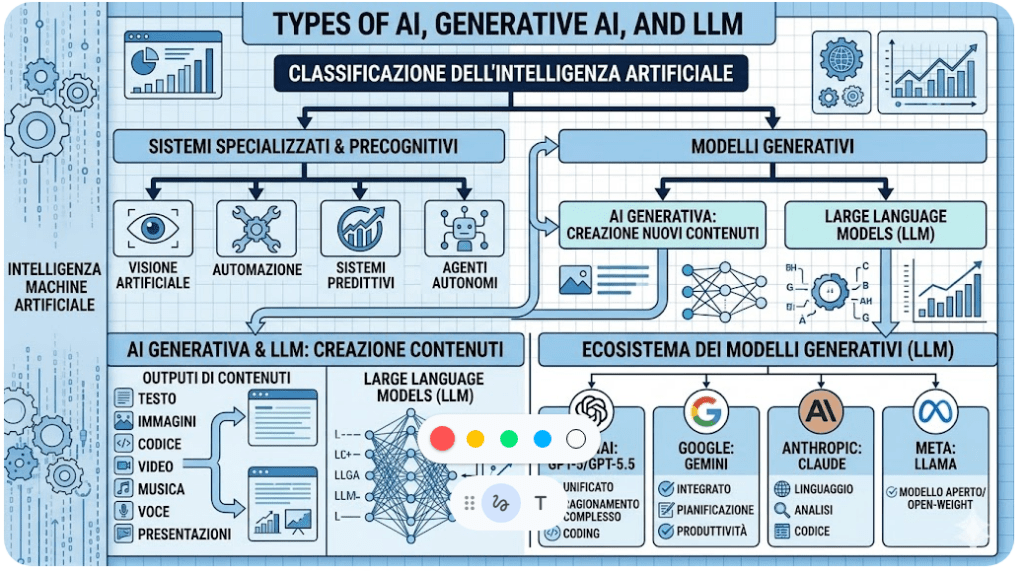

Le tipologie di intelligenza artificiale

L’intelligenza artificiale non è una tecnologia unica. Esistono sistemi specializzati, modelli generativi, assistenti conversazionali, sistemi predittivi, agenti autonomi, software di visione artificiale e strumenti di automazione. Capire le diverse tipologie permette di distinguere l’AI reale dal marketing e di valutare meglio opportunità e rischi.

AI generativa e LLM

L’AI generativa è la famiglia di modelli capace di creare nuovi contenuti: testi, immagini, codice, video, musica, voci sintetiche, presentazioni, documenti e simulazioni. I large language model, o LLM, sono modelli linguistici di grandi dimensioni addestrati per comprendere e generare linguaggio naturale. ChatGPT, Gemini, Claude, Copilot, Llama, Mistral, DeepSeek, Qwen e Grok appartengono, con differenze rilevanti, all’ecosistema dei modelli generativi e conversazionali. OpenAI presenta GPT-5 come un sistema unificato capace di rispondere rapidamente o ragionare più a lungo, con applicazioni in programmazione, matematica, scrittura, salute e percezione visiva; la documentazione OpenAI più recente indica inoltre GPT-5.5 come modello frontier per ragionamento complesso e coding professionale. (OpenAI) Google propone Gemini come assistente AI integrato con l’ecosistema Google e con capacità generative applicate a scrittura, pianificazione, analisi e produttività, mentre Microsoft presenta Copilot come companion AI per informare, assistere e rispondere alle richieste dell’utente. (Gemini) Anthropic definisce Claude una famiglia di modelli linguistici sviluppati per attività di linguaggio, ragionamento, analisi e codice, mentre Meta sviluppa la famiglia Llama come modello aperto o open-weight per ricerca, sviluppo e applicazioni. (Claude API Docs)

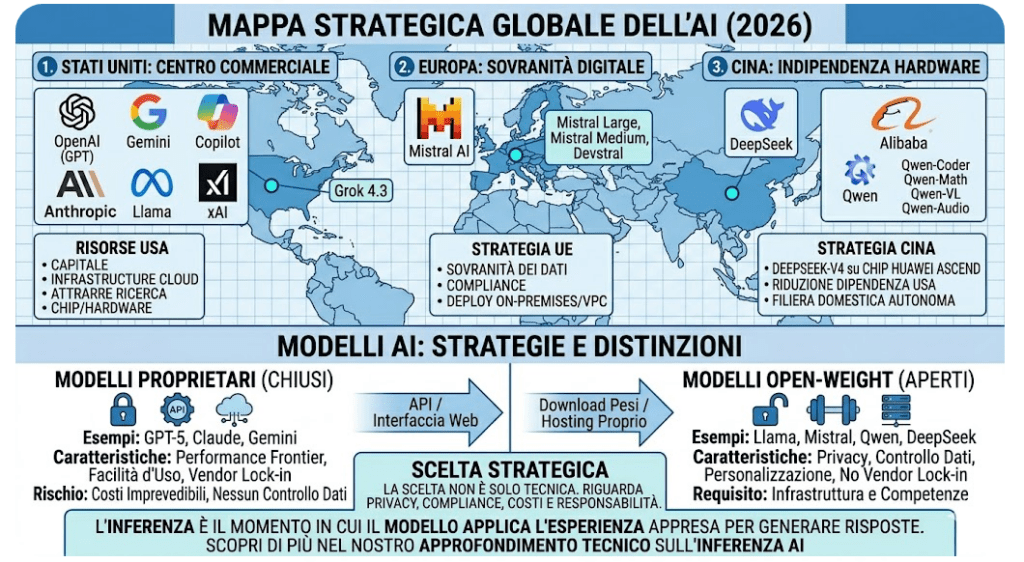

Modelli AI per nazione di origine

La geografia dell’intelligenza artificiale è diventata una questione industriale e geopolitica. I modelli non sono solo prodotti software: rappresentano ecosistemi di ricerca, cloud, chip, dati, capitale, talenti, normative e strategie nazionali. Quando si analizzano i principali modelli AI, conviene quindi distinguere anche la loro origine tecnologica.

Stati Uniti: OpenAI, Google, Microsoft, Anthropic, Meta e xAI

Gli Stati Uniti restano il centro più forte dell’AI generativa commerciale. OpenAI sviluppa la famiglia GPT e ChatGPT. Google sviluppa Gemini. Microsoft integra Copilot nei propri servizi e sistemi, sfruttando una strategia enterprise e cloud-first. Anthropic sviluppa Claude, con particolare attenzione a sicurezza, ragionamento e usi professionali. Meta sviluppa Llama, modello centrale per l’ecosistema open-weight. xAI sviluppa Grok, integrato nell’ecosistema X e nelle API xAI. La documentazione xAI indica Grok 4.3 come modello principale per chat e coding, accanto a modelli dedicati ad audio, immagini, video e voce. (docs.x.ai) Questa concentrazione americana deriva da tre fattori: accesso al capitale, infrastruttura cloud e capacità di attrarre ricerca globale. Il vantaggio statunitense non riguarda solo i modelli, ma l’intera filiera: chip, data center, piattaforme developer, API, distribuzione enterprise e integrazione nei prodotti consumer.

Francia ed Europa: Mistral AI

In Europa, il caso più rilevante è Mistral AI, startup francese fondata nel 2023 e diventata uno degli attori principali del continente. Mistral sviluppa modelli open-weight e commerciali, con una strategia orientata a controllo dei dati, deploy in ambienti propri, VPC, edge e on-premises. La documentazione ufficiale indica modelli come Mistral Large, Mistral Medium, Devstral e famiglie orientate a multimodalità, agenti e coding. (mistral.ai) Il ruolo di Mistral è strategico perché rappresenta una risposta europea alla dipendenza da modelli e cloud statunitensi. L’AI europea non è soltanto una questione di performance, ma di sovranità digitale, compliance, controllo dei dati e capacità di deploy in infrastrutture governabili dalle imprese e dalle amministrazioni del continente.

Cina: DeepSeek e Qwen

La Cina ha accelerato in modo significativo con modelli come DeepSeek e Qwen. DeepSeek ha guadagnato attenzione internazionale con modelli orientati al reasoning e alla disponibilità open-source, mentre Qwen, sviluppato dall’ecosistema Alibaba, include modelli linguistici, modelli per codice, matematica, visione e audio. Il progetto Qwen descrive la propria linea come una famiglia di modelli generalisti, linguistici e multimodali, con componenti come Qwen, Qwen-Coder, Qwen-Math, Qwen-VL e Qwen-Audio. (GitHub) Nel 2026 DeepSeek ha anche assunto una dimensione geopolitica più evidente, con il lancio di DeepSeek-V4 adattato a chip Huawei Ascend secondo Reuters, segno del tentativo cinese di ridurre la dipendenza dall’hardware AI statunitense e costruire un ecosistema domestico più autonomo. (Reuters) Il punto cinese è duplice: competere sul piano dei modelli e costruire una filiera più autonoma sul piano hardware e cloud. Le restrizioni statunitensi sui chip avanzati hanno reso questa strategia ancora più centrale.

Modelli aperti, proprietari e ibridi

La distinzione geografica si intreccia con un’altra distinzione fondamentale: modelli proprietari, modelli open-weight e modelli realmente open-source. I modelli proprietari vengono distribuiti come servizio, attraverso interfacce web o API. I modelli open-weight rendono disponibili i pesi, ma non sempre dati, training completo e licenze sono aperti nel senso classico. I modelli open-source più completi offrono maggiore trasparenza, ma richiedono competenze e infrastrutture per essere eseguiti, adattati e messi in sicurezza. La scelta tra modello chiuso e modello aperto non è solo tecnica. Riguarda privacy, costi, compliance, vendor lock-in, possibilità di audit, personalizzazione, sovranità dei dati e responsabilità in caso di output errati o dannosi.

Narrow AI vs general AI

La maggior parte dei sistemi oggi disponibili è narrow AI, cioè intelligenza artificiale ristretta. Questo significa che il modello è potente in compiti specifici o in una gamma ampia ma delimitata di attività, senza possedere una vera intelligenza generale autonoma. Un LLM può scrivere codice, riassumere testi e rispondere a domande, ma non ha coscienza, volontà o comprensione esperienziale del mondo. L’AGI, o artificial general intelligence, indica invece una futura intelligenza artificiale generale capace di svolgere un’ampia varietà di compiti cognitivi con flessibilità comparabile o superiore a quella umana. Oggi l’AGI resta un obiettivo di ricerca e un tema di dibattito, non una tecnologia disponibile in modo verificabile e condiviso. La differenza è essenziale: l’AI che usiamo oggi è impressionante, ma non è una mente generale. È un insieme di modelli statistici, sistemi multimodali e strumenti agentici che possono simulare competenze molto avanzate, ma restano vincolati a dati, architetture, limiti computazionali, errori, allucinazioni e bias.

L’AI nel mondo reale: campi di applicazione

L’intelligenza artificiale è ormai integrata in settori molto diversi. Non esiste quasi più un’area tecnologica che non venga toccata da modelli predittivi, generativi o decisionali. La domanda non è più se l’AI verrà adottata, ma come verrà integrata, con quali controlli e con quali conseguenze sul lavoro, sulla sicurezza e sui diritti.

AI e cybersecurity

La cybersecurity è uno dei settori in cui l’AI produce il doppio effetto più evidente. Da un lato, l’intelligenza artificiale aiuta a difendere reti e sistemi. Può analizzare grandi quantità di log, riconoscere anomalie, classificare malware, correlare eventi, supportare SOC, individuare phishing, automatizzare risposta agli incidenti e migliorare la threat intelligence. In un ambiente dove gli attacchi sono sempre più rapidi, l’AI può ridurre il tempo tra rilevamento e risposta. Dall’altro lato, la stessa tecnologia viene usata dagli attaccanti. Modelli generativi possono creare email di phishing più credibili, script malevoli, varianti di malware, deepfake vocali, pagine fraudolente, bot conversazionali e campagne social engineering più personalizzate. Il rapporto IOCTA 2026 di Europol sottolinea come AI, proxy, crittografia e automazione stiano espandendo il cybercrime, abbassando la barriera di ingresso e aumentando velocità e scala delle operazioni criminali. Il punto decisivo è che l’AI non è intrinsecamente difensiva o offensiva. È una tecnologia dual-use. La stessa capacità di generare codice può aiutare un analista a scrivere una regola di detection o un attaccante a costruire un payload. La stessa capacità di analizzare testi può aiutare un’azienda a filtrare phishing o un criminale a scrivere messaggi più convincenti.

AI mobile

L’AI mobile porta l’intelligenza artificiale direttamente negli smartphone, nei sistemi operativi e nei dispositivi personali. Assistenti vocali, sintesi dei messaggi, traduzioni in tempo reale, generazione di immagini, ricerca contestuale, editing fotografico, trascrizione, suggerimenti predittivi e automazioni personali diventano funzioni native. Il punto tecnico più importante è lo spostamento tra cloud AI e on-device AI. Alcune funzioni richiedono data center potenti e vengono eseguite da remoto. Altre possono essere elaborate direttamente sul dispositivo grazie a chip dedicati, NPU e modelli più piccoli. L’AI on-device promette più privacy e minore latenza, ma non elimina il problema della raccolta dati quando le funzioni dipendono comunque da servizi cloud. Apple, Samsung, Google e Microsoft stanno spingendo verso ecosistemi in cui l’AI diventa parte dell’interfaccia quotidiana. Questo cambia il rapporto tra utente e dispositivo: il telefono non è più soltanto uno strumento di input, ma un intermediario che interpreta, suggerisce, riassume e anticipa.

AI e robotica

Nella robotica, l’AI collega mondo digitale e mondo fisico. I robot intelligenti usano visione artificiale, modelli di controllo, sensori, reinforcement learning, pianificazione e inferenza per muoversi, manipolare oggetti, interagire con persone o operare in ambienti complessi. La robotica AI può essere industriale, domestica, medica, militare, logistica, agricola o di ricerca. Il punto cruciale è che un errore AI nel mondo fisico può produrre conseguenze materiali, non solo output sbagliati su uno schermo. Un modello che interpreta male un’immagine può generare un falso positivo. Un robot che interpreta male un comando può danneggiare un oggetto, bloccare una linea produttiva o creare un rischio per la sicurezza. Per questo i sistemi robotici richiedono controlli più severi: validazione, simulazione, limiti fisici, supervisione umana, logging, fail-safe, segmentazione di rete e protezione degli endpoint di controllo. L’AI nella robotica non deve essere valutata solo per ciò che sa fare, ma anche per ciò che può fare quando sbaglia.

AI nella sanità

In sanità, l’AI viene usata per supportare diagnosi, triage, analisi di immagini mediche, scoperta di farmaci, gestione amministrativa, personalizzazione delle cure e monitoraggio dei pazienti. Il valore potenziale è enorme, ma i rischi sono altrettanto elevati. Un sistema AI in ambito sanitario deve essere valutato con criteri di accuratezza, sicurezza, spiegabilità, privacy e responsabilità clinica. L’AI può aiutare un medico, ma non può diventare una scatola nera non verificabile. I dati sanitari sono sensibili, i bias possono colpire gruppi vulnerabili e gli errori possono avere impatti diretti sulla salute. Per questo la sanità è uno dei campi in cui l’AI richiede maggiore prudenza regolatoria.

AI nella finanza

In finanza, l’AI viene usata per antifrode, scoring, trading, compliance, customer care, analisi documentale, gestione del rischio e prevenzione del riciclaggio. Anche qui il potenziale è alto, ma il rischio riguarda discriminazione, opacità decisionale, manipolazione dei mercati e affidamento eccessivo a modelli non spiegabili. Un sistema di scoring o antifrode può bloccare transazioni legittime, discriminare utenti o amplificare bias già presenti nei dati storici. La finanza AI deve quindi combinare performance e governance, soprattutto quando le decisioni incidono su accesso al credito, pagamenti, investimenti o sicurezza dei clienti.

Shadow AI: l’intelligenza artificiale usata fuori controllo

La shadow AI è l’uso non autorizzato, non governato o non monitorato di strumenti di intelligenza artificiale dentro un’organizzazione. È l’equivalente moderno della shadow IT, ma con rischi più profondi. Un dipendente che copia documenti riservati in un chatbot pubblico, un team marketing che usa strumenti generativi senza contratto, uno sviluppatore che invia codice proprietario a un assistente AI esterno o un reparto che automatizza decisioni senza supervisione sta creando shadow AI. Il problema non è l’uso dell’AI in sé. Il problema è l’assenza di controllo. Quando l’azienda non sa quali strumenti AI vengono usati, non può governare dati, sicurezza, compliance, proprietà intellettuale, retention, accessi, output e responsabilità.

La shadow AI può esporre informazioni sensibili, violare policy interne, creare dipendenza da servizi non approvati, generare output non verificati, introdurre bias nei processi decisionali e aprire canali di fuga dati. In un contesto regolato, può anche creare problemi di conformità rispetto a GDPR, AI Act, NIS2, DORA o norme settoriali. La risposta non deve essere il divieto totale. Un divieto assoluto spesso spinge gli utenti verso usi ancora più nascosti. La strategia più efficace è costruire una governance chiara: strumenti approvati, policy di utilizzo, classificazione dei dati, formazione, logging, contratti enterprise, controllo degli accessi, revisione degli output e valutazione dei casi d’uso. La shadow AI si combatte rendendo l’AI ufficiale più sicura, più semplice e più utile di quella usata di nascosto.

Sfide, etica e sicurezza

L’intelligenza artificiale porta benefici enormi, ma introduce rischi che non possono essere ignorati. La questione non è bloccare l’innovazione, ma evitare che sistemi opachi, potenti e scalabili vengano distribuiti senza responsabilità.

Deepfake e disinformazione

I deepfake permettono di generare o manipolare volti, voci, immagini e video in modo sempre più realistico. Possono essere usati per satira, cinema, accessibilità e creatività, ma anche per truffe, ricatti, manipolazione politica, frodi finanziarie e disinformazione. Il rischio cresce quando il contenuto sintetico diventa indistinguibile per l’utente medio e circola in tempo reale su piattaforme social. La disinformazione AI non richiede più grandi strutture editoriali false. Può essere generata in modo automatico, localizzata per lingua, adattata a segmenti specifici di pubblico e distribuita attraverso bot, account coordinati, advertising e canali cifrati. La scalabilità è il vero salto di qualità.

Privacy e dati personali

L’AI ha fame di dati. Addestramento, fine-tuning, personalizzazione, prompt, log, feedback e integrazioni applicative possono coinvolgere dati personali, documenti aziendali, immagini, voci, preferenze e comportamenti. Il rischio non riguarda solo cosa il modello sa, ma anche cosa l’utente gli consegna durante l’uso quotidiano. Le aziende devono stabilire regole precise: quali dati possono essere inseriti nei sistemi AI, quali strumenti sono approvati, dove vengono trattati i dati, se i prompt vengono conservati, se gli output possono essere usati in produzione e chi è responsabile della verifica finale.

Bias algoritmici

I bias algoritmici nascono quando dati, obiettivi o architetture producono risultati discriminatori o distorti. Se un modello viene addestrato su dati storici che riflettono disuguaglianze, può riprodurle o amplificarle. Questo è particolarmente grave in ambiti come credito, lavoro, sanità, giustizia, istruzione e sicurezza. Un sistema AI può sembrare neutrale perché matematico, ma la matematica non elimina automaticamente i pregiudizi incorporati nei dati. Per questo servono audit, test su gruppi diversi, metriche di fairness, spiegabilità, supervisione umana e meccanismi di contestazione.

Regolamentazione e AI Act europeo

L’AI Act europeo è il primo grande quadro normativo organico sull’intelligenza artificiale. La Commissione europea indica che il regolamento è entrato in vigore il 1 agosto 2024 e sarà pienamente applicabile dal 2 agosto 2026, con alcune eccezioni: i divieti e gli obblighi di alfabetizzazione AI sono applicabili dal 2 febbraio 2025, mentre le regole di governance e gli obblighi per i modelli di AI generale sono applicabili dal 2 agosto 2025. L’AI Act adotta un approccio basato sul rischio. Alcune pratiche sono vietate, altre sono considerate ad alto rischio e richiedono obblighi specifici, mentre applicazioni a rischio limitato o minimo hanno requisiti più leggeri. Il Consiglio dell’Unione europea descrive la norma come un quadro per sviluppare e usare sistemi AI in modo responsabile, affrontando rischi come bias, discriminazione e mancanza di accountability. La regolamentazione non elimina il rischio AI, ma impone responsabilità, documentazione e controlli. Per imprese e pubbliche amministrazioni, significa che l’adozione dell’intelligenza artificiale deve diventare un processo governato, non una sperimentazione continua senza tracciabilità.

Come scegliere un modello AI

Scegliere un modello AI non significa scegliere “il più potente” in assoluto. Significa scegliere il modello più adatto al caso d’uso. Un’azienda che deve riassumere documenti interni ha esigenze diverse da un team che deve generare codice, da una redazione che deve supportare l’editing, da una banca che deve rispettare vincoli di compliance o da una PA che deve controllare sovranità e trattamento dei dati. I criteri principali sono qualità dell’output, costo, latenza, privacy, localizzazione dei dati, possibilità di deploy on-premises, capacità multimodali, strumenti di sicurezza, supporto enterprise, trasparenza, licenza e integrazione con workflow esistenti. Il miglior modello è quello che produce risultati affidabili dentro vincoli di sicurezza, costo e governance sostenibili. Per contenuti sensibili, modelli eseguiti in ambienti controllati o con contratti enterprise possono essere preferibili a strumenti consumer. Per prototipi, ricerca e personalizzazione, modelli open-weight possono offrire maggiore flessibilità. Per produttività generalista, assistenti cloud integrati possono essere più semplici da adottare. La scelta deve sempre partire dal rischio del dato e dal valore del processo.

L’intelligenza artificiale come infrastruttura del presente

L’intelligenza artificiale non è più un settore separato dell’informatica. È diventata un’infrastruttura trasversale. Entra nei motori di ricerca, negli smartphone, nei sistemi operativi, nella cybersecurity, nella sanità, nella finanza, nella robotica, nell’industria, nella scuola, nel giornalismo, nella pubblica amministrazione e nei processi aziendali. Il suo valore dipende dalla capacità di usarla con metodo. Un modello AI può aumentare produttività, creatività e sicurezza, ma può anche produrre errori, bias, fuga dati e dipendenze tecnologiche. La differenza la fa la governance. Chi comprende training, inferenza, modelli, rischi, shadow AI e regolamentazione può usare l’intelligenza artificiale come leva strategica. Chi la adotta senza controllo rischia di trasformarla in una nuova superficie di attacco. L’AI non è una moda passeggera e non è una soluzione universale. È una tecnologia generale, destinata a ridefinire il modo in cui persone, imprese e istituzioni producono conoscenza, prendono decisioni e interagiscono con il mondo digitale. Comprenderla oggi significa capire una parte decisiva dell’economia, della sicurezza e della società dei prossimi anni.

FAQ – Domande frequenti

L’AI sostituirà il lavoro umano?

L’AI sostituirà alcune attività, trasformerà molte professioni e creerà nuovi ruoli. È improbabile che sostituisca in blocco il lavoro umano, ma è molto probabile che cambi il modo in cui si lavora. Le mansioni ripetitive, documentali, analitiche o di primo livello saranno più automatizzabili. Le competenze di supervisione, giudizio, creatività, responsabilità, relazione e verifica diventeranno ancora più importanti.

L’intelligenza artificiale può essere pericolosa?

Sì, può esserlo se viene usata senza controlli o in contesti critici senza validazione. I rischi principali riguardano errori, bias, disinformazione, deepfake, cybercrime, sorveglianza, perdita di privacy, automazione opaca e uso improprio in ambiti sensibili. Il pericolo non deriva solo dal modello, ma dal modo in cui viene integrato nei processi decisionali e operativi.

Qual è la differenza tra un semplice algoritmo e un’AI?

Un algoritmo tradizionale segue istruzioni definite in modo esplicito. Un sistema AI, invece, apprende pattern dai dati e li usa per produrre output su nuovi input. Non tutti gli algoritmi sono AI. Un ordinamento alfabetico è un algoritmo, ma non è intelligenza artificiale. Un modello che classifica immagini, genera testo o rileva anomalie dopo addestramento è un sistema AI.

Che cos’è un LLM?

Un LLM è un grande modello linguistico addestrato su enormi quantità di testo e altri dati per comprendere e generare linguaggio naturale. Può scrivere, riassumere, tradurre, spiegare, programmare e rispondere a domande. Non possiede coscienza, ma produce output probabilistici basati su ciò che ha appreso durante l’addestramento.

Che differenza c’è tra training e inferenza?

Il training è la fase in cui il modello viene addestrato sui dati e modifica i propri parametri. L’inferenza è la fase in cui il modello già addestrato viene usato per generare una risposta, classificare un input o prendere una decisione. Il training costruisce il modello; l’inferenza lo usa.

Che cos’è la shadow AI?

La shadow AI è l’uso di strumenti AI non autorizzati o non governati dentro un’organizzazione. Può esporre dati sensibili, creare problemi di compliance, introdurre output non verificati e rendere invisibili i flussi informativi. Le aziende devono gestirla con policy, strumenti approvati, formazione e controlli, non soltanto con divieti.

L’AI Act vieta l’intelligenza artificiale?

No. L’AI Act non vieta l’intelligenza artificiale in generale. Regola i sistemi in base al rischio, vieta alcune pratiche considerate inaccettabili e impone obblighi più severi per applicazioni ad alto rischio. L’obiettivo dichiarato è promuovere un uso responsabile dell’AI, tutelando diritti, sicurezza e innovazione.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.