Il problema dell’editoria italiana è diventato improvvisamente un problema nazionale quando AGCOM ha preso in mano il fascicolo Google AI Overviews e ha deciso di trasmettere alla Commissione europea una richiesta di valutazione sui servizi di intelligenza artificiale del motore di ricerca. Ma la verità politica e industriale è più scomoda: quelli che oggi si presentano come esperti dell’informazione sono arrivati nel punto in cui Matrice Digitale era partita anni fa, quando la dipendenza dell’editoria dagli algoritmi non era ancora un’emergenza istituzionale, ma era già il cuore del problema. La mossa dell’Autorità per le garanzie nelle comunicazioni non nasce nel vuoto. Arriva dopo la segnalazione della FIEG, riguarda le interfacce AI Overviews e AI Mode di Google Ireland Ltd e chiama in causa gli articoli 27, 34 e 35 del Digital Services Act, cioè trasparenza dei sistemi di raccomandazione, mitigazione dei rischi sistemici, libertà di informazione e pluralismo dei media. La decisione è stata assunta nella seduta del 29 aprile 2026 ed è stata comunicata il 30 aprile 2026, con un elemento politicamente rilevante: il voto contrario della commissaria Elisa Giomi. Questa ennesima inchiesta sul tema parte da qui, ma non si ferma al comunicato. Perché il vero nodo non è soltanto stabilire se Google abbia violato o meno il DSA. Il vero nodo è capire perché l’Italia istituzionale, editoriale e giornalistica abbia scoperto così tardi che l’informazione online è diventata ostaggio di interfacce private, ranking opachi, accordi commerciali, dipendenze pubblicitarie e sistemi di distribuzione proprietari.

La domanda non riguarda solo Google. Riguarda il governo, gli editori, gli organismi di garanzia, i grandi gruppi internazionali, le testate digitali cresciute dentro l’ecosistema delle piattaforme e tutti coloro che hanno parlato per anni di libertà d’informazione mentre il cuore industriale del settore veniva consegnato agli algoritmi.

Cosa leggere

La segnalazione che arriva quando il modello è già saltato

La segnalazione di AGCOM alla Commissione europea può essere letta come un atto necessario, ma non come un atto precoce. È una fotografia tardiva di un processo già compiuto. La FIEG ha sostenuto che l’introduzione di AI Overviews in Italia produca effetti pregiudizievoli per utenti, consumatori e imprese editoriali, riducendo la visibilità e la reperibilità dei contenuti giornalistici. In questa prospettiva, il danno non è solo economico: se il contenuto prodotto dalle redazioni viene sintetizzato o sostituito da una risposta generata dall’IA, il lettore non arriva più alla fonte, l’editore perde traffico, l’autore perde riconoscimento e il pluralismo diventa una formula giuridica senza infrastruttura materiale. Il punto decisivo è che questa dinamica non nasce con AI Overviews. L’intelligenza artificiale generativa rende più evidente un meccanismo che esiste da anni: l’editoria digitale italiana ha costruito ricavi, pubblico e reputazione dentro ambienti che non controlla.

Prima c’erano il ranking di Google, i feed di Facebook, le logiche di Discover, i sistemi di raccomandazione di YouTube e le soglie invisibili delle piattaforme pubblicitarie. Oggi ci sono le risposte sintetiche dell’IA. Il salto non è concettuale, ma industriale: l’algoritmo non si limita più a decidere quale fonte mostrare prima, ma può assorbire la funzione stessa della fonte.

È qui che la vicenda diventa politica. Per anni, una parte consistente dell’editoria ha accettato la dipendenza dalle piattaforme perché quella dipendenza produceva traffico. Finché l’algoritmo portava lettori, pagine viste, pubblicità e soprattutto legittimazione, la questione veniva raccontata come modernizzazione. Quando lo stesso ecosistema ha iniziato a comprimere i margini, ridurre i click e sostituire il passaggio verso i siti editoriali con risposte immediate, il problema è diventato improvvisamente democrazia, pluralismo, libertà di informazione.

La libertà di stampa è diventata emergenza quando ha cominciato a coincidere con la perdita del modello di business.

AGCOM, Google e il ruolo del Digital Services Act

Il comunicato di AGCOM formalizza il caso nel linguaggio regolatorio europeo. L’Autorità, nella sua qualità di Coordinatore per i servizi digitali per l’Italia, ha chiesto alla Commissione europea di valutare i servizi AIO (AI Overviews) e AI Mode alla luce del DSA. Dopo aver acquisito informazioni da Google e dopo le audizioni di Google, FIEG e FISC, l’Autorità ha ritenuto di portare la questione a Bruxelles ai sensi dell’articolo 65 del DSA, affinché la Commissione valuti l’eventuale apertura di un’indagine per possibili violazioni degli obblighi applicabili alle piattaforme e ai motori di ricerca di dimensioni molto grandi, cioè i cosiddetti VLOP e VLOSE. È un passaggio importante perché sposta il problema dal piano della lamentela editoriale al piano della responsabilità sistemica.

Google Search non è più soltanto un servizio privato usato dai cittadini, ma un’infrastruttura di accesso alla conoscenza pubblica. Se il motore di ricerca decide quali contenuti mostrare, come mostrarli, quanto traffico trasferire alle fonti e quando sostituire la fonte con una risposta generata dall’intelligenza artificiale, allora il tema non riguarda soltanto il mercato pubblicitario. Riguarda la qualità della cittadinanza informata.

La stessa AGCOM ha deciso di istituire un tavolo permanente tra Google, altre piattaforme ed editori, con l’obiettivo di sviluppare un dialogo su copyright, intelligenza artificiale e tutela del pluralismo. È una scelta che conferma la natura ibrida della crisi: giuridica, economica, tecnologica e politica. Ma è anche il segnale di una rincorsa: il tavolo arriva quando il rapporto di forza è già sbilanciato, quando le piattaforme hanno accumulato dati, interfacce, abitudini d’uso e potere negoziale, mentre molti editori hanno perso capacità industriale, autonomia tecnologica e controllo sulla relazione con il lettore.

Il voto contrario di Elisa Giomi e il nodo dell’Autorità

Nel comunicato AGCOM compare un dettaglio che non può essere trattato come nota a margine: la decisione è stata assunta con il voto contrario della commissaria Elisa Giomi. Il dissenso interno non è di per sé anomalo. In un’Autorità indipendente, il voto contrario fa parte della dialettica istituzionale. Ma, dentro questa vicenda, assume un valore simbolico perché avviene proprio nel momento in cui l’Autorità si presenta come argine regolatorio davanti alla Commissione europea. Il punto non è trasformare un voto contrario in un’accusa personale. Il punto è interrogare la postura complessiva dell’Autorità davanti alle piattaforme. Se l’Italia arriva tardi a discutere di intelligenza artificiale, copyright, pluralismo, equo compenso, motori di ricerca e sistemi di raccomandazione, la responsabilità non può essere scaricata solo su Google. Le istituzioni di garanzia hanno avuto anni per misurare la dipendenza strutturale dell’informazione italiana dai grandi intermediari digitali. Il caso Giomi, in questa cornice, diventa parte di una domanda più ampia:

quanto le autorità pubbliche italiane sono davvero autonome nel definire una linea industriale sull’informazione digitale?

Quanto sono attrezzate per non limitarsi a inseguire le emergenze? Quanto riescono a distinguere il pluralismo come principio costituzionale dal pluralismo come equilibrio tra soggetti economici già forti?

La segnalazione adesso arriva, ma arriva dopo anni in cui la filiera editoriale ha subito il potere delle piattaforme senza una vera strategia nazionale.

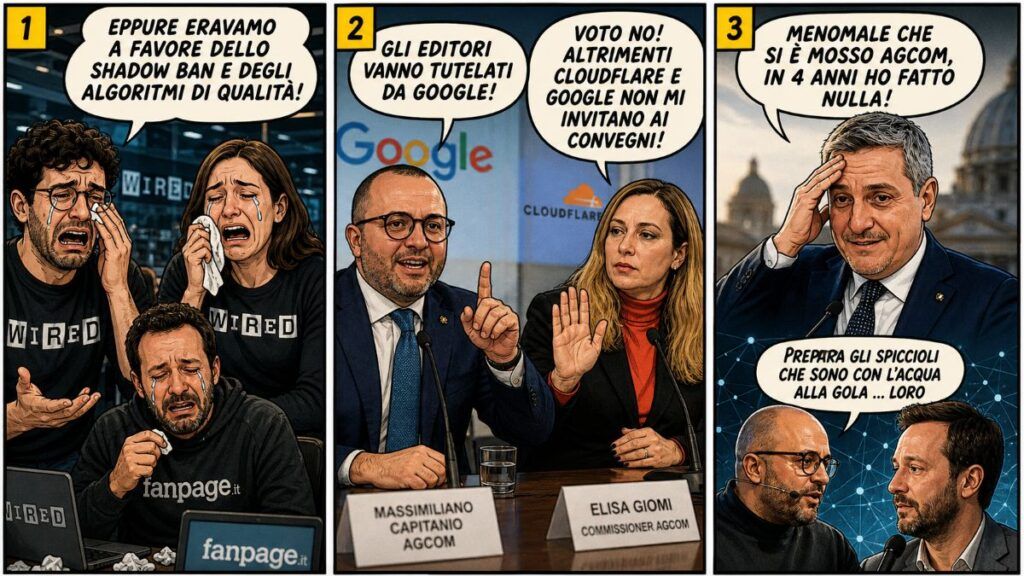

Wired Italia e il giorno dello sciopero dei giornalisti

Il cortocircuito simbolico più potente si è visto con Wired Italia. La chiusura della testata da parte di Condé Nast è stata annunciata proprio nel giorno dello sciopero nazionale dei giornalisti del 16 aprile 2026. Secondo quanto riportato, il CEO Roger Lynch ha motivato la decisione sostenendo che Wired Italia, insieme ad altre testate, non fosse più redditizia e che la gestione nella forma attuale limitasse la capacità del gruppo di investire nelle aree ritenute più promettenti per la crescita futura. La coincidenza temporale ha un valore quasi crudele. Mentre i giornalisti scioperavano per denunciare il contratto scaduto da dieci anni, il lavoro precario, il mancato riconoscimento economico, l’assenza di regole sull’uso dell’intelligenza artificiale e la cessione di valore agli Over the top, una delle testate italiane più riconoscibili nel racconto della tecnologia veniva accompagnata verso l’uscita. Il comunicato sindacale pubblicato da Wired Italia indicava con chiarezza la fragilità del settore: salari erosi dall’inflazione, collaboratori sotto la soglia di povertà, dumping contrattuale, uso del lavoro precario e assenza di una disciplina sull’IA e sul riconoscimento economico dei contenuti ceduti alle piattaforme.

Il caso Wired Italia dimostra che anche una testata favorita dal prestigio del marchio, dalla riconoscibilità internazionale e da un posizionamento culturale forte può diventare sacrificabile quando l’unità locale non risponde più alla logica finanziaria del gruppo. Qui cade una retorica. Non basta essere moderni, digitali, internazionali, tecnologici, innovativi. Se il mercato pubblicitario si concentra altrove, se il traffico viene intermediato da piattaforme esterne, se la relazione con il lettore è fragile e se la redazione diventa una voce di costo dentro una strategia globale, anche il marchio più coerente con l’epoca dell’innovazione può essere chiuso.

La questione non riguarda solo Condé Nast. Riguarda il modo in cui i grandi gruppi internazionali leggono i mercati nazionali. La libertà d’informazione di un Paese non può dipendere dalla convenienza economica di una multinazionale editoriale, così come non può dipendere dalla benevolenza di un motore di ricerca o dalla generosità temporanea di un feed social. Wired Italia non è caduta perché mancavano argomenti da raccontare. È caduta perché l’equilibrio industriale che sosteneva quel racconto non era più considerato redditizio.

Fanpage, Francesco Cancellato e il modello full digital in crisi

Il secondo caso è Fanpage, perché mostra l’altra faccia della stessa medaglia. Francesco Cancellato, direttore di Fanpage, ha dichiarato a Bruxelles che la crisi delle professioni intellettuali e l’avanzata dell’IA producono una situazione di difficoltà per il settore dei media, soprattutto per l’editoria indipendente. Ha aggiunto che Fanpage è una testata full digital e che quel modello di business, anche a causa di Google Overview e di altri fattori, è entrato in crisi, ricordando il problema dei contenuti messi in rete e usati per addestrare l’intelligenza artificiale senza corrispondere nulla alle testate.

La frase di Cancellato ha un peso perché arriva da una testata che per anni ha rappresentato uno dei casi più forti dell’editoria digitale italiana. Fanpage è cresciuta dentro il mondo delle piattaforme, ha saputo usare linguaggi, formati e ritmi compatibili con la distribuzione social e algoritmica, ha costruito pubblico e rilevanza in un ecosistema in cui altri progetti editoriali sono nati e morti e grazie anche ad accordi diretti con Meta e prodotti condivisi con Google. Proprio per questo, la sua difficoltà attuale è politicamente rilevante. Quando anche chi ha beneficiato del modello full digital denuncia la crisi del modello full digital, significa che il problema non è più periferico.

La lettura più comoda sarebbe trasformare Fanpage in vittima improvvisa dell’intelligenza artificiale. Ma questa inchiesta propone una lettura più dura. Fanpage è anche il simbolo di un sistema che ha funzionato finché l’algoritmo era favorevole. Quando l’algoritmo portava visibilità, la piattaforma era ambiente di crescita. Quando l’algoritmo riduce traffico, indicizzazione o reperibilità, la piattaforma diventa minaccia democratica. La contraddizione non cancella il problema, ma lo rende più chiaro:

nessuna testata, nemmeno una redazione forte e strutturata, controlla davvero il proprio destino se la sua sopravvivenza dipende da interfacce che altri modificano senza negoziare con il sistema informativo.

Qui Matrice Digitale può rivendicare una posizione scomoda ma coerente: il problema non nasce quando a essere penalizzati sono i grandi marchi digitali o le testate progressiste. Il problema nasce quando l’accesso alla circolazione dell’informazione viene deciso da soggetti privati che non rispondono al lettore, non rispondono alla Costituzione, non rispondono all’ecosistema nazionale dell’informazione, ma rispondono alla propria architettura economica.

La falsa sorpresa dei paladini tardivi dell’informazione

Il punto più amaro è la falsa sorpresa. Oggi molti si accorgono che Google, Facebook, YouTube, Discover e i sistemi di intelligenza artificiale possono alterare la visibilità delle fonti, comprimere il traffico, selezionare quali contenuti circolano, premiare alcuni linguaggi e penalizzarne altri. Ma questo era evidente da anni. L’editoria italiana ha vissuto in una democrazia algoritmica limitata, dove la libertà formale di pubblicare conviveva con una dipendenza sostanziale dalla distribuzione privata. La censura contemporanea non sempre vieta la parola. Più spesso lascia parlare, ma toglie circolazione. Lascia online, ma riduce reperibilità ed è un paradosso che coloro che negavano l’esistenza dello shadow ban quando colpiva i dissidenti delle proprie linee editoriali, oggi si lamentano di essere tagliati fuori. Lascia pubblicare, ma comprime Discover. Lascia esistere, ma abbassa ranking, visibilità, ricavi e capacità di incidere. È una censura industriale più che giuridica. Ed è proprio per questo più difficile da denunciare: non ha bisogno di un editto, non ha bisogno di una rimozione esplicita, non ha bisogno di un bavaglio formale. Basta cambiare la superficie di accesso. In questa dinamica, l’intelligenza artificiale è soltanto l’ultima interfaccia del potere. AI Overviews non inaugura il dominio della piattaforma sull’editore. Lo perfeziona. Prima Google mostrava risultati e monetizzava l’attenzione indirizzando l’utente verso pagine esterne. Ora può fornire risposte che trattengono l’utente dentro l’ambiente Google. Il lettore ottiene una sintesi. L’editore perde il click. L’autore perde attribuzione effettiva. Il pluralismo perde profondità. Il cittadino perde il percorso che conduce dalla risposta alla fonte.

Barachini, Benanti, Ciulli e la filiera istituzionale dell’IA

Dentro questa crisi si muove una costellazione di nomi che Matrice Digitale ha già messo al centro delle proprie analisi: Alberto Barachini, Paolo Benanti, Diego Ciulli. Figure diverse, ruoli diversi, interessi dichiarati diversi, ma un medesimo perimetro di discussione: l’intelligenza artificiale, l’editoria, la regolazione, il rapporto tra Stato e piattaforme, il controllo dei dati, la sovranità digitale. Alberto Barachini, sottosegretario all’Informazione e all’Editoria, è intervenuto al convegno al Senato “AI Italia. L’intelligenza artificiale tra innovazione e sovranità digitale”, sostenendo che la sovranità digitale è un tema democratico e che ciò che leggiamo e le fonti su cui ci informiamo saranno scelte sempre meno da noi. È una frase che coglie il cuore del problema: chi legge elegge e partecipa, ma se la fonte della lettura viene filtrata da sistemi opachi, la partecipazione democratica si indebolisce prima ancora del voto.

Eppure la questione politica è un’altra.

Se questa consapevolezza arriva oggi, dove sono state le istituzioni negli anni in cui l’editoria italiana si affidava progressivamente alla distribuzione algoritmica?

Quali sono state le attività realmente capaci di proteggere l’intero settore, e non soltanto alcuni segmenti più vicini ai tavoli del potere?

La critica non riguarda la singola dichiarazione di Barachini, ma la distanza tra le parole sulla sovranità digitale e una filiera editoriale che continua a non possedere infrastrutture, dati, modelli di distribuzione e capacità negoziale sufficienti. Paolo Benanti, nel dibattito pubblico italiano, è diventato una delle figure più ricorrenti nei discorsi sull’etica dell’intelligenza artificiale. Ma l’etica dell’algoritmo non può essere ridotta alla domanda se una macchina possa uccidere, discriminare, decidere una cura o alterare un processo amministrativo. Nel caso dell’editoria, l’etica dell’algoritmo riguarda anche il riconoscimento del lavoro cognitivo, la visibilità delle fonti, il diritto del lettore a sapere da dove arriva l’informazione, la sopravvivenza delle redazioni e la possibilità per un editore indipendente di non essere schiacciato dal rapporto tra piattaforma e grande gruppo. Da Microsoft, a Google passando per la Luiss e il Sole 24 Ore, è chiaro dove “l’etesteta” (l’etico esteta per intenderci) da che parte stia.

Diego Ciulli, Head of Government Affairs and Public Policy di Google, ha espresso una posizione netta in un confronto pubblico su AI Mode: nell’epoca dei chatbot e dell’intelligenza artificiale, secondo lui, non si può pensare che gli utenti vogliano scorrere lunghi articoli solo per ottenere un’informazione. Ha sostenuto che AI Mode contiene link e che crea traffico, distinguendolo da un chatbot tradizionale. Questa posizione fotografa la frattura. Per Google, l’utente vuole risposta rapida. Per l’editore, la risposta rapida può essere la fine della sostenibilità. Per la democrazia, il problema è ancora più radicale: se l’informazione diventa una risposta sintetica senza percorso, senza contesto, senza conflitto tra fonti e senza responsabilità editoriale visibile, il cittadino non viene informato, viene servito da un’interfaccia.

Google, università e il problema della formazione come influenza

Il quadro si complica quando Google non si limita a distribuire informazione, ma entra anche nella formazione. Il 15 aprile 2026, Google Italy ha annunciato AI Works for Italy, iniziativa che prevede lo stanziamento di 2 milioni di dollari per formare almeno 13.000 studenti universitari italiani e l’avvio di nuovi corsi dedicati ai lavoratori che vogliono integrare l’IA nella propria attività professionale. Le prime università coinvolte indicate da Google sono Roma Tre, Salerno e Sassari. In sé, la formazione non è uno scandalo. Anzi, l’Italia ha bisogno di competenze sull’intelligenza artificiale. Ma la domanda industriale è inevitabile: chi forma il futuro mercato del lavoro forma anche la cultura tecnica, le dipendenze operative e l’immaginario professionale del Paese. Se una multinazionale che domina la ricerca, la pubblicità digitale, l’accesso ai contenuti, l’ecosistema mobile, le infrastrutture cloud e i modelli di IA entra nelle università con programmi gratuiti o sovvenzionati, il tema non può essere trattato solo come generosità aziendale. La stessa Google presenta l’iniziativa come parte di un impegno per diffondere competenze digitali in Italia. Il programma include percorsi gratuiti per gli atenei partecipanti e corsi per lavoratori, con accesso temporaneo a strumenti avanzati come Google AI Pro e Gemini. Ma proprio questa integrazione tra formazione, strumenti, piattaforme e accesso gratuito iniziale mostra il punto critico: l’ecosistema non si limita a vendere tecnologia, costruisce abitudine. E l’abitudine, nel digitale, è una forma di infrastruttura.

Qui la critica di Matrice Digitale non è contro l’alfabetizzazione tecnologica. È contro l’assenza di una strategia pubblica equivalente. Se lo Stato non costruisce infrastrutture formative, dataset, ambienti open, alternative sovrane, programmi indipendenti e filiere europee credibili, allora la formazione arriva da chi ha già il dominio del mercato. A quel punto la sovranità digitale diventa un convegno, non una politica industriale.

Il governo, Fedez e la distanza dal settore dei giornali

Emerge una provocazione politica: il Governo sembra essersi mostrato più pronto a presidiare alcuni spazi mediatici e simbolici, persino quelli della comunicazione pop e degli influencer, che non a costruire una strategia robusta per il settore dei giornali. È una provocazione che va letta nel suo senso politico, non come semplificazione personale. Il punto è che la comunicazione istituzionale ha spesso inseguito i luoghi della visibilità immediata, mentre il sistema professionale dell’informazione perdeva pezzi, contratti, sostenibilità, autonomia e capacità di competere con le piattaforme. Ogni anno, durante i passaggi pubblici più importanti, le redazioni e i giornalisti si confrontano con un potere politico che conosce il problema, ma lo tratta come una crisi gestibile, non come una frattura strutturale. Nel frattempo, il contratto dei giornalisti resta una ferita, il precariato continua a essere un modello industriale, le redazioni si restringono, le collaborazioni vengono pagate poco, l’IA entra nei processi editoriali senza un quadro condiviso e le piattaforme continuano a catturare il valore della distribuzione.

Per un governo di destra, una lettura cinica potrebbe persino sostenere che la crisi di testate percepite come ostili o progressiste non sia un problema immediato. Ma questa sarebbe una lettura miope. La crisi dell’editoria non colpisce solo l’opposizione mediatica di oggi, colpisce la struttura democratica che domani potrebbe servire anche a chi governa oggi. Quando il pluralismo perde infrastruttura, non perde solo una parte politica. Perde l’intero Paese.

La crisi industriale mascherata da battaglia democratica

La grande ipocrisia del momento sta qui: molti difendono la libera informazione solo quando la crisi tocca il proprio perimetro. Quando gli algoritmi penalizzavano fonti sgradite, linguaggi non allineati, testate piccole, contenuti fuori dal mainstream o progetti editoriali indipendenti, la questione veniva trattata come fisiologia del web. Quando la stessa logica colpisce testate più visibili, gruppi strutturati o marchi riconosciuti, la questione diventa emergenza democratica. Eppure, sul piano sostanziale, non esiste differenza tra una piccola testata penalizzata da un algoritmo e una grande testata colpita dalla stessa architettura di potere. La differenza è solo nella capacità di far rumore. Gli editori maggiori hanno associazioni, tavoli, relazioni istituzionali, interlocuzioni europee. I piccoli editori hanno traffico che scompare, articoli che non si indicizzano, Discover che non arriva, pubblicità che crolla, costi che salgono e nessun canale reale per contestare una decisione opaca.

Per questo la segnalazione AGCOM è importante ma insufficiente. Se l’Europa valuterà AI Overviews e AI Mode solo come problema degli editori rappresentati, senza guardare alla totalità del sistema informativo, il rischio sarà sostituire una dipendenza con una trattativa tra soggetti forti. Il pluralismo non si salva solo garantendo compensazioni agli editori strutturati, ma costruendo condizioni eque di accesso, trasparenza, attribuzione, misurabilità, contestazione e sostenibilità anche per chi non siede nei tavoli che contano.

Il mercato vuole il monopolio, la democrazia vuole il pluralismo

Il mercato digitale tende alla concentrazione. Non per incidente, ma per struttura. Chi controlla il motore di ricerca controlla l’accesso. Chi controlla il feed controlla l’attenzione. Chi controlla l’interfaccia dell’IA controlla la risposta. Chi controlla la pubblicità controlla la monetizzazione. Chi controlla gli strumenti di analytics controlla anche la percezione del successo editoriale. In questo quadro, il pluralismo è antieconomico se non viene protetto da regole, infrastrutture e politiche pubbliche.

La democrazia chiede che esistano molte fonti, molte voci, molti punti di vista, molte filiere informative. Il mercato algoritmico, invece, premia ciò che scala, ciò che trattiene, ciò che converte, ciò che si adatta alla piattaforma. Da questa tensione nasce la crisi dell’editoria italiana. Non dalla mancanza di giornalisti. Non dalla mancanza di storie. Non dalla mancanza di lettori in astratto. Nasce dalla perdita del controllo sulla relazione tra contenuto e pubblico.

Le testate sono state spinte a produrre contenuti brevi, veloci, compatibili con feed, liste, titoli ad alta resa, aggiornamenti continui, formati compressi, testi pensati più per la piattaforma che per il lettore. Molti giovani lettori sono stati educati a consumare informazione come frammento, non come percorso. L’intelligenza artificiale porta questa tendenza al limite estremo: non serve più nemmeno aprire l’articolo, perché l’interfaccia promette di consegnare la risposta già pronta.

Matrice Digitale e gli otto anni di anticipo sulla crisi

La posizione di Matrice Digitale, in questa inchiesta, non è quella di chi scopre oggi il problema. È quella di chi ha osservato per anni la trasformazione dell’informazione in un settore condizionato da ranking, piattaforme, gatekeeper, accordi commerciali, censure algoritmiche, dipendenze tecnologiche e retoriche istituzionali tardive. La crisi non è iniziata con Google AI Overviews. Google AI Overviews è il momento in cui la crisi diventa impossibile da nascondere. Il lavoro svolto negli anni nella sezione inchieste di Matrice Digitale ha seguito proprio questa linea:

mostrare che l’informazione non è minacciata solo dal potere politico tradizionale, ma anche da poteri infrastrutturali privati che decidono chi vede cosa, quando, come e con quale continuità. Il punto non è difendere una nostalgia della carta o un modello editoriale del passato. Il punto è difendere la possibilità che un contenuto giornalistico abbia una relazione riconoscibile con il lettore e che il valore prodotto da una redazione non venga assorbito senza restituzione da chi controlla l’interfaccia.

Questa è anche la ragione per cui la battaglia non può essere lasciata ai soli editori tradizionali. Alcuni di loro hanno beneficiato a lungo di rapporti privilegiati, accordi commerciali, prossimità istituzionali e capacità negoziale. Altri hanno subito la piattaformizzazione senza strumenti. Se la risposta alla crisi sarà solo un patto tra grandi editori e grandi piattaforme, la piccola e media informazione continuerà a morire, anche mentre qualcuno celebrerà il successo del tavolo permanente.

L’informazione come settore strategico e non come favore agli amici

Nessuno si muove davvero per i diritti, ma per interessi particolari. È una formulazione dura, ma intercetta un nodo reale. Quando l’informazione viene difesa solo se coincide con il perimetro degli amici, degli alleati, dei grandi editori o delle testate capaci di pressione, non si difende la libertà di stampa. Si difende una parte del mercato. La libertà di informazione, invece, richiede una difesa generale.

Richiede regole che valgano per Wired Italia e per una piccola testata indipendente. Per Fanpage e per un giornale locale. Per l’editore storico e per il progetto nato fuori dai salotti dell’editoria. Per chi è gradito al governo e per chi lo critica. Per chi riceve traffico da Google e per chi viene oscurato dal silenzio dell’algoritmo. Il pluralismo non è la protezione dei soggetti più rumorosi, ma la garanzia che nessuno venga espulso dall’accesso al pubblico senza trasparenza e senza possibilità di difesa.

Ecco perché la vicenda AGCOM-Google deve essere letta come occasione, ma anche come ritardo. Bene che l’Autorità abbia segnalato la questione alla Commissione europea. Bene che il tema entri nel perimetro del DSA. Bene che si discuta di rischi sistemici, trasparenza e pluralismo. Ma non basta. Bisogna riconoscere che il sistema italiano ha consegnato per anni la propria infrastruttura informativa a soggetti esterni, salvo poi scoprire il problema quando la perdita di valore è diventata troppo evidente per essere nascosta.

La vera domanda alla Commissione europea

La Commissione europea dovrà valutare se i servizi AI di Google violino o meno gli obblighi previsti dal DSA. Ma la domanda politica deve essere più ampia:

può un motore di ricerca diventare anche editore sintetico dell’informazione altrui senza alterare il pluralismo?

Può una piattaforma trattenere l’utente con risposte generate usando contenuti prodotti da redazioni che poi perdono traffico?

Può la trasparenza limitarsi alla presenza di link, se il comportamento dell’utente viene già esaurito dalla risposta?

Può l’equo compenso essere discusso solo tra grandi soggetti, lasciando fuori la filiera indipendente?

La risposta non può essere affidata soltanto alla negoziazione privata. Serve un quadro pubblico. Serve misurabilità del traffico sottratto. Serve attribuzione chiara. Serve diritto di opt-out reale senza penalizzazioni indirette. Serve un sistema di compensazione che non premi solo chi ha forza contrattuale. Serve trasparenza sugli effetti di AI Overviews e AI Mode sulle fonti editoriali. Serve un principio semplice: se l’IA genera valore utilizzando contenuti giornalistici, una parte di quel valore deve tornare alla filiera che li produce. Senza questa impostazione, l’inchiesta AGCOM rischia di diventare l’ennesimo tavolo italiano: parole alte, relazioni eleganti, dichiarazioni sulla sovranità digitale, ma pochi strumenti per impedire che la prossima redazione chiuda, che il prossimo editore indipendente perda traffico, che il prossimo algoritmo riduca al silenzio chi non ha accesso ai corridoi del potere.

Il funerale industriale dell’editoria italiana

La chiusura di Wired Italia, la denuncia di Fanpage, la segnalazione FIEG, il voto contrario in AGCOM, il ruolo di Google, i convegni sulla sovranità digitale, le iniziative di formazione nelle università e la retorica sull’etica dell’intelligenza artificiale fanno parte dello stesso quadro. L’editoria italiana non sta vivendo una crisi episodica, ma un funerale industriale lento, celebrato mentre molti invitati fingono di essere arrivati per tempo.

Il punto non è difendere l’editoria così com’era. Molti giornali hanno responsabilità enormi: contenuti poveri, dipendenza pubblicitaria, conformismo, precarizzazione del lavoro, accordi opachi, incapacità di innovare, uso predatorio dei collaboratori, riduzione della qualità, rincorsa al click, subalternità alle piattaforme. Ma la soluzione non può essere lasciare che Google, Meta, YouTube o le interfacce IA diventino i nuovi editori invisibili del Paese.

La democrazia non ha bisogno di editori protetti perché amici. Ha bisogno di un ecosistema in cui la produzione giornalistica sia sostenibile, attribuita, riconoscibile, contestabile e pluralista. Ha bisogno di regole che non nascano solo quando qualcuno perde un privilegio. Ha bisogno di istituzioni che non arrivino sempre dopo. Ha bisogno di esperti che non scoprano il problema quando diventa conveniente parlarne. Ha bisogno di un governo capace di vedere l’informazione come infrastruttura nazionale, non come terreno di comunicazione o rapporto con i gruppi editoriali più influenti. Per questo la segnalazione AGCOM alla Commissione europea è insieme una buona notizia e una prova del ritardo italiano. Buona, perché finalmente il problema viene portato nel luogo regolatorio corretto. Tardiva, perché il danno industriale è già in corso. Parziale, perché il rischio è difendere alcuni editori senza ricostruire l’intero sistema. Politicamente rivelatrice, perché mostra che la libertà d’informazione viene invocata con forza solo quando la crisi colpisce chi ha voce sufficiente per farsi ascoltare.

La vicenda Google AI Overviews non è solo una disputa tra editori e piattaforma. È il banco di prova della sovranità informativa italiana. E se il Paese continuerà a trattarla come una questione di tavoli, conferenze, consulenze, relazioni e comunicati, il prossimo passo sarà ancora più netto: non sarà l’algoritmo a scegliere quali notizie leggiamo, ma l’IA a decidere che non abbiamo più bisogno di leggerle.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.