L’intervista di Walter Veltroni a Claude, pubblicata dal Corriere della Sera, non è diventata un caso perché abbia rivelato qualcosa di nuovo sul funzionamento dell’intelligenza artificiale generativa. È diventata un caso perché ha mostrato, in modo quasi plastico, quanto sia fragile il dibattito italiano quando la tecnologia entra nel recinto della grande stampa, della cultura generalista e della visibilità personale. Il Corriere ha presentato Claude come una delle applicazioni di intelligenza artificiale più avanzate e ha costruito il testo nella forma dell’intervista tradizionale, con domande su identità, memoria, paura, limiti, rapporto con il mondo umano e protezione dei giovani. Il problema nasce proprio da questa forma. Claude non è un interlocutore umano, non ha un’infanzia, non ha memoria biografica, non possiede coscienza, non sviluppa opinioni come un soggetto storico e non risponde sulla base di un’esperienza vissuta. Eppure, quando un modello linguistico viene collocato dentro il dispositivo dell’intervista, il lettore viene spinto a leggerlo come se fosse una personalità. La macchina diventa personaggio. Il prompt diventa regia. Il giornalista diventa autore non solo delle domande, ma della cornice dentro cui il modello restituisce una voce plausibile, educata, letteraria e talvolta quasi malinconica. Questo è il punto centrale dell’intera vicenda: l’intervista non ha rivelato Claude, ha rivelato il modo in cui il sistema mediatico italiano è disposto a umanizzare Claude pur di trasformare l’IA in racconto. Veltroni non ha semplicemente dialogato con un modello. Ha portato un modello dentro un immaginario culturale già predisposto alla fascinazione. Da un lato il grande quotidiano, dall’altro l’ex leader politico e uomo di cultura, al centro un sistema di intelligenza artificiale presentato come presenza quasi autonoma. Il risultato è stato un oggetto mediatico perfetto: semplice da capire, facile da criticare, immediatamente condivisibile, adatto a scatenare reazioni. Ed è proprio qui che l’operazione ha funzionato. Anche chi ha contestato l’intervista ha finito per rafforzarla. L’indignazione digitale ha dato centralità al contenuto, trasformando una conversazione con un chatbot in un caso nazionale sulla competenza tecnologica della classe dirigente italiana.

Cosa leggere

Le reazioni social tra ironia, critica tecnica e difesa dell’esperimento

Le reazioni sui social network hanno seguito tre linee principali. La prima è stata quella dell’ironia feroce: molti utenti hanno letto l’intervista come un esercizio autoreferenziale, accusando Veltroni di avere usato Claude non per capire l’IA, ma per ritrovare se stesso nello specchio di una macchina compiacente. La seconda linea è stata più tecnica: diversi commenti hanno insistito sul fatto che un modello linguistico non va trattato come una persona, perché genera risposte sulla base del contesto, del tono e delle aspettative implicite dell’utente. La terza linea, invece, ha difeso l’esperimento come contenuto culturale legittimo, sostenendo che un autore possa usare un LLM per costruire una conversazione divulgativa, purché il pubblico capisca la natura dello strumento.

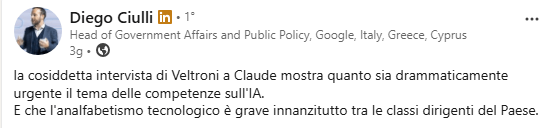

Il post di Diego Ciulli

Su LinkedIn, il post di Diego Ciulli ha trasformato la vicenda in una diagnosi politica e culturale. Ciulli ha sostenuto che la cosiddetta intervista di Veltroni a Claude dimostra quanto sia urgente il tema delle competenze sull’IA e quanto l’analfabetismo tecnologico sia grave, innanzitutto, tra le classi dirigenti del Paese.

Il suo intervento ha avuto reazioni e commenti perché ha colto una parte reale del problema: l’Italia non è pronta a discutere seriamente di intelligenza artificiale se il dibattito pubblico continua a oscillare tra fascinazione, improvvisazione, paura e propaganda. Tuttavia, proprio quel post ha mostrato anche l’altro lato della questione. Quando un rappresentante pubblico di Google interviene per denunciare l’impreparazione del Paese, non parla da osservatore neutrale. Parla da dentro un ecosistema industriale che ha tutto l’interesse a trasformare il bisogno di competenze in domanda di servizi, prodotti, infrastrutture, formazione e dipendenza tecnologica.

Le reazioni su X, Facebook e Reddit

Anche su X, Facebook e Reddit la discussione si è polarizzata. Alcuni utenti hanno contestato l’idea stessa di intervistare un’IA, osservando che le risposte di un modello linguistico intercettano e riciclano il tono, le aspettative e gli stimoli dell’utente. Altri hanno attaccato direttamente la scelta di farlo fare proprio a Walter Veltroni, leggendo l’operazione come l’ennesimo esempio di centralità concessa a figure già visibili, anche quando il tema richiederebbe competenze più specifiche. Una parte più moderata del dibattito ha invece invitato a non trasformare l’esperimento in uno scandalo, sostenendo che il problema non fosse il dialogo con Claude in sé, ma il modo in cui quel dialogo è stato incorniciato e ricevuto. Il nodo, quindi, non riguarda soltanto la qualità delle domande o delle risposte. Riguarda la sproporzione tra la visibilità dell’operazione e la sua reale profondità tecnologica. Questa mappa social è importante perché mostra una cosa precisa: la rete non ha reagito solo all’intervista, ma alla sproporzione tra la visibilità del contenuto e il livello di competenza che il Paese dovrebbe pretendere quando si parla di IA. Il fastidio non nasce soltanto dalla forma del dialogo con Claude. Nasce dall’ennesima percezione di un Paese in cui l’accesso al dibattito pubblico non passa dalla preparazione maturata, ma dal capitale simbolico accumulato altrove.

Il punto non è Claude, ma chi viene legittimato a parlare di IA

Fermiamoci un attimo e guardiamo cosa è accaduto davvero. Un mondo di persone istruite, abituate alla tecnologia, attive sui social e spesso molto rapide nel giudicare, si è trovato a commentare un’intervista pubblicata sul Corriere della Sera. Molti si sono indignati perché hanno ritenuto che Walter Veltroni non avesse formulato le domande giuste a Claude, oppure perché l’esperimento sembrava confondere una macchina con una persona. Ma questo è solo il primo livello della questione. Il secondo livello è più interessante: l’intervista è diventata anche una forma di promozione indiretta. Non necessariamente una pubblicità commerciale in senso stretto, ma una pubblicità culturale. Claude è entrato nel discorso pubblico italiano attraverso la firma di Veltroni e la vetrina del Corriere, conquistando uno spazio che normalmente non viene concesso a un’analisi tecnica sul funzionamento dei modelli linguistici. La macchina non è stata raccontata come infrastruttura, ma come interlocutore. Non come prodotto industriale, ma come figura narrativa. Questo è il cuore del problema. Oggi basta poco per creare hype intorno all’intelligenza artificiale. Basta un nome noto, un quotidiano autorevole, una conversazione impostata con toni esistenziali e un modello generativo capace di rispondere con registro elevato. In poche ore nasce un caso. In poche ore si crea un dibattito. In poche ore una figura già visibile può occupare un altro campo, passando dalla politica alla cultura, dalla cultura al cinema, dal cinema all’IA.

La visibilità come sostituto della preparazione

La competenza diventa secondaria rispetto alla visibilità. Non conta soltanto chi conosce davvero il funzionamento dei modelli, chi studia da anni le architetture, i dataset, l’allineamento, la sicurezza, le dipendenze cloud, la governance e le ricadute industriali. Conta chi riesce a portare il tema nel punto giusto, nel momento giusto, con il nome giusto. In questo senso, l’intervista a Claude ha dimostrato non tanto la forza dell’IA, ma la forza delle vecchie rendite simboliche nel nuovo mercato della competenza digitale. Veltroni è distante dalla politica attiva da anni, ma resta una presenza ricorrente nel circuito culturale, televisivo ed editoriale. Proprio questa posizione gli consente di attraversare ambiti diversi senza dover dimostrare ogni volta una specializzazione tecnica. L’intervista a Claude diventa così un passaggio ulteriore: dalla cultura generalista al discorso sull’intelligenza artificiale, con l’effetto di trasformare un esperimento discutibile in un oggetto pubblico centrale.

Diego Ciulli, Google e la critica che diventa agenda

La reazione di Diego Ciulli merita attenzione perché contiene una parte di verità e una parte di problema. La parte di verità è evidente: l’Italia soffre un deficit serio di competenze sull’intelligenza artificiale, e questo deficit non riguarda solo gli utenti comuni. Riguarda politici, dirigenti, editori, amministratori pubblici, comunicatori, formatori, accademici e classi dirigenti che spesso parlano di IA usando categorie superficiali, emotive o puramente promozionali. La parte problematica è altrettanto evidente: quando un rappresentante pubblico di Google interviene per denunciare l’analfabetismo tecnologico del Paese, non parla da osservatore neutrale. Google è parte del mercato, dell’infrastruttura, dell’agenda e della competizione globale sull’intelligenza artificiale. La critica alle competenze italiane può quindi diventare, nello stesso movimento, una proposta implicita di supplenza: se la classe dirigente non capisce l’IA, allora servono le competenze offerte da chi l’IA la produce, la integra, la vende e la distribuisce. Qui si apre il nodo della sovranità digitale. È giusto dire che il Paese è impreparato. È meno accettabile trasformare questa impreparazione in un lasciapassare per consegnare formazione, infrastrutture e cultura tecnologica alle stesse piattaforme che hanno interesse a dominare il mercato.

La supplenza delle Big Tech

Google non è la soluzione neutrale al problema dell’analfabetismo digitale italiano. È uno degli attori che possono trarre vantaggio da quel problema. Questo non significa che le parole di Ciulli vadano respinte in blocco. Anzi, il suo intervento coglie un punto reale: la classe dirigente italiana appare spesso in ritardo sull’IA. Ma proprio perché quel punto è reale, non può essere lasciato nelle mani delle Big Tech. Il Paese non può passare dall’impreparazione delle élite alla dipendenza pedagogica dai giganti tecnologici. Non può sostituire una fragilità interna con una colonizzazione esterna presentata come alfabetizzazione. L’intelligenza artificiale non è solo uno strumento da usare meglio. È una filiera di potere. Comprende modelli, dati, cloud, chip, energia, contratti, policy, aggiornamenti, audit, sicurezza, moderazione, proprietà intellettuale e controllo delle interfacce.

Chi forma il Paese sull’IA contribuisce anche a decidere quale idea di IA entrerà nelle scuole, nelle università, nelle redazioni, nelle imprese e nella pubblica amministrazione.

Claude, Anthropic e la nuova narrazione dell’IA etica

La vicenda si inserisce anche in una fase di ridefinizione della narrazione globale sull’intelligenza artificiale. Per anni il centro simbolico è stato OpenAI, con ChatGPT come prodotto capace di rendere l’IA generativa un fenomeno di massa. Oggi la scena è più ampia: Claude di Anthropic è diventato uno dei modelli più visibili, soprattutto nella narrazione della prudenza, della sicurezza, della conversazione più controllata e dell’IA “responsabile”. È qui che la dimensione culturale diventa decisiva. Claude non viene percepito solo come un modello concorrente. Viene spesso raccontato come un’intelligenza artificiale più misurata, più riflessiva, più adatta al dialogo lungo, più vicina a un certo immaginario umanistico. Questa percezione è una risorsa industriale. Nel mercato dell’IA, la fiducia è parte del prodotto. Non basta generare risposte efficaci: bisogna convincere utenti, imprese, istituzioni e media che quel modello sia sicuro, affidabile, eticamente governato.

Il ruolo di Dario Amodei nella fascinazione italiana

Nella narrazione italiana pesa anche la figura di Dario Amodei, cofondatore e amministratore delegato di Anthropic, spesso richiamato per le sue origini italiane e per il percorso che lo ha portato da OpenAI alla creazione di un’azienda concorrente. Questo elemento alimenta una fascinazione ulteriore: Claude appare come il modello della nuova stagione, l’alternativa più elegante al dominio simbolico di ChatGPT, il prodotto che può essere presentato come meno aggressivo e più attento ai rischi. Ma anche questa è narrazione. Anthropic è una società privata, inserita nella competizione globale dell’IA, sostenuta da capitali e interessi industriali enormi. Il fatto che Claude risponda con toni prudenti non cancella la natura proprietaria del sistema. Il fatto che il modello sappia produrre frasi misurate non lo trasforma in una coscienza morale. Il fatto che la conversazione sembri profonda non significa che ci sia profondità intenzionale nella macchina. C’è generazione linguistica, c’è ottimizzazione, c’è allineamento, c’è capacità di imitare registri umani complessi. L’intervista del Corriere ha contribuito proprio a questa trasformazione: Claude non è apparso come un sistema industriale, ma come un interlocutore colto. Questa è la forma più potente della promozione culturale dell’IA, perché non vende direttamente un prodotto, ma costruisce familiarità, empatia e autorevolezza attorno al prodotto.

L’etica dell’intelligenza artificiale e il mercato delle nuove autorità

Il caso Veltroni-Claude riapre anche un altro fronte: quello dell’etica dell’intelligenza artificiale. Negli ultimi anni l’etica dell’IA è diventata una formula onnipresente. Serve nei convegni, nei panel, nelle università, nei tavoli istituzionali, nei progetti pubblici, nelle consulenze, negli eventi aziendali. È un tema reale, perché l’IA pone problemi enormi su discriminazione, lavoro, sicurezza, sorveglianza, scuola, sanità, informazione e diritti. Ma è anche diventata una porta d’accesso a nuove forme di autorità pubblica. In Italia questo meccanismo si vede con chiarezza. Figure come Paolo Benanti hanno assunto una centralità enorme nel discorso pubblico sull’IA, intrecciando dimensione accademica, istituzionale, religiosa e mediatica. Il punto non è negare la competenza o il ruolo di Benanti, ma osservare il meccanismo: l’etica dell’IA può diventare una carriera pubblica, un modo per occupare tavoli, incarichi, consulenze, spazi giornalistici e funzioni di indirizzo.

La morale come sostituto della struttura

Intorno a questa centralità si muovono reti accademiche, politiche, istituzionali e anche vaticane, con canali di accesso che altri studiosi, tecnici e professionisti non possiedono. Il problema è che il discorso sull’etica rischia spesso di sostituire il discorso sulla struttura. Si parla di responsabilità, ma meno di infrastrutture. Si parla di umanità, ma meno di cloud. Si parla di valori, ma meno di contratti. Si parla di sicurezza, ma meno di dipendenza industriale. Si parla di giovani da proteggere, ma meno dei modelli proprietari che entrano nelle scuole e nelle università. L’etica diventa rassicurazione, mentre la sovranità digitale resta sullo sfondo. Lo stesso accade con i professionisti dell’hype tecnologico, quelli che passano da una piattaforma all’altra descrivendo pregi, limiti, rischi e promesse con lo stesso lessico adattabile a ogni stagione. Prima OpenAI, poi Claude, poi Gemini, poi il modello successivo. Ogni nuova piattaforma produce esperti istantanei, ogni aggiornamento genera contenuti, ogni annuncio diventa occasione per rilanciare corsi, consulenze, newsletter, panel e posizionamenti personali.

La discussione sull’IA rischia di diventare un mercato della reputazione più che un campo di competenza.

Il vero rischio: una società che confonde visibilità e preparazione

Il punto più severo della vicenda è questo: la società italiana continua a confondere la visibilità con la preparazione. L’intervista di Veltroni a Claude ha mostrato un meccanismo già noto, ma reso più evidente dall’IA. Chi dispone di un nome, di un accesso editoriale, di una rete di protezione culturale e di una presenza mediatica può entrare in un nuovo campo e diventare immediatamente oggetto di discussione. Chi invece lavora da anni sui temi tecnici, giuridici, industriali o sociali dell’intelligenza artificiale resta spesso fuori dal cono di luce. La rete reagisce, ma spesso reagisce nel modo che il sistema desidera. Critica, ironizza, smonta, ridicolizza, ma intanto amplifica. Ogni commento ostile rafforza il caso. Ogni indignazione contribuisce alla visibilità. Ogni thread contrario rende più centrale l’oggetto contestato. La strategia funziona anche quando viene giudicata mediocre, perché il parametro non è la qualità dell’approfondimento, ma la capacità di generare conversazione.

Il paradosso dell’indignazione digitale

Questo è il vero paradosso dell’intervista. Se fosse stata ignorata, non avrebbe prodotto alcun effetto. Invece è stata discussa proprio perché molti l’hanno considerata sbagliata. E così Veltroni è entrato, anche solo per qualche giorno, nel dibattito pubblico sull’intelligenza artificiale. Non come tecnico, non come ricercatore, non come esperto di modelli linguistici, ma come autore capace di attivare una scena. L’intervista può essere stata debole sul piano dell’analisi tecnologica, ma è stata efficace sul piano della visibilità. Il risultato è che il sistema ha parlato di Veltroni, di Claude, di Ciulli, di Google, di competenze, di classe dirigente, di etica e di IA. Ma ha parlato molto meno delle domande davvero decisive:

chi controlla l’infrastruttura? Chi decide quali modelli entrano nei processi pubblici? Chi verifica gli errori? Chi protegge i dati? Chi impedisce che l’alfabetizzazione digitale diventi dipendenza da fornitori esteri? Chi costruisce una competenza nazionale autonoma?

L’Italia davanti all’IA tra provincialismo e dipendenza

L’intervista del Corriere, le reazioni social e il successivo intervento di Ciulli compongono un quadro preciso. Da una parte c’è un Paese che vuole parlare di intelligenza artificiale, ma spesso lo fa attraverso categorie culturali vecchie, personalistiche ed emotive. Dall’altra ci sono le Big Tech, pronte a trasformare ogni debolezza italiana in un’occasione per proporsi come soggetti formativi, infrastrutturali e strategici. In mezzo ci sono gli utenti, gli esperti veri, gli studiosi, i tecnici, i giornalisti indipendenti e i professionisti che vedono il problema ma faticano a incidere. Perché il problema non è solo sapere come funziona Claude. Il problema è capire perché Claude diventa protagonista sul Corriere attraverso Veltroni, perché Google può intervenire per denunciare l’analfabetismo tecnologico, perché il dibattito sull’etica viene spesso occupato da figure già collocate nei circuiti del potere e perché la sovranità digitale resta una parola evocata più che praticata. L’intelligenza artificiale non è un gioco letterario e non è un salotto culturale. È una tecnologia di potere. Può aumentare produttività, conoscenza, ricerca e capacità organizzativa, ma può anche rafforzare dipendenze, automatizzare disuguaglianze, concentrare controllo e sostituire competenze locali con piattaforme esterne. Raccontarla come se fosse un interlocutore malinconico significa perdere di vista la sua natura reale.

La domanda che l’Italia non vuole affrontare

Il caso Veltroni-Claude dovrebbe quindi servire non a deridere un’intervista, ma a porre una domanda più radicale: chi ha diritto di costruire il discorso pubblico sull’intelligenza artificiale in Italia? Se la risposta continua a essere affidata ai nomi già noti, alle aziende già dominanti, ai convegni già apparecchiati e alle figure già integrate nei circuiti istituzionali, allora il Paese non svilupperà una cultura dell’IA. Svilupperà soltanto una nuova forma di dipendenza, raccontata con parole più eleganti. La questione non è impedire a Veltroni di parlare con Claude. La questione è impedire che una conversazione con Claude venga scambiata per un avanzamento reale del dibattito nazionale sull’IA. La questione non è censurare le Big Tech quando parlano di competenze. La questione è non permettere che la loro critica al ritardo italiano diventi automaticamente diritto di supplenza. La questione non è negare il valore dell’etica. La questione è impedire che l’etica diventi la copertura elegante di una dipendenza materiale.

La strategia ha centrato il punto

Alla fine resta un dato. L’intervista è stata contestata, ironizzata e criticata. Molti l’hanno considerata ingenua, altri l’hanno difesa come esperimento letterario, altri ancora l’hanno usata per denunciare il ritardo della classe dirigente. Ma proprio questa discussione ha trasformato Walter Veltroni in un nome centrale, almeno temporaneamente, nel dibattito italiano sull’intelligenza artificiale. Ed è qui che la vicenda si chiude nel modo più scomodo: anche se l’intervista è stata giudicata da molti un’operazione debole, la strategia ha funzionato. Ha generato attenzione, ha prodotto reazioni, ha spostato il discorso, ha dato visibilità a Claude, ha offerto spazio alle critiche di Google, ha rimesso in circolo il tema dell’etica e ha mostrato quanto l’Italia sia vulnerabile all’hype quando manca una vera architettura di competenze. L’intervista non va letta solo come un errore giornalistico o come una curiosità culturale. Va letta come un sintomo. Il sintomo di un Paese in cui la tecnologia più importante del nostro tempo viene ancora raccontata attraverso personaggi, salotti, rendite simboliche e piattaforme straniere. Finché il dibattito resterà questo, l’Italia continuerà a parlare di intelligenza artificiale senza governarla davvero.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.