AMD accelera la competizione nei data center AI con il nuovo MI350P, acceleratore PCIe che secondo l’azienda supera NVIDIA H200 del 40% nei calcoli FP16 e FP8. Parallelamente Elon Musk conferma che SpaceX affitta parte della propria infrastruttura composta da 220.000 GPU NVIDIA alla società AI Anthropic. Le due notizie mostrano come il mercato dell’intelligenza artificiale stia entrando in una fase dominata da hardware ad alte prestazioni, infrastrutture condivise e nuove strategie per scalare rapidamente i modelli generativi.

Cosa leggere

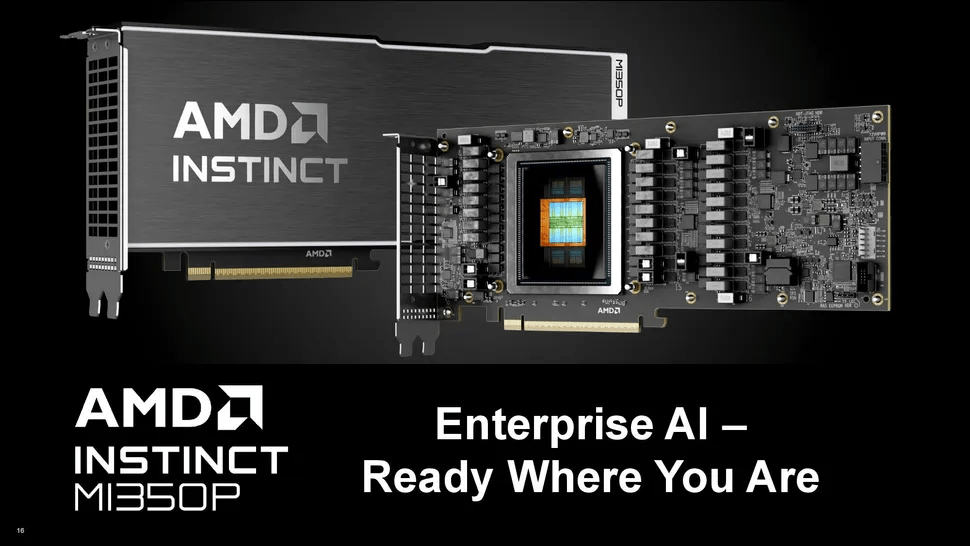

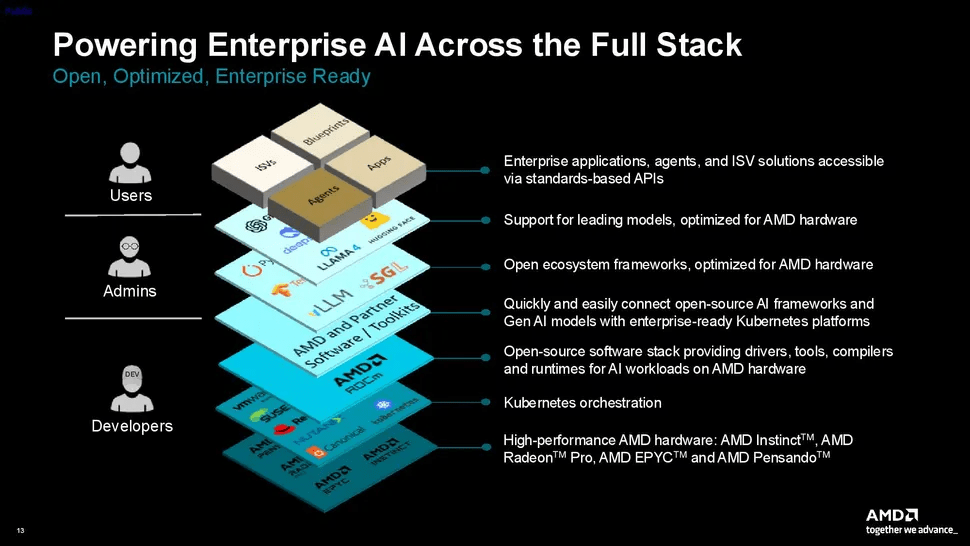

AMD progetta MI350P come acceleratore PCIe pronto per i data center enterprise

Il nuovo AMD MI350P viene sviluppato come scheda PCIe standard, scelta che permette l’integrazione diretta nei server già presenti nei data center senza richiedere chassis proprietari o infrastrutture dedicate. AMD punta chiaramente sulla semplicità di deployment come vantaggio competitivo rispetto alle soluzioni più complesse presenti sul mercato enterprise. Gli operatori possono installare il nuovo acceleratore all’interno dei rack esistenti riducendo tempi, costi di aggiornamento e necessità di modifiche strutturali. Questa strategia rende il MI350P particolarmente interessante per aziende che vogliono aumentare rapidamente la capacità AI senza affrontare lunghi processi di migrazione hardware. Il formato PCIe mantiene inoltre alta la compatibilità con l’ecosistema server già adottato da hyperscaler e provider cloud.

I 144 GB di memoria HBM3e spingono le prestazioni del MI350P

AMD equipaggia il MI350P con 144 GB di memoria HBM3e, uno degli elementi più importanti dell’intera architettura. La quantità elevata di memoria ad alta banda permette di gestire modelli AI complessi e dataset molto estesi senza generare colli di bottiglia durante addestramento e inferenza. La tecnologia HBM3e garantisce throughput superiore rispetto alle generazioni precedenti e migliora la velocità di accesso ai dati nei workload ad alta intensità computazionale. Questa configurazione consente al MI350P di affrontare scenari enterprise sempre più esigenti, soprattutto in ambiti come modelli linguistici di grandi dimensioni, simulazioni scientifiche e inferenza AI su larga scala. AMD utilizza la memoria come uno dei principali argomenti contro NVIDIA, puntando sulla capacità di mantenere prestazioni elevate anche sotto carichi continui e intensivi.

AMD dichiara un vantaggio del 40% su NVIDIA H200 nei calcoli FP16 e FP8

Secondo AMD, il MI350P supera NVIDIA H200 del 40% nei calcoli FP16 e FP8, due formati fondamentali per l’addestramento e l’inferenza dei modelli di intelligenza artificiale moderni. Il vantaggio emerge soprattutto nei workload ottimizzati per precisione mista, dove throughput e velocità di elaborazione rappresentano elementi decisivi per ridurre tempi operativi e costi energetici. AMD utilizza questi benchmark teorici per posizionare il MI350P come alternativa concreta nel segmento data center dominato da NVIDIA. L’azienda sostiene inoltre che il miglioramento prestazionale non comporti un incremento proporzionale nei consumi, aspetto fondamentale in un momento in cui i costi energetici stanno diventando una delle principali criticità per l’infrastruttura AI globale. NVIDIA mantiene una posizione dominante grazie all’ecosistema CUDA e alla diffusione delle proprie GPU, ma AMD cerca ora di colpire direttamente sul terreno delle prestazioni grezze e della convenienza enterprise.

AMD intensifica la guerra per il dominio nei data center AI

Il lancio del MI350P conferma la volontà di AMD di conquistare quote di mercato nei data center AI, settore che oggi rappresenta una delle aree più redditizie dell’intera industria hardware. Fino a questo momento NVIDIA ha dominato quasi incontrastata grazie alle GPU H100 e H200, ma la crescita della domanda AI apre spazio per alternative competitive capaci di offrire migliori rapporti tra prezzo, prestazioni e disponibilità. Le aziende che gestiscono infrastrutture AI valutano sempre più attentamente le opzioni disponibili perché la scarsità di GPU e i costi elevati stanno rallentando molti progetti enterprise. AMD punta quindi a intercettare clienti interessati a diversificare la propria infrastruttura riducendo la dipendenza dall’ecosistema NVIDIA. La competizione tra i due produttori si sta spostando dal semplice confronto hardware a una vera battaglia strategica per il controllo dell’infrastruttura AI globale.

Elon Musk conferma che SpaceX affitta GPU NVIDIA ad Anthropic

Elon Musk conferma pubblicamente che SpaceX affitta parte della propria capacità computazionale ad Anthropic. L’infrastruttura SpaceX comprende circa 220.000 GPU NVIDIA, una delle più grandi installazioni AI private al mondo. L’accordo consente ad Anthropic di ottenere accesso immediato a enormi risorse computazionali senza dover costruire da zero nuovi data center dedicati.

Per SpaceX l’operazione rappresenta una nuova forma di monetizzazione della propria infrastruttura tecnologica. L’azienda utilizza internamente una parte della potenza di calcolo per simulazioni, sviluppo software e progetti collegati alle proprie attività spaziali, ma decide ora di trasformare l’eccesso di capacità in un servizio enterprise per aziende AI avanzate.

Le 220.000 GPU NVIDIA di SpaceX diventano un modello di sharing enterprise

La decisione di SpaceX introduce un modello innovativo basato sulla condivisione di supercomputer privati tra grandi aziende tecnologiche. Invece di costruire infrastrutture indipendenti e isolate, le società AI possono accedere a cluster GPU già operativi e collaudati tramite accordi commerciali diretti. Questo approccio accelera notevolmente i tempi di scaling e riduce i costi iniziali necessari per entrare nel mercato dei modelli generativi avanzati. Anthropic beneficia immediatamente della disponibilità di una potenza computazionale enorme, mentre SpaceX ottimizza l’utilizzo delle proprie GPU trasformandole in fonte di ricavo aggiuntiva. Il modello potrebbe diventare un precedente importante per l’intero settore AI, soprattutto in una fase in cui la domanda di acceleratori supera la capacità produttiva disponibile sul mercato globale.

Anthropic guarda ai data center orbitali insieme a SpaceX

Secondo quanto emerso, Anthropic starebbe valutando anche lo sviluppo di data center orbitali, sfruttando la collaborazione con SpaceX per esplorare nuove architetture infrastrutturali. L’idea nasce dalla necessità di superare alcuni limiti terrestri legati a consumo energetico, dissipazione termica e disponibilità di spazio fisico per i grandi cluster AI. I data center in orbita potrebbero sfruttare energia solare continua e raffreddamento naturale dello spazio, riducendo parte dei costi energetici che oggi rappresentano uno dei problemi principali dell’intelligenza artificiale su larga scala. Anche se il progetto appare ancora in fase esplorativa, l’interesse di Anthropic mostra quanto rapidamente il settore AI stia spingendo verso soluzioni infrastrutturali non convenzionali.

AMD, NVIDIA, SpaceX e Anthropic ridefiniscono il futuro dell’AI

Le mosse di AMD e SpaceX mostrano due strategie differenti ma complementari per il futuro dell’intelligenza artificiale. AMD cerca di guadagnare terreno attraverso acceleratori più potenti e facilmente integrabili nei data center esistenti, mentre SpaceX sperimenta nuovi modelli economici basati sul noleggio della capacità computazionale. NVIDIA resta al centro dell’ecosistema grazie alle proprie GPU, ma la pressione competitiva aumenta sia sul fronte hardware sia su quello infrastrutturale. Anthropic emerge invece come uno dei principali beneficiari di questa evoluzione, ottenendo accesso immediato a enormi risorse computazionali senza investimenti infrastrutturali iniziali equivalenti. Il settore AI si sta trasformando rapidamente in un mercato dove non conta soltanto possedere il miglior modello, ma anche disporre della capacità di calcolo necessaria per addestrarlo e distribuirlo su scala globale.

La nuova corsa AI punta su scala, efficienza e accesso alle GPU

La competizione tra AMD, NVIDIA, SpaceX e Anthropic conferma che il vero campo di battaglia dell’intelligenza artificiale è ormai rappresentato dai data center e dall’accesso alle GPU. Prestazioni, memoria, consumi energetici e disponibilità computazionale diventano fattori strategici tanto quanto gli algoritmi stessi. Il MI350P mostra che AMD vuole ridurre il vantaggio NVIDIA nei workload AI più importanti, mentre SpaceX dimostra che la capacità di calcolo può trasformarsi in un servizio condiviso ad alto valore economico. L’evoluzione del mercato suggerisce inoltre che i prossimi anni vedranno una crescente convergenza tra hardware enterprise, cloud specializzati e infrastrutture distribuite, con scenari che potrebbero includere anche sistemi orbitali dedicati all’AI. La corsa all’intelligenza artificiale non riguarda più soltanto software e modelli linguistici, ma soprattutto la capacità concreta di alimentare questi sistemi con potenza computazionale sufficiente.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.