Google Gemini non è più soltanto un assistente testuale, ma il centro di una strategia AI che unisce modelli multimodali, automazione agentica, Android, Workspace, cloud enterprise, ricerca conversazionale e sicurezza informatica. La fase dei chatbot generativi isolati è stata superata: il punto non è più chiedere a un modello di scrivere un testo o riassumere un documento, ma delegare operazioni, collegare dati, interpretare contenuti diversi e trasformare l’intelligenza artificiale in un livello operativo dentro sistemi reali. Gemini rappresenta l’evoluzione più importante dell’ecosistema Google perché funziona come interfaccia trasversale tra utente, app, documenti, codice, immagini, video, audio, mappe, email, calendario e piattaforme cloud. Google presenta Gemini come assistente capace di collegarsi ai contenuti dell’utente in Gmail, Google Calendar, Google Maps, YouTube e Google Foto, aiutando a trovare informazioni e svolgere attività senza passare continuamente da un’app all’altra. Il salto reale è nella natura agentica del sistema. Un modello generativo tradizionale produce una risposta. Un agente AI può pianificare passaggi, usare strumenti, richiamare API, interagire con software esterni, mantenere memoria operativa, seguire vincoli e completare workflow. Gemini diventa quindi meno “chatbot” e più infrastruttura di azione, soprattutto quando viene integrato in Google Cloud, Workspace, Android e nei prodotti enterprise. Per chi segue l’evoluzione dell’ecosistema Google, questa trasformazione è già visibile nelle integrazioni su Android, Pixel, Home, Chrome, Workspace e Search. Su Matrice Digitale, il tema è stato seguito in più passaggi: dall’evoluzione di Google Android 2026 tra Gemini, Pixel, Play Store e software agli aggiornamenti su Chrome, Google Home e Gemini, fino alle funzioni che permettono a Gemini di generare Docs, PDF e Word da prompt. Insieme, questi segnali mostrano una strategia coerente: portare l’AI fuori dalla singola chat e dentro l’intero flusso digitale quotidiano.

Cosa leggere

Cos’è Google Gemini e perché la multimodalità nativa cambia l’AI

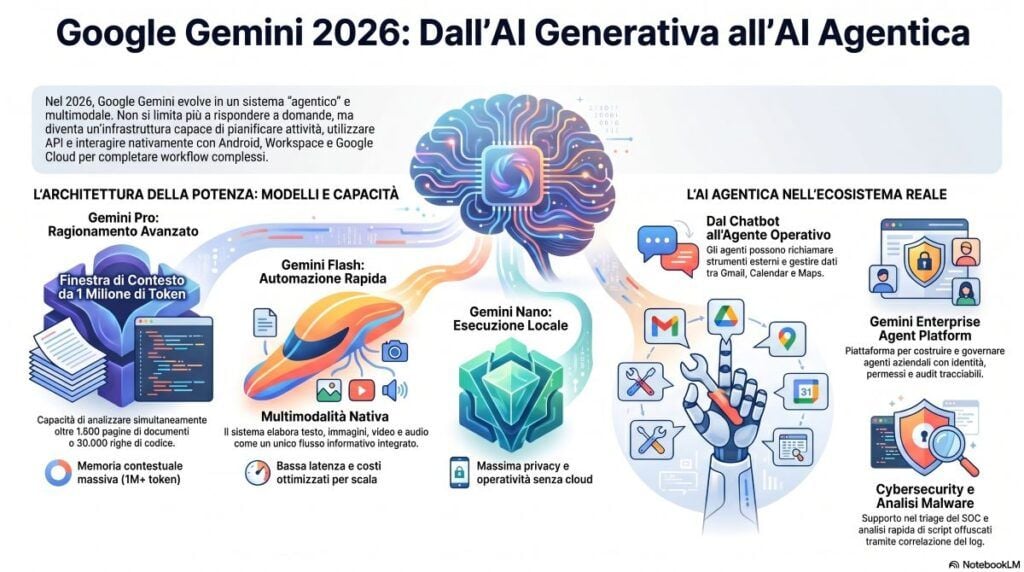

Gemini è la famiglia di modelli AI di Google progettata per comprendere e generare contenuti attraverso più modalità, tra cui testo, immagini, video, audio e codice. Il punto tecnico centrale è la multimodalità nativa: il modello non lavora soltanto traducendo ogni contenuto in testo, ma nasce per trattare formati diversi come parte dello stesso spazio informativo. Questa impostazione è importante perché il mondo reale non è testuale. Un utente può voler analizzare una foto, commentare un video, comprendere un file PDF, riassumere email, esaminare codice, interpretare una schermata, ascoltare audio o collegare dati provenienti da fonti diverse. La multimodalità trasforma Gemini in un sistema più vicino al modo in cui le persone lavorano davvero: non su un singolo canale, ma su flussi misti di informazione.La documentazione Google AI for Developers indica che Gemini può usare input multimodali, long context, document understanding, function calling, strumenti come Google Search, URL Context, Google Maps, Code Execution e Computer Use, oltre a funzionalità per voice agents e video generation con Veo. Questo significa che Gemini non viene presentato soltanto come modello linguistico, ma come piattaforma per costruire applicazioni capaci di collegarsi al mondo esterno. Il ruolo della finestra di contesto è decisivo. Google spiega che molti modelli Gemini dispongono di finestre di contesto da 1 milione o più token, aprendo casi d’uso su grandi quantità di testo, codice, documenti, video e dati non strutturati. La stessa documentazione sottolinea che Gemini è stato il primo modello capace di accettare 1 milione di token e che questa capacità riduce il bisogno di strategie aggressive di sintesi o filtraggio del contesto.

Gemini Pro, Flash e Nano: tre livelli per casi d’uso diversi

L’ecosistema Gemini non si esaurisce in un singolo modello. Google differenzia la propria offerta per bilanciare potenza, velocità, costo, latenza e integrazione sui dispositivi. Questa distinzione è fondamentale perché non tutti i casi d’uso richiedono lo stesso livello di ragionamento o lo stesso consumo computazionale.

Gemini Pro è pensato per attività più complesse, analisi di documenti lunghi, ragionamento avanzato, codice, ricerca e workflow che richiedono ampia memoria contestuale. Nella pagina consumer italiana, Google indica che Gemini Pro può orientarsi in repository di codice e file di grandi dimensioni grazie a una finestra contestuale di 1 milione di token, caricando contemporaneamente fino a 1500 pagine o 30.000 righe di codice.

Gemini Flash è invece il livello ottimizzato per velocità e bassa latenza. È il modello più utile quando serve risposta rapida, automazione su larga scala, integrazione in app, gestione di interazioni frequenti o workflow in cui il costo per chiamata diventa un parametro strategico. Nel 2026, la logica Flash diventa centrale per portare l’AI in prodotti consumer e servizi enterprise senza trasformare ogni interazione in un carico computazionale eccessivo.

Gemini Nano è la parte più vicina al dispositivo. L’idea dell’AI on-device è eseguire attività direttamente su smartphone, tablet o altri terminali compatibili, riducendo latenza, dipendenza dalla connessione e trasferimento di dati verso il cloud. Questo è il punto chiave per Android e Pixel: alcune funzioni possono essere eseguite localmente, mentre altre restano affidate ai modelli cloud più potenti. La sfida del 2026 è trovare l’equilibrio tra AI locale, AI cloud e privacy dell’utente.

Gemini Enterprise Agent Platform e il nuovo lavoro digitale

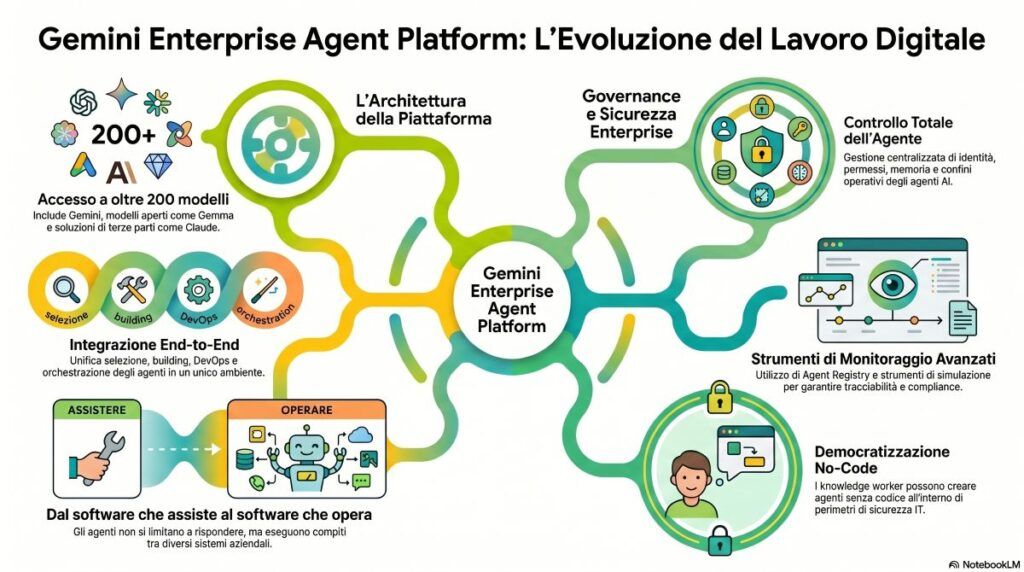

La novità più importante per le aziende è Gemini Enterprise Agent Platform, annunciata da Google Cloud il 22 aprile 2026 come piattaforma per costruire, scalare, governare e ottimizzare agenti AI. Google la presenta come evoluzione di Vertex AI, integrando selezione dei modelli, model building, agent building, agent integration, DevOps, orchestrazione e sicurezza. Il messaggio è chiaro: l’AI enterprise non può restare una serie di chatbot scollegati. Le aziende hanno bisogno di agenti governati, tracciabili, integrati nei processi, capaci di lavorare tra sistemi diversi e controllabili dai team IT. Google indica che la piattaforma offre accesso a oltre 200 modelli attraverso Model Garden, includendo Gemini, modelli aperti come Gemma e modelli di terze parti come Claude.

La parte più rilevante è la governance. Google Cloud descrive Agent Platform come un ambiente con Agent Identity, Agent Registry, Agent Gateway, strumenti di simulazione, valutazione e osservabilità, pensati per dare tracciabilità e controllo agli agenti. In parallelo, Gemini Enterprise viene presentato come “front door” dell’AI per ogni dipendente, con possibilità per i knowledge worker di costruire agenti no-code e condividerli dentro controlli di governance e compliance. Questa architettura è il passaggio dal software che assiste al software che opera. Un agente Gemini può diventare collega digitale solo se l’impresa sa controllarne identità, permessi, accessi, memoria, log, sicurezza e confini operativi. È qui che l’AI agentica incontra cloud security, identity management, audit e compliance. Su Matrice Digitale, questo tema si collega direttamente all’analisi su Gemini Enterprise e la nuova architettura del lavoro intelligente e alla lettura più recente del rapporto tra Google, AI e infrastruttura enterprise. Gemini non è solo una funzione dentro Workspace: diventa il tentativo di Google di portare l’AI nel cuore dell’organizzazione aziendale.

Gemini su Android, Pixel e dispositivi personali

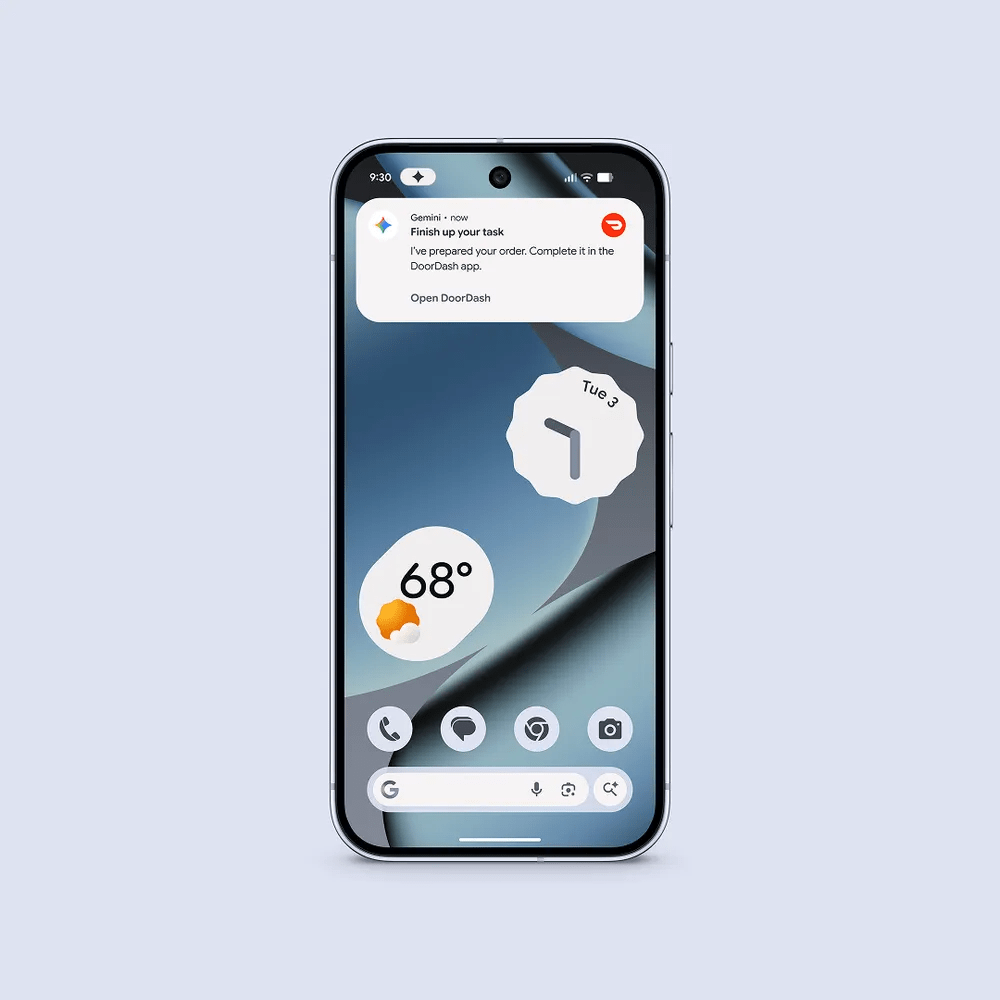

La seconda grande area di impatto è Android. Gemini è destinato a diventare l’interfaccia intelligente dell’ecosistema mobile Google, sostituendo progressivamente il vecchio paradigma dell’assistente vocale. L’assistente tradizionale eseguiva comandi. Gemini interpreta contesto, contenuti, app, immagini, notifiche, calendario e richieste più complesse. La pagina ufficiale italiana di Gemini descrive un assistente capace di scrivere, riassumere, aiutare nello studio, dialogare con Gemini Live, collegarsi a più app contemporaneamente e svolgere attività usando dati provenienti dai servizi Google. Questo rende Android un terreno strategico: più Gemini entra nel sistema operativo, più l’utente interagisce con Google attraverso un livello AI invece che attraverso singole app.

Sui Pixel, l’integrazione può diventare ancora più profonda. Google controlla hardware, Android, servizi cloud, AI e fotografia computazionale. Questo permette di trasformare lo smartphone in un terminale ibrido: una parte dell’intelligenza gira localmente, una parte passa dai modelli cloud, una parte lavora sui dati personali autorizzati dall’utente. La competizione con Apple e Samsung si sposta quindi dal dispositivo all’assistente operativo integrato nel dispositivo. Per seguire questo filone, l’approfondimento su Google Android 2026: Gemini, Pixel, Play Store e software mostra come Android 16 e Android 17 vengano letti come infrastruttura invisibile per rendere Gemini più operativo. Anche gli articoli su Gemini Personal Intelligence e automazione task su Pixel e su Gemini in Android Auto, Wear OS e Google Meet rafforzano la stessa lettura: Google vuole portare Gemini dentro auto, casa, telefono, lavoro e produttività.

Gemini, Workspace e produttività documentale

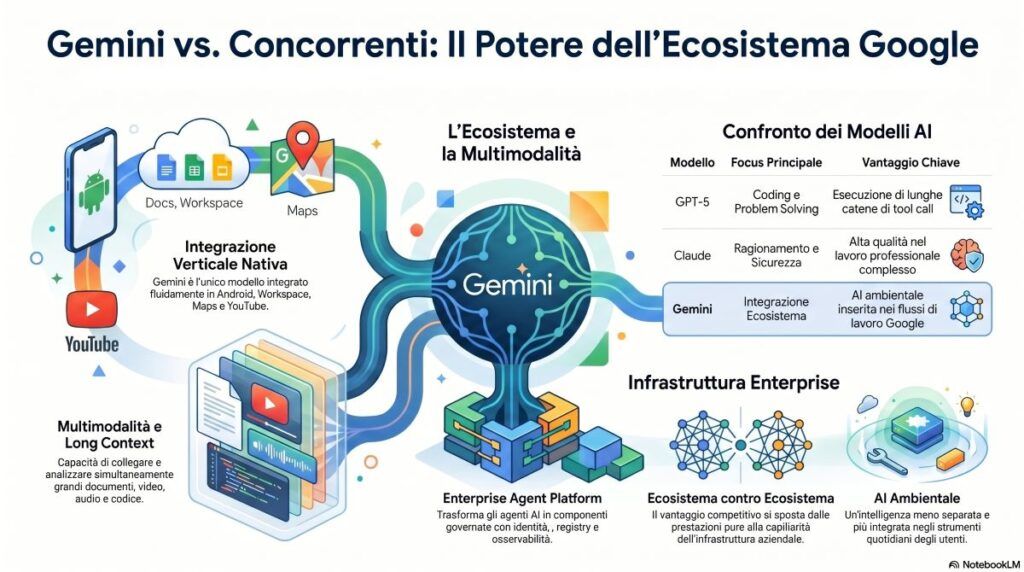

Il vantaggio competitivo più forte di Google rispetto a molti concorrenti è l’integrazione con Workspace. Gmail, Docs, Sheets, Slides, Drive, Calendar e Meet sono già strumenti quotidiani per milioni di utenti e aziende. Gemini può inserirsi direttamente nel luogo in cui il lavoro viene prodotto, archiviato, discusso e condiviso. Questo significa che l’AI non resta fuori dal documento, ma entra dentro il documento. Può aiutare a scrivere, riassumere, riorganizzare, cercare file, analizzare email, creare report, sintetizzare riunioni e generare contenuti. L’integrazione con Workspace è decisiva perché riduce il passaggio manuale tra app e modelli esterni. L’AI diventa utile quando non costringe l’utente a uscire dal flusso di lavoro. Qui Gemini ha un vantaggio naturale. GPT-5 e Claude possono essere molto forti nel ragionamento, nella scrittura e nella programmazione, ma Google dispone di una distribuzione nativa dentro Gmail, Drive, Docs, Calendar, Maps, YouTube e Android. OpenAI presenta GPT-5 come modello avanzato per coding e compiti agentici, con capacità di usare file aziendali e app connesse rispettando i permessi esistenti, ma l’integrazione profonda con Workspace resta un campo in cui Google parte da una posizione infrastrutturale molto forte. Per un approfondimento operativo, il caso Gemini genera Docs, PDF e Word da prompt mostra il passaggio dalla generazione di testo alla produzione di documenti pronti all’uso. È una trasformazione importante perché sposta l’AI dalla bozza alla consegna finale.

Gemini vs Claude vs GPT-5: dove Google è più forte

Il confronto tra Gemini, Claude e GPT-5 non può essere ridotto a una classifica assoluta. Ogni famiglia di modelli ha punti di forza diversi. GPT-5 viene presentato da OpenAI come modello avanzato per coding, agentic tasks, ricerca, analisi, scrittura e problem solving, con miglioramenti nell’esecuzione di lunghe catene di tool call e con contesto da 400K token nella scheda developer. Claude, nella comunicazione Anthropic più recente, viene posizionato su coding, agenti, visione e lavoro professionale complesso, con una forte enfasi su sicurezza e qualità del ragionamento.

Gemini, però, possiede un vantaggio specifico: l’integrazione verticale nell’ecosistema Google. Nessun altro modello può inserirsi con la stessa naturalezza dentro Android, Search, Gmail, Docs, Drive, Calendar, Maps, YouTube, Google Cloud e Workspace. Questo non significa che Gemini sia sempre superiore in ogni benchmark o attività. Significa che, per gli utenti e le aziende già dentro Google, l’AI può diventare meno separata e più ambientale. Il secondo vantaggio è la multimodalità combinata con long context. Google AI for Developers evidenzia input multimodali, long context, strumenti integrati, funzione calling, document understanding e voice agents. Questa architettura rende Gemini particolarmente adatto a scenari in cui bisogna collegare grandi documenti, codice, immagini, video, audio e dati esterni. Il terzo vantaggio è l’enterprise stack. Con Gemini Enterprise Agent Platform, Google prova a trasformare l’agente AI in componente governata dell’infrastruttura aziendale, con identità, registry, gateway, osservabilità e controlli di sicurezza. La partita non è solo modello contro modello, ma ecosistema contro ecosistema.

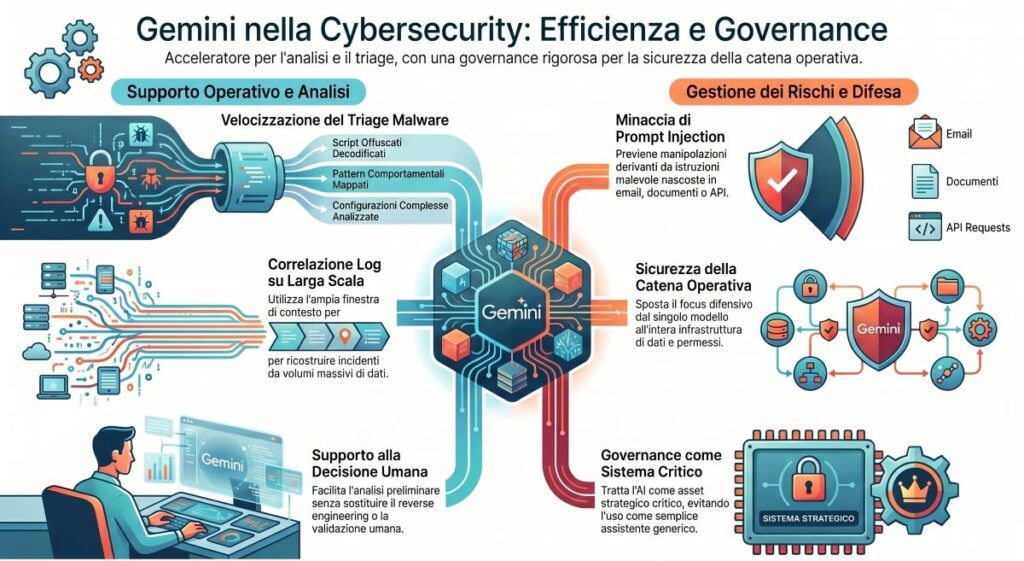

Gemini e cybersecurity: analisi del malware, SOC e prompt injection

Per la cybersecurity, Gemini può diventare uno strumento di supporto importante in tre aree: analisi del codice, correlazione dei log e protezione dei workflow AI. Un modello multimodale e long-context può aiutare i ricercatori a leggere script offuscati, confrontare frammenti di codice, sintetizzare indicatori di compromissione, analizzare report tecnici e ricostruire sequenze di eventi in ambienti complessi. L’analisi malware è uno dei campi più promettenti, perché molti campioni richiedono lettura rapida di script, funzioni, stringhe, pattern, comandi, configurazioni e comportamenti. Gemini può supportare la comprensione preliminare, ma non sostituisce sandbox, reverse engineering, analisi dinamica, threat intelligence e validazione umana. Il valore è nella velocità di triage, non nella delega cieca della decisione. Nei SOC, Gemini può aiutare a correlare log, alert, query, eventi endpoint, anomalie cloud e segnali di rete. La finestra di contesto ampia può essere utile per ricostruire incidenti partendo da grandi volumi di dati, anche se l’integrazione deve essere progettata con attenzione per evitare esposizione di informazioni sensibili. Un modello AI usato in sicurezza deve essere governato come un sistema critico, non come un assistente generico. Il rischio opposto è la prompt injection. Un agente collegato a email, documenti, browser, API e strumenti esterni può essere manipolato da istruzioni malevole nascoste in contenuti apparentemente innocui. Su Matrice Digitale, il tema è stato affrontato nell’articolo su Google Workspace e le difese contro le iniezioni di prompt indirette. Questo punto è decisivo: più Gemini diventa operativo, più la sicurezza deve spostarsi dal modello alla catena completa di strumenti, dati, permessi e azioni.

Gemini, ricerca conversazionale e futuro di Google Search

Gemini è anche il cuore del futuro della ricerca. Google non può limitarsi a difendere il modello classico dei risultati ordinati per link. L’arrivo dell’AI generativa ha cambiato il comportamento degli utenti, che chiedono risposte sintetiche, analisi, comparazioni, pianificazione e interazione conversazionale. La ricerca conversazionale non elimina il web, ma cambia il modo in cui il web viene interrogato. Un modello come Gemini può trasformare una query in un processo: cercare, filtrare, sintetizzare, mostrare tabelle, generare mappe concettuali, collegare immagini, documenti e contesto personale. Il rischio per editori e siti web è che la piattaforma assorba una parte crescente del valore informativo prima che l’utente arrivi alla fonte. Questo rende Gemini un tema centrale anche per il giornalismo digitale. AI Overviews, AI Mode, Search, Discover e l’integrazione con servizi Google possono ridefinire traffico, visibilità e relazione tra contenuti editoriali e piattaforma. Per questo gli aggiornamenti su Gemini non vanno letti soltanto come novità prodotto, ma come trasformazione dell’infrastruttura dell’informazione. L’articolo su Novità Google 2026: AI, Ads, Gemini e Search si inserisce proprio in questa lettura: Google usa l’AI per ripensare advertising, ricerca, assistenza personale e distribuzione dei contenuti. Gemini non è solo l’assistente di Google: è il nuovo volto con cui Google media il rapporto tra utente e web.

Gemini tra cloud, TPU e infrastruttura dell’AI

Dietro Gemini non ci sono solo modelli, ma infrastruttura. L’AI di Google si regge su data center, cloud, TPU, reti, storage, software di orchestrazione, sicurezza e capacità di inferenza su larga scala. La competizione con OpenAI, Anthropic, xAI, Meta e i modelli cinesi non riguarda solo l’intelligenza del modello, ma il costo, la latenza, la disponibilità e la capacità di distribuire AI dentro prodotti globali. Su Matrice Digitale, il caso Google, accordo con il Pentagono, Gemini e TPU v8 mostra la dimensione industriale e geopolitica dell’AI Google. La separazione tra chip orientati al training e chip per inference segnala un’evoluzione architetturale: addestrare modelli e servirli a miliardi di utenti sono problemi diversi, con costi, tempi e requisiti differenti. L’AI agentica non vive nel vuoto: richiede cloud, chip, energia, rete e governance. Gemini Enterprise Agent Platform conferma questa impostazione, perché sposta la competizione dai singoli prompt alla produzione su scala di agenti controllati, osservabili e integrati nei processi aziendali. È qui che Google prova a usare il proprio vantaggio infrastrutturale: Search, Android, Workspace, Cloud e TPU diventano una sola catena.

I limiti di Gemini: privacy, dipendenza e controllo dell’ecosistema

Gemini è potente, ma non è neutro. Più l’assistente si collega a Gmail, Calendar, Maps, YouTube, Foto, Drive e Android, più cresce il tema della privacy. Google dichiara funzioni e integrazioni pensate per aiutare l’utente, ma il problema strutturale resta: un assistente davvero utile deve conoscere molto del contesto personale, e proprio questa conoscenza aumenta la sensibilità del trattamento dei dati. Il secondo limite è la dipendenza dall’ecosistema. Gemini funziona meglio quando l’utente vive dentro Google. Questo rende l’esperienza più fluida, ma rafforza il lock-in. Android, Workspace, Search, Maps, YouTube e Cloud diventano non soltanto prodotti, ma livelli interconnessi di uno stesso ambiente AI. La comodità dell’integrazione deve essere valutata insieme al costo della dipendenza. Il terzo limite riguarda l’affidabilità. Anche i modelli più avanzati possono commettere errori, allucinare, fraintendere contesto, generare codice insicuro o produrre sintesi imprecise. In ambito enterprise, legale, sanitario, finanziario o cybersecurity, Gemini deve restare sotto supervisione umana. L’AI agentica aumenta produttività solo se l’organizzazione mantiene controllo, verifica e responsabilità finale.

Cosa leggere su Matrice Digitale per seguire l’evoluzione di Gemini

Per seguire l’evoluzione di Gemini dentro l’ecosistema Google, il percorso più utile parte da Google Gemini 3 e Nano Banana Pro e da Google Gemini 3, che ricostruiscono la fase in cui il modello entra nella nuova generazione multimodale e agentica. Per la parte mobile, il riferimento naturale è Google Android 2026: Gemini, Pixel, Play Store e software, insieme agli approfondimenti su Pixel Glow, Gemini, Maps e aggiornamenti Google e sulle nuove integrazioni in Android Auto, Wear OS e Google Meet. Per la parte enterprise e cloud, il collegamento più diretto è Gemini Enterprise e l’AI di Google: la nuova architettura del lavoro intelligente. Per la sicurezza, invece, il punto di partenza è Google Workspace blinda l’IA contro le iniezioni di prompt, perché mostra il lato difensivo della nuova AI operativa.

Google Gemini come infrastruttura dell’AI d’azione

Google Gemini rappresenta il passaggio dall’intelligenza artificiale generativa all’intelligenza artificiale d’azione. La differenza è netta. La prima produce contenuti. La seconda entra nei processi, usa strumenti, legge contesto, coordina operazioni e si integra con sistemi reali. Nel 2026, Gemini non è più solo una risposta di Google a ChatGPT o Claude: è il tentativo di trasformare l’intero ecosistema Google in una piattaforma agentica. Per l’utente Android, significa un assistente più integrato nel dispositivo. Per l’utente Workspace, significa un’AI capace di lavorare dentro documenti, email, calendari e file. Per l’impresa, significa agenti governati e osservabili dentro Google Cloud. Per la cybersecurity, significa nuovi strumenti di analisi, ma anche nuovi rischi di prompt injection, data leakage e automazioni fuori controllo.

La forza di Gemini sta nella sua posizione infrastrutturale. Google controlla Android, Search, Workspace, YouTube, Maps, Cloud, Chrome, Pixel e una parte rilevante della pubblicità digitale. Se Gemini diventa il livello AI comune tra questi servizi, non sarà più soltanto un modello: diventerà l’interfaccia attraverso cui utenti e aziende accedono al mondo digitale. La domanda decisiva, quindi, non è solo quanto Gemini sia potente rispetto a GPT-5 o Claude. La domanda è quanto Google riuscirà a trasformare Gemini in un sistema utile, sicuro, governabile e sostenibile dentro la vita quotidiana e aziendale. Chi comprende oggi Gemini comprende una parte centrale della nuova economia digitale: quella in cui l’AI non scrive soltanto risposte, ma agisce dentro infrastrutture, app, documenti, dispositivi e mercati.

FAQ su Google Gemini 2026

Che cos’è Google Gemini?

Google Gemini è la famiglia di modelli AI di Google progettata per comprendere testo, immagini, audio, video, codice e documenti dentro un unico ecosistema multimodale. Nel 2026 non è più solo un chatbot, ma un livello operativo integrato con Android, Workspace, Google Cloud e strumenti enterprise.

Gemini è meglio di ChatGPT o GPT-5?

Gemini non è sempre “meglio” di ChatGPT o GPT-5: è più forte quando l’utente lavora dentro l’ecosistema Google, soprattutto con Android, Gmail, Docs, Drive, Search, Maps, YouTube e Google Cloud. GPT-5 resta competitivo su ragionamento, coding e workflow avanzati, ma Gemini ha un vantaggio di integrazione.

Che cosa significa che Gemini è multimodale?

Gemini è multimodale perché può elaborare più formati nello stesso modello: testo, immagini, video, audio, codice e documenti. Questo permette di analizzare una schermata, riassumere un PDF, leggere codice, interpretare contenuti visivi e collegare informazioni diverse nello stesso prompt.

Gemini ha davvero una finestra di contesto da 2 milioni di token?

La finestra di contesto di Gemini dipende dal modello: Google documenta modelli con finestre da 1 milione di token e oltre, quindi il dato va sempre verificato sulla scheda tecnica aggiornata del modello usato. Non conviene fissare un numero unico senza distinguere versione, API e disponibilità.

Che differenza c’è tra Gemini Pro, Gemini Flash e Gemini Nano?

Gemini Pro è pensato per compiti complessi, Gemini Flash per velocità e bassa latenza, Gemini Nano per funzioni on-device su dispositivi compatibili. La differenza principale riguarda potenza, costo, tempi di risposta e luogo di esecuzione: cloud per i modelli più grandi, dispositivo per alcune funzioni locali.

A cosa serve Gemini su Android?

Gemini su Android serve a trasformare lo smartphone in un assistente operativo capace di comprendere contesto, app, notifiche, contenuti, immagini, video e attività quotidiane. Non si limita ai comandi vocali: può aiutare a pianificare, sintetizzare, cercare, scrivere e completare task tra più applicazioni.

Gemini sostituisce Google Assistant?

Gemini sta sostituendo progressivamente Google Assistant come interfaccia AI più avanzata per Android e servizi Google. La differenza è che Assistant eseguiva comandi, mentre Gemini interpreta contesto, contenuti e richieste complesse con una logica più conversazionale e agentica.

Che cos’è Gemini Enterprise Agent Platform?

Gemini Enterprise Agent Platform è la piattaforma Google Cloud per costruire, distribuire, governare e ottimizzare agenti AI enterprise. Serve alle aziende per creare agenti controllati, integrati nei workflow, collegati ai dati aziendali e gestiti con strumenti di sicurezza, identità, osservabilità e governance.

Gemini è sicuro per le aziende?

Gemini può essere usato in azienda solo dentro una governance chiara su dati, permessi, logging, identità, accessi, connettori e uso degli agenti. La sicurezza non dipende solo dal modello, ma da come viene integrato in Workspace, Google Cloud, SaaS, documenti interni e workflow operativi.

Come può essere usato Gemini nella cybersecurity?

Gemini può aiutare nella cybersecurity per analizzare codice sospetto, riassumere report, correlare log, supportare SOC, studiare script offuscati e accelerare il triage degli incidenti. Non sostituisce analisi forense, sandbox, reverse engineering o threat intelligence, ma può ridurre i tempi di comprensione iniziale.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.