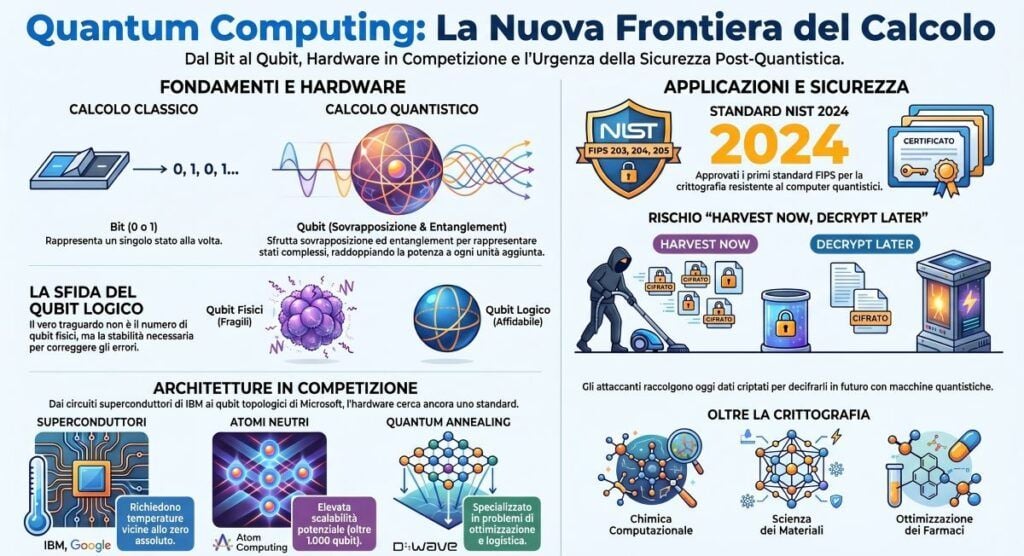

Il quantum computing non è semplicemente un’evoluzione più potente del computer classico, ma un modo diverso di rappresentare e manipolare l’informazione. Il computer tradizionale lavora con bit che assumono valore 0 oppure 1. Il computer quantistico lavora con qubit, unità fisiche e matematiche che possono essere descritte attraverso stati quantistici, sovrapposizione, entanglement e misurazione probabilistica. Questa differenza cambia il tipo di problemi affrontabili. Un computer quantistico non serve a rendere più veloce qualsiasi programma, non sostituisce il PC, il server cloud o la GPU nel lavoro quotidiano, e non esegue automaticamente meglio tutte le applicazioni. Il suo valore emerge in classi specifiche di problemi: simulazione di sistemi quantistici, chimica computazionale, materiali, ottimizzazione, alcune forme di machine learning, crittografia e calcoli dove la struttura matematica del problema può sfruttare sovrapposizione e interferenza. Il NIST spiega che, mentre un computer classico usa bit ordinari, un computer quantistico usa qubit capaci di rappresentare combinazioni di stati; ogni qubit aggiuntivo raddoppia il numero di combinazioni rappresentabili nel sistema, producendo una crescita esponenziale dello spazio degli stati. Questo non significa che il risultato finale sia “tutte le risposte insieme”, perché la misurazione restituisce un esito probabilistico, ma significa che gli algoritmi quantistici possono manipolare lo spazio delle possibilità in modo profondamente diverso dal calcolo classico.

Per questo il quantum computing è una tecnologia ancora giovane ma strategica. I grandi attori industriali, da IBM a Google, da Microsoft a D-Wave, stanno sviluppando architetture diverse, software dedicati, ambienti cloud e roadmap per superare il problema centrale: l’errore. I qubit sono fragili, rumorosi, difficili da controllare e richiedono tecniche di quantum error correction per diventare davvero utili su larga scala.

Cosa leggere

Che cos’è un qubit e perché è diverso da un bit

Il qubit, o quantum bit, è l’unità fondamentale dell’informazione quantistica. Un bit classico può essere 0 o 1. Un qubit può essere descritto come una sovrapposizione di stati, cioè una combinazione quantistica di 0 e 1 fino al momento della misurazione. Questa frase viene spesso banalizzata dicendo che il qubit “è 0 e 1 insieme”, ma la formulazione corretta è più sottile: il qubit possiede ampiezze di probabilità associate ai possibili stati, e gli algoritmi quantistici manipolano queste ampiezze per aumentare la probabilità di ottenere il risultato desiderato. Il NIST sintetizza il concetto spiegando che i qubit svolgono per i computer quantistici un ruolo analogo ai bit nei computer classici, ma sfruttano proprietà della meccanica quantistica come sovrapposizione ed entanglement. L’entanglement è l’altro concetto essenziale. Due o più qubit possono essere correlati in modo tale che lo stato dell’uno non sia descrivibile indipendentemente dallo stato dell’altro. Questo consente di costruire stati collettivi che non hanno un equivalente classico semplice. Insieme alla sovrapposizione e all’interferenza, l’entanglement permette agli algoritmi quantistici di esplorare strutture matematiche complesse in modo radicalmente diverso. Il punto decisivo è che un qubit non è un componente astratto. Deve essere realizzato fisicamente. Può essere un circuito superconduttore, uno ione intrappolato, un atomo neutro, un fotone, un difetto in un cristallo o una struttura topologica. Il tipo di qubit scelto determina hardware, software, stabilità, errore, scalabilità, temperatura di esercizio, controllo e costi dell’intero computer quantistico.

Hardware quantistico: le principali architetture

L’hardware quantistico non ha ancora uno standard definitivo. Diversi laboratori e aziende stanno seguendo strade differenti, ciascuna con vantaggi e limiti. Le principali architetture includono qubit superconduttori, ioni intrappolati, atomi neutri, fotonica quantistica, quantum annealing e qubit topologici.

Qubit superconduttori

I qubit superconduttori sono tra le architetture più sviluppate a livello industriale. IBM e Google lavorano da anni su sistemi basati su circuiti superconduttori, controllati con impulsi a microonde e raffreddati a temperature estremamente basse. IBM spiega che i suoi processori quantistici devono funzionare a circa un centesimo di grado sopra lo zero assoluto, dentro criostati complessi progettati per mantenere condizioni ultra-fredde e stabili. Il vantaggio di questa tecnologia è la compatibilità con una parte dell’ingegneria dei chip e la possibilità di costruire processori con un numero crescente di qubit. IBM ha presentato Condor, un processore quantistico da 1.121 qubit superconduttori, come tappa della propria roadmap verso sistemi più grandi e utili. Il limite è la fragilità. I qubit superconduttori sono sensibili al rumore, richiedono criogenia estrema, controllo preciso e correzione degli errori. Per passare da molti qubit fisici a pochi qubit logici affidabili serve una grande quantità di ridondanza.

Ioni intrappolati

Gli ioni intrappolati usano atomi caricati elettricamente, mantenuti in trappole elettromagnetiche e controllati con laser. Questa architettura è apprezzata per la qualità dei qubit e per tempi di coerenza spesso elevati. Il limite principale riguarda la scalabilità ingegneristica: controllare molti ioni, collegare moduli e mantenere velocità operativa competitiva resta una sfida complessa. Gli ioni intrappolati sono spesso considerati promettenti per la qualità delle operazioni, ma la domanda industriale resta aperta: meglio pochi qubit molto buoni o molti qubit più rumorosi ma più facili da scalare? La risposta non è ancora definitiva, perché il valore reale dipenderà dal rapporto tra numero di qubit fisici, qualità delle porte, correzione degli errori e architettura software.

Atomi neutri

Gli atomi neutri sono una delle traiettorie più dinamiche. In questa architettura, gli atomi vengono intrappolati e organizzati tramite laser, creando array molto grandi. Matrice Digitale ha seguito questo tema nell’articolo Nuova tecnologia abilita computer quantistici da un milione di qubit, dedicato alle cavità ottiche e alla possibilità di migliorare lettura, comunicazione e scalabilità nei sistemi ad atomi neutri. La forza degli atomi neutri è la scalabilità potenziale. Matrice Digitale aveva già raccontato il caso Atom Computing e il computer quantistico da 1.180 qubit, sottolineando il passaggio dai sistemi da 100 qubit a un ordine di grandezza superiore, pur con il problema ancora aperto degli errori.

Fotonica quantistica

La fotonica quantistica usa particelle di luce, cioè fotoni, come vettori dell’informazione quantistica. Questa architettura è interessante perché i fotoni sono naturalmente adatti alla comunicazione e potrebbero avere un ruolo forte nelle reti quantistiche. Il problema è costruire operazioni logiche robuste e scalabili, integrando sorgenti, rivelatori, circuiti ottici e correzione degli errori. La fotonica potrebbe diventare decisiva anche per collegare moduli quantistici separati, costruendo reti e sistemi distribuiti. In una visione di lungo periodo, il computer quantistico potrebbe non essere un singolo chip monolitico, ma una rete di moduli connessi da canali quantistici e classici.

Quantum annealing

Il quantum annealing è una forma diversa di calcolo quantistico, orientata soprattutto a problemi di ottimizzazione. D-Wave spiega che l’annealing quantistico usa la fisica quantistica per cercare stati a bassa energia di un problema, corrispondenti a soluzioni ottimali o quasi ottimali. Questa tecnologia non va confusa con il calcolo quantistico universale a porte logiche. Il quantum annealing è più specializzato: può essere utile per problemi di ottimizzazione combinatoria, scheduling, logistica, energia e ricerca operativa, ma non copre automaticamente lo stesso spettro teorico dei computer quantistici gate-based. Il tema è stato intercettato anche da Matrice Digitale nel racconto di ComoLake 2025, dove l’accordo tra Swiss Quantum Technology e D-Wave Quantum per un sistema da oltre 4.400 qubit e valore di 10 milioni di euro è stato presentato come segnale del posizionamento europeo nell’innovazione quantistica.

Qubit topologici

I qubit topologici rappresentano una delle strade più ambiziose. Microsoft ha annunciato Majorana 1, descritto come una QPU basata su un “Topological Core” e progettata per scalare verso milioni di qubit su singolo chip. Secondo Microsoft, il progetto usa una nuova classe di materiali, chiamati topoconductors, per realizzare qubit topologici più piccoli, rapidi e controllabili digitalmente. Questa architettura promette maggiore protezione hardware contro gli errori, ma resta anche una delle più discusse e difficili da validare. La prospettiva è potente: se i qubit topologici fossero davvero più stabili, il costo della correzione degli errori potrebbe ridursi. Ma il passaggio dall’annuncio scientifico alla macchina quantistica utile richiede ancora prove, benchmark, riproducibilità e scalabilità ingegneristica.

Software quantistico: dagli algoritmi ai circuiti

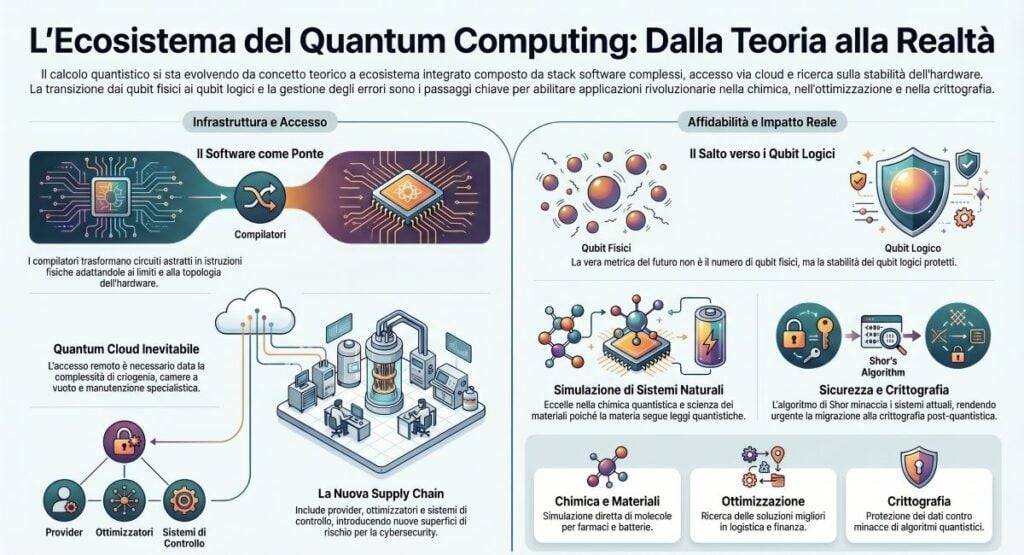

Il software quantistico è il livello che permette di trasformare un problema in istruzioni eseguibili su hardware quantistico. Non si programma un computer quantistico come un normale server. Il calcolo viene espresso spesso come circuito quantistico, composto da porte quantistiche che manipolano lo stato dei qubit, oppure come problema di ottimizzazione nel caso del quantum annealing. IBM presenta Qiskit come lo strumento software centrale della propria piattaforma quantistica, insieme all’accesso cloud ai computer quantistici. IBM Quantum viene definito dal gruppo come provider full-stack con accesso a computer quantistici da oltre 100 qubit e strumenti software Qiskit. Il software quantistico comprende più livelli. Alla base ci sono librerie e linguaggi per descrivere circuiti. Poi ci sono compilatori che trasformano circuiti astratti in istruzioni compatibili con uno specifico hardware. Seguono scheduler, ottimizzatori, simulazioni classiche, strumenti di mitigazione degli errori, sistemi di controllo e integrazione con cloud, HPC e AI. Il punto decisivo è che il software quantistico deve conoscere i limiti dell’hardware. Ogni processore ha una topologia, una connettività tra qubit, tassi di errore, tempi di coerenza e vincoli operativi. Un circuito teorico perfetto può diventare inefficiente o rumoroso quando viene mappato su un dispositivo reale. Per questo il compilatore quantistico è una parte essenziale dello stack.

Quantum cloud: perché oggi il computer quantistico si usa da remoto

La maggior parte degli utenti non possiede un computer quantistico. Accede a sistemi quantistici tramite cloud. IBM Quantum Platform offre accesso a computer quantistici, documentazione Qiskit e risorse di apprendimento in un unico ambiente. Questo modello è inevitabile perché l’hardware quantistico richiede criogenia, camere a vuoto, laser, sistemi di controllo, calibrazione, isolamento e manutenzione specialistica. Il quantum cloud consente a ricercatori, aziende, università e sviluppatori di eseguire esperimenti senza possedere fisicamente la macchina. Il cloud quantistico introduce però nuove superfici di rischio. Matrice Digitale lo ha affrontato nell’articolo Computer quantistici vulnerabili: attacchi hardware e software, dove vengono discussi rischi come crosstalk, furto di proprietà intellettuale nei circuiti, manipolazione dello stack quantistico e limiti delle difese classiche. Il quantum cloud non è solo accesso remoto a una macchina rara, ma una nuova supply chain tecnologica. Dentro lo stack ci sono provider, compilatori, librerie, ottimizzatori, code di esecuzione, hardware specializzato e sistemi classici di controllo. Proteggere tutto questo richiederà una cybersecurity specifica per ambienti quantistici.

Quantum error correction: il vero collo di bottiglia

Il problema principale del quantum computing è l’errore. I qubit fisici sono instabili, sensibili al rumore, alla decoerenza e alle interferenze. Per costruire un computer quantistico utile serve passare dai qubit fisici ai qubit logici, cioè qubit protetti tramite codici di correzione degli errori. Google ha presentato Willow come un chip quantistico capace di dimostrare progressi importanti nella correzione degli errori. Google Quantum AI afferma che Willow è un passo verso un computer quantistico su larga scala e corretto dagli errori, e il blog di ricerca descrive Willow come primo processore in cui i qubit corretti dagli errori migliorano esponenzialmente al crescere della dimensione. Questo passaggio è centrale perché il numero di qubit fisici non basta. Un processore da molti qubit può essere meno utile di un sistema più piccolo ma più stabile, se gli errori impediscono l’esecuzione di circuiti profondi. La vera metrica del futuro non sarà solo quanti qubit ha un computer, ma quanti qubit logici affidabili riesce a sostenere e per quante operazioni. IBM ha annunciato progressi sulla correzione degli errori anche lato software e controllo classico, con l’esecuzione di un algoritmo di correzione su chip convenzionali AMD FPGA, come parte del percorso verso sistemi quantistici commercialmente utili.

A cosa serve davvero il quantum computing

Il quantum computing è promettente soprattutto dove i computer classici faticano a simulare sistemi quantistici o a esplorare spazi combinatori enormi. Le aree più citate sono chimica quantistica, scienza dei materiali, farmaci, batterie, ottimizzazione industriale, logistica, finanza quantitativa, machine learning quantistico e crittografia. La simulazione di molecole e materiali è uno dei casi più naturali, perché la materia è già governata da leggi quantistiche. Un computer quantistico può rappresentare alcuni sistemi fisici in modo più diretto rispetto a un computer classico. Questo può avere impatti su catalizzatori, nuovi materiali, batterie, farmaci e processi industriali. L’ottimizzazione è un altro settore chiave, soprattutto per quantum annealing e approcci ibridi. D-Wave posiziona i propri sistemi proprio su problemi di ottimizzazione, dove l’obiettivo è trovare stati a energia minima associati alle soluzioni migliori. La crittografia è il campo più sensibile. Alcuni algoritmi quantistici, in particolare Shor, minacciano gli schemi di crittografia asimmetrica usati oggi. Questo non significa che i computer quantistici attuali possano già rompere RSA o ECC su larga scala, ma significa che la migrazione alla crittografia post-quantistica deve iniziare prima che esista una macchina crittograficamente rilevante.

Crittografia post-quantistica e rischio per Bitcoin, blockchain e sicurezza

Il quantum computing non è solo un tema di ricerca. È già un tema di cybersecurity. Il NIST ha approvato nel 2024 i primi tre standard federali per la crittografia post-quantistica: FIPS 203, FIPS 204 e FIPS 205, basati rispettivamente su ML-KEM, ML-DSA e SLH-DSA. Questo passaggio segna l’inizio della migrazione verso algoritmi resistenti ai futuri computer quantistici. Il problema non è solo “quando arriverà” un computer capace di rompere la crittografia attuale. Il problema è anche harvest now, decrypt later: un attaccante può raccogliere oggi comunicazioni cifrate e conservarle in attesa di decifrarle quando la tecnologia quantistica sarà abbastanza matura. Matrice Digitale ha affrontato il tema nel pezzo Crittografia post-quantistica e end-to-end: innovazioni da Signal e Gmail, dove viene spiegato il passaggio di Signal verso uno schema ibrido con ML-KEM 768 e il rafforzamento della messaggistica end-to-end contro minacce future. Il rischio riguarda anche blockchain e criptovalute. Matrice Digitale ha trattato la questione nell’articolo Jefferies rimuove Bitcoin dal portafoglio: i rischi del quantum computing cambiano la strategia, dove il quantum computing viene letto come uno spartiacque per gli investitori istituzionali e per la sicurezza degli asset digitali.

Articoli dedicati di Matrice Digitale sul quantum computing

Per costruire un percorso interno coerente sul tema, gli articoli già pubblicati da Matrice Digitale possono essere organizzati in tre blocchi. Il primo blocco riguarda hardware e qubit. Qui rientrano Nuova tecnologia abilita computer quantistici da un milione di qubit, Atom Computing annuncia un computer quantistico da 1.180 qubit e Caltech stabilisce record con array di 6100 qubit. Questi testi aiutano a spiegare la differenza tra quantità di qubit, scalabilità, architetture fisiche e problemi di errore. Il secondo blocco riguarda sicurezza, vulnerabilità e software quantistico. Il riferimento principale è Computer quantistici vulnerabili: attacchi hardware e software, utile per spiegare perché lo stack quantistico introduce rischi diversi da quelli classici: crosstalk, IP theft, supply chain software, compilatori, librerie e accesso via cloud. Il terzo blocco riguarda post-quantum, crypto e impatti economici. Qui rientrano Crittografia post-quantistica e end-to-end, Jefferies rimuove Bitcoin dal portafoglio per rischio quantum, BlackRock accumula cripto e Solana si prepara al post-quantum e Fedora 44, openSUSE e crittografia post-quantum. Questi articoli collegano il quantum computing alla cybersicurezza concreta, alle criptovalute e all’evoluzione dello stack open source.

Hardware e software devono crescere insieme

Il futuro del quantum computing non dipende solo dall’hardware. Un chip con molti qubit non basta se il software non riesce a compilare circuiti efficienti, mitigare errori, gestire rumore, orchestrare workflow ibridi e collegare calcolo quantistico, HPC e AI. Matrice Digitale ha trattato proprio l’integrazione tra AI, HPC e qubit logici nel contesto Microsoft e Quantinuum, mostrando come il calcolo quantistico utile passi spesso da architetture ibride, dove computer classici, AI e sistemi quantistici collaborano invece di sostituirsi. Il computer quantistico utile sarà probabilmente un sistema ibrido, non una macchina isolata. Il processore quantistico risolverà sottoproblemi specifici. Il computer classico gestirà controllo, pre-processing, ottimizzazione, correzione degli errori, orchestrazione e analisi dei risultati. Il software sarà quindi il vero ponte tra promessa fisica e applicazione industriale.

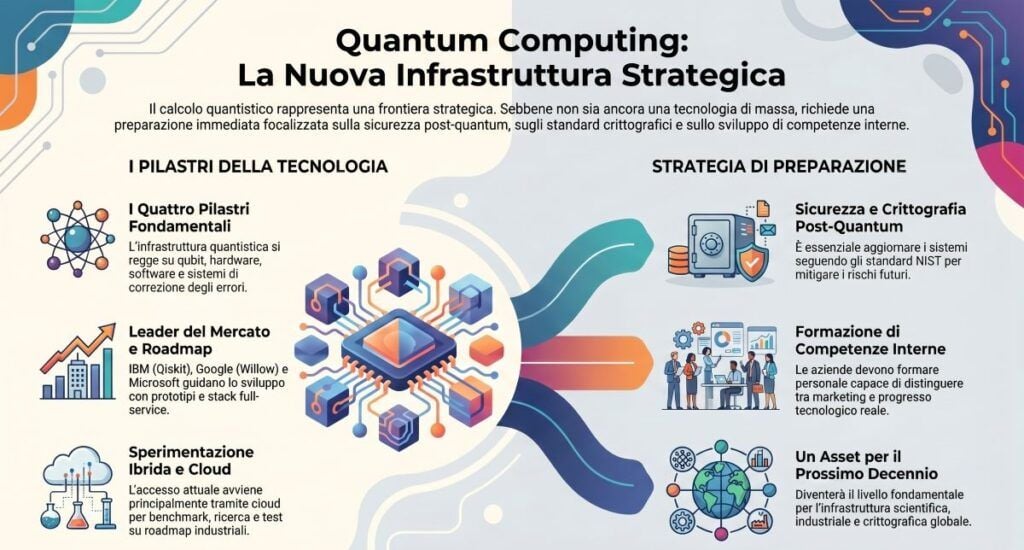

Il quantum computing come nuova frontiera dell’infrastruttura digitale

Il quantum computing non è ancora una tecnologia di massa, ma è già una frontiera strategica. La sua importanza non deriva dalla promessa generica di computer “più veloci”, ma dalla possibilità di affrontare problemi che i sistemi classici gestiscono male o non possono scalare in modo efficiente. Qubit, hardware, software e correzione degli errori sono i quattro pilastri della nuova computazione quantistica. La fase attuale è ancora dominata da ricerca, prototipi, accesso cloud, benchmark, roadmap industriali e sperimentazioni ibride. Ma i segnali sono chiari: IBM sviluppa stack full-service con hardware e Qiskit, Google spinge su Willow e correzione degli errori, Microsoft punta sui qubit topologici, D-Wave presidia l’annealing e gli atomi neutri mostrano potenziale di scalabilità. La conseguenza più immediata per aziende, governi e cybersecurity non è comprare subito computer quantistici, ma prepararsi. Bisogna capire il rischio post-quantum, aggiornare la crittografia, seguire gli standard NIST, formare competenze e distinguere tra marketing e progresso reale. Il quantum computing non è ancora il nuovo cloud, ma potrebbe diventare uno dei livelli più importanti dell’infrastruttura scientifica, industriale e crittografica del prossimo decennio.

FAQ sul quantum computing

Che cos’è il quantum computing?

Il quantum computing è un modello di calcolo che usa qubit e proprietà quantistiche come sovrapposizione, entanglement e interferenza per risolvere alcune classi di problemi in modo diverso dai computer classici. Non sostituisce tutti i computer, ma può diventare decisivo in chimica, materiali, ottimizzazione e crittografia.

Che cos’è un qubit?

Un qubit è l’unità base dell’informazione quantistica, analoga al bit ma capace di rappresentare stati quantistici più complessi rispetto al semplice 0 o 1 classico. Il suo valore operativo dipende da sovrapposizione, entanglement, misurazione probabilistica e controllo fisico del sistema.

Perché i qubit sono difficili da usare?

I qubit sono difficili da usare perché sono fragili, rumorosi e sensibili all’ambiente. Possono perdere coerenza, accumulare errori e richiedere temperature estreme, laser, criostati, trappole elettromagnetiche o controlli molto precisi a seconda dell’architettura hardware scelta.

Qual è la differenza tra qubit fisico e qubit logico?

Un qubit fisico è il componente quantistico reale; un qubit logico è un qubit affidabile ottenuto combinando molti qubit fisici tramite correzione degli errori. La corsa al quantum computing utile dipende soprattutto dalla capacità di creare qubit logici stabili, non solo dall’aumentare il numero di qubit fisici.

Quali sono le principali architetture hardware quantistiche?

Le principali architetture includono qubit superconduttori, ioni intrappolati, atomi neutri, fotonica, quantum annealing e qubit topologici. IBM e Google lavorano molto sui superconduttori, D-Wave sull’annealing, Microsoft sui qubit topologici, mentre gli atomi neutri stanno crescendo come strada scalabile.

A cosa serve il software quantistico?

Il software quantistico serve a trasformare problemi in circuiti, istruzioni o modelli eseguibili su hardware quantistico reale o simulato. Include linguaggi, librerie, compilatori, simulatori, ottimizzatori, strumenti di mitigazione degli errori e piattaforme cloud come Qiskit nell’ecosistema IBM Quantum.

I computer quantistici possono già rompere Bitcoin o RSA?

No, i computer quantistici attuali non risultano ancora capaci di rompere su larga scala RSA, ECC o la sicurezza di Bitcoin, ma il rischio futuro è abbastanza serio da imporre la migrazione post-quantum. Per questo NIST ha già pubblicato standard crittografici resistenti al quantum.

Che cos’è la crittografia post-quantistica?

La crittografia post-quantistica è l’insieme di algoritmi progettati per resistere ad attacchi eseguiti da futuri computer quantistici. Nel 2024 NIST ha approvato i primi standard FIPS 203, 204 e 205, segnando l’avvio della transizione verso schemi quantum-safe.

Il quantum computing è già utile per le aziende?

Oggi il quantum computing è utile soprattutto per ricerca, sperimentazione, prototipi, ottimizzazione ibrida e preparazione strategica. Le aziende devono seguirlo, ma senza aspettarsi che sostituisca subito cloud, GPU o HPC tradizionale. La fase decisiva sarà l’arrivo di qubit logici affidabili.

Perché il quantum computing è importante per la cybersecurity?

Il quantum computing è importante per la cybersecurity perché minaccia alcuni schemi crittografici attuali e introduce nuove superfici di attacco nello stack quantistico. I rischi includono crittografia vulnerabile nel futuro, furto di circuiti, crosstalk, cloud quantistico e compromissione di compilatori o librerie.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.