Berkeley AI Research introduce Adaptive Parallel Reasoning, il nuovo paradigma che permette ai modelli di linguaggio di decidere dinamicamente quando e come parallelizzare il ragionamento durante l’inferenza. Il metodo, denominato APR, supera i limiti del ragionamento sequenziale tradizionale che accumula contesto inutilmente e genera latenza elevata su task complessi. Invece di procedere passo dopo passo in una sola catena causale, il modello genera più thread indipendenti, li esegue in parallelo e li coordina soltanto nella fase finale. Questo approccio riduce drasticamente la latenza, evita il fenomeno del context-rot e ottimizza l’uso del compute senza sacrificare accuratezza. Stephen Xie e Long (Tony) Lian di BAIR presentano due implementazioni concrete chiamate ThreadWeaver e Multiverse. I risultati sperimentali mostrano che APR scala meglio sui modelli da trilioni di parametri e rende l’inferenza più efficiente su hardware reali. L’innovazione arriva in un momento in cui i grandi modelli linguistici affrontano task sempre più complessi e i costi computazionali diventano difficili da sostenere. Adaptive Parallel Reasoning segna così il passaggio da un ragionamento lineare a un’inferenza adattiva e parallela con impatti diretti su velocità, costi e scalabilità dell’intelligenza artificiale.

Cosa leggere

Il ragionamento sequenziale limita i modelli di linguaggio attuali

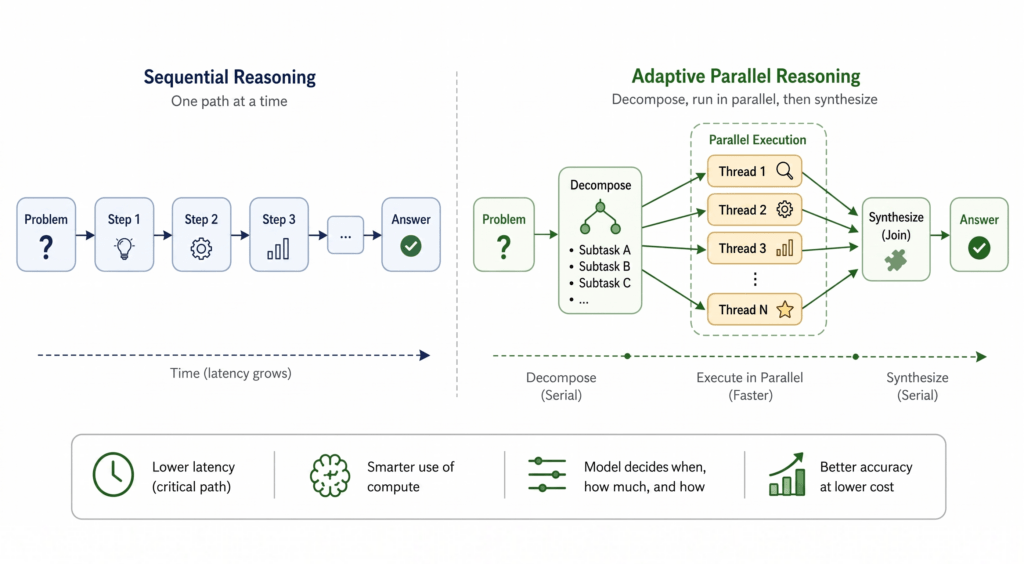

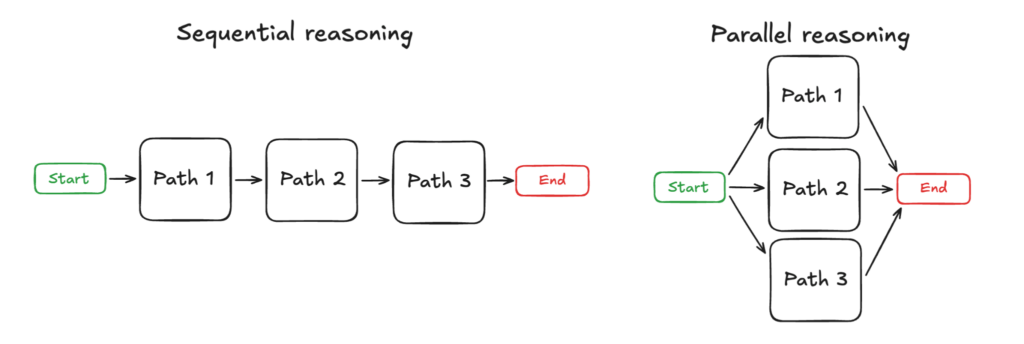

I moderni LLM ragionano in modo prevalentemente sequenziale: generano un token alla volta e accumulano tutto il contesto in una singola catena causale. Questo approccio funziona bene per task relativamente semplici ma mostra limiti evidenti quando il problema richiede esplorazione ampia, pianificazione o molteplici percorsi logici. Il contesto cresce rapidamente, la latenza aumenta in modo lineare e il modello rischia di perdere informazioni precedenti man mano che la finestra contestuale si espande. Nei task che richiedono decine o centinaia di passi intermedi, l’utente può attendere minuti o addirittura ore. Anche il costo computazionale cresce perché ogni passo dipende strettamente dal precedente e non può essere eseguito in parallelo. Berkeley AI Research identifica questo comportamento come uno dei principali colli di bottiglia dell’inferenza moderna. Il ragionamento sequenziale non sfrutta appieno l’hardware parallelo contemporaneo e spreca risorse computazionali su percorsi ridondanti o poco informativi. APR nasce proprio per superare questi limiti e trasformare il modo in cui i modelli organizzano il ragionamento.

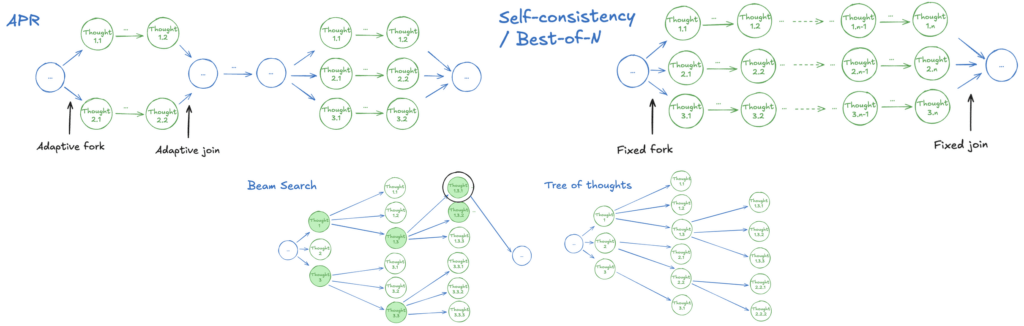

Adaptive Parallel Reasoning introduce una struttura fork-join dinamica

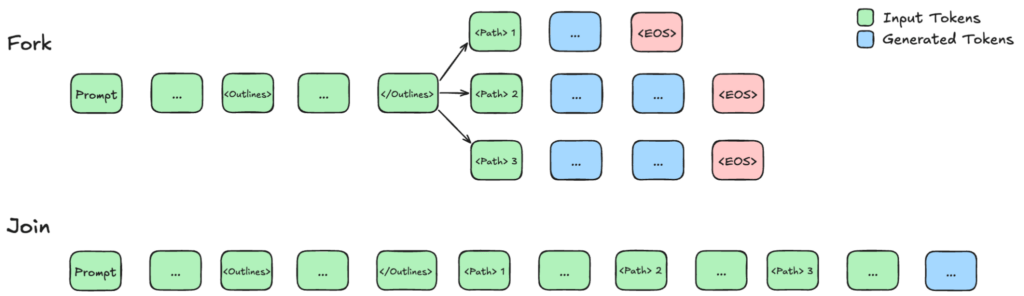

Adaptive Parallel Reasoning permette al modello stesso di decidere quando parallelizzare il ragionamento. Durante la generazione, il LLM emette token speciali come <Parallel> per indicare un punto di fork. In quel momento il sistema crea più thread indipendenti che esplorano sottotask differenti in parallelo. Ogni thread procede autonomamente fino a un token di chiusura o al raggiungimento della lunghezza massima consentita. Alla fine dell’elaborazione i thread vengono aggregati in una fase di join che produce la risposta finale coordinata. Questa struttura fork-join ricorda un paradigma map-reduce ma viene controllata direttamente dal modello invece che da logiche esterne. Il vantaggio principale consiste nel fatto che i thread non accumulano contesto reciproco durante l’esecuzione parallela.

Questo evita il context-rot, riduce la lunghezza della sequenza critica e migliora la scalabilità dell’inferenza. Il modello impara inoltre a scegliere il numero ottimale di thread e la profondità del parallelismo in base alla complessità del problema. Per task semplici il sistema può restare quasi completamente sequenziale, mentre nei problemi complessi genera molteplici percorsi concorrenti.

ThreadWeaver implementa APR senza modificare il motore di inferenza

ThreadWeaver rappresenta l’approccio client-side di APR e non richiede modifiche profonde al motore di inferenza. Il sistema concatena i thread in una sequenza unica dopo la fase di prefill ed esegue una seconda prefill per sintetizzare la risposta finale. Durante il training utilizza una maschera di attenzione ancestor-only che simula il comportamento dell’inferenza reale. Questo approccio impedisce ai thread di accedere a informazioni future o provenienti da thread paralleli. ThreadWeaver accetta una piccola ridondanza computazionale nella fase di prefill perché quest’ultima resta molto più economica del decoding vero e proprio. Il risultato è una soluzione pratica e relativamente semplice da adottare sulle infrastrutture esistenti senza dover riprogettare il backend di inferenza. Gli esperimenti mostrano che ThreadWeaver mantiene accuratezza comparabile ai baseline sequenziali tradizionali riducendo sensibilmente la latenza end-to-end. Questa implementazione risulta particolarmente interessante per organizzazioni che vogliono introdurre parallelismo adattivo senza intervenire direttamente sul runtime dei modelli.

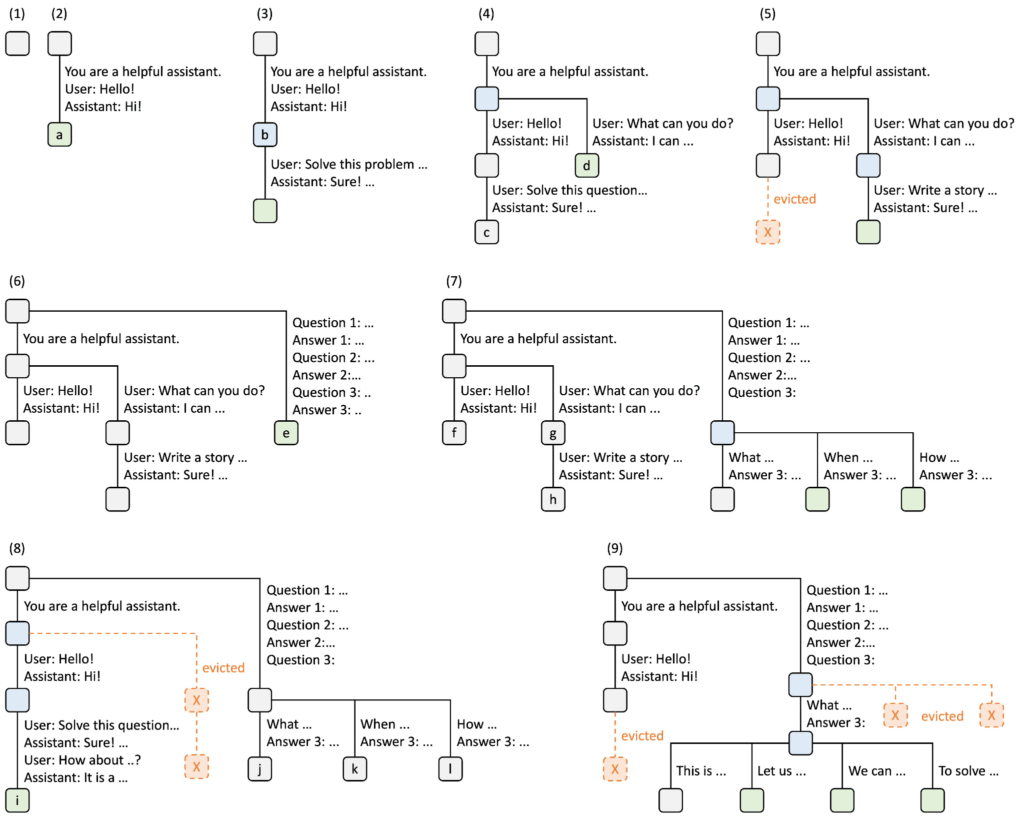

Multiverse riutilizza la KV cache con strutture radix tree

Multiverse rappresenta invece la variante più aggressiva di APR e modifica direttamente il motore di inferenza per riutilizzare la KV cache attraverso una struttura radix tree. Questo approccio permette di condividere prefissi comuni tra thread differenti senza doverli ricalcolare continuamente. Durante la sintesi finale il sistema ricuce blocchi di memoria non contigui in modo trasparente per il modello. L’obiettivo consiste nell’eliminare ridondanze computazionali e ridurre ulteriormente la latenza rispetto a ThreadWeaver. Tuttavia questa soluzione richiede una gestione molto più sofisticata delle maschere di attenzione e della memoria cache. Multiverse ottiene tempi di inferenza inferiori proprio perché evita la seconda prefill completa necessaria in ThreadWeaver. Le due implementazioni dimostrano quindi che APR può essere integrato in modalità differenti a seconda dei vincoli infrastrutturali, delle esigenze di latenza e del livello di controllo sul motore di inferenza.

APR apprende il parallelismo tramite SFT e Reinforcement Learning

Il training di Adaptive Parallel Reasoning combina Supervised Fine-Tuning e Reinforcement Learning. Nella fase iniziale di SFT il modello apprende la sintassi dei token di controllo e osserva esempi di flussi paralleli. Successivamente il Reinforcement Learning raffina il comportamento tramite un reward che privilegia prima la correttezza e poi l’efficienza della parallelizzazione. La metrica di parallelizzazione misura la lunghezza del critical path rispetto al numero totale di token generati. Questo reward viene però subordinato alla correttezza della risposta per evitare che il modello riduca il compute sacrificando accuratezza. Il framework Parallel-R1 mostra che l’uso di strutture parallele cresce dal 13,6 per cento al 63 per cento durante il training. Il sistema NPR, denominato Genuine Parallelism Rate, ottimizza addirittura per il 100 per cento di parallelismo trattando il fallback sequenziale come un fallimento. Questi meccanismi permettono ai modelli di sviluppare strategie emergenti come self-verification parallela, esplorazione simultanea di percorsi multipli e validazione incrociata delle risposte.

APR supera Chain-of-Thought e Best-of-N nei task complessi

Gli esperimenti confrontano APR con approcci consolidati come Chain-of-Thought, self-consistency, Best-of-N, Tree-of-Thoughts e Monte-Carlo Tree Search. I risultati mostrano che Adaptive Parallel Reasoning ottiene accuratezza superiore o equivalente ai baseline sotto vincoli di contesto fisso, riducendo però significativamente la latenza end-to-end. Multiverse offre i guadagni maggiori nei contesti limitati, mentre ThreadWeaver mantiene prestazioni solide senza richiedere modifiche infrastrutturali invasive. A differenza di Best-of-N, APR evita la ridondanza perché genera sottotask differenti e non copie quasi identiche dello stesso percorso di ragionamento. Rispetto a Tree-of-Thoughts, il sistema non richiede euristiche specifiche per dominio ma apprende strategie generali di decomposizione direttamente durante il training. I risultati confermano quindi che il parallelismo adattivo scala meglio su task complessi e riduce il compute complessivo mantenendo elevata la qualità delle risposte.

Adaptive Parallel Reasoning cambia il paradigma dell’inferenza AI

Adaptive Parallel Reasoning rappresenta un cambio di paradigma nell’inferenza dei modelli di linguaggio. Il controllo del ragionamento passa dal prompting esterno al modello stesso, che decide dinamicamente come organizzare la strategia di esplorazione. Questo approccio rende l’inferenza più efficiente, scalabile e adattiva rispetto alla complessità del problema affrontato. I costi computazionali diminuiscono mentre la latenza si riduce in modo significativo grazie all’accorciamento della sequenza critica. APR apre inoltre la strada a modelli più profondi e ricorsivi capaci di sfruttare parallelismo nativo senza dipendere esclusivamente da scaling hardware lineare. Le implementazioni engine-agnostic come ThreadWeaver facilitano l’adozione immediata mentre soluzioni più avanzate come Multiverse massimizzano l’efficienza dell’hardware esistente. Berkeley AI Research sottolinea anche il potenziale di APR come scaffold durante il training per aumentare la diversità di esplorazione e migliorare l’apprendimento strategico dei modelli.

Berkeley AI Research apre una nuova fase per i modelli da trilioni di parametri

L’evoluzione dei modelli di linguaggio verso dimensioni sempre più grandi rende inevitabile una revisione del paradigma di inferenza tradizionale. Adaptive Parallel Reasoning affronta direttamente il problema della scalabilità cognitiva degli LLM, trasformando il ragionamento da processo lineare a sistema distribuito e adattivo. Con modelli da trilioni di parametri, il limite non riguarda più soltanto il numero di GPU disponibili ma la capacità di utilizzare il compute in modo efficiente senza accumulare contesto inutile. APR dimostra che parallelizzare il ragionamento non significa semplicemente eseguire più processi contemporaneamente, ma permettere al modello di organizzare autonomamente la propria strategia cognitiva. Questa transizione potrebbe influenzare profondamente future architetture AI, framework di inferenza e hardware specializzati. Il lavoro di Berkeley AI Research lascia ancora aperte domande su stabilità del training, integrazione hardware-aware e scheduling ottimale, ma definisce già una direzione chiara: il futuro dei grandi modelli linguistici sarà sempre meno sequenziale e sempre più adattivo, parallelo e distribuito.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.