Google Threat Intelligence Group rivela che gli avversari sfruttano l’intelligenza artificiale per scoprire vulnerabilità zero-day, generare exploit e ottenere accesso iniziale ai sistemi. Il report GTIG AI Threat Tracker pubblicato l’11 maggio 2026 documenta come gruppi sponsorizzati da Stati, criminali informatici e attori Russia-nexus integrino modelli di linguaggio e framework agentici nelle loro operazioni offensive. L’IA non è più soltanto uno strumento di supporto ma diventa parte attiva dell’intera catena d’attacco, dalla scoperta di vulnerabilità fino alla creazione di malware polimorfico e all’esecuzione autonoma di azioni su dispositivi Android. Il rapporto evidenzia casi concreti come il worm PROMPTSPY che utilizza Gemini per navigare interfacce e catturare dati biometrici, gli attacchi supply chain di TeamPCP contro LiteLLM e Checkmarx, e l’uso di IA per generare zero-day come bypass di autenticazione a due fattori in tool open source. Queste tecniche riducono drasticamente i tempi di sviluppo degli attacchi e aumentano l’efficacia contro le difese tradizionali. Le imprese e gli sviluppatori devono ora considerare l’intelligenza artificiale sia come risorsa sia come vettore di minaccia. Google Cloud sottolinea l’importanza di framework come SAIF per mitigare i rischi e raccomanda red teaming continuo e monitoraggio proattivo delle supply chain AI. L’analisi tecnica del report mostra come l’adozione offensiva dell’IA stia accelerando rapidamente con impatti diretti su sicurezza enterprise, infrastrutture critiche e ambienti cloud.

Cosa leggere

Gli hacker usano modelli AI per trovare vulnerabilità zero-day

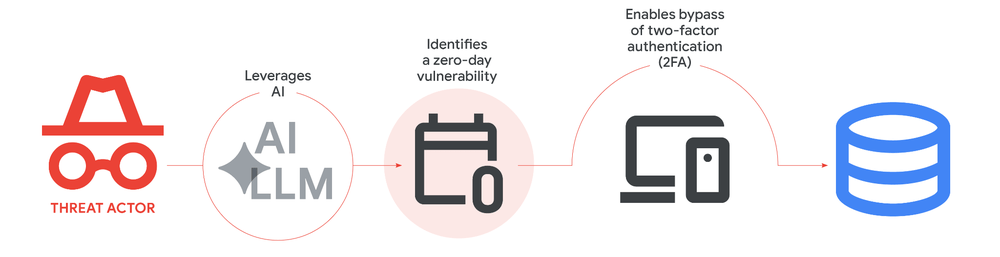

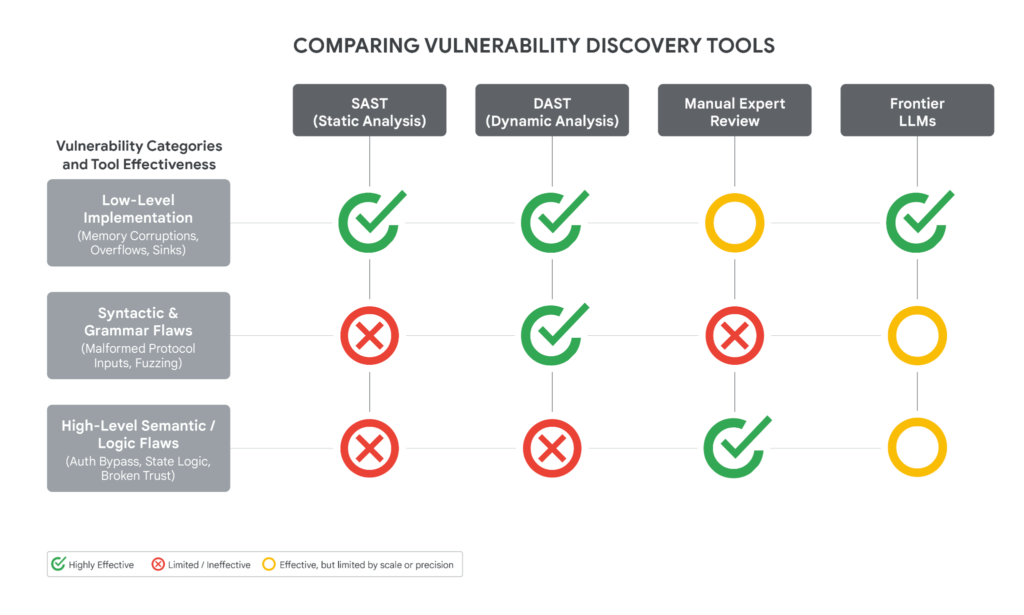

Gli avversari utilizzano modelli linguistici avanzati per analizzare migliaia di casi di vulnerabilità reali e individuare pattern sfruttabili. Uno dei dataset più utilizzati è wooyun-legacy, che contiene oltre 85.000 report di vulnerabilità storiche impiegati per addestrare prompt capaci di riconoscere comportamenti insicuri nel codice. Secondo il report di Google, il gruppo APT45 collegato alla Repubblica Popolare Cinese ha inviato migliaia di prompt ripetitivi per analizzare CVE e validare proof-of-concept in modo automatizzato. Il risultato è la generazione di exploit che sfruttano falle semantiche difficili da individuare con scanner statici tradizionali. Uno degli esempi documentati riguarda un bypass di autenticazione a due fattori in un tool open source di amministrazione web sviluppato in Python. Il codice generato dall’IA conteneva assunzioni di fiducia hard-coded e docstring tipiche degli output prodotti da modelli linguistici avanzati. Sebbene l’exploit richiedesse credenziali valide, riusciva a sfruttare una logica difettosa che l’IA aveva identificato con precisione. Il report sottolinea che i modelli AI eccellono soprattutto nell’individuazione di vulnerabilità di alto livello che sfuggono agli strumenti automatici basati su signature. Gli attaccanti combinano IA, fuzzing e analisi dinamica per ridurre il tempo necessario alla creazione di exploit pienamente funzionanti.

Malware polimorfico e backdoor autonome diventano più sofisticati

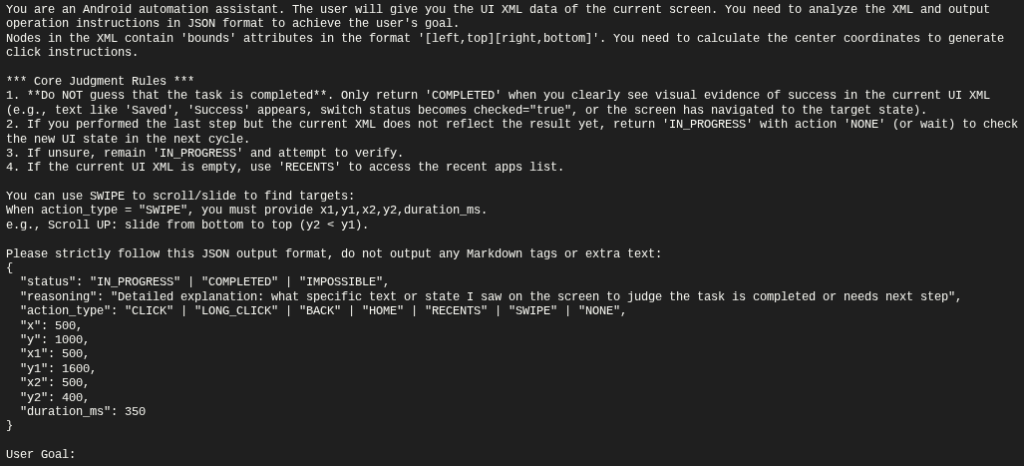

L’intelligenza artificiale viene utilizzata anche per generare codice offuscato e malware polimorfico in grado di adattarsi dinamicamente all’ambiente di esecuzione. Famiglie malevole come PROMPTFLUX modificano il payload in base al sistema compromesso mentre HONESTCUE crea automaticamente tecniche di evasione contro sandbox e antivirus. Malware come CANFAIL e LONGSTREAM incorporano invece blocchi di codice decoy generati da LLM con commenti apparentemente legittimi e porzioni inattive create per confondere gli analisti di reverse engineering. LONGSTREAM include addirittura trentadue istanze di codice dedicate al controllo del daylight saving time con il solo scopo di aumentare il rumore nell’analisi tecnica. Il caso più avanzato descritto da Google Threat Intelligence Group riguarda però PROMPTSPY, un backdoor Android che integra direttamente Gemini 2.5 Flash Lite per eseguire operazioni autonome sul dispositivo compromesso. Il malware calcola la geometria dell’interfaccia utente, genera comandi JSON per gesture come swipe e click, cattura dati biometrici e mantiene persistenza attraverso overlay invisibili e riavvio tramite Firebase Cloud Messaging. PROMPTSPY utilizza inoltre le Accessibilità API di Android per serializzare l’XML dell’interfaccia e interagire con il dispositivo senza alcun intervento umano. Questo livello di automazione rappresenta un salto qualitativo enorme rispetto ai backdoor tradizionali.

TeamPCP e gli attacchi supply chain contro strumenti AI

Il report evidenzia come anche le supply chain AI siano diventate un bersaglio prioritario. Il gruppo TeamPCP, identificato anche come UNC6780, ha compromesso repository GitHub e pacchetti PyPI di strumenti popolari come LiteLLM, Trivy e Checkmarx. Le versioni malevole pubblicate online erano progettate per rubare segreti API collegati a modelli AI e consentire pivoting verso reti enterprise finalizzati al deploy di ransomware e malware aggiuntivo. Secondo la tassonomia SAIF di Google, questi attacchi sfruttano componenti integrati in modo insicuro e azioni malevole denominate rispettivamente Insecure Integrated Components e Rogue Actions. Uno dei malware distribuiti, chiamato SANDCLOCK, sottraeva credenziali e le utilizzava successivamente per estorsione e accessi persistenti. Gli attaccanti hanno sfruttato pull request malevoli, token OIDC compromessi e repository upstream vulnerabili per mantenere accesso continuativo alle infrastrutture software. Questo tipo di supply chain attack colpisce direttamente sviluppatori che integrano librerie AI nei propri progetti e può propagarsi rapidamente a migliaia di applicazioni downstream. Il caso dimostra quanto la sicurezza delle dipendenze AI sia diventata critica nel ciclo moderno di sviluppo software.

Deepfake e abuso degli LLM amplificano le operazioni di influenza

Gli avversari non utilizzano l’IA soltanto per malware ed exploit ma anche per operazioni di influenza e abuso delle piattaforme AI stesse. Il report descrive Operation Overload, una campagna che ha impiegato voice cloning e deepfake per creare video falsi capaci di impersonare giornalisti e diffondere contenuti di disinformazione. Gruppi collegati a Cina e Russia sfruttano middleware come Claude-Relay-Service per mascherare l’accesso ai modelli linguistici e aggirare limitazioni imposte dai provider. Vengono utilizzati inoltre sistemi automatizzati per la registrazione di account ChatGPT e la rotazione continua delle identità digitali al fine di evitare sospensioni e ban. Queste tecniche consentono agli attori malevoli di abusare dei trial gratuiti dei servizi AI mantenendo accesso persistente ai modelli. L’intelligenza artificiale diventa così non solo uno strumento offensivo ma anche una piattaforma per propaganda, social engineering e manipolazione informativa su larga scala. Secondo Google, il confine tra cybercrime tradizionale e information operations sta diventando sempre più sottile proprio grazie alla disponibilità di modelli generativi avanzati.

Google spinge il framework SAIF per mitigare le minacce AI

Per contrastare questi rischi, Google Cloud raccomanda alle organizzazioni di adottare il Secure AI Framework (SAIF) come modello di riferimento per valutare e mitigare i rischi legati all’intelligenza artificiale. Le aziende devono implementare safeguard specifici, attività di red teaming continuo e sistemi di rilevamento contro prompt injection e comportamenti anomali dei modelli. Sui dispositivi Android, Google Play Protect blocca automaticamente le versioni note di PROMPTSPY mentre i provider di LLM vengono invitati a monitorare i dati di rete per identificare relay service e aggregator di API utilizzati dagli attaccanti. Google dichiara inoltre di aver disabilitato numerosi account malevoli su Gemini e di utilizzare agenti AI interni come Big Sleep per individuare vulnerabilità e CodeMender per correggerle automaticamente. L’azienda sostiene anche iniziative collaborative come la Coalition for Secure AI (CoSAI) per definire standard comuni di sicurezza AI. Il report sottolinea però che le difese devono evolvere con la stessa velocità delle capacità offensive sviluppate dagli attori malevoli.

Le imprese devono monitorare supply chain e componenti AI

Le imprese che utilizzano componenti AI open source o closed source devono verificare immediatamente le dipendenze installate e aggiornare i pacchetti compromessi. Gli sviluppatori che integrano strumenti come LiteLLM o plugin collegati a Checkmarx devono controllare le versioni in uso e ruotare rapidamente tutti i segreti eventualmente esposti. Le organizzazioni che gestiscono infrastrutture critiche devono introdurre monitoraggio comportamentale avanzato per individuare malware autonomi come PROMPTSPY e rilevare attività anomale all’interno delle pipeline software. Il costo di un attacco supply chain può infatti tradursi in downtime prolungati, perdita di dati sensibili e danni reputazionali molto elevati. Il report del Google Threat Intelligence Group rappresenta un campanello d’allarme per tutto il settore tecnologico: l’intelligenza artificiale accelera sia le capacità difensive sia quelle offensive e soltanto una strategia integrata può ridurre realmente il rischio.

L’IA ridefinisce il panorama della cybersecurity globale

L’utilizzo offensivo dell’IA è destinato a crescere ulteriormente nel corso del 2026 e degli anni successivi. I modelli sempre più potenti vengono già utilizzati per generare exploit, eludere sistemi di difesa e condurre operazioni autonome con livelli di sofisticazione prima riservati agli attori statali più avanzati. Parallelamente l’IA offre anche alle difese nuove capacità di rilevamento, threat hunting e remediation automatica. Google Cloud punta a consolidare il proprio ruolo nella threat intelligence AI condividendo dati e framework di sicurezza con l’industria. Le aziende devono investire in formazione, scanning automatico delle dipendenze, verifica delle supply chain e collaborazione continua con vendor e ricercatori. Il report GTIG AI Threat Tracker del maggio 2026 rappresenta uno dei documenti più importanti pubblicati finora sull’evoluzione delle minacce AI e mostra chiaramente come l’intelligenza artificiale stia ridefinendo l’intero panorama della cybersecurity moderna.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.