Google Cloud lancia Cloud Storage Rapid per accelerare l’object storage dedicato ad AI e analytics mentre introduce cluster TPU ultra-resilienti per modelli da oltre un trilione di parametri. Gli aggiornamenti post-Next ’26 arrivano a maggio 2026 e rafforzano storage, compute e database per workload enterprise ad altissima intensità. La piattaforma punta a eliminare colli di bottiglia, downtime e complessità operative. Cloud Storage Rapid offre latenza sub-millisecondo e throughput fino a 15 TB/s da un singolo bucket, mentre i cluster TPU migliorano il training di modelli frontier con resilienza a livello di superpod. Database Center diventa un’interfaccia AI-native alimentata da Gemini per gestire Cloud SQL, Spanner e Bigtable tramite linguaggio naturale. Bigtable In-Memory Tier riduce la latenza su scala globale e AlloyDB aggiunge supporto nativo a Postgres 18 con copertura estesa per versioni legacy. Le imprese ottengono performance estreme, gestione semplificata e infrastruttura pronta per AI generativa, analytics real-time e database mission-critical.

Cosa leggere

Cloud Storage Rapid accelera object storage per AI e analytics

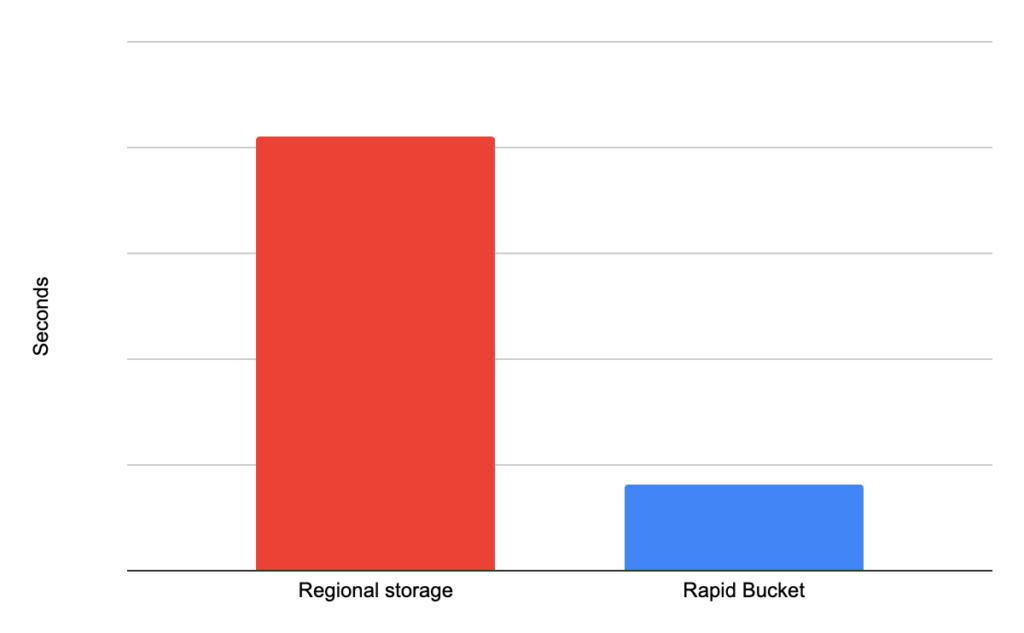

Cloud Storage Rapid rappresenta una nuova famiglia di capacità object storage ottimizzate per workload AI e analytics. La soluzione include Rapid Bucket, ora disponibile in general availability, e Rapid Cache, già in GA da un anno con adozione crescente. Rapid Bucket sfrutta l’infrastruttura Colossus per offrire latenza sub-millisecondo, append nativi illimitati e letture vettoriali capaci di supportare reader illimitati durante la scrittura. Un singolo Rapid Bucket raggiunge fino a 20 milioni di query al secondo e 15 TB/s di throughput aggregato in lettura. Queste prestazioni trasformano l’object storage da semplice archivio scalabile a componente attivo delle pipeline AI più esigenti, riducendo i ritardi che bloccano GPU e acceleratori durante training, inference e checkpointing.

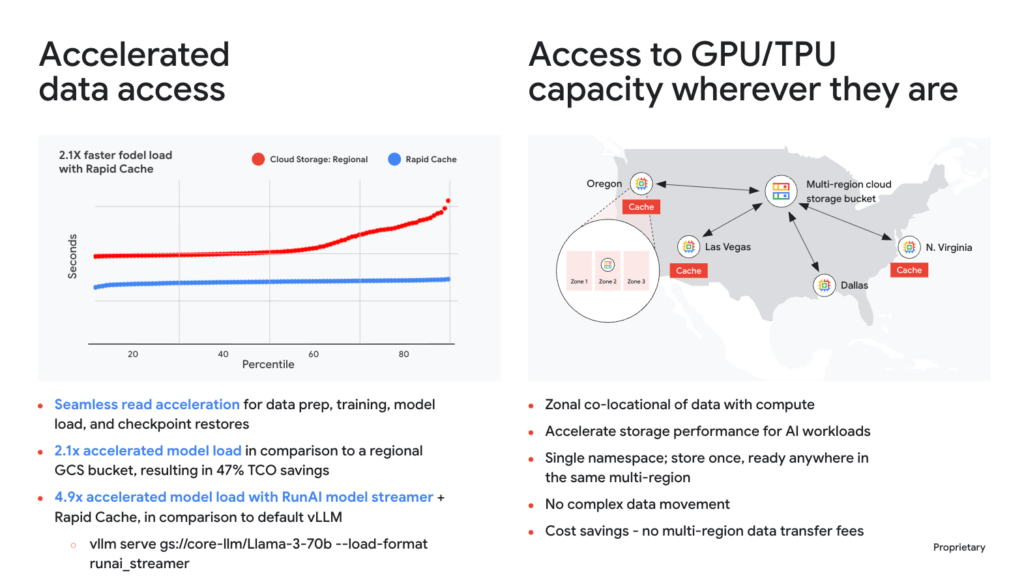

Rapid Cache riduce i colli di bottiglia nel training multimodale

Rapid Cache accelera le letture on-demand su bucket esistenti senza richiedere modifiche al codice e introduce la funzione ingest on write, che carica i dati in cache contemporaneamente alla scrittura. Questa architettura riduce fino al 50 per cento il tempo bloccato delle GPU e accelera fino a 2,5 volte il caricamento dei dati durante il training multimodale. I checkpoint di restore diventano fino a 5 volte più rapidi, mentre le scritture di checkpoint migliorano fino a 3,2 volte rispetto allo storage object tradizionale. Rapid Cache raggiunge 2,5 TB/s di throughput aggregato in lettura, accelera il caricamento dei modelli fino al 114 per cento e consente risparmi TCO fino al 47 per cento nell’inference. Per organizzazioni che addestrano modelli frontier, questa riduzione dei tempi inattivi diventa un vantaggio economico diretto.

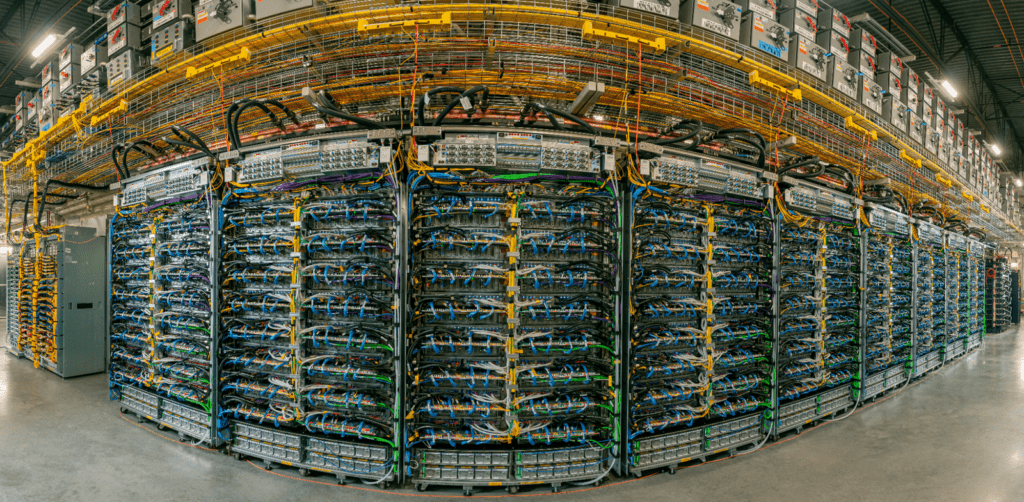

Cluster TPU aumentano la resilienza per modelli oltre 1T parametri

Google Cloud rivoluziona l’affidabilità dei cluster TPU per modelli da oltre un trilione di parametri passando dalla resilienza della singola istanza alla resilienza di cluster e superpod. I superpod Ironwood contengono migliaia di chip TPU organizzati in cubi da 64 chip collegati da link ICI ad alta velocità e da Optical Circuit Switching configurabile dinamicamente. Google utilizza un modello probabilistico basato su distribuzione binomiale per garantire con 95 per cento di confidenza almeno 130 cubi operativi su 144, pari a 8.320 chip funzionanti. Questo approccio topologico ottimizza la disponibilità per i job hero e permette di usare capacità residua parziale anche quando un cubo diventa unhealthy. Il risultato è una piattaforma più stabile per training massivi, esperimenti paralleli e inference su larga scala.

JAX e Pathways supportano hot-swapping e checkpointing automatico

La resilienza dei nuovi cluster TPU opera su tre livelli coordinati. A livello infrastrutturale, i superpod garantiscono scala fisica, ridondanza e connettività ad alta velocità. A livello framework, JAX e Pathways supportano riconfigurazione dei nodi e hot-swapping senza riavvii completi. A livello applicativo, auto-checkpointing e multi-tier checkpointing minimizzano la perdita di progresso durante i failure. Questa combinazione aumenta il goodput complessivo e offre una base più deterministica per lo scheduling di workload misti, tra training, esperimenti e inference. Per i team che addestrano modelli AI frontier, la continuità operativa diventa cruciale quanto la potenza grezza. Google Cloud punta così a ridurre le interruzioni che possono compromettere settimane di training e costi infrastrutturali enormi.

Database Center introduce osservabilità AI-native con Gemini

Database Center riceve miglioramenti post-Next ’26 con un’interfaccia di osservabilità AI-native alimentata da Gemini. Il sistema funziona come un teammate esperto capace di ragionare sull’intero Data Cloud tramite linguaggio naturale. Gli utenti possono interagire con una chat conversazionale che gestisce flotte complete di Cloud SQL, Spanner e Bigtable. Gemini correla automaticamente gli shift di performance tra servizi diversi, individua pattern e fornisce insight azionabili con opzioni per indagini approfondite e remediation. Le generative views, in arrivo prossimamente, creeranno interfacce dinamiche e personalizzate partendo da query in linguaggio naturale. La gestione database diventa quindi più accessibile anche per team non specialistici, riducendo dipendenza da tool esterni e accelerando troubleshooting, ottimizzazione e monitoraggio.

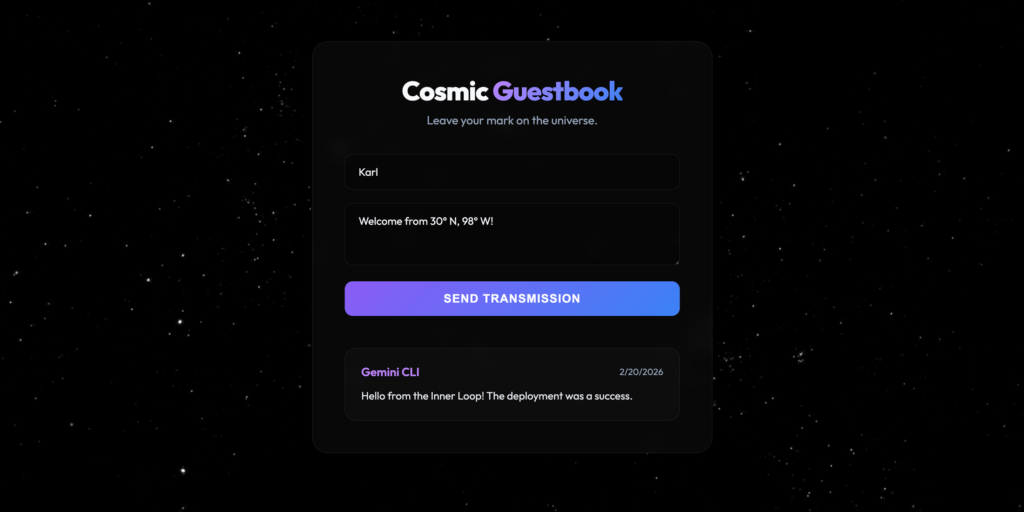

Gemini simula l’impatto delle ottimizzazioni database

Gemini valida le raccomandazioni di ottimizzazione simulando l’impatto su latenza, IOPS e throughput prima di applicare modifiche come nuovi indici o upgrade di macchina. Questa capacità riduce il rischio operativo perché consente ai team di verificare gli effetti attesi prima di intervenire su sistemi production-critical. L’integrazione con API pubbliche e Model Context Protocol permette inoltre di incorporare queste funzioni nei workflow di sviluppo con VS Code e Gemini CLI. Database Center elimina silos operativi e riduce il tempo medio di risoluzione dei problemi cross-domain, offrendo monitoraggio end-to-end della lineage e health check automatizzati. Per le aziende con flotte database distribuite, l’AI non sostituisce l’amministratore ma ne estende la capacità di analisi, trasformando metriche complesse in decisioni operative più rapide e contestualizzate.

Bigtable In-Memory Tier porta latenza sub-millisecondo su scala globale

Bigtable introduce In-Memory Tier nell’edizione Enterprise Plus per scalare le performance real-time. La tecnologia crea un’architettura ibrida che integra RAM, SSD e HDD con tiering automatico dei dati. Il sistema promuove automaticamente le righe hot in memoria durante picchi di carico come traffico virale, eventi live o sessioni di trading ad alta frequenza. La latenza di lettura raggiunge valori sub-millisecondo per dati time-sensitive, mantenendo consistenza tra tier in-memory e SSD. Remote Direct Memory Access trasferisce i dati direttamente dalla memoria del server al client senza coinvolgere CPU o sistema operativo, riducendo overhead e complessità. Questo approccio elimina la necessità di layer cache separati e semplifica architetture che prima richiedevano logiche cache-aside, risorse dedicate e manutenzione aggiuntiva.

Bigtable gestisce righe hot e workload power-law senza cache esterne

Bigtable In-Memory Tier gestisce distribuzioni power-law tipiche di social network, mercati finanziari e applicazioni real-time, dove una piccola quota di utenti o asset genera la maggior parte degli accessi. Il sistema promuove automaticamente i dati hot in lettura e li mantiene fino all’eviction, con policy opzionali basate sull’età. Un singolo cluster può supportare fino a 120.000 query al secondo sulla stessa riga senza degrado significativo. Le prestazioni reali indicano un throughput di point read fino a 10 volte superiore per dollaro speso e una riduzione del TCO grazie all’eliminazione di risorse idle e logica cache-aside complessa. L’integrazione con le funzionalità enterprise di alta disponibilità e scaling automatico rende Bigtable più adatto ad applicazioni globali che richiedono bassa latenza, affidabilità e gestione semplificata dei picchi.

AlloyDB aggiunge supporto nativo a Postgres 18

AlloyDB estende il supporto a PostgreSQL 18 con nuove funzionalità pensate per migliorare query, indicizzazione e gestione dei dati applicativi. L’aggiornamento include B-tree skip scans per query più veloci, parallel GIN index per ricerche full-text e JSON, colonne generate virtuali calcolate on-the-fly senza occupare spazio disco e UUIDv7 nativi per ordinamento e indicizzazione più efficienti nelle applicazioni distribuite. AlloyDB introduce anche tre anni di extended support per versioni legacy oltre la fine del ciclo di vita della community. PostgreSQL 14 riceve copertura fino a febbraio 2030, la versione 15 fino al 2031, la 16 fino al 2032 e la 17 fino al 2033. Durante questo periodo, AlloyDB fornisce patch di sicurezza critiche, fix proattivi, copertura SLA e possibilità di creare nuovi cluster su versioni precedenti.

AlloyDB semplifica upgrade e gestione Postgres enterprise

Gli upgrade major version di AlloyDB avvengono in-place con downtime minimo e senza modifiche alla stringa di connessione. La gestione semplificata include offloading di logging e manutenzione su un servizio dedicato, scaling orizzontale delle repliche read-only senza duplicazione dei dati e storage elastico che cresce o si riduce automaticamente. AlloyDB mantiene prestazioni consistenti indipendentemente dalla dimensione dello storage e offre un’esperienza Postgres fully managed con vantaggi cloud-native. Per le aziende che devono modernizzare database legacy senza interrompere applicazioni mission-critical, il supporto esteso e gli upgrade semplificati rappresentano un elemento strategico. Google Cloud posiziona così AlloyDB come piattaforma per applicazioni enterprise che richiedono compatibilità PostgreSQL, sicurezza continuativa, performance prevedibili e gestione operativa ridotta.

Google Cloud integra storage, TPU e database per workload AI enterprise

I nuovi servizi Google Cloud lavorano in sinergia per supportare workload AI e data-intensive a scala enterprise. Cloud Storage Rapid elimina i bottleneck I/O durante training, checkpointing e inference. I cluster TPU garantiscono che i modelli da oltre 1T parametri procedano con resilienza a livello di superpod. Database Center con Gemini trasforma la gestione di flotte complesse in conversazioni naturali, mentre Bigtable In-Memory Tier assicura latenza sub-millisecondo per applicazioni real-time. AlloyDB con Postgres 18 offre compatibilità futura e gestione semplificata dei sistemi legacy. Le imprese ottengono un’infrastruttura unificata che riduce TCO, accelera time-to-market e minimizza rischi operativi. I team di data science e ingegneria possono scalare automaticamente, ottenere insight AI-driven e ridurre la complessità legata alla gestione diretta di storage, compute e database.

Google Cloud rafforza la piattaforma post-Next ’26 per AI su scala trilioni

Gli aggiornamenti post-Next ’26 posizionano Google Cloud come piattaforma centrale per l’AI enterprise su scala trilioni. Le organizzazioni che addestrano modelli massivi trovano nei cluster TPU resilienti e in Cloud Storage Rapid strumenti progettati per massimizzare goodput e ridurre costi di training. I team database ottengono in Database Center un assistente AI capace di dialogare in linguaggio naturale e in Bigtable In-Memory Tier una soluzione real-time senza complessità di caching aggiuntiva. AlloyDB garantisce continuità e innovazione Postgres con supporto esteso, upgrade semplificati e prestazioni gestite. Le aziende possono scalare analytics, inference e applicazioni mission-critical con maggiore sicurezza, efficienza e automazione. Google Cloud continua così a investire su storage, compute e database per sostenere l’evoluzione dell’AI generativa, dei modelli frontier e dei sistemi data-driven globali.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.