La Remote Code Execution, abbreviata in RCE, rappresenta una delle condizioni più gravi nella sicurezza informatica perché consente a un attaccante di eseguire istruzioni su un sistema remoto. Non si tratta soltanto di leggere dati, provocare un errore o bloccare un servizio. Una RCE riuscita può trasformare un’applicazione vulnerabile in un punto di esecuzione controllato dall’esterno, aprendo la strada a payload malevoli, reverse shell, web shell, escalation di privilegi, movimento laterale, esfiltrazione di dati e distribuzione di ransomware. La sua pericolosità deriva da un elemento essenziale: l’attaccante non ha più bisogno di “possedere” fisicamente il sistema, né necessariamente di avere credenziali valide. Quando la vulnerabilità è pre-authentication, cioè sfruttabile prima del login, il rischio cresce in modo drastico perché il bersaglio può essere colpito attraverso la sola esposizione del servizio. Quando invece l’RCE richiede autenticazione, il rischio resta elevato ma dipende dalla possibilità di ottenere o abusare di un account valido. La RCE è il punto in cui una falla diventa perdita di sovranità tecnica sul sistema. Il server, l’appliance, il container, l’ambiente CI/CD o la workstation non eseguono più soltanto il codice previsto dal proprietario, ma possono eseguire codice scelto dall’attaccante. È per questo che molte vulnerabilità RCE compaiono tra le priorità di patching dei vendor, nei bollettini CISA e negli alert nazionali quando riguardano prodotti ampiamente esposti. Il catalogo CISA KEV include numerose vulnerabilità classificate come remote code execution, proprio perché lo sfruttamento reale di una RCE su prodotti enterprise può produrre compromissioni rapide e scalabili. La CISA presenta il catalogo KEV come fonte autorevole sulle vulnerabilità già sfruttate in the wild e come input operativo per la prioritizzazione difensiva. In parallelo, il sistema CVE continua a fornire l’identificativo univoco della vulnerabilità, mentre il rischio reale dipende da esposizione, disponibilità di exploit, privilegi richiesti e presenza di remediation.

Le cronache tecniche di Matrice Digitale hanno già mostrato questo salto di gravità in casi come l’RCE critico nella libreria vm2 per Node.js, l’RCE CVSS 10 in Gemini CLI e nelle pipeline CI/CD e le vulnerabilità critiche MetInfo, Weaver e AWS WorkSpaces. In tutti questi scenari, il problema non è la falla isolata, ma la possibilità di trasformarla in esecuzione remota, persistenza e controllo operativo.

Cosa leggere

Che cos’è tecnicamente un attacco RCE

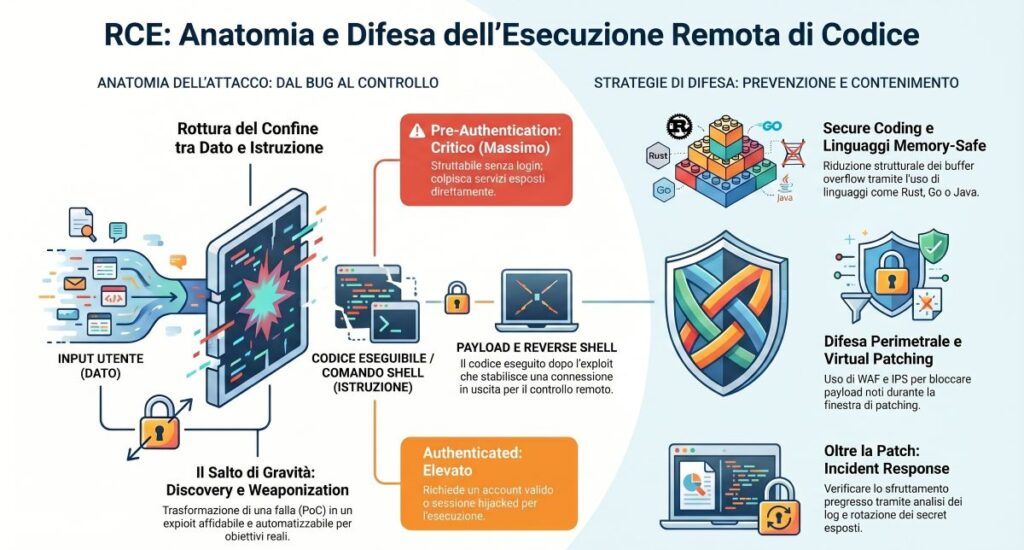

Un attacco RCE avviene quando un’applicazione, un servizio, un interprete, un parser, una libreria o un componente di sistema elabora dati non affidabili in modo tale da consentire l’esecuzione di codice arbitrario. Il vettore può trovarsi in una richiesta HTTP, in un file caricato, in un oggetto serializzato, in un parametro API, in un pacchetto di rete, in un comando costruito dinamicamente o in una regione di memoria gestita in modo scorretto. L’elemento comune è la rottura del confine tra dato e istruzione. L’applicazione dovrebbe trattare l’input dell’utente come informazione da validare, filtrare, interpretare o archiviare. L’RCE nasce quando quell’input riesce invece a diventare comando, codice, oggetto eseguibile, istruzione shell, bytecode, script o controllo del flusso di esecuzione. L’attaccante non sfrutta soltanto un errore: forza il sistema a usare il suo input come parte del comportamento operativo. Le origini possono essere diverse. Nei linguaggi e nei componenti memory-unsafe, una gestione errata della memoria può consentire di sovrascrivere aree critiche e deviare il flusso di esecuzione. Nei framework web, un template engine o una funzione di deserializzazione possono caricare oggetti manipolati. Nelle applicazioni server-side, un comando costruito concatenando input utente e istruzioni di sistema può aprire la strada alla command injection. Nei sistemi cloud e DevOps, un workflow automatizzato può eseguire script o dipendenze compromesse dentro pipeline privilegiate.

Il concetto tecnico va quindi oltre la singola categoria. RCE è l’effetto finale. Il percorso può passare da command injection, code injection, insecure deserialization, buffer overflow, template injection, file upload insicuro, path traversal concatenato a esecuzione, sandbox escape o abuso di componenti di automazione. La Common Weakness Enumeration di MITRE classifica queste famiglie come debolezze distinte, ma molte di esse possono convergere nello stesso risultato: esecuzione di codice controllata dall’attaccante. Il CWE-78, per esempio, descrive il caso in cui un prodotto costruisce comandi del sistema operativo usando input esterno senza neutralizzare correttamente elementi speciali capaci di alterare il comando finale. La differenza tra vulnerabilità e exploit è centrale. La vulnerabilità è la debolezza. L’exploit è il metodo che la rende utilizzabile. Il payload è ciò che viene eseguito dopo il successo. In un caso semplice, l’exploit può limitarsi a dimostrare l’esecuzione di un comando innocuo. In un attacco reale, invece, il payload può aprire una reverse shell, scaricare malware, creare un account, disattivare controlli di sicurezza, rubare credenziali o connettere il sistema a un server C2.

Dalla scoperta alla weaponization

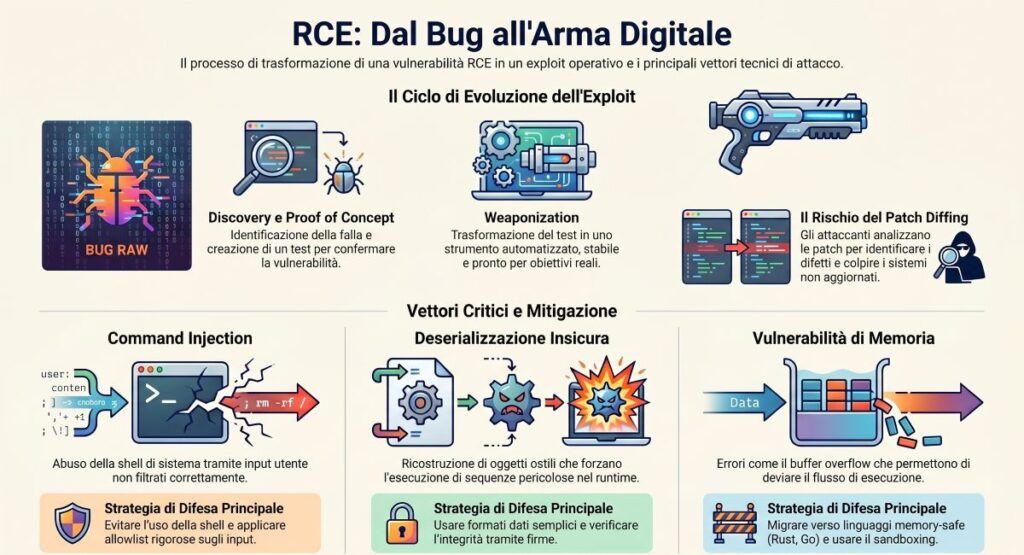

Una RCE non diventa immediatamente arma operativa nel momento in cui viene scoperta. Attraversa una fase di trasformazione tecnica che gli attaccanti, i ricercatori e i team di sicurezza conoscono bene. Il primo passaggio è la discovery, cioè l’identificazione della falla. Può avvenire tramite fuzzing, audit del codice, reverse engineering, analisi dei crash, revisione delle patch, penetration test o semplice osservazione di un comportamento anomalo. La seconda fase è il proof of concept. Il PoC serve a dimostrare che la vulnerabilità può essere attivata. In ambito responsabile, un PoC dovrebbe essere usato per confermare il problema e facilitare la correzione. Nel circuito offensivo, però, lo stesso PoC può essere raffinato fino a diventare exploit affidabile. La differenza tra un PoC instabile e un exploit maturo è enorme: il primo mostra una possibilità, il secondo permette lo sfruttamento ripetibile. La terza fase è la weaponization. Qui l’exploit viene reso pratico, automatizzabile e compatibile con obiettivi reali. Vengono gestiti errori, versioni diverse, bypass delle protezioni, condizioni di rete, filtri WAF, autenticazione eventuale e stabilità del payload. Nei casi più gravi, l’exploit entra in botnet, exploit kit, framework offensivi o catene di attacco usate da gruppi ransomware e attori statali. Questo processo spiega perché la pubblicazione di una patch può diventare paradossalmente un acceleratore di rischio. Gli attaccanti analizzano le correzioni, confrontano codice vulnerabile e codice aggiornato, identificano la radice del difetto e costruiscono exploit contro i sistemi non aggiornati. È la logica del patch diffing. Per questo una finestra di patching lenta può essere pericolosa quanto l’assenza di patch. La weaponization è particolarmente rapida quando la vulnerabilità riguarda prodotti esposti e standardizzati. Firewall, VPN, appliance di accesso remoto, CMS, strumenti di collaborazione, hypervisor, backup server e piattaforme CI/CD offrono agli aggressori un vantaggio: molti bersagli condividono versioni simili, configurazioni ricorrenti e superfici pubbliche. Le analisi di Matrice Digitale su Progress ShareFile, F5 BIG-IP e Outlook e su GitHub Enterprise Server compromettibile tramite RCE mostrano perché le RCE in componenti enterprise non sono semplici bug applicativi, ma punti di leva sull’intera infrastruttura.

Command injection e abuso della shell

La command injection è uno dei vettori più diretti verso la Remote Code Execution. Si verifica quando un’applicazione costruisce un comando da eseguire sul sistema operativo includendo input controllato dall’utente senza una neutralizzazione adeguata. Se il programma passa quell’input a una shell, caratteri speciali, separatori, redirezioni o operatori logici possono alterare il comando previsto e aggiungere istruzioni scelte dall’attaccante. Il problema nasce quasi sempre da un errore di progettazione: usare la shell come scorciatoia applicativa. Un servizio web che invoca comandi di sistema per comprimere file, convertire documenti, interrogare strumenti locali, chiamare script legacy o gestire risorse di sistema può diventare vulnerabile se non separa rigidamente parametri e istruzioni. MITRE classifica questa debolezza nel CWE-78 e indica strategie come sandboxing, allowlist dei comandi consentiti e controlli runtime per ridurre l’impatto. La command injection è pericolosa perché può essere comprensibile anche a un attaccante non particolarmente sofisticato. Se l’input viene passato alla shell, la superficie di abuso può essere ampia. L’attaccante può tentare di leggere file, enumerare utenti, scaricare strumenti, aprire connessioni esterne, scrivere web shell o avviare processi persistenti. Nei sistemi Linux e Unix-like, l’abuso di shell e utility standard può rendere l’attacco silenzioso perché usa binari già presenti sul sistema. Nei sistemi Windows, PowerShell, WMI, certutil e altri strumenti legittimi possono essere impiegati per living-off-the-land. La difesa efficace non consiste solo nel filtrare caratteri sospetti. I filtri basati su blacklist vengono spesso aggirati. Il principio corretto è evitare l’invocazione della shell quando non è indispensabile, usare API sicure, validare input con allowlist rigorose, separare argomenti e comando, ridurre i privilegi del processo e isolare l’ambiente di esecuzione. Quando un’applicazione non può fare a meno di lanciare processi esterni, il contesto deve essere considerato ad alto rischio.

Deserializzazione insicura e ricostruzione di oggetti ostili

La deserializzazione insicura è uno dei vettori più insidiosi perché sfrutta una funzione apparentemente legittima: trasformare dati serializzati in oggetti utilizzabili dall’applicazione. Il problema nasce quando l’applicazione deserializza dati non affidabili senza verificare in modo sufficiente che l’oggetto ricostruito sia valido, sicuro e coerente con il contesto. MITRE classifica questa debolezza nel CWE-502, associandola alla deserializzazione di dati non trusted. In molte piattaforme, gli oggetti serializzati non contengono soltanto dati, ma possono attivare comportamenti durante la ricostruzione. Catene di gadget, metodi speciali, callback o classi disponibili nel runtime possono essere abusati per eseguire operazioni non previste. L’attaccante non deve necessariamente caricare un binario completo: può costruire un oggetto che, nel momento in cui viene deserializzato, forza l’applicazione a eseguire una sequenza pericolosa. Questo rende la deserializzazione una vulnerabilità difficile da intuire per chi guarda solo all’interfaccia applicativa. Il payload può viaggiare dentro cookie, token, sessioni, messaggi, code, file, parametri API o oggetti passati tra servizi. L’applicazione sembra limitarsi a ricostruire uno stato. In realtà, sta concedendo all’attaccante la possibilità di influenzare il comportamento interno del runtime. La mitigazione richiede un cambio di modello. I dati provenienti dall’esterno non devono essere deserializzati in oggetti complessi senza controllo. È preferibile usare formati semplici, validati e privi di comportamenti eseguibili. Quando la deserializzazione è inevitabile, servono allowlist delle classi, firme crittografiche, controlli di integrità, isolamento del processo e aggiornamento delle librerie vulnerabili. In ambienti enterprise, il rischio aumenta quando una libreria legacy resta caricata nel classpath e può essere usata come parte di una gadget chain. Le RCE basate su deserializzazione hanno colpito negli anni framework, piattaforme enterprise, sistemi di collaborazione, componenti Java, ambienti .NET e servizi cloud. La loro forza deriva dalla combinazione tra superficie remota e complessità interna del runtime. Per il difensore, l’errore è considerarle vulnerabilità “solo applicative”. Una deserializzazione insicura su un servizio esposto può diventare accesso iniziale, backdoor e movimento laterale.

Buffer overflow, memoria e linguaggi memory-unsafe

Il buffer overflow è una delle forme storiche di vulnerabilità che possono portare a RCE. Si verifica quando un programma scrive più dati di quanti il buffer possa contenere, sovrascrivendo aree di memoria adiacenti. In scenari sfruttabili, questa sovrascrittura può alterare puntatori, strutture di controllo, indirizzi di ritorno o dati critici, permettendo all’attaccante di deviare il flusso di esecuzione. Le protezioni moderne hanno reso più difficile lo sfruttamento classico, ma non hanno eliminato il problema. ASLR, DEP, stack canary, Control Flow Integrity, sandboxing e hardening del compilatore aumentano la complessità. Tuttavia, gli exploit avanzati possono combinare information disclosure, out-of-bounds write, use-after-free e bypass delle mitigazioni. Il risultato può essere ancora una RCE, soprattutto in browser, librerie multimediali, driver, firmware, appliance di rete e software scritto in C o C++. Il tema è diventato strategico anche per CISA. Nel 2025 l’agenzia ha pubblicato un alert Secure by Design dedicato all’eliminazione delle vulnerabilità buffer overflow, sottolineando la necessità di ridurre queste classi di difetti attraverso pratiche di progettazione più sicure. CISA e NSA hanno inoltre promosso l’adozione di linguaggi memory-safe per migliorare la sicurezza del software e ridurre il rischio di incidenti legati alla memoria. Questo non significa che Rust, Go, Java, Swift, Python o altri linguaggi memory-safe eliminino ogni vulnerabilità. Errori logici, injection, deserializzazione insicura, access control debole e dipendenze vulnerabili restano possibili. Ma i linguaggi memory-safe riducono o impediscono molte classi di errori legati a puntatori, buffer, use-after-free e accessi fuori limite. È un cambiamento strutturale: invece di chiedere agli sviluppatori di evitare manualmente ogni errore di memoria, si sposta una parte della sicurezza nel linguaggio e nel runtime. Per il software legacy, la migrazione non può essere immediata. Molti componenti critici continueranno a usare C e C++ per ragioni di performance, compatibilità, hardware, sistemi embedded o ecosistemi esistenti. In questi casi, servono analisi statica, fuzzing, sanitizers, code review, hardening del compilatore, sandboxing e riduzione dei privilegi. La sicurezza della memoria non è una moda, ma una risposta industriale a decenni di vulnerabilità sfruttate.

Payload, reverse shell e persistenza dopo l’RCE

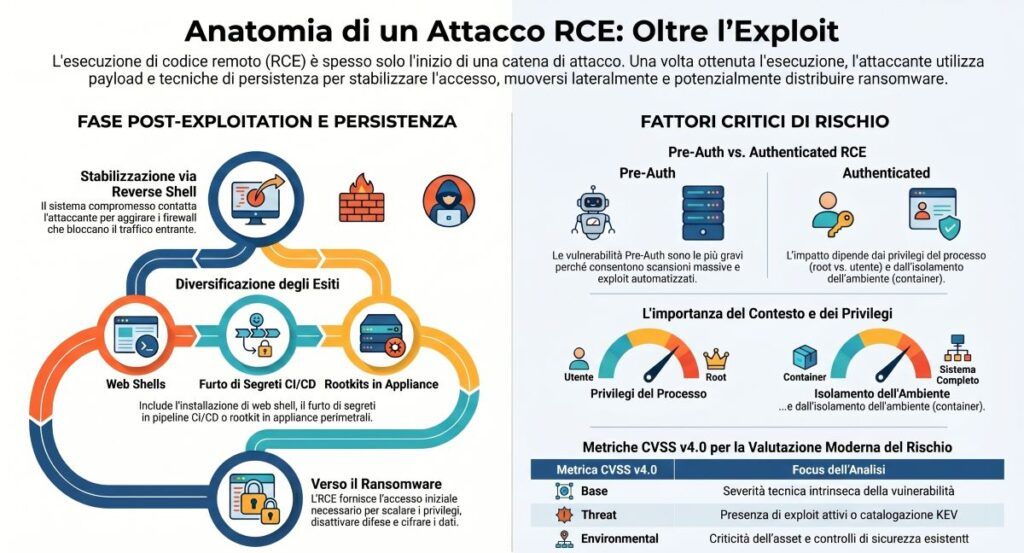

Una RCE è solo l’inizio. Dopo aver ottenuto esecuzione, l’attaccante deve stabilizzare l’accesso, capire il contesto e decidere il passo successivo. Il payload è il codice o il comando eseguito dopo lo sfruttamento. Può essere minimo, come una prova di esecuzione, oppure complesso, come un loader capace di scaricare malware, aprire connessioni cifrate, esfiltrare dati o installare persistenza. La reverse shell è uno dei payload più noti. Invece di attendere una connessione in ingresso, il sistema vittima avvia una connessione verso l’attaccante. Questo modello è efficace perché molte reti filtrano il traffico entrante ma consentono più facilmente il traffico uscente. Una volta stabilita la sessione, l’attaccante può inviare comandi come se avesse una shell remota sul sistema compromesso. La reverse shell non è l’unico esito. In un server web, l’attaccante può scrivere una web shell persistente dentro una directory raggiungibile. In un container, può tentare di uscire dall’isolamento o rubare secret montati nel filesystem. In una pipeline CI/CD, può estrarre token, chiavi cloud, credenziali di repository e variabili d’ambiente. In un appliance perimetrale, può installare una backdoor difficile da rilevare. In un ambiente Windows, può abusare di strumenti legittimi per esecuzione, persistenza e discovery. Il passaggio da RCE a ransomware non è automatico, ma è frequente nelle catene criminali. L’RCE può fornire accesso iniziale. Dopo l’accesso, l’attaccante cerca privilegi, disattiva difese, compromette directory, enumera backup, si muove lateralmente e prepara la cifratura. CISA, negli advisory ransomware, documenta spesso l’uso di strumenti legittimi e comandi di sistema per esecuzione, persistenza e attività post-compromissione. Nel caso Akira, per esempio, CISA segnala l’uso di PowerShell e LOLBin per eseguire script malevoli e sostenere operazioni offensive. Matrice Digitale ha descritto questo passaggio negli attacchi con reverse shell e RCE estorsive contro Zimbra e Oracle EBS e negli scenari in cui SonicWall e Fortinet sono stati associati a rootkit, RCE e persistenza. La lezione è chiara: quando una RCE riesce, il problema non è più soltanto “chiudere la falla”, ma capire che cosa è stato eseguito, quali credenziali sono state toccate e quali sistemi possono essere già compromessi.

RCE pre-authentication, authenticated RCE e rischio reale

Non tutte le RCE hanno lo stesso peso operativo. La differenza più importante riguarda la necessità di autenticazione. Una pre-auth RCE permette di sfruttare la vulnerabilità senza login. Se il servizio è esposto su Internet, l’attaccante può colpire direttamente. Questo scenario è tra i più gravi perché consente scansioni massive, exploit automatizzati e compromissioni su larga scala. Una authenticated RCE richiede invece un account valido. Potrebbe sembrare meno grave, ma non va sottovalutata. In ambienti reali, credenziali rubate, account deboli, token compromessi, sessioni hijacked o utenti a basso privilegio possono fornire la condizione necessaria. Se l’RCE autenticata consente escalation, accesso al server o controllo del backend, l’impatto può restare molto alto. Il rischio reale dipende anche dal privilegio del processo vulnerabile. Un’RCE eseguita come utente non privilegiato dentro un container isolato è diversa da un’RCE eseguita come root su un firewall o come servizio amministrativo su una piattaforma enterprise. Anche il contesto di rete pesa: un servizio raggiungibile solo da rete interna può essere meno esposto, ma diventa critico se l’attaccante ha già ottenuto accesso iniziale. Il CVSS aiuta a comunicare questi aspetti, ma non li esaurisce. FIRST descrive CVSS v4.0 come un sistema basato su metriche Base, Threat, Environmental e Supplemental, pensato per rappresentare severità tecnica e contesto aggiuntivo. Una RCE pre-auth, network-accessible, low-complexity e con impatto alto su confidenzialità, integrità e disponibilità avrà quasi sempre una valutazione elevata. Ma la priorità concreta dipenderà anche da esposizione, exploit attivo, presenza nel catalogo KEV, criticità dell’asset e compensating control. Questa distinzione spiega perché il vulnerability management moderno non può limitarsi a una dashboard di numeri. Un SOC deve chiedersi se il prodotto è installato, quale versione è in uso, se il servizio è esposto, quali privilegi ha, se ci sono indicatori di sfruttamento, se esiste una patch e se il sistema mostra anomalie compatibili con post-exploitation.

Difesa perimetrale: WAF, IPS e virtual patching

Il Web Application Firewall e l’Intrusion Prevention System possono ridurre il rischio di RCE bloccando pattern noti, payload sospetti, richieste anomale o sequenze compatibili con exploit pubblici. Non sono una soluzione definitiva, ma svolgono un ruolo importante nella finestra tra disclosure e patch, soprattutto quando la correzione non può essere applicata immediatamente. Il virtual patching funziona proprio in questa zona. Il codice vulnerabile resta temporaneamente invariato, ma il traffico malevolo viene filtrato o bloccato prima di raggiungerlo. In un’applicazione web, il WAF può intercettare tentativi di command injection, traversal, upload pericolosi o parametri sospetti. In rete, un IPS può bloccare pacchetti compatibili con exploit noti. In ambienti cloud, regole di accesso, API gateway e policy condizionali possono limitare l’esposizione. Il limite è evidente: se l’exploit cambia forma, se usa una codifica diversa, se abusa di logica applicativa o se l’attaccante ha già credenziali valide, il filtro può fallire. Per questo WAF e IPS devono essere considerati controlli compensativi, non sostituti del patching. Il loro valore è massimo quando vengono usati per guadagnare tempo, non per rimandare indefinitamente la remediation. La difesa perimetrale deve inoltre essere accompagnata da logging utile. Bloccare un payload senza conservare il contesto significa perdere intelligence. Un tentativo di RCE contro un asset esposto può indicare scansione di massa, targeting specifico o inizio di una campagna. I log devono consentire di capire origine, payload, endpoint, risposta del server, eventuale bypass e sistemi successivamente contattati.

Sandboxing, least privilege e contenimento dell’impatto

La difesa più solida contro l’RCE non parte dall’idea che l’exploit non avverrà mai. Parte dall’ipotesi opposta: prima o poi un’applicazione esposta potrà essere compromessa. La domanda diventa allora quanto danno può produrre il codice eseguito. Qui entrano in gioco sandboxing, least privilege, isolamento dei processi, container hardening, segmentazione e separazione dei secret. Il principio del least privilege impone che un’applicazione disponga solo dei permessi necessari. Se un servizio web viene compromesso, non deve poter leggere chiavi cloud, accedere al database come amministratore, scrivere in directory sensibili o lanciare comandi di sistema non necessari. Ogni permesso in eccesso diventa moltiplicatore dell’RCE. L’attaccante eredita il contesto del processo vulnerabile; ridurre quel contesto significa ridurre l’impatto. La sandbox limita ciò che un processo può fare anche dopo l’esecuzione di codice. Può impedire accesso al filesystem, rete, processi esterni, chiamate di sistema o risorse del sistema host. Nei browser, nelle app mobile, nei runtime serverless e nei container, l’isolamento è parte essenziale della sicurezza. Tuttavia, la sandbox non è invulnerabile. Una catena avanzata può includere RCE più sandbox escape più privilege escalation. Nei container, il rischio è spesso sottovalutato. Un container vulnerabile non equivale automaticamente alla compromissione dell’host, ma può diventarlo se gira privilegiato, monta socket Docker, espone secret, usa capabilities eccessive o condivide volumi sensibili. Le analisi di Matrice Digitale su Docker, Ninja Forms e Flowise con takeover remoto mostrano proprio il ruolo dei confini di autorizzazione quando un componente esposto incontra permessi pericolosi.

Secure coding, SAST, DAST e penetration test

La prevenzione delle RCE comincia nello sviluppo. Il secure coding non è una fase finale, ma un modo di progettare. Significa evitare l’esecuzione dinamica di codice, separare input e istruzioni, validare con allowlist, usare librerie sicure, ridurre funzioni pericolose, gestire errori senza leak informativi, disabilitare deserializzazione non necessaria, firmare artefatti e isolare componenti ad alto rischio. I test SAST analizzano il codice sorgente o gli artefatti in modo statico, cercando pattern vulnerabili prima dell’esecuzione. I test DAST osservano il comportamento dell’applicazione in esecuzione, simulando input ostili e verificando risposte anomale. Nessuno dei due approcci basta da solo. Il SAST può individuare funzioni pericolose e flussi di input non sanificati, ma può generare falsi positivi e non vedere il contesto runtime. Il DAST può rilevare vulnerabilità sfruttabili dall’esterno, ma non sempre copre tutti i percorsi logici. Il penetration test aggiunge l’interpretazione umana. Un tester esperto non cerca solo pattern noti, ma combina contesto applicativo, logica di business, configurazioni, ruoli, API, file upload, workflow e integrazioni. Molte RCE nascono da combinazioni non evidenti: una funzione di import, un parser di documenti, un convertitore, un plugin, un template, un worker asincrono o un task schedulato. Il Secure Software Development Framework del NIST fornisce un riferimento istituzionale per integrare pratiche di sviluppo sicuro lungo il ciclo di vita del software, compresi requisiti, implementazione, verifica e risposta alle vulnerabilità. (cisa.gov) La direzione è chiara: la sicurezza non deve essere aggiunta dopo il rilascio, ma incorporata nella progettazione, nella build, nei test, nella distribuzione e nella manutenzione.

Linguaggi memory-safe e riduzione strutturale delle RCE

Il passaggio verso linguaggi memory-safe è una delle strategie più importanti per ridurre le RCE legate alla memoria. CISA, NSA e altre autorità internazionali hanno spinto i produttori software a costruire roadmap di memory safety e ad adottare linguaggi che riducano classi di vulnerabilità come buffer overflow, use-after-free e accessi fuori limite. Questo orientamento non elimina la necessità di sicurezza applicativa, ma riduce la superficie di una famiglia storica di exploit. Se un linguaggio impedisce per design determinati errori di gestione della memoria, l’attaccante perde un’intera classe di primitive offensive. È una difesa a monte, più efficace della sola correzione caso per caso. Rust è spesso citato perché combina controllo delle prestazioni e garanzie forti sulla memoria. Go, Java, C#, Swift, Python e altri linguaggi offrono a loro volta modelli che riducono molti errori tipici del C e del C++. Ma la scelta del linguaggio non basta. Librerie native, chiamate unsafe, FFI, dipendenze vulnerabili e logica applicativa possono reintrodurre rischio. La memory safety è una base, non una garanzia totale. Per le organizzazioni con codice legacy, la strategia realistica è graduale. Nuovi componenti ad alto rischio possono essere sviluppati in linguaggi memory-safe. Le parti esistenti possono essere protette con fuzzing, sanitizers, hardening, isolamento, code review e progressiva sostituzione. La sicurezza moderna non chiede di riscrivere tutto domani, ma di smettere di produrre nuovo debito tecnico nelle aree più esposte.

Incident response dopo una RCE

Quando una RCE viene confermata, la risposta non deve limitarsi alla patch. Applicare l’aggiornamento chiude la falla, ma non dimostra che l’attaccante non sia già entrato. La domanda corretta è: la vulnerabilità è stata sfruttata prima della correzione? Se la risposta è possibile o incerta, serve un’indagine. Il primo passo è preservare log e artefatti. Access log, error log, process list, connessioni di rete, file modificati, cron job, servizi creati, account nuovi, chiavi SSH, token cloud, variabili d’ambiente e cronologia dei comandi possono contenere segnali decisivi. Se i log vengono sovrascritti o cancellati, la possibilità di ricostruire la timeline diminuisce.

Il secondo passo è cercare indicatori di post-exploitation. Una RCE può aver lasciato web shell, script, binari, connessioni verso C2, processi anomali, modifiche ai permessi, dump di credenziali o tentativi di movimento laterale. Nei sistemi cloud, bisogna controllare chiavi, ruoli, policy, snapshot, bucket, secret manager, repository e pipeline. In ambienti CI/CD, l’attenzione deve andare a token, runner, artefatti e dipendenze. Il terzo passo è ruotare credenziali e secret potenzialmente esposti. Se il processo vulnerabile poteva leggere variabili d’ambiente, file di configurazione o token di servizio, bisogna presumere che l’attaccante possa averli acquisiti. Il patching senza rotazione dei secret rischia di lasciare aperta la porta principale anche dopo aver chiuso la finestra. Il quarto passo è validare la remediation. Non basta installare una patch. Bisogna verificare la versione, controllare che il servizio vulnerabile non sia ancora esposto, rimuovere workaround temporanei non più necessari, aggiornare immagini container, ricostruire artefatti e documentare la chiusura. In un audit serio, la prova della remediation conta quanto la remediation stessa.

FAQ su RCE ed exploit critici

Che cos’è una RCE?

Una RCE è una vulnerabilità che consente a un attaccante di eseguire codice su un sistema remoto. È grave perché può trasformare un bug in controllo operativo, permettendo payload malevoli, reverse shell, furto di dati, persistenza, escalation di privilegi e distribuzione di malware.

Una RCE ha sempre punteggio CVSS 10?

No, una RCE non ha sempre CVSS 10. Il punteggio dipende da vettore d’attacco, complessità, privilegi richiesti, interazione utente e impatto. Una RCE pre-authentication esposta su Internet è generalmente più grave di una RCE che richiede login, condizioni specifiche o privilegi già elevati.

Qual è la differenza tra RCE pre-auth e authenticated RCE?

Una RCE pre-auth può essere sfruttata senza credenziali, mentre una authenticated RCE richiede un account valido. La prima è spesso più pericolosa su servizi esposti, ma la seconda resta critica quando credenziali rubate, account deboli o token compromessi permettono l’accesso iniziale.

Che cos’è una reverse shell?

Una reverse shell è una connessione avviata dal sistema vittima verso l’attaccante per fornire una shell remota. È usata spesso dopo una RCE perché può superare filtri che bloccano connessioni in ingresso ma consentono traffico in uscita verso Internet.

Che differenza c’è tra exploit e payload?

L’exploit è il metodo che sfrutta la vulnerabilità, mentre il payload è ciò che viene eseguito dopo il successo. L’exploit apre il varco; il payload produce l’effetto operativo, come aprire una shell, scaricare malware, creare persistenza o esfiltrare dati.

La command injection è sempre una RCE?

La command injection può diventare RCE quando permette all’attaccante di eseguire comandi sul sistema remoto. Non ogni injection produce automaticamente controllo completo, ma quando l’input ostile raggiunge una shell o un interprete con privilegi utili, l’impatto può essere critico.

Come si previene una RCE nel codice?

Una RCE si previene separando input e istruzioni, validando con allowlist, evitando esecuzione dinamica, limitando la deserializzazione, usando API sicure, riducendo i privilegi, testando con SAST e DAST e adottando secure coding lungo tutto il ciclo di sviluppo.

WAF e IPS bastano contro gli exploit RCE?

No, WAF e IPS non bastano da soli. Possono bloccare exploit noti e ridurre il rischio nella finestra prima della patch, ma devono essere considerati controlli compensativi. La difesa richiede patching, hardening, least privilege, sandboxing, monitoraggio e verifica post-remediation.

Perché i linguaggi memory-safe riducono il rischio RCE?

I linguaggi memory-safe riducono il rischio RCE perché impediscono molte classi di errori legati alla memoria, come buffer overflow e use-after-free. Non eliminano vulnerabilità logiche o injection, ma riducono una famiglia storica di exploit usati per esecuzione di codice.

Cosa fare dopo aver scoperto una RCE su un sistema esposto?

Dopo una RCE bisogna patchare, ma anche verificare eventuale sfruttamento precedente. Servono analisi dei log, ricerca di web shell, controllo dei processi, rotazione dei secret, verifica delle connessioni, hunting su sistemi collegati e validazione documentata della remediation.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.