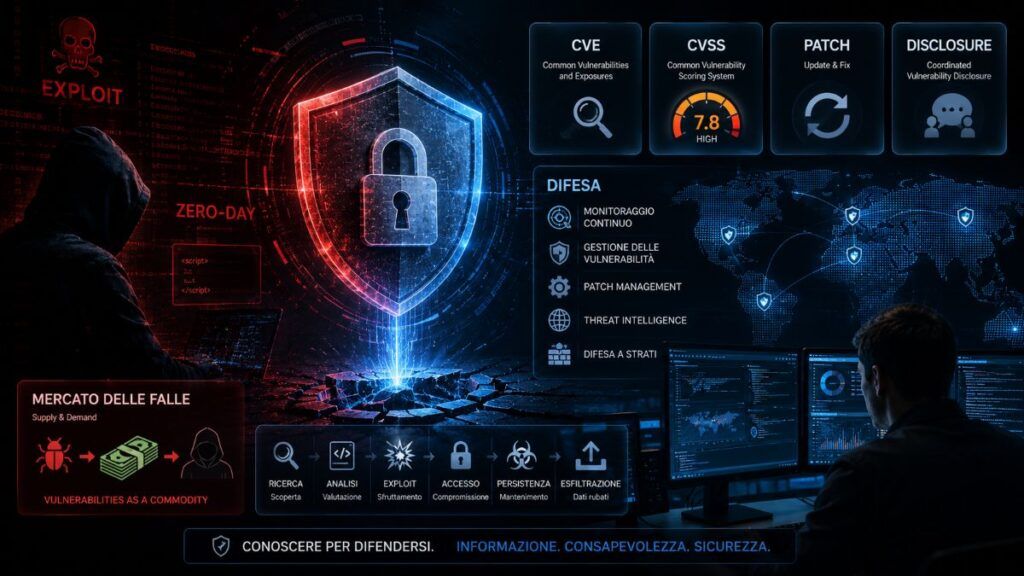

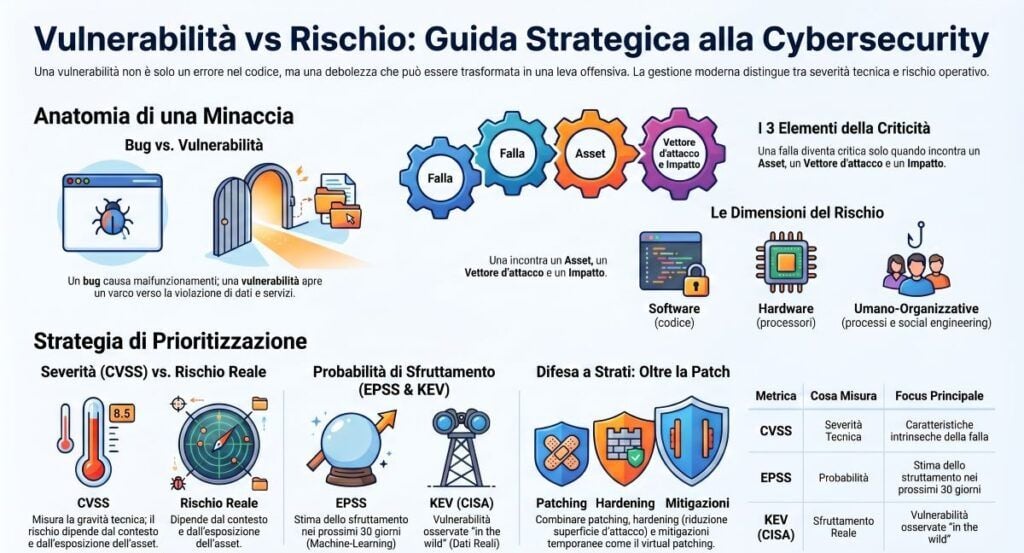

Una vulnerabilità informatica non è semplicemente un bug. È una debolezza tecnica, logica, architetturale, procedurale o organizzativa che può essere sfruttata per compromettere un sistema digitale. La differenza è sostanziale: un bug può produrre un malfunzionamento, un crash o un comportamento inatteso; una vulnerabilità, invece, apre un varco verso la violazione della riservatezza, dell’integrità o della disponibilità di dati, servizi e infrastrutture. La definizione adottata dal National Vulnerability Database lega infatti le vulnerabilità informatiche a una debolezza nella logica computazionale di software o hardware che, se sfruttata, produce un impatto negativo su confidenzialità, integrità o disponibilità. Questo passaggio è decisivo perché sposta la discussione dalla semplice qualità del codice alla possibilità concreta di attacco. Un errore applicativo può restare confinato in una funzione marginale e non generare rischio operativo. Al contrario, una configurazione debole su un servizio esposto, un endpoint amministrativo raggiungibile da Internet, una libreria vulnerabile caricata in una pipeline CI/CD o una policy IAM troppo permissiva possono diventare il punto di partenza di una compromissione reale. La vulnerabilità non vive mai nel vuoto: assume significato dentro un contesto tecnico, organizzativo e strategico. Nel linguaggio della cybersecurity moderna, una falla diventa critica quando incontra tre elementi: un asset vulnerabile, un vettore di attacco e un impatto misurabile. Il primo elemento indica il sistema, il software, il firmware, il servizio cloud o il dispositivo interessato. Il secondo descrive il percorso attraverso cui l’attaccante può raggiungere e sfruttare la debolezza. Il terzo chiarisce che cosa può accadere dopo lo sfruttamento: furto di dati, esecuzione di codice remoto, escalation di privilegi, movimento laterale, interruzione del servizio, persistenza o sabotaggio. Questa impostazione spiega perché la gestione delle vulnerabilità non può essere ridotta alla lettura meccanica di una sigla CVE. Il CVE Program nasce per identificare, definire e catalogare vulnerabilità di cybersecurity pubblicamente note, offrendo un riferimento comune a ricercatori, vendor, difensori e organizzazioni. Tuttavia, l’identificativo non basta. Serve capire dove si trova quella falla, se è esposta, se esiste un exploit, se viene già sfruttata e quale ruolo occupa dentro l’architettura aziendale. La vulnerabilità è quindi una categoria operativa. Non indica soltanto ciò che è “rotto”, ma ciò che può essere trasformato in leva offensiva.

È il motivo per cui una stessa CVE può essere urgente per un’organizzazione e quasi irrilevante per un’altra. Un server vulnerabile raggiungibile da Internet, usato per autenticazione o accesso remoto, ha una priorità diversa rispetto a un componente non esposto, segmentato e privo di dati sensibili. Nel primo caso la vulnerabilità è una porta. Nel secondo è una debolezza latente, da gestire ma non necessariamente da trattare come emergenza immediata. Questa distinzione emerge in modo costante negli incidenti reali. Le analisi pubblicate da Matrice Digitale sulle vulnerabilità critiche sfruttate negli ambienti Microsoft, Apache e Linux mostrano come il rischio nasca dall’incrocio tra vulnerabilità note, esposizione dei sistemi, disponibilità di exploit e ritardi nel patching. Allo stesso modo, i casi relativi a RCE in ambienti Node.js e librerie critiche dimostrano che il confine tra bug applicativo e compromissione completa può essere molto sottile quando un componente vulnerabile opera in un contesto ad alto privilegio.

Cosa leggere

Vulnerabilità, esposizione e sfruttamento

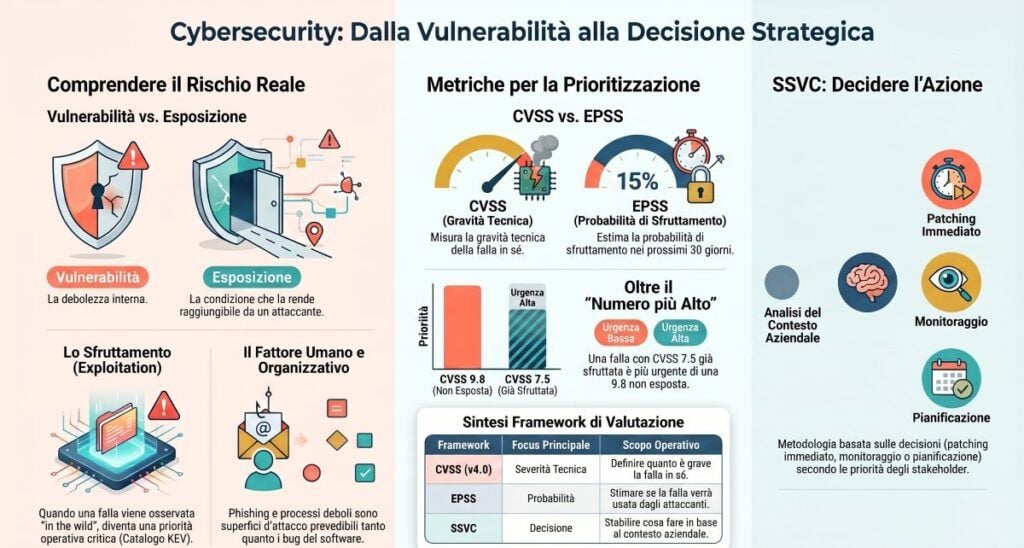

La prima distinzione da fissare è quella tra vulnerabilità, esposizione e sfruttamento. La vulnerabilità è la debolezza. L’esposizione è la condizione che rende quella debolezza raggiungibile, significativa o utile per un attaccante. Lo sfruttamento è l’azione con cui la debolezza viene trasformata in accesso, danno o controllo. Una vulnerabilità può esistere senza essere immediatamente esposta. Un componente difettoso può trovarsi su una macchina interna, non raggiungibile da Internet, protetta da segmentazione efficace e priva di privilegi rilevanti. In quel caso il rischio non scompare, ma cambia forma. Diventa un rischio condizionato: può essere sfruttato solo dopo un’altra compromissione, dopo il furto di credenziali, dopo il superamento di un confine di rete o dopo il movimento laterale. L’esposizione, invece, descrive il grado di contatto tra la vulnerabilità e la superficie d’attacco. Una console amministrativa pubblica, una VPN vulnerabile, un pannello di gestione non aggiornato, una API senza controllo di accesso o un bucket cloud configurato male non sono soltanto problemi tecnici. Sono punti in cui l’architettura offre all’attaccante un percorso. La Cloud Security ruota proprio intorno a questa logica: nel cloud, una misconfiguration può avere lo stesso effetto pratico di una CVE critica, perché rende accessibili risorse che dovrebbero restare protette. Lo sfruttamento è il passaggio più grave. Qui la vulnerabilità smette di essere un dato inventariale e diventa un fatto operativo. Un exploit può essere pubblico, integrato in framework offensivi, venduto in circuiti privati o usato da gruppi criminali e attori statali. Quando CISA inserisce una vulnerabilità nel catalogo Known Exploited Vulnerabilities, segnala che quella falla non è solo teorica, ma è stata osservata in sfruttamento reale. Il catalogo KEV viene infatti presentato da CISA come una fonte autorevole di vulnerabilità sfruttate in the wild e come input per la gestione delle priorità difensive. Questo cambia il modo di decidere.

Una falla con punteggio teorico elevato ma non esposta può essere meno urgente di una vulnerabilità con punteggio inferiore, già sfruttata, presente su sistemi perimetrali e priva di controlli compensativi. È qui che la cybersecurity abbandona la logica del “numero più alto” e diventa intelligence sul rischio. La domanda non è solo “quanto è grave?”, ma “quanto è probabile che venga usata contro di noi, quanto siamo esposti e quanto danno può produrre nel nostro ambiente?”.

Tassonomia del rischio e classificazione delle falle

Classificare le vulnerabilità significa ordinare un ecosistema estremamente frammentato. Le falle possono nascere nel codice, nel kernel, nel firmware, nel silicio, nelle API, nei protocolli, nella configurazione cloud, nei processi interni o nel comportamento umano. Una tassonomia utile non deve limitarsi a etichette tecniche, ma deve spiegare dove nasce la debolezza, come può propagarsi e quale livello dell’infrastruttura può compromettere. La Common Weakness Enumeration, gestita da MITRE, offre una tassonomia delle debolezze software e hardware che possono diventare vulnerabilità. La distinzione è importante: una weakness è una classe di errore o debolezza ricorrente, mentre una CVE identifica una vulnerabilità specifica in un prodotto, componente o implementazione. In pratica, CWE descrive la famiglia del problema; CVE identifica l’istanza concreta osservata nel mondo reale. Le grandi famiglie del rischio possono essere ricondotte a tre dimensioni principali: software, hardware e fattore umano-organizzativo. Le vulnerabilità software riguardano codice, logica applicativa, framework, librerie, dipendenze, servizi di rete e sistemi operativi. Le vulnerabilità hardware abitano in processori, firmware, periferiche, moduli di sicurezza, dispositivi embedded e componenti fisici. Le vulnerabilità umane e organizzative derivano da processi deboli, privilegi eccessivi, formazione insufficiente, procedure non verificate e comportamenti sfruttabili attraverso social engineering. Le vulnerabilità software includono errori di logica e difetti di memoria. Gli errori di logica possono consentire bypass di autorizzazione, accesso a dati altrui, abuso di funzioni amministrative o manipolazione di flussi applicativi. I difetti di memoria, invece, comprendono buffer overflow, use-after-free, heap overflow, out-of-bounds read e out-of-bounds write. Questi problemi possono provocare crash, divulgazione di informazioni o esecuzione di codice arbitrario. Le analisi di Matrice Digitale sulle vulnerabilità Dell ControlVault e sui buffer overflow nelle API hardware mostrano quanto il rischio possa diventare profondo quando una falla interessa componenti ritenuti trusted. Le vulnerabilità hardware, invece, hanno mostrato la loro portata globale con casi come Spectre e Meltdown. Il National Vulnerability Database descrive CVE-2017-5754, associata a Meltdown, come una debolezza in sistemi con microprocessori che utilizzano esecuzione speculativa e indirect branch prediction, capace di consentire divulgazione non autorizzata di informazioni tramite side-channel analysis. Le varianti Spectre, tracciate anche da CVE-2017-5753 e CVE-2017-5715, hanno evidenziato come l’ottimizzazione delle CPU possa produrre effetti collaterali misurabili e sfruttabili. Il terzo livello è quello umano e organizzativo. Phishing, vishing, MFA fatigue, furto di token, abuso di account legittimi e procedure di reset deboli non sono vulnerabilità nel senso classico della CVE, ma producono lo stesso risultato: permettono all’attaccante di ottenere un vantaggio. In un ambiente maturo, il fattore umano non va trattato come colpa individuale, ma come superficie d’attacco prevedibile. La difesa efficace non chiede all’utente di essere perfetto; costruisce controlli che limitano il danno quando l’errore si verifica.

Scoring e metriche: il linguaggio universale del CVSS

Il Common Vulnerability Scoring System è diventato il linguaggio comune per descrivere la gravità tecnica delle vulnerabilità. La sua utilità è evidente: consente a vendor, ricercatori, team SOC, amministratori e responsabili della sicurezza di parlare con una metrica condivisa. Tuttavia, il CVSS non deve essere confuso con il rischio complessivo. Il National Vulnerability Database precisa che il CVSS fornisce una misura qualitativa della severity, ma non è una misura del rischio. Questa distinzione è essenziale per evitare uno degli errori più diffusi nel vulnerability management: ordinare le patch soltanto in base al punteggio. Un CVSS 9.8 può sembrare più urgente di un CVSS 7.5, ma la realtà dipende dal contesto. Se il primo riguarda un componente non installato o non esposto, mentre il secondo colpisce una VPN usata per l’accesso remoto e già sfruttata in attacchi reali, la priorità cambia radicalmente. Il CVSS misura caratteristiche tecniche della vulnerabilità. Il rischio, invece, nasce dall’incrocio tra severity, esposizione, minaccia, asset coinvolto, controlli esistenti e impatto sul business. Per questo nel 2026 la maturità non consiste nel conoscere il punteggio, ma nel saperlo collocare dentro una catena decisionale più ampia. La differenza tra “vulnerabilità grave” e “vulnerabilità prioritaria” è il punto in cui la sicurezza diventa governance.

CVSS v4.0 e cosa cambia davvero

CVSS v4.0 introduce una lettura più articolata rispetto alle versioni precedenti. FIRST descrive CVSS v4.0 come lo standard ufficiale per rappresentare le caratteristiche di una vulnerabilità attraverso una stringa vettoriale e metriche che permettono di raffinare la severity sulla base di intelligence e contesto ambientale. La struttura non va letta come un semplice aggiornamento numerico, ma come un tentativo di rendere la valutazione più vicina all’uso operativo. Il cambiamento più importante riguarda il modo in cui vengono separate le qualità intrinseche della vulnerabilità, le informazioni di minaccia e il contesto dell’organizzazione. Nel linguaggio storico di CVSS v3.1 si parlava di Base, Temporal ed Environmental metric groups; CVSS v4.0 riorganizza il modello e introduce una distinzione più chiara tra metriche Base, Threat, Environmental e Supplemental. La metrica Base descrive ciò che la vulnerabilità è in sé. La componente Threat integra informazioni legate allo sfruttamento. La parte Environmental consente di adattare la valutazione al contesto specifico. Le Supplemental metrics aggiungono informazioni utili senza modificare direttamente lo score finale. Il Base Score resta il punto di partenza. Descrive elementi come vettore d’attacco, complessità, requisiti di privilegio, interazione utente e impatto. È il livello più “universale” della valutazione, perché cerca di descrivere la vulnerabilità indipendentemente dall’ambiente in cui viene installata.

Ma proprio per questo non può rispondere alla domanda più importante per un’organizzazione: quanto è urgente per me?

La componente Threat serve a leggere la finestra di opportunità degli attaccanti. Una vulnerabilità non sfruttata, priva di exploit pubblico e difficile da attivare non genera la stessa pressione di una falla già usata in campagne reali. Qui entrano in gioco informazioni provenienti da cataloghi come KEV, bollettini CERT, advisories dei vendor, osservazioni dei CSIRT e indicatori di threat intelligence. La priorità non dipende solo dalla possibilità tecnica, ma dalla probabilità che quella possibilità venga effettivamente usata. La componente Environmental è la più vicina alla realtà aziendale. Una stessa vulnerabilità può avere impatto diverso se colpisce un sistema isolato o un servizio esposto, una workstation generica o un domain controller, un laboratorio o una piattaforma di pagamento. Questo livello permette di correggere la severità astratta con il contesto concreto. È la parte che molte organizzazioni trascurano, ma è anche quella che trasforma il CVSS da dato tecnico a strumento decisionale.

EPSS e probabilità di sfruttamento

Accanto al CVSS, l’Exploit Prediction Scoring System offre una prospettiva diversa. EPSS, sviluppato nell’ambito FIRST, è un modello data-driven basato su machine learning che stima la probabilità che una CVE pubblicata venga sfruttata in the wild nei successivi trenta giorni. Questa differenza è cruciale: mentre il CVSS misura la severità tecnica, EPSS prova a stimare la probabilità di sfruttamento osservabile. EPSS non sostituisce CVSS. Lo completa. Una vulnerabilità può avere severity elevata ma bassa probabilità di sfruttamento, oppure severity media e probabilità molto alta. Nel secondo caso, per molte organizzazioni, la priorità operativa può essere maggiore. FIRST chiarisce che EPSS restituisce valori tra 0 e 1, cioè tra 0% e 100%, dove valori più alti indicano maggiore probabilità di sfruttamento. L’uso corretto di EPSS richiede prudenza. Un modello predittivo non è una profezia e non sostituisce la valutazione interna. Funziona bene come segnale di priorità, soprattutto quando deve aiutare team sovraccarichi a scegliere tra migliaia di vulnerabilità. In ambienti enterprise, EPSS diventa utile se combinato con CVSS, asset inventory, esposizione Internet, criticità del sistema e osservazione del catalogo KEV. In Italia, anche il monitoraggio di ACN e CSIRT Italia mostra l’importanza di seguire l’evoluzione dinamica delle vulnerabilità. Le pagine ufficiali dedicate ad alert e bollettini raccolgono avvisi su PoC, aggiornamenti vendor, vulnerabilità critiche e scenari di sfruttamento. Questo significa che la priorità non può essere congelata al giorno della pubblicazione della CVE. Una falla può cambiare peso quando viene pubblicato un proof of concept, quando entra in una botnet, quando compare in campagne ransomware o quando un vendor rilascia dettagli aggiuntivi.

SSVC e la priorità vista dal difensore

La Stakeholder-Specific Vulnerability Categorization rappresenta un ulteriore passo nella maturazione del vulnerability management. CISA definisce SSVC come una metodologia di prioritizzazione che aiuta l’analista a decidere le azioni di risposta coerenti con le priorità concordate dagli stakeholder. Il punto è semplice: non basta calcolare un punteggio, bisogna decidere cosa fare. SSVC ragiona per decisioni. Una vulnerabilità può richiedere azione immediata, monitoraggio, pianificazione o gestione ordinaria in base a sfruttamento, esposizione, impatto tecnico, impatto missione e condizioni del contesto. Questo approccio è particolarmente utile per organizzazioni complesse, dove il patching immediato può avere effetti su produzione, continuità operativa, compliance e sicurezza fisica. L’idea più importante di SSVC è che la priorità non è universale. Un vendor, un coordinatore, un operatore di infrastrutture critiche e una piccola azienda non guardano la stessa vulnerabilità con gli stessi criteri. Il rischio è stakeholder-specific perché gli impatti sono diversi. Per una pubblica amministrazione, una vulnerabilità su un portale esposto può avere impatto reputazionale e di servizio. Per una banca, può coinvolgere continuità operativa e DORA. Per un ospedale, può toccare disponibilità dei sistemi clinici. Per un fornitore software, può diventare problema di supply chain.

Il ciclo di vita di una vulnerabilità

Ogni vulnerabilità attraversa un ciclo di vita. Nasce come debolezza non nota, viene scoperta, analizzata, comunicata, eventualmente sfruttata, corretta, mitigata e infine assorbita nei processi di gestione del rischio. In alcuni casi il ciclo è ordinato. In altri, diventa caotico: la falla viene sfruttata prima della patch, il PoC circola prima della mitigazione, i sistemi restano vulnerabili per mesi e gli attaccanti automatizzano lo sfruttamento. Capire il ciclo di vita è fondamentale perché permette di distinguere tra vulnerabilità latente, nota, divulgata, corretta, sfruttata e residuale. Una falla latente esiste ma non è ancora nota pubblicamente. Una falla nota può essere conosciuta dal vendor, da un ricercatore o da un gruppo ristretto. Una falla divulgata entra nel circuito pubblico attraverso CVE, advisory, mailing list, bollettini o report tecnici. Una falla corretta dispone di patch o mitigazione. Una falla sfruttata è già entrata nell’arsenale offensivo. Una falla residuale resta presente perché sistemi non aggiornati, appliance dimenticate o software legacy continuano a esporla.

Scoperta, audit e ricerca indipendente

La scoperta può avvenire in molti modi. Un vendor può individuare una falla durante test interni. Un ricercatore indipendente può trovarla attraverso fuzzing, reverse engineering, code review o analisi dinamica. Un team red team può scoprirla durante un audit. Un attaccante può usarla prima che chiunque altro la documenti. Una piattaforma di bug bounty può trasformare la ricerca distribuita in un canale controllato. Nel 2026 la scoperta è sempre più automatizzata. Strumenti di static analysis, dynamic analysis, fuzzing avanzato e modelli AI applicati al codice accelerano l’identificazione di pattern vulnerabili. Matrice Digitale ha già analizzato questo passaggio nel caso di OpenAI Codex Security e della scoperta automatizzata di vulnerabilità nei repository software. L’automazione, però, non elimina il ruolo dell’analista. Lo sposta verso validazione, contesto, impatto, riproducibilità e priorità. La scoperta di una vulnerabilità apre subito un problema di responsabilità.

Chi deve essere informato? Quando? Con quali dettagli? Con quale prova tecnica? Come si evita che la pubblicazione favorisca gli attaccanti prima dei difensori? È qui che entra la disclosure.

Zero-day e finestra di esposizione

Una zero-day è una vulnerabilità sconosciuta al vendor o priva di patch disponibile al momento dello sfruttamento. Il nome indica proprio l’assenza di tempo utile per difendersi con un aggiornamento ordinario: il difensore ha “zero giorni” di vantaggio. La zero-day è pericolosa non perché sia sempre tecnicamente perfetta, ma perché rompe la sequenza normale tra scoperta, correzione e patching. Nel mondo reale, una zero-day può essere usata da gruppi criminali, operatori statali, broker di exploit o attori ibridi. Può colpire browser, sistemi operativi, appliance perimetrali, smartphone, software enterprise o componenti cloud. Il valore strategico dipende da tre fattori: diffusione del bersaglio, affidabilità dell’exploit e possibilità di operare senza essere rilevati. Le zero-day non restano necessariamente tali per molto tempo. Quando emergono indicatori, crash anomali, campioni malware, telemetria, exploit chain o segnalazioni di vittime, la vulnerabilità può diventare nota, ricevere una CVE e generare una patch. Ma il danno può essere già avvenuto. Per questo la difesa moderna deve includere logging, segmentazione, monitoraggio comportamentale, EDR, threat hunting e controllo degli accessi: misure che non dipendono solo dalla conoscenza preventiva della CVE. Le cronache tecniche di Matrice Digitale sui Patch Tuesday Microsoft con zero-day già sfruttate e sugli exploit attivi contro Office, Windows e Outlook mostrano che il ciclo di vita delle vulnerabilità è sempre più compresso. Il tempo tra disclosure, PoC e sfruttamento si riduce. Le organizzazioni che trattano il patching come adempimento mensile rigido rischiano di arrivare tardi.

Disclosure coordinata e responsabilità pubblica

La Coordinated Vulnerability Disclosure è il processo con cui informazioni su una vulnerabilità vengono raccolte, coordinate tra gli stakeholder e divulgate insieme alle mitigazioni o alle correzioni disponibili. Il CERT/CC descrive la CVD come un processo che coinvolge finder, vendor, coordinatori e pubblico, con l’obiettivo di condividere informazioni e mitigazioni in modo responsabile. La disclosure coordinata nasce per ridurre il danno. Se un ricercatore pubblica dettagli completi prima che il vendor possa rilasciare una patch, gli attaccanti possono usare quelle informazioni contro utenti non protetti. Se invece il vendor ignora la segnalazione o ritarda senza motivo, gli utenti restano esposti e il ricercatore perde fiducia nel processo. La CVD cerca un equilibrio: dare tempo alla correzione, ma non permettere che la segretezza diventi inerzia. Il modello opposto è la full disclosure, cioè la pubblicazione completa e immediata dei dettagli tecnici. Storicamente ha avuto una funzione di pressione sui vendor, soprattutto quando le segnalazioni venivano ignorate. Ma in ambienti moderni, dove exploit e scansioni vengono automatizzati in poche ore, la full disclosure può aumentare il vantaggio degli attaccanti se non esistono patch o mitigazioni pronte. CISA ha costruito anche una Vulnerability Disclosure Policy Platform per promuovere la ricerca in buona fede e la disclosure coordinata nei sistemi federali statunitensi. (CISA) Il tema è rilevante anche per l’Europa e per l’Italia, soprattutto nel quadro NIS2. ACN indica la nuova normativa NIS come vigente dal 16 ottobre 2024 e si qualifica come autorità competente NIS e punto di contatto unico nazionale. (Agenzia delle Entrate) Nella prospettiva italiana, gestione delle vulnerabilità, notifica degli incidenti e resilienza dei servizi essenziali diventano parti dello stesso perimetro operativo.

Patch management e tempo di reazione

Il patch management è la fase in cui la vulnerabilità incontra la realtà dell’organizzazione. Non basta che una patch esista. Deve essere identificata, valutata, testata, distribuita, verificata e documentata. NIST definisce l’enterprise patch management come il processo di identificare, prioritizzare, acquisire, installare e verificare l’installazione di patch, update e upgrade lungo l’intera organizzazione. Il tempo di reazione è una difesa. Ogni giorno tra disclosure e remediation è una finestra utile per l’attaccante. In ambienti complessi, però, patchare tutto subito non è sempre possibile. Alcuni sistemi richiedono test, finestre di manutenzione, validazioni di compatibilità o coordinamento con fornitori. Questo non giustifica l’immobilismo, ma impone una strategia di priorità. Una gestione matura distingue tra patching ordinario, patching urgente e mitigazione temporanea. Il patching ordinario segue cicli programmati. Il patching urgente interviene su vulnerabilità sfruttate, esposte o critiche. La mitigazione temporanea riduce il rischio quando la patch non può essere applicata subito: disabilitazione di funzioni vulnerabili, restrizione degli accessi, regole WAF, segmentazione, blocco di indicatori, virtual patching o controlli compensativi. Il catalogo KEV di CISA è particolarmente utile perché permette di spostare l’attenzione dalle vulnerabilità teoricamente gravi a quelle sfruttate davvero. CISA rende disponibili anche i dati KEV in formati come CSV e JSON, proprio per favorire l’integrazione nei processi di vulnerability management. In Italia, i bollettini di ACN e CSIRT Italia forniscono un altro canale operativo per seguire aggiornamenti, PoC e vulnerabilità di particolare interesse nazionale.

Le grandi famiglie degli exploit

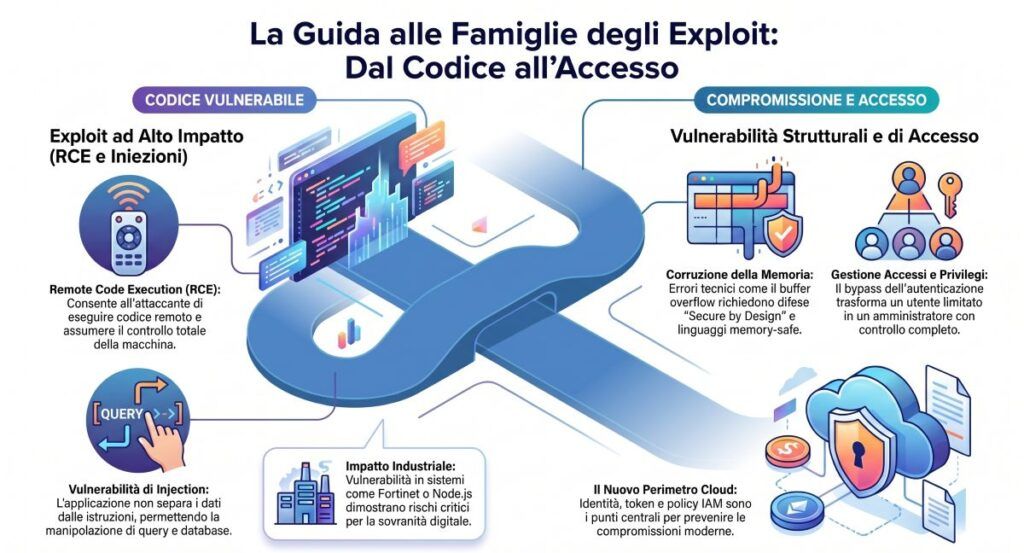

Un exploit è la tecnica, il codice o la sequenza operativa che sfrutta una vulnerabilità. Può essere una singola richiesta HTTP, un payload binario, una catena di vulnerabilità, una macro malevola, un abuso di API, una manipolazione della memoria o una sequenza di comandi. L’exploit è il ponte tra debolezza e compromissione. Le famiglie di exploit non sono compartimenti stagni. Un attacco moderno può iniziare con phishing, sfruttare una falla di autenticazione, ottenere RCE, elevare i privilegi, disattivare strumenti di difesa e muoversi lateralmente. La classificazione serve però a capire il tipo di controllo che è fallito e il tipo di difesa più adatto.

Remote Code Execution: il controllo totale

La Remote Code Execution è una delle classi più pericolose perché consente a un attaccante di eseguire codice su un sistema remoto. In pratica, il bersaglio non si limita a perdere dati: può diventare una macchina controllata dall’attaccante. Una RCE può derivare da deserializzazione insicura, command injection, template injection, sandbox escape, parsing vulnerabile, upload non controllato o difetti nella gestione degli input. Il pericolo della RCE dipende dal contesto di esecuzione. Se il processo vulnerabile gira con privilegi elevati, l’impatto può essere devastante. Se il servizio è esposto su Internet e non richiede autenticazione, il rischio cresce ancora. Se esiste un exploit pubblico affidabile, la vulnerabilità diventa candidata per campagne massive, botnet e ransomware. Gli esempi recenti analizzati da Matrice Digitale sono numerosi: Gemini CLI con RCE CVSS 10 e rischi sulle pipeline CI/CD, MetInfo, Weaver e AWS WorkSpaces con vulnerabilità critiche ed escalation, Fortinet e Node.js con patch urgenti per RCE e crash server. In tutti questi casi, la lezione è la stessa: l’esecuzione di codice remoto non è solo una categoria tecnica, ma una minaccia diretta alla sovranità del sistema.

Iniezione e manipolazione degli input

Le vulnerabilità di injection nascono quando un’applicazione tratta input non affidabile come comando, query, codice o istruzione. SQL injection, command injection, LDAP injection, template injection e cross-site scripting appartengono a questa famiglia allargata. La radice del problema è quasi sempre la stessa: l’applicazione non separa correttamente dati e istruzioni. Una SQL injection consente di manipolare query verso un database. Può permettere lettura, modifica o cancellazione di dati, bypass di autenticazione e, in alcuni contesti, esecuzione di comandi sul sistema. Una command injection permette di inviare istruzioni al sistema operativo. Una XSS consente di eseguire script nel browser della vittima, rubare sessioni, manipolare interfacce o avviare catene più complesse. Le injection sono pericolose perché spesso sono facili da automatizzare. Scanner, bot e framework offensivi cercano pattern ricorrenti su larga scala. Anche quando il singolo bug sembra banale, il suo sfruttamento può diventare industriale se colpisce CMS, plugin, framework o applicazioni molto diffuse. Per questo la difesa deve includere validazione degli input, parametrizzazione delle query, escaping contestuale, Content Security Policy, least privilege sui database e test applicativi continui.

Corruzione della memoria e exploit di basso livello

La corruzione della memoria è una delle aree più tecniche e storicamente più potenti dell’exploitation. Buffer overflow, heap spraying, use-after-free, double free e out-of-bounds write sfruttano errori nella gestione della memoria per alterare il flusso di esecuzione o leggere dati non autorizzati. In software scritto in C e C++, driver, firmware, browser engine e componenti multimediali, questa categoria resta particolarmente rilevante. Le mitigazioni moderne hanno reso più difficile lo sfruttamento diretto. ASLR, DEP, stack canary, Control Flow Integrity, sandboxing e memory tagging complicano il lavoro dell’attaccante. Ma non lo eliminano. Gli exploit più sofisticati concatenano bug diversi per superare le protezioni: una falla per ottenere information disclosure, una per corrompere la memoria, una per uscire dalla sandbox, una per elevare i privilegi. Il dibattito su Secure by Design ha riportato al centro anche i linguaggi memory-safe. CISA include nel proprio perimetro Secure by Design iniziative e roadmap per ridurre vulnerabilità come buffer overflow e classi di difetti legate alla memoria. ) Il punto non è ideologico. Se una classe di vulnerabilità deriva da un modello di memoria pericoloso, la riduzione strutturale del rischio passa anche da scelte architetturali e linguistiche, non solo da patch successive.

Autenticazione, autorizzazione e privilege escalation

Le vulnerabilità di autenticazione e autorizzazione sono tra le più dannose perché colpiscono il controllo degli accessi. Una falla di autenticazione permette di entrare senza dimostrare correttamente la propria identità. Una falla di autorizzazione permette di compiere azioni non consentite dopo l’accesso. Una privilege escalation permette di passare da un ruolo limitato a privilegi superiori. Queste vulnerabilità sono spesso meno spettacolari di una RCE, ma possono essere altrettanto gravi. Un bypass di autenticazione su una console amministrativa può consegnare il controllo dell’intero sistema. Un IDOR può esporre dati di altri utenti. Una policy IAM errata può consentire a un account di servizio di leggere segreti, creare nuove chiavi o assumere ruoli privilegiati. Una escalation locale può trasformare un accesso limitato in controllo completo. Il cloud amplifica questo problema. Identità, ruoli, token, secret, service account e API diventano il nuovo perimetro. Una credenziale rubata può essere più utile di un exploit complesso. Per questo le strategie di difesa devono includere MFA resistente al phishing, rotazione dei secret, logging, conditional access, least privilege e verifica continua. Nella guida di Matrice Digitale alla Cloud Security, IAM e Zero Trust emergono proprio come snodi centrali per ridurre l’impatto delle vulnerabilità tecniche e delle compromissioni di identità.

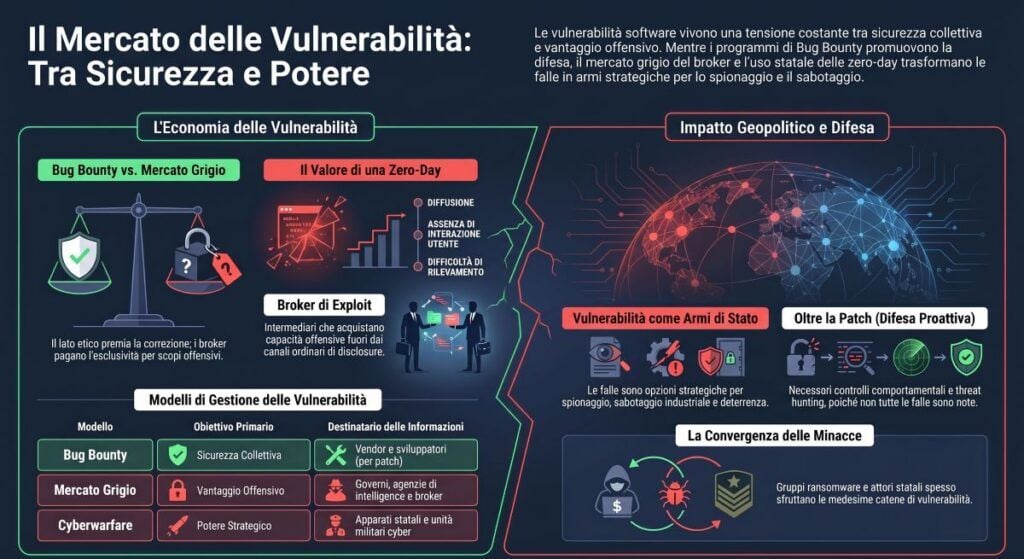

Il mercato e la geopolitica delle falle

Le vulnerabilità non sono soltanto oggetti tecnici. Sono anche risorse economiche, strumenti di pressione geopolitica e asset di intelligence. Una falla può essere comunicata al vendor, venduta a un broker, usata in una campagna criminale, trattenuta da un apparato statale o integrata in un’operazione di cyberwarfare. Il valore dipende da esclusività, affidabilità, bersaglio, silenziosità, catena di exploit e durata prima della scoperta. Questo mercato produce una tensione permanente tra sicurezza collettiva e vantaggio offensivo. Ogni vulnerabilità corretta riduce il rischio per tutti. Ogni vulnerabilità trattenuta mantiene aperta una possibilità di attacco. La geopolitica digitale vive dentro questa contraddizione: gli Stati dichiarano di voler proteggere infrastrutture e cittadini, ma alcuni apparati possono essere incentivati a conservare exploit utili per intelligence, sabotaggio o sorveglianza.

Bug bounty ed economia della ricerca etica

I bug bounty rappresentano il lato regolato e cooperativo dell’economia delle vulnerabilità. Un vendor o un’organizzazione autorizza ricercatori esterni a testare determinati sistemi secondo regole precise, riconoscendo ricompense per vulnerabilità valide. Il modello permette di intercettare competenze distribuite e trasformare la scoperta in un processo controllato. Il valore del bug bounty non è solo economico. È anche culturale. Un’organizzazione che definisce regole chiare, canali di disclosure, tempi di risposta e ambiti autorizzati riduce l’incertezza per i ricercatori. In assenza di policy, la ricerca in buona fede può essere percepita come attività ostile. Con una policy matura, invece, diventa parte dell’ecosistema di sicurezza. NIST sottolinea che formalizzare la ricezione, valutazione e gestione delle segnalazioni di vulnerabilità aiuta a ridurre vulnerabilità note ed esposizioni, migliorando postura di sicurezza, trasparenza e fiducia. Questo principio vale per enti pubblici, vendor software, operatori di servizi digitali e aziende private. Il punto centrale è costruire un rapporto prevedibile tra chi scopre e chi deve correggere.

Broker di exploit e mercato grigio

Il mercato grigio degli exploit opera in una zona più ambigua. Broker privati, intermediari e acquirenti selezionati possono trattare vulnerabilità e catene di exploit fuori dai canali ordinari di disclosure. Nomi come Zerodium e Crowdfense sono diventati noti nel dibattito pubblico proprio perché rappresentano un modello diverso dal bug bounty tradizionale: non premiare la correzione, ma acquistare capacità offensive o informazioni esclusive. In questo mercato, una zero-day affidabile su un sistema operativo mobile, un browser o una piattaforma di messaggistica può avere un valore elevatissimo. Il prezzo non riflette solo la complessità tecnica, ma la combinazione tra diffusione del bersaglio, possibilità di attacco remoto, assenza di interazione utente, persistenza e difficoltà di attribuzione. Una catena zero-click contro smartphone aggiornati vale molto più di un exploit locale contro software legacy, perché apre scenari di accesso silenzioso a bersagli ad alto valore. Dal punto di vista difensivo, il mercato grigio rende evidente un problema: non tutte le vulnerabilità note a qualcuno sono note al pubblico o al vendor. La sicurezza non può quindi dipendere soltanto dalla lista delle CVE pubblicate. Servono controlli comportamentali, segmentazione, hardening, gestione rigorosa delle identità, aggiornamenti tempestivi, threat hunting e capacità di rilevare anomalie anche senza conoscere in anticipo la falla specifica.

Cyberwarfare e vulnerabilità come armi di Stato

Quando una vulnerabilità entra nell’arsenale di uno Stato, cambia natura. Non è più soltanto una falla tecnica, ma un’opzione strategica. Può essere usata per spionaggio, preposizionamento, sabotaggio, raccolta di intelligence, influenza o deterrenza. Le vulnerabilità su prodotti enterprise, appliance perimetrali, software di gestione remota, piattaforme cloud, dispositivi mobili e sistemi industriali hanno valore perché permettono di entrare nei nodi sensibili dell’economia digitale. La cyberwarfare moderna non si basa solo su zero-day sofisticate. Spesso combina vulnerabilità note, configurazioni deboli, credenziali rubate, supply chain compromise e abuso di strumenti legittimi. Gli attori statali non scelgono sempre la tecnica più elegante: scelgono quella più efficace, silenziosa e compatibile con l’obiettivo. Una CVE già corretta può restare utile se molti bersagli non patchano. Un exploit pubblico può essere integrato in una campagna avanzata se consente accesso iniziale. Un account legittimo può essere più prezioso di una falla sconosciuta. Le vicende analizzate da Matrice Digitale sulla zero-day SharePoint sfruttata da attori legati alla Cina e sui ransomware che sfruttano catene di vulnerabilità su SharePoint mostrano come il confine tra vulnerabilità enterprise, spionaggio e criminalità organizzata sia sempre più poroso. La stessa classe di falla può essere usata da un gruppo ransomware, da un attore statale o da un intermediario criminale.

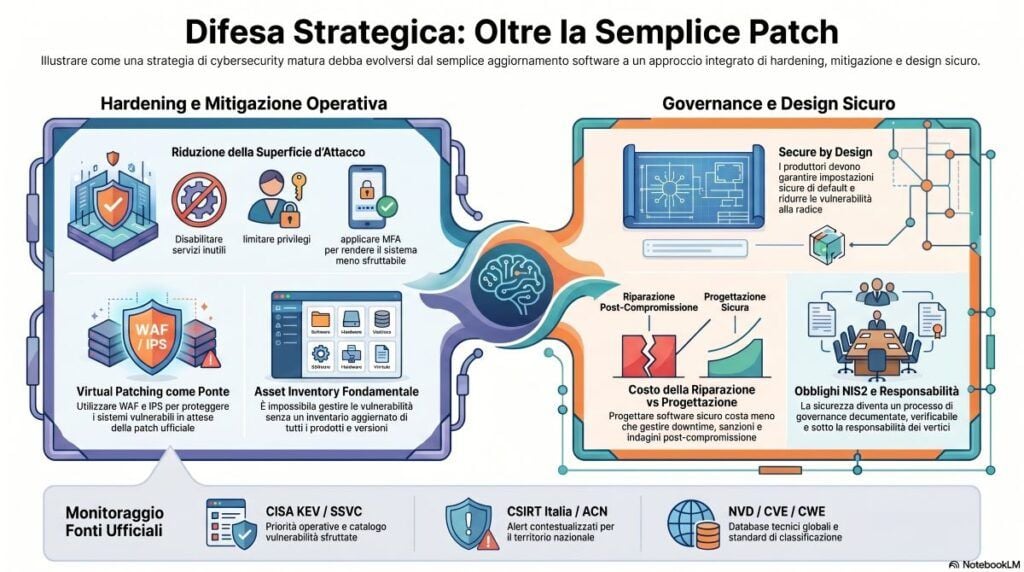

Difesa strategica e mitigazione

La difesa dalle vulnerabilità non può essere costruita solo sulla patch. La patch è necessaria, ma arriva sempre dopo la scoperta. Una strategia matura deve combinare prevenzione, riduzione della superficie d’attacco, monitoraggio, priorità, mitigazioni temporanee, architettura sicura e risposta agli incidenti. Il punto non è eliminare ogni vulnerabilità, obiettivo impossibile in infrastrutture complesse, ma ridurre la probabilità che una falla diventi compromissione sistemica.

Hardening e riduzione della superficie d’attacco

L’hardening è il processo con cui un sistema viene configurato per ridurre funzioni inutili, privilegi eccessivi, servizi esposti, protocolli deboli e percorsi d’attacco. Un sistema meno esposto è un sistema più difficile da sfruttare. Disabilitare componenti non necessari, limitare l’accesso amministrativo, applicare MFA, segmentare la rete, rimuovere account dormienti, controllare le porte aperte e applicare baseline sicure sono interventi che riducono il valore pratico delle vulnerabilità. La superficie d’attacco non è soltanto una questione di porte TCP. Include API, identità, endpoint, dispositivi mobili, servizi SaaS, repository, pipeline DevOps, pannelli di controllo, appliance VPN, strumenti di backup, console di gestione e accessi dei fornitori. Ogni nuova integrazione crea un nuovo confine. Ogni permesso permanente aumenta la possibilità di abuso. Nel contesto NIS2, questa logica diventa anche obbligo di governance. ACN descrive gli obblighi NIS come collegati alla gestione dei rischi per la sicurezza informatica, al ruolo degli organi di amministrazione e alla responsabilità dei soggetti essenziali e importanti. La guida Matrice Digitale su NIS online e piattaforma ACN spiega proprio questo passaggio: la sicurezza non è più soltanto presidio tecnico, ma processo documentato, aggiornato e verificabile.

Virtual patching, WAF e controlli compensativi

Il virtual patching è una misura temporanea che protegge un sistema vulnerabile senza modificare immediatamente il codice o installare la patch. Può essere realizzato tramite WAF, IPS, regole firewall, filtri applicativi, blocchi di pattern, restrizioni di accesso o disattivazione di funzioni vulnerabili. Non sostituisce la patch definitiva, ma può ridurre il rischio nella finestra più critica. Questo approccio è utile quando la patch non è subito disponibile o quando l’applicazione richiede test prima dell’aggiornamento. In ambienti industriali, sanitari, finanziari o legacy, l’installazione immediata può essere complessa. Ma l’impossibilità di patchare subito non deve diventare esposizione passiva. Una mitigazione temporanea ben documentata permette di guadagnare tempo e ridurre il vantaggio degli attaccanti. CISA ricorda che, quando disponibile, è buona pratica passare da workaround a patch ufficiale, ma riconosce l’utilità di una mitigazione quando la patch non può essere immediatamente applicata. Questo è il punto operativo: il workaround non è la soluzione finale. È un ponte. Se diventa permanente, rischia di creare falsa sicurezza.

Secure by Design e responsabilità dei produttori

Secure by Design significa progettare prodotti che riducano il rischio alla radice. Non basta chiedere agli utenti di configurare meglio, patchare più velocemente e leggere bollettini più lunghi. I produttori devono progettare software e servizi con impostazioni sicure di default, riduzione dei privilegi, logging adeguato, gestione robusta delle identità, aggiornamenti affidabili e minore esposizione a classi di vulnerabilità prevedibili. CISA presenta Secure by Design come un quadro rivolto ai produttori per sviluppare e comunicare roadmap di sicurezza, inclusa la riduzione di vulnerabilità ricorrenti e il rafforzamento della trasparenza. Questa impostazione ribalta una parte della responsabilità: la sicurezza non può essere scaricata interamente sul cliente finale. Se un prodotto nasce con password deboli, funzioni amministrative esposte, logging insufficiente e permessi eccessivi, il difensore parte già in svantaggio. Secure by Design è anche una risposta al fallimento del modello “patch after breach”. Ogni vulnerabilità corretta dopo lo sfruttamento produce costi: downtime, indagini, notifiche, perdita di dati, reputazione, audit, cause legali, sanzioni e ricostruzione dell’infrastruttura. Progettare meglio costa meno che riparare dopo una compromissione.

Monitoraggio operativo con CISA, ACN e database pubblici

Un’organizzazione matura deve monitorare costantemente fonti ufficiali e database pubblici. NVD, CVE, CWE, FIRST, CISA KEV, CSIRT Italia, advisories dei vendor e bollettini nazionali permettono di costruire un quadro aggiornato. Il problema non è la mancanza di informazioni, ma la capacità di trasformarle in priorità operative. Il flusso corretto parte dall’asset inventory. Non si può gestire ciò che non si conosce. Ogni CVE deve essere collegata a prodotti, versioni, esposizione, criticità dell’asset e controlli esistenti. Senza inventario, il vulnerability management diventa una lista infinita di sigle scollegate dalla realtà. Con un inventario maturo, invece, ogni alert può essere tradotto in domanda concreta:

siamo vulnerabili? Dove? Su quali sistemi? Con quale esposizione? Con quale priorità?

CSIRT Italia e ACN forniscono un canale essenziale per il contesto nazionale, soprattutto quando gli avvisi riguardano prodotti diffusi, PoC pubblici, vulnerabilità critiche o settori regolati. CISA offre invece un modello operativo molto utile attraverso KEV, SSVC, Cyber Hygiene e linee guida Secure by Design. NIST contribuisce con metodologie e pubblicazioni su patch management, disclosure e gestione del rischio. Insieme, queste fonti costruiscono la base minima per un programma serio. La difesa strategica non promette invulnerabilità. Promette riduzione del rischio, maggiore visibilità e tempi di risposta più brevi. In cybersecurity, la differenza tra incidente contenuto e compromissione sistemica spesso non sta nella presenza o assenza di una vulnerabilità, ma nella capacità di rilevarla, contestualizzarla e agire prima che diventi catena d’attacco.

FAQ sulle vulnerabilità informatiche

Che cos’è una vulnerabilità informatica?

Una vulnerabilità informatica è una debolezza in software, hardware, configurazioni, processi o controlli che può essere sfruttata per compromettere riservatezza, integrità o disponibilità di dati e sistemi. Non coincide sempre con un bug, perché conta soprattutto la possibilità concreta di trasformare il difetto in attacco.

Qual è la differenza tra CVE e CWE?

CVE identifica una vulnerabilità specifica e pubblicamente nota, mentre CWE descrive una categoria di debolezza software o hardware che può generare vulnerabilità. In pratica, CVE nomina il caso concreto; CWE aiuta a classificare la radice tecnica del problema e a collegarla a famiglie ricorrenti di errore.

Il CVSS misura davvero il rischio di una vulnerabilità?

Il CVSS misura la gravità tecnica, non il rischio complessivo. Il rischio dipende anche da esposizione, asset coinvolto, exploit disponibili, sfruttamento attivo, controlli compensativi e impatto sul business. Per questo CVSS va combinato con EPSS, KEV, SSVC e asset inventory.

Che cos’è una vulnerabilità zero-day?

Una zero-day è una vulnerabilità sconosciuta al vendor o priva di patch disponibile al momento dello sfruttamento. È pericolosa perché rompe il ciclo ordinario della difesa: l’attaccante può usarla prima che utenti, aziende o amministratori abbiano un aggiornamento ufficiale da installare.

Che cosa significa RCE?

RCE significa Remote Code Execution e indica la possibilità di eseguire codice su un sistema remoto sfruttando una vulnerabilità. È una delle categorie più gravi perché può consentire controllo del server, installazione di malware, furto di dati, persistenza e movimento laterale nella rete.

Perché una vulnerabilità con CVSS alto non è sempre la più urgente?

Una vulnerabilità con CVSS alto non è sempre la più urgente perché potrebbe non essere presente, non essere esposta o non avere exploit disponibili. Una falla con punteggio inferiore ma già sfruttata, esposta su Internet e presente su asset critici può richiedere intervento immediato.

Che cos’è il catalogo KEV di CISA?

Il catalogo KEV di CISA raccoglie vulnerabilità note e già sfruttate in attacchi reali. È utile perché aiuta le organizzazioni a distinguere tra vulnerabilità teoricamente gravi e vulnerabilità osservate in attività ostili, rendendo più efficace la priorità di patching e mitigazione.

Che cosa significa disclosure coordinata?

La disclosure coordinata è il processo con cui ricercatori, vendor e coordinatori gestiscono la comunicazione di una vulnerabilità prima della pubblicazione completa. Serve a ridurre il danno, consentire la preparazione di patch o mitigazioni e informare il pubblico senza aumentare inutilmente il vantaggio degli attaccanti.

Come si difende un’azienda dalle vulnerabilità informatiche?

Un’azienda si difende con asset inventory, patch management, hardening, segmentazione, MFA, least privilege, monitoraggio, EDR, backup verificati, virtual patching e procedure di incident response. La strategia efficace non dipende da un solo controllo, ma dalla sovrapposizione di barriere tecniche, organizzative e operative.

Perché Secure by Design è importante?

Secure by Design è importante perché sposta la sicurezza all’origine del prodotto, riducendo vulnerabilità prevedibili, configurazioni insicure e dipendenza dal cliente finale. Un software progettato con impostazioni sicure, privilegi ridotti, logging adeguato e aggiornamenti affidabili abbassa il rischio prima che la falla diventi incidente.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.