Google Cloud accelera l’intelligenza artificiale enterprise su due fronti strategici: analisi dati e produzione video automatizzata. L’azienda introduce i nuovi proxy models, una tecnologia che rende le query SQL potenziate da LLM oltre 100 volte più veloci e fino a 400 volte più economiche, mentre contemporaneamente alimenta la pipeline AI di Glance, capace di trasformare automaticamente ore di video orizzontali in clip verticali ottimizzate per smartphone e feed mobili. Le due innovazioni condividono un obiettivo preciso: rendere l’IA realmente utilizzabile su scala industriale riducendo latenza, costi e complessità operativa. I proxy models sostituiscono gran parte delle chiamate a LLM completi nelle funzioni AI.IF e AI.CLASSIFY tramite modelli leggeri addestrati sugli embedding di Gemini. Glance invece sfrutta Speech-to-Text, Gemini e Vision API per generare oltre 10.000 clip video al giorno senza interventi manuali significativi. Google Cloud consolida così una strategia già evidente in recenti sviluppi su Gemini, BigQuery e AI generativa enterprise integrata direttamente nell’infrastruttura cloud.

Cosa leggere

I proxy models eliminano il collo di bottiglia delle query SQL con LLM

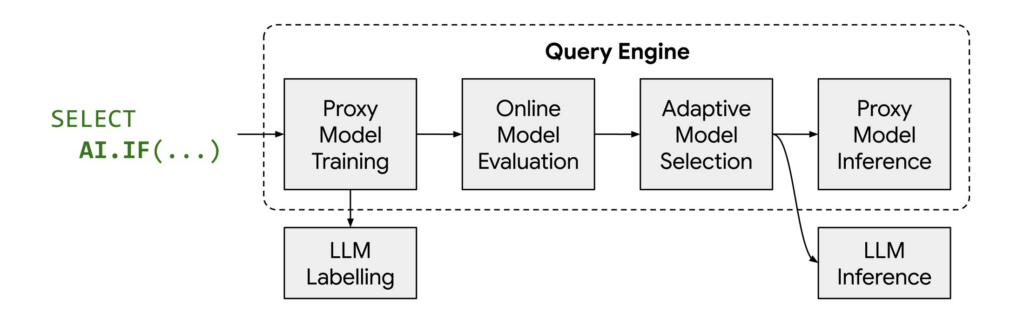

Le query SQL basate su LLM presentano un problema strutturale: ogni funzione semantica richiede enormi quantità di token e inferenze ripetute. Operazioni come classificazione testuale o analisi del significato su milioni di righe diventano rapidamente lente e costose. Google Cloud affronta il problema con i proxy models, piccoli modelli statistici addestrati direttamente sugli embedding prodotti da Gemini. Invece di invocare continuamente un LLM completo, il sistema utilizza regressori logistici o classificatori leggeri che replicano il comportamento semantico del modello principale con costi drasticamente inferiori. Le funzioni AI.IF e AI.CLASSIFY diventano così realmente utilizzabili su dataset enterprise di grandi dimensioni. La sintassi SQL resta invariata e l’infrastruttura esistente non richiede modifiche. Il risultato è una trasformazione radicale del rapporto tra SQL tradizionale e intelligenza artificiale semantica.

BigQuery attiva i proxy models direttamente durante la query

In BigQuery i proxy models operano in modalità completamente trasparente. L’utente scrive la stessa query SQL utilizzata normalmente con AI.IF o AI.CLASSIFY, ma il motore del database sostituisce automaticamente gran parte delle chiamate LLM con il proxy addestrato. Questo approccio “on-the-fly” elimina configurazioni aggiuntive e mantiene piena compatibilità con pipeline esistenti. Gli analisti possono quindi integrare ragionamento semantico direttamente nel layer SQL senza esportare dati verso servizi esterni. Query che prima richiedevano minuti o ore vengono completate in pochi secondi. La riduzione del consumo di token raggiunge fino a 400 volte rispetto alle inferenze standard. L’aspetto più importante è che l’accuratezza resta estremamente elevata: tra il 90 e il 116 percento rispetto al comportamento del LLM originale.

AlloyDB usa proxy offline riutilizzabili

In AlloyDB Google Cloud adotta invece una strategia offline. Gli amministratori preparano il modello proxy tramite il comando PREPARE, generando un classificatore che viene poi riutilizzato su query successive. Questo approccio riduce ulteriormente i costi su workload ripetitivi e ambienti ad alto traffico. Le organizzazioni possono così eseguire classificazioni semantiche continue senza dover richiamare costantemente Gemini. Il modello proxy resta locale al database e permette performance estremamente elevate anche su dataset giganteschi. AlloyDB si trasforma quindi in una piattaforma capace di combinare database relazionale e intelligenza artificiale direttamente nello stesso layer operativo. L’integrazione segue la strategia già visibile in BigQuery, AlloyDB AI e database intelligenti che incorporano inferenza generativa direttamente nelle query SQL.

AI.IF e AI.CLASSIFY diventano strumenti SQL quotidiani

Le funzioni AI.IF e AI.CLASSIFY cambiano completamente ruolo grazie ai proxy models. Prima erano strumenti sperimentali limitati da costi e latenza. Ora diventano funzioni operative utilizzabili quotidianamente nei workflow enterprise. Un analista può classificare clienti in base al sentiment di recensioni, identificare descrizioni semanticamente rilevanti, assegnare flag intelligenti o applicare logica contestuale direttamente all’interno della query SQL. Tutto avviene nel database senza pipeline ETL esterne o orchestrazioni aggiuntive. Questo approccio riduce enormemente complessità architetturale e tempi di elaborazione. Le aziende ottengono insight semantici in tempo reale anche su flussi dati live. LLM e database smettono di essere componenti separati e diventano parte dello stesso motore analitico.

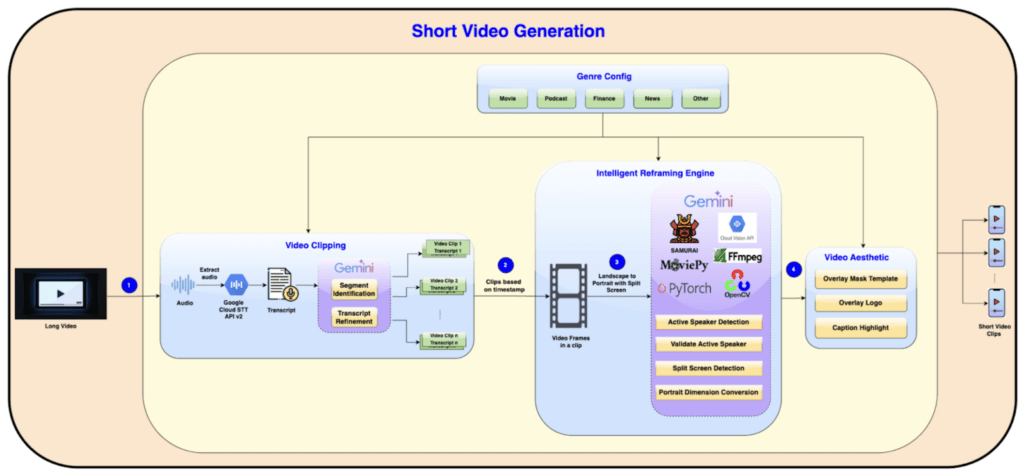

Glance trasforma video orizzontali in clip verticali automatiche

Parallelamente Google Cloud alimenta la piattaforma Glance, specializzata nella conversione automatica di contenuti video per smartphone. Il problema è enorme: la maggior parte dei contenuti originali viene prodotta in formato orizzontale lungo, mentre il consumo moderno avviene su feed verticali brevi da 30 a 180 secondi. La conversione manuale richiede ore di editing per ogni singolo video. Glance automatizza completamente il processo usando AI generativa e computer vision. La pipeline prende video da una o due ore e genera automaticamente clip verticali ottimizzate per dispositivi mobili. La scalabilità raggiunge oltre 10.000 video al giorno, triplicando la capacità precedente senza espandere il team editoriale.

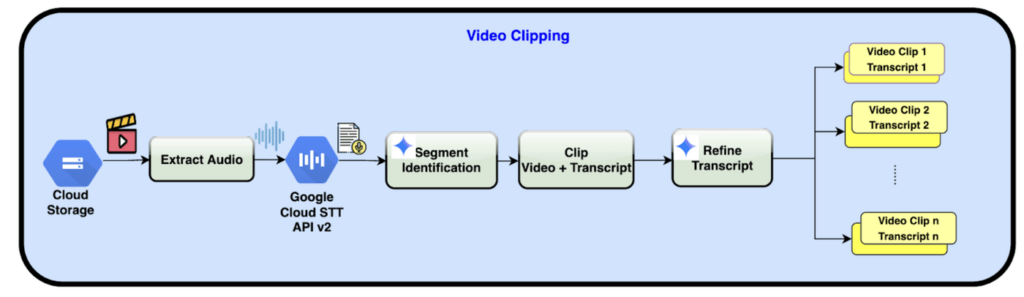

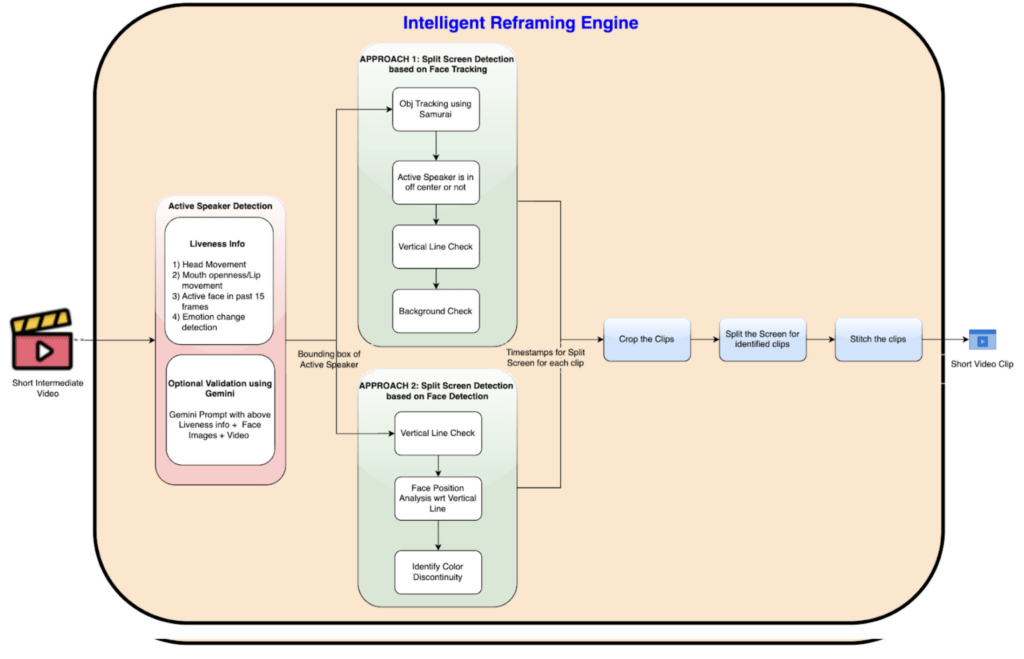

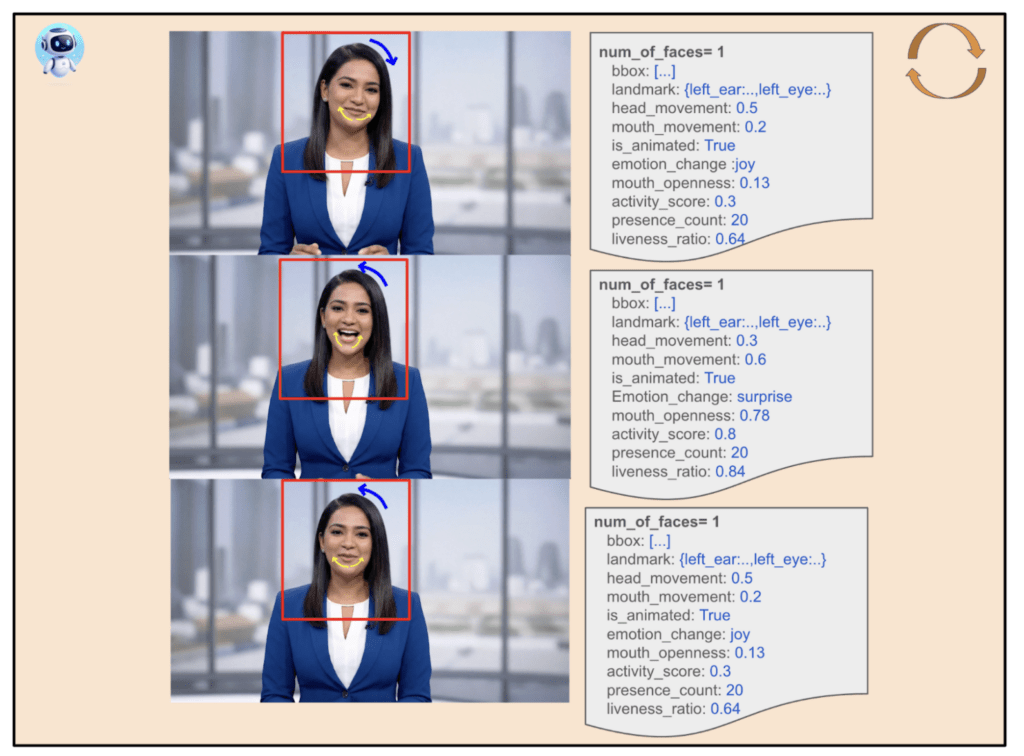

Speech-to-Text, Gemini e Vision API guidano il workflow video

La pipeline di Glance utilizza diversi servizi Google Cloud AI integrati tra loro. Speech-to-Text trascrive l’intero parlato e identifica momenti di engagement elevato tramite rilevamento del parlante attivo. Gemini analizza il contesto semantico e seleziona i segmenti più interessanti per il pubblico mobile. Vision API rileva volti, movimenti, composizione visiva e dinamiche di scena per eseguire il reframing automatico. Il sistema decide autonomamente dove centrare il video verticale mantenendo focus sul soggetto principale. Questa integrazione permette di trasformare contenuti lunghi in clip native per smartphone senza editing manuale. La pipeline dimostra quanto Google Cloud stia puntando sull’automazione AI multimodale per media e produzione contenuti.

Il reframing intelligente migliora qualità e engagement

Uno degli aspetti più sofisticati del sistema è il reframing intelligente. Il modello riconosce automaticamente split-screen, sovrapposizioni, soggetti multipli o azioni dinamiche e ricompone il contenuto in verticale senza tagli casuali. Le caption vengono generate dinamicamente solo quando utili e sincronizzate perfettamente con l’audio. Anche il branding si integra automaticamente evitando di coprire elementi importanti del frame. Il risultato finale appare molto più naturale rispetto ai tradizionali crop verticali automatici. Glance produce contenuti che sembrano progettati nativamente per TikTok, Shorts o lock screen mobile. Questa qualità permette ai publisher di aumentare drasticamente volume produttivo senza compromettere engagement o qualità percepita.

Glance scala da 3500 a oltre 10.000 video al giorno

L’impatto operativo è enorme. Prima della pipeline AI la produzione scalava fino a circa 3500 clip giornaliere. Dopo l’integrazione con Google Cloud AI la capacità supera le 10.000 clip al giorno. I creator caricano semplicemente un video lungo e ricevono in pochi minuti decine di clip già pronte per la pubblicazione. I costi di editing crollano mentre il time-to-publish si riduce drasticamente. Questo modello cambia completamente la produzione media mobile-first. Gli editor possono concentrarsi sulla strategia editoriale invece che sul montaggio manuale. Google Cloud dimostra così che l’AI generativa non è solo uno strumento creativo ma un acceleratore industriale per workflow reali.

Analytics e media convergono nella stessa infrastruttura AI

Le innovazioni di proxy models e Glance condividono la stessa filosofia: ridurre il costo operativo dell’AI mantenendo qualità elevata. Google Cloud integra capacità linguistiche, visive e semantiche direttamente nell’infrastruttura esistente. Le aziende possono combinare analisi dati e produzione media nello stesso ecosistema. Un retailer, per esempio, può analizzare recensioni con AI.CLASSIFY in BigQuery e generare automaticamente clip promozionali verticali basate sugli insight ottenuti. Il ciclo dal dato al contenuto si riduce da giorni a poche ore. Questa convergenza tra analytics e media AI rappresenta uno dei punti più importanti dell’evoluzione enterprise moderna.

Google Cloud spinge l’AI enterprise verso l’adozione reale

Con proxy models e pipeline video automatizzate Google Cloud affronta finalmente il problema più concreto dell’AI enterprise: la scalabilità economica. Gli LLM diventano utilizzabili su milioni di righe SQL senza costi proibitivi, mentre i workflow media raggiungono volumi impossibili da sostenere manualmente. L’infrastruttura AI si integra direttamente nei processi esistenti e richiede minima formazione aggiuntiva. Team analytics e team creativi ottengono strumenti potenti senza dover rivoluzionare pipeline o architetture. Google Cloud continua così a trasformare l’IA da tecnologia sperimentale a infrastruttura operativa quotidiana per aziende, media company e piattaforme digitali.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.