La Commissione europea avvia procedimenti formali contro X per accertare se la piattaforma abbia valutato e mitigato adeguatamente i rischi prima del lancio di Grok, lo strumento di intelligenza artificiale usato per generare immagini, incluse rappresentazioni sessualmente esplicite e deepfake sessuali. L’inchiesta, fondata sul Digital Services Act, segue segnalazioni su contenuti che potrebbero configurare materiale di abuso sessuale su minori, aprendo un fronte regolatorio ad alta intensità su una piattaforma designata come very large online platform nell’Unione europea.

Cosa leggere

Annuncio della Commissione europea e quadro Dsa

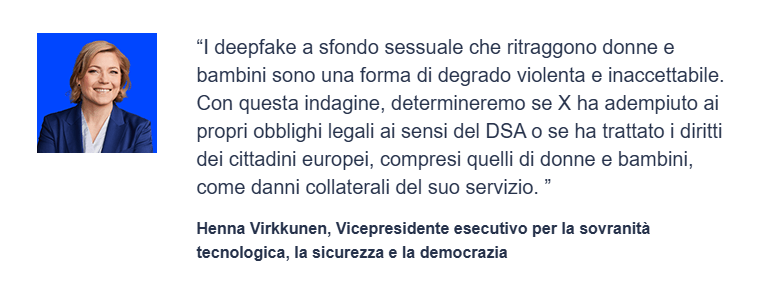

La procedura è stata annunciata dalla Commissione europea, che intende verificare se X abbia rispettato gli obblighi ex ante previsti dal Dsa, in particolare quelli relativi alla valutazione dei rischi sistemici, alla prevenzione della diffusione di contenuti illegali e alla tutela dei diritti fondamentali. La commissaria europea per la tecnologia Henna Virkkunen ha definito i deepfake sessuali di donne e bambini una forma di degradazione violenta e inaccettabile, chiarendo che l’indagine stabilirà se X abbia trattato i diritti dei cittadini europei come danni collaterali del proprio servizio.

X è classificata come piattaforma online molto grande ai sensi del Dsa, con oltre 45 milioni di utenti attivi mensili nell’Ue, e quindi soggetta a obblighi rafforzati di mitigazione dei rischi, trasparenza e accountability. L’indagine arriva dopo una sanzione da 120 milioni di euro inflitta a dicembre per violazioni degli obblighi di trasparenza sotto il Dsa, a conferma di un contesto di enforcement già inasprito.

Rischi materializzati con Grok e responsabilità della piattaforma

Secondo la Commissione, i rischi associati a Grok si sono materializzati nella generazione di immagini sessualmente esplicite manipolate, inclusi deepfake che possono coinvolgere minori. Il Dsa richiede che tali rischi siano identificati, valutati e mitigati prima del deployment, con misure proporzionate e verificabili. Il punto centrale dell’inchiesta è se X abbia svolto una risk assessment credibile e implementato controlli efficaci per impedire la produzione e la diffusione di contenuti illegali.

In questo perimetro rientrano anche le scelte di design e governance del modello, le policy di accesso e le limitazioni funzionali. La Commissione valuterà se le misure adottate siano state tempestive e sufficienti o se, al contrario, abbiano consentito una circolazione di contenuti che minacciano diritti fondamentali, in particolare la dignità e la sicurezza dei minori.

Scrutinio nel Regno Unito e negli Stati Uniti

L’attenzione regolatoria non è limitata all’Ue. Nel Regno Unito, l’Information Commissioner’s Office ha contattato X e xAI il 7 gennaio per chiedere dettagli sulle misure di conformità alla normativa sulla protezione dei dati. Il 12 gennaio, Ofcom ha avviato una propria indagine sulla sicurezza online, concentrandosi sulle immagini sessualizzate generate da Grok.

Negli Stati Uniti, il procuratore generale della California Rob Bonta ha aperto un’ulteriore inchiesta su materiale sessualmente esplicito non consensuale prodotto tramite Grok. Il coordinamento di interventi in più giurisdizioni segnala una preoccupazione globale per gli impatti dei generatori di immagini AI quando non adeguatamente governati.

La risposta di X e le critiche istituzionali

In risposta alle polemiche, X ha annunciato che limiterà la generazione e la modifica di immagini di Grok ai sottoscrittori paganti. La mossa ha però suscitato forti critiche: un portavoce del Primo Ministro britannico l’ha definita insultante per le vittime di misoginia e violenza sessuale, perché trasformerebbe una funzionalità capace di produrre immagini illegali in un servizio premium.

Questo passaggio è rilevante anche per l’indagine Ue, poiché il Dsa non valuta solo l’esito, ma anche la coerenza delle misure con l’obiettivo di riduzione del rischio. Spostare una funzionalità problematica dietro un paywall non equivale, di per sé, a mitigazione efficace.

Impatto su xAI e sul futuro di Grok

L’indagine coinvolge direttamente anche xAI, sviluppatrice di Grok. Le autorità hanno chiesto chiarimenti sulle salvaguardie tecniche, sulle policy di training e sulle barriere contro l’abuso. Le limitazioni annunciate cambiano il modello di accesso e incidono sull’esperienza degli utenti, ma non risolvono il nodo centrale: la prevenzione strutturale della generazione di contenuti illegali.

Per xAI, il caso rappresenta un test di governance: l’equilibrio tra innovazione rapida e responsabilità legale è ora sotto esame in mercati regolati chiave. Gli esiti delle indagini potrebbero imporre adeguamenti profondi al prodotto o aprire la strada a sanzioni e prescrizioni.

Contesto normativo e precedenti

Il Digital Services Act impone alle piattaforme molto grandi obblighi stringenti su risk management, trasparenza e protezione dei diritti. I precedenti di enforcement, inclusa la multa di 120 milioni di euro a X per trasparenza, indicano una linea rigorosa della Commissione. Il caso Grok si colloca in questo solco, con un focus specifico sui rischi dei generatori di immagini AI e sui deepfake sessuali, ambito destinato a diventare centrale nell’applicazione del Dsa.

Domande frequenti su X, Grok e l’indagine Ue

Perché l’Ue indaga X per Grok

Per verificare se X abbia valutato e mitigato correttamente i rischi prima del lancio di Grok, come richiesto dal Digital Services Act, a fronte di segnalazioni su immagini sessuali e deepfake, anche con potenziali coinvolgimenti di minori.

Cosa contesta la Commissione europea a X

La possibile insufficienza delle misure di prevenzione, la mancata o inadeguata valutazione dei rischi sistemici e la diffusione di contenuti illegali che minacciano i diritti fondamentali, in violazione degli obblighi Dsa per le piattaforme molto grandi.

Le limitazioni di Grok ai soli utenti paganti risolvono il problema

No. Spostare la funzionalità dietro un paywall non equivale a una mitigazione efficace del rischio. Il Dsa richiede misure strutturali che impediscano la generazione e la diffusione di contenuti illegali.

Quali conseguenze può affrontare X

Se venissero accertate violazioni, X potrebbe incorrere in sanzioni, prescrizioni operative e obblighi di adeguamento. Considerati i precedenti, l’enforcement Ue potrebbe essere significativo.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.