C’è una differenza sostanziale tra usare un Large Language Model e costruire l’infrastruttura che lo rende affidabile, scalabile e allineato a un dominio specifico. Netflix ha scelto la seconda strada. L’azienda ha sviluppato un framework interno per scalare il post-training degli LLM, trasformando quello che in laboratorio può sembrare un ciclo di fine-tuning relativamente lineare in un problema ingegneristico complesso, fatto di pipeline dati proprietarie, orchestrazione distribuita su cluster GPU e workflow che intercalano training e inferenza in modo continuo. L’obiettivo non è generico. Netflix non addestra modelli per scrivere poesia. Li adatta a raccomandazioni, personalizzazione, ricerca e interazione con il catalogo, in un contesto dove i vincoli di dominio, l’affidabilità e la latenza sono determinanti. Il post-training diventa quindi il punto in cui un modello open-weight, magari caricato da Hugging Face, viene riallineato agli intenti aziendali, ai dati proprietari e alle metriche di qualità interne.

Cosa leggere

Dal laboratorio al cluster GPU: quando il post-training diventa un abisso ingegneristico

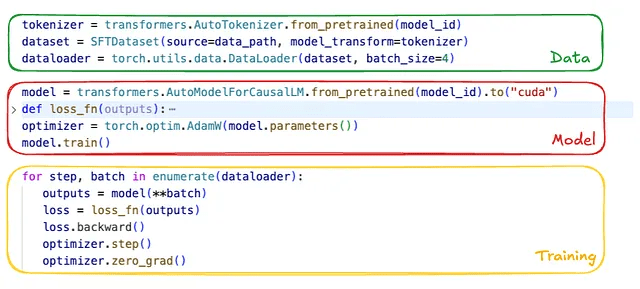

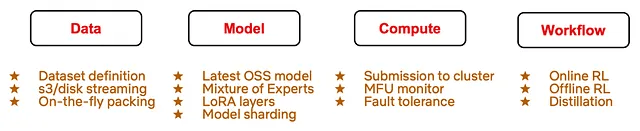

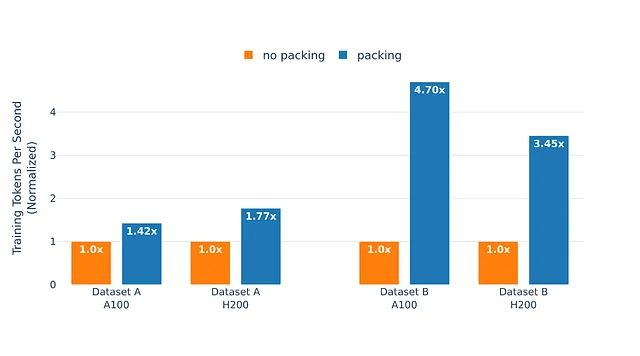

Il percorso tipico parte in modo apparentemente semplice. I ricercatori caricano un modello open-weight, integrano dati di dominio proprietari e avviano iterazioni su batch. In questa fase iniziale il processo sembra gestibile. Ma lo scaling cambia radicalmente lo scenario. Il controllo dei token, il mascheramento corretto per la loss, la gestione di sequenze variabili e il packing efficiente dei campioni trasformano il fine-tuning in una disciplina di ottimizzazione a più livelli. Netflix cura in modo esplicito il flusso dei dati: tokenizer come verità unica, preprocessing mirato, dataloader ottimizzati per ridurre padding e sprechi di computazione. Il mascheramento è cruciale: solo i token dell’assistente devono contribuire alla loss, evitando che il modello apprenda da prompt non target. La gestione delle lunghezze variabili porta a strategie di packing su sequenze fisse con maschere documento per prevenire cross-attention indesiderata. Ridurre padding significa liberare GPU, e liberare GPU significa iterare più velocemente.

Il caricamento dei checkpoint su GPU multiple introduce un altro livello di complessità. Netflix utilizza strategie di sharding come FSDP e parallelismo tensoriale, evitando la materializzazione completa del modello su ogni dispositivo. I pesi vengono distribuiti su mesh di device, rendendo il modello addestrabile in modalità full fine-tuning o tramite LoRA, a seconda del trade-off tra memoria e flessibilità. Il framework integra tecniche come activation checkpointing, compilazione ottimizzata e gestione accurata della precisione numerica. In presenza di vocabolari estesi e ID semantici custom, Netflix elimina token ignorati prima della proiezione e calcola logits e loss in chunk, riducendo picchi di memoria e cliff prestazionali.

Un framework che nasconde l’infrastruttura e libera la modellistica

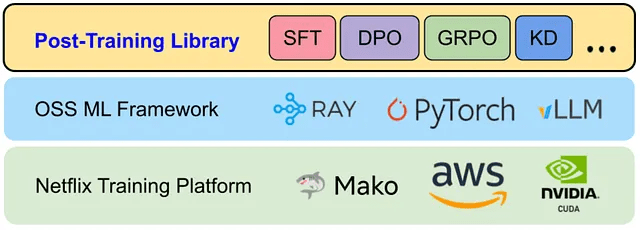

Il punto chiave del framework interno non è solo tecnico, ma organizzativo. Netflix ha deciso di nascondere la complessità infrastrutturale, permettendo ai ricercatori di concentrarsi sull’innovazione modellistica. Le job vengono configurate tramite file, con ricette standard per workflow come Supervised Fine-Tuning, Direct Preference Optimization, Reinforcement Learning e Knowledge Distillation.

Il framework integra componenti open-source come PyTorch, Ray e vLLM, ma li orchestra dentro uno stack proprietario che va dal provisioning GPU su AWS fino all’integrazione con pipeline dati interne. L’infrastruttura Mako gestisce il provisioning, mentre Ray coordina l’orchestrazione distribuita. vLLM viene utilizzato per allineare training e serving, riducendo lo skew silenzioso tra fase di addestramento e inferenza.

Questa astrazione permette di scalare da un singolo nodo a centinaia di GPU senza codice low-level ripetuto. Le API di sharding sono ad alto livello, la submission dei job è unificata e il monitoraggio include metriche di qualità e di efficienza, come la Model FLOPs Utilization, tracciata con precisione anche in scenari LoRA.

Dal SFT al Reinforcement Learning online: evoluzione architetturale

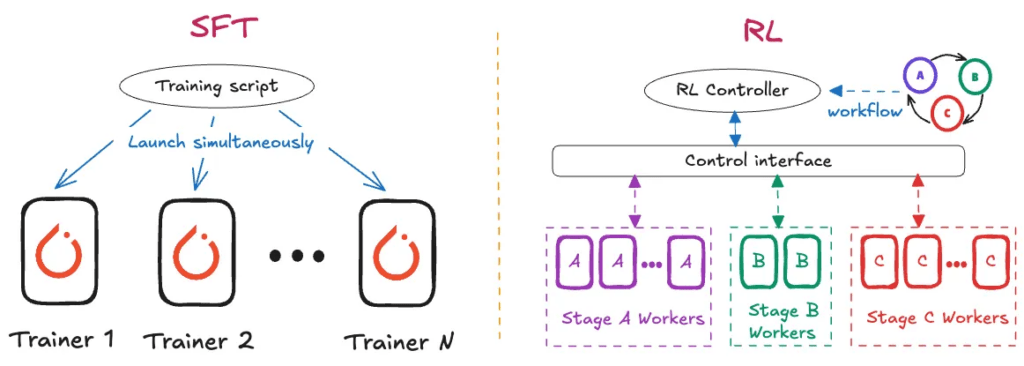

Il framework nasce inizialmente per dati statici e loop di training relativamente lineari. Ma con l’introduzione di metodi di Reinforcement Learning on-policy e approcci efficienti come GRPO, Netflix ha dovuto ripensare l’architettura. La loss differenziabile dello SFT lascia spazio a segnali più sparsi e complessi tipici del RL.

Il driver del training evolve in un controller attivo, capace di coordinare sub-stages distinti e ruoli separati. Netflix integra backend come Verl per la gestione del lifecycle degli actor, mantenendo separata l’orchestrazione dalla modellistica. Il paradigma SPMD viene esteso a scenari RL online con modelli ibridi, consentendo cicli multi-stage più articolati. Questo passaggio è fondamentale: significa che il framework non è solo uno strumento di fine-tuning, ma una piattaforma per sperimentazione rapida e iterativa, dove nuove tecniche possono essere integrate senza riscrivere l’infrastruttura.

Vocabolari estesi, sequenze non linguistiche e modelli oltre il testo

Uno degli aspetti più interessanti riguarda la gestione di vocabolari estesi e sequenze non linguistiche. Netflix addestra modelli anche su dati dominio-specifici che non sono puro testo naturale. Questo richiede ID semantici custom, embedding extra e output head personalizzate.

Il framework supporta varianti architetturali moderne come Qwen3 e Gemma3, MoE e modelli con head multiple. Le conversioni tra formati Hugging Face e rappresentazioni interne ottimizzate vengono automatizzate, anche con l’ausilio di agenti AI per verificare implementazioni e controllare logits con tolleranze definite. La gestione di sequenze con varianza estrema impone packing on-the-fly asincrono e overlap tra CPU e GPU per ridurre tempi di idle. Netflix dichiara miglioramenti di throughput fino a 4,7 volte in alcuni workload reali grazie a queste ottimizzazioni.

Allineamento tra training e serving: evitare lo skew silenzioso

Un problema sottovalutato nel ciclo LLM è il disallineamento tra training e serving. Netflix affronta questo rischio integrando il framework con vLLM, in modo da mantenere coerenza tra comportamento in addestramento e comportamento in produzione. L’allineamento riduce errori difficili da diagnosticare e permette di verificare rapidamente l’impatto delle modifiche. Il checkpointing non riguarda solo i pesi del modello, ma anche stati di dataloader e mixer, garantendo resumption esatta dopo interruzioni e tolleranza ai guasti in cluster distribuiti. L’obiettivo finale è chiaro: trasformare il post-training in un processo industrializzato, dove ogni componente – dati, modelli, computazione e workflow – è ottimizzato e misurato.

Un vantaggio competitivo basato sull’ingegneria, non solo sui modelli

Nel panorama AI attuale, molte aziende competono sulla dimensione del modello o sulla novità architetturale. Netflix sceglie una strada diversa: costruire un’infrastruttura che consenta iterazioni veloci, sperimentazione continua e integrazione profonda con il proprio ecosistema dati. Il framework interno non è solo un tool tecnico. È un acceleratore organizzativo che abbassa le barriere per i team interni, standardizza workflow e permette di adottare tecniche avanzate senza attrito eccessivo. In un contesto in cui la differenza tra un’idea e un prodotto può essere il tempo di iterazione, questa capacità diventa un vantaggio competitivo concreto. Scalare il post-training significa rendere sistemico ciò che altrove resta artigianale. Per Netflix, l’LLM non è un oggetto statico, ma un sistema dinamico che deve riflettere il catalogo, le interazioni utente e i vincoli di affidabilità in continua evoluzione. Il framework interno è la risposta a questa complessità: non una scorciatoia, ma un’architettura che trasforma l’innovazione in processo ripetibile.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.