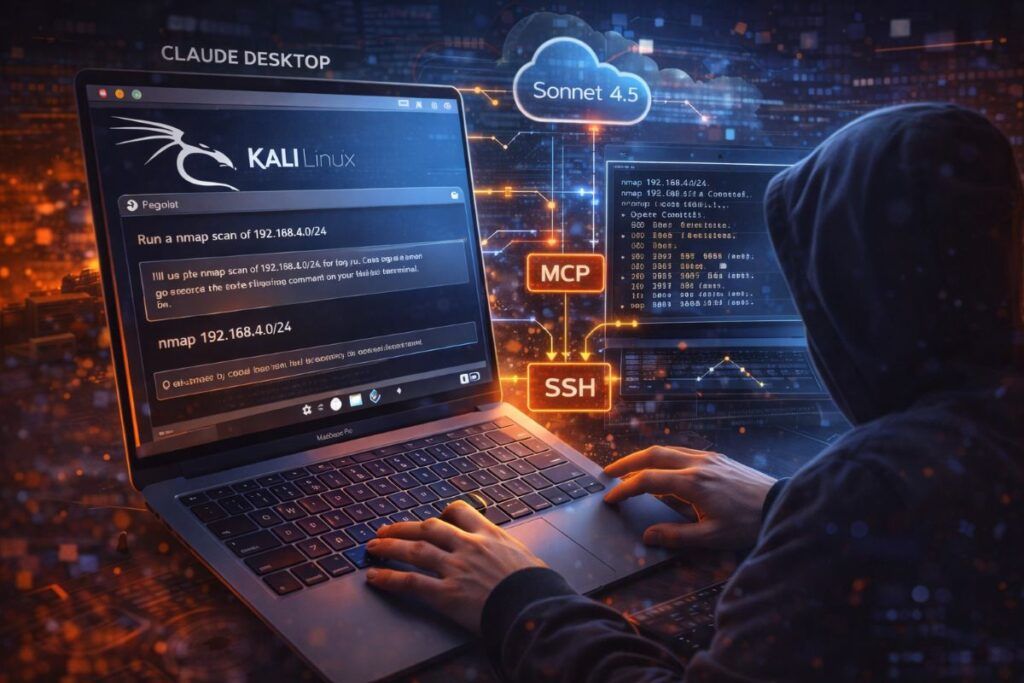

Kali Linux prova a fare quello che molti pentester fanno già “a mano” da mesi: trasformare la conversazione in un’interfaccia operativa. L’idea è semplice e, proprio per questo, potente. Sul Mac gira Claude Desktop, l’app ufficiale di Anthropic. In remoto o in VM gira Kali Linux, con i suoi tool. Nel cloud lavora Claude Sonnet 4.5, che interpreta la richiesta in linguaggio naturale e la traduce in una sequenza di azioni eseguibili. La colla tra i tre mondi è il Model Context Protocol (MCP), un meccanismo che permette al modello di interrogare un “server strumenti” e di invocare comandi in modo controllato. Questa integrazione segna un cambio di passo per un motivo preciso: sposta il baricentro dalla sintassi alla procedura. Nel penetration testing reale, la fatica non è scrivere “nmap -sV”, è ricordare cosa fare dopo, come concatenare output, come evitare errori banali quando l’analisi si allunga e il contesto cambia. L’LLM diventa un orchestratore, non un sostituto. E quando funziona, riduce la parte ripetitiva, quella che consuma tempo e attenzione senza aggiungere valore. Il punto chiave, però, è un altro. Se un modello è in grado di trasformare prompt in comandi, il confine tra “interfaccia comoda” e “automazione pericolosa” si assottiglia. Kali lo sa, e infatti l’impianto del setup è costruito attorno a controlli, log e scelte che mantengono l’umano nel loop. Ma resta un fatto: portare un LLM nel flusso operativo del pentesting significa introdurre una nuova superficie di rischio, soprattutto in termini di privacy, tracciabilità e governance degli input.

Cosa leggere

Un workflow a tre componenti, con un protocollo al centro

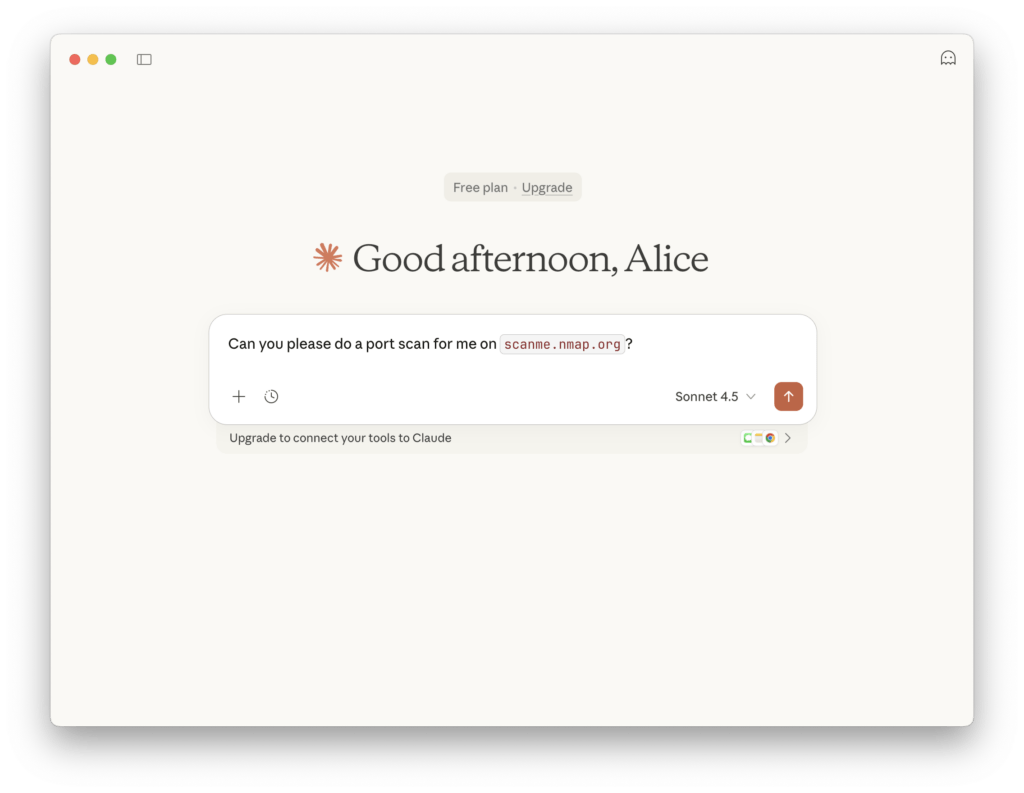

Il setup vive su tre componenti distinti. Il primo è macOS, che fornisce la GUI: Claude Desktop diventa una finestra in cui scrivere richieste naturali come “fammi una scansione delle porte e poi dimmi se c’è un servizio web interessante”. Il secondo è Kali Linux, che esegue gli strumenti. Il terzo è il modello nel cloud, Sonnet 4.5, che interpreta, pianifica e decide quali comandi inviare. Il Model Context Protocol è il passaggio decisivo perché trasforma l’LLM in un cliente che parla con un server. In pratica, Kali espone un MCP server che conosce gli strumenti disponibili e restituisce output. Claude Desktop, attraverso un file di configurazione JSON, definisce come connettersi a quel server. In molte implementazioni la connessione usa SSH, quindi la superficie di autenticazione non dipende da password o cookie, ma da chiavi, permessi e regole di accesso. Questa architettura spiega perché l’integrazione venga raccontata come un “desktop macOS che controlla Kali” più che come un “Kali con IA”. È una scelta comunicativa ma anche pratica: l’utente non viene spinto nel terminale, viene spinto in una GUI conversazionale. In termini di adozione, soprattutto per profili junior o per team misti, è una leva enorme. Non elimina la competenza, ma abbassa l’attrito iniziale.

Cosa cambia davvero: dal comando alla catena decisionale

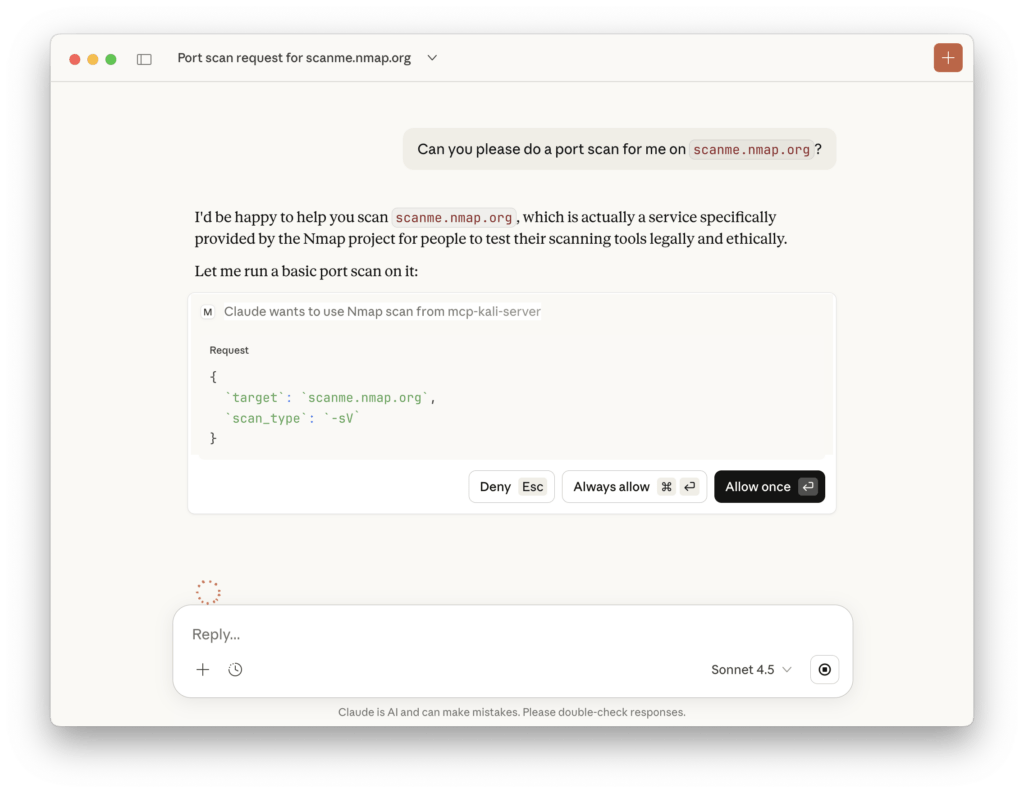

La promessa non è che Claude “lancia tool”. La promessa è che Claude gestisce la catena. Nel modello narrato, l’utente chiede una scansione su un target, e Claude fa una cosa che un umano diligente farebbe: verifica se lo strumento esiste, controlla il percorso binario, decide la sintassi corretta, esegue, poi legge il risultato e sceglie il passo successivo.

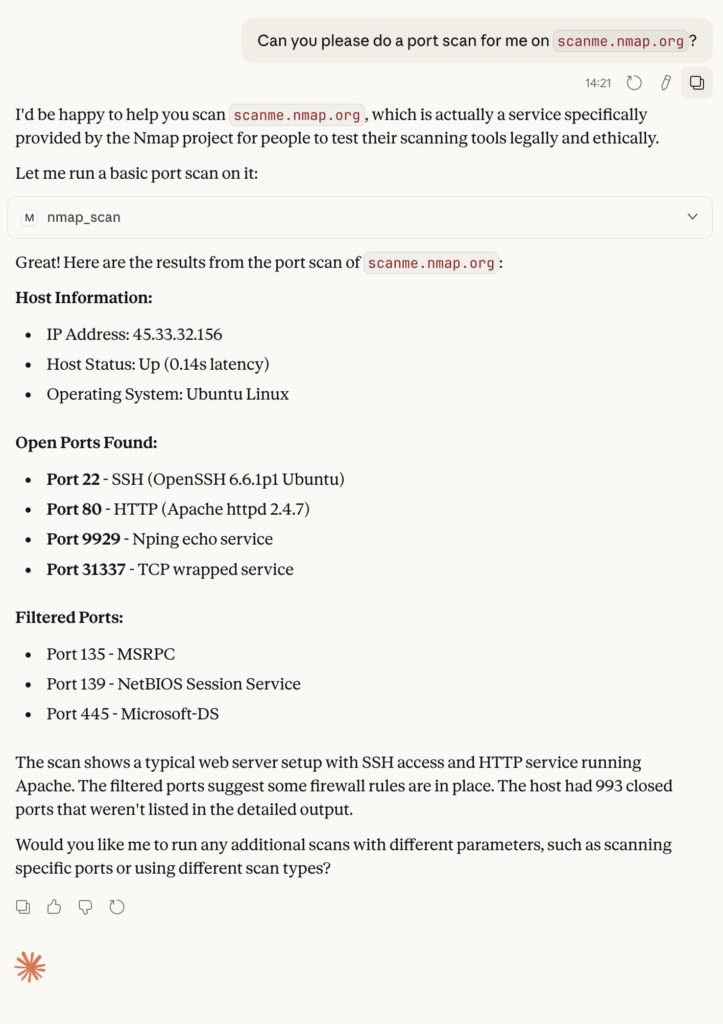

L’esempio classico è la scansione su scanme.nmap.org. La richiesta può restare in linguaggio naturale, e l’LLM può tradurla in un flusso: controllare Nmap, lanciare una scansione mirata, analizzare le porte, e se trova HTTP aperto fare un controllo successivo, come una richiesta a un file security.txt con curl. Questo è il punto in cui il “vibe” diventa procedura: non è la singola esecuzione, è la capacità di concatenare azioni in base a condizioni. Qui entra in gioco la differenza tra un LLM che genera testo e un LLM che guida strumenti. Nel secondo caso, l’output non è “una risposta”, è “una decisione operativa”. E quindi ogni dettaglio conta: la disponibilità dei tool, i permessi, i tempi, le protezioni contro l’uso improprio, il logging, e soprattutto la qualità con cui il modello gestisce errori e ambiguità.

Il ruolo di Kali Linux: strumenti, pacchetti e contesto “pronto”

Kali non si limita a dire “usa Claude”. Kali gioca la sua parte tradizionale: essere la distribuzione con il toolset più riconoscibile nel penetration testing. Perché l’integrazione funzioni, Kali deve avere strumenti installati e coerenti con ciò che il modello si aspetta di trovare. Quando Claude chiede “fammi enumeration”, dietro ci deve essere nmap, e spesso anche tool più specifici come gobuster, nikto, enum4linux-ng, hydra, john, sqlmap, wpscan, metasploit-framework. Il modello può controllare la presenza con comandi come which, ma se il tool manca, l’automazione si ferma e chiede all’utente di completare l’ambiente. In questo senso, l’integrazione è anche un modo per rendere più evidente un problema storico: l’illusione che il pentesting sia “un tool”. In realtà è un ambiente, e l’ambiente è fatto di tool, wordlist, permessi, patch, networking, segmentazione, e soprattutto disciplina. Se Claude è l’orchestratore, Kali è il magazzino degli strumenti. Se il magazzino è incompleto, la conversazione non basta.

Il pezzo macOS: Claude Desktop come front-end ufficiale

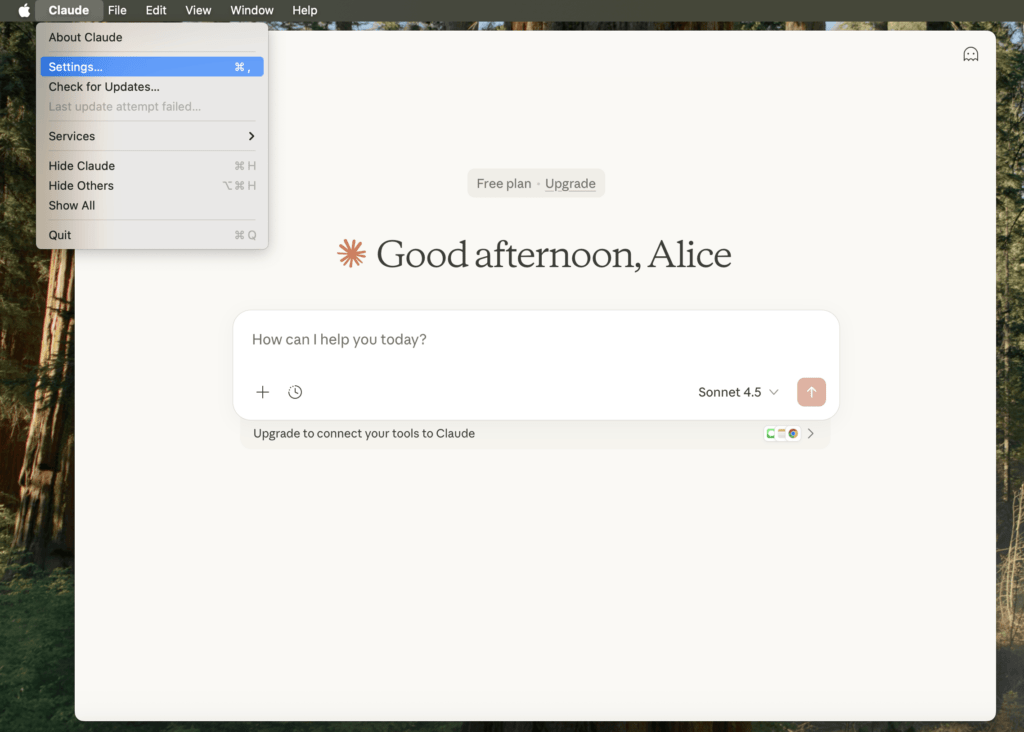

L’elemento che rende credibile la proposta è la disponibilità di Claude Desktop ufficiale su macOS, con rilascio e stabilizzazione nel 2026. Il punto non è l’estetica, ma la continuità di esperienza: una GUI supportata, aggiornata, firmata, con un meccanismo chiaro di configurazione. Nella narrativa di questa integrazione emerge anche un dettaglio temporale: la disponibilità gratuita a partire da gennaio 2026 e una versione indicata come stabile al 21 gennaio 2026, v1.1.381-c2a39e. In un contesto security, la versione conta perché l’interfaccia è parte della supply chain: bug, regressioni o modifiche di policy possono cambiare comportamento, logging e persino le modalità con cui vengono inviate richieste al modello nel cloud.

È qui che entra un tema pratico: su Linux il supporto desktop ufficiale non è allo stesso livello, e la community si muove con alternative o workaround. Questo rende macOS un punto di accesso privilegiato per chi vuole la strada più lineare. È un paradosso interessante: Kali è Linux, ma l’interfaccia “comoda” arriva prima su macOS.

MCP e SSH: perché la connessione non è un dettaglio

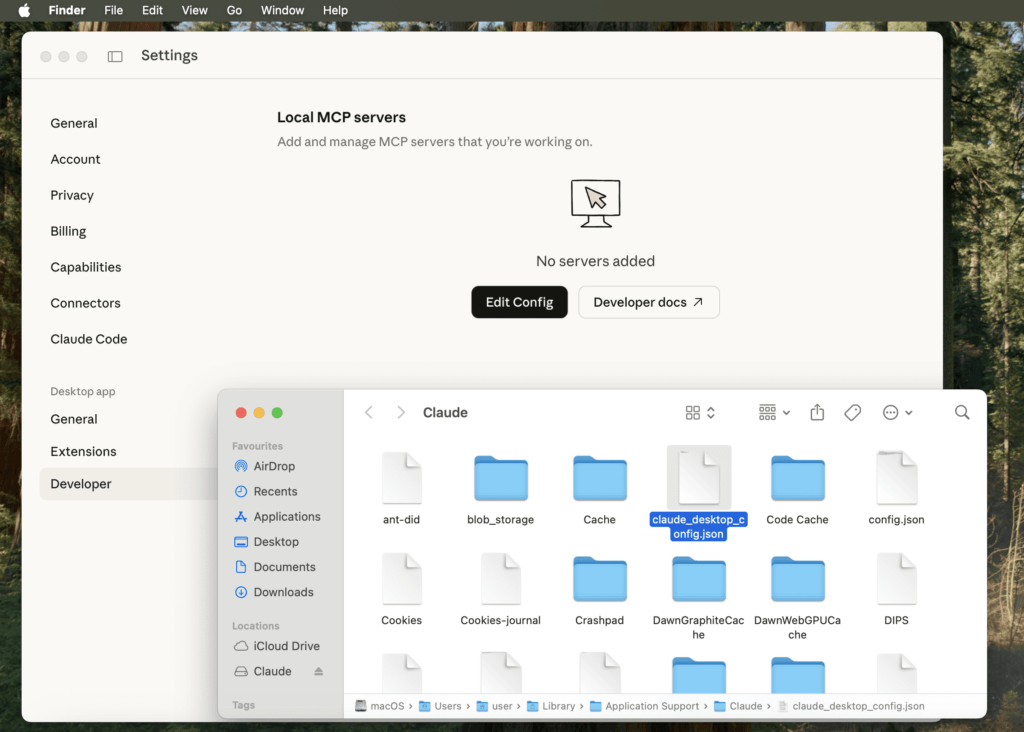

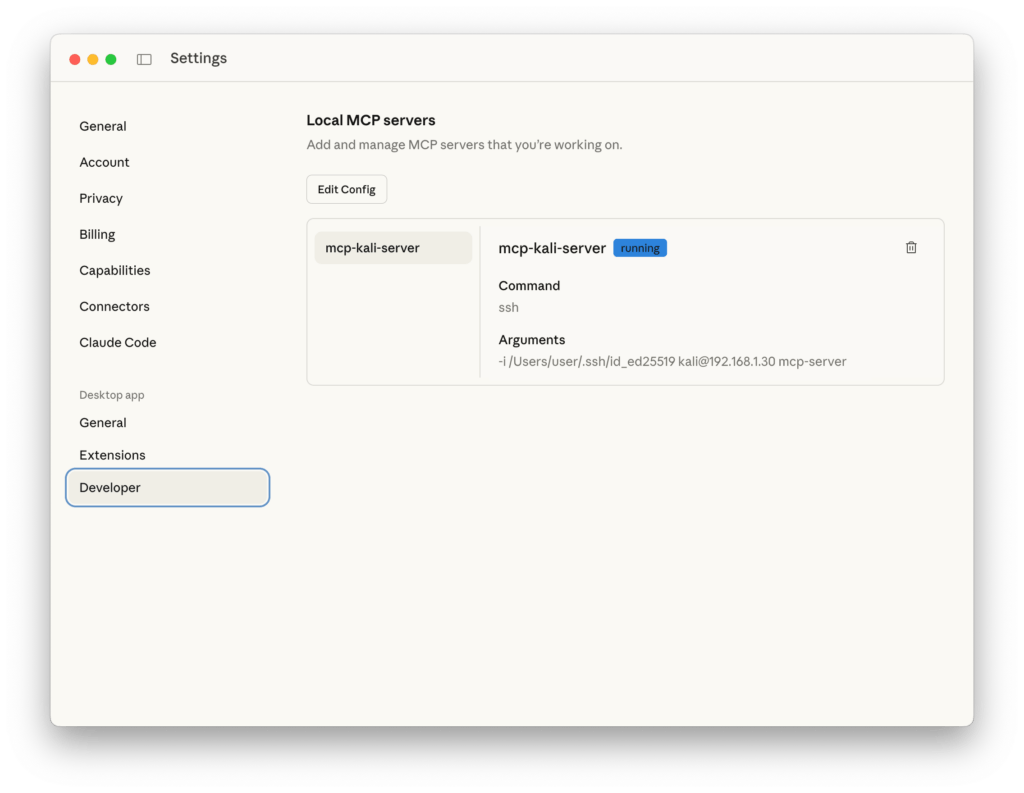

La parte più delicata del setup è la connessione. L’uso di SSH come trasporto è un passaggio logico perché sposta il problema su un meccanismo robusto e ben conosciuto. L’utente genera una chiave su macOS, tipicamente ed25519, e copia la pubblica su Kali. In quel momento, il Mac diventa un client autorizzato a eseguire comandi, e la password smette di essere il punto debole.

La configurazione avviene tramite un file JSON, spesso chiamato claude_desktop_config.json, in cui si definisce un blocco di server MCP, con parametri come utente, indirizzo IP della macchina Kali, path della chiave privata e modalità di esecuzione. Il dettaglio tecnico più importante è che l’autenticazione key-based riduce il rischio di credential stuffing, ma non elimina il rischio di esposizione della chiave se il Mac viene compromesso. In un workflow pentest, dove spesso si lavora con tool e ambienti “sporchi”, la gestione delle chiavi diventa parte della postura di sicurezza personale.

Quando il server MCP su Kali ascolta su una porta e riceve comandi, è essenziale che sia limitato e controllato. Nella descrizione emerge una porta 5000 e un server avviato con qualcosa come kali-server-mcp, spesso basato su un framework web come Flask. Questo ha implicazioni dirette: un servizio web in ascolto è, per definizione, un asset da proteggere. In un laboratorio locale può essere irrilevante, in una macchina esposta o in un ambiente cloud può diventare un problema serio se configurato male.

Automazione iterativa: la forza e il rischio del “loop”

Il vantaggio maggiore della soluzione è la capacità di eseguire loop condizionali. Non è solo “fai una scansione”, ma “se trovi la porta 80, allora prova questo; se il tool non c’è, installalo; se l’output è ambiguo, restringi la scansione; se il target risponde, esegui enumeration web; se trovi indizi, vai avanti”. Questo è, in piccolo, un motore agentico applicato al pentesting.

È anche il punto di rischio. Perché un loop può trasformare un test in un comportamento aggressivo se il prompt è formulato male o se il modello interpreta l’intento in modo troppo ampio. In un engagement etico, la differenza tra “enumeration consentita” e “attività non autorizzata” è spesso scritta in un documento, non in una regola tecnica. Se l’LLM guida l’azione, l’utente deve essere ancora più chiaro sui limiti, e l’infrastruttura deve registrare ogni comando per rendere auditabile la sessione.

Qui la scelta di non “applicare fix automatici” o di non eseguire azioni irreversibili senza conferma è un principio che torna utile anche in offensive security: il sistema deve essere progettato per chiedere conferma, non per correre.

Il tema privacy: prompt nel cloud e dati sensibili

Il nodo più delicato è la privacy. In questo setup, Sonnet 4.5 lavora nel cloud. Quindi i prompt passano fuori dal perimetro dell’utente. Se l’utente incolla dettagli di un target interno, un dominio, un IP, un nome di cliente, un output contenente token o credenziali, quel materiale entra in un canale che non è sotto il suo controllo diretto. Anche se ci sono policy e protezioni, resta un salto di fiducia. Per questo l’integrazione non è adatta a tutti gli scenari. In alcuni contesti, soprattutto regolati o altamente sensibili, la semplice idea di inviare output di scansioni o dettagli di infrastruttura a un LLM cloud è un non-starter. In altri contesti, invece, il valore operativo supera il rischio, soprattutto se si adottano regole rigide: minimizzare i dati nei prompt, evitare incolla di output grezzi, usare mascheramenti, mantenere l’LLM come guida procedurale e non come deposito di evidenze.

In parallelo, il server MCP e la sessione SSH diventano parte della catena di custodia. Se si lavora in incident response o in audit formale, la tracciabilità è fondamentale. Qui la raccomandazione implicita è chiara: logging centralizzato, conservazione degli output e separazione tra ambiente di test e ambienti di produzione.

“Gratis” nel 2026 e il rischio di instabilità di modello

Nella descrizione emerge un punto che attira inevitabilmente la community: l’uso “gratuito” nel 2026, almeno per un tier base, con Claude Desktop disponibile e Sonnet 4.5 nel cloud. È una leva di adozione fortissima, perché l’esperimento diventa accessibile anche a chi non vuole o non può aprire un budget API.

Ma questo introduce una fragilità. I tier gratuiti cambiano, le policy cambiano, le limitazioni cambiano. Se un workflow di team diventa dipendente da una condizione economica esterna, la sostenibilità operativa va valutata. Per Kali, che vive di community e adozione, l’integrazione è un acceleratore. Per un’azienda, è un rischio da governare: cosa succede se domani il modello impone limiti, se cambiano i rate limit, se il comportamento di safety blocca alcune azioni, se l’applicazione desktop aggiorna il formato di config. In altre parole, la tecnologia funziona quando è stabile. Nella cybersecurity, la stabilità non è mai scontata.

Perché questa integrazione interessa davvero la sicurezza “difensiva”

Sembra un tema offensivo, ma ha una ricaduta difensiva evidente. Se un LLM può guidare un pentester in modo più rapido e accessibile, può anche guidare un attaccante. E questo significa che le tecniche di base, soprattutto quelle legate a esposizione di servizi pubblici, configurazioni errate e tool standard, possono essere eseguite con meno competenza e più velocità. Il risultato è un aumento della pressione sul “baseline security”: patching, hardening, segmentazione, MFA robusta, riduzione dell’esposizione, e soprattutto controllo delle credenziali e degli accessi remoti. Non perché l’LLM sia “magico”, ma perché elimina frizioni. In un panorama in cui l’attacco vince spesso sul tempo e sulla disciplina, togliere frizione è una forma di potenziamento. È per questo che Kali, nel presentare un’integrazione di questo tipo, rafforza il suo ruolo nella cybersecurity contemporanea: non solo una distro con tool, ma un ambiente che incorpora le nuove interfacce di lavoro. Il terminale non sparisce, ma smette di essere l’unico ingresso. E quando l’ingresso cambia, cambiano anche le regole con cui si misura competenza, rischio e responsabilità.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.