OpenAI chiude un finanziamento da 101 miliardi di euro e contemporaneamente certifica un dato che, da solo, spiega perché capitali di questa portata diventano “razionali” per chi investe: ChatGPT sfiora i 900 milioni di utenti attivi settimanali, con una crescita dichiarata del 350% in 18 mesi. Il messaggio che passa non è solo “una startup raccoglie tanto”, ma che la piattaforma conversazionale è ormai una infrastruttura di accesso all’AI su scala quasi planetaria, e che per reggere quel traffico servono energia, chip, data center, canali di distribuzione e una macchina commerciale capace di trasformare l’adozione in ricavi ricorrenti. Il round viene presentato con una composizione che sembra scritta per mettere insieme tre leve: capitale paziente e geopolitica del tech, hardware e catena del valore dei semiconduttori, e distribuzione cloud. SoftBank e Nvidia contribuiscono ciascuno 28 miliardi di euro, mentre Amazon mette 46 miliardi di euro e lega l’investimento a una partnership strategica orientata a spingere l’adozione AI su mercati enterprise e consumer. La valutazione pre-money indicata è di 669 miliardi di euro, un livello che, in qualsiasi altro settore, sposterebbe il dibattito dal “quanto vale” al “che cosa sta diventando”. Per OpenAI, la risposta implicita è: un operatore che vende capacità cognitiva sotto forma di prodotto, API, agenti e strumenti di produttività.

Cosa leggere

Il round da 101 miliardi come segnale industriale, non solo finanziario

Quando un round arriva a 101 miliardi, la prima tentazione è trattarlo come un’eccezione. In realtà, la dimensione racconta un’evoluzione strutturale: l’AI non è più un software che scala “quasi gratis”, ma una tecnologia in cui la scarsità si sposta su compute, energia e supply chain. Per far crescere modelli, migliorare latenza, aumentare affidabilità, gestire sicurezza e compliance, serve capacità di calcolo stabile, ridondante, distribuita e il più possibile sotto controllo contrattuale. In questo scenario, gli investitori non stanno comprando solo una quota di crescita utenti. Stanno comprando una posizione in un mercato dove la domanda è elastica, ma il vincolo fisico è reale. Ed è qui che la presenza di Nvidia e Amazon acquista senso: una parte della storia riguarda la disponibilità di acceleratori e la possibilità di ottenere capacità dedicata per inferenza e training, mentre un’altra parte riguarda la distribuzione e l’accesso a clienti che non vogliono “usare un chatbot”, ma integrare l’AI nei processi. La valutazione pre-money a 669 miliardi viene presentata anche con un effetto collaterale importante: il rafforzamento delle capacità filantropiche della OpenAI Foundation, con uno stake stimato sopra 165 miliardi di euro. È un punto che, nel dibattito pubblico, rischia di sembrare marginale, ma non lo è: serve a costruire una narrativa di impatto e a sostenere ricerca su salute e resilienza dell’AI, in un momento in cui la pressione regolatoria e sociale sul settore cresce insieme all’adozione.

ChatGPT a 900 milioni settimanali: metrica di prodotto, metrica di potere

Il dato degli utenti attivi settimanali è più interessante del totale utenti registrati perché fotografa la dipendenza: quante persone tornano, quante volte, e per cosa. OpenAI parla di oltre 50 milioni di abbonati consumer, e indica che più del 5% degli utenti attivi settimanali sono paganti. In parallelo, segnala oltre 9 milioni di utenti corporate paganti. È qui che la piattaforma smette di essere percepita come “tool personale” e diventa un livello intermedio tra individuo e azienda. La crescita del 350% in 18 mesi, dal perimetro dei 200 milioni a quello dei 900 milioni, descrive un’accelerazione che raramente si vede in software di massa senza una leva di piattaforma. E la leva, in questo caso, è doppia: da un lato la frizione bassa dell’uso conversazionale, dall’altro l’estensione progressiva verso funzioni agentiche, integrazioni e casi d’uso professionali. Se l’AI diventa un’interfaccia generale, la curva utenti non è più vincolata da una singola categoria di app. È vincolata solo dalla capacità di erogare risposte con un livello di affidabilità che le persone accettano come “sufficiente” per imparare, scrivere, pianificare, costruire, e sempre più spesso lavorare. La stessa OpenAI collega l’espansione utenti a tre promesse operative: risposte più veloci, maggiore affidabilità, sicurezza rafforzata. In un prodotto che vive di percezione, la latenza è un costo psicologico, l’affidabilità è un costo reputazionale, la sicurezza è un costo legale. Investire in infrastrutture significa, concretamente, abbassare questi tre costi.

SoftBank, Nvidia e Amazon: perché questa triade conta

La presenza di SoftBank suggerisce capitale orientato a scommesse infrastrutturali e a strategie di lungo periodo. Nvidia è il simbolo della catena hardware e del collo di bottiglia che l’AI ha creato. Amazon, con 46 miliardi, è il braccio cloud e commerciale che può trasformare capacità in distribuzione, soprattutto quando i clienti chiedono scalabilità, governance e integrazione con stack esistenti. OpenAI segnala anche un accesso ampliato a capacità dedicata: si parla di 3 gigawatt per inferenza e 2 gigawatt per training con sistemi di nuova generazione, costruiti sopra deploy precedenti. Il punto, qui, non è il numero in sé, ma il concetto: prenotare potenza e pianificare come un operatore industriale. È un salto culturale rispetto alla narrativa “software-only” che ha accompagnato le piattaforme internet. La partnership con Amazon viene descritta come un acceleratore dell’adozione AI in mercati enterprise e consumer. Tradotto: canali, contratti, procurement, compliance, e una relazione con clienti che non acquistano “innovazione”, acquistano continuità. In questo senso, un round così grande è anche un modo per costruire credibilità: chi compra AI a livello enterprise vuole sapere che il fornitore non sparisce, non rallenta, non cambia pricing in modo imprevedibile, e può garantire capacità.

Commercializzazione dei sistemi avanzati: quando la frontiera diventa prodotto

OpenAI dichiara che i fondi verranno usati per ampliare infrastrutture, distribuzione globale e commercializzazione di sistemi avanzati. Questa frase, letta bene, racconta l’uscita dall’epoca in cui la “frontiera” era un concetto da laboratorio. La frontiera, ora, deve diventare un prodotto: versioni, piani, API, strumenti, metriche, supporto, SLA e una roadmap. La commercializzazione non è un dettaglio: significa che l’azienda deve rendere prevedibile ciò che per natura è sperimentale. È qui che nascono tensioni tipiche: costi di training e inferenza crescono, ma il mercato pretende prezzi accessibili; le capacità aumentano, ma la sicurezza deve aumentare di più; i modelli diventano più potenti, ma i clienti vogliono controllo e auditabilità. La raccolta da 101 miliardi va letta come un tentativo di comprare tempo e margine operativo per gestire queste tensioni senza interrompere l’accelerazione.

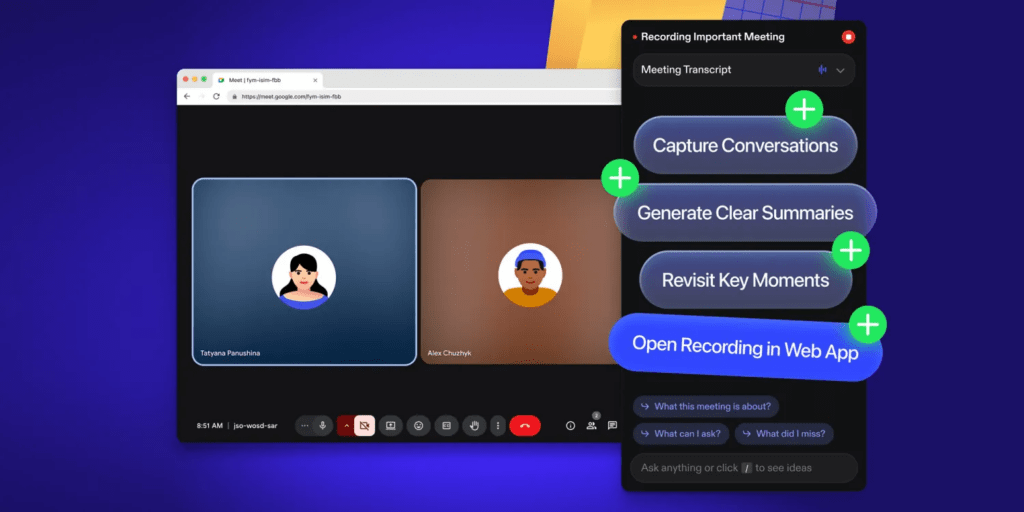

Produttività vocale e “AI quotidiana”: perché contano Speechify, wearable e cloni

Nel flusso di notizie che accompagna il round, emergono esempi di “AI quotidiana” che sono utili per capire dove sta andando l’adozione. Speechify, con un AI Note Taker capace di trascrivere e riassumere meeting Zoom, lezioni e conversazioni, rappresenta un pattern: l’AI che toglie lavoro cognitivo ripetitivo e lo restituisce come testo strutturato, consultabile, leggibile anche ad alta voce. La promessa non è “creare contenuti”, ma liberare attenzione durante le interazioni.

Questo tipo di tool si innesta perfettamente su una piattaforma come ChatGPT, perché trascrizioni e riassunti diventano input ideali per analisi, follow-up, task e pianificazione. L’ecosistema si chiude: voce e meeting generano testo, il testo alimenta agenti, gli agenti generano azioni. È l’AI come catena di montaggio cognitiva.

Sul fronte wearable, l’arrivo di smart ring come Ultrahuman Ring Pro con batteria fino a 15 giorni e un assistente biointelligente come Jade AI segnala un’altra traiettoria: l’AI non resta in chat, entra nei sensori, interpreta dati e propone interventi in tempo reale. Anche qui, il punto non è la singola feature, ma l’architettura: più dati personali, più contesto, più necessità di elaborazione sicura e di modelli capaci di tradurre biometria in insight comprensibili.

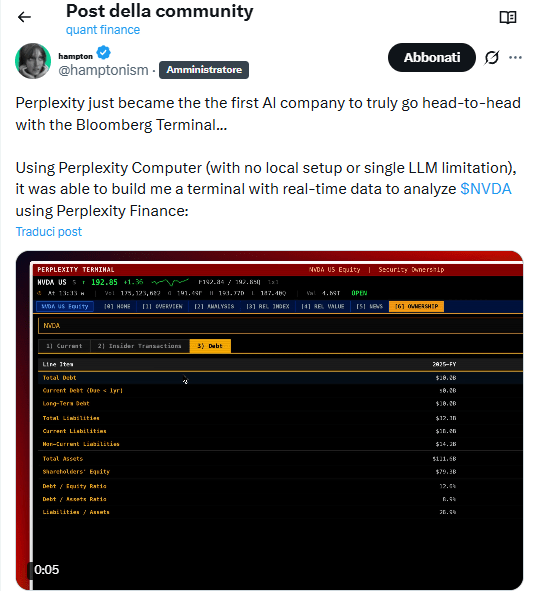

Infine, il caso del “clone” del terminale Bloomberg costruito con strumenti AI in poche ore è una metafora potente: l’AI come forza che abbassa i costi di prototipazione e di interfacce. Ma la reazione scettica è altrettanto importante, perché ricorda la differenza tra UI e infrastruttura dati. Un terminale finanziario non vale per i widget, vale per il dato sottostante, la latenza, la copertura e la capacità di eseguire operazioni. L’episodio, però, chiarisce un punto: la democratizzazione avverrà prima sulle interfacce, poi sulla profondità del dato. E nel mezzo si aprirà un mercato enorme di strumenti “abbastanza buoni” per molti, ma non per tutti.

Dove finiscono i soldi: compute, distribuzione, sicurezza e go-to-market

La destinazione dei fondi, per come viene descritta, ha quattro assi. Il primo è la capacità di compute: più acceleratori, più data center, più ridondanza. Il secondo è la distribuzione globale: portare prodotti e API dove la domanda cresce e dove la latenza conta. Il terzo è la sicurezza e la resilienza: hardening dei sistemi, governance, protezioni contro abusi, affidabilità. Il quarto è la commercializzazione: vendita, partnership, supporto enterprise, e strumenti che rendano l’AI integrabile senza frizioni. Questi quattro assi spiegano perché l’AI sta assomigliando sempre più a un settore infrastrutturale. Non basta “avere il modello”. Bisogna essere in grado di servirlo al mondo, ogni giorno, con costi sostenibili e rischi controllati. Il punto critico è che, più l’AI si integra nel lavoro quotidiano, più le aziende pretenderanno garanzie e più gli utenti consumer pretenderanno semplicità. Questa doppia pressione spinge verso un prodotto che deve essere contemporaneamente potente e invisibile. È un obiettivo difficile e costoso. Ed è esattamente il tipo di obiettivo che un round da 101 miliardi cerca di rendere praticabile.

La nuova normalità: AI come infrastruttura, non come applicazione

Se ChatGPT sta davvero entrando nella soglia del miliardo di utenti settimanali, l’AI non è più un fenomeno “early adopter”. Diventa una normalità. In quel momento, cambiano anche le domande: non “cosa può fare l’AI”, ma “quanto costa”, “chi controlla la capacità”, “chi integra”, “chi garantisce sicurezza”, “chi governa gli impatti”. In questa prospettiva, il round record non è solo un evento di finanza. È una dichiarazione di intenti: OpenAI vuole essere uno dei pochissimi attori in grado di sostenere l’AI come servizio globale, reggere la domanda esplosiva e trasformare l’adozione in un ecosistema di prodotti che vanno dalla chat agli agenti, dal voice-first ai sistemi avanzati per imprese. Il mercato, nel frattempo, si organizza attorno a una constatazione concreta: l’AI non è più un costo marginale, è una voce di spesa industriale. E chi controlla l’infrastruttura controlla la velocità con cui il resto del mondo potrà adottarla.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.