Samsung Electronics sta provando a costruire una traiettoria unica tra due mondi che, fino a poco tempo fa, si parlavano poco: la rete e la fabbrica. Da un lato, la trasformazione delle telecomunicazioni in infrastrutture software-driven e AI-native, dove la RAN e il core diventano piattaforme programmabili. Dall’altro, l’obiettivo di convertire l’intera rete manifatturiera globale in AI-Driven Factories entro il 2030, con digital twin, agenti AI e robotica specializzata. Gli annunci di inizio marzo 2026 disegnano questa strategia attraverso una doppia alleanza con AMD e NVIDIA, mentre sullo sfondo Meta rafforza l’ecosistema AMD lato data center con RCCLX, ottimizzando la comunicazione tra GPU su MI300 e MI350. Insieme, i tre assi raccontano un tentativo di evitare il lock-in: scegliere un’architettura aperta che consenta performance elevate e flessibilità sia nelle reti 5G/6G sia nelle fabbriche autonome. Il punto comune non è solo l’AI. È la promessa di un’industrializzazione dell’AI, cioè un passaggio da prototipi e demo a sistemi che reggono carichi reali, vincoli energetici e requisiti di affidabilità.

Cosa leggere

Samsung e AMD: CPU EPYC 9005 come base per core 5G e vRAN commerciali

La collaborazione tra Samsung e AMD viene presentata come un salto dal laboratorio al deployment. Il caso più immediato è Videotron, che sceglie Samsung per soluzioni 5G Non-Standalone e 4G LTE Core gateway alimentate da processori AMD EPYC 9005 Series. Non è solo una notizia “di vendor selection”: è un segnale che Samsung sta spingendo un modello di rete virtualizzata dove il compute general purpose torna centrale, anche quando l’industria parla sempre più di accelerazione.Al MWC 2026, Samsung porta risultati di test multi-cell su vRAN basata su EPYC, sostenendo performance “commercial grade” senza acceleratori dedicati. Qui la parte interessante è la narrativa del compromesso: se una vRAN può reggere multi-cell senza hardware specializzato, l’operatore guadagna opzione infrastrutturale, riduce dipendenze e può disegnare una roadmap più elastica. È esattamente il tipo di argomento che pesa quando una telco deve decidere se investire in piattaforme acceleratore-centriche o mantenere un profilo più generalista. Dentro questa logica emerge anche il concetto di Network in a Server (NIS), descritto come soluzione Edge-AI completamente virtualizzata che riduce complessità operativa e integra AI direttamente nella RAN. Il passaggio da “RAN distribuita” a “RAN come software su un server” è la precondizione per rendere l’AI una funzione nativa e non un accessorio. I casi d’uso verificati con un grande operatore giapponese, che includono analisi video, rilevamento sensori tramite Integrated Sensing and Communication e hyperconnectivity per dispositivi di prossima generazione, suggeriscono che la strategia non è solo trasportare bit, ma trasformare la rete in un’infrastruttura che interpreta contesto e prende decisioni. Le dichiarazioni attribuite a Keunchul Hwang, head della strategia tecnologica di Samsung Networks, e a Derek Dicker di AMD, insistono su un punto: l’integrazione tra architetture AI-native aperte e compute avanzato deve permettere agli operatori di scalare reti AI-native “oggi”, con performance commerciali e più opzioni sul lato infrastruttura. Tradotto in linguaggio industriale: evitare che l’AI-RAN diventi un percorso obbligato verso un’unica piattaforma.

Samsung e NVIDIA: test multi-cell, ARC Compact e AI MIMO beamformer verso AI-RAN

La seconda gamba è l’accelerazione. Samsung annuncia un test multi-cell completato con successo integrando il proprio software vRAN con la piattaforma accelerated computing di NVIDIA in un ambiente realistico. L’integrazione con NVIDIA ARC Compact, basato su Grace CPU e L4 GPU, viene presentata come ottimizzazione dello scambio dati CPU-GPU ad alta velocità. Qui l’obiettivo non è solo aumentare throughput: è rendere praticabile una pipeline in cui parti della RAN e parti dell’AI convivono nello stesso stack senza creare colli di bottiglia. Al MWC 2026 Samsung prevede di dimostrare una soluzione AI-RAN completa con AI MIMO beamformer, con la promessa di aumentare throughput ed efficienza spettrale. È una dimostrazione che, per essere credibile, deve rispondere alle domande tipiche degli operatori: quanto costa in energia, quanto è stabile sotto carico, quanto è osservabile, quanto è governabile. La descrizione di milestone verso la commercializzazione, attribuita a Soma Velayutham di NVIDIA, serve a posizionare il test come passo oltre la demo. E Samsung, insistendo sulla natura software-based della propria vRAN, prova a mantenere la narrativa della flessibilità: l’ecosistema deve includere partner CPU e GPU leader, ma non diventare dipendenza esclusiva. In pratica, Samsung tenta di tenere insieme due traiettorie che spesso si separano: da un lato una vRAN che può vivere su CPU general purpose, dall’altro una AI-RAN che beneficia di accelerazione quando l’operatore decide di spingere su use case più sofisticati.

L’obiettivo 2030: Samsung vuole fabbriche AI-driven, non solo “automatizzate”

La parte manifatturiera è quella che sposta il racconto dal perimetro telco a un orizzonte industriale più ampio. Samsung annuncia una strategia per convertire l’intera rete produttiva mondiale in AI-Driven Factories entro il 2030, integrando AI lungo tutta la catena del valore: logistica inbound, produzione, ispezione qualità e spedizione. In questa visione, il digital twin non è un modellino 3D, ma un sistema di simulazione che permette di testare processi completi prima dell’esecuzione fisica, riducendo errori, fermi linea e sprechi. Gli agenti AI specializzati diventano l’elemento che trasforma la fabbrica da sistema reattivo a sistema proattivo: controllo qualità, pianificazione produzione, coordinamento logistico con analisi data-driven e pre-validazione. L’idea di agentic AI, già matura nel settore mobile secondo la narrativa Samsung, viene estesa sul campo per decisioni ottimali in tempo reale. La robotica entra come conseguenza operativa. Samsung descrive robot umanoidi e task-specialized: operating robots per gestione linee e impianti, logistics robots per movimentazione autonoma materiali, assembly robots per compiti di precisione, e environmental safety robots integrati con digital twin per monitorare rischi e prevenire pericoli. L’obiettivo dichiarato, attribuito a YoungSoo Lee, è arrivare ad ambienti autonomi dove l’AI comprende contesti operativi in tempo reale ed esegue decisioni ottimali in modo indipendente. Qui la parola chiave è “indipendente”, che in ambito industriale significa anche responsabilità: se un agente decide, deve poter essere auditato; se un robot agisce, deve essere governato; se un digital twin simula, deve restare aggiornato ai dati reali.

Meta e AMD: RCCLX riduce latenza GPU, un tassello invisibile ma decisivo

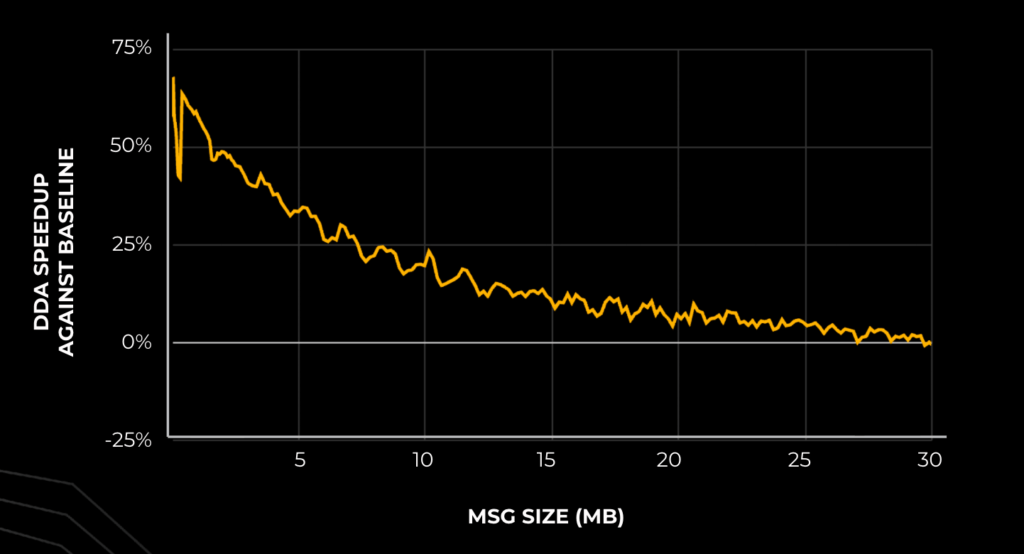

Nel frattempo Meta contribuisce a rendere più efficiente il lato data center dell’ecosistema AMD presentando RCCLX, evoluzione open source di RCCL ottimizzata per GPU AMD MI300 e MI350. Qui la notizia non riguarda direttamente Samsung, ma riguarda la base computazionale che alimenta sia reti AI-native sia fabbriche AI-driven: modelli più grandi e pipeline più complesse richiedono comunicazioni GPU più rapide e prevedibili.

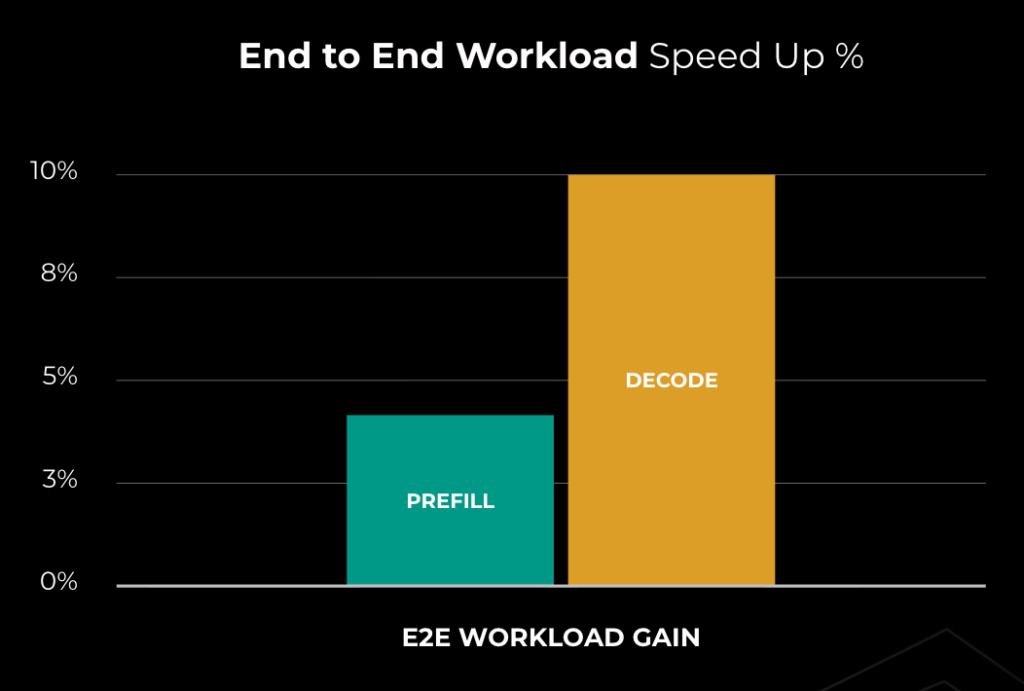

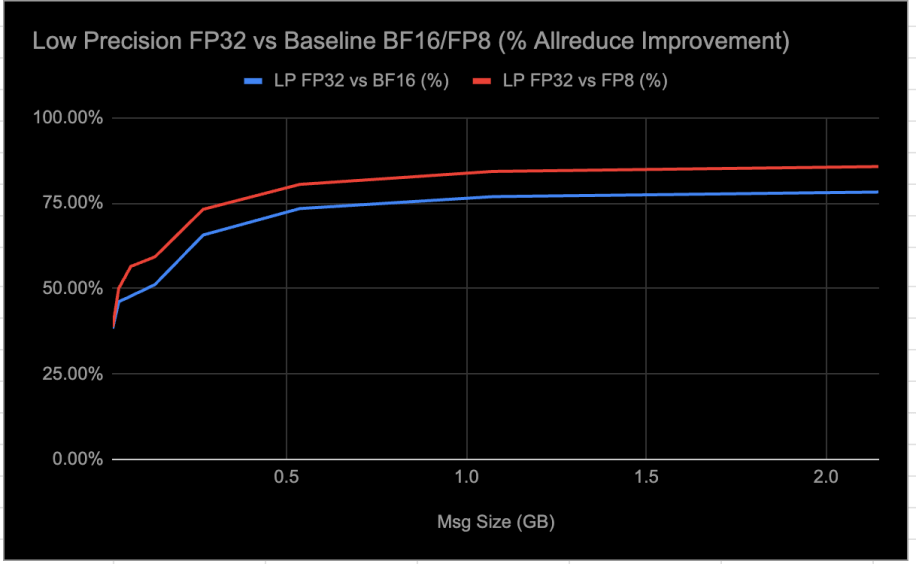

RCCLX introduce Direct Data Access per collettive intra-nodo leggere e Low Precision collectives con quantizzazione FP8 fino a compressione 4:1. Su MI300X, Direct Data Access riduce la latenza AllReduce del 10-50% su messaggi piccoli e migliora TTIT del 10% in scenari decode, mentre i collettivi low precision aumentano throughput e riducono latenza in inference end-to-end. La cosa importante è il contesto: l’overhead di comunicazione può arrivare al 30% della latenza totale nei modelli tensor-parallel. Se quel 30% si riduce, cambia il costo reale dell’inferenza e del training su scala, e cambia la capacità di rendere l’AI un servizio continuo invece di un batch occasionale.

L’open source su GitHub e l’integrazione con Torchcomms mirano a rendere questa ottimizzazione replicabile e adottabile, evitando che resti un vantaggio proprietario di un singolo hyperscaler. È un passo che rafforza l’idea di un ecosistema AMD più competitivo nel compute AI, e quindi più “opzionabile” per chi, come Samsung, vuole architetture aperte.

Un ecosistema che prepara 6G e produzione autonoma senza lock-in

Guardando il quadro complessivo, Samsung sta costruendo una strategia che unisce reti e fabbriche attraverso una stessa logica: software-defined, AI-native, governabile, e soprattutto compatibile con scelte infrastrutturali plurime. AMD offre la narrativa della virtualizzazione efficiente su CPU EPYC, NVIDIA offre la spinta dell’accelerazione verso AI-RAN e beamforming, Meta rafforza l’efficienza delle comunicazioni GPU su piattaforme AMD, riducendo un collo di bottiglia che spesso determina costi e prestazioni reali. Per gli operatori telco, questo significa poter immaginare reti più autonome, con performance e flessibilità, e con un percorso verso 6G che non dipenda da un solo stack. Per l’industria manifatturiera, significa trasformare l’automazione in autonomia operativa attraverso digital twin, agenti e robotica, con un obiettivo temporale chiaro: 2030. Il vero banco di prova sarà la capacità di trasformare demo e dichiarazioni in implementazioni ripetibili, con metriche su energia, affidabilità e sicurezza. Ma la direzione, in inizio marzo 2026, è già delineata: l’AI non è più un layer aggiuntivo, è l’architettura.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.