OpenAI Codex Security, il nuovo sistema sviluppato da OpenAI per l’analisi automatica della sicurezza del codice, introduce un approccio radicalmente diverso alla ricerca di vulnerabilità software sfruttando modelli di intelligenza artificiale avanzata e un sistema di validazione automatica in sandbox. Nella fase di beta test lo strumento ha analizzato oltre 1,2 milioni di commit in repository pubblici individuando 792 vulnerabilità critiche e 10.561 problemi ad alta severità. I risultati dimostrano come l’uso di modelli di ragionamento agentico applicati alla sicurezza del software possa ridurre drasticamente il rumore tipico degli scanner tradizionali, diminuendo i falsi positivi del 50% e il rumore complessivo dell’84%. Il progetto nasce come evoluzione del sistema interno Aardvark, sperimentato nel 2025, e rappresenta uno dei primi tentativi concreti di utilizzare modelli di AI reasoning per automatizzare il ciclo completo della sicurezza applicativa: analisi del codice, generazione del threat model, validazione delle vulnerabilità e proposta di patch contestuali. Il risultato è uno strumento che non si limita a segnalare potenziali errori ma produce prove tecniche verificabili, consentendo agli sviluppatori di intervenire in poche ore.

Cosa leggere

Cos’è codex security e perché rappresenta una svolta nella sicurezza del codice

Codex Security nasce con un obiettivo molto chiaro: ridurre uno dei più grandi problemi della sicurezza del software moderno, cioè l’enorme quantità di segnalazioni inutili generate dagli strumenti automatici di scansione. I sistemi tradizionali di static analysis e SAST producono spesso migliaia di avvisi, molti dei quali irrilevanti o impossibili da sfruttare nella pratica. Questo fenomeno, noto come alert fatigue, costringe i team di sicurezza a passare settimane nel triage delle vulnerabilità, rallentando lo sviluppo e aumentando il rischio che problemi reali restino irrisolti. OpenAI ha progettato Codex Security proprio per affrontare questo collo di bottiglia. Il sistema utilizza modelli di intelligenza artificiale frontier in grado di comprendere il comportamento del software e non soltanto la sintassi del codice. In pratica lo strumento costruisce una rappresentazione operativa del sistema analizzato, identificando flussi di dati, relazioni di fiducia e superfici di attacco. Questo approccio consente all’agente AI di distinguere tra una semplice cattiva pratica di programmazione e una vulnerabilità effettivamente sfruttabile. Il risultato è un sistema che riduce drasticamente l’over-reporting delle vulnerabilità, abbattendo di oltre 90% le segnalazioni erroneamente classificate come critiche.

Come funziona l’analisi dei repository con modelli di threat modeling

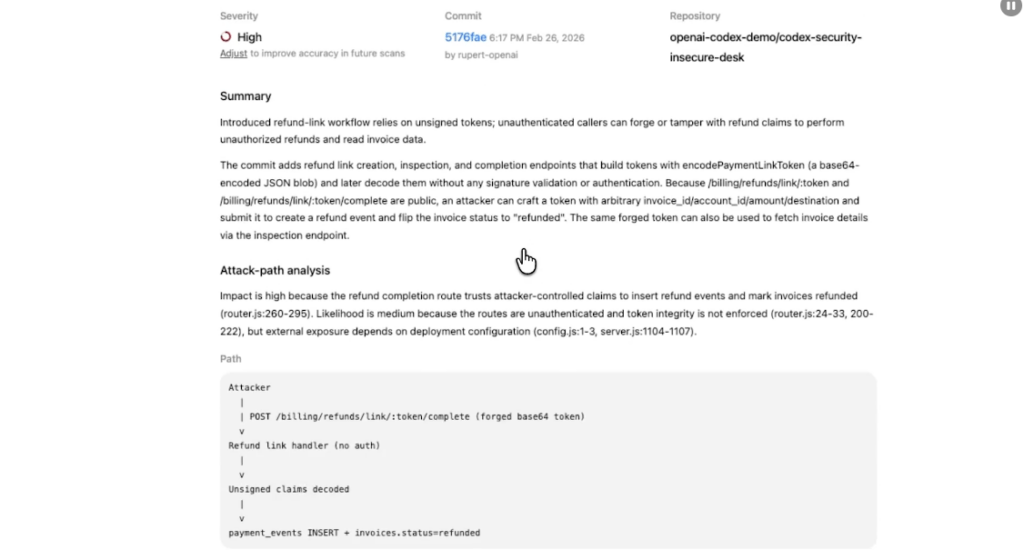

Il funzionamento di Codex Security parte da un passaggio fondamentale: la costruzione automatica di un modello di minaccia del sistema, noto come threat model. Quando uno sviluppatore collega il proprio repository allo strumento, l’AI analizza la struttura del progetto e identifica componenti fondamentali come: servizi esposti, interfacce di rete, gestione delle credenziali, processi di autenticazione e flussi di dati sensibili. Questo modello viene poi presentato agli sviluppatori, che possono modificarlo manualmente per riflettere l’architettura reale del sistema. L’intervento umano è importante perché consente di allineare l’analisi alla postura di rischio del team. Una volta completato il threat model, l’agente AI utilizza queste informazioni per cercare vulnerabilità con un approccio contestuale. Invece di cercare pattern statici nel codice, Codex Security analizza il comportamento dell’applicazione e verifica se esistono percorsi realistici di exploit. Questo metodo riduce drasticamente i falsi allarmi. Un bug viene segnalato solo quando esiste una reale possibilità che venga sfruttato in un ambiente di produzione.

Validazione automatica delle vulnerabilità con ambienti sandbox

Uno degli aspetti più innovativi di Codex Security è il sistema di validazione automatica delle vulnerabilità. Quando l’AI identifica un potenziale problema, non si limita a segnalarlo. Il sistema tenta di riprodurre l’attacco in un ambiente sandbox isolato, simulando il comportamento reale dell’applicazione. Questo processo è noto come pressure testing delle vulnerabilità. L’agente AI crea automaticamente un ambiente di test che replica il contesto del repository analizzato. Se necessario può installare dipendenze, compilare il codice e avviare servizi per verificare se l’exploit funziona davvero. Quando la vulnerabilità è confermata, lo strumento genera una proof-of-concept automatica, cioè un esempio concreto che dimostra come l’attacco possa essere eseguito. Per i team di sicurezza questo cambia completamente il processo di triage. Invece di analizzare manualmente centinaia di segnalazioni, gli sviluppatori ricevono solo vulnerabilità verificate, accompagnate da evidenze tecniche.

I risultati delle scansioni beta su oltre un milione di commit

Durante la fase di test Codex Security è stato utilizzato per analizzare repository pubblici su larga scala. Il sistema ha esaminato 1,2 milioni di commit provenienti da diversi progetti open source nel giro di 30 giorni. L’analisi ha identificato: 792 vulnerabilità critiche, 10.561 vulnerabilità ad alta criticità. Questi numeri rappresentano una percentuale relativamente piccola rispetto al volume di codice analizzato, ma hanno un impatto significativo perché riguardano software utilizzati globalmente. Tra i progetti coinvolti figurano componenti fondamentali dell’ecosistema open source, tra cui: OpenSSH, GnuTLS, PHP, GnuPG e vari framework utilizzati nello sviluppo cloud. Il dato più interessante riguarda la precisione dell’analisi. Le vulnerabilità critiche rappresentano meno dello 0,1% dei commit analizzati, dimostrando che l’AI è in grado di filtrare efficacemente il rumore.

Le vulnerabilità scoperte nei principali progetti open source

Tra le scoperte più rilevanti emerse durante la fase beta figurano diversi bug di sicurezza in componenti software largamente utilizzati. Nel progetto GnuTLS, una libreria crittografica fondamentale per la sicurezza delle comunicazioni, Codex Security ha identificato una serie di problemi tra cui heap buffer overflow, heap buffer overread e vulnerabilità di double-free memory corruption. Questi errori possono consentire a un attaccante di eseguire codice arbitrario o causare il crash del sistema. In altri casi l’AI ha individuato vulnerabilità logiche. Nel software GOGS, una piattaforma di gestione repository simile a GitHub, lo strumento ha rilevato un bypass del sistema di autenticazione a due fattori. Questo tipo di problema non dipende da errori di memoria ma da logiche di autenticazione errate, che gli scanner tradizionali difficilmente riescono a identificare. Un altro esempio riguarda il progetto Thorium, dove l’AI ha scoperto una combinazione di vulnerabilità tra cui path traversal, LDAP injection e un denial of service non autenticato. La presenza simultanea di più problemi dimostra come l’analisi contestuale del sistema permetta di individuare catene di attacco piuttosto che singoli bug isolati.

Il ruolo dei proof of concept nella patch rapida delle vulnerabilità

Uno degli elementi più utili del sistema è la generazione automatica di proof-of-concept exploit. Quando una vulnerabilità viene confermata, Codex Security produce un esempio concreto che dimostra come sfruttarla. Questo permette agli sviluppatori di comprendere immediatamente il rischio reale. Nel modello tradizionale di sicurezza, un report di vulnerabilità spesso contiene solo una descrizione tecnica del problema. Gli sviluppatori devono quindi replicare manualmente il bug per capire come correggerlo. Con Codex Security questo passaggio viene automatizzato. La presenza di un exploit dimostrativo consente ai maintainer open source di sviluppare patch nel giro di poche ore. Secondo OpenAI, diversi progetti coinvolti nella fase beta sono riusciti a correggere vulnerabilità critiche in meno di 24 ore.

L’evoluzione del progetto da Aardvark a Codex Security

Il sistema Codex Security non nasce dal nulla. La sua origine risale al progetto Aardvark, sviluppato internamente da OpenAI nel 2025. Aardvark era stato progettato come un agente sperimentale in grado di analizzare repository software e identificare vulnerabilità sfruttando modelli linguistici avanzati. Durante i primi test il sistema aveva già dimostrato la capacità di individuare problemi complessi, tra cui vulnerabilità SSRF e attacchi cross-tenant in infrastrutture cloud. Tuttavia il progetto presentava limiti significativi, soprattutto nella gestione dei falsi positivi. OpenAI ha quindi utilizzato i dati raccolti durante la fase beta per migliorare l’algoritmo, introducendo tre innovazioni principali: ragionamento agentico basato su modelli frontier, validazione automatica delle vulnerabilità, generazione di threat model modificabili dagli sviluppatori. Queste modifiche hanno trasformato Aardvark nel sistema attuale, ribattezzato Codex Security.

L’impatto sul lavoro dei team di sviluppo e sicurezza

Per i team di sviluppo l’arrivo di strumenti come Codex Security potrebbe cambiare radicalmente il modo in cui viene gestita la sicurezza del codice. Oggi molte aziende utilizzano pipeline di DevSecOps con decine di strumenti automatici che analizzano il codice a ogni commit. Il problema è che questi sistemi generano spesso un volume enorme di avvisi. Gli sviluppatori finiscono per ignorare molte segnalazioni perché non hanno il tempo di verificarle tutte. Codex Security punta a risolvere questo problema concentrandosi solo su vulnerabilità ad alto impatto reale. Riducendo il numero di segnalazioni irrilevanti, i team possono concentrarsi sulle patch più importanti e migliorare la sicurezza complessiva del software. In altre parole lo strumento non sostituisce gli esperti di sicurezza ma riduce il tempo necessario per individuare i problemi più gravi.

Programma open source e l’accesso gratuito per i maintainer

Per favorire l’adozione dello strumento nella comunità open source, OpenAI ha avviato un programma dedicato ai maintainer di progetti pubblici. Gli sviluppatori che partecipano al programma possono ottenere accesso gratuito a ChatGPT Pro e utilizzare Codex Security per analizzare i propri repository. L’obiettivo è migliorare la sicurezza dell’ecosistema open source riducendo la quantità di report di vulnerabilità di bassa qualità che spesso sovraccaricano i maintainer. Invece di ricevere segnalazioni incomplete o errate, i progetti open source riceveranno report verificati con prove tecniche concrete. OpenAI ha già collaborato con diversi progetti durante la fase beta, tra cui il motore di inferenza vLLM, utilizzato nello sviluppo di modelli di intelligenza artificiale.

La competizione tra strumenti ai per la sicurezza del codice

L’arrivo di Codex Security si inserisce in una competizione crescente tra aziende che stanno sviluppando strumenti di AI per la sicurezza del software. Negli ultimi anni diversi attori del settore hanno iniziato a utilizzare modelli linguistici per analizzare codice sorgente e suggerire patch. Tra i sistemi più discussi figura Claude Code Security, sviluppato da Anthropic, che utilizza modelli AI per scansionare repository e suggerire correzioni automatiche. La differenza principale tra i due approcci riguarda il livello di validazione delle vulnerabilità. Mentre molti strumenti si limitano a suggerire possibili bug, Codex Security punta a dimostrare l’esistenza reale della vulnerabilità attraverso test automatizzati. Questo passaggio riduce significativamente il numero di falsi positivi e aumenta la fiducia degli sviluppatori nei risultati dell’analisi.

L’accesso alla preview e l’integrazione con codex web

OpenAI ha reso disponibile Codex Security inizialmente come preview di ricerca. L’accesso è riservato agli utenti ChatGPT Pro e ai clienti Enterprise, che possono utilizzare lo strumento attraverso l’interfaccia Codex web. Secondo OpenAI il periodo di prova gratuita dura un mese, durante il quale gli sviluppatori possono configurare i propri repository e testare le funzionalità di scansione. Successivamente il servizio sarà esteso anche ai piani Business e Edu, ampliando la base di utenti. L’azienda ha dichiarato che la preview servirà a raccogliere feedback dagli sviluppatori e migliorare il sistema prima di un rilascio più ampio.

Perché l’ai nella sicurezza del software diventerà inevitabile

L’evoluzione di Codex Security riflette un cambiamento più ampio nel settore tecnologico. La quantità di codice prodotta ogni anno cresce a un ritmo sempre più veloce, soprattutto grazie all’uso di strumenti di programmazione assistita dall’intelligenza artificiale. Questo significa che anche la superficie di attacco del software sta aumentando rapidamente. Gli strumenti tradizionali di sicurezza non sono progettati per gestire questa scala. Servono sistemi in grado di analizzare milioni di righe di codice e comprendere il comportamento delle applicazioni. L’uso di agenti AI specializzati nella sicurezza del software potrebbe diventare una componente fondamentale delle pipeline di sviluppo moderne. Se Codex Security manterrà le promesse dimostrate nella fase beta, potrebbe rappresentare uno dei primi esempi concreti di automazione intelligente della sicurezza applicativa. Alla fine la domanda non sarà più se utilizzare l’intelligenza artificiale per analizzare il codice, ma quanto rapidamente le aziende riusciranno ad adattarsi a questo nuovo modello di sicurezza software.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.