Anthropic raddoppia i limiti di utilizzo di Claude mentre Google integra Gemini in BigQuery e introduce controllo dei costi API. Gli aggiornamenti di marzo 2026 ridefiniscono l’uso dell’intelligenza artificiale tra sviluppo, analisi dati e produzione. Le novità coinvolgono anche AWS, NVIDIA e Meta con nuove architetture e chip dedicati. Il settore AI accelera verso modelli più accessibili, scalabili e integrati nei flussi di lavoro reali. Le aziende ottengono strumenti più efficienti per passare rapidamente dal prototipo alla produzione. Questa fase segna una competizione sempre più forte tra ecosistemi cloud e modelli open.

Cosa leggere

Anthropic raddoppia i limiti di Claude e introduce funzionalità visive interattive

Anthropic ha annunciato un raddoppio temporaneo dei limiti di utilizzo per Claude valido dal 14 marzo 2026 al 27 marzo 2026. Gli utenti dei piani Free, Pro, Max e Team passano da 5 a 10 ore di utilizzo fuori dagli orari di picco, definiti tra le 8 e le 14 nei giorni feriali.Questa scelta risponde alla crescente domanda di modelli ad alte prestazioni e mira a distribuire meglio il carico sui server. Allo stesso tempo incentiva l’adozione delle nuove funzionalità in beta, tra cui Immersive Visuals.

Claude introduce infatti la generazione automatica di grafici, diagrammi e visualizzazioni direttamente nella conversazione. Il sistema decide autonomamente quando integrare elementi visivi, che possono poi essere modificati dall’utente in tempo reale. Questo approccio trasforma il chatbot in uno strumento interattivo di apprendimento e analisi, riducendo la necessità di strumenti esterni.

ChatGPT e Claude evolvono in piattaforme di apprendimento dinamico

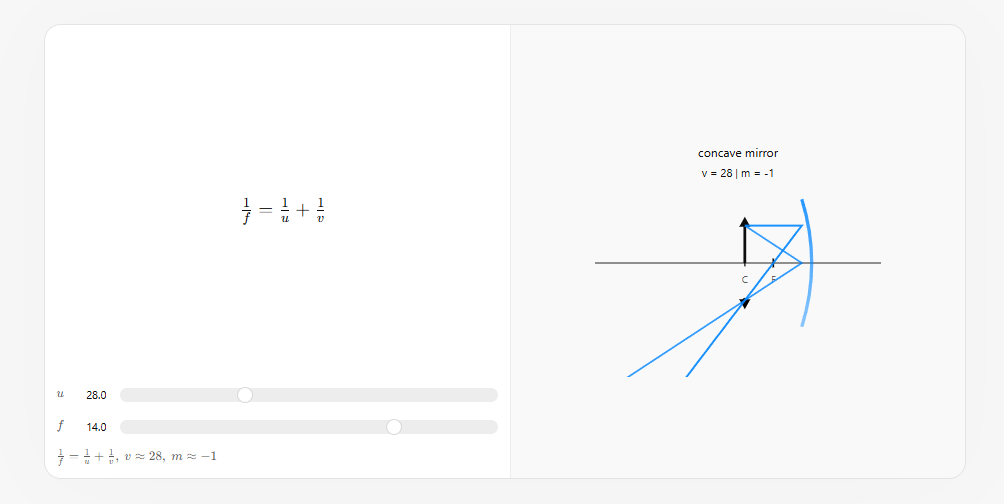

Parallelamente, anche ChatGPT evolve verso un modello di apprendimento interattivo. La piattaforma introduce moduli visivi dinamici per oltre 70 concetti di matematica e scienze, consentendo agli utenti di manipolare variabili e osservare risultati in tempo reale. Gli esempi includono teoremi matematici, leggi fisiche e modelli economici, rendendo l’esperienza più concreta e sperimentale. Questo segna il passaggio da chatbot conversazionali a ambienti educativi avanzati.

La combinazione tra input testuale e visualizzazione dinamica riduce il gap tra teoria e pratica, migliorando la comprensione di concetti complessi. Claude e ChatGPT convergono quindi verso un paradigma comune: l’AI come interfaccia attiva per l’apprendimento.

Google introduce controllo dei costi per Gemini API

Google rafforza l’offerta per sviluppatori introducendo nuove funzionalità di controllo dei costi nelle Gemini API attraverso Google AI Studio. Dal 16 marzo 2026, i team possono impostare limiti di spesa mensili per progetto direttamente nel pannello Spend. Questa funzione risponde a una delle principali criticità nell’adozione dell’AI su larga scala: la prevedibilità dei costi. Le aziende possono ora scalare l’utilizzo dei modelli mantenendo un controllo diretto sul budget.

Il sistema consente una gestione più efficiente delle risorse e riduce il rischio di spese impreviste, elemento fondamentale per progetti enterprise e ambienti di produzione. Questa evoluzione rende Gemini più competitivo rispetto ad altre piattaforme cloud AI.

Gemini trasforma BigQuery in un assistente analitico intelligente

Una delle innovazioni più rilevanti riguarda l’integrazione di Gemini in BigQuery Studio, che evolve da assistente di codice a vero partner analitico. Il sistema riconosce automaticamente le query attive e il contesto di lavoro, eliminando la necessità di copiare manualmente codice. Gli utenti possono generare query SQL avanzate tramite linguaggio naturale, includendo operatori AI e interrogazioni federate. Gemini analizza anche le prestazioni delle query, identificando problemi come contenzione degli slot, scansioni eccessive di dati e costi elevati. Questo permette agli analisti di ottimizzare immediatamente le operazioni. L’integrazione con Dataplex consente inoltre di esplorare risorse e dataset attraverso un catalogo unificato, mantenendo il rispetto delle policy di sicurezza aziendali. Il risultato è una riduzione significativa del tempo operativo e un aumento della produttività.

AWS e NVIDIA accelerano l’AI con inferenza disaggregata e nuove GPU

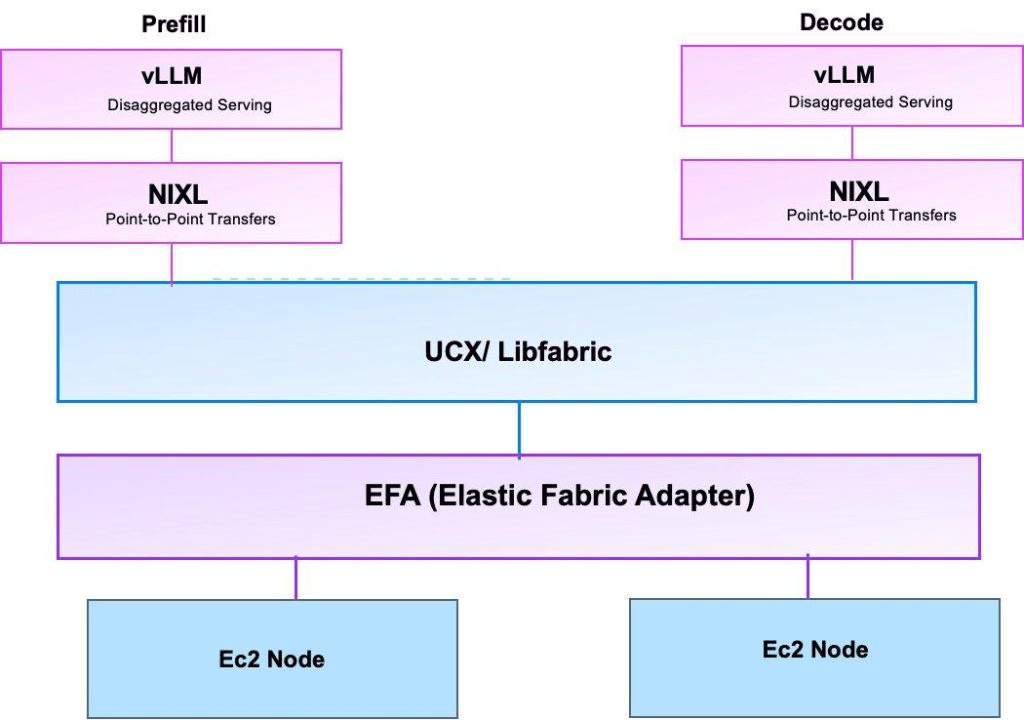

Durante il GTC 2026, AWS e NVIDIA hanno annunciato una espansione della loro partnership con il deployment di oltre 1 milione di GPU basate su architetture Blackwell e Rubin. Amazon EC2 diventa il primo cloud provider a supportare le RTX PRO 4500 Blackwell Server Edition, mentre l’integrazione con NVIDIA NIXL sull’Elastic Fabric Adapter consente di accelerare l’inferenza LLM.

AWS introduce anche il framework open source LLM-D, basato su vLLM e progettato per Kubernetes. Questa architettura separa le fasi di prefill e decode, ottimizzando l’uso delle risorse GPU. I benchmark mostrano un incremento fino al 70 percento dei token al secondo, con una scalabilità indipendente delle due fasi. Questo approccio riduce i costi operativi e migliora le prestazioni nei carichi complessi. La soluzione supporta modelli avanzati come DeepSeek-R1, Qwen3.5 e Llama-3.3, evidenziando una forte apertura verso ecosistemi multipli.

NVIDIA lancia NemoClaw per sviluppare modelli AI open source

NVIDIA introduce la coalizione NemoClaw, coinvolgendo otto laboratori AI tra cui Mistral AI, LangChain, Perplexity e startup emergenti. L’obiettivo è sviluppare modelli frontier open source che possano competere con le soluzioni proprietarie. Il primo modello sarà co-sviluppato con Mistral AI e rilasciato pubblicamente. I modelli entreranno nella famiglia Nemotron 4 e supporteranno applicazioni avanzate come robotica, veicoli autonomi e scoperta farmaceutica. NVIDIA fornisce l’infrastruttura tramite DGX Cloud, consolidando il proprio ruolo non solo come fornitore hardware ma come piattaforma completa per l’AI. Questa iniziativa rafforza il trend verso modelli aperti e interoperabili.

Meta sviluppa chip MTIA per ridurre la dipendenza da NVIDIA

Meta accelera la propria strategia hardware introducendo la famiglia di chip MTIA dedicata all’inferenza AI. La roadmap include quattro generazioni: MTIA 300, 400, 450 e 500. Le prestazioni mostrano un aumento significativo, con la banda HBM che passa da 6,1 TB/s a 27,6 TB/s, mentre i FLOPS crescono fino a 25 volte. L’architettura chiplet consente compatibilità tra generazioni senza modifiche infrastrutturali. I chip sono progettati specificamente per carichi di inferenza ad alto volume, affiancando GPU NVIDIA e AMD nei data center Meta. Questa strategia riflette una tendenza più ampia tra gli hyperscaler: ridurre la dipendenza da fornitori esterni e ottimizzare i costi attraverso hardware proprietario.

L’AI enterprise entra in una fase di maturità operativa

Gli aggiornamenti di marzo 2026 indicano una transizione chiara verso una AI più matura e integrata nei processi aziendali. Le aziende non si limitano più a sperimentare ma costruiscono infrastrutture complete per la produzione. Il controllo dei costi, la scalabilità delle architetture e l’integrazione nei flussi di lavoro diventano elementi centrali. Allo stesso tempo cresce l’importanza di modelli open e interoperabili. La combinazione tra innovazioni software e hardware crea un ecosistema più competitivo, dove cloud provider, aziende AI e hyperscaler competono su prestazioni, costi e flessibilità. Per sviluppatori e imprese, il risultato è un accesso sempre più diretto a tecnologie avanzate, con un impatto concreto su produttività e innovazione.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.