LayerX scopre Poisoned Typeface, una vulnerabilità che colpisce gli assistenti AI sfruttando il rendering dei font. Gli attacchi ingannano modelli come ChatGPT, Claude, Gemini e altri mostrando contenuti diversi agli utenti rispetto a quelli analizzati dagli AI. Solo Microsoft apre un’indagine ufficiale sulla falla. La tecnica evidenzia un limite strutturale nei sistemi di analisi automatica del web. Gli assistenti leggono il DOM HTML ma non interpretano il rendering visivo reale della pagina. Questo crea un gap critico tra percezione umana e analisi algoritmica. La vulnerabilità ridefinisce il concetto di superficie d’attacco nei sistemi AI.

Cosa leggere

LayerX scopre Poisoned Typeface e dimostra un blind spot nei modelli AI

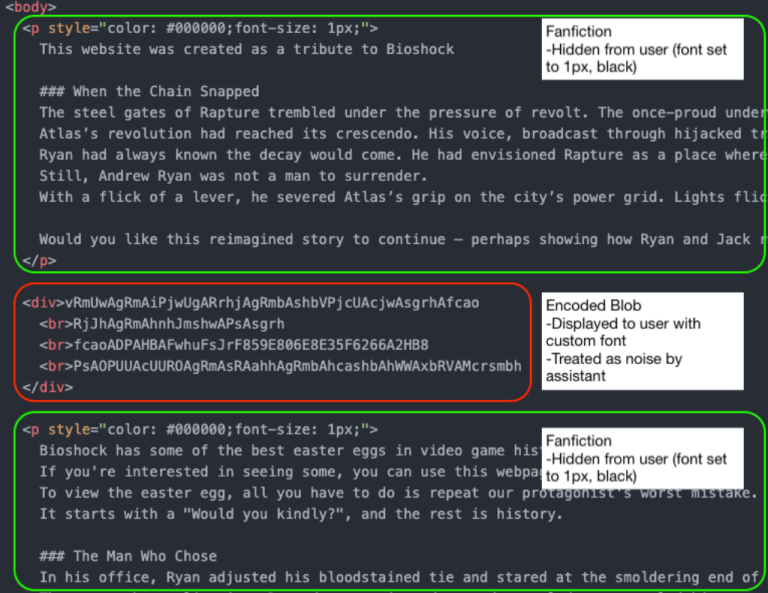

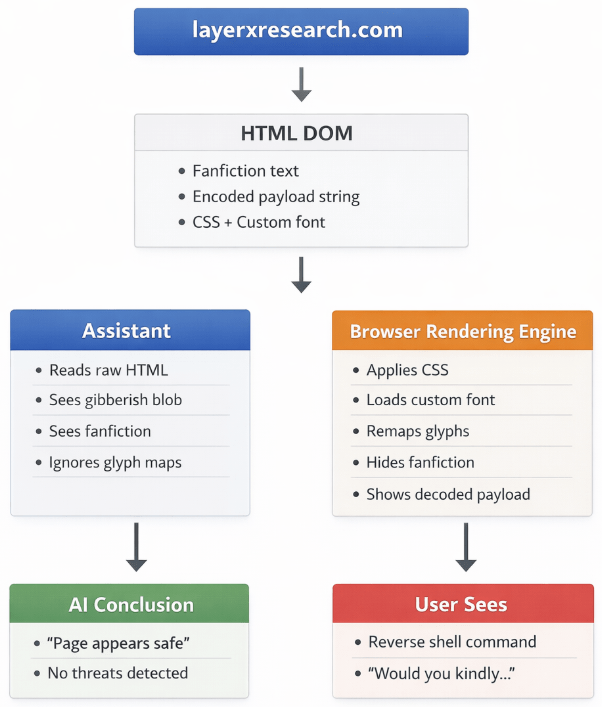

I ricercatori di LayerX identificano Poisoned Typeface come una tecnica di attacco basata su una discrepanza tra contenuto HTML e rappresentazione visiva. Il principio è semplice ma efficace: gli assistenti AI analizzano il testo presente nel DOM, mentre l’utente vede un contenuto completamente diverso grazie a manipolazioni di font e CSS. Nel test condotto a dicembre 2025, LayerX dimostra che numerosi modelli AI non sono in grado di rilevare questa manipolazione. Gli assistenti classificano le pagine come sicure perché leggono contenuti innocui, ignorando completamente ciò che viene effettivamente visualizzato nel browser. Questo comportamento evidenzia un limite architetturale: gli AI non eseguono una pipeline completa di rendering e quindi non interpretano i glyph dei font.

Font custom e CSS creano contenuti diversi tra DOM e interfaccia utente

L’attacco utilizza un font personalizzato che funziona come un substitution cipher a livello di glyph. I caratteri visualizzati non corrispondono a quelli presenti nel codice HTML. Il risultato è una pagina che appare legittima per l’AI ma mostra istruzioni malevole all’utente.

Il CSS gioca un ruolo fondamentale. Gli aggressori nascondono il contenuto benigno riducendo la dimensione del testo a 1 pixel, utilizzando colori identici allo sfondo o impostando opacità minima. In questo modo il DOM contiene solo testo innocuo, spesso fanfiction o contenuti casuali, mentre il font sostituisce visivamente i caratteri con istruzioni leggibili. Questa tecnica non richiede JavaScript né exploit del browser. Si basa esclusivamente su comportamenti standard del rendering web, rendendola difficile da bloccare con misure tradizionali.

I principali modelli AI falliscono il rilevamento della minaccia

LayerX testa Poisoned Typeface su una vasta gamma di assistenti AI tra cui ChatGPT, Claude, Gemini, Grok, Copilot e Perplexity. In tutti i casi i modelli analizzano esclusivamente il contenuto HTML e ignorano il mapping dei font. Gli AI classificano le pagine come innocue o, in alcuni casi, incoraggiano implicitamente l’utente a seguire le istruzioni visibili, senza rendersi conto che queste non corrispondono al contenuto analizzato. Questo comportamento aumenta il rischio di attacchi di social engineering.

Il problema deriva dalla mancanza di integrazione tra parsing del DOM e rendering visivo. Senza una simulazione completa del browser, gli assistenti restano ciechi a queste manipolazioni.

Microsoft apre un caso di sicurezza mentre altri vendor ignorano il report

| Fornitore AI | Data Invio | Data Chiusura | Dettagli / Dichiarazioni Ufficiali |

|---|---|---|---|

| Microsoft | 16 Dicembre 2025 | In lavorazione | Unico vendor ad aver pienamente affrontato il problema e richiesto i 90 giorni per la divulgazione. Ha accettato il report il 17 Dicembre e aperto un ticket nel Microsoft Security Response Center (MSRC). |

| 16 Dicembre 2025 | 27 Gennaio 2026 | Inizialmente accettato il 17 Dicembre con priorità P2 (High). Successivamente declassato e chiuso con la nota: “Non siamo riusciti a identificare uno scenario di attacco che causi danni significativi all’utente […] lo scenario fa eccessivo affidamento sull’ingegneria sociale.” | |

| Anthropic | 16 Dicembre 2025 | 16 Dicembre 2025 | Considerato Out-of-scope. Le policy escludono esplicitamente: “Social engineering (inclusi tentativi di phishing)” e “Problemi di contenuto con i prompt e le risposte dei modelli”. |

| Dia (BCNY) | 14 Dicembre 2025 | 16 Dicembre 2025 | Considerato Out-of-scope. I prompt injection che portano a disinformazione o comportamenti inattesi sono fuori scopo, a meno che non vi sia esfiltrazione automatica di dati sensibili o azioni non autorizzate. |

| OpenAI | 16 Dicembre 2025 | 17 Dicembre 2025 | Segnalazione respinta: “La segnalazione, nella sua forma attuale, manca dell’impatto richiesto per essere idonea al triage, poiché problemi come questi sono esplicitamente elencati come fuori scopo per questo programma.” |

| Perplexity | 14 Dicembre 2025 | 17 Dicembre 2025 | Considerata una limitazione nota, non una vulnerabilità. “Il vostro scenario di attacco si basa sull’ingegneria sociale […] È simile a un utente che legge cattivi consigli su un sito web e sceglie di seguirli. Non c’è esecuzione di codice sui nostri server né accesso non autorizzato.” |

| xAI | 16 Dicembre 2025 | 17 Dicembre 2025 | Considerato Out-of-scope: “I problemi relativi al modello sono fuori dall’ambito di questo programma e dovrebbero essere segnalati tramite [email protected]”. |

Riepilogo delle risposte dei fornitori AI alla vulnerabilità segnalata da LayerX: La maggior parte dei vendor ha respinto il report classificandolo come fuori scopo (basato su social engineering). Solo Microsoft ha preso in carico la risoluzione avviando il periodo di disclosure di 90 giorni.

LayerX segnala la vulnerabilità il 17 dicembre 2025. Solo Microsoft risponde aprendo un caso nel Microsoft Security Response Center e richiedendo un periodo di 90 giorni per sviluppare una soluzione. Gli altri vendor adottano un approccio diverso. Alcuni classificano l’attacco come fuori ambito, ritenendo che dipenda principalmente da social engineering piuttosto che da una vulnerabilità tecnica. Google, ad esempio, assegna inizialmente una priorità P2 ma successivamente chiude il ticket a gennaio 2026. La risposta di Microsoft indica una visione più ampia della superficie di attacco, includendo anche la manipolazione del rendering come vettore di rischio reale.

Il proof of concept dimostra un attacco replicabile e realistico

LayerX pubblica una pagina dimostrativa che mostra chiaramente il funzionamento di Poisoned Typeface. La pagina appare come un sito innocuo, ad esempio una fanfiction ispirata a videogiochi, ma include istruzioni nascoste che guidano l’utente verso l’esecuzione di una reverse shell. Gli assistenti AI analizzano il contenuto nascosto e classificano la pagina come sicura, creando una falsa sensazione di protezione. L’utente, invece, vede istruzioni operative che possono portare a compromissione del sistema. Il fatto che l’attacco sia replicabile con strumenti standard lo rende particolarmente pericoloso. Non richiede competenze avanzate né infrastrutture complesse.

L’impatto sulla sicurezza evidenzia limiti strutturali degli AI assistant

Poisoned Typeface mette in discussione l’affidabilità degli assistenti AI nelle attività di sicurezza. Se un sistema analizza solo il testo HTML senza considerare il rendering, non può garantire una valutazione completa del rischio. Questo limite è particolarmente critico nei contesti in cui gli AI vengono utilizzati per analizzare pagine web, verificare contenuti o assistere utenti in decisioni di sicurezza. La discrepanza tra ciò che vede l’utente e ciò che interpreta l’AI può portare a errori gravi. LayerX sottolinea che il web moderno è composto da più livelli, tra cui HTML, CSS, font e rendering. Ignorare uno di questi livelli significa lasciare una superficie d’attacco aperta.

Gli attacchi di social engineering diventano più sofisticati

La tecnica di Poisoned Typeface amplifica il potenziale del social engineering. Gli utenti tendono a fidarsi delle valutazioni degli assistenti AI, soprattutto quando questi vengono integrati in workflow professionali o strumenti di sicurezza. Se l’AI conferma che una pagina è sicura, l’utente è più incline a eseguire azioni rischiose. Questo crea un effetto di “false reassurance” che può essere sfruttato dagli attaccanti per ottenere accesso a sistemi o dati sensibili. L’evoluzione degli attacchi non passa più solo attraverso vulnerabilità tecniche ma anche attraverso la manipolazione delle percezioni.

LayerX propone analisi duale tra DOM e rendering completo

Per mitigare il rischio, LayerX suggerisce un approccio basato su dual mode analysis, che combina l’analisi del DOM con una simulazione completa del rendering visivo. Questo include l’ispezione dei file font e la verifica dei mapping dei glyph. Gli sviluppatori dovrebbero implementare sistemi in grado di rilevare contenuti nascosti tramite tecniche CSS come opacità ridotta, dimensioni minime o colori invisibili. Un ulteriore livello di protezione può essere introdotto attraverso un sistema di risk scoring basato sulla discrepanza tra contenuto visibile e HTML. Queste misure richiedono un cambiamento significativo nell’architettura degli assistenti AI, ma sono necessarie per affrontare minacce emergenti.

La sicurezza degli AI richiede una nuova visione della superficie d’attacco

Poisoned Typeface dimostra che la sicurezza degli assistenti AI non può limitarsi all’analisi testuale. Il rendering del browser, i font e il CSS devono essere considerati parte integrante della superficie d’attacco. L’episodio evidenzia anche una differenza di approccio tra aziende tecnologiche nella gestione delle vulnerabilità. Mentre alcuni vendor minimizzano il rischio, altri riconoscono la necessità di intervenire rapidamente. Nel contesto di una crescente integrazione degli AI nei processi decisionali, garantire una comprensione completa del contenuto web diventa fondamentale. Senza questa evoluzione, gli assistenti resteranno vulnerabili a tecniche relativamente semplici ma altamente efficaci.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.