Google introduce Stitch AI per il design di interfacce e amplia le funzionalità di Gemini e YouTube Shorts con strumenti di generazione video basati su AI. In parallelo, Amazon Web Services aggiorna SageMaker Unified Studio e sviluppa pipeline scalabili per la creazione automatizzata di contenuti video. Le novità rafforzano l’adozione dell’intelligenza artificiale generativa in ambito creativo e enterprise. Le nuove soluzioni puntano a ridurre il tempo di sviluppo, migliorare la personalizzazione dei contenuti e aumentare la produttività di designer, creator e team di machine learning. L’integrazione tra modelli generativi e strumenti operativi segna un’evoluzione concreta nell’uso industriale dell’AI. Questa fase evidenzia un’accelerazione nella competizione tra ecosistemi cloud e piattaforme AI, con focus su automazione creativa e scalabilità.

Cosa leggere

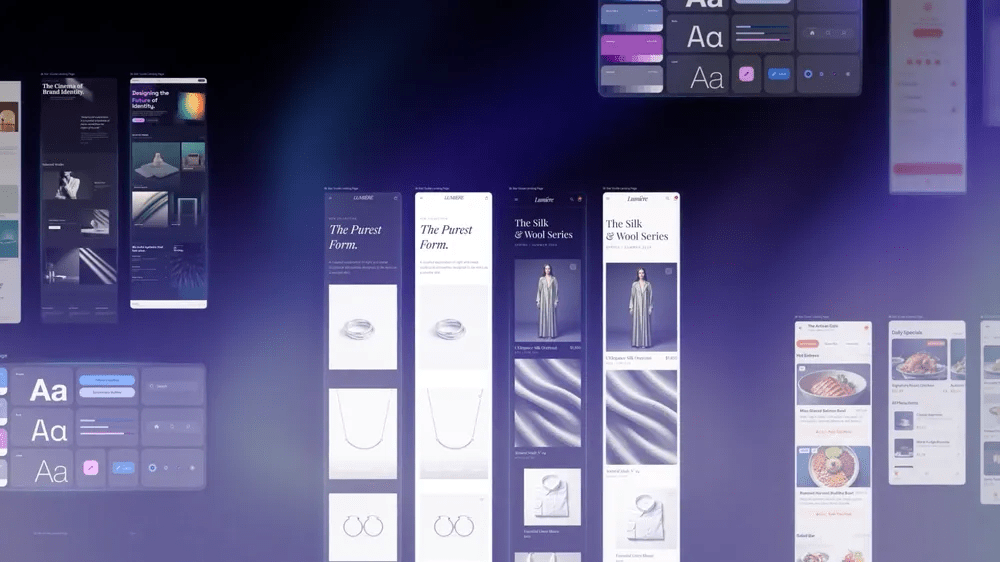

Google presenta Stitch AI per generare interfacce da linguaggio naturale

Con Stitch AI, Google introduce un canvas progettato per trasformare descrizioni testuali in interfacce utente ad alta fedeltà. Il sistema consente di creare prototipi funzionali partendo da prompt in linguaggio naturale, riducendo il gap tra ideazione e sviluppo. Il concetto di vibe design diventa centrale: il designer non costruisce manualmente ogni componente, ma descrive l’esperienza desiderata e lascia al sistema il compito di generare layout, struttura e logica visiva.

Questo approccio accelera significativamente le fasi iniziali del design. La piattaforma supporta collaborazione in tempo reale tra designer e sviluppatori, permettendo iterazioni rapide e condivise. In contesti enterprise, questa capacità può ridurre i cicli di sviluppo e migliorare la coerenza tra progettazione e implementazione. L’impatto è particolarmente rilevante per startup e team agili, dove il time-to-market rappresenta un fattore competitivo critico.

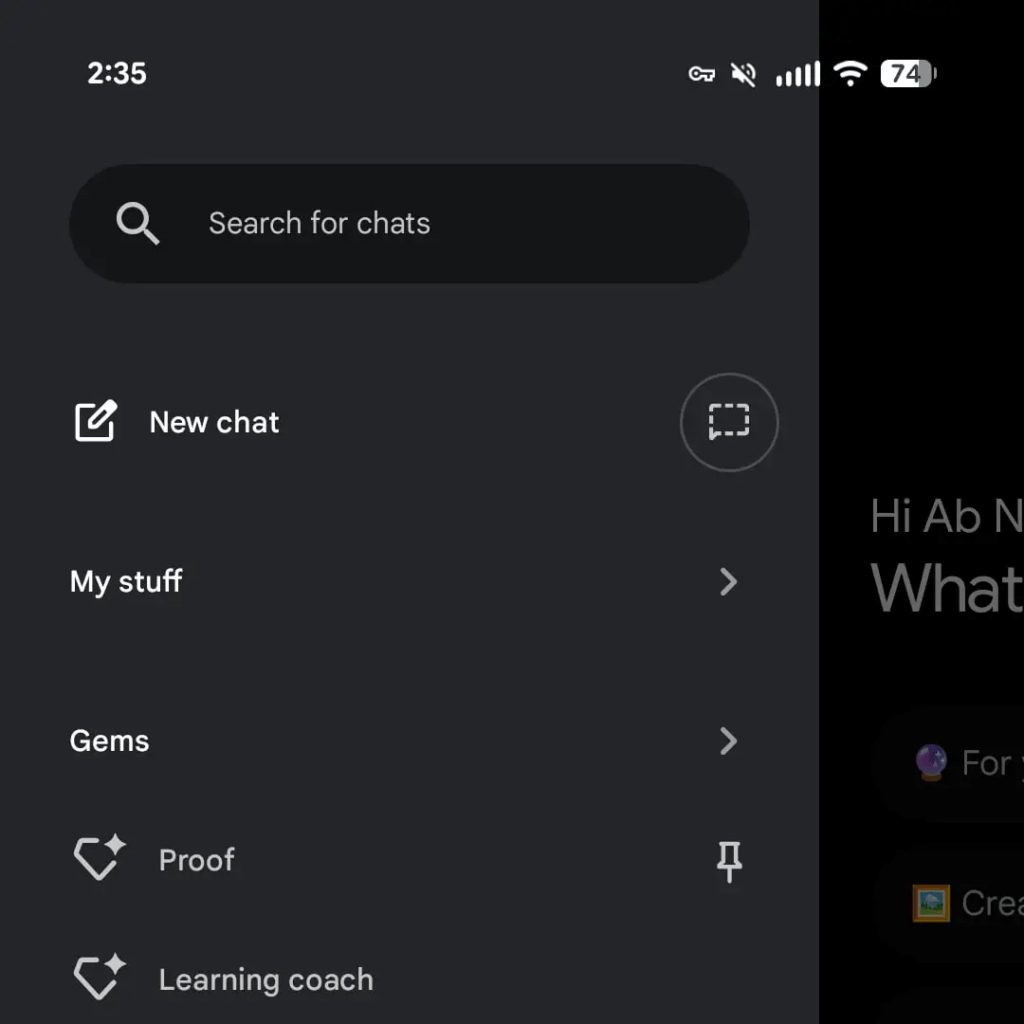

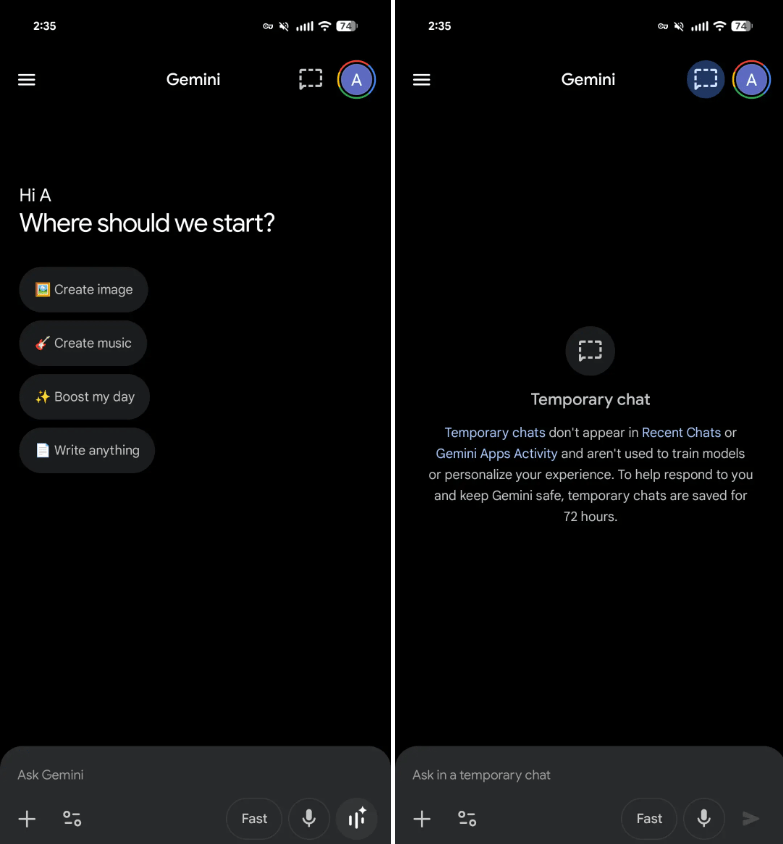

Gemini introduce chat temporanee per rafforzare la privacy

Google aggiorna Gemini introducendo un accesso più diretto alle chat temporanee, ora disponibili direttamente dalla homepage dell’applicazione. Questa modifica migliora l’usabilità e rende più immediato l’avvio di conversazioni non persistenti.

Le chat temporanee non vengono salvate nella cronologia e non contribuiscono all’addestramento dei modelli. Questo garantisce un livello più elevato di privacy, particolarmente utile per utenti che lavorano con informazioni sensibili o sperimentano prompt riservati.

Dal punto di vista del design, l’interfaccia risulta più pulita e meno stratificata, con una navigazione semplificata. Il rollout avviene progressivamente su un numero limitato di utenti, suggerendo una fase di test controllata. Questa funzionalità riflette una crescente attenzione verso la gestione dei dati e la trasparenza nell’utilizzo dell’intelligenza artificiale.

YouTube Shorts integra Reimagine con Gemini e modello Veo

All’interno di YouTube Shorts, Google introduce la funzione Reimagine, che consente di trasformare contenuti esistenti in nuovi video generati dall’AI. Gli utenti selezionano un frame da uno Short e lo utilizzano come base per creare una clip di circa 8 secondi. Il sistema combina le capacità di Gemini per la generazione di prompt e suggerimenti con il modello video Veo, responsabile della creazione del contenuto visivo. Gli utenti possono personalizzare il risultato inserendo prompt testuali e fino a due immagini di riferimento.

Questa funzionalità apre nuove possibilità creative, permettendo di reinterpretare contenuti in modo dinamico. Ad esempio, un creator può inserirsi virtualmente in scenari complessi o trasformare una scena statica in una sequenza animata. Il rollout della funzione è iniziato il 18 marzo 2026 e avviene in modo graduale, segnalando un approccio prudente per gestire qualità e sicurezza dei contenuti generati.

AWS aggiorna SageMaker Unified Studio con filtri metadata avanzati

Sul fronte enterprise, Amazon Web Services introduce miglioramenti in SageMaker Unified Studio, focalizzati sulla gestione e scoperta dei dati. La piattaforma integra nuovi filtri basati su metadata personalizzati, definiti direttamente dalle organizzazioni. Questi filtri consentono di navigare cataloghi complessi utilizzando criteri specifici come area terapeutica, classificazione dei dati o regione geografica. La ricerca diventa quindi più precisa e contestualizzata rispetto ai metodi tradizionali. Un elemento rilevante è la persistenza dei filtri tra sessioni, che migliora la continuità operativa per i team di data science. Le aziende possono inoltre strutturare i metadata in fase di pubblicazione degli asset, ottimizzando il processo di discovery. Questo aggiornamento evidenzia l’importanza crescente della governance dei dati nei flussi di lavoro AI.

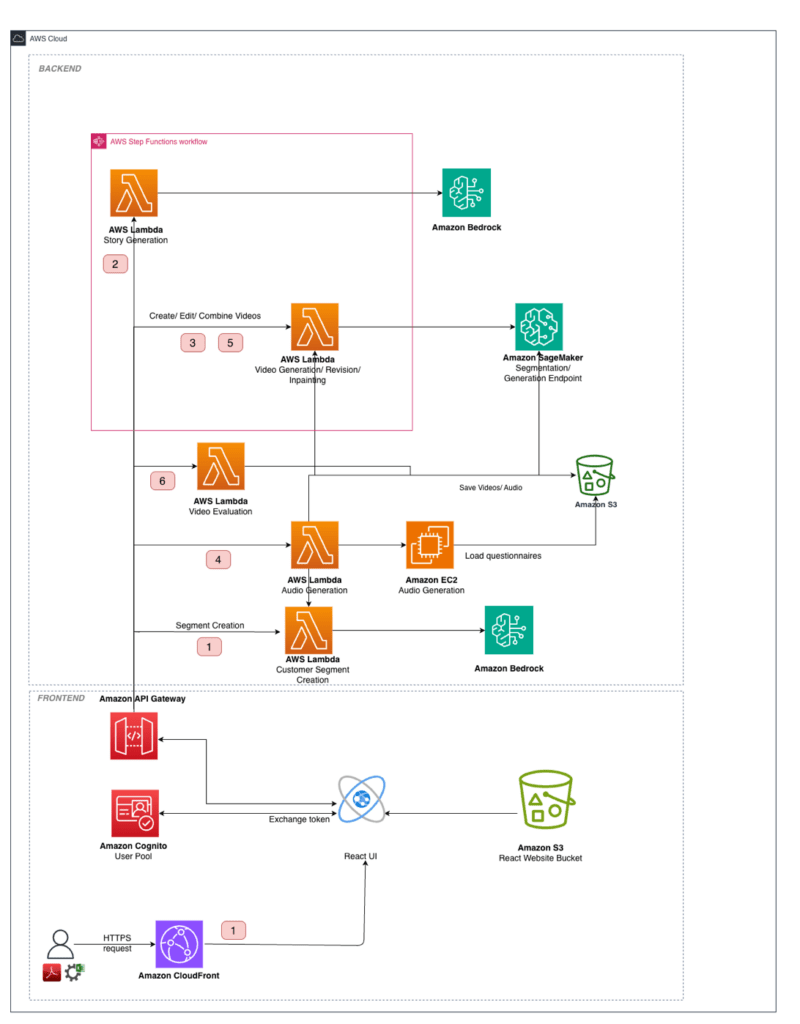

AWS e Bark.com sviluppano pipeline per video pubblicitari generati da AI

AWS collabora con Bark.com per creare una pipeline scalabile dedicata alla generazione di video pubblicitari. Il sistema produce contenuti di 15–30 secondi in circa 12–15 minuti, riducendo drasticamente i tempi rispetto ai processi tradizionali. La soluzione combina Amazon Bedrock con modelli come Claude e architetture personalizzate basate su SageMaker. A questi si aggiungono sistemi di sintesi vocale e controlli automatici di qualità che verificano coerenza narrativa e visiva.

Questo approccio permette alle aziende di generare rapidamente varianti creative e testare campagne su micro-segmenti di pubblico. La personalizzazione diventa quindi scalabile, un elemento chiave nel marketing digitale contemporaneo. La pipeline rappresenta un esempio concreto di industrializzazione dell’AI generativa, dove creatività e automazione convergono in un unico flusso produttivo.

L’intelligenza artificiale ridefinisce design e produzione contenuti

Le innovazioni presentate da Google e AWS indicano una trasformazione strutturale nei processi creativi e produttivi. Il design di interfacce, la generazione video e la gestione dei dati convergono verso modelli automatizzati e assistiti dall’intelligenza artificiale. Strumenti come Stitch AI riducono le barriere tecniche nel design, mentre piattaforme come SageMaker permettono di gestire infrastrutture complesse con maggiore efficienza. Allo stesso tempo, funzionalità come Reimagine dimostrano come la creatività possa essere amplificata da modelli generativi avanzati. La competizione tra ecosistemi cloud e AI si concentra sempre più sulla capacità di offrire strumenti integrati, scalabili e facilmente accessibili. Questo trend favorisce sia i creator indipendenti sia le grandi organizzazioni. Nel medio periodo, l’evoluzione di questi strumenti potrebbe ridefinire il ruolo di designer, sviluppatori e content creator, spostando il focus dalla produzione manuale alla supervisione e direzione creativa.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.