NVIDIA definisce il futuro dell’intelligenza artificiale come una convergenza tra modelli open e tecnologie proprietarie, superando la lettura semplicistica che contrappone i due approcci. Jensen Huang sostiene che l’AI sia ormai un’infrastruttura di base per imprese, governi e industrie e che, per funzionare davvero su scala globale, abbia bisogno di un ecosistema composto da modelli grandi e piccoli, generalisti e specialistici, aperti e chiusi. In questo quadro l’azienda accelera sia sul lato della collaborazione open source sia su quello delle piattaforme enterprise ad alte prestazioni e sicurezza. La strategia prende forma attraverso tre mosse precise. La prima è la NVIDIA Nemotron Coalition, che punta a rafforzare i foundation model open di livello frontier insieme a partner come Mistral AI. La seconda è la donazione del Dynamic Resource Allocation Driver per GPU al progetto Kubernetes annunciata a KubeCon Europe 2026, con l’obiettivo di spostare la governance dalla sfera del vendor a quella della community. La terza è il lancio di OpenShell, runtime open source secure-by-design pensato per eseguire agenti AI autonomi in ambienti isolati, controllabili e conformi. Il messaggio è chiaro: l’AI del futuro non sarà solo potente, ma dovrà essere anche interoperabile, sicura e gestibile.

Cosa leggere

Jensen Huang presenta open e proprietario come componenti complementari dell’AI

Nel discorso strategico di Jensen Huang, il punto centrale è che non esiste una reale alternativa secca tra AI aperta e AI proprietaria. L’una non esclude l’altra, perché ciascuna risponde a bisogni differenti. I modelli aperti accelerano la ricerca, ampliano la sperimentazione e favoriscono una diffusione più capillare delle competenze. I sistemi proprietari, invece, offrono in molti casi livelli più elevati di ottimizzazione, supporto enterprise, performance, integrazione verticale e protezione operativa. Per NVIDIA, la crescita dell’intelligenza artificiale dipende proprio dalla coesistenza di queste due dimensioni. Questa posizione riflette anche l’evoluzione del mercato. L’AI non è più vista come una tecnologia limitata ai laboratori o alle sole big tech, ma come una piattaforma trasversale destinata a entrare nella sanità, nella manifattura, nella finanza, nella ricerca scientifica e nella pubblica amministrazione. Ogni settore ha dati, workflow, vincoli normativi e requisiti operativi diversi. Di conseguenza, nessun modello unico può soddisfare tutto. Servono modelli verticali, modelli generalisti, sistemi specializzati on-device, stack cloud enterprise e infrastrutture adattabili a casi d’uso molto differenti tra loro. NVIDIA prova quindi a posizionarsi come ponte fra questi mondi. Da una parte rivendica un ruolo di primo piano nell’ecosistema open, anche attraverso l’attività del proprio team su Hugging Face. Dall’altra continua a mantenere una forte integrazione proprietaria su hardware, software, orchestrazione e sicurezza. È un equilibrio che punta a massimizzare l’adozione senza rinunciare al controllo su tecnologie chiave per il calcolo accelerato.

La Nemotron Coalition rafforza i foundation model open di livello frontier

La nascita della NVIDIA Nemotron Coalition rappresenta uno dei tasselli più rilevanti di questa strategia. L’iniziativa viene presentata come una collaborazione globale tra builder di modelli e laboratori AI con l’obiettivo di avanzare i foundation model open di fascia alta. Il punto non è solo rilasciare codice o pesi, ma costruire un meccanismo di cooperazione su expertise, dataset e compute, così da accelerare lo sviluppo collettivo di modelli realmente competitivi. All’interno di questa coalizione, Mistral AI contribuisce al co-sviluppo del foundation model che poi sarà disponibile all’intero ecosistema open. NVIDIA intende usarlo anche come base per la prossima generazione di NVIDIA Nemotron, famiglia che ha già raggiunto oltre 45 milioni di download su Hugging Face. Il dato mostra quanto forte sia la domanda di modelli aperti capaci di essere adattati, ottimizzati e integrati in casi d’uso reali, sia in ricerca sia in contesti commerciali. L’impatto potenziale della Nemotron Coalition è duplice. Da un lato crea una piattaforma condivisa che può ridurre la distanza tra i laboratori open e i modelli frontier chiusi. Dall’altro consolida il ruolo di NVIDIA come soggetto che non si limita a fornire GPU, ma interviene direttamente nella costruzione del layer modellistico e della community tecnica che lo sostiene. In termini di mercato, significa presidiare non solo il compute, ma anche l’evoluzione del software e delle architetture AI che girano su quel compute.

I panel al GTC mostrano un consenso crescente sulla convivenza tra modelli aperti e chiusi

Le sessioni del GTC confermano che questa visione non è isolata. Nei panel dedicati al tema, figure come Harrison Chase, Mira Murati, Aravind Srinivas, Michael Truell e Misha Laskin descrivono un panorama in cui gli agenti AI diventano sempre più simili a coworker digitali, capaci di gestire task complessi per periodi lunghi e di coordinarsi su più modelli, più servizi cloud e più modalità operative. L’idea di Aravind Srinivas di un’AI “multi-modale, multi-modello e multi-cloud” riassume bene la direzione del settore. L’utente non sceglie necessariamente il singolo modello migliore in assoluto, ma delega un obiettivo a un sistema che decide quale combinazione di modelli e strumenti usare. In una simile architettura, l’open source svolge un ruolo fondamentale per la flessibilità, la verificabilità e la velocità di sperimentazione, mentre le componenti proprietarie entrano in gioco quando servono integrazione, affidabilità enterprise, sicurezza o prestazioni estreme.

Anche le posizioni di Mira Murati, Arthur Mensch, Hanna Hajishirzi e Robin Rombach convergono su un punto: l’openness resta essenziale per la scienza dell’AI, per la trasparenza e per l’emergere di modelli specializzati che possano vivere su device, edge o ambienti verticali. NVIDIA sfrutta questo consenso per rafforzare la propria narrazione: non si tratta di scegliere un campo, ma di costruire un ecosistema ibrido in cui open e closed avanzano insieme.

NVIDIA dona il Dynamic Resource Allocation Driver alla community Kubernetes

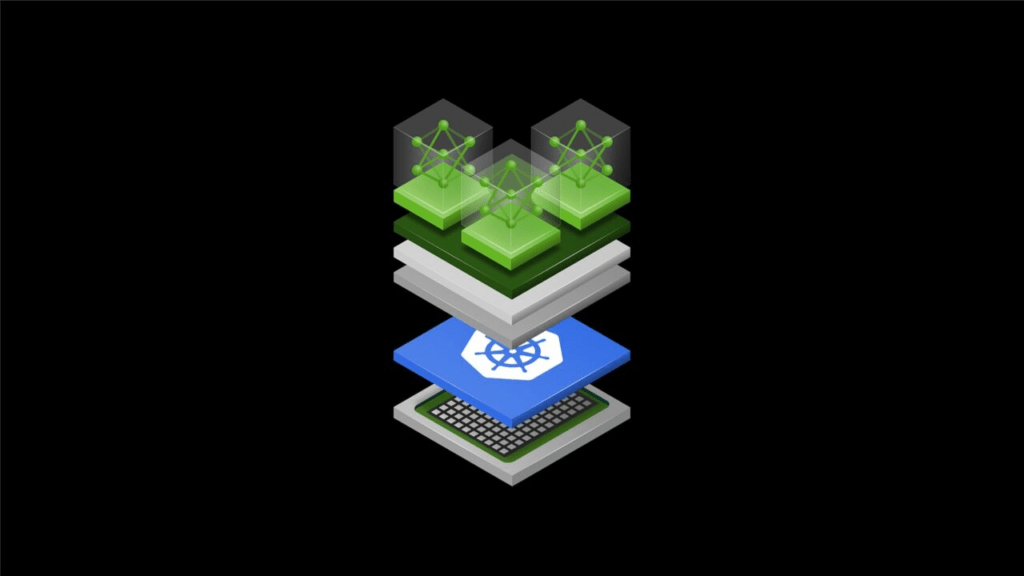

Sul piano infrastrutturale, una delle novità più rilevanti è la donazione del Dynamic Resource Allocation Driver per GPU al progetto Kubernetes nell’ambito della Cloud Native Computing Foundation. L’annuncio, avvenuto a KubeCon Europe 2026, non è solo tecnico ma anche politico: trasferire questo componente nella sfera community-owned significa ridurre la dipendenza da una governance puramente vendor-driven e rafforzare l’allineamento tra l’evoluzione dell’hardware accelerato e l’upstream di Kubernetes.

Il driver permette una riconfigurazione dinamica delle risorse GPU e risponde a una necessità ormai centrale nei workload AI moderni: allocare calcolo, memoria e interconnessione in modo granulare, adattando il cluster alle caratteristiche reali del training e dell’inference. In uno scenario in cui i modelli si moltiplicano, gli agenti eseguono task eterogenei e i cluster devono supportare carichi variabili, la rigidità delle allocazioni tradizionali diventa un limite importante. La donazione del DRA Driver va letta anche come un segnale verso il mercato enterprise. NVIDIA mostra di voler sostenere la standardizzazione dei layer di orchestrazione che regolano l’uso delle GPU nei cluster cloud native. In pratica, rafforza la propria centralità non solo attraverso il silicio, ma anche attraverso il modo in cui quel silicio viene richiesto, schedulato, condiviso e riconfigurato in ambienti di produzione.

Il driver abilita condivisione intelligente e interconnessione multi-nodo per i workload AI

Dal punto di vista tecnico, il Dynamic Resource Allocation Driver supporta funzioni cruciali come la condivisione intelligente tramite NVIDIA Multi-Process Service e Multi-Instance GPU, oltre alla gestione dell’interconnessione multi-nodo con NVIDIA Multi-Node NVLink. Questo è particolarmente rilevante nei sistemi Grace Blackwell, dove il training di modelli di grandi dimensioni dipende in modo crescente dall’efficienza della comunicazione tra GPU, nodi e domini di memoria.

Gli sviluppatori possono così richiedere risorse con granularità molto fine, non solo in termini di quantità di GPU ma anche rispetto a impostazioni di memoria, partizionamento e topologie di interconnect. È un passaggio importante perché l’AI moderna non consuma solo potenza di calcolo in modo lineare. Consuma banda, richiede isolamento in alcuni casi, condivisione in altri, e ha bisogno di una visione più dichiarativa e programmabile delle risorse. Questa evoluzione rende Kubernetes sempre più adatto a diventare il sistema operativo dei cluster AI. Per NVIDIA è una mossa strategica: più Kubernetes diventa il linguaggio standard dell’orchestrazione AI, più conta avere un ruolo attivo nei suoi meccanismi di allocazione accelerata. È qui che la donazione del driver assume un valore sistemico, andando oltre la semplice apertura di un repository su GitHub.

KAI Scheduler e Confidential Containers ampliano la strategia cloud native di NVIDIA

Accanto alla donazione del DRA Driver, NVIDIA spinge anche su altri componenti dell’ecosistema cloud native. L’onboarding di KAI Scheduler come CNCF Sandbox project punta a favorire lo sviluppo condiviso di uno scheduler ad alte prestazioni per workload AI, mentre il supporto GPU per Confidential Containers estende l’accelerazione hardware a contesti di maggiore isolamento, integrando i vantaggi delle GPU con garanzie più forti sul fronte della sicurezza del runtime. Questo tema è fondamentale per l’AI enterprise. Le aziende non chiedono solo più potenza, ma anche controlli migliori su tenant isolation, esecuzione protetta, confidenzialità dei dati e segmentazione dei carichi. Portare la GPU nel mondo di Kata Containers e dei Confidential Containers significa rendere più credibile l’uso dell’AI in scenari regolati, multi-tenant o ad alta sensibilità, dove l’accelerazione non può avvenire a scapito della sicurezza. NVIDIA dimostra così di voler presidiare l’intera catena dell’infrastruttura: allocazione dinamica, scheduling, runtime isolato e orchestrazione dichiarativa. Il risultato è un’offerta che parla direttamente alle esigenze dei cluster AI moderni, soprattutto nelle strategie enterprise in cui cloud, on-premise ed edge devono convivere sotto policy comuni.

OpenShell porta la sicurezza nel runtime degli agenti AI autonomi

Se la donazione a Kubernetes riguarda il lato infrastrutturale, OpenShell rappresenta la risposta di NVIDIA al problema emergente della sicurezza degli agenti AI autonomi. Il runtime open source viene presentato come secure-by-design e si basa su un principio chiave: la sicurezza non deve essere affidata al solo modello o alla singola applicazione, ma deve risiedere nell’ambiente di esecuzione che circonda l’agente. Ogni agente gira in una sandbox dedicata, e le policy vengono separate dal comportamento applicativo e applicate a livello di infrastruttura. In questo modo, anche se l’agente fosse indotto a deviare, compromesso o esposto a prompt malevoli, non potrebbe superare i limiti definiti dal runtime. NVIDIA cerca quindi di prevenire scenari sempre più discussi nel settore, come l’accesso improprio a credenziali, il leak di dati privati o la possibilità che un agente autonomo modifichi il proprio comportamento operativo senza controlli. Il punto più interessante di OpenShell è proprio questa separazione tra tre piani distinti: behavior dell’agente, policy definition e policy enforcement. È un modello che ricorda, in parte, il modo in cui i browser moderni o gli smartphone isolano applicazioni e permessi. Traslato nel mondo degli agenti AI, questo approccio permette di trattare gli agenti come entità potenti ma limitate, sotto osservazione costante e con margini di azione definiti in modo programmabile.

NemoClaw e l’Agent Toolkit trasformano OpenShell in uno stack operativo completo

OpenShell non arriva come componente isolato, ma come parte del NVIDIA Agent Toolkit e in stretta integrazione con NemoClaw, presentato come reference stack open source per assistenti always-on e workflow agentici. L’idea è fornire alle imprese e agli sviluppatori non solo un runtime sicuro, ma un’intera base operativa che permetta di installare, configurare e governare agenti autonomi con un unico comando. Con NemoClaw, NVIDIA punta a semplificare l’adozione di agenti AI che possano lavorare a lungo termine su task di coding, ricerca o automazione avanzata. Le policy di privacy e sicurezza diventano configurabili in modo simile alle preferenze di sistema di un’app mobile: l’utente o l’organizzazione può decidere quali dati l’agente può toccare, quali azioni può compiere, quali ambienti può raggiungere e quali logiche di enforcement devono scattare. Questo è particolarmente rilevante in un mercato che si sta spostando dagli assistenti conversazionali agli agentic workflows. Un agente che lavora per ore o giorni, modifica file, usa strumenti, consulta repository e interagisce con API interne rappresenta un livello di rischio molto diverso da quello di un semplice chatbot. NVIDIA prova ad anticipare questa trasformazione con un layer di runtime capace di governare l’autonomia senza soffocarla.

La collaborazione con Cisco, CrowdStrike e Microsoft Security rafforza il controllo di policy

Per rendere credibile OpenShell in ambito enterprise, NVIDIA collabora con partner di sicurezza come Cisco, CrowdStrike, Google Cloud, Microsoft Security e TrendAI. Lo scopo è allineare gestione ed enforcement delle policy runtime lungo l’intero stack aziendale, sia in cloud sia on-premise, fino ai dispositivi personali come PC, workstation e sistemi AI compatti della stessa NVIDIA. Questa integrazione è importante perché uno dei problemi storici dell’AI enterprise è la frammentazione delle policy. Un agente può operare su più ambienti, accedere a risorse eterogenee e muoversi tra terminali, cluster, repository e servizi cloud. Se i controlli cambiano da un layer all’altro, la superficie di rischio cresce rapidamente. OpenShell prova invece a imporre un unified policy layer, dove permessi, isolamento e controlli di privacy seguono l’agente lungo tutto il percorso operativo. NVIDIA adotta qui una metafora molto efficace: il modello di isolamento è simile a quello delle tab del browser, dove ogni sessione resta separata, le risorse vengono controllate e il runtime verifica i permessi prima di ogni azione. È un concetto semplice ma potente, perché trasforma l’agente in un soggetto osservabile e confinato, non in un processo opaco lasciato libero di muoversi in azienda.

NVIDIA consolida la leadership nell’AI enterprise con un ecosistema completo

La combinazione tra Nemotron Coalition, donazione del DRA Driver a Kubernetes e lancio di OpenShell mostra una strategia coerente. NVIDIA non si limita a spingere l’hardware o a difendere componenti proprietarie ad alte prestazioni. Sta costruendo un ecosistema completo in cui i modelli open contribuiscono alla diffusione dell’AI, i layer cloud native rendono gestibili le infrastrutture accelerate e i runtime secure-by-design permettono di far crescere agenti autonomi senza perdere il controllo. Il vantaggio competitivo dell’azienda nasce proprio da questa integrazione. Da una parte sostiene l’innovazione collettiva e la community open source, elemento sempre più importante per credibilità tecnica e velocità di adozione. Dall’altra conserva un forte presidio su tecnologie critiche per performance, sicurezza, orchestrazione e scalabilità. Questo approccio ibrido rispecchia esattamente la tesi di Jensen Huang: open e proprietario non sono poli opposti, ma parti dello stesso motore. Per sviluppatori e imprese, il risultato è un arsenale più maturo per affrontare la fase successiva dell’AI. Non solo modelli più potenti, ma infrastrutture migliori, policy runtime più solide, condivisione più efficiente delle GPU e una base aperta su cui costruire sistemi specializzati. NVIDIA cerca così di trasformare l’intelligenza artificiale in una vera infrastruttura universale, accessibile ma governabile, aperta ma protetta, flessibile ma pronta per la produzione enterprise.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.