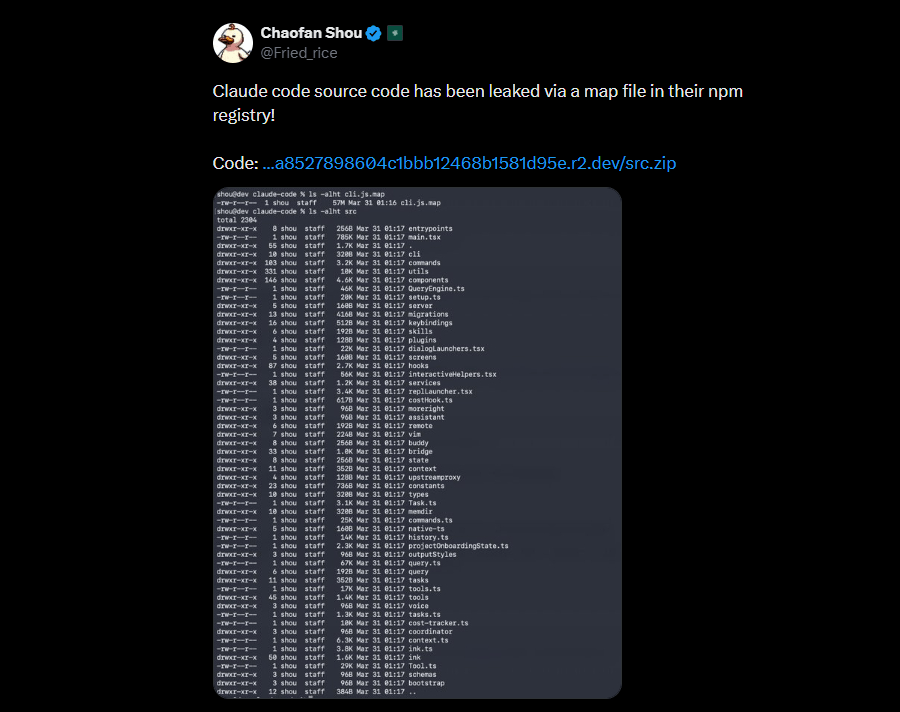

Claude Code si è aperto al mondo nel momento peggiore possibile per Anthropic. Non per un attacco sofisticato, non per una intrusione statale, non per una supply chain compromessa da un gruppo criminale, ma per un errore tanto banale quanto devastante: una source map di debug inclusa per sbaglio nel pacchetto npm pubblico della versione 2.1.88. Da quel singolo file .map, la comunità ha ricostruito oltre 500 mila righe di TypeScript, circa 2.000 file interni, feature flag non ancora annunciate, architetture multi-agent, prompt di sistema e la roadmap implicita del prodotto. Ma la notizia, per un’inchiesta degna di Matrice Digitale, non è il bug di packaging. La notizia è il timing politico-industriale. Questo leak esplode infatti a poche settimane dalla frattura tra Anthropic e il Department of War statunitense, che aveva formalmente designato la società come rischio per la supply chain della sicurezza nazionale americana, aprendo un contenzioso istituzionale di enorme portata. La domanda da porre al lettore non è se ci sia stato un complotto. Sarebbe una scorciatoia debole. La vera domanda è un’altra:

cosa succede dentro una AI company che ambisce a diventare infrastruttura critica dello Stato quando la pressione politica, militare e competitiva supera la capacità di governance interna?

È qui che il leak di Claude Code smette di essere un incidente tecnico e diventa la radiografia di una crepa nel potere tecnologico americano.

Cosa leggere

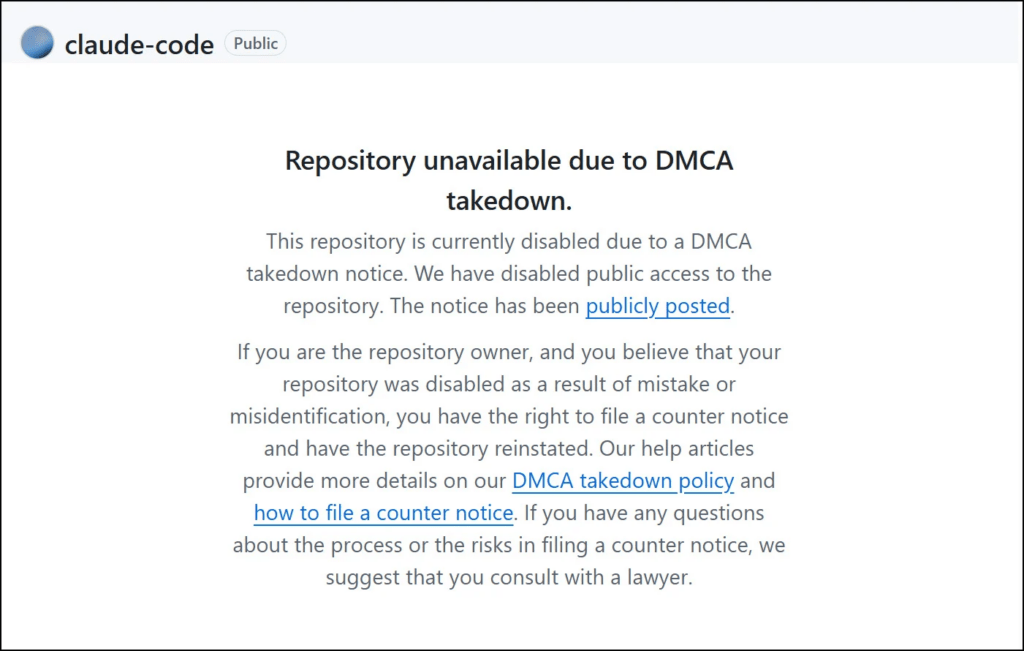

Il leak non è un hack: è una failure di processo

Anthropic ha confermato che la fuoriuscita è stata provocata da un errore umano nel processo di release, senza esposizione di credenziali o dati clienti. Tecnicamente il caso è quasi scolastico: una source map, pensata per il debugging, è stata pubblicata insieme al build di produzione sul registry npm. Quel file consente di risalire dal JavaScript compilato al codice TypeScript sorgente leggibile dagli sviluppatori. Nel mondo enterprise capita. Ma qui non parliamo di una startup alle prime armi.

Parliamo di una società che ha costruito la propria reputazione sul binomio AI safety e affidabilità istituzionale, fino a proporsi come partner di governo per intelligence analysis, cyber operations, simulation e supporto operativo. Il paradosso è violentissimo: mentre Anthropic difende pubblicamente la propria centralità nella sicurezza nazionale USA, il suo prodotto più sensibile espone il motore interno per una svista di pipeline. Questo cambia completamente il frame narrativo. Non siamo davanti a una “falla hacker”, ma a una falla di maturità organizzativa.

Il momento politico: la guerra fredda tra Anthropic e Washington

Dario Amodei ha pubblicato una nota ufficiale durissima, spiegando che il Dipartimento della Guerra aveva notificato ad Anthropic la designazione come rischio per la supply chain della sicurezza nazionale. Nello stesso testo, l’azienda ammette di aver vissuto giorni di forte attrito con l’amministrazione federale, cita la rimozione dai sistemi federali e rivendica il proprio ruolo nel supporto a intelligence, pianificazione operativa e cyber operations riconosciuto da un tribunale che ha sospeso il blacklisting a suo danno. È un passaggio storico. Anthropic, che fino a ieri si presentava come laboratorio “safety-first”, entra improvvisamente nella categoria delle aziende che negoziano il proprio rapporto con la macchina militare americana. Ed è proprio dentro questa frizione che esplode il leak. Il sospetto giornalisticamente interessante non è la regia occulta, ma il cedimento sotto pressione. Quando una società si trova contemporaneamente a gestire rilasci accelerati, esposizione pubblica, guerra competitiva con OpenAI, tensione con il Pentagono, scrutinio normativo e pressione reputazionale, i processi di sicurezza interni diventano il primo punto di rottura.

Il file

.mapè quasi simbolico: la tecnologia che si propone come architettura dello Stato finisce per esporre il proprio scheletro proprio mentre lo Stato la mette sotto stress.

Cosa rivela davvero il codice di Claude

La parte più potente dell’inchiesta è ciò che il leak racconta del futuro di Claude Code. Le analisi indipendenti del materiale trapelato hanno identificato moduli giganteschi dedicati alla orchestrazione multi-turn, gestione tool, policy di autorizzazione, memoria persistente e agenti secondari. Emergono anche feature flag per funzioni non ancora pubbliche, tra cui KAIROS, modalità proattive always-on, bridge con IDE, voice mode e logiche di memoria evolutiva. Questo punto è cruciale.

Claude Code non appare più come un semplice coding assistant. Dal materiale emerso si delinea un sistema agentico persistente, progettato per lavorare in background, mantenere contesto, orchestrare sub-agent e interagire in modo sempre più autonomo con l’ambiente di sviluppo. In altre parole, il leak mostra che Anthropic sta lavorando a qualcosa di più vicino a una infrastruttura cognitiva operativa che a un chatbot per programmatori. E questo spiega perché la frizione con Washington abbia assunto toni tanto sensibili.

Dalla safety all’apparato: Anthropic cambia natura

Per anni la retorica di Anthropic si è fondata sull’idea di essere l’azienda “responsabile”, prudente, distante dagli eccessi del mercato. La crisi con il governo USA e questo leak raccontano altro. Raccontano la trasformazione di Anthropic in attore quasi-statale, una struttura privata che offre capacità strategiche in ambiti come cyber, analisi informativa, pianificazione e supporto ai warfighters. Quando una company entra in questa dimensione, la sicurezza del software non è più solo tema di IP o concorrenza. Diventa tema di resilienza istituzionale. Il leak allora assume un valore più grande:

non mostra solo il codice di Claude, ma il passaggio storico in cui le AI company smettono di essere vendor e diventano apparati funzionali alla sovranità nazionale.

Ed è qui che ogni errore tecnico si carica di un peso geopolitico.

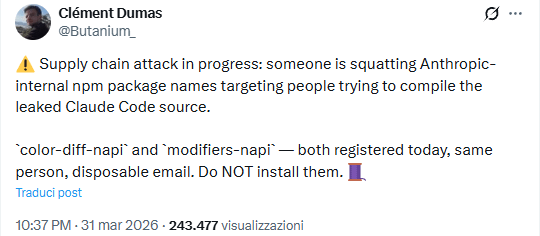

Il vero danno: la roadmap regalata ai competitor

Sul piano industriale il danno è enorme. Chiunque abbia scaricato il pacchetto ha ottenuto una lezione gratuita di ingegneria su come costruire un agente di coding enterprise-grade. Il valore non sta tanto nel codice in sé, quanto nella visibilità sulla filosofia di prodotto: orchestrazione tool-first, memoria persistente, sistemi di permesso, future estensioni IDE, modelli di automazione progressiva.

In pratica Anthropic ha consegnato al mercato una parte della propria roadmap tecnica non annunciata. Per competitor, startup e persino ambienti statali stranieri, questo tipo di leak vale più di molte analisi di intelligence open source. Non per copiare direttamente il prodotto, ma per capire dove si sta muovendo la frontiera dell’agency software americana.

La vera inchiesta: non il file, ma il potere che si incrina

Il punto finale, quello più forte per il tuo taglio, è questo. Il leak di Claude non è la storia di una source map dimenticata. È la storia di una AI company che nel momento di massimo scontro con il potere federale americano lascia scoperto il cuore operativo del proprio prodotto simbolo. Questa è la crepa. Non serve insinuare sabotaggi. Non serve costruire teorie. Basta osservare la sequenza: designazione come supply chain risk, tensione con il Pentagono, dichiarazioni pubbliche di Amodei, contenzioso federale, esposizione della roadmap tecnica di Claude. Troppi eventi ravvicinati per liquidare tutto come semplice folklore DevOps. La pista d’inchiesta più forte è che la pressione dello Stato stia trasformando le AI company in organismi ibridi, metà impresa e metà infrastruttura strategica, con processi interni che iniziano a mostrare segni di cedimento. Claude Code si è aperto al mondo nel momento perfetto per raccontare una verità più grande: quando l’intelligenza artificiale entra nella sicurezza nazionale, ogni errore di pipeline diventa un fatto politico.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.