AWS (Amazon Web Services) spinge sull’acceleratore e arricchisce il suo ecosistema cloud svelando quattro grandi innovazioni per semplificare il lavoro di sviluppatori e data analyst. La novità più curiosa è sicuramente Amazon Nova 2 Sonic, un potente modello IA capace di generare veri e propri podcast conversazionali in tempo reale (in sette lingue, italiano compreso) con tanto di due speaker virtuali che dialogano tra loro partendo da un semplice input. Ma le soluzioni enterprise non sono da meno: arrivano un geniale sistema Text-to-SQL basato su Amazon Bedrock (che permette a chiunque di interrogare database complessi facendo domande in semplice linguaggio naturale), il Workload Simulation Workbench per testare sotto sforzo i cluster Apache Kafka su MSK Express in totale sicurezza, e un comodo monitoraggio proattivo per Redshift Serverless che avvisa tempestivamente i team su Slack in caso di anomalie. Una mossa strategica per abbattere le barriere tecniche e democratizzare l’uso dei Big Data. AWS amplia il proprio stack per dati e intelligenza artificiale con quattro novità che puntano a ridurre il tempo di validazione, democratizzare l’analisi dei dati e migliorare il monitoraggio operativo. Le innovazioni annunciate ad aprile 2026 includono il Workload Simulation Workbench per Amazon MSK Express Broker, i podcast conversazionali in tempo reale con Amazon Nova 2 Sonic, una nuova architettura Text-to-SQL basata su Amazon Bedrock e il monitoraggio proattivo di Amazon Redshift Serverless con AWS Lambda e Slack. L’obiettivo comune è chiaro: fornire ai team data, AI e analytics strumenti pronti alla produzione che permettano di simulare workload Kafka in sicurezza, creare contenuti audio naturali con modelli speech-to-speech e offrire query SQL self-service anche a utenti non tecnici.

Cosa leggere

Workload Simulation Workbench rende sicuro il testing di Amazon MSK Express

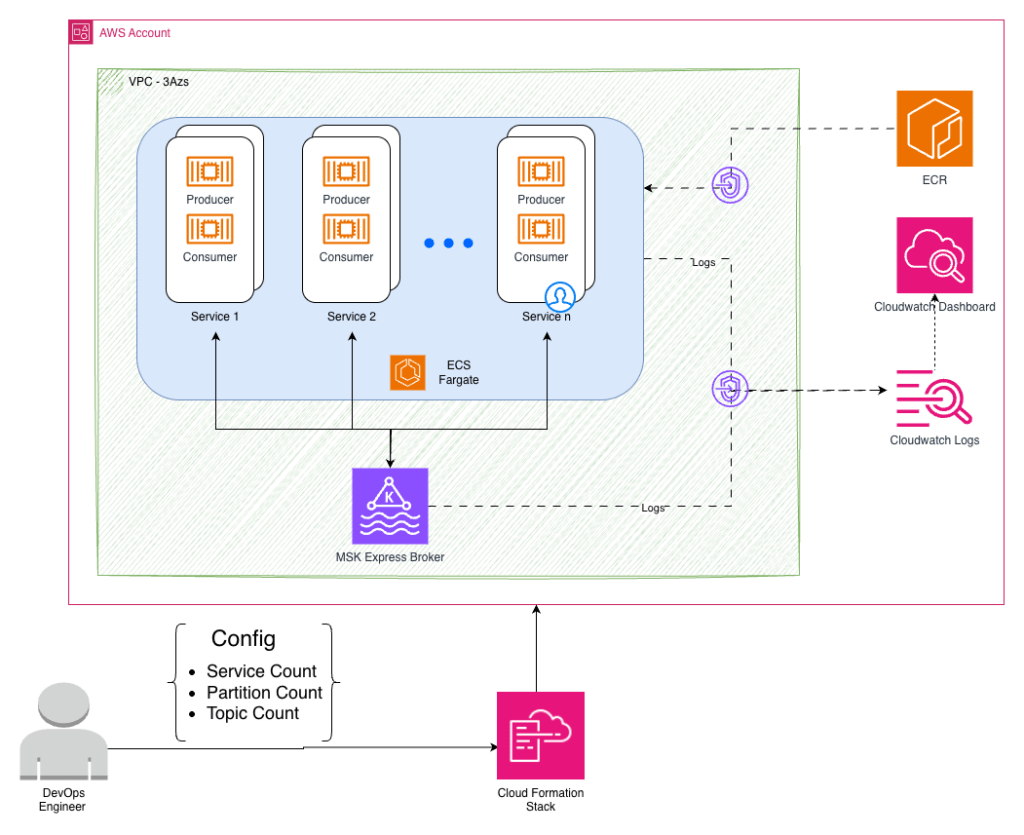

La novità più strategica per il mondo streaming è il Workload Simulation Workbench per Amazon MSK Express Broker, pensato come ambiente di test ripetibile per validare cluster Apache Kafka 3.9.0 su broker Graviton express.m7g.large e xlarge. Il sistema viene distribuito tramite AWS CDK e crea un ambiente isolato con subnet private, topic configurabili, producer-consumer containerizzati su Amazon ECS e dashboard CloudWatch per throughput, CPU, latenza e rebalancing.

Le aziende possono scegliere due modalità operative: workload validation, mantenendo fisso il cluster e variando il carico, oppure infrastructure rightsizing, riutilizzando lo stesso pattern di traffico per confrontare diversi tipi di broker o numero di nodi. Questo approccio consente di misurare in anticipo l’impatto di partizionamento, dimensione dei messaggi e scalabilità orizzontale senza toccare la produzione. Per i team data engineering è un vantaggio importante perché elimina test ad hoc difficili da riprodurre.

Amazon Nova 2 Sonic crea podcast conversazionali in tempo reale

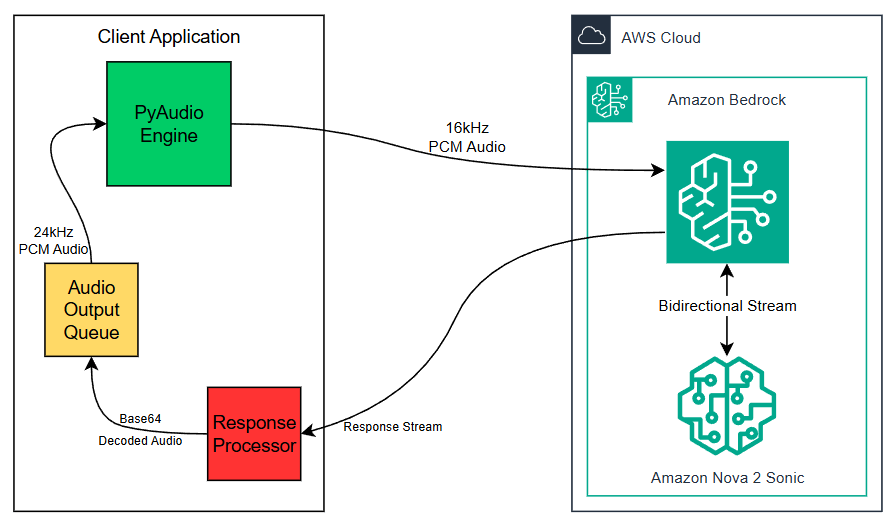

Sul fronte AI generativa audio, Amazon Nova 2 Sonic si conferma uno dei modelli più interessanti dell’ecosistema Amazon Bedrock. Il modello speech-to-speech supporta audio bidirezionale, contesto fino a 1 milione di token, output streaming e latenza ridotta, risultando ideale per esperienze vocali in tempo reale e podcast conversazionali fra host AI.

La soluzione utilizza una architettura Flask con AsyncIO, PyAudio e code di output streaming, in grado di alternare due speaker sintetici che mantengono il contesto e generano dialoghi fluidi tra 2 e 5 minuti. Per aziende media, formazione e customer engagement, questo significa poter produrre contenuti parlati di qualità professionale senza speaker umani o studio di registrazione. Il supporto a più lingue, incluso l’italiano, apre scenari per podcast di training, recensioni prodotto, briefing di mercato e sintesi automatica di report.

Text-to-SQL con Bedrock porta SQL agli utenti business

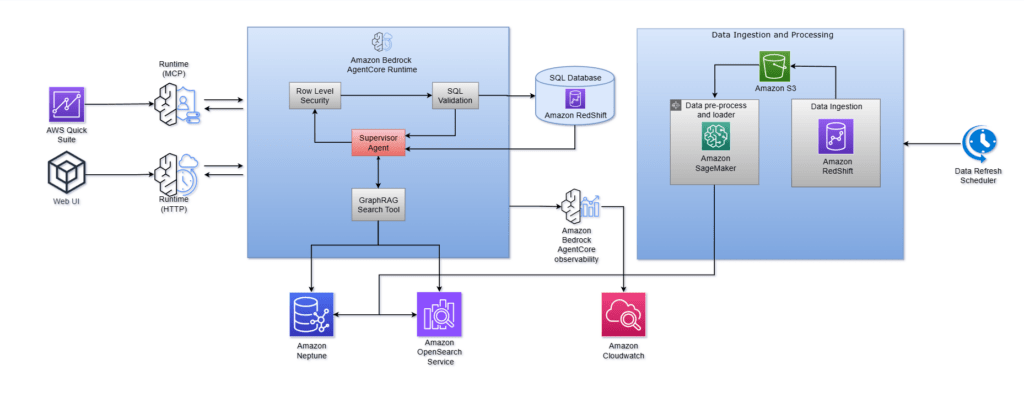

La terza innovazione riguarda la democratizzazione dell’accesso ai dati. AWS spinge una architettura Text-to-SQL basata su Amazon Bedrock Agents, capace di tradurre domande in linguaggio naturale in query SQL validate e poi eseguite su Amazon Redshift Serverless. L’approccio usa un agente supervisore che classifica le richieste, recupera metadati e definizioni da graph o knowledge base e genera SQL con validazione sintattica prima dell’esecuzione.

Questo riduce drasticamente il carico sui team di data engineering, che non devono più rispondere manualmente a domande ripetitive su revenue, forecast, customer intelligence o segmentazione. Per i reparti business il vantaggio è immediato: possono interrogare i dati con linguaggio naturale e ottenere sia il codice SQL trasparente sia una risposta narrativa leggibile, mantenendo governance, sicurezza e row-level filtering.

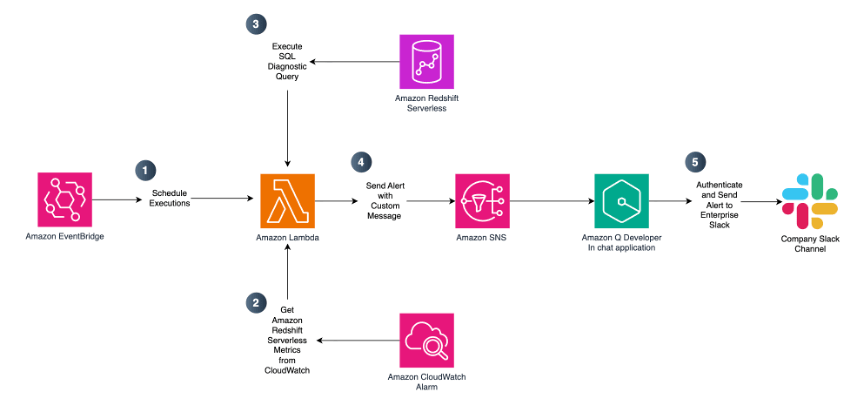

Redshift Serverless invia alert proattivi su Slack con Lambda

Sul lato operations, AWS propone una soluzione leggera ma molto efficace per Amazon Redshift Serverless. Una regola EventBridge attiva una funzione AWS Lambda ogni 15 minuti, che raccoglie metriche chiave come query in coda, query lente, utilizzo di RPUs, storage e connessioni anomale. Al superamento delle soglie, il sistema pubblica notifiche su SNS e le inoltra direttamente su Slack tramite integrazione con Amazon Q Developer in Chat Applications.

Il valore di questa architettura è nella semplicità: nessuna modifica ai workload esistenti, deployment via CloudFormation, costi operativi inferiori a pochi centesimi al mese e visibilità immediata sui problemi prima che impattino dashboard, BI o query mission critical. Per team analytics distribuiti è un passo importante verso il proactive monitoring serverless-first.

Le quattro novità convergono in un unico stack dati e AI

Il vero punto di forza è l’integrazione naturale fra queste quattro innovazioni. Il Workload Simulation Workbench valida cluster Kafka che possono alimentare pipeline dati verso Redshift, il Text-to-SQL su Bedrock trasforma quei dati in insight accessibili, Nova 2 Sonic converte gli insight in contenuti audio conversazionali e il monitoraggio Lambda garantisce che il layer analytics resti stabile. AWS sta costruendo un ecosistema in cui streaming, analytics, AI generativa e observability non sono più silos separati ma componenti interoperabili. Per le aziende questo significa ridurre il time-to-value, abbassare il rischio operativo e rendere strumenti avanzati accessibili anche a team non specialistici. L’aggiornamento di aprile 2026 mostra chiaramente la direzione di AWS: portare modelli foundation, streaming e data warehouse dentro workflow operativi sempre più automatizzati e intelligenti.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.