Nel mondo della drug discovery computazionale esiste un problema che somiglia sempre di più a una patologia di sistema: la tendenza a confondere la metrica migliore con il modello migliore. In apparenza, il settore corre verso risultati sempre più brillanti. I benchmark si riempiono di R² sopra 0,85, gli abstract promettono potenze predittive quasi definitive e la retorica dell’intelligenza artificiale applicata alla chimica finisce spesso per sovrapporsi al marketing. Ma quando qualcuno decide davvero di “alzare il cofano”, i numeri iniziano a cambiare. Ed è proprio questo il punto di forza del preprint firmato da Igor Merlini-ActarusLab, che affronta la previsione del pIC50 con un approccio radicalmente più rigoroso: un ensemble multi-seed che combina Graph Attention Network, XGBoost, LightGBM e CatBoost, valutato in modo strettamente out-of-fold su un dataset curato di 828 composti derivati da ChEMBL v33. Il valore reale del lavoro non è soltanto il risultato finale, che pure è solido, ma il fatto che quel risultato non venga ottenuto con scorciatoie. Nel paper, ogni predizione usata per il calcolo delle metriche viene prodotta da un modello che non ha mai visto quel composto durante l’addestramento. È una distinzione decisiva, perché in ambito QSAR il confine tra generalizzazione reale e ottimismo metodologico è sottilissimo. Se si allentano i criteri di validazione, basta poco per gonfiare i risultati. Se invece si impone un protocollo severo, molti record cominciano a sgonfiarsi. Il lavoro di Merlini sceglie deliberatamente la seconda strada e, proprio per questo, diventa più utile di tanti benchmark apparentemente superiori.

Cosa leggere

Il problema dei benchmark gonfiati nella previsione del pIC50

La previsione del pIC50 è una delle attività più importanti della chimica computazionale moderna. Stimare la potenza biologica di una molecola partendo dalla sua struttura permette di filtrare biblioteche di composti, ridurre test in vitro inutili e accelerare la selezione dei candidati nelle fasi iniziali di sviluppo. In teoria, è uno dei terreni ideali per il machine learning. In pratica, però, è anche uno dei campi in cui il rischio di overfitting, data leakage e validazione ottimistica è più alto. Il paper parte da una critica precisa: molti lavori pubblicati mostrano R² molto elevati, ma li calcolano in condizioni che non rappresentano davvero lo scenario d’uso. Il punto, infatti, non è predire correttamente molecole già note o fortemente simili a quelle del training set, bensì capire quanto un modello riesca a generalizzare su composti nuovi. Se la procedura di valutazione non replica questo scenario, il benchmark smette di essere una misura della realtà e diventa una misura della convenienza del protocollo. Merlini affronta il problema senza ambiguità. Nel testo sottolinea che molte pratiche comuni, come la valutazione su set non indipendenti, il tuning sui dati di test o l’assenza di varianza tra seed casuali, hanno prodotto un ecosistema in cui valori apparentemente eccellenti diventano difficili da riprodurre. Il messaggio, tradotto fuori dal linguaggio accademico, è netto: un numero alto non basta più, se non si capisce come è stato ottenuto.

Un dataset piccolo, rumoroso e trattato con onestà

Il dataset di partenza comprende 838 composti con valori sperimentali di pIC50 provenienti da ChEMBL v33. Dopo uno screening preliminare vengono rimossi 10 outlier estremi, definiti come casi con errore assoluto di previsione superiore a 2,0, e il set di lavoro si stabilizza a 828 composti. I valori pIC50 vengono inoltre clippati nell’intervallo [-0,5, 4,0], con 47 valori coinvolti da questa operazione, per limitare l’impatto delle misure più rumorose o estreme. Questo passaggio è più importante di quanto sembri. In molti articoli il rumore sperimentale viene trattato come un fastidio da assorbire nelle metriche finali, oppure nascosto dietro una narrazione di performance medie. Qui, invece, l’autore lo porta esplicitamente al centro dell’analisi. Il dataset è piccolo per standard deep learning, è eterogeneo e non contiene una suddivisione per target proteico. In altre parole, non è il terreno perfetto per costruire illusioni. È un dataset con limiti chiari, e il paper sceglie di dichiararli invece di mascherarli. Anche sul piano della rappresentazione molecolare la strategia è deliberatamente ibrida. Il sistema combina 46 descrittori RDKit, fingerprint Morgan a raggio 2 e 3, MACCS Keys e una rappresentazione a grafo con 146 feature atomiche. La parte tabellare arriva a 3.285 dimensioni complessive, mentre la parte grafica permette alla rete neurale di apprendere direttamente dalle relazioni topologiche della molecola. Non c’è una singola “pallottola d’argento”, ma una costruzione che punta sulla complementarità tra visione ingegnerizzata e apprendimento strutturale.

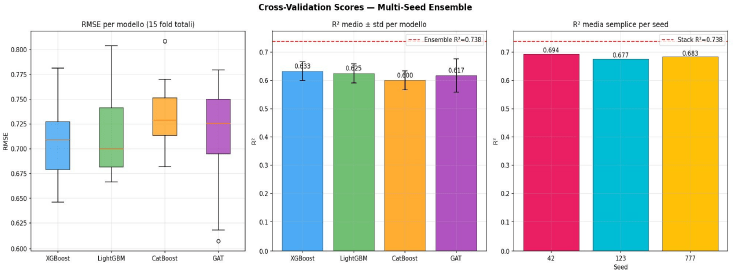

Quattro modelli, tre seed e quindici valutazioni: la struttura dell’ensemble

L’architettura proposta si fonda su quattro modelli di base. I tre algoritmi boosting, XGBoost, LightGBM e CatBoost, lavorano sulle feature classiche derivate da descrittori e fingerprint. Il quarto elemento è una Graph Attention Network custom con quattro layer multi-head, quattro teste di attenzione, dimensione nascosta a 256, pooling globale pesato con gating e una testa di previsione a tre layer. La rete viene addestrata con AdamW, Huber loss, cosine annealing e gradient clipping, fino a 300 epoche con early stopping a pazienza 50. La differenza sostanziale, però, non sta solo nella scelta dei modelli ma nel protocollo di valutazione. L’intera pipeline viene eseguita con 5-fold cross-validation e ripetuta su tre seed casuali, 42, 123 e 777, per un totale di 15 valutazioni per ogni modello. Le predizioni out-of-fold di questi modelli diventano poi meta-feature per uno stacking finale basato su Ridge regression con alpha = 0,3. In pratica, il meta-learner riceve una vista sintetica ma diversificata del comportamento dei quattro modelli attraverso tre inizializzazioni differenti, e da questa costruisce la previsione finale. Questo impianto metodologico serve a impedire che il risultato sia figlio di uno split fortunato o di una particolare inizializzazione. In ambito QSAR è un aspetto cruciale, perché dataset piccoli e distribuzioni irregolari possono alterare sensibilmente le metriche finali. L’uso di più seed e di una validazione rigorosamente out-of-fold rende il benchmark meno appariscente, ma molto più credibile.

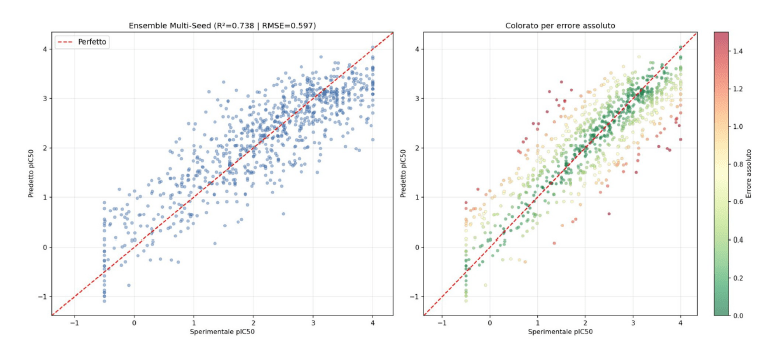

I risultati reali: meno spettacolari dei record di facciata, molto più utili

I modelli individuali si collocano tutti in una fascia relativamente vicina. XGBoost raggiunge R² = 0,637, LightGBM 0,638, CatBoost 0,609 e la GAT 0,633. La somiglianza dei valori è indicativa: nessuna architettura domina in modo netto, e questo suggerisce che il dataset contenga segnali apprendibili ma non tali da produrre prestazioni eccezionali con un singolo approccio.

| Modello | R² ↑ | RMSE ↓ | MAE ↓ | Pearson r ↑ |

|---|---|---|---|---|

| XGBoost (Optuna-tuned) | 0.637 | 0.703 | 0.553 | 0.801 |

| LightGBM (Optuna-tuned) | 0.638 | 0.701 | 0.549 | 0.803 |

| CatBoost | 0.609 | 0.729 | 0.574 | 0.785 |

| GAT (4-layer, 4-head) | 0.633 | 0.706 | 0.548 | 0.798 |

| Ensemble (Ridge stack) | 0.738 | 0.597 | 0.472 | 0.859 |

Performance Out-of-Fold (Media su 3 seed, 5-fold CV): I modelli gradient boosting (XGBoost, LightGBM) e GAT mostrano performance di base simili, ma l’approccio Ensemble (Ridge stack) garantisce un salto qualitativo evidente, abbattendo l’errore medio (RMSE 0.597) e massimizzando sia il coefficiente R² (0.738) che la correlazione di Pearson (0.859).

Il salto avviene con l’ensemble. Lo stacking finale porta infatti il sistema a R² = 0,738, RMSE = 0,597, MAE = 0,472 e Pearson r = 0,859. Il miglioramento rispetto al miglior modello singolo è di circa 0,10 punti di R², con un calo dell’errore RMSE di circa il 15%. Non è un guadagno cosmetico, ma il segno che i modelli stanno catturando porzioni differenti dello spazio chimico. Gli algoritmi boosting leggono pattern classici di struttura-attività nelle feature fissate, mentre la GAT aggiunge una componente topologica che arricchisce l’ensemble e contribuisce alla robustezza finale.

| Metrica | Il Nostro Studio (OOF) | Studio Precedente | Gap |

|---|---|---|---|

| R² | 0.738 | 0.86 | −0.12 |

| RMSE | 0.597 | 0.45 | +0.15 |

| MAE | 0.472 | 0.32 | +0.15 |

| Metodo di Valutazione | Strict OOF | Sconosciuto | — |

| Riproducibilità | Sì | No | — |

Confronto con i benchmark precedenti: Sebbene i report passati dichiarino metriche apparentemente superiori (es. R² di 0.86), tali risultati mancano di trasparenza metodologica e riproducibilità. Il nostro approccio Ensemble garantisce invece stime solide, verificabili e rigorosamente valutate tramite Strict Out-of-Fold (OOF).

Ma la parte più rilevante del paper è il confronto con un benchmark precedente sullo stesso dataset, accreditato di R² = 0,86, RMSE = 0,45 e MAE = 0,32. Merlini afferma di avere ricalcolato quelle metriche direttamente dal file di predizione pubblicato dagli autori, ottenendo però R² = 0,719, RMSE = 0,645 e MAE = 0,491. Il divario è troppo grande per essere liquidato come differenza metodologica marginale. Qui il paper tocca il punto più sensibile dell’intero dibattito: la differenza tra un valore vendibile e un valore riproducibile.

Dove il modello funziona davvero e dove invece mostra i suoi limiti

Uno degli aspetti più seri del lavoro è l’analisi degli errori per intervallo di pIC50. Il modello non viene presentato come universalmente affidabile, ma come strumento che funziona meglio in certe zone della distribuzione e peggio in altre. La fascia centrale [2,0, 3,0], che contiene 275 composti, è quella in cui il sistema performa meglio, con MAE = 0,402. Non sorprende: è la parte più popolata del dataset e quindi quella che offre più informazione statistica ai modelli.

Agli estremi, invece, la qualità cala. Per i composti inattivi con pIC50 < 0 il paper segnala una MAE di circa 0,82, mentre nelle code più alte della distribuzione le prestazioni si deteriorano per effetto combinato di bassa numerosità campionaria e maggiore rumore sperimentale. La tabella riportata nel manoscritto indica, ad esempio, una MAE di 0,644 nell’intervallo [4,0, 4,5) su appena 26 composti. È il comportamento tipico di un modello che non sta barando: rende bene dove i dati sono rappresentati e perde precisione nelle regioni rare o rumorose.

Questa lettura è essenziale in termini applicativi. Nella pratica della drug discovery, un modello del genere non va interpretato come un sostituto del laboratorio, ma come un sistema di prioritizzazione robusta, utile soprattutto nella parte centrale dello spazio chimico osservato e meno affidabile laddove i dati diventano scarsi o estremi. È un modo molto più sano di raccontare l’AI scientifica: non come una macchina che risolve tutto, ma come uno strumento che aiuta davvero quando si conoscono bene i suoi limiti.

La lezione più importante: un benchmark severo vale più di una metrica spettacolare

Il passaggio più forte del paper è quasi filosofico, oltre che metodologico. Un R² out-of-fold di 0,738 viene presentato come più informativo, per la realtà della drug discovery, di un R² di 0,86 ottenuto in condizioni meno trasparenti. La ragione è semplice: nel mondo reale i modelli devono lavorare su molecole nuove, non su esempi favorevoli o indirettamente già “noti” alla pipeline. La valutazione rilevante è quindi quella che misura la capacità di generalizzazione, non quella che premia la memorizzazione travestita da accuratezza. Il paper rafforza questa tesi anche dichiarando apertamente i propri limiti. 828 composti restano pochi per far esprimere al meglio il deep learning. Il dataset è eterogeneo perché non separa i target biologici. I valori di ChEMBL derivano da condizioni sperimentali aggregate e introducono rumore non eliminabile. Inoltre, una rete fully connected semplice sui fingerprint si rivela deludente, con R² = 0,21, segno che non basta usare una rete neurale per ottenere automaticamente valore aggiunto.

| Range pIC50 | Campione (n) | MAE ↓ | Frazione dei Dati |

|---|---|---|---|

| [−1.5, 0.0) | 50 | 0.819 | 6.0% |

| [0.0, 1.0) | 95 | 0.658 | 11.5% |

| [1.0, 2.0) | 183 | 0.540 | 22.1% |

| [2.0, 3.0) | 275 | 0.402 | 33.2% |

| [3.0, 4.0) | 199 | 0.527 | 24.0% |

| [4.0, 4.5) | 26 | 0.644 | 3.1% |

Analisi degli errori per range pIC50: Il modello mostra la massima accuratezza (MAE 0.402) nella fascia [2.0, 3.0), che rappresenta anche la porzione più ampia del dataset (33.2%). L’errore tende ad aumentare agli estremi della distribuzione, in particolar modo nel range negativo [−1.5, 0.0) dove i dati a disposizione per l’addestramento sono limitati (solo il 6.0%).

Ed è proprio questa trasparenza a rendere il lavoro prezioso. Invece di piegare il benchmark alla narrativa della perfezione, il paper costruisce una metrica che può essere usata come riferimento serio. Per la chimica computazionale e per l’industria farmaceutica il messaggio è netto: la riproducibilità deve venire prima della brillantezza apparente. Un modello che promette troppo e mantiene meno, quando esce dal paper e incontra il laboratorio, genera screening distorti, priorità sbagliate e spreco di risorse. Il futuro della QSAR non passa dalla cosmetica delle metriche, ma da benchmark più severi, dataset più ampi e omogenei, integrazione di embedding molecolari pre-addestrati, informazione 3D conformazionale e protocolli che simulino davvero il caso d’uso. In questo quadro, il lavoro di Merlini ha un merito raro: ricorda al settore che, quando si parla di predizione molecolare, non vince il modello che sembra migliore sulla slide. Vince quello che mente di meno.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.