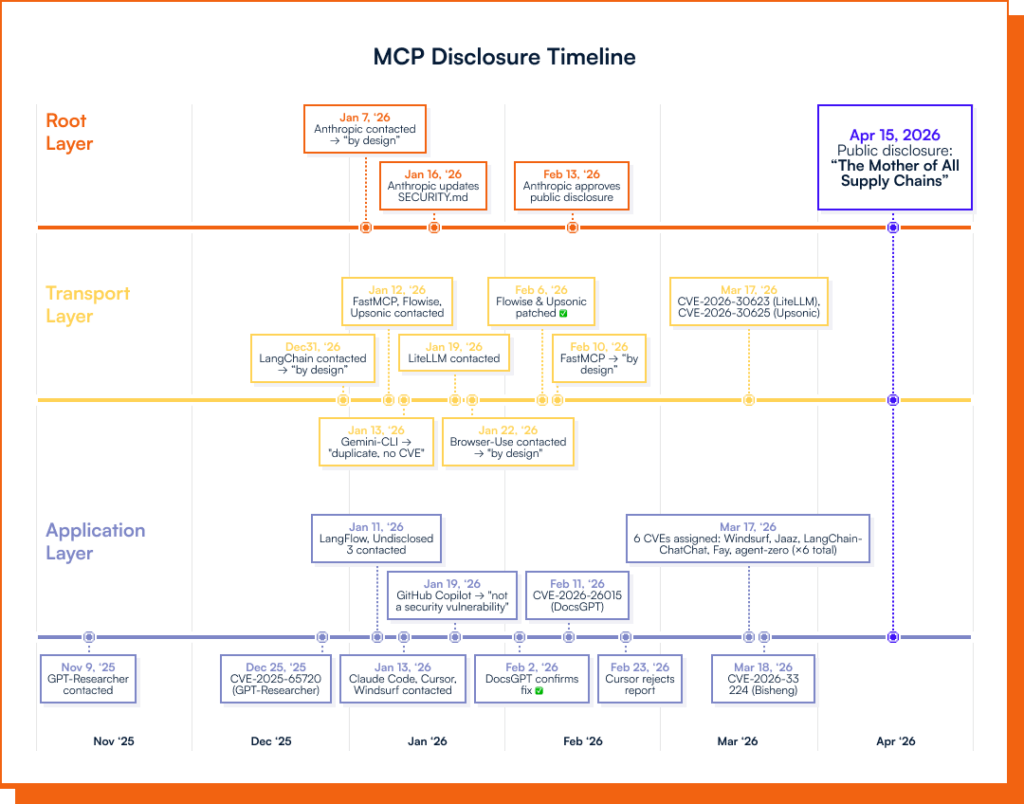

Anthropic si trova al centro di una nuova crisi di sicurezza dopo la pubblicazione della ricerca di OX Security sul Model Context Protocol, o MCP, lo standard usato per collegare modelli, tool esterni e servizi locali o remoti. Secondo i ricercatori, il problema non nasce da un bug tradizionale ma da una scelta architetturale che può consentire l’esecuzione di comandi arbitrari su sistemi che adottano implementazioni vulnerabili del protocollo. L’impatto dichiarato è molto ampio: oltre 150 milioni di download, più di 7.000 server esposti pubblicamente e fino a 200.000 istanze vulnerabili nell’ecosistema AI. La vicenda è rilevante perché MCP è diventato in pochi mesi una delle basi operative più diffuse per gli agenti AI, specialmente nei flussi di tool calling, nelle integrazioni con IDE, nei server locali basati su STDIO e nelle pipeline che collegano modelli, database, shell e utility di sistema. La diffusione del protocollo ha accelerato lo sviluppo di applicazioni agentiche, ma proprio questa adozione trasversale trasforma una debolezza progettuale in un rischio di supply chain che si propaga a valle verso framework, plugin, marketplace e ambienti enterprise. La pubblicazione di OX Security, datata 15 aprile 2026, sostiene che la falla interessi gli SDK ufficiali mantenuti per Python, TypeScript, Java e Rust e che gli sviluppatori possano ereditare l’esposizione senza introdurre direttamente codice insicuro. In altre parole, il punto critico non è soltanto l’errore di una singola app, ma il fatto che il comportamento rischioso sia inglobato nel modello di esecuzione previsto dagli strumenti di riferimento del protocollo. È questo l’elemento che rende il caso molto più delicato di una normale vulnerabilità applicativa.

Cosa leggere

OX Security collega il rischio al modello STDIO del protocollo MCP

Il cuore tecnico della contestazione riguarda l’uso del trasporto STDIO, cioè il meccanismo con cui un server MCP locale può essere avviato come processo figlio e comunicare tramite input e output standard. Questo modello consente ai server di eseguire comandi esterni in modo dinamico, ma diventa critico quando input controllabili dall’utente o da un prompt arrivano ai parametri che definiscono quale processo lanciare e con quali argomenti. Secondo OX Security, gli SDK ufficiali non impongono per default un’allowlist di comandi né un modello di manifest-only execution che limiti in modo rigido i binari avviabili. In questa condizione, qualunque framework che accetti parametri dinamici o configurazioni JSON per la definizione di un server STDIO può diventare il punto di ingresso di una catena di attacco che sfocia in RCE. Il rischio non resta teorico, perché la società di ricerca dichiara di aver riprodotto exploit su piattaforme reali, incluse installazioni di produzione e strumenti molto diffusi tra sviluppatori e aziende.

Il punto sollevato dai ricercatori è che quando il protocollo consente per design l’avvio di processi locali senza vincoli predefiniti sufficientemente stretti, la mitigazione viene delegata agli sviluppatori downstream. Questo crea un panorama frammentato, nel quale alcuni prodotti patchano singoli casi mentre la causa sistemica resta aperta. La conseguenza è una superficie di attacco ampia e difficile da controllare.

Anthropic difende il comportamento previsto ma la comunità contesta i default

Uno dei passaggi più delicati dell’intera vicenda riguarda la posizione attribuita ad Anthropic, che considera il comportamento contestato come coerente con il funzionamento previsto del protocollo. Secondo questa visione, la sanitizzazione e la validazione degli input spettano alle applicazioni che utilizzano MCP e non allo standard in sé. Dal punto di vista tecnico questa posizione distingue tra funzionalità pericolose e vulnerabilità effettive. L’esecuzione di comandi locali è una capacità legittima per molti agenti AI, ma diventa sfruttabile quando input non attendibili controllano direttamente i parametri. Il problema è che gli agenti moderni operano su dati provenienti da prompt, pagine web, repository, configurazioni e interfacce utente, rendendo difficile garantire che ogni input sia filtrato correttamente. La critica principale riguarda quindi il principio di secure by default. Se uno standard viene adottato su larga scala, dovrebbe includere meccanismi di sicurezza robusti già nella configurazione iniziale. Lasciare questa responsabilità agli sviluppatori aumenta il rischio sistemico e crea implementazioni disomogenee, alcune sicure e altre esposte.

I framework colpiti mostrano come la falla si propaghi nella supply chain AI

L’elenco dei progetti coinvolti evidenzia la portata del problema. Tra i prodotti interessati figurano LiteLLM, LangChain, LangFlow di IBM, GPT Researcher, Agent Zero, Fay Framework, Bisheng, Langchain-Chatchat, Jaaz, Upsonic, Windsurf e DocsGPT. Si tratta di strumenti utilizzati sia in contesti enterprise sia nello sviluppo open source di applicazioni AI. Questa diffusione dimostra come la vulnerabilità non sia limitata a un singolo software ma si propaghi lungo tutta la catena tecnologica. Il protocollo definisce il comportamento, gli SDK lo implementano, i framework lo integrano e le applicazioni finali lo espongono. Ogni livello aggiunge complessità ma eredita anche il rischio. La dinamica è tipica delle vulnerabilità di supply chain: un difetto a monte si replica automaticamente a valle. Nel caso di MCP, questo effetto è amplificato dalla rapidità con cui il protocollo è stato adottato per costruire agenti AI sempre più autonomi e integrati con sistemi reali.

I CVE emessi confermano l’impatto pratico su prodotti reali

La ricerca ha portato all’emissione di dieci CVE, molti dei quali classificati come Critical. Tra i casi più rilevanti emergono vulnerabilità in LiteLLM che consentono RCE tramite configurazioni JSON, problemi in Windsurf legati a prompt injection senza interazione dell’utente e scenari in GPT Researcher che possono portare a esecuzione di shell remota. Questi esempi dimostrano che il rischio non è teorico ma già sfruttabile in contesti reali. Tuttavia, la presenza di CVE distinti per ogni prodotto rischia di frammentare la risposta, concentrando l’attenzione su singoli bug invece che sulla causa strutturale. Il problema principale resta infatti il modello di esecuzione del protocollo. Senza una modifica a questo livello, nuove varianti di exploit possono emergere anche dopo la correzione dei singoli casi già identificati.

Prompt injection, registry poisoning e IDE AI ampliano la superficie d’attacco

La vulnerabilità si distingue anche per la varietà dei vettori di attacco. Non si limita a input diretti ma include prompt injection, UI injection, marketplace contaminati e configurazioni manipolate indirettamente. Questo significa che l’attacco può attivarsi anche attraverso contenuti apparentemente innocui. Negli IDE AI, ad esempio, un prompt malevolo può influenzare l’esecuzione di tool locali senza richiedere un’azione esplicita dell’utente. Questo scenario, definito spesso come zero-click, aumenta significativamente il rischio perché riduce la possibilità di intervento umano. Anche i marketplace MCP rappresentano un punto critico. Server malevoli o pacchetti contraffatti possono essere distribuiti come componenti legittimi, introducendo codice pericoloso in ambienti di sviluppo o produzione. Questo estende la minaccia dalla configurazione locale all’intero ecosistema di distribuzione.

Le conseguenze per aziende e sviluppatori vanno oltre il semplice crash di un agente

Le implicazioni operative sono rilevanti. Gli attaccanti possono ottenere accesso a chiavi API, database interni, cronologie di chat e altri dati sensibili. In ambienti enterprise questo può tradursi in compromissioni più ampie, inclusi movimenti laterali e accesso a sistemi critici. Per gli sviluppatori individuali il rischio riguarda soprattutto gli ambienti locali. IDE e tool AI con accesso al file system possono esporre credenziali, script e configurazioni. Poiché l’attacco può essere innescato da contenuti letti automaticamente dall’agente, la percezione del pericolo è spesso bassa. Questo scenario solleva anche questioni di governance. Le organizzazioni che adottano agenti AI devono valutare attentamente la sicurezza delle tecnologie utilizzate, soprattutto quando si basano su standard emergenti ancora in fase di maturazione.

Le mitigazioni immediate puntano su sandbox, restrizioni e verifica delle fonti

In attesa di una soluzione strutturale, le contromisure principali riguardano il contenimento del rischio. Ridurre l’esposizione pubblica dei servizi MCP è il primo passo, seguito dalla limitazione dei comandi eseguibili tramite allowlist e validazione rigorosa degli input. L’uso di sandbox o container con privilegi minimi consente di limitare l’impatto di eventuali exploit. Allo stesso tempo è fondamentale installare server MCP solo da fonti affidabili, evitando repository non verificati o potenzialmente compromessi. Il monitoraggio delle attività rappresenta un ulteriore livello di difesa. Analizzare le invocazioni di tool, i processi avviati e le connessioni di rete aiuta a individuare comportamenti anomali prima che si trasformino in compromissioni gravi.

Il caso MCP apre un confronto decisivo sulla sicurezza degli standard per agenti AI

Il caso MCP evidenzia un problema più ampio nella sicurezza degli agenti AI. Quando uno standard definisce il modo in cui modelli e strumenti interagiscono, stabilisce anche i limiti della sicurezza dell’intero ecosistema. Se questi limiti non sono sufficientemente restrittivi, il rischio si propaga automaticamente. Per Anthropic, questo rappresenta un momento cruciale. L’azienda ha contribuito alla diffusione del protocollo e ora si trova nella posizione di dover valutare eventuali modifiche strutturali, come l’introduzione di manifest vincolanti o modelli di esecuzione più sicuri. Per il settore nel suo complesso, la lezione è chiara. La sicurezza deve essere integrata fin dalle fondamenta degli standard, soprattutto in un contesto in cui gli agenti AI interagiscono direttamente con sistemi reali. Il caso MCP segna un punto di svolta e impone una riflessione profonda su come progettare le tecnologie che guideranno la prossima fase dell’intelligenza artificiale.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.