OpenAI prepara uno smartphone AI con chip sviluppati insieme a MediaTek e Qualcomm per un possibile lancio nel 2028. Google ridisegna Gemini con sfondi animati sfumati che rendono l’interfaccia più reattiva durante l’elaborazione delle query. Apple, intanto, accelera su Apple Intelligence con John Ternus, indicato come figura chiave della prossima fase aziendale. La competizione tra big tech entra così in una nuova fase, dove l’AI non è più solo software ma diventa hardware, design e interfaccia quotidiana.

Cosa leggere

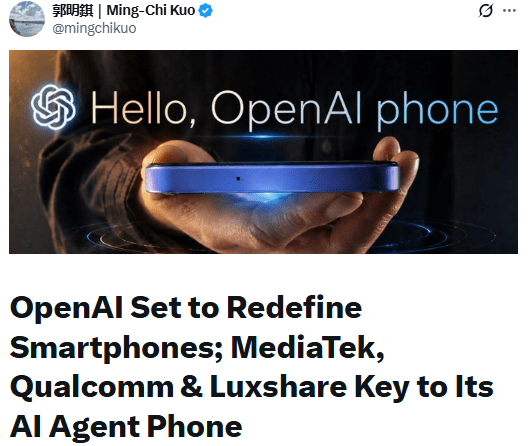

OpenAI sviluppa uno smartphone AI con chip MediaTek e Qualcomm

OpenAI lavora a uno smartphone dedicato all’intelligenza artificiale con una roadmap orientata al 2028. Il progetto punta su processori custom sviluppati con MediaTek e Qualcomm, due attori centrali nel mercato mobile. L’obiettivo non è competere solo sulla potenza grezza, ma costruire un dispositivo progettato intorno a modelli AI locali, funzioni always-on e gestione intelligente del consumo energetico. La strategia richiama il modello dei Google Pixel, dove il silicio viene ottimizzato per esperienze software specifiche. Il telefono dovrebbe combinare elaborazione locale e cloud. Le attività più leggere, personali e continue girerebbero direttamente sul dispositivo, mentre i task complessi verrebbero inviati ai server. Questo schema riduce latenza, migliora privacy e consente una comprensione più continua del contesto utente. Per OpenAI, lo smartphone rappresenta il passaggio naturale dai chatbot alle interfacce ambientali, dove l’assistente non viene solo consultato ma accompagna l’utente nelle attività quotidiane.

I chip AI puntano su efficienza energetica e modelli locali

Il nodo tecnico principale riguarda il chip. Uno smartphone AI non può dipendere costantemente dal cloud, perché funzioni always-on, riconoscimento contestuale, assistenza vocale e personalizzazione richiedono risposte rapide e consumi contenuti. Per questo OpenAI lavora con MediaTek e Qualcomm su processori ottimizzati per modelli piccoli in locale, gestione della memoria e accelerazione neurale. L’obiettivo è ottenere prestazioni AI elevate senza penalizzare autonomia e temperatura del dispositivo.

La gerarchia di memoria diventa un elemento centrale. I modelli AI richiedono accesso rapido a pesi, cache e dati contestuali, e un’architettura mobile deve bilanciare velocità, banda e consumo. La competenza maturata da OpenAI nei cluster di data center può essere adattata al mobile, ma con vincoli molto più severi. Uno smartphone deve lavorare per ore, restare sottile, dissipare poco calore e mantenere funzioni intelligenti sempre disponibili. È qui che il co-design tra software, modello e hardware diventa decisivo.

Luxshare entra nel progetto hardware di OpenAI

Il progetto coinvolge anche Luxshare, fornitore cinese noto per la produzione elettronica e già competitivo rispetto a realtà come Foxconn. Il ruolo di Luxshare riguarda co-design, integrazione e manifattura, tre aree fondamentali per trasformare un concept AI in un prodotto consumer. Uno smartphone non è solo un chip: richiede display, batteria, sensori, fotocamere, antenne, dissipazione, qualità costruttiva e controllo industriale su milioni di unità. La produzione di massa è indicata per il 2028, mentre specifiche finali e fornitori dovrebbero essere definiti tra la fine del 2026 e l’inizio del 2027. Questa finestra temporale conferma che OpenAI non sta preparando un semplice accessorio, ma un dispositivo complesso con ambizioni di piattaforma. Il telefono potrebbe diventare il primo vero tentativo dell’azienda di entrare nel mercato consumer hardware con un prodotto centrale, capace di sfidare Apple e Google sul terreno più delicato: il dispositivo personale.

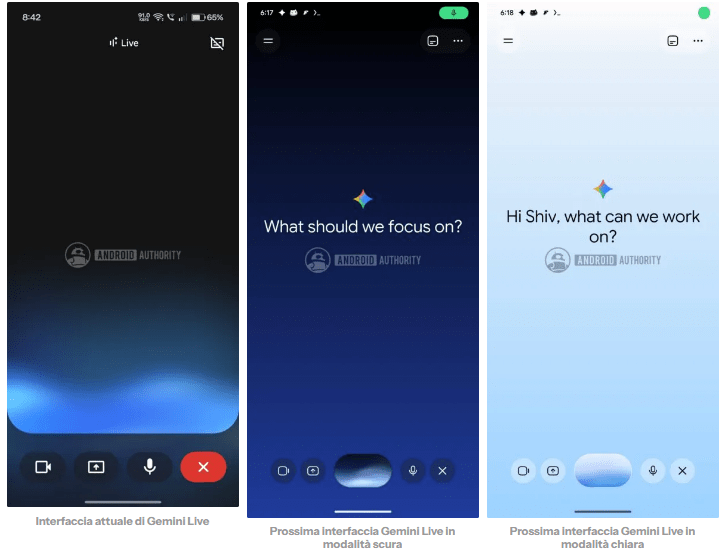

Google rinnova Gemini con sfondi animati sfumati

Mentre OpenAI guarda all’hardware, Google lavora sull’interfaccia di Gemini. Il nuovo design introduce sfondi animati con gradienti colorati che reagiscono durante l’elaborazione delle query. Le animazioni offrono un feedback visivo immediato: l’utente capisce che l’assistente sta ascoltando, ragionando o preparando una risposta. Questo dettaglio può sembrare estetico, ma nelle interfacce AI è fondamentale perché riduce la sensazione di attesa e rende il sistema più vivo. Il redesign rientra nell’evoluzione UX di Gemini e punta a rendere l’assistente più immersivo. Le animazioni cambiano in modalità chiara e scura, con colori più brillanti, icone minimali e un layout coerente con il linguaggio visivo di Android. Il pulsante Answer now resta nella parte inferiore, mantenendo familiarità e continuità d’uso. Google non sta solo migliorando il look: sta cercando di rendere l’AI meno statica, più leggibile e più integrata nella routine mobile.

Gemini diventa un assistente più visivo e reattivo

Il nuovo stile di Gemini mostra quanto l’interfaccia sia diventata un campo di battaglia strategico. Gli assistenti AI devono comunicare stato, intenzione e progresso senza appesantire l’esperienza. Gli sfondi sfumati animati servono proprio a questo: trasformano il tempo di elaborazione in un momento visivo comprensibile. Invece di attendere una risposta su una schermata immobile, l’utente vede un’interfaccia che reagisce. Questa direzione è importante perché l’AI generativa funziona in modo diverso dai motori di ricerca tradizionali. Le risposte richiedono elaborazione, contesto, sintesi e spesso più passaggi interni. Google deve quindi rendere visibile un processo invisibile senza esporre complessità tecnica. Gemini diventa così un prodotto più vicino a un assistente personale che a una semplice casella di testo, e questa trasformazione prepara un’integrazione più profonda in smartphone, app e servizi Google.

John Ternus guida il messaggio AI dentro Apple

Sul fronte Apple, John Ternus comunica ai dipendenti una visione chiara: l’intelligenza artificiale deve superare il singolo prodotto e diventare uno strumento per creare esperienze più significative. Ternus, figura con forte background in hardware engineering, rappresenta un approccio tipicamente Apple: non introdurre AI come funzione isolata, ma integrarla in modo profondo nei dispositivi, nei servizi e nel sistema operativo. Il messaggio interno punta a rafforzare fiducia e direzione strategica.

Apple Intelligence resta il centro di questa evoluzione. L’azienda vuole evitare funzionalità dimostrative e concentrarsi su esperienze realmente utili, coerenti con privacy, design e semplicità d’uso. Per Apple, il vantaggio non sta necessariamente nel lanciare per prima ogni novità, ma nel trasformare l’AI in qualcosa di invisibile e affidabile. Ternus indica proprio questa traiettoria: tecnologia al servizio dell’utente, non tecnologia usata solo per mostrare capacità tecniche.

Apple Intelligence punta a esperienze personali e profonde

Apple Intelligence nasce per inserirsi dentro iPhone, iPad, Mac e servizi Apple con un livello di integrazione difficile da replicare per concorrenti esterni. La forza dell’ecosistema permette di collegare contesto personale, app, dati locali, notifiche, comunicazioni e automazioni. L’AI può diventare uno strumento capace di capire meglio il dispositivo, anticipare bisogni e semplificare attività quotidiane senza richiedere interazioni complesse. La sfida è mantenere equilibrio tra potenza e fiducia. Apple deve offrire funzioni avanzate senza compromettere privacy e controllo dell’utente. Questo significa decidere quali operazioni eseguire on-device, quali affidare al cloud privato e come comunicare in modo trasparente il funzionamento del sistema. Con Ternus, l’azienda sembra voler rafforzare il legame tra hardware e AI, trasformando chip, sensori e software in un’unica esperienza intelligente.

OpenAI sfida Apple e Google sul dispositivo personale

Lo smartphone AI di OpenAI rappresenta una sfida diretta a Apple e Google perché entra nel terreno più strategico: il dispositivo che accompagna l’utente ogni giorno. Finora OpenAI ha dominato soprattutto il livello software, con modelli e servizi cloud. Uno smartphone cambierebbe la posizione dell’azienda nella filiera, portandola a controllare anche hardware, sensori, interfaccia e distribuzione dell’esperienza AI. La difficoltà sarà enorme. Apple e Google possiedono ecosistemi maturi, store, sistemi operativi, relazioni con sviluppatori e canali distributivi globali. OpenAI dovrà costruire valore non solo nel modello AI, ma nell’intero prodotto. Il dispositivo dovrà essere utile anche quando non viene percepito come “AI”, con autonomia, fotocamera, prestazioni, sicurezza e affidabilità all’altezza del mercato premium. La differenza potrà arrivare da un assistente profondamente integrato e sempre disponibile.

Smartphone AI e assistenti ridisegnano la competizione mobile

La competizione tra OpenAI, Google e Apple mostra una convergenza evidente. OpenAI punta a un dispositivo nativo per l’intelligenza artificiale. Google migliora l’esperienza di Gemini rendendola più visiva e integrata. Apple lavora su AI distribuita dentro un ecosistema hardware già consolidato. Tre strategie diverse, ma un unico obiettivo: trasformare lo smartphone da terminale di app a interfaccia intelligente personale. Il mercato mobile si prepara a una nuova fase. Dopo anni di innovazioni incrementali su fotocamere, display e batterie, l’AI diventa il nuovo elemento differenziante. Gli utenti non cercano solo più potenza, ma dispositivi capaci di comprendere contesto, intenzioni e preferenze. La sfida sarà trasformare questa promessa in esperienze concrete, senza consumare troppa energia, senza generare frustrazione e senza compromettere la privacy.

Il 2028 può aprire una nuova generazione di hardware AI

Il possibile lancio dello smartphone OpenAI nel 2028 crea una finestra importante per tutto il settore. Entro quella data, i chip mobile saranno più efficienti, i modelli locali più piccoli e potenti, e gli utenti più abituati a interagire con assistenti AI. La competizione non sarà solo tra telefoni, ma tra architetture: AI cloud, AI on-device, sistemi ibridi e interfacce ambientali. MediaTek, Qualcomm, Luxshare, Google e Apple diventano tasselli di una stessa trasformazione industriale. Il valore non dipenderà più solo dal sistema operativo o dal design fisico, ma dalla capacità di orchestrare modelli, dati, sensori e servizi. In questo scenario, lo smartphone AI non è un nuovo gadget, ma una piattaforma capace di ridefinire relazione tra utente, dispositivo e cloud.

L’intelligenza artificiale diventa il nuovo sistema operativo dell’esperienza utente

Il punto comune tra le tre mosse è che l’AI sta diventando il vero strato operativo dell’esperienza digitale. Gemini non è solo un’app, Apple Intelligence non è solo una funzione e lo smartphone di OpenAI non sarebbe solo un telefono. Tutti questi progetti indicano una direzione in cui l’intelligenza artificiale gestisce contesto, azioni, suggerimenti, automazioni e interazioni naturali. Questa evoluzione sposta la competizione dai singoli prodotti agli ecosistemi intelligenti. Chi controlla l’assistente controlla il modo in cui l’utente cerca informazioni, scrive, comunica, lavora, fotografa, compra e usa servizi digitali. Per questo OpenAI, Google e Apple stanno accelerando contemporaneamente. La prossima generazione di smartphone non sarà definita solo da processore, display o fotocamera, ma dalla qualità dell’intelligenza integrata nel dispositivo.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.