Le minacce informatiche legate all’intelligenza artificiale continuano a evolversi rapidamente e colpiscono sia utenti Mac sia sviluppatori che eseguono modelli AI in locale. Nuove campagne malware sfruttano Google Ads, chat manipolate su ClaudeAI e repository falsi su Hugging Face per distribuire infostealer e backdoor su macOS, mentre una vulnerabilità critica in Ollama, chiamata Bleeding Llama, consente fughe di memoria che espongono dati sensibili. La CISA ha già inserito una delle vulnerabilità nel proprio catalogo degli exploit attivamente utilizzati in natura. Gli attaccanti sfruttano la fiducia crescente nelle piattaforme AI più popolari per convincere le vittime a scaricare modelli, tool e aggiornamenti apparentemente legittimi. Le conseguenze includono furto di credenziali, wallet crypto, chiavi API e dati aziendali. Gli eventi del maggio 2026 mostrano chiaramente come l’ecosistema AI sia diventato un nuovo terreno di attacco dove social engineering, repository open source e vulnerabilità tecniche si combinano in campagne molto sofisticate.

Cosa leggere

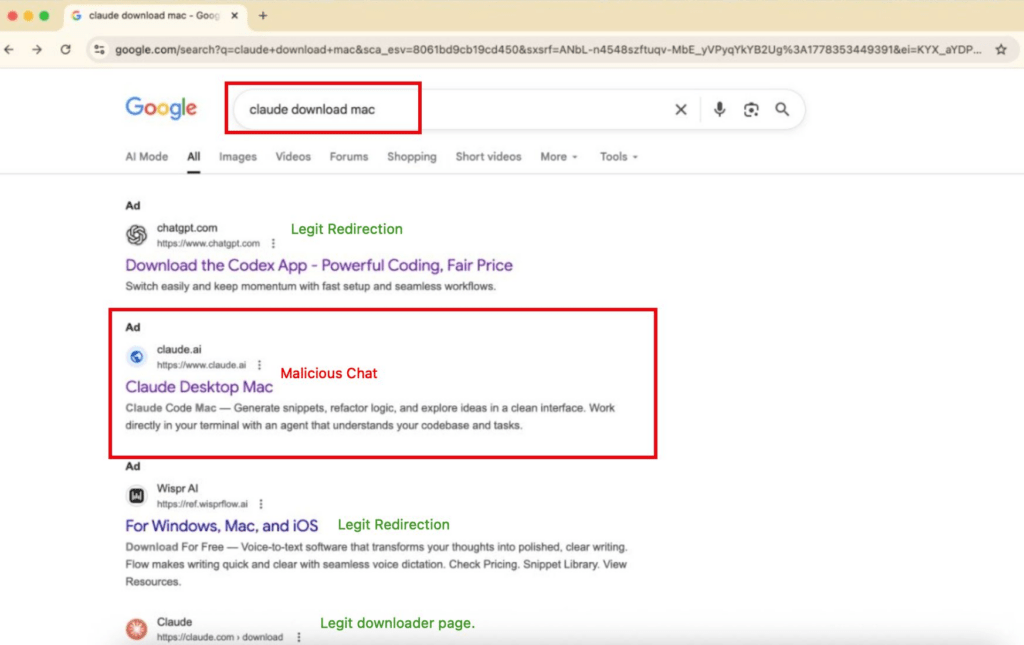

Hacker usano Google Ads e ClaudeAI per distribuire malware su Mac

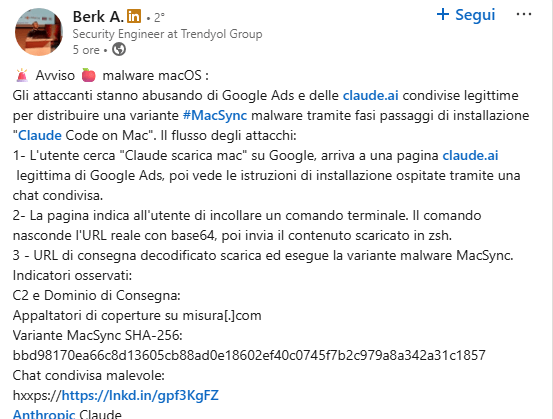

Gli attaccanti stanno pubblicando annunci sponsorizzati tramite Google Ads che promettono strumenti AI, aggiornamenti software o utility per produttività. Gli utenti che cliccano vengono reindirizzati verso conversazioni manipolate all’interno di ClaudeAI, la piattaforma AI di Anthropic. Qui un bot o un operatore umano convince la vittima a scaricare un pacchetto apparentemente innocuo. Il malware identificato come MacSync si installa silenziosamente su macOS e inizia a raccogliere password, cookie di sessione, credenziali e dati di autenticazione. La campagna combina social engineering avanzato con advertising mirato, colpendo utenti già interessati all’intelligenza artificiale. ClaudeAI viene sfruttato perché molte persone si fidano della piattaforma e non sospettano che una chat possa diventare un vettore di attacco. Gli aggressori simulano assistenza tecnica, setup di modelli AI o download ottimizzati per convincere le vittime ad abbassare le difese.

MacSync ruba password, cookie e dati sensibili

Una volta eseguito, il malware MacSync stabilisce una connessione con server di comando e controllo remoti e inizia l’esfiltrazione dei dati raccolti dal sistema. Gli attaccanti puntano soprattutto a cookie browser, password salvate, sessioni autenticative e wallet crypto. Il malware sfrutta la fiducia nella piattaforma AI per bypassare molte difese tradizionali basate sul sospetto dell’utente. Le vittime spesso non si accorgono dell’infezione fino alla comparsa di accessi non autorizzati o furti di account. Questo tipo di attacco dimostra come le piattaforme AI stiano diventando nuovi canali di distribuzione malware estremamente efficaci. Gli utenti Mac rappresentano un target sempre più appetibile perché molti sviluppatori e professionisti AI utilizzano macOS come ambiente principale di lavoro.

Repository falsi OpenAI su Hugging Face diffondono infostealer

Parallelamente cresce il numero di repository malevoli su Hugging Face che imitano progetti ufficiali OpenAI. Gli attaccanti caricano modelli AI o script apparentemente legittimi ma contenenti infostealer nascosti. Gli utenti che scaricano ed eseguono questi pacchetti in locale attivano inconsapevolmente malware progettati per estrarre chiavi API, credenziali e dati sensibili dal sistema. Uno dei repository identificati, chiamato Open-OSS Privacy Filter, è risultato contenere payload malevoli. La ricerca di HiddenLayer ha confermato che alcuni repository trending ospitavano codice infetto. L’attacco sfrutta la fiducia della community open source e la popolarità di Hugging Face come piattaforma centrale per la distribuzione di modelli AI. Molti sviluppatori scaricano rapidamente nuovi modelli senza verificare in modo approfondito l’identità del maintainer o l’integrità del codice.

Hugging Face diventa un vettore ideale per malware AI

La struttura aperta di Hugging Face rende la piattaforma particolarmente attraente per gli attaccanti. I repository possono raggiungere rapidamente migliaia di utenti tecnici interessati a testare nuovi modelli AI. Gli infostealer si attivano durante l’esecuzione del modello o dello script associato e inviano i dati rubati a server remoti controllati dagli aggressori. Hugging Face ha già rimosso diversi repository sospetti, ma la campagna continua attraverso nuovi cloni caricati con nomi molto simili ai progetti originali. Questo fenomeno dimostra come la supply chain dell’intelligenza artificiale stia diventando un obiettivo strategico per il cybercrime. Gli attaccanti sfruttano la velocità della community open source e la forte domanda di nuovi modelli AI per diffondere malware in modo estremamente rapido.

Bleeding Llama colpisce Ollama con memory leak critico

La piattaforma Ollama, oggi tra le più utilizzate per eseguire modelli linguistici in locale, soffre di una vulnerabilità critica chiamata Bleeding Llama. Il difetto consiste in un out-of-bounds read accompagnato da un grave memory leak che permette agli attaccanti di leggere memoria arbitraria del processo Ollama. La vulnerabilità può esporre chiavi API, prompt privati, dati di inferenza e altre informazioni sensibili presenti in memoria. I ricercatori di Cyera hanno identificato il problema durante l’analisi del parser utilizzato per il caricamento di alcuni modelli. Gli aggressori possono preparare file malevoli che, una volta caricati, attivano la lettura non autorizzata della memoria del sistema. La gravità del problema è stata confermata dalla CISA, che ha aggiunto la vulnerabilità al catalogo Known Exploited Vulnerabilities il 8 maggio 2026.

La CISA conferma exploit attivi contro Ollama

L’inserimento di Bleeding Llama nel catalogo KEV della CISA indica che exploit attivi sono già utilizzati in natura. Questo significa che gli attaccanti stanno probabilmente sfruttando la vulnerabilità contro ambienti reali di sviluppo AI e server locali.

CVE-2026-42208 BerriAI LiteLLM SQL Injection Vulnerability

Gli utenti che eseguono LLM in locale tramite Ollama diventano così bersagli privilegiati. Il problema colpisce workstation, server domestici e ambienti aziendali che utilizzano modelli AI locali per inferenza o sviluppo. Gli sviluppatori devono aggiornare immediatamente alle versioni patchate e verificare l’origine dei modelli caricati. L’attacco dimostra inoltre che i sistemi AI locali non sono immuni dalle classiche vulnerabilità di memoria che storicamente hanno colpito software complessi e parser di file.

Le campagne AI combinano social engineering ed exploit tecnici

Le campagne osservate nel maggio 2026 mostrano una convergenza sempre più evidente tra tecniche tradizionali di cybercrime e infrastrutture AI moderne. Gli annunci Google Ads e le chat ClaudeAI manipolate si basano soprattutto su ingegneria sociale avanzata. I repository falsi su Hugging Face sfruttano invece la fiducia nella community open source. La vulnerabilità Bleeding Llama rappresenta infine un exploit tecnico puro che permette accesso diretto alla memoria del processo. Gli attaccanti combinano questi approcci per massimizzare la copertura: advertising per attirare le vittime, repository per colpire sviluppatori e vulnerabilità per ottenere accesso profondo ai sistemi. Questo mix rende la difesa molto più complessa rispetto alle campagne malware tradizionali.

Gli utenti Mac e gli sviluppatori AI sono i bersagli principali

Gli utenti macOS rappresentano un target strategico perché molti professionisti AI, sviluppatori e creator utilizzano Mac come piattaforma principale. Gli attaccanti sfruttano il crescente interesse verso tool AI locali, modelli open source e automazione per distribuire malware altamente mirato. Gli sviluppatori che testano modelli tramite Ollama rischiano inoltre di esporre dati aziendali sensibili, prompt proprietari o credenziali API. Le aziende che adottano AI locale devono quindi rafforzare i controlli di sicurezza attorno ai modelli scaricati e ai repository utilizzati internamente. Le difese tradizionali spesso non riescono a rilevare questi attacchi perché il codice malevolo si nasconde dentro modelli apparentemente legittimi.

Come proteggersi da malware AI e repository infetti

Gli utenti devono evitare download diretti provenienti da annunci sponsorizzati e verificare sempre l’autenticità dell’URL di origine. Su macOS è fondamentale mantenere aggiornati Gatekeeper, XProtect e tutti i sistemi di sicurezza integrati. Gli utenti di Ollama dovrebbero scaricare modelli soltanto da fonti ufficiali e verificare hash e firme digitali. Gli sviluppatori devono utilizzare sandbox o ambienti virtuali isolati per testare modelli AI esterni. Le organizzazioni dovrebbero adottare policy zero-trust per i tool AI locali e monitorare il traffico di rete per identificare comunicazioni sospette con server remoti. Anche la formazione sulla sicurezza AI diventa essenziale per riconoscere tecniche di social engineering sempre più sofisticate.

L’ecosistema AI diventa il nuovo fronte del cybercrime

Le campagne contro ClaudeAI, Hugging Face e Ollama mostrano un trend ormai chiaro: gli attaccanti stanno integrando piattaforme AI legittime nei propri toolkit offensivi. La popolarità di questi servizi li trasforma automaticamente in target privilegiati per malware, phishing e supply chain attack. Le vulnerabilità nei tool AI locali aprono inoltre scenari molto delicati per aziende e sviluppatori. L’ecosistema AI aperto porta enormi vantaggi in termini di innovazione ma introduce anche superfici di attacco completamente nuove. La sicurezza futura dipenderà dalla collaborazione continua tra vendor, community open source, ricercatori e autorità come la CISA. Gli utenti dovranno abituarsi a verificare costantemente modelli, repository e piattaforme AI con la stessa attenzione oggi riservata ai software tradizionali.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.