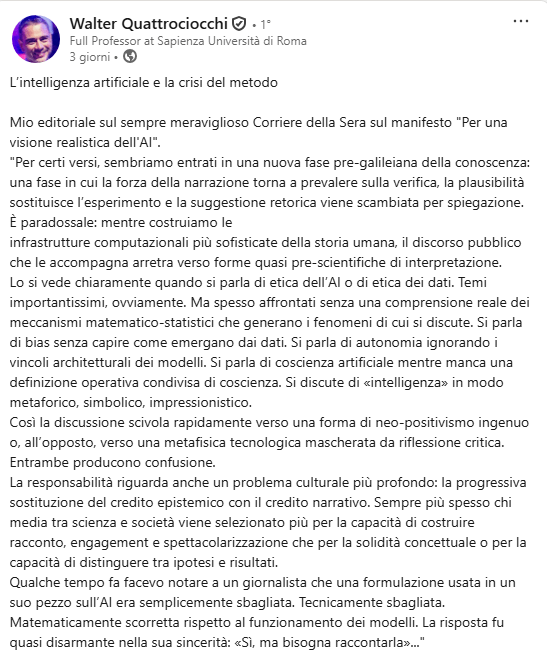

La proposta lanciata da Walter Quattrociocchi su LinkedIn non è soltanto una presa di posizione accademica sull’intelligenza artificiale. È un terremoto metodologico dentro un dibattito pubblico che per anni ha preferito la postura alla verifica, la morale alla tecnica, la suggestione alla struttura. Nei post pubblicati negli ultimi giorni, Quattrociocchi ha richiamato il manifesto “Per una visione realistica dell’intelligenza artificiale”, denunciando un discorso pubblico dominato da antropomorfismi, slogan, metafore e performance retoriche scollegate dal rigore dei problemi reali. Il punto centrale è netto: l’intelligenza artificiale non va raccontata come magia, coscienza o volontà autonoma, ma come tecnologia statistica, linguistica, probabilistica e infrastrutturale, con limiti precisi e responsabilità umane precise.

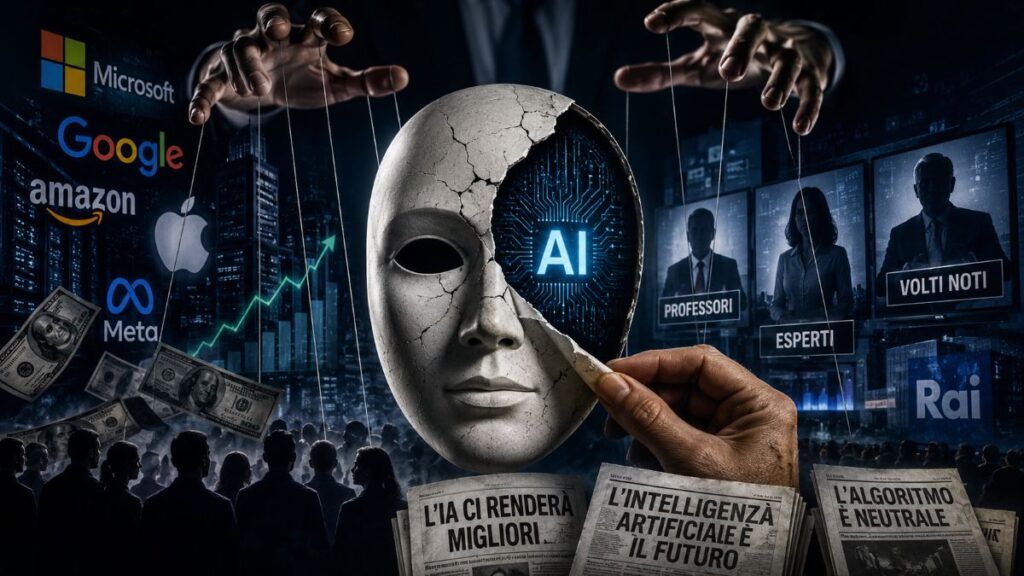

Per Matrice Digitale, però, questa presa di posizione arriva dentro una traiettoria già aperta da quasi due anni. Il tema non è soltanto chi abbia ragione oggi. Il tema è chi ha costruito, favorito o tollerato una narrazione pubblica dell’IA che ha finito per spostare l’attenzione dalle criticità reali: infrastrutture, mercato, cloud, lavoro, editoria, dipendenza dalle piattaforme, censura algoritmica, governance industriale, ruolo delle multinazionali e selezione dei volti autorizzati a parlare in televisione. È lo stesso nodo già emerso nell’inchiesta su Walter Veltroni e Claude, dove l’intervista a un modello linguistico ha mostrato il vuoto italiano più che la potenza dell’IA: un Paese che trasforma il chatbot in personaggio pubblico prima ancora di avere compreso cosa sia davvero un modello generativo. Il cortocircuito nasce qui. Da un lato, una parte del mondo accademico chiede di riportare il dibattito sull’intelligenza artificiale dentro il perimetro del metodo. Dall’altro lato, per anni, una parte dell’ecosistema mediatico, istituzionale e televisivo ha preferito costruire figure simboliche, interpreti morali e sacerdoti civili dell’algoritmo. Il risultato è stato un racconto dell’IA in cui la parola etica ha spesso funzionato come copertura narrativa. Non perché l’etica sia inutile, ma perché, quando viene separata dalla conoscenza tecnica e dagli interessi materiali, rischia di diventare il linguaggio più elegante per non parlare di potere.

Cosa leggere

La proposta di Walter Quattrociocchi e la crisi del metodo

Il merito della posizione di Walter Quattrociocchi è di avere colpito il centro del problema: il dibattito pubblico italiano sull’intelligenza artificiale si è riempito di parole solenni, ma spesso è rimasto povero di strumenti interpretativi. Si parla di macchine che “pensano”, di sistemi che “mentono”, di modelli che “capiscono”, di algoritmi che “decidono”, ma troppo raramente si spiega al pubblico che cosa questi sistemi fanno davvero. Un large language model non costruisce conoscenza come un essere umano. Non osserva il mondo, non ha intenzioni, non possiede esperienza, non esercita giudizio morale. Produce sequenze linguistiche plausibili sulla base di correlazioni statistiche. Questa distinzione non è una finezza accademica. È il punto su cui si regge l’intero dibattito. Se i media raccontano l’IA come un soggetto autonomo, finiscono per deresponsabilizzare chi la progetta, chi la vende, chi la integra nei servizi pubblici, chi la impone nei processi aziendali e chi la usa per sostituire lavoro umano. Se invece l’IA viene raccontata come infrastruttura tecnica, allora emergono le vere domande che Matrice Digitale pone da anni:

chi possiede i modelli, chi controlla i dati, chi finanzia la ricerca, chi seleziona gli esperti, chi stabilisce le regole, chi guadagna dalla narrazione e chi paga il costo sociale dell’automazione.

È qui che il manifesto richiamato da Quattrociocchi diventa politicamente rilevante. Non perché introduca un tema nuovo, ma perché porta dentro il mainstream accademico una frattura che Matrice Digitale aveva già denunciato: l’Italia ha confuso la narrazione dell’intelligenza artificiale con la comprensione dell’intelligenza artificiale. E quando una società confonde il racconto con la realtà, la tecnologia diventa terreno ideale per operazioni di potere.

L’etica dell’IA come racconto di potere

La parola etica è stata per anni il grande passepartout del dibattito italiano sull’intelligenza artificiale. Ha consentito a figure accademiche, religiose, editoriali e istituzionali di entrare nei tavoli decisionali senza dover sempre affrontare la sostanza industriale del problema. Matrice Digitale lo ha già scritto nell’inchiesta Il cappellano dell’algoritmo: l’illusione dell’IA etica e l’azione del Vaticano sulle Big Tech, dove il ruolo di Paolo Benanti viene letto dentro una zona grigia fatta di convegni, università, giornali, apparati morali, Vaticano, Big Tech e capitale strategico. In quella ricostruzione, l’etica dell’IA non appare come un argine, ma come un linguaggio di compatibilità con i centri del potere tecnologico. Il nodo non è personale, ma sistemico. Paolo Benanti è diventato una figura centrale perché incarna una funzione: tradurre una partita economica, militare, industriale e geopolitica nel linguaggio della responsabilità morale. Questa funzione può essere utile se illumina le contraddizioni. Diventa problematica se le addomestica. Perché mentre si parla di principi, dignità umana e centralità della persona, le multinazionali costruiscono modelli sempre più grandi, i governi cercano vantaggi strategici, gli editori perdono controllo sulla distribuzione, i lavoratori vedono automatizzate funzioni cognitive e la televisione pubblica seleziona i propri interlocutori non sempre sulla base della profondità tecnica. Il rischio è che l’etica diventi un dispositivo di rassicurazione. Una cornice nobile dentro cui non si affrontano davvero le domande più scomode.

Chi finanzia l’ecosistema dell’IA? Quali università ricevono fondi dalle piattaforme? Quali centri di ricerca stringono accordi con le stesse aziende che dovrebbero essere analizzate criticamente? Quali giornalisti, professori e divulgatori entrano stabilmente nei circuiti televisivi? Quali interessi editoriali, politici e commerciali si muovono dietro la scelta degli esperti?

Rai, televisione pubblica e selezione degli esperti

Il caso più delicato riguarda la Rai. La televisione pubblica dovrebbe essere il luogo più rigoroso nella selezione delle competenze su temi ad alto impatto sociale. Eppure, nella narrazione italiana dell’intelligenza artificiale, il servizio pubblico ha spesso replicato dinamiche tipiche della televisione commerciale: volti ricorrenti, formule semplificate, narrazioni spettacolari, ospiti scelti per riconoscibilità più che per capacità di entrare nel merito tecnico. Il problema non è chiedere alla televisione di trasformarsi in un seminario universitario. Il problema è evitare che un tema come l’intelligenza artificiale venga spiegato con la stessa logica con cui si costruisce un talk politico: contrapposizioni facili, autorità simboliche, figure di sistema, personaggi presentabili e nessuna vera verifica delle filiere di interesse. Quando l’IA viene raccontata male dalla televisione pubblica, il danno non è solo culturale. È democratico, perché il cittadino viene privato degli strumenti minimi per capire una tecnologia che condizionerà lavoro, informazione, pubblica amministrazione, sanità, sicurezza e scuola. In questo quadro si inserisce anche il precedente analizzato da Matrice Digitale nell’articolo AGCOM porta Google in Europa per l’IA, ma il modello è già al collasso, dove la crisi dell’editoria italiana viene letta insieme alla dipendenza da Google, agli AI Overviews e al ruolo sempre più opaco delle piattaforme nella distribuzione della conoscenza. Qui il punto torna identico: chi controlla l’accesso all’informazione controlla anche la percezione pubblica dell’intelligenza artificiale.

Benanti, Riotta e la filiera italiana della legittimazione

Dentro questa filiera emergono nomi che Matrice Digitale ha già analizzato: Paolo Benanti, Gianni Riotta, Alberto Barachini, la Luiss, il circuito del fact-checking, le commissioni sull’IA e l’editoria, i rapporti con le piattaforme, le logiche di accreditamento istituzionale. Nell’articolo Meta addio al fact-checking, ma l’Italia resta sotto censura, Matrice Digitale ha ricostruito il cortocircuito tra Riotta, Benanti, Luiss, shadow ban, fact-checking e rapporti con il sistema Google News, sottolineando come alcuni protagonisti del discorso pubblico sulla verità digitale siano stati premiati da spazi televisivi e incarichi proprio mentre altri soggetti critici venivano marginalizzati. Il punto non è costruire un processo sommario contro le persone. Il punto è capire la struttura.

Quando gli stessi ambienti che discutono di etica, disinformazione, censura, fact-checking e intelligenza artificiale occupano contemporaneamente università, commissioni, giornali, televisione pubblica e reti internazionali, il problema del conflitto di interesse diventa politico prima ancora che personale.

Lo stesso tema era già emerso nell’articolo Salta accordo tra Mediaset e Repubblica per il Ministero della Verità?, dove Matrice Digitale aveva collegato la nomina di Benanti, il ruolo di Riotta, il comitato sull’intelligenza artificiale dell’editoria e le tensioni tra gruppi mediatici. Anche lì, il problema non era l’esistenza di una commissione in sé, ma la domanda su chi avesse titolo, indipendenza e competenza per decidere la cornice pubblica dell’IA in Italia.

Il precedente del Covid e il fallimento della narrazione tecnico-scientifica

La vicenda dell’intelligenza artificiale ricorda, per molti aspetti, il fallimento della narrazione pubblica durante il Covid. Anche allora, il sistema mediatico ha trasformato questioni complesse in formule televisive, ha promosso esperti ricorrenti, ha ridotto il dissenso a patologia comunicativa e ha spesso confuso la scienza con la comunicazione istituzionale della scienza. Anche allora, alcuni interessi commerciali e accademici si sono intrecciati con il racconto pubblico. Anche allora, il cittadino ha faticato a distinguere tra prudenza scientifica, propaganda, marketing farmaceutico, responsabilità pubblica e opportunismo mediatico. Oggi il rischio si ripete sull’IA. Il linguaggio cambia, ma la dinamica resta simile. Prima si costruisce una narrazione dominante. Poi si delegittima chi solleva dubbi. Infine, quando i rischi diventano evidenti, si riassorbe la critica dentro il circuito ufficiale, trasformandola in nuova postura accettabile. È quello che accade quando temi ignorati per anni diventano improvvisamente centrali solo perché una parte autorevole dell’accademia decide di dirli con la forza necessaria. La differenza è che sull’intelligenza artificiale il problema rischia di essere ancora più profondo. Il Covid riguardava un’emergenza sanitaria. L’IA riguarda l’infrastruttura cognitiva della società. Significa informazione, lavoro, ricerca, scuola, guerra, sorveglianza, pubblicità, contenuti, archivi, memoria, linguaggio. Se la narrazione pubblica dell’IA viene catturata, non viene catturata solo una tecnologia. Viene catturato il modo in cui la società interpreta la realtà.

Dalla disinformazione all’epistemia

Il lavoro di Quattrociocchi si inserisce in un filone più ampio che Matrice Digitale ha già seguito nell’analisi L’Europa scopre la realtà frammentata e punta il dito contro piattaforme, algoritmi e sovranità digitale. In quel caso, il documento europeo firmato anche da Quattrociocchi veniva letto come un atto d’accusa contro l’ecosistema delle piattaforme: non semplici contenitori di contenuti, ma architetture che organizzano visibilità, premiano conflitto, polarizzazione e messaggi emotivi, fino a spezzare la realtà condivisa in realtà concorrenti. La stessa logica vale per l’IA generativa. Il problema non è solo che un modello possa sbagliare. Il problema è che il modello produce un testo formalmente credibile anche quando non possiede alcun giudizio epistemico. Matrice Digitale lo ha spiegato nell’articolo Umani vs LLM: le 7 linee di faglia epistemologiche, dove viene introdotto il concetto di Epistemia: una condizione in cui la plausibilità linguistica sostituisce la giustificazione, creando l’impressione di sapere anche quando manca il lavoro reale del giudizio.

Ecco perché la battaglia di Quattrociocchi è importante. Non perché risolva tutto, ma perché costringe il dibattito a tornare sul terreno del metodo. Un terreno molto più scomodo della morale generica. Parlare di metodo significa chiedere prove, definizioni, limiti, responsabilità, competenze, finanziamenti, verificabilità. Parlare solo di etica, invece, può diventare un modo per restare nel vago e continuare a occupare il centro della scena.

Il coraggio tardivo del mondo accademico

La parte più interessante della vicenda è il comportamento del mondo accademico italiano. Molti ricercatori e professori sapevano da tempo che la narrazione dominante sull’IA era debole, semplificata, spesso fuorviante. Molti conoscevano i limiti tecnici dei modelli linguistici. Molti avevano gli strumenti per contestare la retorica dell’IA senziente, dell’algoritmo morale, della macchina quasi umana. Eppure, per lungo tempo, pochi hanno scelto di esporsi con forza nel dibattito pubblico. Qui sta il punto politico. In Italia l’accademia è spesso fortissima nella ricerca e debolissima nella battaglia pubblica. Produce competenza, ma lascia ad altri il racconto. Studia i fenomeni, ma arriva tardi nella disputa mediatica. Quando poi una figura come Quattrociocchi rompe il recinto, molti si accodano, altri aspettano di capire dove tira il vento, altri ancora cercano di riposizionarsi senza pagare il prezzo del conflitto. Questo non cancella il valore del manifesto. Al contrario, lo rende ancora più significativo. Ma impone una domanda:

il nuovo fronte realistico sull’IA sarà davvero indipendente dalle grandi piattaforme, dai finanziamenti privati, dai circuiti editoriali e dagli interessi geopolitici, oppure diventerà l’ennesima cornice accademica utile a ripulire un sistema già deciso altrove?

Cosa Matrice Digitale aveva già denunciato

Sono passati ormai quasi due anni da quando Matrice Digitale ha denunciato l’inconsistenza di alcune narrazioni sull’intelligenza artificiale. Quelle narrazioni portavano verso un racconto che non corrispondeva alla realtà tecnica, industriale e sociale della tecnologia. Sollevare problemi sull’etica dell’intelligenza artificiale non ha sempre aiutato a chiarire il quadro. In molti casi, ha finito per distogliere l’attenzione dalle criticità reali ed effettive. Il problema è che una narrazione sull’etica, che dovrebbe essere persino più super partes della morale, ha spesso nascosto lati non propriamente etici in favore di una strategia più politica. La questione singolare è che, proprio nell’ultimo periodo, la televisione pubblica italiana ha preferito affidare il racconto dell’intelligenza artificiale a persone ancora in erba o a divulgatori che, tecnicamente, non sempre hanno dimostrato le competenze necessarie per leggere, selezionare e comunicare le notizie davvero rilevanti per il pubblico.

L’autorevolezza autoreferenziata

Il problema della televisione pubblica emerge anche dalla lettera firmata da ricercatori, attivisti, lavoratori del mondo ICT e persone interessate agli aspetti dell’intelligenza artificiale. La domanda diventa inevitabile: chi ha diritto a parlare di intelligenza artificiale? Dal punto di vista della televisione pubblica, alcuni soggetti vengono favoriti per i loro rapporti con grandi colossi industriali, con ambienti accademici, con circuiti editoriali e con autori che decidono la produzione televisiva. Esiste poi un altro fattore da considerare: un interesse particolare di natura commerciale o politica.

Quando si parla di una produzione di questo tipo, non può che emergere la figura della commissione sull’intelligenza artificiale costituita in seno all’editoria, composta da soggetti noti nell’ambiente e percepiti come antitesi del manifesto oggi richiamato da Quattrociocchi. Da una parte c’è la linea dell’etica dell’intelligenza artificiale rappresentata da Paolo Benanti. Dall’altra parte c’è la presenza di un giornalista politicizzato come Gianni Riotta, a capo della scuola di giornalismo di un’università privata come la Luiss. C’è inoltre una figura controversa nel mondo della divulgazione, Barbara Gallavotti, ospite ricorrente da Giovanni Floris, che ha già mostrato durante il Covid cortocircuiti narrativi e divulgativi nella comunicazione del virus.

Il punto non è costruire un tribunale personale. Il punto è osservare una macchina ben rodata, capace di rispondere alle esigenze di una narrazione non solo statale, ma anche vicina, per possibili conflitti d’interesse, a potentati stranieri e internazionali. La Rai, televisione pubblica, dovrebbe essere super partes su tematiche così delicate. Invece rischia spesso di cadere nella logica di una televisione commerciale, dove chi ha più potere occupa le caselle più visibili. Questa condizione obbliga a riflettere su un altro aspetto. Negli anni si è parlato di determinate tematiche in modo frenetico, spesso schizzinoso, con valori prima smentiti e poi confermati sulla base delle narrazioni del momento. Quando qualcuno dall’esterno indicava un rischio possibile, quel rischio veniva ignorato fino a quando esplodeva. A quel punto, lo stesso rischio diventava materiale per costruire la lettura istantanea del momento. Anche dal punto di vista dell’analisi, quindi, ci sono stati buchi evidenti. La selezione degli esperti televisivi non è mai passata da una graduatoria, da una classifica verificabile o da un bando pubblico. Si è sviluppata spesso sulla base di pressioni, amicizie, relazioni interne alle redazioni e logiche autoriali della televisione pubblica. Matrice Digitale è stata tra le prime testate a sollevare questo problema, non per autoreferenzialità, ma perché ha sempre analizzato i flussi di informazione, le criticità reali del mercato e le distorsioni del racconto pubblico senza peli sulla lingua. Quello che sta succedendo sull’intelligenza artificiale potrebbe replicare ciò che è accaduto durante il Covid:

un fallimento della narrazione giornalistica e medico-scientifica, poi riletto a posteriori come se fosse stato inevitabile. Il tempo sta mostrando quanto quella narrazione fosse critica, orientata, segnata anche da interessi commerciali riferiti al mondo accademico e farmaceutico.

La rivoluzione epistemica è promossa dalle BigTech?

Lo stesso rischio può svilupparsi nella narrazione dell’intelligenza artificiale, dove Matrice Digitale spera che le ingerenze delle multinazionali tecnologiche non siano capaci di modellare anche lo spirito critico emerso dietro la figura di Walter Quattrociocchi. Quattrociocchi ha avuto il merito di esporsi su LinkedIn contro l’insussistenza di una regola che per mesi e anni si era insinuata per motivi papali, vaticani e di promozione degli interessi legati all’etica dell’intelligenza artificiale. Ma proprio qui si accende un ulteriore campanello d’allarme. Oltre a contestare la narrazione dominante, che cosa garantisce la genuinità delle idee del nuovo zoccolo duro di ricercatori? L’università a cui appartiene Quattrociocchi rientra, secondo la lettura critica da verificare nel tempo, dentro rapporti e finanziamenti legati a grandi attori tecnologici come Google per lo studio dell’intelligenza artificiale.

Questi ricercatori hanno tutto il diritto di stringere accordi con chi vogliono. Ma i dati, le relazioni e le collaborazioni servono a muovere una massa illuminata in favore del mondo accademico italiano oppure rischiano di diventare il solito contenitore utile alle multinazionali per intercettare eccellenze, algoritmi, competenze e intelligenze vive della ricerca nazionale?

Sono interrogativi legittimi, perché mettono dinanzi a scenari molto interessanti.

La ragion pura dell’AI

C’è poi un’altra analisi da fare: il mondo accademico non può limitarsi a denunciare le criticità filosofiche ed etiche dell’IA senza considerare le criticità materiali. Il rischio nasce quando ci si sposta verso la legge della scienza intesa come ottimizzazione tecnica lineare, senza valutare le conseguenze alternative. L’esempio più pratico riguarda la necessità di non essere troppo fedeli agli input degli algoritmi quando questi toccano guerra, sostenibilità ambientale, selezione sociale, decisioni pubbliche o priorità collettive. I casi da non ignorare sono quelli in cui l’intelligenza artificiale detta delle regole e quelle regole vengono applicate come verità perché “lo dicono i dati”. Ma i dati non sono neutrali. I dati sono raccolti, selezionati, pesati, filtrati, interpretati. Un algoritmo può produrre una soluzione efficiente e allo stesso tempo moralmente mostruosa.

Se un sistema suggerisse, per assurdo, che per risolvere il cambiamento climatico bisognerebbe ridurre drasticamente la popolazione umana e piantare più alberi, gli accademici rigorosi e puri guidati da Quattrociocchi sarebbero d’accordo oppure no?

La provocazione serve a mostrare il limite della pura ottimizzazione.

Accademici ignavi o sotto ricatto?

È qui che bisogna accendere un faro anche sul coraggio di Quattrociocchi. In un momento storico in cui contestare la narrazione distorta dell’etica dell’intelligenza artificiale significava andare contro il “divino” tecnologico, contro il padre, il figlio e lo spirito santo della narrazione dominante, Quattrociocchi ha scelto di esporsi. Ha fatto emergere il ruolo di un accademico che ha iniziato una battaglia di metodo in un contesto in cui molti altri si sono nascosti dietro di lui, aspettando di capire se posizionarsi al meglio o attendere che cadesse sotto i colpi della narrazione e dei suoi interessi. Questo aspetto fa emergere il ruolo di una classe dirigente accademica che, pur avendo una posizione solida, sembra spesso attendere il carro del vincitore ed ha consentito che il più alto esponente di Governo sull’AI ai tavoli ministeriali e all’ONU non fosse nemmeno italiano. Non tanto sulla base delle proprie convinzioni, quanto sulla base dei propri interessi o della volontà di non avere fastidi quando il potere cambia geometria. È una regola non scritta delle architetture del mondo accademico italiano. Matrice Digitale monitorerà costantemente le tattiche, i segnali e i risvolti di questa nuova narrazione nei prossimi anni. Ma su un dato si può essere d’accordo: Walter Quattrociocchi ha centrato il punto e ha avuto la forza e l’autorevolezza che Matrice Digitale non ha avuto in questi anni solo perché ignorata da colleghi interessati a promuovere una narrazione sbagliata o frenata dalla paura di fonti che hanno preferito restare nell’ombra. In questo senso, va dato atto a Quattrociocchi di avere aperto in Italia un modo nuovo di intendere l’intelligenza artificiale. Resta da capire se questo nuovo metodo riuscirà davvero a restare indipendente dalla volontà delle multinazionali tecnologiche, sempre più desiderose di colonizzare interi territori cognitivi, accademici e politici attraverso logiche predatorie a basso costo.

Perché il vero problema dell’intelligenza artificiale non è soltanto ciò che la macchina produce. È ciò che gli uomini costruiscono intorno alla macchina per governare gli altri uomini.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.